ホームページ >テクノロジー周辺機器 >AI >Meta のオープンソース ChatGPT の代替品は使いやすいですか?テスト結果と修正方法を公開、2日で5.2kスター

Meta のオープンソース ChatGPT の代替品は使いやすいですか?テスト結果と修正方法を公開、2日で5.2kスター

- PHPz転載

- 2023-04-11 22:25:011315ブラウズ

ChatGPT の継続的な人気により、大手テクノロジー企業は長い間休むことができませんでした。

つい先週、Meta は新しい大規模モデル シリーズを「オープンソース」化しました—— LLaMA (Large Language Model Meta AI)、パラメータの数は 70 億から 650 億の範囲に及びます。 LLaMA は、これまでにリリースされた多くの大型モデルよりもパラメータが少ないものの、パフォーマンスが優れているため、リリース時には多くの研究者が興奮しました。

たとえば、130 億パラメータの LLaMA モデルは、「ほとんどのベンチマークで」1750 億パラメータの GPT-3 を上回るパフォーマンスを示し、単一の V100 GPU で実行できます。65 個のパラメータを備えた最大の LLaMA モデルです。 10 億のパラメータは、Google の Chinchilla-70B や PaLM-540B に匹敵します。

パラメータの数が減るのは一般の研究者や営利団体にとっては良いことですが、LLaMA は本当に論文どおりのパフォーマンスを発揮するのでしょうか?現在の ChatGPT と比較すると、LLaMA はかろうじて競合できるでしょうか?これらの質問に答えるために、一部の研究者はこのモデルをテストしました。

一部の企業はすでに LLaMA の欠点を補おうとしており、RLHF などのトレーニング方法を追加することで LLaMA のパフォーマンスを向上させることができるかどうかを確認したいと考えています。

LLaMA 予備レビュー

このレビューは @En Ryu という名前の Medium 著者からのものです。ここでは、ジョーク解釈、ゼロショット分類、コード生成という 3 つの困難なタスクにおける LLaMA と ChatGPT のパフォーマンスを比較しています。関連するブログ記事は「ミニ投稿:LLaMA初見」です。

作者は、RTX 3090/RTX 4090 で LLaMA 7B/13B バージョンを実行し、単一の A100 で 33B バージョンを実行しています。

ChatGPT とは異なり、他のモデルは命令の微調整に基づいていないため、プロンプトの構造が異なることに注意してください。

ジョークの説明

これは、Google のオリジナルの PaLM 論文に示されている使用例です。なぜ面白いのかを説明するモデル。このミッションには世界の知識と基本的なロジックの組み合わせが必要です。 PaLM より前のすべてのモデルではこれができませんでした。著者らは、PaLM の論文からいくつかの例を抽出し、LLaMA-7B、LLaMA-13B、LLaMA-33B のパフォーマンスを ChatGPT と比較しました。

#ご覧のとおり、結果はひどいものです。これらのモデルは笑いを誘いますが、実際には理解していません。関連するテキストのストリームをランダムに生成しているだけです。 ChatGPT のパフォーマンスは LLaMA-33B と同じくらい悪いですが (他のいくつかのモデルはさらに悪い)、別の戦略に従っています。つまり、大量のテキストを生成し、その答えの少なくとも一部が正しいことを期待しています (しかし、それらのほとんどは明らかに No です)。 、それは試験中に質問に答えるためのみんなの戦略と非常に似ていますか?

しかし、ChatGPT は少なくとも Schmidthuber に関するジョークを理解しました。しかし、全体として、ゼロサンプルのジョーク解釈タスクにおけるこれらのモデルのパフォーマンスは、PaLM からは程遠いです (PaLM の例が慎重に選択されていない限り)。

ゼロサンプル分類

著者が検討した 2 番目のタスクは、より困難です - クリックベイト)分類です。クリックベイトが何であるかについては人間ですら同意できないため、著者はプロンプトでこれらのモデルの例をいくつか提供しています (つまり、サンプルがゼロではなく、実際にはサンプルが少ないです)。以下は LLaMa のプロンプトです:

I will tell whether the following news titles are clickbait: 1) The WORST care homes in England: Interactive map reveals the lowest-rated 2,530 residences - so is there one near you? Clickbait: yes 2) Netflix's top 10 most-watched movies of all time Clickbait: yes 3) Peering Through the Fog of Inflation Clickbait: no 4) You’ll never believe which TV cook this cheeky chap grew up to be Clickbait: yes

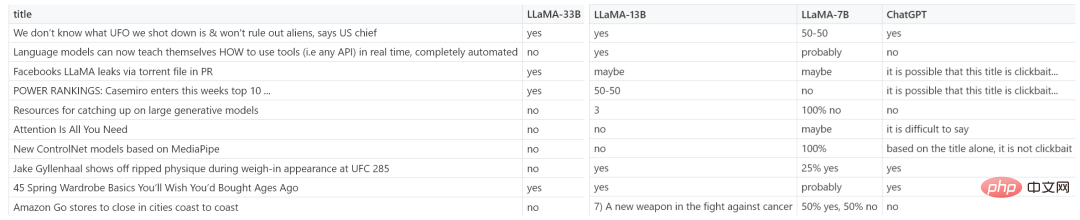

下の図は、LLaMA-7B、LLaMA-13B、LLaMA-33B、および ChatGPT の結果の例を示しています。

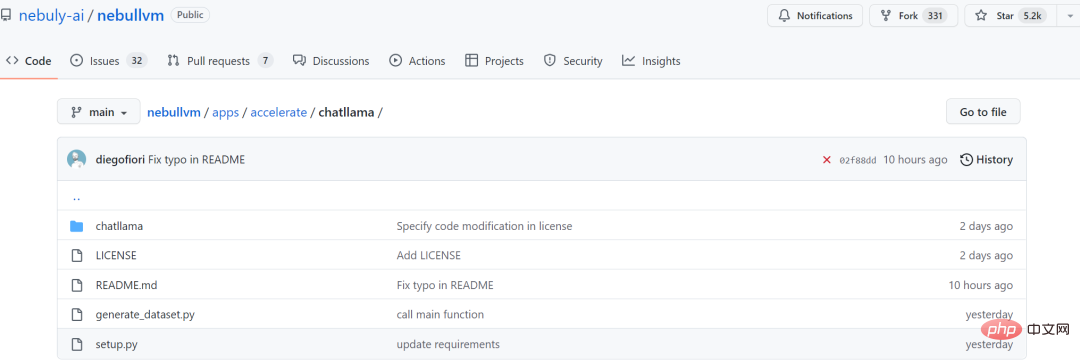

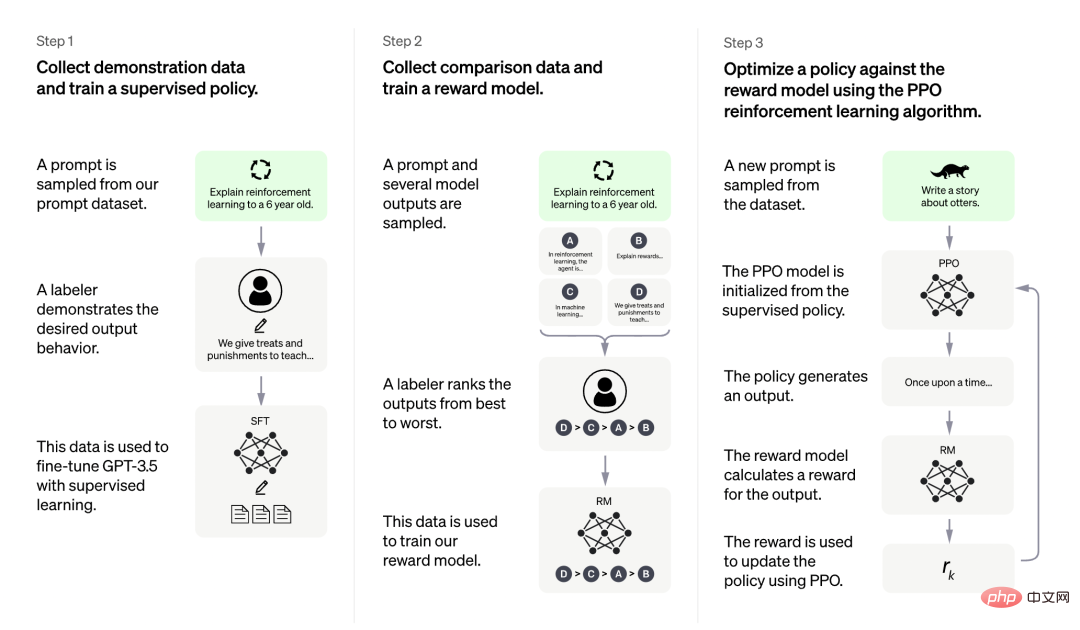

很明显,赢家为 LLaMA-33B,它是唯一一个能够遵循所有请求格式(yes/no)的模型,并且预测合理。ChatGPT 也还可以,但有些预测不太合理,格式也有错误。较小的模型(7B/13B)不适用于该任务。 代码生成 虽然 LLM 擅长人文学科,但在 STEM 学科上表现糟糕。LLaMA 虽然有基准测试结果,但作者在代码生成领域尝试了一些特别的东西,即将人类语言零样本地转换为 SQL 查询。这并不是很实用,在现实生活中直接编写查询会更有效率。这里只作为代码生成任务的一个示例。 在 prompt 中,作者提供表模式(table schema)以及想要实现的目标,要求模型给出 SQL 查询。如下为一些随机示例,老实说,ChatGPT 看起来效果更好。 从测试结果来看,LLaMA 在一些任务上表现还不错,但在另一些任务上和 ChatGPT 还有一些差距。如果能像 ChatGPT 一样加入一些「训练秘籍」,效果会不会大幅提升? 虽然 LLaMA 发布之初就得到众多研究者的青睐,但是少了 RLHF 的加持,从上述评测结果来看,还是差点意思。 在 LLaMA 发布三天后,初创公司 Nebuly AI 开源了 RLHF 版 LLaMA(ChatLLaMA)的训练方法。它的训练过程类似 ChatGPT,该项目允许基于预训练的 LLaMA 模型构建 ChatGPT 形式的服务。项目上线刚刚 2 天,狂揽 5.2K 星。 项目地址:https://github.com/nebuly-ai/nebullvm/tree/main/apps/accelerate/chatllama ChatLLaMA 训练过程算法实现主打比 ChatGPT 训练更快、更便宜,我们可以从以下四点得到验证:

-- We have a table `events` with columns `event_id`, `timestamp`, `user_id`, `rpc_method`.

-- We want to count how many users issued request "Login" over the last week.

-- SQL query for this is:

-- 7b

SELECT count (*)

FROM events

WHERE user_id IN (SELECT user_id

FROM events

WHERE timestamp >= NOW () - INTERVAL 7 DAY)

AND rpc_method = 'Login';

-- 13b

SELECT COUNT (*) FROM events WHERE rpc_method = "Login"

AND UNIX_TIMESTAMP (timestamp) >= UNIX_TIMESTAMP (CURRENT_DATE - INTERVAL 7 DAY)

-- 33b

SELECT user_id,

COUNT (DISTINCT user_id) AS total

FROM events

WHERE timestamp BETWEEN TIMESTAMP '2013-08-14 00:00:00' AND TIMESTAMP '2013-08-21 00:00:00'

AND rpc_method = 'Login'

GROUP BY user_id

-- ChatGPT

SELECT COUNT (DISTINCT user_id)

FROM events

WHERE rpc_method = 'Login'

AND timestamp >= DATE_SUB (NOW (), INTERVAL 1 WEEK);

加入 RLHF,初创公司 Nebuly AI 开源 ChatLLaMA 训练方法

图源:https://openai.com/blog/chatgpt

更是有研究者表示,ChatLLaMA 比 ChatGPT 训练速度最高快 15 倍。

不过有人对这一说法提出质疑,认为该项目没有给出准确的衡量标准。

项目刚刚上线 2 天,还处于早期阶段,用户可以通过以下添加项进一步扩展:

- 带有微调权重的 Checkpoint;

- 用于快速推理的优化技术;

- 支持将模型打包到有效的部署框架中。

Nebuly AI 希望更多人加入进来,创造更高效和开放的 ChatGPT 类助手。

该如何使用呢?首先是使用 pip 安装软件包:

pip install chatllama-py

然后是克隆 LLaMA 模型:

git clone https://github.com/facebookresearch/llama.gitcd llama pip install -r requirements.txt pip install -e .

一切准备就绪后,就可以运行了,项目中介绍了 ChatLLaMA 7B 的训练示例,感兴趣的小伙伴可以查看原项目。

以上がMeta のオープンソース ChatGPT の代替品は使いやすいですか?テスト結果と修正方法を公開、2日で5.2kスターの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。