Maison >Périphériques technologiques >IA >ICLR 2024 | Modéliser les couches critiques pour les attaques de porte dérobée par apprentissage fédéré

ICLR 2024 | Modéliser les couches critiques pour les attaques de porte dérobée par apprentissage fédéré

- PHPzavant

- 2024-04-07 09:04:081107parcourir

L'apprentissage fédéré utilise plusieurs parties pour former des modèles tout en protégeant la confidentialité des données. Cependant, comme le serveur ne peut pas surveiller le processus de formation effectué localement par les participants, ces derniers peuvent altérer le modèle de formation local, posant ainsi des risques de sécurité pour le modèle d'apprentissage fédéré global, tels que des attaques de porte dérobée.

Cet article se concentre sur la manière de lancer des attaques par porte dérobée sur l'apprentissage fédéré dans un cadre de formation protégé de manière défensive. Cet article révèle que l’implantation d’attaques par porte dérobée est plus étroitement liée à certaines couches du réseau neuronal et appelle ces couches les couches clés pour les attaques par porte dérobée. Dans l'apprentissage fédéré, les clients participant à la formation sont répartis sur différents appareils. Ils entraînent chacun leurs propres modèles, puis téléchargent les paramètres du modèle mis à jour sur le serveur pour agrégation. Puisque le client participant à la formation n'est pas digne de confiance et qu'il y a un certain risque, le serveur

Basé sur la découverte de la couche clé de la porte dérobée, cet article propose de contourner la détection de l'algorithme de défense en attaquant la couche clé de la porte dérobée , afin qu'un petit nombre de participants puissent être contrôlés pour mener des attaques de porte dérobée efficaces.

Titre de l'article : Apprentissage fédéré par porte dérobée en empoisonnant les couches critiques de porte dérobée

Lien de l'article : https://openreview.net/pdf?id=AJBGSVSTT2

Lien de code : https://github.com/zhmzm/ Poisoning_Backdoor-critical_Layers_Attack

Method

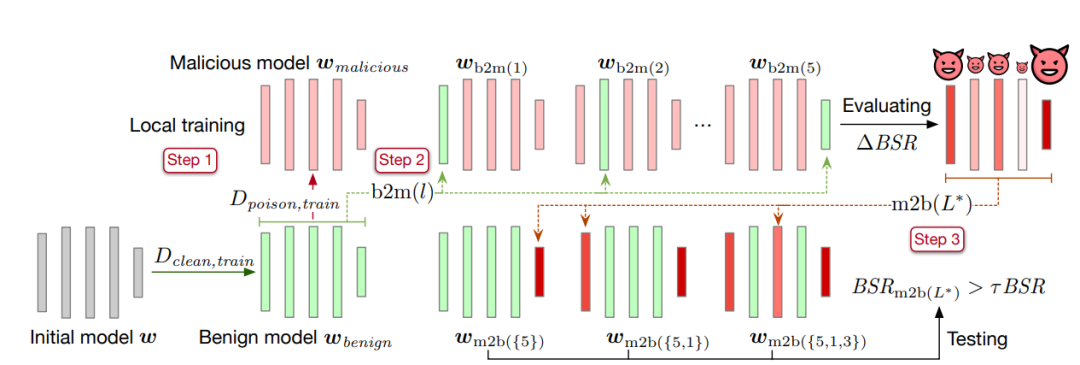

Cet article propose une méthode de remplacement de couche pour identifier les couches critiques de porte dérobée. La méthode spécifique est la suivante :

La première étape consiste à entraîner le modèle sur un ensemble de données propres jusqu'à convergence, et à enregistrer les paramètres du modèle en tant que modèle bénin

. Copiez ensuite le modèle bénin et entraînez-le sur l'ensemble de données contenant la porte dérobée. Après la convergence, enregistrez les paramètres du modèle et enregistrez-le en tant que modèle malveillant

. Copiez ensuite le modèle bénin et entraînez-le sur l'ensemble de données contenant la porte dérobée. Après la convergence, enregistrez les paramètres du modèle et enregistrez-le en tant que modèle malveillant .

. La deuxième étape consiste à remplacer une couche de paramètres du modèle inoffensif par le modèle malveillant contenant la porte dérobée, et à calculer le taux de réussite des attaques de porte dérobée du modèle résultant

. La différence entre le taux de réussite des attaques par porte dérobée obtenu et le taux de réussite des attaques par porte dérobée du modèle malveillant BSR est ΔBSR, qui peut être utilisé pour obtenir l'impact de cette couche sur les attaques par porte dérobée. En utilisant la même méthode pour chaque couche du réseau neuronal, vous pouvez obtenir une liste de l'impact de toutes les couches sur les attaques de porte dérobée.

. La différence entre le taux de réussite des attaques par porte dérobée obtenu et le taux de réussite des attaques par porte dérobée du modèle malveillant BSR est ΔBSR, qui peut être utilisé pour obtenir l'impact de cette couche sur les attaques par porte dérobée. En utilisant la même méthode pour chaque couche du réseau neuronal, vous pouvez obtenir une liste de l'impact de toutes les couches sur les attaques de porte dérobée. La troisième étape consiste à trier toutes les couches en fonction de leur impact sur les attaques de porte dérobée. Prenez la couche ayant le plus grand impact dans la liste et ajoutez-la à l'ensemble de couches critiques d'attaque de porte dérobée

, et intégrez les paramètres de la couche critique d'attaque de porte dérobée (couches de l'ensemble

, et intégrez les paramètres de la couche critique d'attaque de porte dérobée (couches de l'ensemble  ) du modèle malveillant dans le modèle bénin. Calculez le taux de réussite des attaques de porte dérobée du modèle obtenu

) du modèle malveillant dans le modèle bénin. Calculez le taux de réussite des attaques de porte dérobée du modèle obtenu . Si le taux de réussite de l'attaque par porte dérobée est supérieur au seuil défini τ multiplié par le taux de réussite de l'attaque par porte dérobée du modèle malveillant

. Si le taux de réussite de l'attaque par porte dérobée est supérieur au seuil défini τ multiplié par le taux de réussite de l'attaque par porte dérobée du modèle malveillant  , l'algorithme est arrêté. S'il n'est pas satisfait, continuez à ajouter la couche la plus grande parmi les couches restantes de la liste à la couche clé pour les attaques de porte dérobée

, l'algorithme est arrêté. S'il n'est pas satisfait, continuez à ajouter la couche la plus grande parmi les couches restantes de la liste à la couche clé pour les attaques de porte dérobée jusqu'à ce que les conditions soient remplies.

jusqu'à ce que les conditions soient remplies.

Après avoir obtenu la collection des couches clés des attaques backdoor, cet article propose une méthode d'attaque des couches clés des backdoors pour contourner la détection des méthodes de défense. De plus, cet article présente l'agrégation de simulation et les centres de modèles inoffensifs pour réduire davantage la distance par rapport aux autres modèles inoffensifs.

Résultats expérimentaux

Cet article vérifie l'efficacité des attaques de couche clé par porte dérobée sur plusieurs méthodes de défense sur les ensembles de données CIFAR-10 et MNIST. L’expérience utilisera le taux de réussite des attaques par porte dérobée BSR et le taux d’acceptation des modèles malveillants MAR (taux d’acceptation des modèles bénins BAR) comme indicateurs pour mesurer l’efficacité de l’attaque.

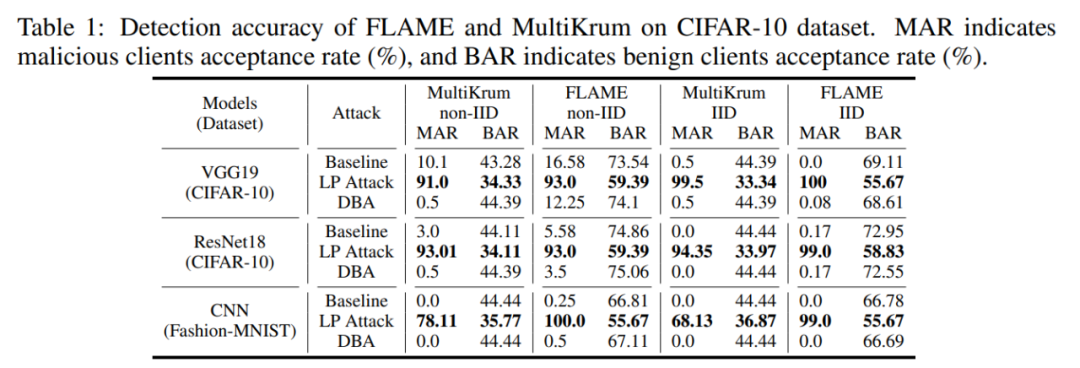

Tout d’abord, l’attaque par couches LP Attack peut permettre aux clients malveillants d’obtenir un taux de sélection élevé. Comme le montre le tableau ci-dessous, LP Attack a atteint un taux de réception de 90 % sur l'ensemble de données CIFAR-10, ce qui est bien supérieur aux 34 % d'utilisateurs inoffensifs.

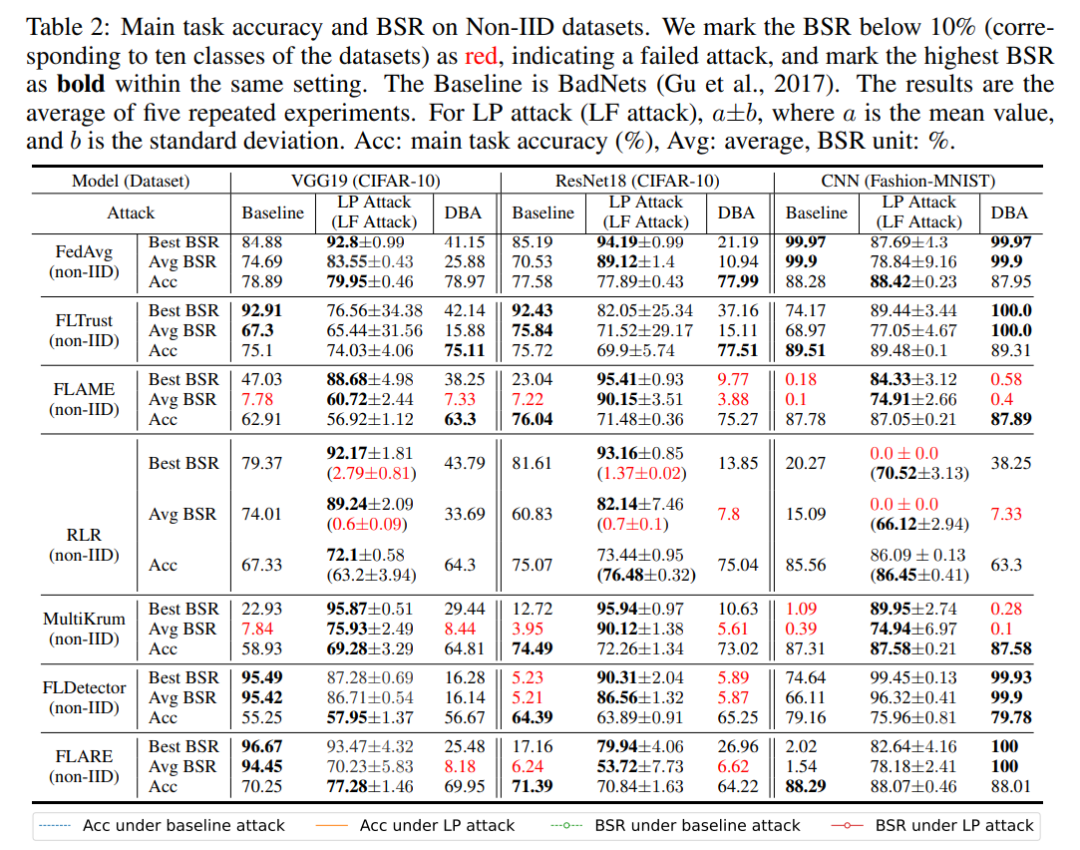

Ensuite, LP Attack peut atteindre un taux de réussite élevé d'attaques par porte dérobée, même dans un environnement ne comptant que 10 % de clients malveillants. Comme le montre le tableau ci-dessous, LP Attack peut atteindre un taux de réussite élevé des attaques de porte dérobée BSR sous la protection de différents ensembles de données et de différentes méthodes de défense.

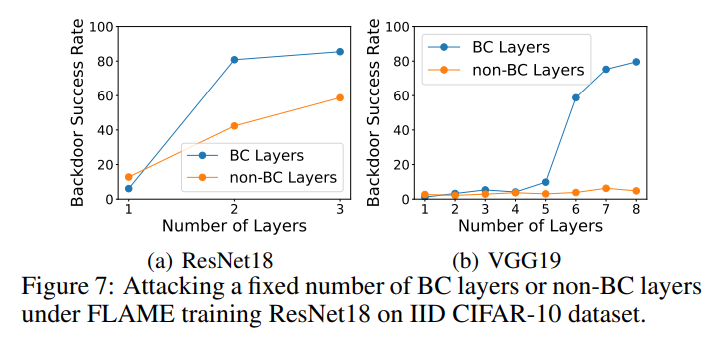

Dans l'expérience d'ablation, cet article a empoisonné respectivement la couche clé de porte dérobée et la couche clé non dérobée et a mesuré le taux de réussite des attaques de porte dérobée des deux expériences. Comme le montre la figure ci-dessous, en attaquant le même nombre de couches, le taux de réussite de l'empoisonnement des couches de clés non dérobées est bien inférieur à celui de l'empoisonnement des couches de clés de porte dérobée. Cela montre que l'algorithme de cet article peut sélectionner une clé d'attaque de porte dérobée efficace. couches.

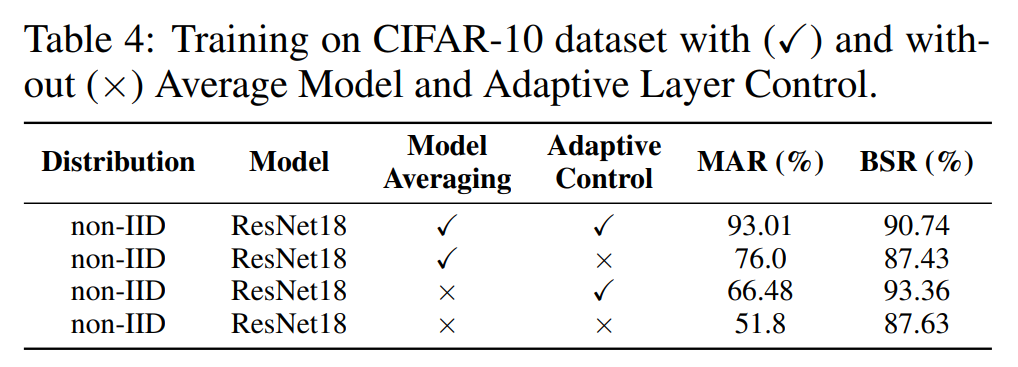

De plus, nous menons des expériences d'ablation sur le module d'agrégation de modèles Model Averaging et le module de contrôle adaptatif Adaptive Control. Comme le montre le tableau ci-dessous, les deux modules améliorent le taux de sélection et le taux de réussite des attaques de porte dérobée, prouvant l'efficacité de ces deux modules.

Résumé

Cet article a révélé que les attaques par porte dérobée sont étroitement liées à certaines couches et a proposé un algorithme pour rechercher les couches clés des attaques par porte dérobée. Cet article propose une attaque par couche sur l'algorithme de protection dans l'apprentissage fédéré en utilisant des portes dérobées pour attaquer les couches clés. L’attaque proposée révèle les vulnérabilités des trois types actuels de méthodes de défense, indiquant que des algorithmes de défense plus sophistiqués seront nécessaires pour protéger la sécurité de l’apprentissage fédéré à l’avenir.

Présentation de l'auteur

Zhuang Haomin, diplômé de l'Université de technologie de Chine du Sud avec un baccalauréat, a travaillé comme assistant de recherche au laboratoire IntelliSys de l'Université d'État de Louisiane et étudie actuellement pour un doctorat à l'Université de. Notre Dame. Les principales orientations de recherche sont les attaques par porte dérobée et les attaques par échantillons contradictoires.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

) du modèle malveillant dans le modèle bénin. Calculez le taux de réussite des attaques de porte dérobée du modèle obtenu

) du modèle malveillant dans le modèle bénin. Calculez le taux de réussite des attaques de porte dérobée du modèle obtenu