Double 叒叕 est le début d'une nouvelle fonctionnalité.

Avez-vous déjà rencontré une situation dans laquelle vous souhaitez changer l'arrière-plan d'un personnage d'image, mais l'IA produit toujours l'effet "l'objet n'est ni la personne ni l'objet". Même dans les outils de génération matures tels que Midjourney et DALL・E, certaines techniques d'invite sont nécessaires pour maintenir la cohérence des personnages, sinon les personnages changeront ici et là et vous ne pourrez pas obtenir les résultats souhaités. Cependant, cette fois, c'est votre chance. La nouvelle fonctionnalité « Personnage – Vidéo » de l'outil AIGC PixVerse peut vous aider à réaliser tout cela. De plus, il peut générer des vidéos dynamiques pour rendre vos personnages plus vivants.

Saisissez une image et vous pourrez obtenir les résultats vidéo dynamiques correspondants. Sur la base du maintien de la cohérence des personnages, les riches éléments d'arrière-plan et la dynamique des personnages rendent les résultats générés très intelligents. Jetons d'abord un coup d'œil à l'effet.

Nous pouvons voir à partir de ces exemples que les visages des personnages générés par cet outil sont fondamentalement cohérents, accompagnés d'expressions vives, et que leurs arrière-plans sont plus riches. Cela aide les utilisateurs à résoudre dans une large mesure les étapes compliquées de la recréation. Désormais, vous pouvez le mettre à jour en un seul clic et réaliser de nouveaux travaux sans effort. L'internaute @heyronir a démontré son effet de génération. Il a d'abord entré les images suivantes :

Voici le résultat qu'il a obtenu :  Résultats 1

Résultats 1

Résultats 2

Résultats 2

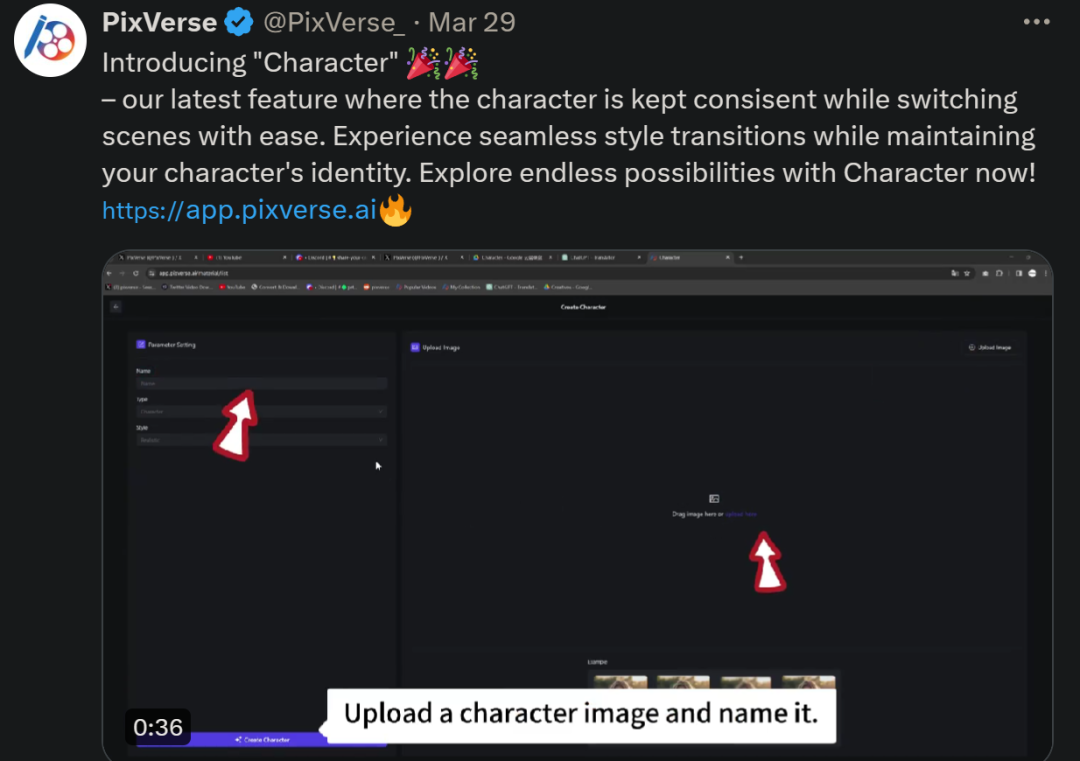

L'entrée de comparaison et la génération de résultats peuvent être vues, résultat 1 La forme du visage du personnage, ses proportions et sa structure osseuse sont relativement conformes aux matériaux d'origine, mais les orbites sont légèrement plus profondes et la longueur des cheveux est légèrement plus courte. Dans l’ensemble, il semble être peu différent du matériel initialement fourni. Cependant, la différence entre le résultat généré 2 et le matériau original est plus évidente. La forme du visage du personnage, la direction des os du visage, la couleur des pupilles et la coiffure sont tous très différents. Cependant, cela est toujours lié à l'invite saisie par l'utilisateur. Nous pouvons continuer à déboguer dans l'outil pour obtenir les résultats souhaités. Si vous êtes intéressé, allez l'essayer. Adresse de l'expérience : https://app.pixverse.ai/loginCet outil est également très simple à utiliser. Plus précisément, il ne prend que trois étapes à compléter. Étape 1 : Recherchez la fonction "Personnage - Vidéo" Démarrez depuis la page d'accueil de l'application ou du site Web. Recherchez l'option intitulée « Personnage », cliquez dessus pour continuer, puis sélectionnez Créer un personnage.

Étape 2 : Créez votre personnage Vous pouvez maintenant télécharger l'image que vous souhaitez utiliser comme visage de votre personnage. Donnez un nom à votre personnage, créez-le et attendez environ 20 secondes que PixVerse termine son entraînement. Étape 3 : Créer une vidéo Cliquez sur "Créer" et sélectionnez le personnage dans le menu. Entrez l'invite requise, sélectionnez le rapport hauteur/largeur de la vidéo générée, cliquez sur Créer et dans quelques minutes, la vidéo du personnage sera créée.

Regardons d'autres résultats générés par les internautes, vous apporteront-ils une nouvelle inspiration :

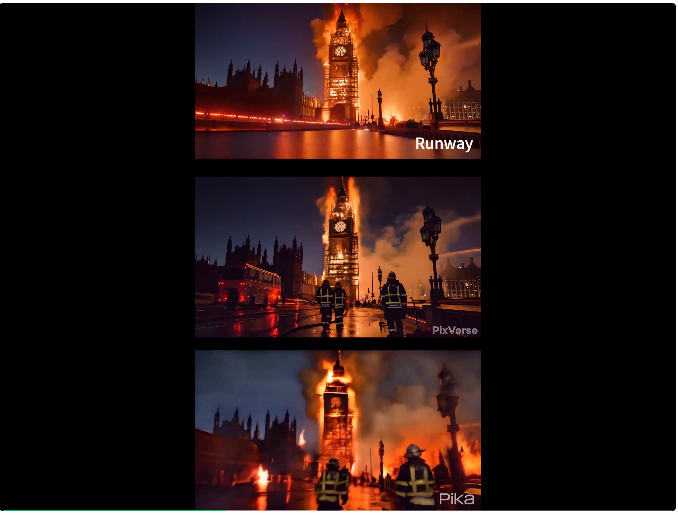

En fait, ce n'est pas la première fois que PixVerse est exposé à tout le monde a attiré l’attention du plus grand nombre. Il s'agit d'un outil de génération vidéo lancé par Aishi Technology. Entrez simplement du texte et PixVerse générera une vidéo basée sur celui-ci. Dans le canal Discord de PixVerse, il proposera également quatre options pour chaque texte. Vous pourrez sélectionner lentement parmi les options et ajuster constamment la direction de génération. Vous pouvez même choisir la météo en fonction de son écran, avec des options ensoleillées, pluvieuses, de jour et de nuit disponibles. En février de cette année, Aishi Technology Wang Changhu a été interviewée par ce site Web. Il a déclaré que les performances de PixVerse ont atteint le niveau de Pika à certains égards et les ont même dépassées dans de nombreuses critiques. Dans l'évaluation comparative de PixVerse, Pika et Runway, l'auto-média KOL Guizang a déclaré : Le modèle de PixVerse est le plus équilibré des trois, permettant une amplitude de mouvement relativement forte tout en conservant une bonne cohérence.  https://weibo.com/6182606334/4994 169402301252

https://weibo.com/6182606334/4994 169402301252

Dans le cas d'une concurrence aussi féroce dans le domaine de l'IA générative, chaque outil cherche sa propre nouvelle issue. Apparemment, la compétence utilisée par PixVerse cette fois est « Cohérence ». Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Résultats 1

Résultats 1 Résultats 2

Résultats 2

https://weibo.com/6182606334/4994 169402301252

https://weibo.com/6182606334/4994 169402301252