Maison >Périphériques technologiques >IA >Top 10 des algorithmes d'intelligence artificielle incontournables

Top 10 des algorithmes d'intelligence artificielle incontournables

- PHPzavant

- 2024-03-06 09:37:13665parcourir

Avec la popularité continue de la technologie de l'intelligence artificielle (IA), divers algorithmes jouent un rôle important dans la promotion du développement de ce domaine. Des algorithmes de régression linéaire utilisés pour prédire les prix de l’immobilier aux réseaux de neurones alimentant les voitures autonomes, ces algorithmes alimentent et exploitent silencieusement d’innombrables applications. À mesure que la quantité de données augmente et que la puissance de calcul s’améliore, les performances et l’efficacité des algorithmes d’intelligence artificielle s’améliorent également constamment. Le champ d'application de ces algorithmes est de plus en plus large, couvrant le diagnostic médical, l'évaluation des risques financiers, le traitement du langage naturel, etc.

Aujourd'hui, nous vous emmènerons jeter un œil à ces algorithmes d'intelligence artificielle populaires ( régression linéaire, régression logistique, arbre de décision, Naive Bayes, Support Vector Machine (SVM), apprentissage d'ensemble, algorithme K du plus proche voisin, algorithme K-means, réseau neuronal, apprentissage par renforcement Deep Q-Networks), explorez leurs principes de fonctionnement, scénarios d'application et leur application dans le monde réel influence.

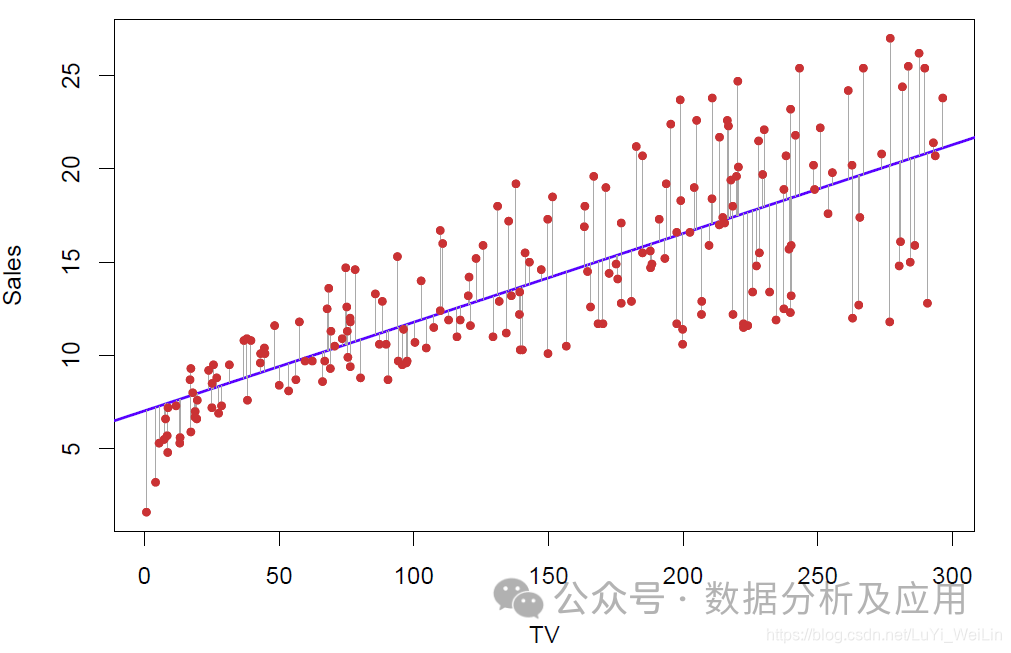

1. Régression linéaire :

Le principe de la régression linéaire est de trouver une ligne droite optimale pour s'adapter au maximum à la distribution des points de données.

La formation du modèle consiste à utiliser des données d'entrée et de sortie connues pour optimiser le modèle, généralement en minimisant la différence entre les valeurs prédites et les valeurs réelles.

Avantages : simple et facile à comprendre, haute efficacité de calcul.

Inconvénients : Capacité limitée à gérer des relations non linéaires.

Scénarios d'utilisation : convient aux problèmes de prévision de valeurs continues, tels que la prévision des prix de l'immobilier, des cours des actions, etc.

Exemple de code (utilisez la bibliothèque Scikit-learn de Python pour créer un modèle de régression linéaire simple) :

from sklearn.linear_model import LinearRegressionfrom sklearn.datasets import make_regression# 生成模拟数据集X, y = make_regression(n_samples=100, n_features=1, noise=0.1)# 创建线性回归模型对象lr = LinearRegression()# 训练模型lr.fit(X, y)# 进行预测predictions = lr.predict(X)

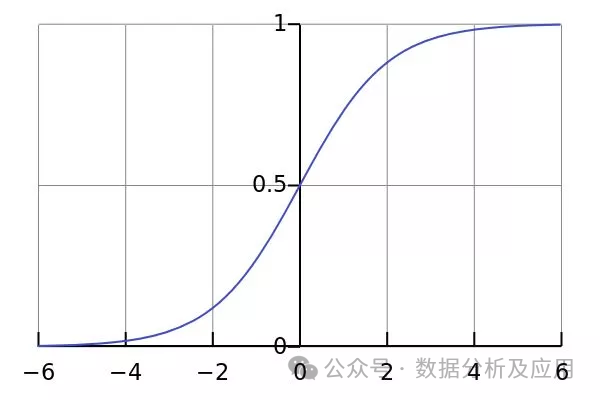

2. Régression logistique :

Principe du modèle : La régression logistique est une méthode utilisée pour A. algorithme d'apprentissage automatique qui résout les problèmes de classification binaire en mappant des entrées continues sur des sorties discrètes (généralement binaires). Il utilise une fonction logistique pour mapper les résultats de la régression linéaire sur la plage (0,1) afin d'obtenir la probabilité de classification.

Formation de modèle : utilisez des échantillons de données de classifications connues pour former un modèle de régression logistique, en optimisant les paramètres du modèle afin de minimiser la perte d'entropie croisée entre la probabilité prédite et la classification réelle.

Avantages : Simple et facile à comprendre, meilleur pour les problèmes à deux classifications.

Inconvénients : Capacité limitée à gérer des relations non linéaires.

Scénarios d'utilisation : convient aux problèmes de classification binaire, tels que le filtrage du spam, la prédiction de maladies, etc.

Exemple de code (utilisez la bibliothèque Scikit-learn de Python pour créer un modèle de régression logistique simple) :

from sklearn.linear_model import LogisticRegressionfrom sklearn.datasets import make_classification# 生成模拟数据集X, y = make_classification(n_samples=100, n_features=2, n_informative=2, n_redundant=0, random_state=42)# 创建逻辑回归模型对象lr = LogisticRegression()# 训练模型lr.fit(X, y)# 进行预测predictions = lr.predict(X)

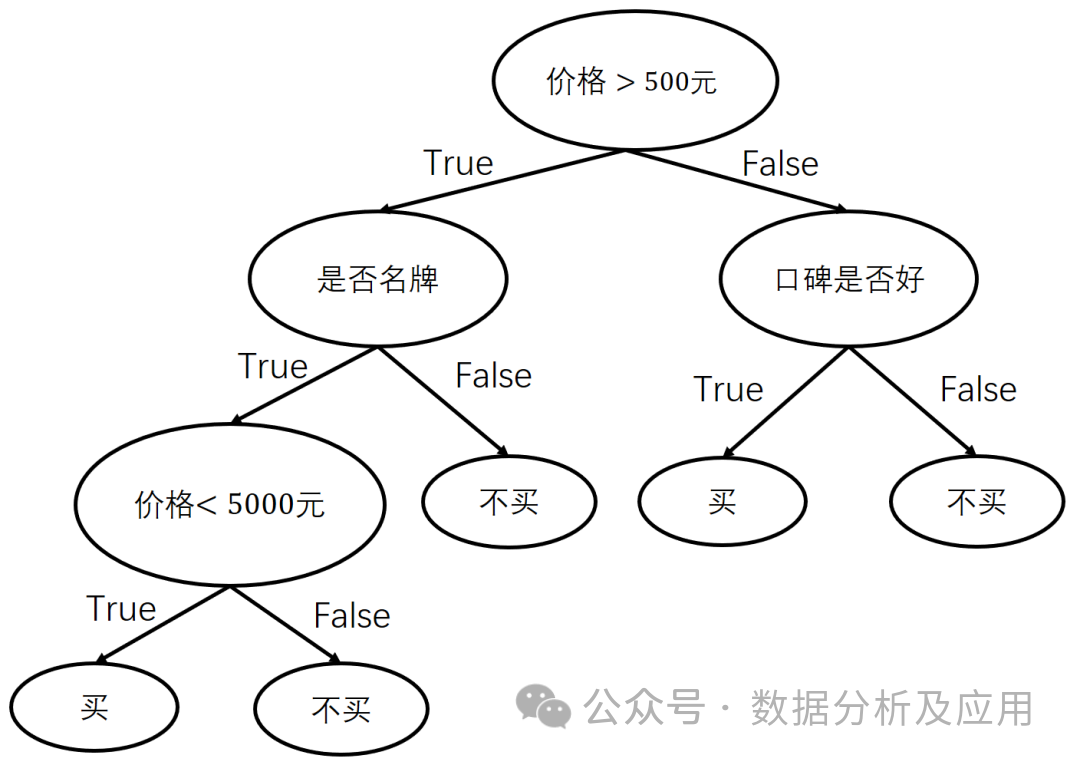

Arbre de décision :

Principe du modèle : l'arbre de décision est un apprentissage supervisé. des algorithmes qui construisent des limites de décision en divisant de manière récursive un ensemble de données en sous-ensembles plus petits. Chaque nœud interne représente une condition de jugement sur un attribut de fonctionnalité, chaque branche représente une valeur d'attribut possible et chaque nœud feuille représente une catégorie.

Formation du modèle : créez un arbre de décision en sélectionnant les meilleurs attributs de partitionnement et utilisez des techniques d'élagage pour éviter le surajustement.

Avantages : Facile à comprendre et à expliquer, capable de gérer les problèmes de classification et de régression.

Inconvénients : facile à surajuster, sensible au bruit et aux valeurs aberrantes.

Scénarios d'utilisation : convient aux problèmes de classification et de régression, tels que la détection de fraude par carte de crédit, les prévisions météorologiques, etc.

Exemple de code (utilisez la bibliothèque Scikit-learn de Python pour créer un modèle d'arbre de décision simple) :

from sklearn.tree import DecisionTreeClassifierfrom sklearn.datasets import load_irisfrom sklearn.model_selection import train_test_split# 加载数据集iris = load_iris()X = iris.datay = iris.target# 划分训练集和测试集X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)# 创建决策树模型对象dt = DecisionTreeClassifier()# 训练模型dt.fit(X_train, y_train)# 进行预测predictions = dt.predict(X_test)

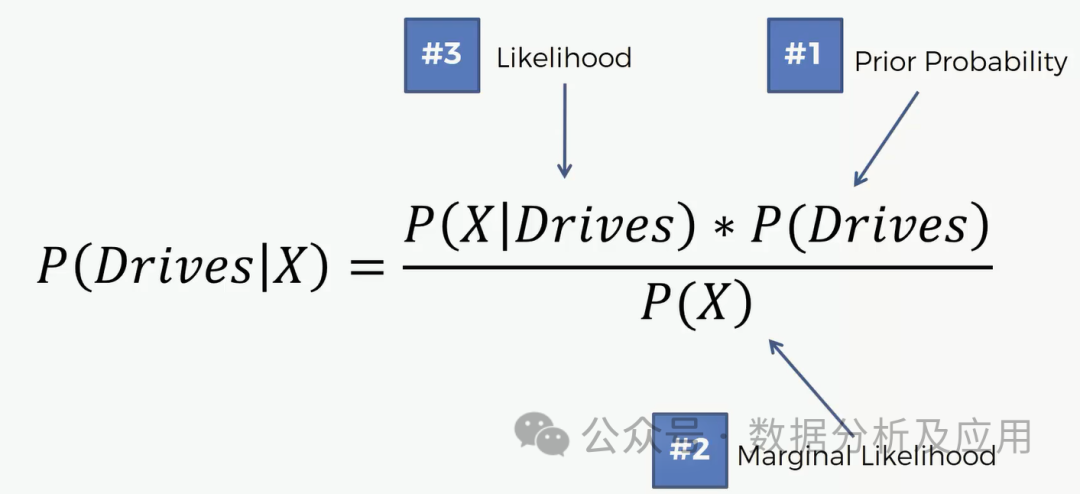

4, Naive Baye s :

Principe du modèle : Naive Baye Si est un méthode de classification basée sur le théorème de Bayes et l'hypothèse d'indépendance conditionnelle des caractéristiques. Il effectue une modélisation probabiliste des valeurs d'attribut des échantillons dans chaque catégorie, puis prédit la catégorie à laquelle appartiennent les nouveaux échantillons en fonction de ces probabilités.

Formation du modèle : créez un classificateur Naive Bayes en utilisant des échantillons de données avec des catégories et des attributs connus pour estimer la probabilité a priori de chaque catégorie et la probabilité conditionnelle de chaque attribut.

Avantages : Simple, efficace, particulièrement efficace pour les grandes catégories et les petits ensembles de données.

Inconvénients : Mauvaise modélisation des dépendances entre fonctionnalités.

Scénarios d'utilisation : convient à la classification de texte, au filtrage du spam et à d'autres scénarios.

Exemple de code (création d'un classificateur Bayes naïf simple à l'aide de la bibliothèque Scikit-learn de Python) :

from sklearn.naive_bayes import GaussianNBfrom sklearn.datasets import load_iris# 加载数据集iris = load_iris()X = iris.datay = iris.target# 创建朴素贝叶斯分类器对象gnb = GaussianNB()# 训练模型gnb.fit(X, y)# 进行预测predictions = gnb.predict(X)

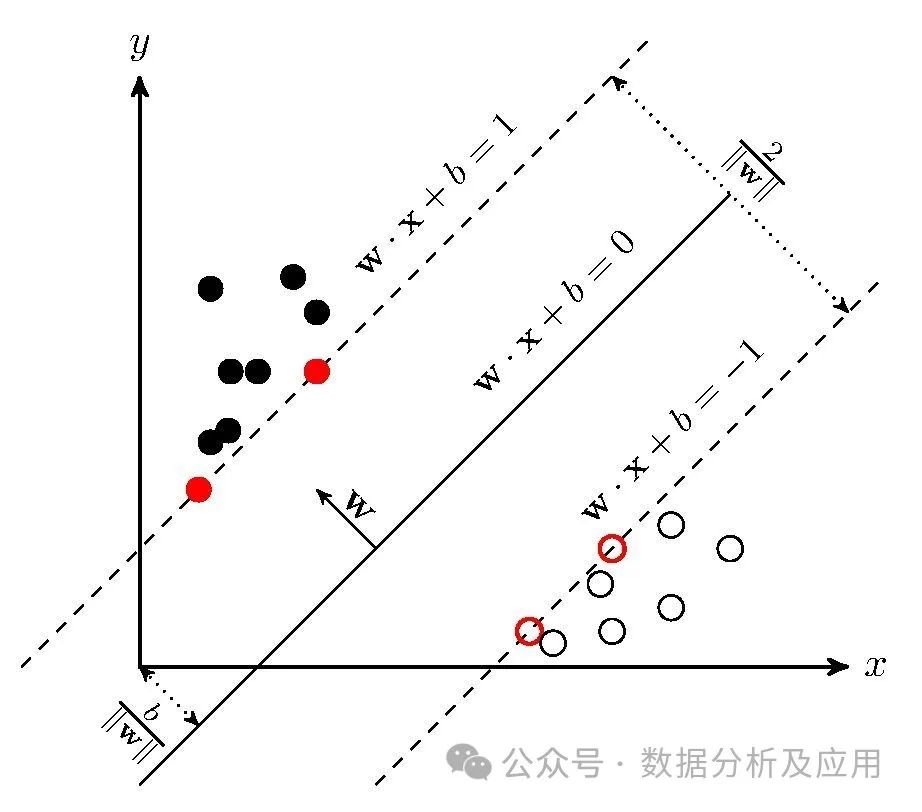

5、支持向量机(SVM):

模型原理:支持向量机是一种监督学习算法,用于分类和回归问题。它试图找到一个超平面,使得该超平面能够将不同类别的样本分隔开。SVM使用核函数来处理非线性问题。

模型训练:通过优化一个约束条件下的二次损失函数来训练SVM,以找到最佳的超平面。

优点:对高维数据和非线性问题表现良好,能够处理多分类问题。

缺点:对于大规模数据集计算复杂度高,对参数和核函数的选择敏感。

使用场景:适用于分类和回归问题,如图像识别、文本分类等。

示例代码(使用Python的Scikit-learn库构建一个简单的SVM分类器):

from sklearn import svmfrom sklearn.datasets import load_irisfrom sklearn.model_selection import train_test_split# 加载数据集iris = load_iris()X = iris.datay = iris.target# 划分训练集和测试集X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)# 创建SVM分类器对象,使用径向基核函数(RBF)clf = svm.SVC(kernel='rbf')# 训练模型clf.fit(X_train, y_train)# 进行预测predictions = clf.predict(X_test)

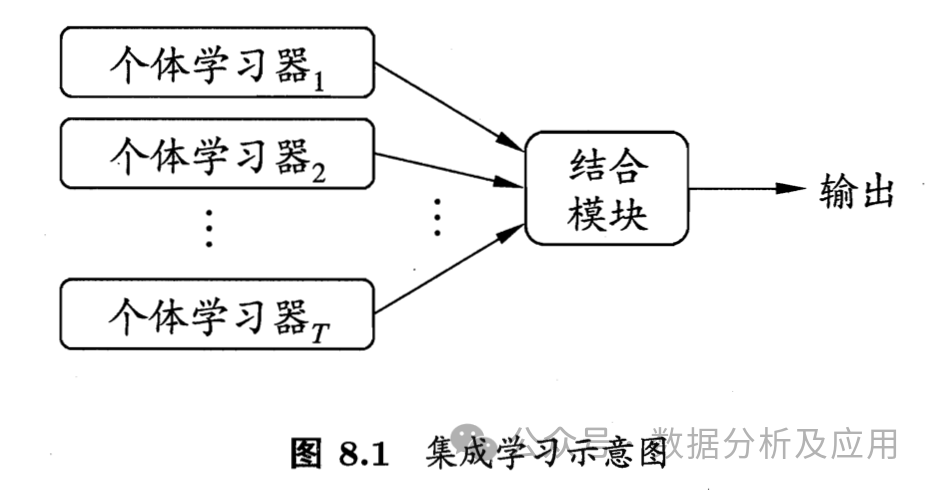

6、集成学习:

模型原理:集成学习是一种通过构建多个基本模型并将它们的预测结果组合起来以提高预测性能的方法。集成学习策略有投票法、平均法、堆叠法和梯度提升等。常见集成学习模型有XGBoost、随机森林、Adaboost等

模型训练:首先使用训练数据集训练多个基本模型,然后通过某种方式将它们的预测结果组合起来,形成最终的预测结果。

优点:可以提高模型的泛化能力,降低过拟合的风险。

缺点:计算复杂度高,需要更多的存储空间和计算资源。

使用场景:适用于解决分类和回归问题,尤其适用于大数据集和复杂的任务。

示例代码(使用Python的Scikit-learn库构建一个简单的投票集成分类器):

from sklearn.ensemble import VotingClassifierfrom sklearn.linear_model import LogisticRegressionfrom sklearn.tree import DecisionTreeClassifierfrom sklearn.datasets import load_irisfrom sklearn.model_selection import train_test_split# 加载数据集iris = load_iris()X = iris.datay = iris.target# 划分训练集和测试集X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)# 创建基本模型对象和集成分类器对象lr = LogisticRegression()dt = DecisionTreeClassifier()vc = VotingClassifier(estimators=[('lr', lr), ('dt', dt)], voting='hard')# 训练集成分类器vc.fit(X_train, y_train)# 进行预测predictions = vc.predict(X_test)7、K近邻算法:

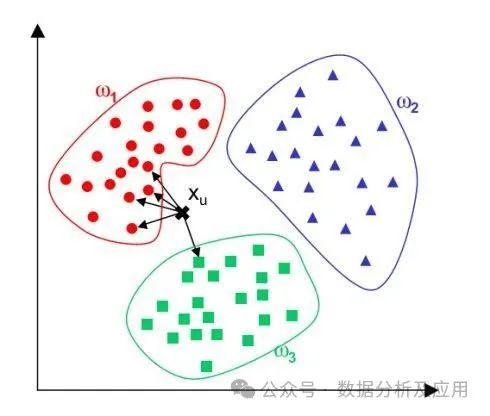

模型原理:K近邻算法是一种基于实例的学习,通过将新的样本与已知样本进行比较,找到与新样本最接近的K个样本,并根据这些样本的类别进行投票来预测新样本的类别。

模型训练:不需要训练阶段,通过计算新样本与已知样本之间的距离或相似度来找到最近的邻居。

优点:简单、易于理解,不需要训练阶段。

缺点:对于大规模数据集计算复杂度高,对参数K的选择敏感。

使用场景:适用于解决分类和回归问题,适用于相似度度量和分类任务。

示例代码(使用Python的Scikit-learn库构建一个简单的K近邻分类器):

from sklearn.neighbors import KNeighborsClassifierfrom sklearn.datasets import load_irisfrom sklearn.model_selection import train_test_split# 加载数据集iris = load_iris()X = iris.datay = iris.target# 划分训练集和测试集X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)# 创建K近邻分类器对象,K=3knn = KNeighborsClassifier(n_neighbors=3)# 训练模型knn.fit(X_train, y_train)# 进行预测predictions = knn.predict(X_test)

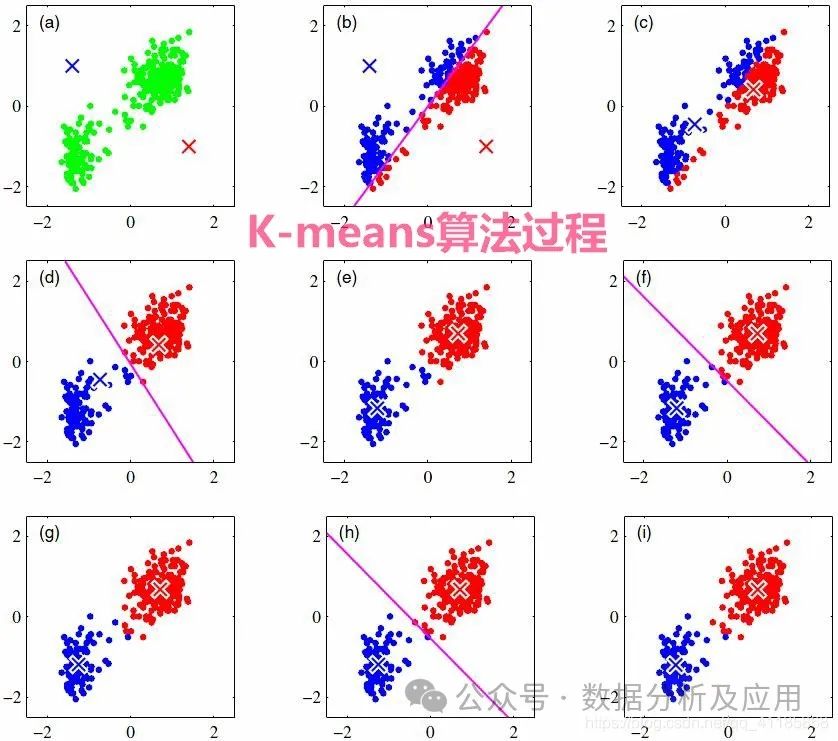

8、K-means算法:

模型原理:K-means算法是一种无监督学习算法,用于聚类问题。它将n个点(可以是样本数据点)划分为k个聚类,使得每个点属于最近的均值(聚类中心)对应的聚类。

模型训练:通过迭代更新聚类中心和分配每个点到最近的聚类中心来实现聚类。

优点:简单、快速,对于大规模数据集也能较好地运行。

缺点:对初始聚类中心敏感,可能会陷入局部最优解。

使用场景:适用于聚类问题,如市场细分、异常值检测等。

示例代码(使用Python的Scikit-learn库构建一个简单的K-means聚类器):

from sklearn.cluster import KMeansfrom sklearn.datasets import make_blobsimport matplotlib.pyplot as plt# 生成模拟数据集X, y = make_blobs(n_samples=300, centers=4, cluster_std=0.60, random_state=0)# 创建K-means聚类器对象,K=4kmeans = KMeans(n_clusters=4)# 训练模型kmeans.fit(X)# 进行预测并获取聚类标签labels = kmeans.predict(X)# 可视化结果plt.scatter(X[:, 0], X[:, 1], c=labels, cmap='viridis')plt.show()

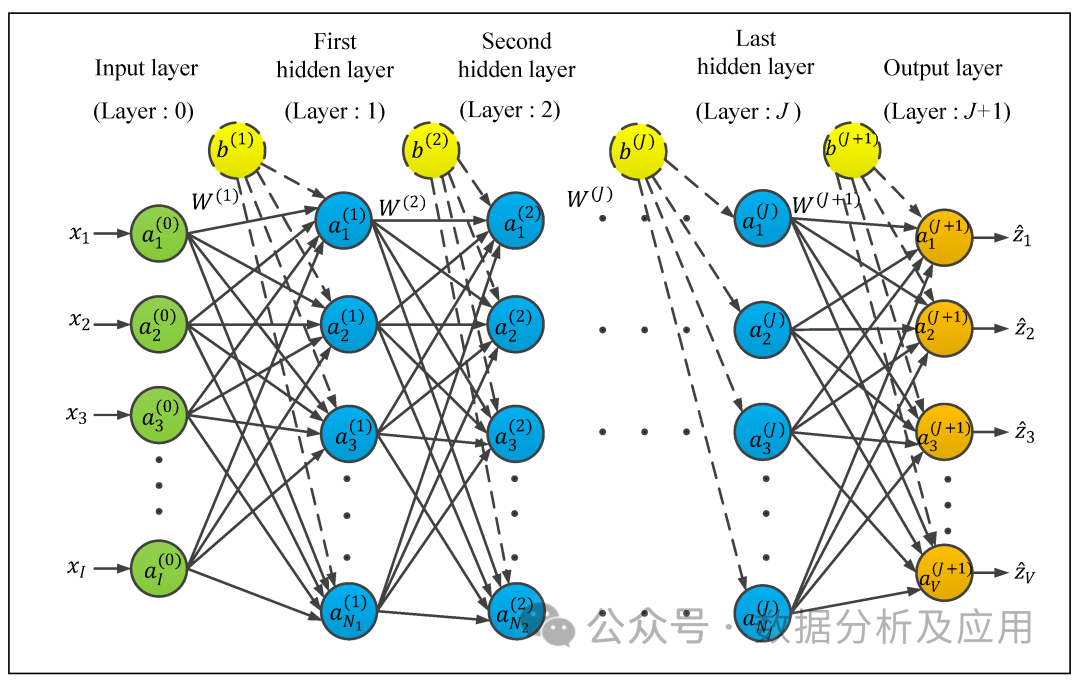

9、神经网络:

模型原理:神经网络是一种模拟人脑神经元结构的计算模型,通过模拟神经元的输入、输出和权重调整机制来实现复杂的模式识别和分类等功能。神经网络由多层神经元组成,输入层接收外界信号,经过各层神经元的处理后,最终输出层输出结果。

模型训练:神经网络的训练是通过反向传播算法实现的。在训练过程中,根据输出结果与实际结果的误差,逐层反向传播误差,并更新神经元的权重和偏置项,以减小误差。

优点:能够处理非线性问题,具有强大的模式识别能力,能够从大量数据中学习复杂的模式。

缺点:容易陷入局部最优解,过拟合问题严重,训练时间长,需要大量的数据和计算资源。

使用场景:适用于图像识别、语音识别、自然语言处理、推荐系统等场景。

示例代码(使用Python的TensorFlow库构建一个简单的神经网络分类器):

import tensorflow as tffrom tensorflow.keras import layers, modelsfrom tensorflow.keras.datasets import mnist# 加载MNIST数据集(x_train, y_train), (x_test, y_test) = mnist.load_data()# 归一化处理输入数据x_train = x_train / 255.0x_test = x_test / 255.0# 构建神经网络模型model = models.Sequential()model.add(layers.Flatten(input_shape=(28, 28)))model.add(layers.Dense(128, activation='relu'))model.add(layers.Dense(10, activation='softmax'))# 编译模型并设置损失函数和优化器等参数model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])# 训练模型model.fit(x_train, y_train, epochs=5)# 进行预测predictions = model.predict(x_test)

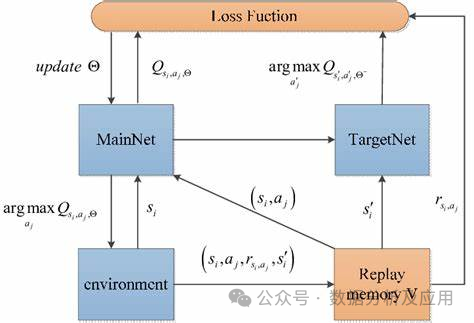

10.深度强化学习(DQN):

模型原理:Deep Q-Networks (DQN) 是一种结合了深度学习与Q-learning的强化学习算法。它的核心思想是使用神经网络来逼近Q函数,即状态-动作值函数,从而为智能体在给定状态下选择最优的动作提供依据。

模型训练:DQN的训练过程包括两个阶段:离线阶段和在线阶段。在离线阶段,智能体通过与环境的交互收集数据并训练神经网络。在线阶段,智能体使用神经网络进行动作选择和更新。为了解决过度估计问题,DQN引入了目标网络的概念,通过使目标网络在一段时间内保持稳定来提高稳定性。

优点:能够处理高维度的状态和动作空间,适用于连续动作空间的问题,具有较好的稳定性和泛化能力。

缺点:容易陷入局部最优解,需要大量的数据和计算资源,对参数的选择敏感。

使用场景:适用于游戏、机器人控制等场景。

示例代码(使用Python的TensorFlow库构建一个简单的DQN强化学习模型):

import tensorflow as tffrom tensorflow.keras.models import Sequentialfrom tensorflow.keras.layers import Dense, Dropout, Flattenfrom tensorflow.keras.optimizers import Adamfrom tensorflow.keras import backend as Kclass DQN:def __init__(self, state_size, action_size):self.state_size = state_sizeself.action_size = action_sizeself.memory = deque(maxlen=2000)self.gamma = 0.85self.epsilon = 1.0self.epsilon_min = 0.01self.epsilon_decay = 0.995self.learning_rate = 0.005self.model = self.create_model()self.target_model = self.create_model()self.target_model.set_weights(self.model.get_weights())def create_model(self):model = Sequential()model.add(Flatten(input_shape=(self.state_size,)))model.add(Dense(24, activation='relu'))model.add(Dense(24, activation='relu'))model.add(Dense(self.action_size, activation='linear'))return modeldef remember(self, state, action, reward, next_state, done):self.memory.append((state, action, reward, next_state, done))def act(self, state):if len(self.memory) > 1000:self.epsilon *= self.epsilon_decayif self.epsilon

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Implémentation et application de l'algorithme de réseau neuronal (BP) Python

- Comment implémenter un algorithme de tri par sélection en langage C

- Qu'est-ce que l'éducation à l'intelligence artificielle ?

- La compréhension du langage naturel est un domaine d'application important de l'intelligence artificielle. Quel est son objectif ?

- Comment comprendre l'algorithme de remplacement de page