Maison >Périphériques technologiques >IA >Le premier système universel de modélisation graphique et textuelle 3D pour meubles et appareils électroménagers qui ne nécessite aucun guidage et peut être utilisé dans des modèles de visualisation généralisés.

Le premier système universel de modélisation graphique et textuelle 3D pour meubles et appareils électroménagers qui ne nécessite aucun guidage et peut être utilisé dans des modèles de visualisation généralisés.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2024-01-09 19:30:25748parcourir

De nos jours, toutes les tâches ménagères sont prises en charge par des robots.

Le robot de Stanford capable d'utiliser des casseroles vient d'apparaître, et le robot capable d'utiliser des machines à café vient d'arriver, Figure-01.

Figure-01 Il suffit de regarder la vidéo de démonstration et de suivre 10 heures de formation pour pouvoir utiliser la machine à café avec compétence. De l’insertion de la capsule de café à l’appui sur le bouton de démarrage, tout se fait en une seule fois.

Cependant, il est difficile de permettre à un robot d'apprendre de manière autonome à utiliser divers meubles et appareils électroménagers sans avoir besoin de vidéos de démonstration lorsqu'il les rencontre. Cela nécessite que le robot ait de fortes capacités de perception visuelle et de prise de décision, ainsi que des compétences de manipulation précises.

Lien papier : https://arxiv.org/abs/2312.01307

Page d'accueil du projet : https://geometry.stanford.edu/projects/sage/

Code : https://github.com/ geng-haoran/SAGE

Aperçu du problème de recherche

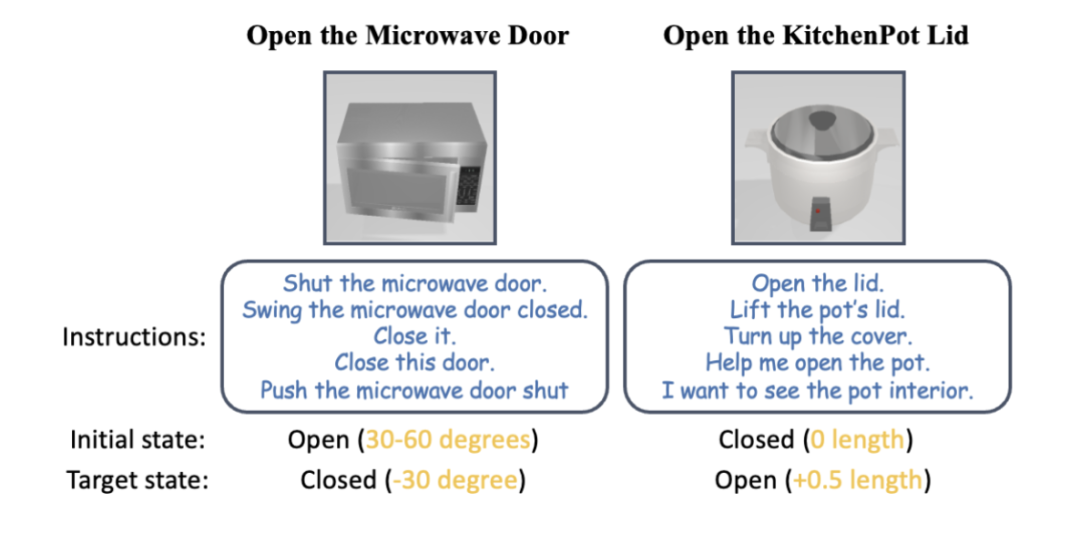

Figure 1 : Selon les instructions humaines, le bras robotique peut utiliser divers appareils électroménagers sans aucune instruction.

Récemment, PaLM-E et GPT-4V ont favorisé l'application de grands modèles graphiques dans la planification des tâches des robots, et le contrôle généralisé des robots guidé par le langage visuel est devenu un domaine de recherche populaire.

Une méthode courante dans le passé consistait à construire un système à deux couches. Le grand modèle graphique de la couche supérieure effectue la planification et la planification des compétences, et le modèle de stratégie de compétences de contrôle de la couche inférieure est responsable de l'exécution physique des actions. Mais lorsque les robots seront confrontés à une variété d'appareils électroménagers qu'ils n'ont jamais vus auparavant et nécessiteront des opérations en plusieurs étapes dans les tâches ménagères, les couches supérieures et inférieures des méthodes existantes seront impuissantes.

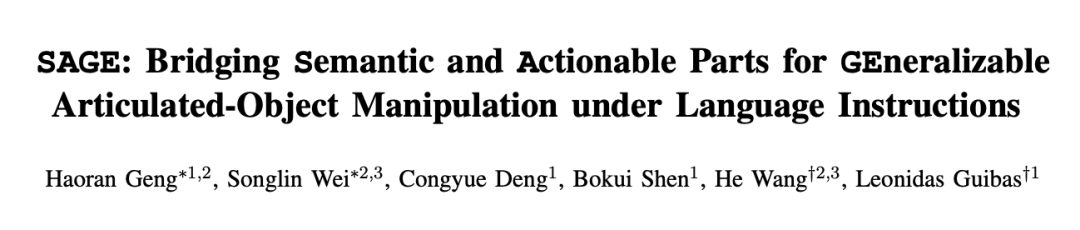

Prenons comme exemple le modèle graphique le plus avancé GPT-4V. Bien qu'il puisse décrire une seule image avec du texte, il est encore plein d'erreurs en matière de détection, de comptage, de positionnement et d'estimation de l'état des pièces utilisables. Les surlignages rouges sur la figure 2 correspondent aux diverses erreurs commises par GPT-4V lors de la description d'images de commodes, de fours et d'armoires sur pied. Sur la base d'une description erronée, la planification des compétences du robot n'est évidemment pas fiable.

Figure 2 : GPT-4V ne peut pas gérer des tâches axées sur le contrôle généralisé telles que le comptage, la détection, le positionnement et l'estimation d'état.

Le modèle de stratégie de compétences de contrôle de niveau inférieur est responsable de l'exécution des tâches confiées par le modèle graphique et textuel de niveau supérieur dans diverses situations réelles. La plupart des résultats de recherche existants codent de manière rigide les points de préhension et les méthodes de fonctionnement de certains objets connus sur la base de règles, et ne peuvent généralement pas traiter de nouvelles catégories d'objets qui n'ont jamais été vues auparavant. Cependant, les modèles de fonctionnement de bout en bout (tels que RT-1, RT-2, etc.) utilisent uniquement la modalité RVB, manquent de perception précise de la distance et ont une mauvaise généralisation aux changements dans de nouveaux environnements tels que la hauteur.

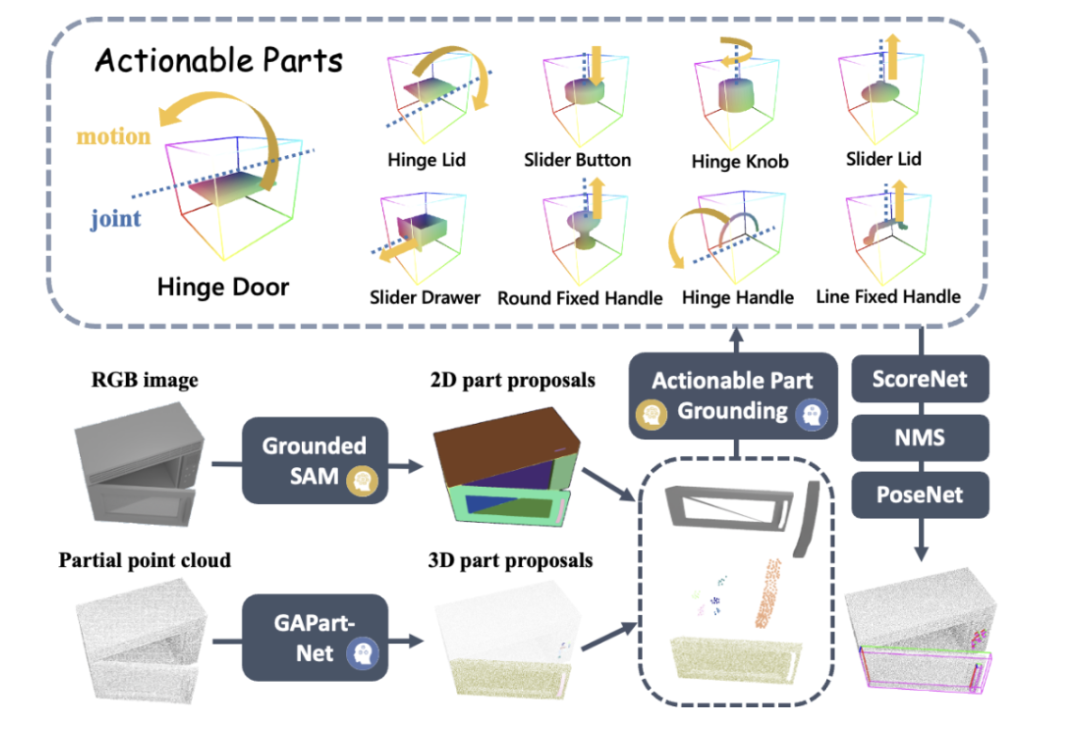

Inspirée par le précédent travail CVPR Highlight de l’équipe du professeur Wang He, GAPartNet [1], l’équipe de recherche s’est concentrée sur les pièces communes (GAParts) dans diverses catégories d’appareils électroménagers. Bien que les appareils électroménagers soient en constante évolution, il existe toujours quelques pièces indispensables. Il existe des géométries et des modèles d'interaction similaires entre chaque appareil électroménager et ces pièces communes.

En conséquence, l'équipe de recherche a introduit le concept de GAPart dans l'article GAPartNet [1]. GAPart fait référence à un composant généralisable et interactif. GAPart apparaît sur différentes catégories d'objets battants. Par exemple, les portes battantes peuvent être trouvées dans les coffres-forts, les armoires et les réfrigérateurs. Comme le montre la figure 3, GAPartNet [1] annote la sémantique et la pose de GAPart sur différents types d'objets.

Figure 3 : GAPart : parties généralisables et interactives [1].

Sur la base de recherches antérieures, l'équipe de recherche a introduit de manière créative GAPart basé sur la vision tridimensionnelle dans le système de manipulation d'objets du robot SAGE. SAGE fournira des informations pour VLM et LLM grâce à une détection de pièces 3D généralisable et une estimation précise de la pose. Au niveau de la prise de décision, la nouvelle méthode résout le problème des capacités de calcul et de raisonnement précises insuffisantes du modèle graphique bidimensionnel ; au niveau de l'exécution, la nouvelle méthode réalise des opérations généralisées sur chaque pièce grâce à une API d'opération physique robuste basée sur GAPart pose.

SAGE constitue le premier système de modèles graphiques et textuels incarnés en trois dimensions à grande échelle, fournissant de nouvelles idées pour l'ensemble du lien entre les robots, de la perception à l'interaction physique jusqu'au feedback, et explorant de nouvelles façons pour les robots de contrôler intelligemment et universellement des objets complexes tels que comme les meubles et les appareils électroménagers.

Introduction au système

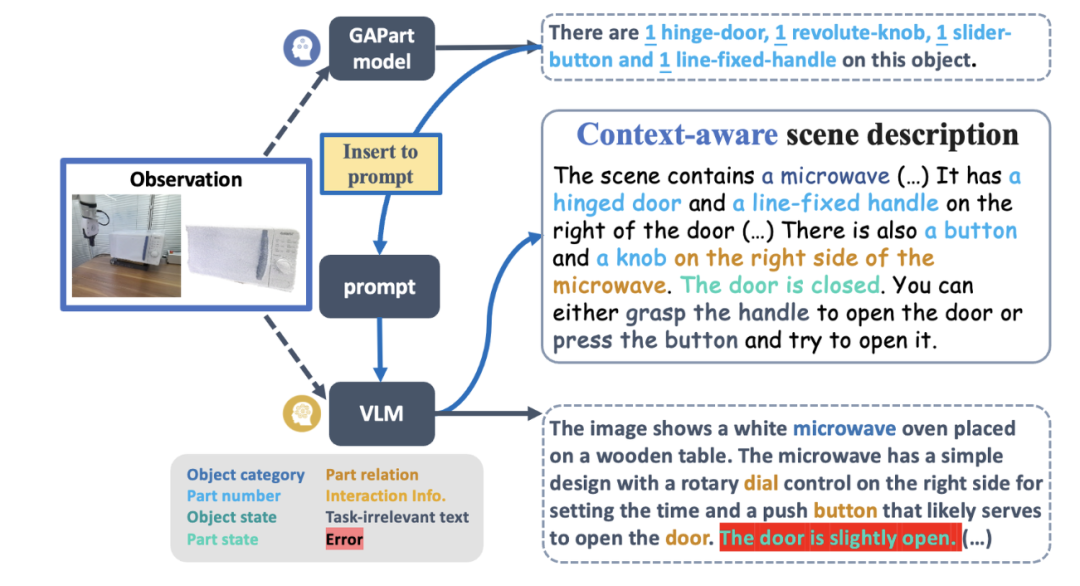

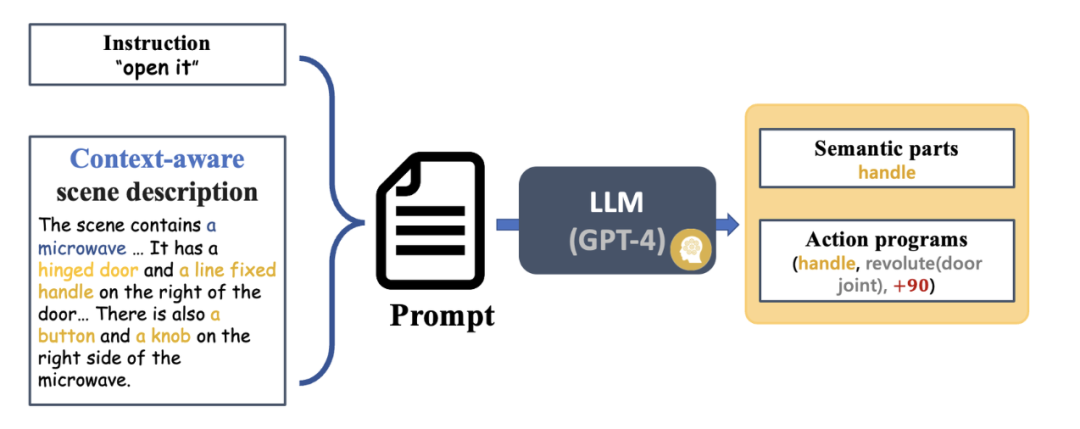

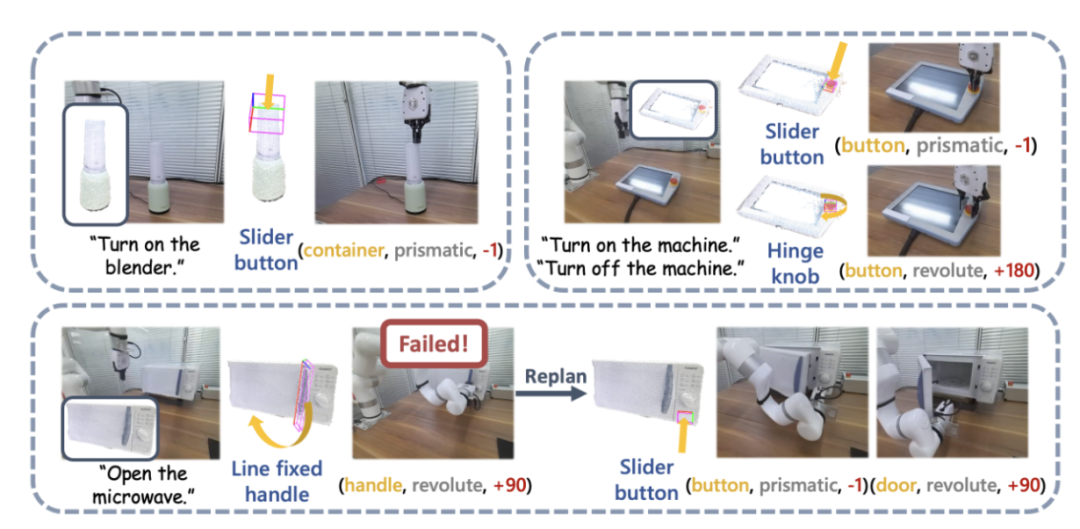

La figure 4 montre le processus de base de SAGE. Premièrement, un module d'interprétation des instructions capable d'interpréter le contexte analysera les instructions entrées dans le robot et ses observations, et convertira ces analyses en le prochain programme d'action du robot et ses parties sémantiques associées. Ensuite, SAGE mappe la partie sémantique (telle que le conteneur) à la partie qui doit être actionnée (telle que le bouton coulissant) et génère des actions (telles que l'action « appuyer » sur le bouton) pour terminer la tâche.

Figure 4 : Aperçu des méthodes.

Figure 11 : Expérience de simulation SAPIEN.

Ils ont utilisé l'environnement SAPIEN [4] pour mener des expériences de simulation et ont conçu 12 tâches de manipulation d'objets articulés guidées par le langage. Pour chaque catégorie de fours à micro-ondes, de meubles de rangement et d'armoires, 3 tâches ont été conçues, comprenant des états ouvert et fermé dans différents états initiaux. Les autres tâches sont « Ouvrir le couvercle du pot », « Appuyer sur le bouton de la télécommande » et « Démarrer le mixeur ». Les résultats expérimentaux montrent que SAGE fonctionne bien dans presque toutes les tâches.

Résumé

SAGE est le premier cadre de modèle de langage visuel 3D capable de générer des instructions générales de manipulation pour des objets articulés complexes tels que des meubles et des appareils électroménagers. Il convertit les actions ordonnées par le langage en manipulations exécutables en reliant la sémantique des objets et la compréhension de l'opérabilité au niveau des pièces.

Présentation de l'équipe

SAGE Ce résultat de recherche provient du laboratoire du professeur Leonidas Guibas de l'Université de Stanford, de l'Emboded Perception and Interaction (EPIC Lab) du professeur Wang He de l'Université de Pékin et de l'Institut de recherche sur l'intelligence artificielle Zhiyuan. Les auteurs de l'article sont Geng Haoran (co-auteur), étudiant à l'Université de Pékin et chercheur invité à l'Université de Stanford, Wei Songlin, doctorant à l'Université de Pékin (co-auteur), Deng Congyue et Shen Bokui, doctorants à l'Université de Stanford, et les superviseurs sont le professeur Leonidas. Guibas et le professeur Wang He.Références :

[2] Kirillov, Alexander, Eric Mintun, Nikhila Ravi, Hanzi Mao, Chloe Rolland, Laura Gustafson, Tete Xiao et al. "Segmentez n'importe quoi."

[3] Zhang, Hao, Feng Li, Shilong Liu, Lei Zhang, Hang Su, Jun Zhu, Lionel M. Ni et Heung-Yeung Shum. « Dino : Detr avec des boîtes d'ancrage de débruitage améliorées pour une utilisation de bout en bout. détection d'objet final." Préimpression arXiv arXiv : 2203.03605 (2022). environnement interactif." Dans Actes de la conférence IEEE/CVF sur la vision par ordinateur et la reconnaissance de formes, pp.11097-11107.2020.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Présentation d'une boîte de message améliorée (MessageBoxEx) en C# qui peut transporter des messages supplémentaires

- Quelles connaissances les ingénieurs PHP doivent-ils connaître ?

- Code pour postmessage en HTML5 pour implémenter le transfert de valeur entre les fenêtres enfant et parent

- Quel âge faut-il pour devenir ingénieur front-end WEB ?