Maison >Périphériques technologiques >IA >Transformer révolutionne la modélisation 3D et l'effet de génération MeshGPT alarme les modélisateurs professionnels et les internautes : une idée révolutionnaire

Transformer révolutionne la modélisation 3D et l'effet de génération MeshGPT alarme les modélisateurs professionnels et les internautes : une idée révolutionnaire

- 王林avant

- 2023-11-29 14:17:201321parcourir

Dans le domaine de l'infographie, le maillage triangulaire est le principal moyen de représenter des objets géométriques 3D, et c'est également la méthode d'expression de ressources 3D la plus couramment utilisée dans les jeux, les films et les interfaces de réalité virtuelle. L'industrie utilise généralement des maillages triangulaires pour simuler les surfaces d'objets complexes, tels que des bâtiments, des véhicules, des animaux, etc. Dans le même temps, les transformations géométriques courantes, les opérations de détection de géométrie, de rendu et d'ombrage doivent également être effectuées sur la base de maillages triangulaires. Par rapport à d'autres représentations de formes 3D telles que des nuages de points ou des voxels, les maillages triangulaires fournissent une représentation plus cohérente : plus. contrôlable, plus facile à utiliser, plus compact et peut être directement appliqué dans les pipelines de rendu modernes, obtenant une qualité visuelle supérieure avec moins de primitives

Des chercheurs précédents ont essayé d'utiliser des méthodes de représentation de volumes telles que les pixels, les nuages de points et les neurones. les champs sont utilisés pour générer des modèles 3D. Ces méthodes de représentation doivent également être converties en maillages via un post-traitement pour être utilisées dans des applications en aval, telles que l'utilisation de l'algorithme Marching Cubes pour le traitement des isosurfaces

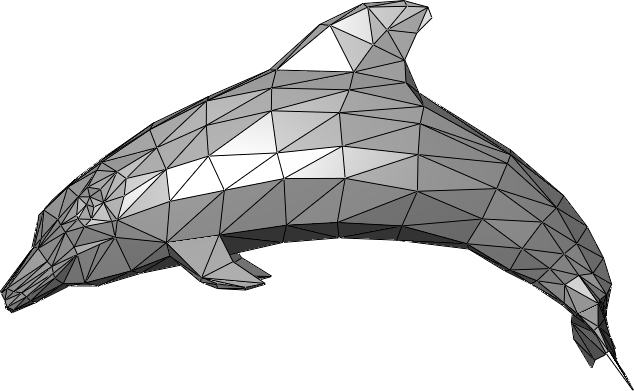

Malheureusement, cette approche peut conduire à les maillages trop denses et trop fins, souvent avec des erreurs cahoteuses causées par un lissage excessif et un isosurfaçage, comme celui présenté ci-dessous :

En comparaison, les maillages 3D modélisés par des professionnels de la modélisation 3D sont plus compacts en représentation tout en conservant des détails nets avec moins de triangles.

De nombreux chercheurs espèrent depuis longtemps résoudre le problème de génération automatique de maillages triangulaires afin de simplifier davantage le processus de production d'actifs 3D.

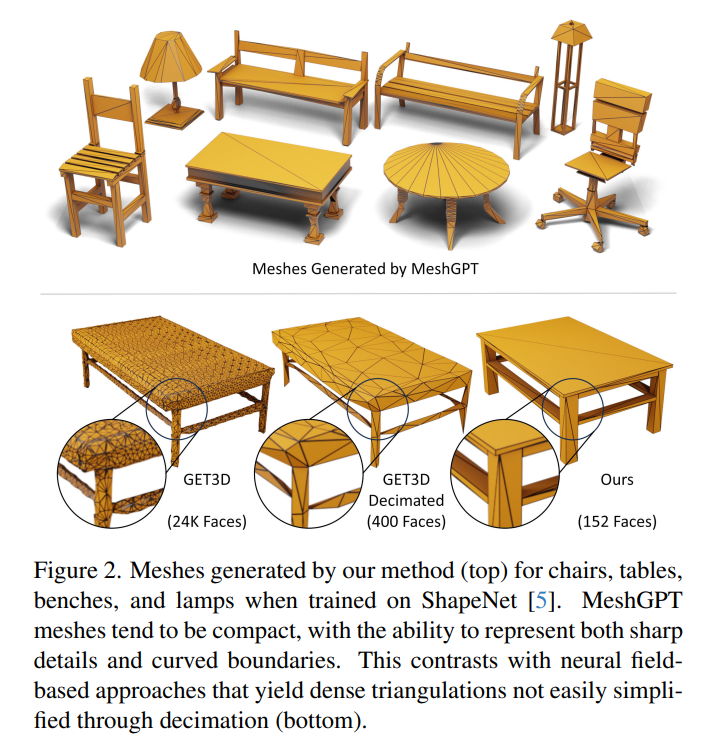

Dans un article récent, des chercheurs ont proposé une nouvelle solution : MeshGPT, qui génère directement la représentation du maillage sous la forme d'un ensemble de triangles.

Le lien vers l'article peut être trouvé sur : https://nihalsid.github.io/mesh-gpt/static/MeshGPT.pdf

Inspirés par le modèle de génération de langage Transformer, ils ont adopté un Méthode de génération de séquence directe, synthétisant des maillages triangulaires en séquences triangulaires

En suivant le paradigme de génération de texte, les chercheurs ont d'abord appris le vocabulaire des triangles, et les triangles ont été codés sous forme d'intégrations quantifiées latentes. Pour encourager les intégrations de triangles apprises à préserver les caractéristiques géométriques et topologiques locales, nous utilisons un codeur convolutif graphique. Ces intégrations de triangles sont ensuite décodées par un décodeur ResNet, qui traite la séquence de jetons représentant les triangles pour générer les coordonnées des sommets des triangles. Enfin, les chercheurs ont formé une architecture basée sur GPT basée sur le vocabulaire appris pour générer automatiquement une séquence de triangles représentant le maillage, et ont obtenu les avantages de bords clairs et de haute fidélité.

Des expériences dans plusieurs catégories sur l'ensemble de données ShapeNet montrent que MeshGPT améliore considérablement la qualité des maillages 3D générés

par rapport aux techniques existantes, avec une amélioration moyenne de 9 % de la couverture de forme et des scores FID améliorés de 30 points.

Sur les plateformes de médias sociaux, MeshGPT a également suscité des discussions animées :

Quelqu'un a dit un jour : "C'est une idée vraiment révolutionnaire

Un internaute a souligné que le point culminant." L'un des avantages de cette méthode est qu'elle surmonte le plus gros obstacle des autres méthodes de modélisation 3D, à savoir les capacités d'édition.

Quelqu'un a prédit avec audace que peut-être tous les problèmes qui n'ont pas été résolus depuis les années 1990 pourraient être inspirés par Transformer :

Il y a également des utilisateurs engagés dans des industries liées à la production 3D/film qui ont exprimé des inquiétudes concernant leur carrière :

Cependant, certaines personnes ont souligné que selon les exemples de génération fournis dans le papier, cette méthode est encore Elle n’a pas atteint le stade d’application à grande échelle. Un modélisateur professionnel pourrait totalement créer ces maillages en moins de 5 minutes

Ce commentateur a suggéré que la prochaine étape pourrait être de laisser LLM contrôler la génération des graines 3D et ajouter le modèle d'image à la partie autorégressive de l'architecture. Une fois ce point atteint, la production d’actifs 3D pour les jeux et autres scènes peut être automatisée à grande échelle.

Ensuite, jetons un coup d'œil aux détails de la recherche de l'article MeshGPT.

Aperçu de la méthode

Inspirés par les progrès des grands modèles de langage, les chercheurs ont développé une méthode basée sur les séquences qui génère de manière autorégressive des maillages triangulaires sous forme de séquences triangulaires. Cette méthode produit des maillages propres, cohérents et compacts avec des arêtes vives et une haute fidélité.

Les chercheurs ont d'abord appris les incorporations de vocabulaire géométrique à partir d'un grand nombre de maillages d'objets 3D pour pouvoir encoder et décoder des triangles. Ensuite, sur la base du vocabulaire d'intégration appris, le transformateur pour la génération de grille est entraîné de manière autorégressive pour la prédiction d'index.

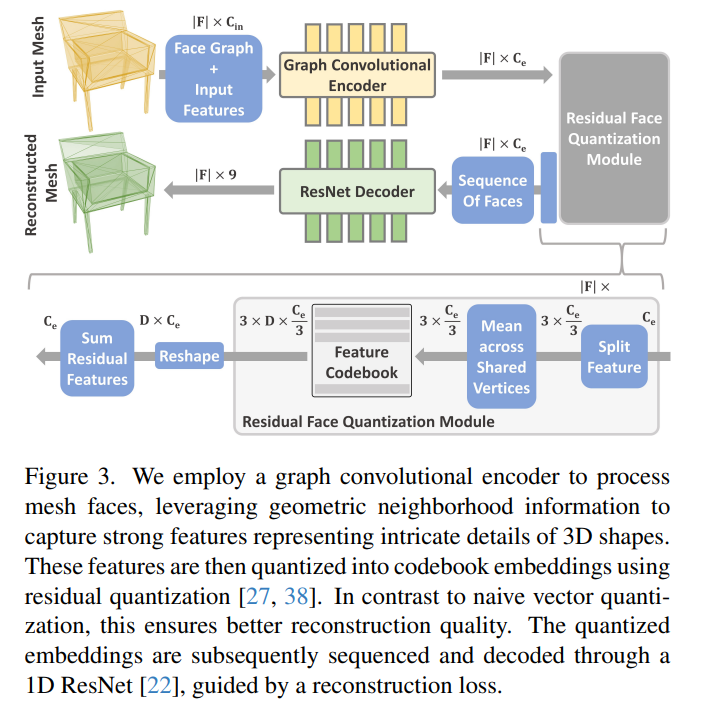

Pour apprendre le vocabulaire des triangles, les chercheurs ont adopté un encodeur convolutionnel graphique qui opère sur les triangles du maillage et leurs voisinages pour extraire de riches caractéristiques géométriques et capturer les détails complexes des formes 3D. Ces caractéristiques sont quantifiées en tant qu'incorporation dans le livre de codes via une quantification résiduelle, réduisant ainsi la longueur de séquence de la représentation en grille. Après tri, ces informations embarquées sont décodées par un ResNet unidimensionnel guidé par la perte de reconstruction. Cette étape jette les bases de la formation ultérieure de Transformer.

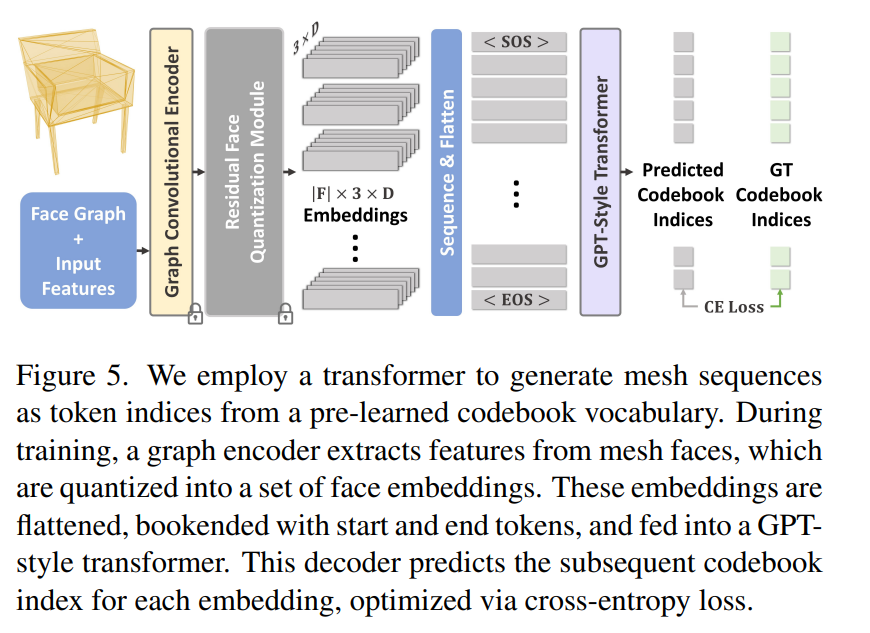

Ensuite, les chercheurs ont utilisé ces intégrations géométriques quantifiées pour former un transformateur décodeur pur similaire à GPT. Pour ce faire, ils extraient une séquence d'intégrations géométriques dans des triangles maillés et entraînent le transformateur à prédire l'index du livre de codes de la prochaine intégration dans la séquence.

Après l'entraînement, le transformateur peut échantillonner de manière autorégressive pour prédire la séquence d'intégrations, puis décoder. Ces intégrations génèrent des structures de maillage nouvelles et diverses qui présentent des triangles irréguliers efficaces similaires aux maillages dessinés par l'homme.

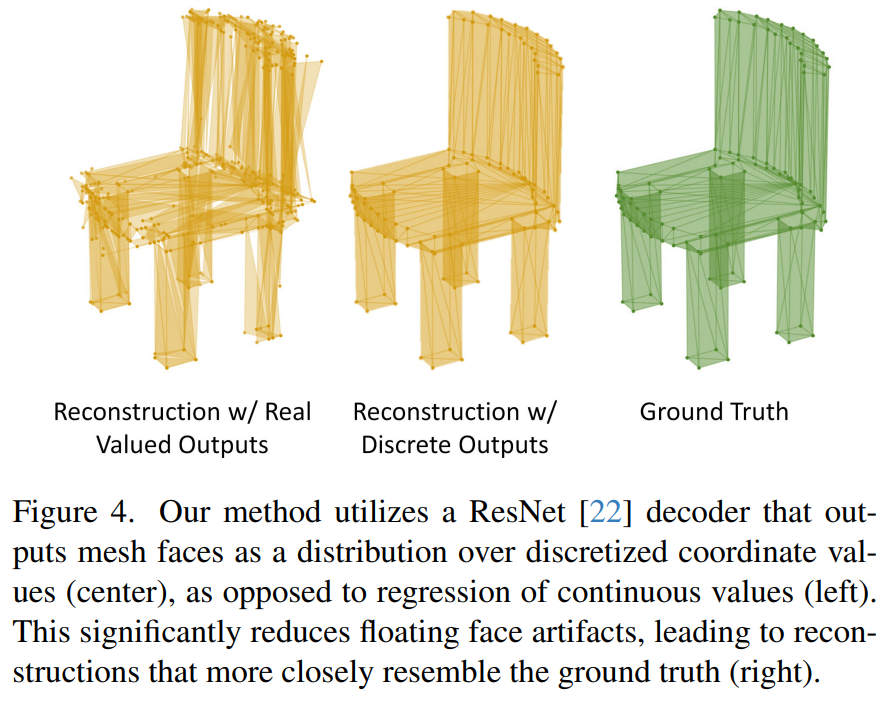

MeshGPT utilise un encodeur de convolution graphique pour traiter les surfaces maillées, utilise les informations de voisinage géométrique pour capturer des caractéristiques fortes qui représentent les détails complexes des formes 3D, puis utilise la méthode de quantification résiduelle pour quantifier ces caractéristiques en intégrations de livres de codes . Cette approche garantit une meilleure qualité de reconstruction par rapport à une simple quantification vectorielle. Guidé par la perte de reconstruction, MeshGPT trie et décode les plongements quantifiés via ResNet.

Cette étude utilise le modèle Transformer pour générer des séquences de grille en tant qu'index de jetons à partir de la bibliothèque de vocabulaire du livre de codes pré-entraîné. Pendant l'entraînement, l'encodeur d'image extrait les caractéristiques des surfaces maillées et les quantifie dans un ensemble d'intégrations de surfaces. Ces intégrations sont carrelées, marquées avec des jetons de début et de fin, puis introduites dans le modèle Transformer de type GPT décrit ci-dessus. Le décodeur est optimisé avec une perte d'entropie croisée, prédisant l'index du livre de codes ultérieur pour chaque intégration

Résultats expérimentaux

L'étude a mené des expériences comparant MeshGPT avec des méthodes de génération de maillage courantes, notamment :

- Polygen, qui génère des maillages polygonaux en générant d'abord des sommets puis des faces conditionnées sur les sommets ;

- BSPNet, qui représente les maillages par décomposition convexe

- AtlasNet, qui représente les maillages 3D comme de multiples déformations 2D du plan ;

De plus, l'étude a comparé MeshGPT à la méthode SOTA basée sur le champ neuronal GET3D.

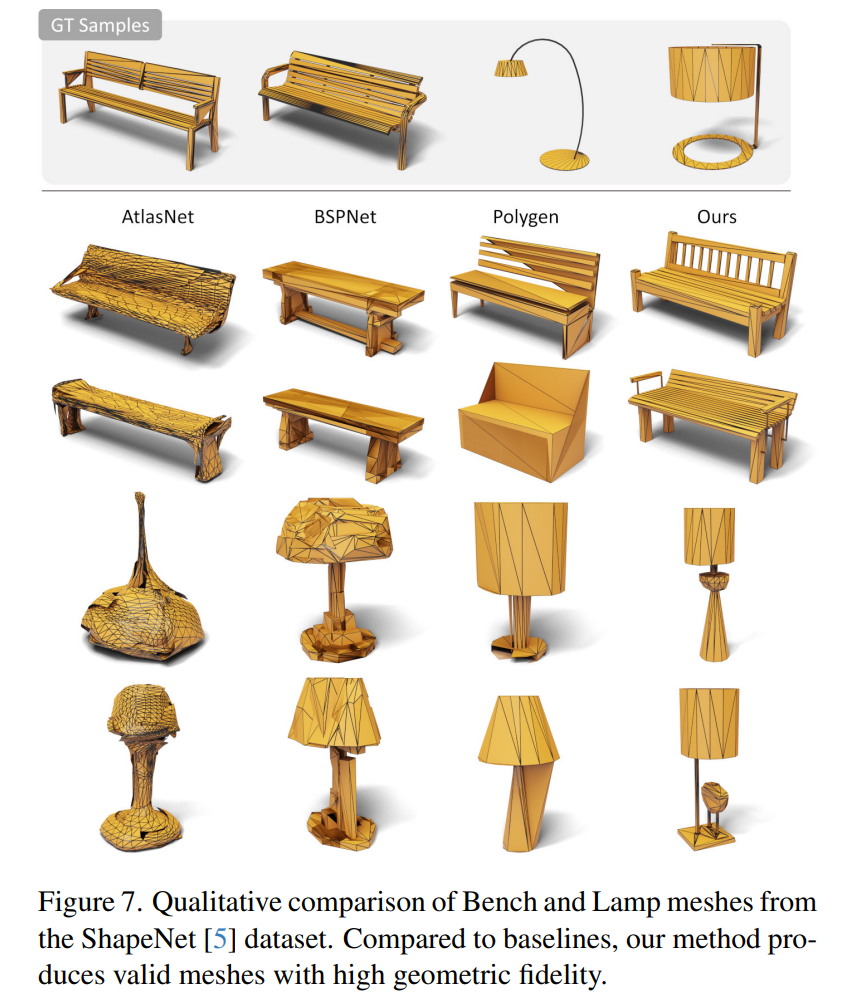

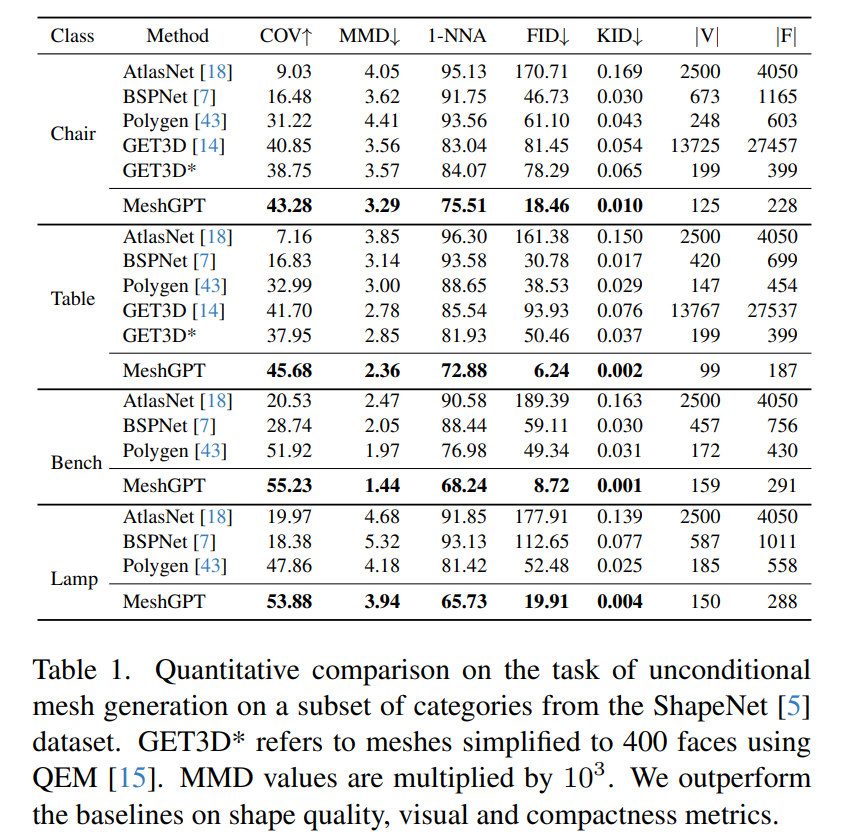

Comme le montrent les figures 6, 7 et le tableau 1, MeshGPT surpasse la méthode de base dans les 4 catégories. MeshGPT peut générer des maillages nets et compacts avec des détails géométriques plus fins.

Plus précisément, par rapport à Polygen, MeshGPT peut générer des formes avec des détails plus complexes, et Polygen est plus susceptible d'accumuler des erreurs lors de l'inférence ; AtlasNet souffre souvent d'artefacts de pliage, ce qui entraîne une diversité et une qualité de forme inférieures par BSPNet ; les arbres ont tendance à produire des formes en blocs avec des motifs de triangulation inhabituels ; GET3D produit une bonne structure de forme de haut niveau, mais avec trop de triangles et de plans imparfaits.

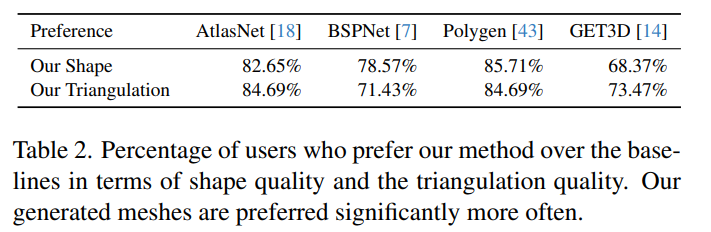

Comme le montre le tableau 2, l'étude permet également aux utilisateurs d'évaluer la qualité du maillage généré par MeshGPT. En termes de forme et de qualité de triangulation, MeshGPT est nettement meilleur. qu'AtlasNet, Polygen et BSPNet. La plupart des utilisateurs ont préféré la qualité de forme (68 %) et la qualité de triangulation (73 %) générées par MeshGPT par rapport à GET3D.

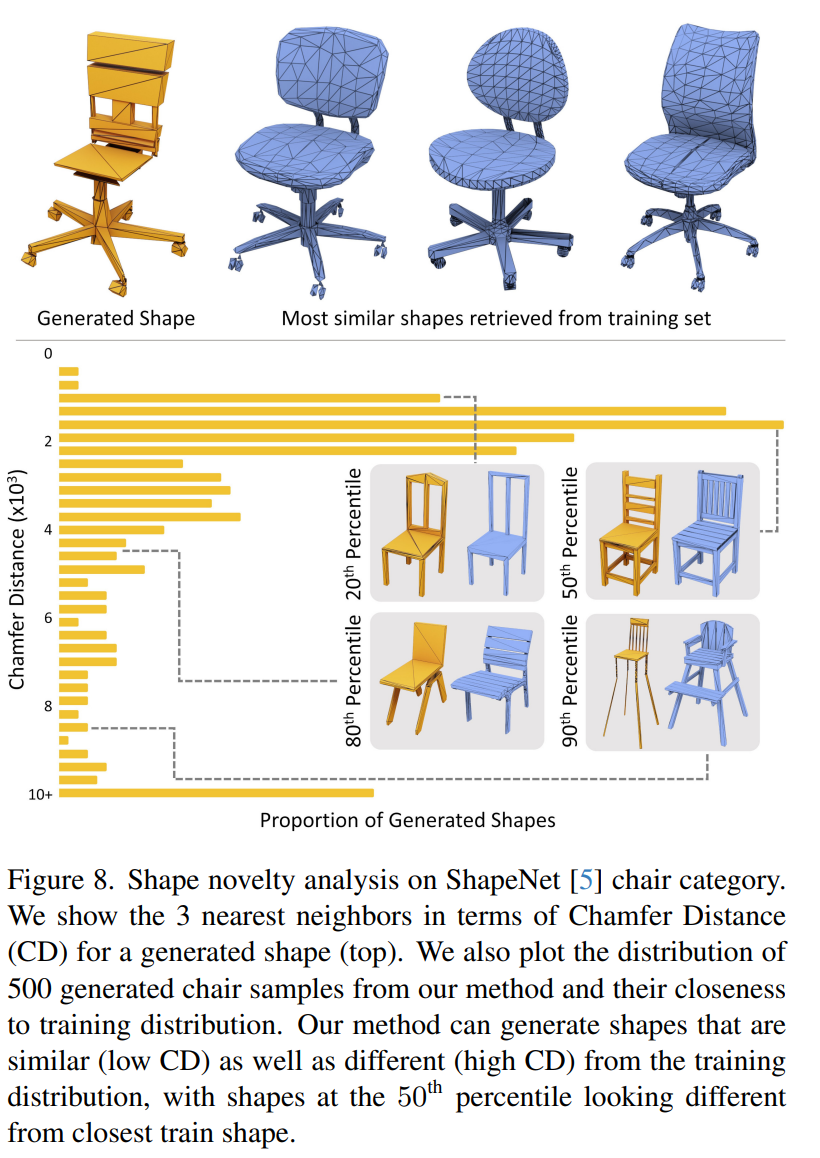

Le contenu réécrit est : une forme inédite. Comme le montre la figure 8, MeshGPT est capable de générer de nouvelles formes au-delà de l'ensemble de données d'entraînement, garantissant que le modèle fait plus que simplement récupérer des formes existantes

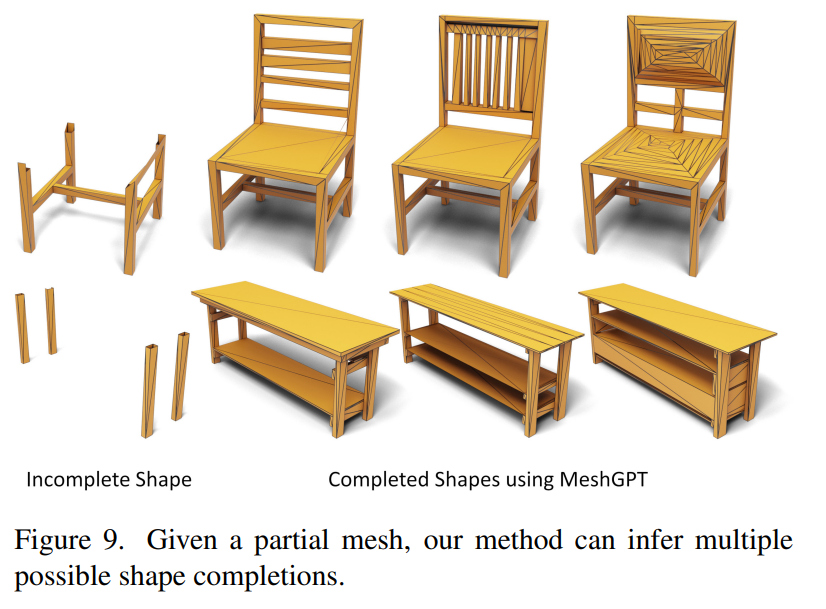

achèvement de la forme. Comme le montre la figure 9 ci-dessous, MeshGPT peut également déduire plusieurs complétions possibles en fonction d'une forme locale donnée et générer plusieurs hypothèses de forme.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!