Maison >Périphériques technologiques >IA >Google lance Mirasol : 3 milliards de paramètres, étendant la compréhension multimodale aux longues vidéos

Google lance Mirasol : 3 milliards de paramètres, étendant la compréhension multimodale aux longues vidéos

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-11-17 23:39:011183parcourir

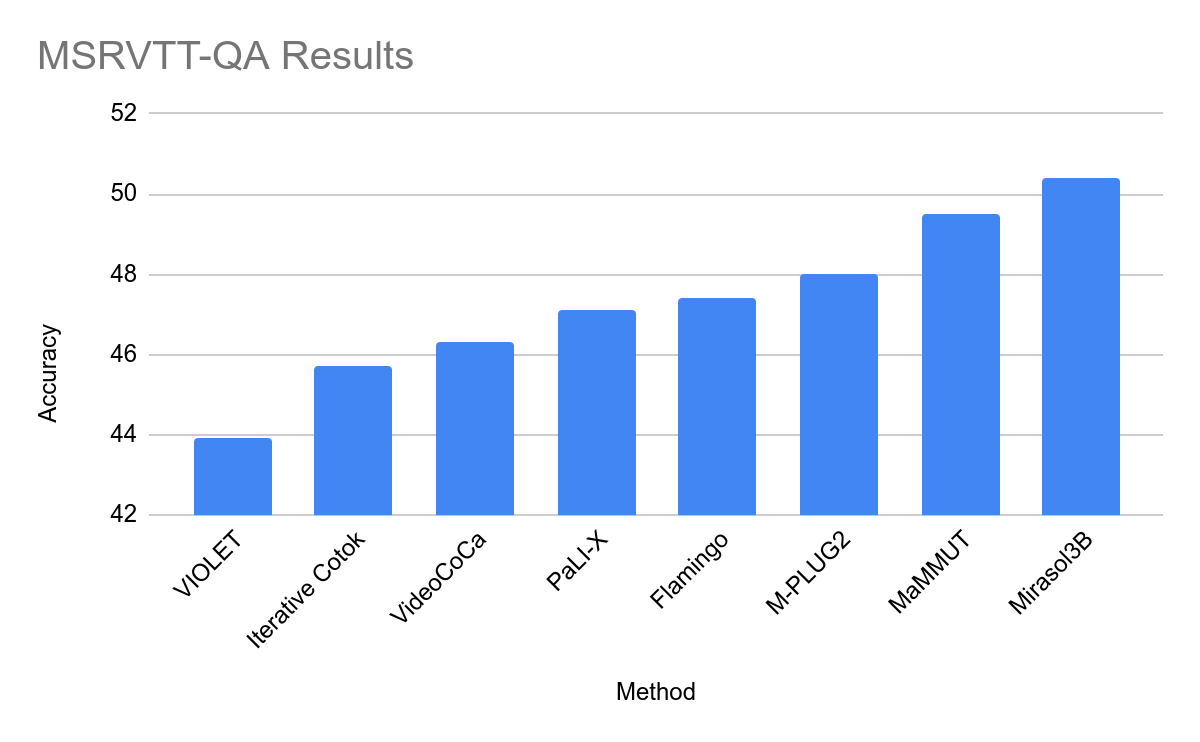

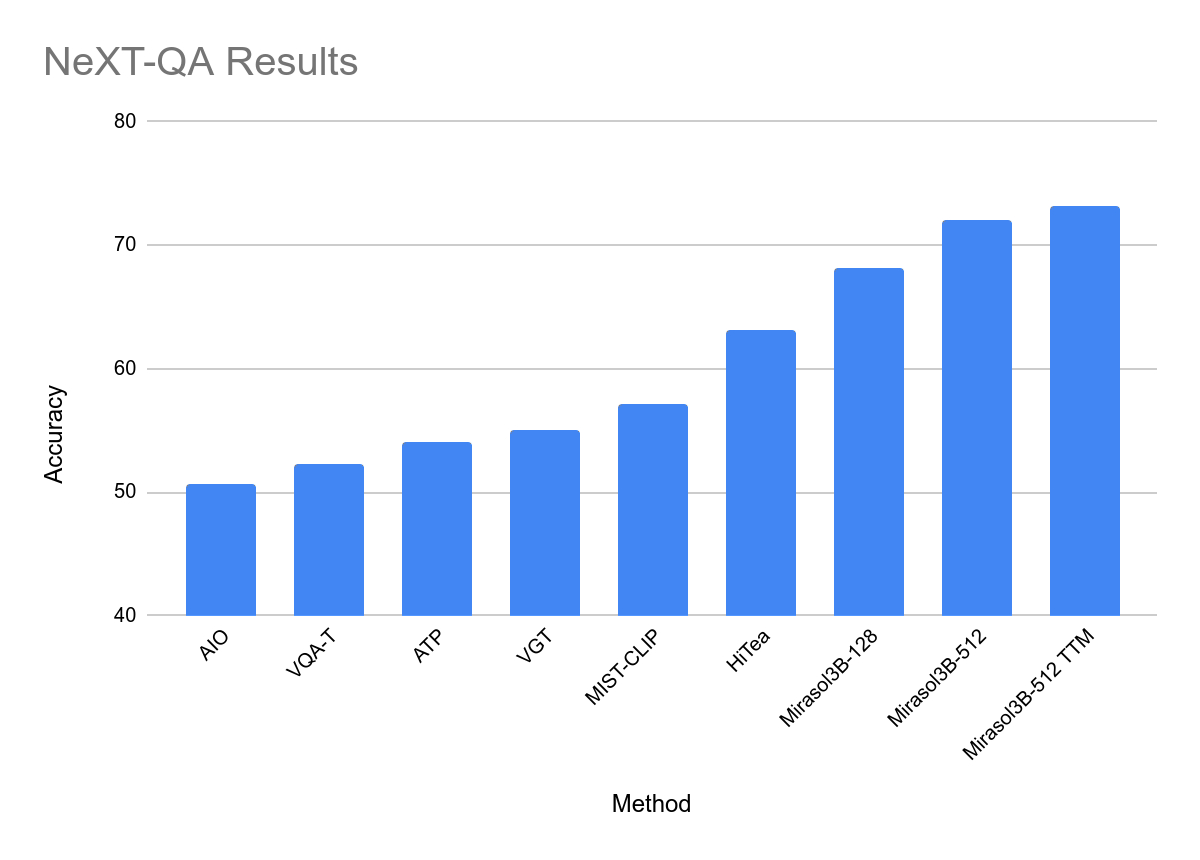

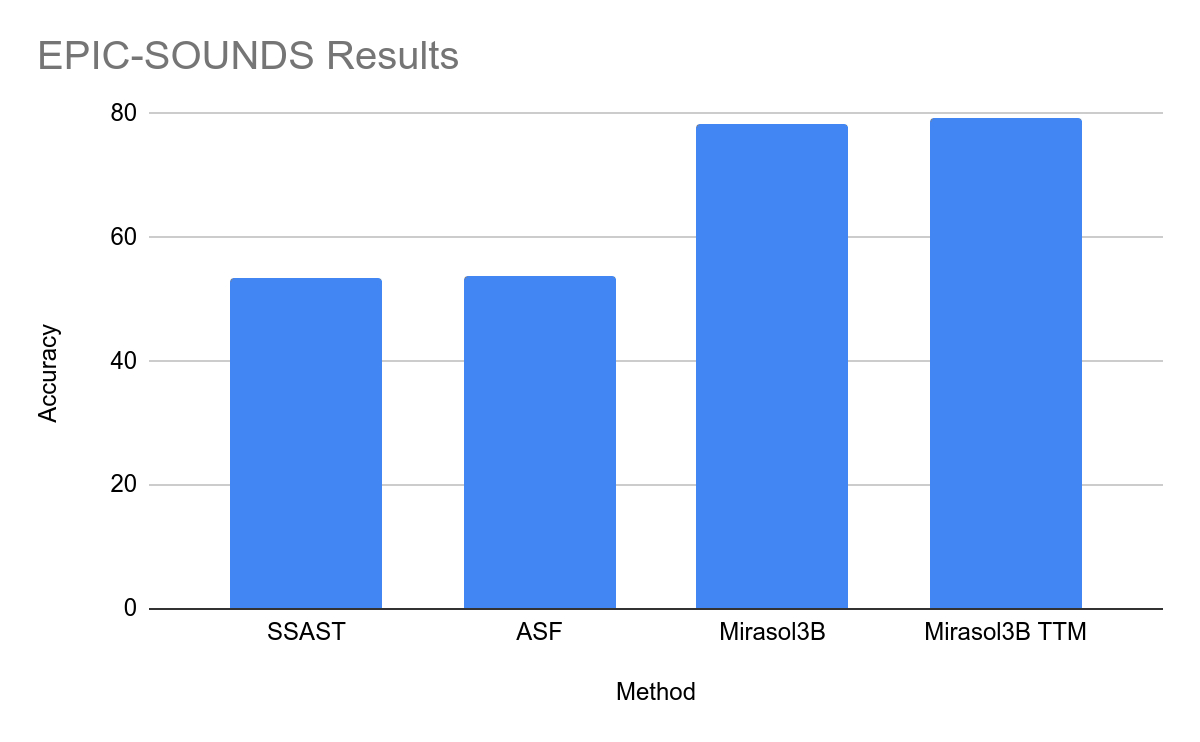

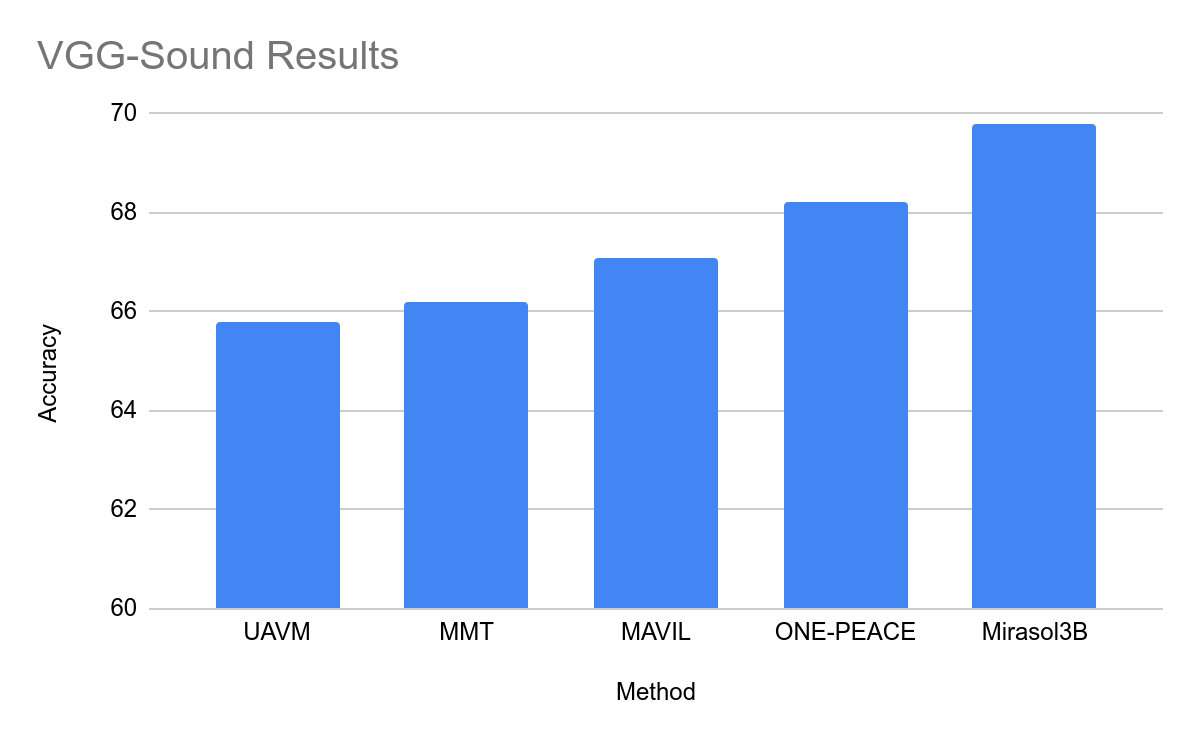

Le 16 novembre, Google a récemment publié un communiqué de presse présentant Mirasol, un petit modèle d'intelligence artificielle capable de répondre aux questions sur les vidéos et d'établir de nouveaux records.

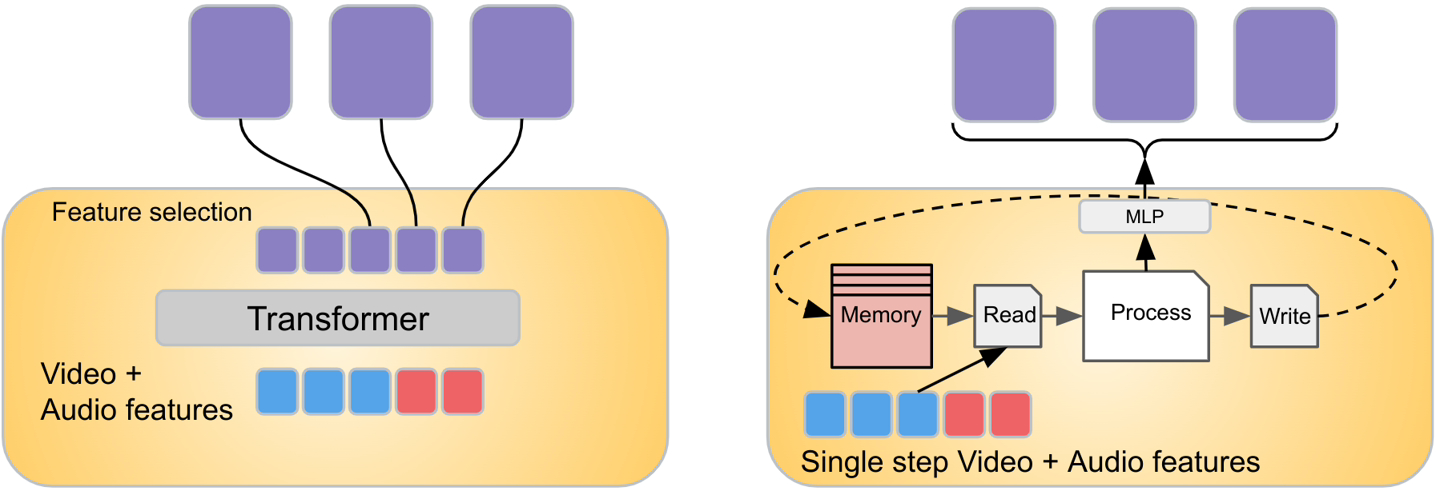

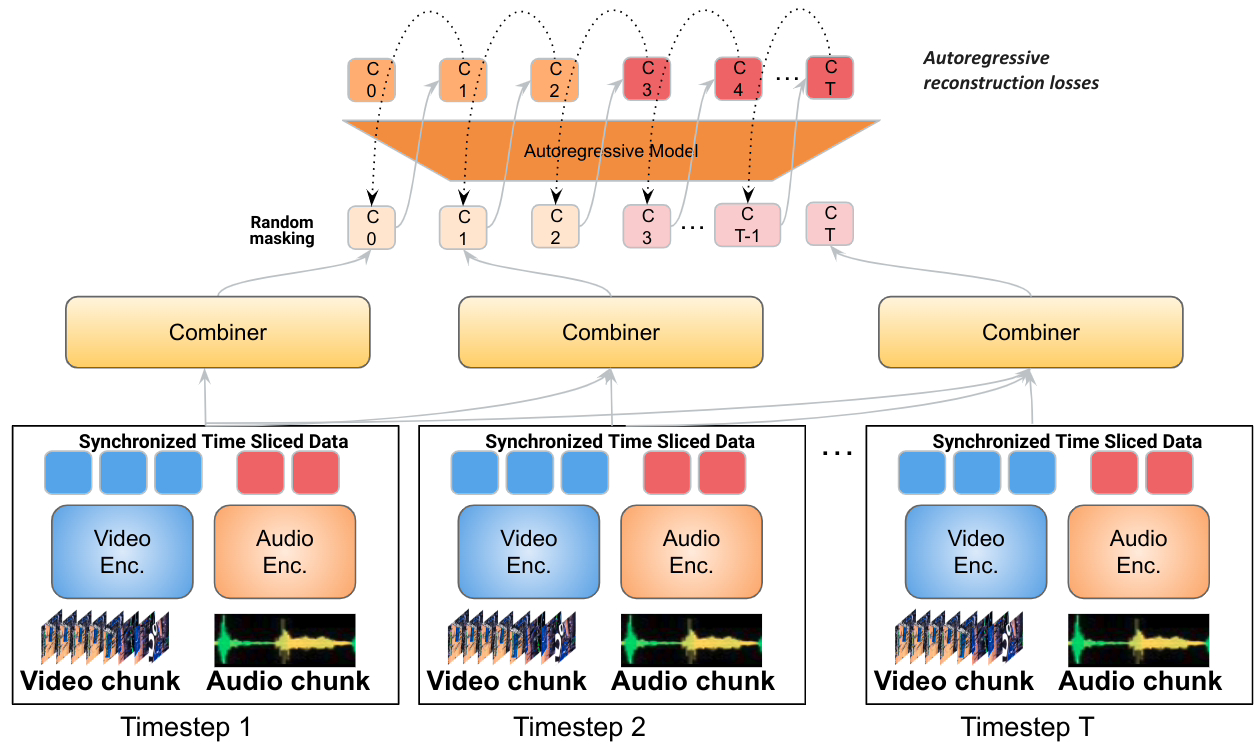

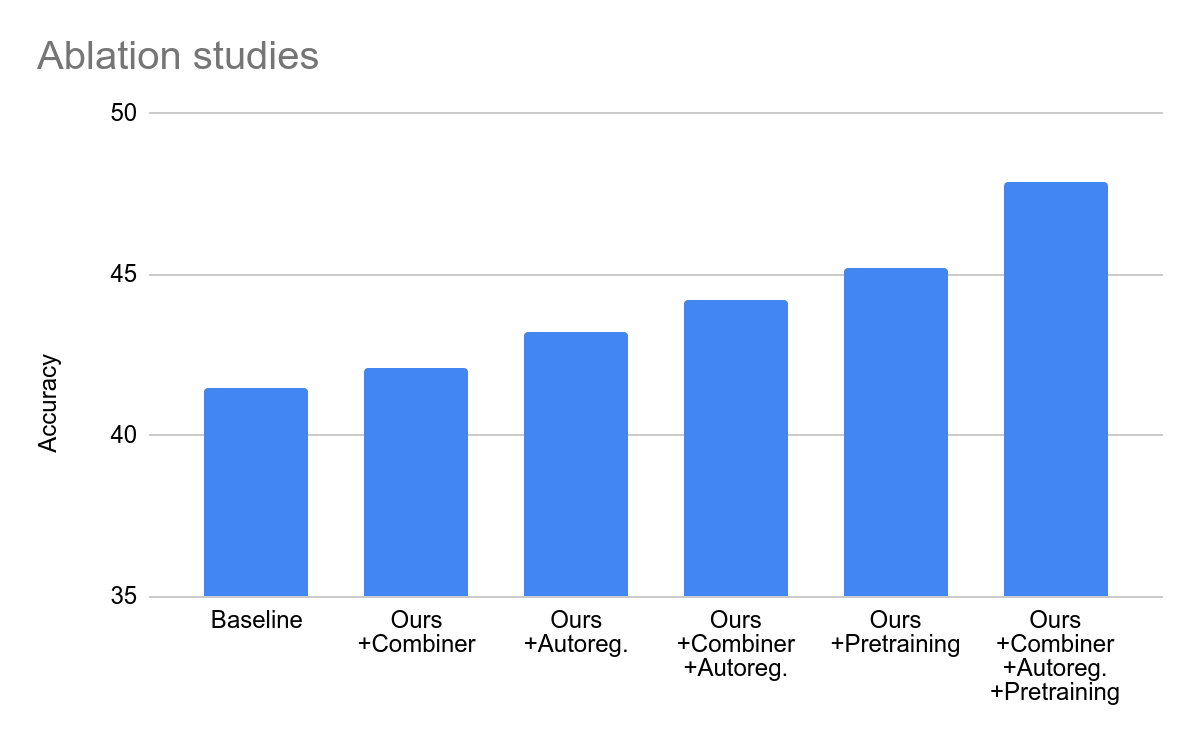

- La nécessité de synchroniser la vidéo et l'audio à des fréquences d'échantillonnage élevées, mais de traiter les titres et les descriptions vidéo de manière asynchrone.

- La vidéo et l'audio génèrent une grande quantité de données, ce qui peut mettre à rude épreuve la capacité du modèle.

version officielle de Mirasol Press release , les utilisateurs intéressés peuvent le lire en profondeur.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Déclaration:

Cet article est reproduit dans:. en cas de violation, veuillez contacter admin@php.cn Supprimer

Article précédent:La session spéciale « AI Super Base » de Tencent Cloud sera dévoilée lors de la conférence WOT, et l'innovation technologique ouvrira un nouveau chapitre dans l'infrastructure de l'IA.Article suivant:La session spéciale « AI Super Base » de Tencent Cloud sera dévoilée lors de la conférence WOT, et l'innovation technologique ouvrira un nouveau chapitre dans l'infrastructure de l'IA.

Articles Liés

Voir plus- Comment installer le plug-in Google json-view

- Quelles sont les principales manifestations de l'intégration de l'intelligence artificielle et de l'éducation ?

- Quelle est l'importance de l'intelligence artificielle

- L'impact de l'intelligence artificielle sur nos vies

- Comment réparer Google Translate ne fonctionne pas dans Chrome sous Windows 10/11