Maison >Périphériques technologiques >IA >UC Berkeley Google innove en LLM, implémente un modèle de diffusion sur terminal et l'utilise pour IGN pour générer des images réalistes en une seule étape, et les séries télévisées américaines deviennent une source d'inspiration

UC Berkeley Google innove en LLM, implémente un modèle de diffusion sur terminal et l'utilise pour IGN pour générer des images réalistes en une seule étape, et les séries télévisées américaines deviennent une source d'inspiration

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-11-14 08:30:091338parcourir

Le modèle de diffusion devenu populaire dans la moitié du monde va-t-il être éliminé ?

Actuellement, les modèles d'IA génératifs, tels que les GAN, les modèles de diffusion ou les modèles de cohérence, génèrent des images en mappant les entrées sur les sorties correspondant à la distribution des données cible. Le contenu qui doit être réécrit est :

Normalement, ceci. Ce type de modèle doit apprendre beaucoup d'images réelles, puis il peut essayer de garantir les caractéristiques réelles des images générées. Le contenu qui doit être réécrit est le suivant :

Récemment, des chercheurs de l'UC Berkeley et de Google ont proposé un modèle. modèle nouvelle génération—— Le contenu qui doit être réécrit pour le Réseau Générateur Idempotent (IGN) est :

Photos

Photos

Adresse papier : https://arxiv.org/abs/2311.01462

Les IGN peuvent être sélectionnés parmi une variété d'entrées, telles que du bruit aléatoire, des graphiques simples, etc., pour générer des images réalistes en une seule étape sans avoir besoin d'une itération en plusieurs étapes. Le contenu qui doit être réécrit est :

. Ce modèle vise à devenir un projecteur « global mapper » (global mapper)), capable de mapper n'importe quelle donnée d'entrée à la distribution de données cible. Le contenu qui doit être réécrit est :

En bref, le modèle général de génération d'images. Ça doit être comme ça à l'avenir. Le contenu qui doit être réécrit est :

Intéressant Oui, une scène efficace dans "Seinfeld" s'est avérée être une source d'inspiration pour l'auteur. est :

Image

Image

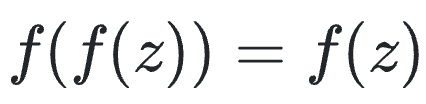

Cette scène résume bien "l'opérateur idempotent" ) Ce concept signifie que pendant le processus d'opération, la même entrée est actionnée à plusieurs reprises et le résultat est toujours le même. doit être réécrit est :

C'est-à-dire

l'image

l'image

doit être réécrite Le contenu réécrit est :

Comme Jerry Seinfeld l'a souligné avec humour, certains comportements de la vie réelle peuvent également être envisagés idempotent Le contenu réécrit est :

Réseaux Génératifs Impuissants

IGN avec Il existe deux différences importantes entre le GAN et les modèles de diffusion :

- Contrairement au GAN, l'IGN ne nécessite pas de générateurs ni de discriminateurs séparés. C'est un "soi". -confrontation" qui complète à la fois les exigences de génération et de discrimination. Le contenu réécrit est :

- Contrairement au modèle de diffusion qui effectue des étapes incrémentielles, IGN tente de mapper l'entrée à la distribution des données en une seule étape. Le contenu réécrit est :

IGN (modèle génératif idempotent) Quelle est la source ?

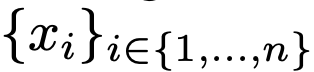

Il est formé pour provenir de la distribution source  Étant donné la distribution cible

Étant donné la distribution cible  des échantillons d'entrée, ce qui doit être réécrit pour générer les échantillons est :

des échantillons d'entrée, ce qui doit être réécrit pour générer les échantillons est :

Étant donné l'exemple d'ensemble de données  , chaque exemple Les deux sont tirés de

, chaque exemple Les deux sont tirés de  Le contenu qui doit être réécrit est : Ensuite, les chercheurs ont entraîné le modèle

Le contenu qui doit être réécrit est : Ensuite, les chercheurs ont entraîné le modèle  à mapper

à mapper  à

à  Le contenu qui doit être réécrit est :

Le contenu qui doit être réécrit est :

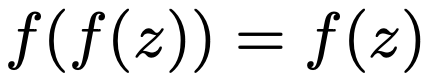

Supposons que les distributions  et

et  sont situées dans le même espace, c'est à dire que leurs instances ont les mêmes dimensions. Ce qu'il faut réécrire est : Cela permet d'appliquer

sont situées dans le même espace, c'est à dire que leurs instances ont les mêmes dimensions. Ce qu'il faut réécrire est : Cela permet d'appliquer  aux deux types d'instances

aux deux types d'instances  . et

. et  Le contenu qui doit être réécrit est :

Le contenu qui doit être réécrit est :

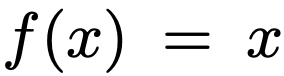

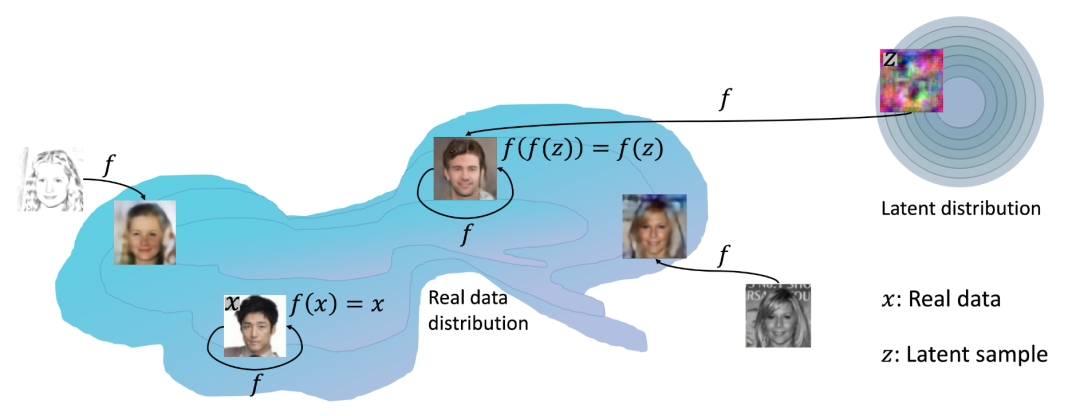

L'image montre l'idée de base derrière IGN : l'exemple réel (x) est invariant au modèle f  Le contenu qui doit être réécrit est : les autres entrées (z) sont mappées Le contenu qui doit être réécrit pour mapper f à son propre flux d'instance via l'optimisation

Le contenu qui doit être réécrit est : les autres entrées (z) sont mappées Le contenu qui doit être réécrit pour mapper f à son propre flux d'instance via l'optimisation  est :

est :

Images

Images

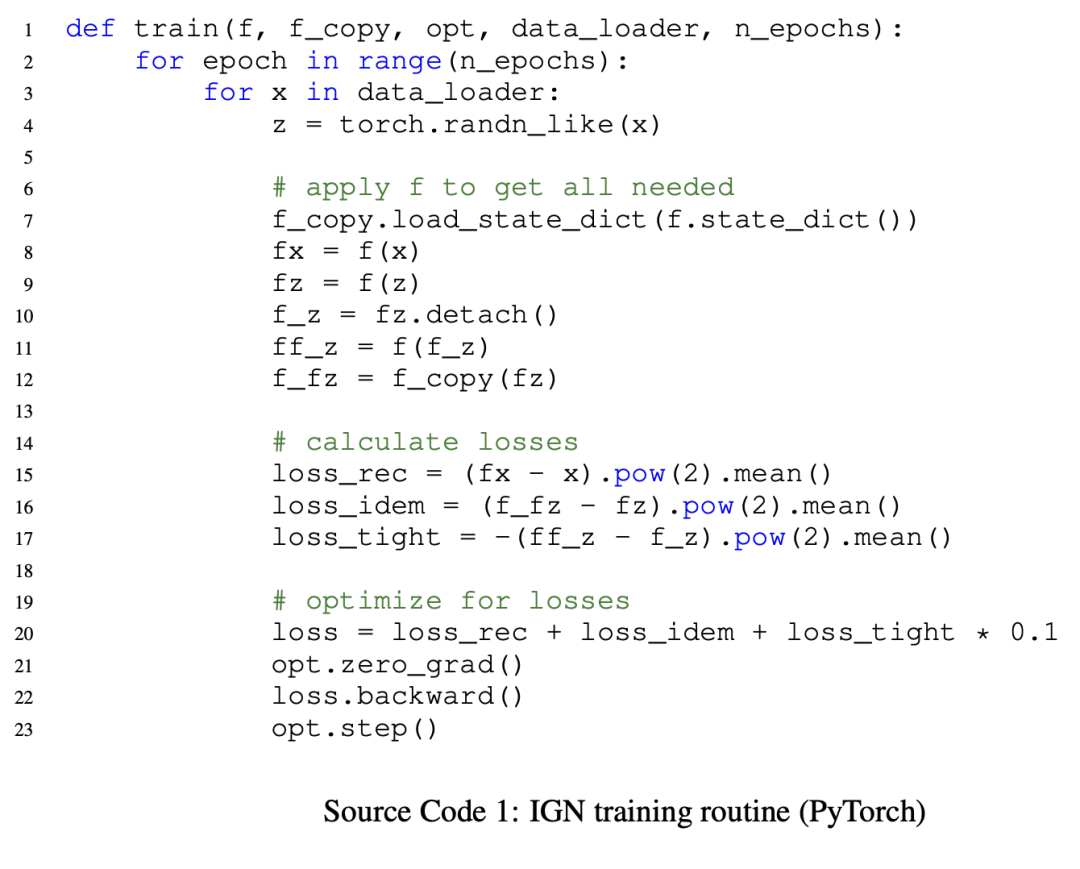

Une partie de l'exemple de routine de formation IGN Code PyTorch Le le contenu qui doit être réécrit est :

Photos

Photos

Résultats expérimentaux

Quel est l'effet après avoir obtenu l'IGN ?

L'auteur admet qu'à ce stade, les résultats générés par l'IGN ne peuvent pas rivaliser avec les modèles de pointe. Ce qui doit être réécrit est :

Dans les expériences, des modèles plus petits et une résolution plus faible. les données ont été utilisées Set, et dans l'exploration, nous nous concentrons principalement sur les méthodes simplifiées qui doivent être réécrites :

Bien sûr, les technologies de modélisation générative de base, telles que le GAN et les modèles de diffusion, ont également mis beaucoup de temps à atteindre leur maturité. et l'échelle. Ce qui doit être réécrit pour les performances est :

Configuration expérimentale

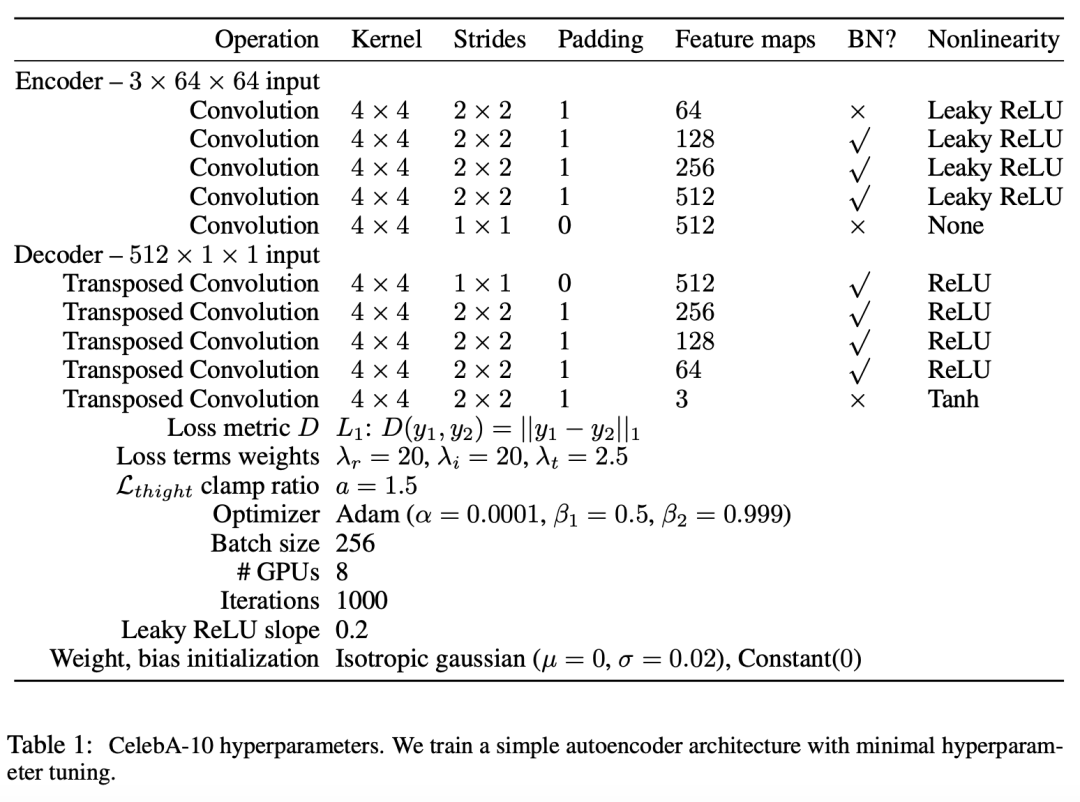

Les chercheurs ont évalué l'IGN sur MNIST (ensemble de données de chiffres manuscrits en niveaux de gris) et CelebA (ensemble de données d'images de visage), en utilisant respectivement 28 × 28 et 64. Le contenu qui doit être réécrit pour la résolution d'image ×64 est :

L'auteur utilise une architecture d'encodeur automatique simple, où l'encodeur est un simple squelette de discriminateur à cinq couches de DCGAN, et le décodeur est le générateur qui doit être réécrit. Le contenu est : Les hyperparamètres de formation et de réseau sont tels qu'indiqués dans le tableau 1. Le contenu qui doit être réécrit est :

Images

Images

Résultats de génération

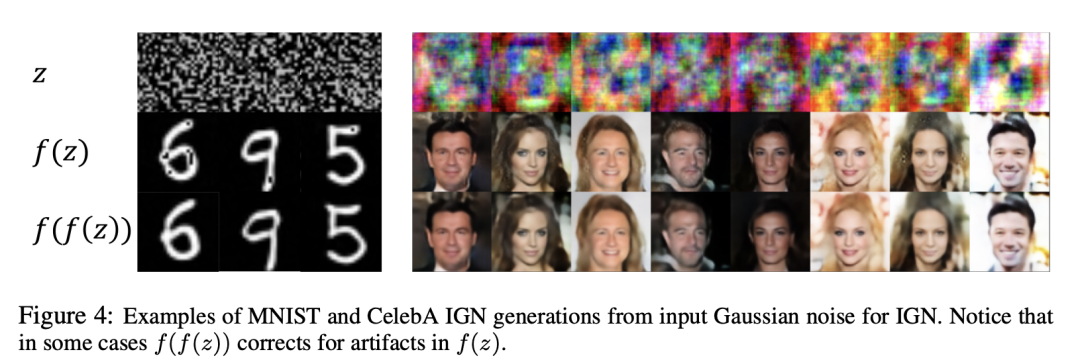

La figure 4 montre après appliquer le modèle une et deux fois de suite. Les résultats qualitatifs pour les deux ensembles de données doivent être réécrits comme suit :

Comme indiqué, l'application de l'IGN une fois (f (z)) produit des résultats de génération cohérents. Ce qui doit être réécrit est : Cependant. , des artefacts peuvent survenir. Des ombres, telles que des trous dans les chiffres du MNIST ou des pixels déformés sur le dessus de la tête et des cheveux dans les images du visage, doivent être réécrites :

Appliquer à nouveau f (f (f (z))) peut corriger ces problèmes, en comblant les trous, ou pour réduire la variation totale autour des patchs de bruit facial. Ce qui doit être réécrit est :

Image

Image

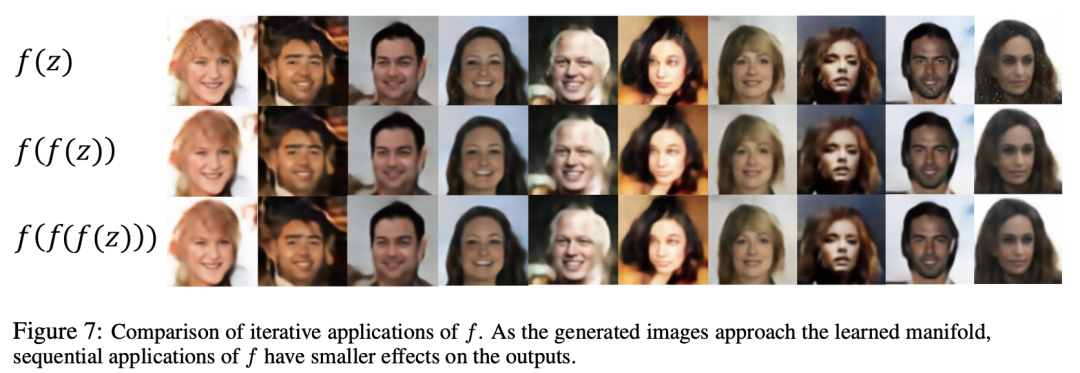

La figure 7 montre des résultats supplémentaires ainsi que les résultats de l'application de f trois fois. . Ce qu'il faut réécrire c'est :

Images

Images

La comparaison de  et

et  montre que lorsque l'image est proche de la variété apprise, l'application de f à nouveau entraîne des changements minimes car l'image est considérée comme distribuée. Ce qui doit être réécrit est :

montre que lorsque l'image est proche de la variété apprise, l'application de f à nouveau entraîne des changements minimes car l'image est considérée comme distribuée. Ce qui doit être réécrit est :

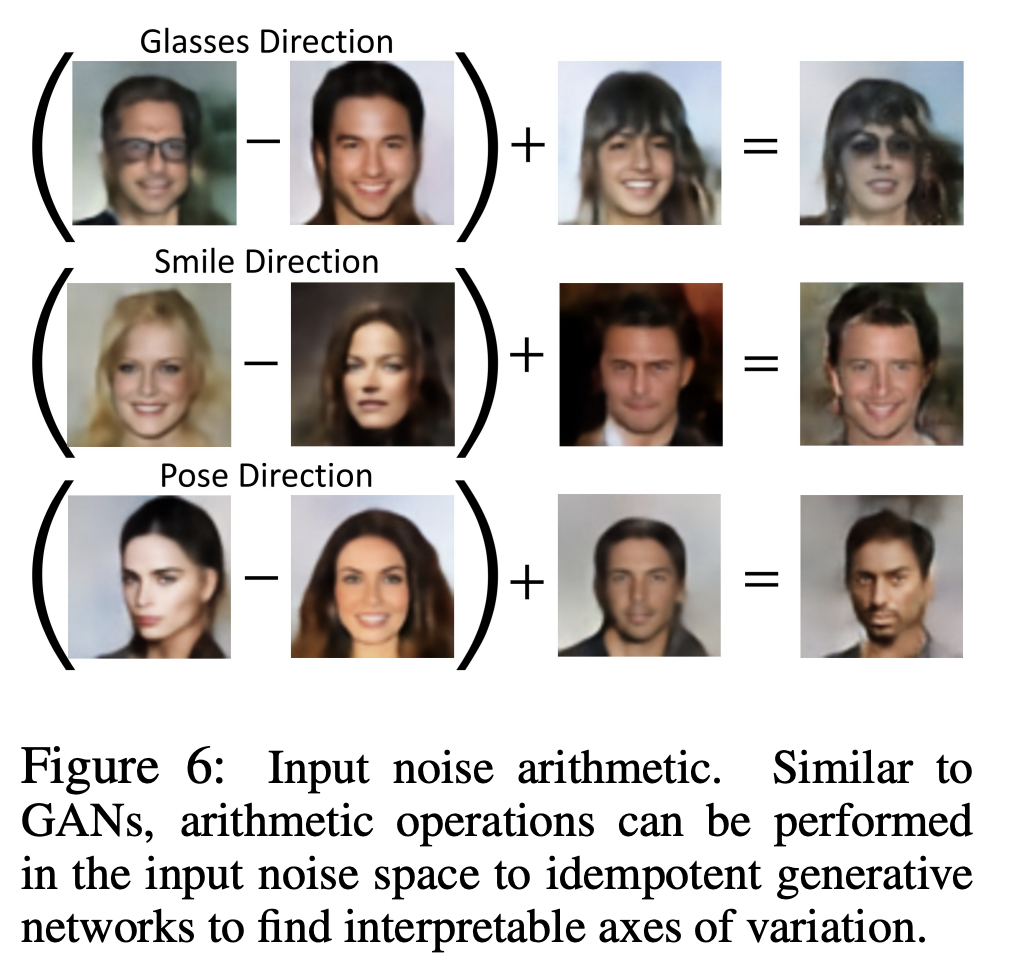

Manipulation de l'espace latent

L'auteur prouve que l'IGN a un espace latent cohérent en effectuant des opérations similaires à celle montrée pour le GAN. La figure 6 montre que ce qui doit être réécrit pour l'algorithme de l'espace latent est :

. Image

Image

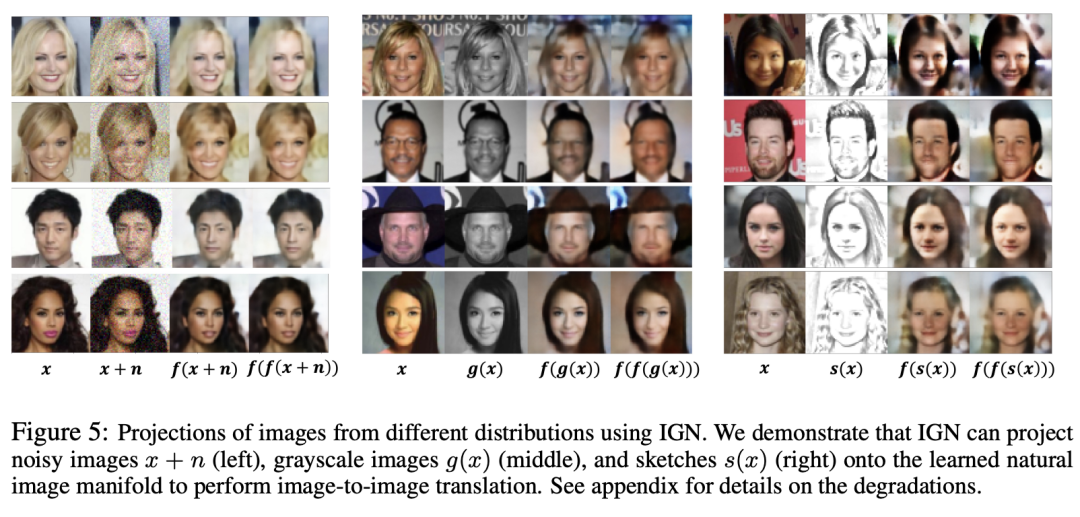

Cartographie hors distribution

L'auteur a également vérifié le potentiel de la « cartographie globale » de l'IGN en saisissant des images de diverses distributions dans le modèle pour générer leurs « images naturelles » équivalentes. Le contenu réécrit est :

Les chercheurs l'ont démontré en débruitant l'image bruyante x+n, en colorant l'image en niveaux de gris  et en convertissant le croquis

et en convertissant le croquis  en l'image réelle de la figure 5. Une chose qui doit être réécrit est :

en l'image réelle de la figure 5. Une chose qui doit être réécrit est :

Image originale x, ces tâches inverses sont mal posées. Ce qui doit être réécrit est : IGN peut créer une cartographie naturelle conforme à la structure de l'image originale Comme le montre l'image, l'application de f améliore continuellement la qualité de l'image (par exemple, il supprime les artefacts sombres et de fumée dans les croquis projetés) Ce qui doit être réécrit est :

Image

Google ensuite ?

Google ensuite ?

Comme le montrent les résultats ci-dessus, l'IGN est plus efficace en matière d'inférence et peut générer des résultats en une seule étape après l'entraînement. Ce qui doit être réécrit est :

Ils peuvent également produire des résultats plus cohérents, ce qui. Peut être étendu à davantage d'applications, telles que la réparation d'images médicales, le contenu qui doit être réécrit est le suivant :

L'auteur de l'article a déclaré :

Nous pensons que ce travail est le premier pas vers un modèle qui apprend à Toute entrée est mappée à une distribution cible. Il s'agit d'un nouveau paradigme de modélisation générative. Ce qui doit être réécrit est :

Ensuite, l'équipe de recherche prévoit d'utiliser davantage de données pour étendre l'échelle de l'IGN, en espérant. pour exploiter de nouvelles formules génératives Le contenu qui doit être réécrit pour réaliser tout le potentiel du modèle d'IA est :

Le dernier code de recherche, qui sera rendu public sur GitHub à l'avenir, le contenu qui doit être réécrit est :

Références :

https://www.php.cn/link/2bd388f731f26312bfc0fe30da009595https://www.php.cn/link/e 1e4e65fddf79af60aab04457a6565a6

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Comment utiliser le modèle de boîte HTML5

- Comment centrer le contenu de l'en-tête dans un tableau HTML ? Une introduction détaillée à l'attribut align de la balise d'en-tête de tableau

- Comment supprimer des modèles redondants dans ZBrush

- Quels sont les modèles courants de développement de logiciels ?

- À quelle couche du modèle osi la fonction de sélection de chemin est-elle terminée ?