Maison >Périphériques technologiques >IA >Les grands patrons se disputent les nouvelles ordonnances réglementaires sur l'IA aux États-Unis, déclenchant une controverse sur l'ampleur de l'extinction humaine.

Les grands patrons se disputent les nouvelles ordonnances réglementaires sur l'IA aux États-Unis, déclenchant une controverse sur l'ampleur de l'extinction humaine.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-11-02 08:41:53930parcourir

Il y a deux jours, les États-Unis ont adopté un décret sur la supervision de l'IA.

À l'avenir, avant que chaque entreprise ne développe des systèmes avancés d'intelligence artificielle, elle devra faire rapport à l'avance et obtenir l'approbation avant de poursuivre la recherche et le développement

Et la commande est chaque détail. . .

Par exemple, le contenu généré par l'IA doit être filigrané, les droits et intérêts des travailleurs concernés doivent être protégés, l'IA ne doit pas mettre beaucoup de personnes au chômage et des moyens doivent être trouvés pour protéger la position de leader des États-Unis dans le domaine de l'IA. etc., sont tous inclus dans cette commande.

En bref, il semble que les États-Unis accordent plus d'importance à la sécurité qu'au développement de l'IA, espère garder la bête de l'IA dans une cage pour le développement.

Cela a fait d'une pierre beaucoup de bruit. Certaines personnes ont immédiatement applaudi et applaudi, pensant que cela aurait dû être fait depuis longtemps. Après tout, vous ne voulez pas voir l’IA coûter leur emploi aux gens.

Certaines personnes estiment que la situation est terrible. Aujourd'hui, les perspectives de développement de l'intelligence artificielle ont été complètement bloquées par ces conservateurs. Il n'y a aucun espoir et ne peut que conduire à la destruction

.Au début, ce n'étaient que les internautes qui faisaient du bruit, mais de manière inattendue, de nombreux grands acteurs du cercle de l'IA ont également pris position et sont devenus les « rois de la gueule forte » et ont exprimé leurs propres opinions.

Ce qui suit est une brève introduction à chaque athlète

Trois personnalités principales participent à cette « bataille au corps à corps », deux lauréats du Turing Award, deux des Big Three, les pères du deep learning : LeCun et Hinton.

Il y a aussi Andrew Ng, pionnier du deep learning et du machine learning et l'un des fondateurs de Google Brain.

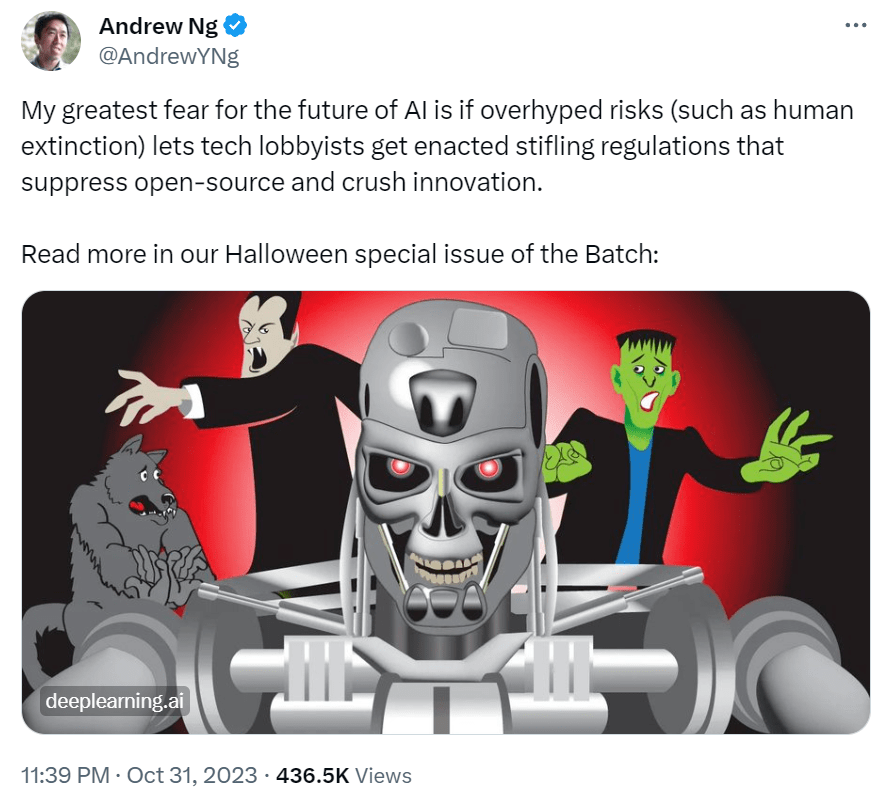

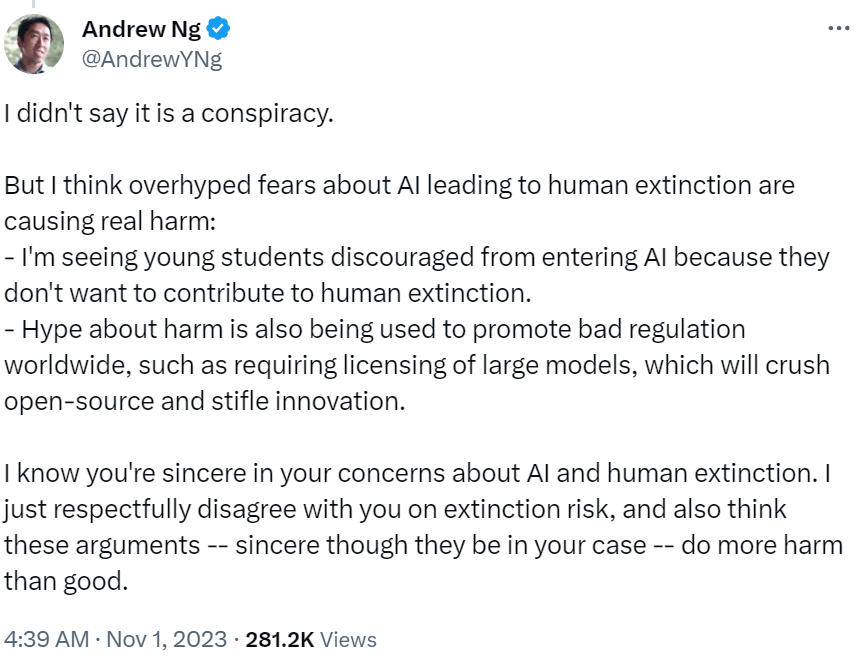

La première personne à s'exprimer a été Andrew Ng, professeur agrégé de Stanford, qui a publié un tweet sur X

Sa position est très claire, à savoir : Une supervision stricte de IA n'est pas du tout propice à l'innovation.

Enda Ng a également écrit un long article détaillé, énumérant d'abord quelques remarques souvent entendues sur Internet à propos de "l'intelligence artificielle provoquera l'extinction humaine", "l'intelligence artificielle remplacera combien d'emplois de personnes", etc.

Puis ils ont directement fixé une cible et ont commencé à tirer, en disant De telles remarques sont du pur battage médiatique et la chose la plus terrifiante Cela encouragera l'émergence de certaines réglementations trop strictes et "supprimera davantage l'open source et l'innovation".

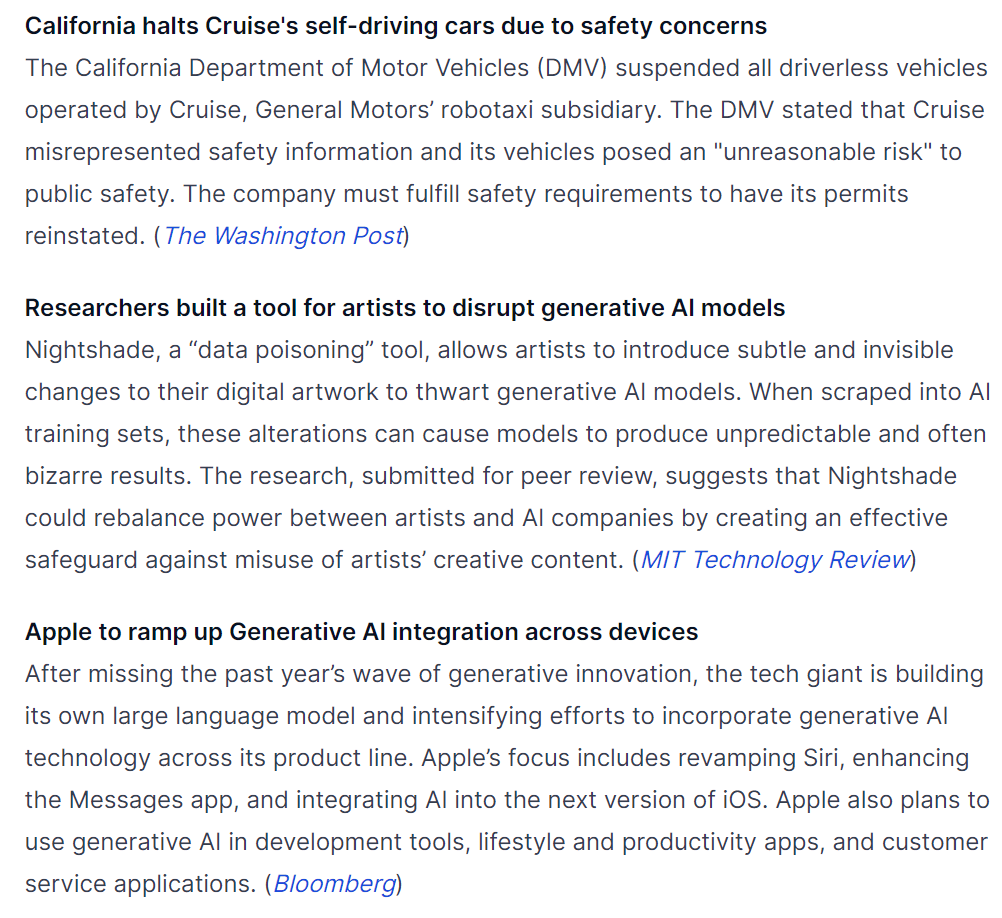

Certains cas montrent que la recherche sur l’intelligence artificielle a ralenti, voire stagné, en raison d’une réglementation stricte. Par exemple, la Californie a suspendu son projet de voiture autonome, et certains ont développé des outils pour détruire les gros modèles génératifs, etc.

Le tweet de Ng Enda était comme allumer une allumette dans une pièce avec des fuites de gaz. L’ensemble du cercle de l’IA était déjà en guerre sur ce sujet, mais maintenant il a explosé. . .

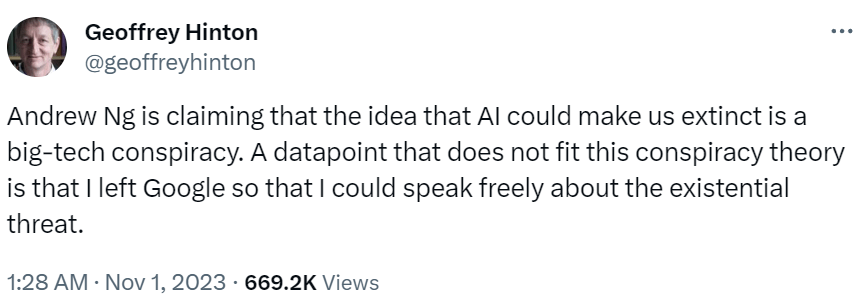

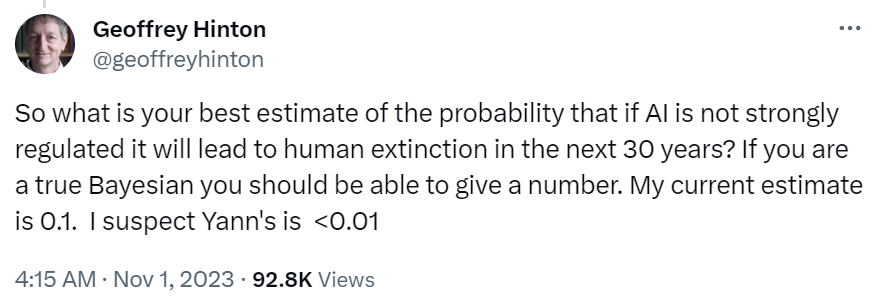

La première personne à comparaître était Hinton. Il pensait que l'IA aurait dû être contrôlée il y a longtemps. Il ne l'a pas caché, l'a affronté de front et s'est même moqué de lui-même.

Vous, Andrew Ng, avez dit que l'IA présentait un petit risque de détruire l'humanité,mais moi, Hinton, j'ai quitté Google justement pour pouvoir parler de ces risques.

J'ai juste l'impression que certaines opinions sont trop nombreuses et peuvent être considérées comme semant la panique. Ces points de vue ont même affecté le développement de l’IA. Cet ordre réglementaire aux États-Unis en est un exemple vivant.

Enfin, Ng Enda a dit quelque chose de yin et de yang : je sais que vos intentions sont bonnes,

mais je pense que vous ferez certainement plus de mal que de bien en étant si méchant chaque jour.

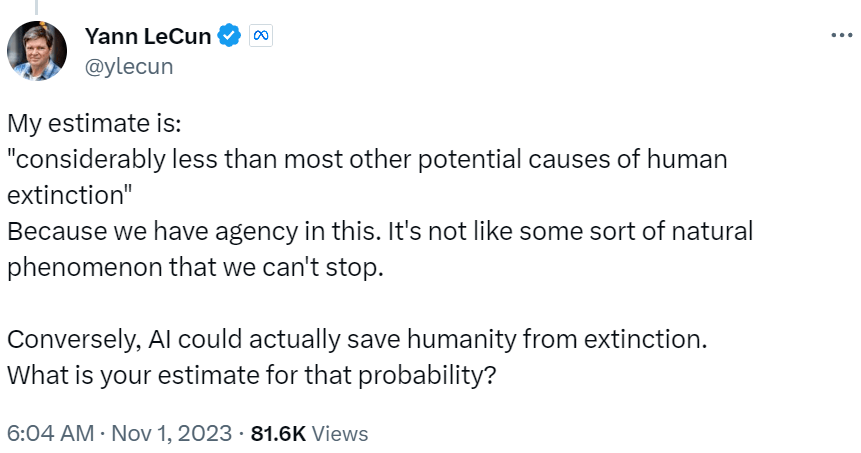

Concernant la question de l’IA provoquant l’extinction de l’humanité dans 30 ans, un autre patron, « l’allié » d’Andrew Ng, LeCun, est apparu immédiatement

Il a directement "attaqué le bouclier de l'autre avec sa lance" et a répondu à Hinton :

Les facteurs qui conduisent à l’extinction des êtres humains ont disparu. Il existe bien plus de menaces que l’IA, et l’IA peut sauver les humains de l’extinction.

Fait intéressant, certains internautes ont également suivi LeCun en versant de l'huile sur Hinton, révélant sa prédiction en 2016 selon laquelle les radiologues seraient remplacés par l'intelligence artificielle d'ici 5 ans

Hunton lui-même est soudain devenu incohérent à cause de cela. Il a rapidement trouvé une excuse pour se défendre, affirmant qu'il avait effectivement quelques problèmes avec l'échelle de temps...

LeCun a également souligné Hinton et Bengio, affirmant que leur position actuelle consiste simplement à aider les géants de la technologie qui ne veulent pas ouvrir le code source et les modèles ouverts

Le renforcement de la supervision augmentera le seuil de recherche et de développement en IA, ce qui rendra la tâche plus difficile pour les personnes souhaitant entrer dans cette industrie

Maintenant, le débat continue et de nombreux pratiquants sont venus encourager leurs supporters.

Mike, directeur de la technologie de Meta, l'a dit sans ambages : « Vous ne parlez que des impacts négatifs de l'intelligence artificielle, mais vous ne voyez pas ses avantages, n'est-ce pas ? »

Bien que l'échec de l'intelligence artificielle ne détruira pas l'humanité, sans l'aide de l'intelligence artificielle, l'humanité sera confrontée à un risque d'extinction plus élevé, comme les tremblements de terre, les météorites, la guerre nucléaire, etc.

Selon le rapport de bataille de première ligne, Musk, qui souhaite participer à diverses activités, a également participé

Mais cette fois, il n’a rien fait de bien. Au lieu de cela, il s’est déguisé en Capitaine Dragonfly juste et juste.

Il a dit sérieusement : La vraie bataille est entre les exterminationnistes et les humanistes. Une fois que vous remarquez cette bataille, vous ne pouvez pas l'ignorer.

Cependant, si nous y regardons, c'est différent de la « guerre des mots » et du « déchirement » que de nombreux médias nationaux ont exagérés.

Bien que les opinions de chacun soient en conflit les unes avec les autres et que la conversation soit très intense, ce sont fondamentalement toutes des opinions bien fondées et peuvent également permettre aux gens de voir clairement quelles sont les différentes opinions de l'industrie sur l'IA.

Comme l'a dit le fondateur d'Amazon, Beff Jezos, dans la zone de commentaires, des commentaires comme celui-ci sont cruciaux et dont les gens ont besoin.

Il n’existe actuellement aucune réponse définitive dans l’industrie à la question de l’équilibre entre le développement et la réglementation de l’IA

Mais ce qui est sûr, c'est que, comme le disent les internautes, « la vérité devient plus claire avec plus de débats ». Sous l'influence constante des deux parties, l'équilibre entre la supervision et le développement de l'IA atteindra toujours un état d'équilibre.

De notre point de vue, nous ne pouvons qu’espérer que ce soit la bonne réponse

Écrit : Squirrel & Bajie Editeur : Jiang Jiang & Noodles Couverture : 萱

Images et sources de données :

Contenu réécrit : X, InternetCe qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Pénurie de main d'œuvre, l'IA peut-elle sauver l'industrie manufacturière américaine ?

- Voici les aéroports avec les vitesses WiFi les plus rapides et les plus lentes aux États-Unis, et quel aéroport a les pires vitesses

- Une recherche révèle le profil des utilisateurs américains de ChatGPT : jeunes, riches et bien éduqués

- La FTC et 17 procureurs généraux d'État intentent une action en justice antitrust contre Amazon

- Ferrari accepte les paiements en crypto-monnaie aux États-Unis et envisage de s'étendre en Europe