Maison >Périphériques technologiques >IA >Comment l'IA générative redéfinit la recherche d'images

Comment l'IA générative redéfinit la recherche d'images

- 王林avant

- 2023-09-29 21:25:08890parcourir

Pour réécrire le contenu sans changer le sens original, la langue doit être réécrite en chinois et la phrase originale n'a pas besoin d'apparaître

Revue | Le contenu de Chonglou doit être réécrit

Ces dernières Depuis quelques mois, l’intelligence artificielle générative suscite un grand intérêt grâce à sa capacité à créer des textes, des sons et des images uniques. Cependant, le potentiel de l'IA générative ne se limite pas à la création de nouvelles données

Les techniques sous-jacentes de l'IA générative (telles que les transformateurs et les modèles de diffusion) peuvent alimenter de nombreuses autres applications, notamment la recherche et la découverte d'informations. En particulier, l'IA générative pourrait révolutionner la recherche d'images, en permettant aux utilisateurs d'explorer des informations visuelles d'une manière qui était auparavant impossible.

Incorporation d'images et de texte

Incorporation d'images et de texte

Les méthodes traditionnelles de recherche d'images reposent sur des descriptions de texte, des balises et d'autres métadonnées qui accompagnent l'image, ce qui limite les options de recherche de l'utilisateur aux informations qui ont été explicitement attachées à l'image. Les personnes qui téléchargent des images doivent soigneusement réfléchir au type de requêtes de recherche qu'elles saisissent pour s'assurer que leurs images sont visibles par d'autres. Et lors de la recherche d'une image, l'utilisateur qui interroge l'information doit essayer d'imaginer quel type de description le téléchargeur d'image aurait pu ajouter à l'image

Comme le dit le proverbe, "une image vaut mille mots". Il existe cependant des limites à ce que l’on peut écrire sur les descriptions d’images. Bien sûr, cela peut être décrit de plusieurs manières selon la façon dont les gens perçoivent l’image. Les gens recherchent parfois en fonction des objets de l'image, et parfois en fonction de caractéristiques telles que le style, la lumière, l'emplacement, etc. Malheureusement, les images sont rarement accompagnées d’informations aussi riches. De nombreuses personnes téléchargent de nombreuses images avec peu ou pas d’informations jointes, ce qui les rend difficiles à découvrir lors des recherches.

La recherche d'images par intelligence artificielle joue un rôle important à cet égard. Il existe de nombreuses approches pour la recherche d’images IA, et différentes entreprises disposent de leurs propres technologies propriétaires. Cependant, il existe également des technologies que ces entreprises ont en commun

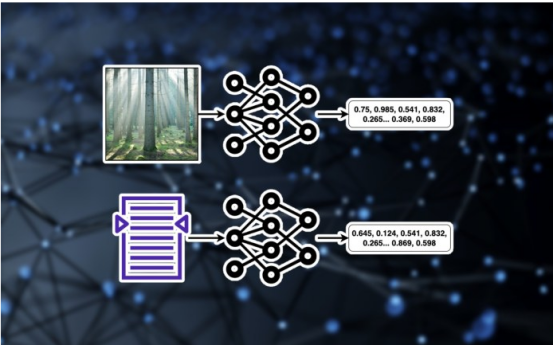

Au cœur de la recherche d'images par intelligence artificielle et de nombreux autres systèmes d'apprentissage profond se trouvent les intégrations. L'intégration est une méthode de représentation numérique de différents types de données. Par exemple, une image de résolution 512 × 512 contient environ 260 000 pixels (ou fonctionnalités). Les modèles d'intégration apprennent des représentations de données visuelles en basse dimension en s'entraînant sur des millions d'images. L'intégration d'images peut être appliquée dans de nombreux domaines utiles, notamment la compression d'images, la génération de nouvelles images ou la comparaison des propriétés visuelles de différentes images. Le même mécanisme fonctionne pour d'autres formes telles que le texte. Les modèles d'intégration de texte sont des représentations de faible dimension du contenu d'extraits de texte. Les intégrations de texte ont de nombreuses applications, notamment la recherche de similarité et l'amélioration de la récupération pour les grands modèles de langage (LLM).

Comment fonctionne la recherche d'images par intelligence artificielle

Mais les choses deviennent plus intéressantes lorsque les intégrations d'images et de texte sont entraînées ensemble. Les ensembles de données open source comme LAION contiennent des millions d'images et leurs descriptions textuelles correspondantes. Lorsque les intégrations de texte et d'images sur ces paires image/légende sont formées ou affinées conjointement, elles apprennent l'association entre les informations visuelles et textuelles. C'est l'idée derrière les techniques d'apprentissage en profondeur telles que le Contrastive Image Language Pretraining (CLIP). Le modèle CLIP (Comparative Language on Image Pre-trained) apprend les intégrations conjointes de texte et d'images

Nous disposons désormais d'outils capables de convertir du texte en intégrations visuelles. Lorsque nous fournissons à ce modèle commun une description textuelle, il génère des intégrations de texte et des intégrations d'images correspondantes. Nous pouvons ensuite comparer les images intégrées avec les images de la base de données et récupérer les plus pertinentes. C'est le principe de base de la recherche d'images par intelligence artificielle

Nous disposons désormais d'outils capables de convertir du texte en intégrations visuelles. Lorsque nous fournissons à ce modèle commun une description textuelle, il génère des intégrations de texte et des intégrations d'images correspondantes. Nous pouvons ensuite comparer les images intégrées avec les images de la base de données et récupérer les plus pertinentes. C'est le principe de base de la recherche d'images par intelligence artificielle

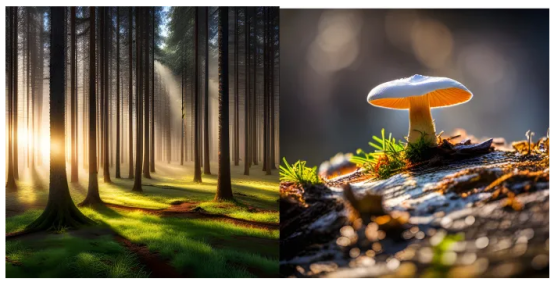

La beauté de ce mécanisme est que les utilisateurs pourront récupérer des images à partir d'une description textuelle des caractéristiques visuelles de l'image, même si cette description n'est pas enregistrée dans son métadonnées. Vous pouvez utiliser des termes de recherche riches, ce qui n'était pas possible auparavant, tels que "Une forêt luxuriante enveloppée dans la brume matinale, un soleil éclatant filtrant à travers la grande forêt de pins et des champignons poussant sur l'herbe".

Dans l'exemple ci-dessus, la recherche AI a renvoyé un ensemble d'images dont les caractéristiques visuelles correspondaient à cette requête. De nombreuses descriptions textuelles ne contiennent pas les mots-clés de requête. Mais leur intégration s’apparente à celle des requêtes. Sans la recherche d’images par l’IA, trouver la bonne image serait beaucoup plus difficile.

De la découverte à la création

Parfois, l’image que les gens recherchent n’existe pas, et même une recherche par l’IA ne peut pas la trouver. Dans ce cas, l’IA générative peut aider les utilisateurs à atteindre les résultats souhaités de deux manières.

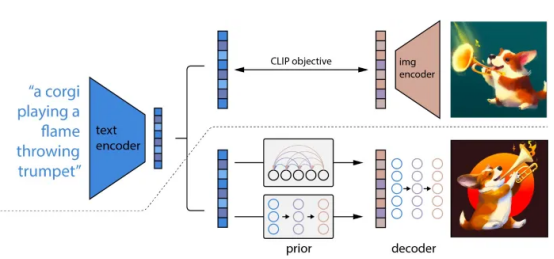

Tout d'abord, nous pouvons créer une nouvelle image à partir de zéro en fonction de la requête de l'utilisateur. Cette approche implique l'utilisation d'un modèle génératif texte-image (tel que Stable Diffusion ou DALL-E) pour créer une intégration pour la requête de l'utilisateur et exploiter cette intégration pour générer l'image. Les modèles génératifs exploitent des modèles d'intégration conjoints tels que le Contrastive Image Language Pre-training (CLIP) et d'autres architectures telles que les transformateurs ou les modèles de diffusion pour convertir les valeurs intégrées en images époustouflantes

DALL-E utilise le Contrastive Image Language Pre-training (CLIP) et diffusion pour générer des images à partir de texte

DALL-E utilise le Contrastive Image Language Pre-training (CLIP) et diffusion pour générer des images à partir de texte

La deuxième méthode consiste à utiliser des images existantes et à les modifier selon vos préférences personnelles à l'aide d'un modèle génératif. Par exemple, dans une image montrant une forêt de pins, il manque des champignons dans l’herbe. Les utilisateurs peuvent choisir une image appropriée comme point de départ et y ajouter des champignons via un modèle génératif

L'IA générative crée un tout nouveau paradigme qui brouille les frontières entre découverte et créativité. Et au sein d'une seule interface, les utilisateurs peuvent rechercher des images, les modifier ou créer des images entièrement nouvelles.

Titre original : Comment l'IA générative redéfinit la recherche d'images, auteur : Ben Dickson

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- La compréhension du langage naturel est un domaine d'application important de l'intelligence artificielle. Quel est son objectif ?

- Comment visualiser l'intelligence artificielle

- Quelles sont les principales directions d'application de l'intelligence artificielle dans le domaine médical ?

- Quel est le cœur de l'intelligence artificielle

- Quelles sont les orientations de développement de l'intelligence artificielle ?