Récemment, l'équipe de traitement du langage naturel de l'Université de Fudan (FudanNLP) a lancé un article de synthèse sur les agents basés sur LLM. Le texte intégral fait 86 pages et contient plus de 600 références ! À partir de l'histoire d'AI Agent, les auteurs ont examiné de manière exhaustive l'état actuel des agents intelligents basés sur des modèles de langage à grande échelle, notamment : l'arrière-plan, la composition, les scénarios d'application de l'agent basé sur LLM et la société d'agents qui a beaucoup attiré attention. Dans le même temps, les auteurs ont discuté de questions prospectives et ouvertes liées à Agent, qui sont d'une grande valeur pour les tendances de développement futures dans des domaines connexes.

Lien papier : https://arxiv.org/pdf/2309.07864.pdfListe papier des agents basés sur LLM : https://github.com/WooooDyy/LLM-Agent-Paper- Les membres de l'équipe List

ajouteront également un "résumé d'une phrase" pour chaque article pertinent, bienvenue dans l'entrepôt Star.

Contexte de recherche

Depuis longtemps, les chercheurs recherchent une intelligence artificielle

générale (Intelligence Générale Artificielle, AGI) équivalente, voire supérieure, aux niveaux humains. Dès les années 1950, Alan Turing étendait le concept d’« intelligence » aux entités artificielles et proposait le fameux test de Turing. Ces entités d'intelligence artificielle sont souvent appelées - agents (Agent*). Le concept d'« agent » vient de la philosophie et décrit une entité qui a des désirs, des croyances, des intentions et la capacité d'agir. Dans le domaine de l'intelligence artificielle, ce terme a pris un nouveau sens : Une entité intelligente présentant des caractéristiques d'autonomie, de réactivité, de positivité et de sociabilité. * Il n'y a pas de consensus sur la traduction chinoise du terme Agent. Certains chercheurs le traduisent par agent, acteur, agent ou agent intelligent. Les termes « agent » et « agent intelligent » apparaissant dans cet article font tous deux référence. à l'Agent.

Depuis, la conception d'agents est devenue un sujet d'intérêt pour la communauté de l'intelligence artificielle. Cependant, les travaux antérieurs se sont principalement concentrés sur l’amélioration de capacités spécifiques des agents, comme le raisonnement symbolique ou la maîtrise de tâches spécifiques (échecs, Go, etc.). Ces études se concentrent davantage sur la conception d'algorithmes et les stratégies de formation, tout en ignorant le développement des capacités générales inhérentes au modèle, telles que la mémoire des connaissances, la planification à long terme, la généralisation efficace et l'interaction efficace. Il s'avère que l'amélioration des capacités inhérentes du modèle est un facteur clé pour promouvoir le développement ultérieur des agents intelligents.

L'émergence de grands modèles de langage (LLM) laisse espérer le développement ultérieur d'agents intelligents. Si le parcours de développement de la PNL à l'AGI est divisé en cinq niveaux : corpus, Internet, perception, incarnation et attributs sociaux, alors les modèles de langage à grande échelle actuels ont atteint le deuxième niveau, avec la saisie et la sortie de texte à l'échelle d'Internet. Sur cette base, si les agents basés sur LLM disposent d'un espace de perception et d'un espace d'action, ils atteindront les troisième et quatrième niveaux. De plus, lorsque plusieurs agents interagissent et coopèrent pour résoudre des tâches plus complexes ou refléter des comportements sociaux dans le monde réel, ils ont le potentiel d’atteindre le cinquième niveau : la société des agents. 一 L'imagination de l'auteur d'une société harmonieuse composée d'agents intelligents peut également y participer. La scène est tirée du Sea Lantern Festival dans « Genshin Impact ». A quoi ressemblera un agent intelligent avec la bénédiction d'un grand modèle ? Inspirés par la loi de Darwin sur la « survie du plus apte », les auteurs ont proposé un cadre général pour les agents intelligents basé sur de grands modèles. Si une personne veut survivre dans la société, elle doit apprendre à s'adapter à l'environnement, elle doit donc avoir des capacités cognitives et être capable de percevoir et de réagir aux changements du monde extérieur. De même, le cadre des agents intelligents se compose également de trois parties :

Terminal de contrôle (Cerveau), terminal de perception (Perception) et terminal d'action (Action).

Contrôle - : Généralement composé de LLM, il est le noyau des agents intelligents. Il peut non seulement stocker de la mémoire et des connaissances, mais également assumer des fonctions indispensables telles que le traitement de l'information et la prise de décision. Il peut présenter le processus de raisonnement et de planification et bien gérer des tâches inconnues, reflétant la généralisation et la transférabilité des agents intelligents.

Fin de perception- : Élargissez l'espace de perception des agents intelligents à partir du texte pur pour inclure des champs multimodaux tels que le texte, la vision et l'audition, permettant à l'agent d'obtenir et d'utiliser plus efficacement les informations de l'environnement environnant.

Côté mobile- : En plus de la sortie de texte régulière, l'agent a également la possibilité d'incarner et d'utiliser des outils, lui permettant de mieux s'adapter aux changements environnementaux, d'interagir avec l'environnement grâce au feedback, et même de façonner l'environnement. .

S Le cadre conceptuel de LLM-BASED AGENT contient trois composants : le terminal de contrôle, la perception et la fin de l'action.

Les auteurs utilisent un exemple pour illustrer le flux de travail de l'agent basé sur LLM : lorsqu'un humain demande s'il va pleuvoir, l'extrémité de perception (Perception) convertit les instructions en une représentation que les LLM peuvent comprendre. Ensuite, le terminal de contrôle (Brain) commence à raisonner et à planifier des actions sur la base de la météo actuelle et des prévisions météorologiques sur Internet. Finalement, l'Action répond et tend le parapluie à l'humain. En répétant le processus ci-dessus, l'agent intelligent peut obtenir en continu des commentaires et interagir avec l'environnement.

Terminal de contrôle : CerveauEn tant que composant central de l'agent intelligent, les auteurs présentent ses capacités sous cinq aspects : Interaction en langage naturel : Langage C'est un médium de communication qui contient des informations riches. Grâce aux puissantes capacités de génération et de compréhension du langage naturel des LLM, les agents intelligents peuvent interagir avec le monde extérieur pendant plusieurs tours via le langage naturel pour atteindre leurs objectifs. Plus précisément, il peut être divisé en deux aspects :

Génération de texte de haute qualité : un grand nombre d'expériences d'évaluation montrent que les LLM peuvent générer un texte fluide, diversifié, nouveau et contrôlable. Malgré de faibles performances dans certaines langues, de bonnes compétences multilingues sont globalement disponibles.

Compréhension de l'implication : en plus du contenu exprimé intuitivement, le langage peut également transmettre des informations telles que les intentions et les préférences du locuteur. L’implication est que cela aide les agents à communiquer et à coopérer plus efficacement, et les grands modèles ont déjà montré leur potentiel à cet égard.

Connaissances :

Les LLM formés sur la base de grands lots de corpus ont la capacité de stocker d'énormes quantités de connaissances. En plus des connaissances linguistiques, les connaissances de bon sens et les connaissances professionnelles sont des éléments importants des agents basés sur le LLM.

Bien que les LLM eux-mêmes aient encore des problèmes tels que l'expiration des connaissances et les hallucinations, certaines recherches existantes peuvent être atténuées dans une certaine mesure grâce à des méthodes telles que l'édition des connaissances ou l'appel à des bases de connaissances externes. Dans le cadre de cet article, le module mémoire (Memory) stocke les séquences passées d'observation, de réflexion et d'action de l'agent. Grâce à des mécanismes de mémoire spécifiques, les agents peuvent réfléchir et appliquer efficacement des stratégies antérieures, leur permettant ainsi de s'appuyer sur des expériences passées pour s'adapter à des environnements inconnus.

Il existe trois méthodes généralement utilisées pour améliorer les capacités de mémoire : Étendre la limite de longueur de l'architecture Backbone : Améliorer le problème inhérent de limite de longueur de séquence des Transformers.

Résumé : Résumer la mémoire pour améliorer la capacité de l'agent à extraire les détails clés de la mémoire. Mémoire compressée (Compression) : En compressant la mémoire à l'aide de vecteurs ou de structures de données appropriées, l'efficacité de la récupération de la mémoire peut être améliorée.

-

De plus, la méthode de récupération de la mémoire est également très importante. Ce n'est qu'en récupérant le contenu approprié que l'agent peut accéder aux informations les plus pertinentes et les plus précises.

Raisonnement et planification : La capacité de raisonnement est cruciale pour que les agents intelligents effectuent des tâches complexes telles que la prise de décision et l'analyse. Spécifique aux LLM, il s'agit d'une série de méthodes d'incitation représentées par la chaîne de pensée (CoT). La planification est une stratégie couramment utilisée face à de grands défis. Il aide les agents à organiser leur réflexion, à fixer des objectifs et à identifier les étapes pour atteindre ces objectifs. Dans une mise en œuvre spécifique, la planification peut comprendre deux étapes :

Formulation du plan : l'agent décompose les tâches complexes en sous-tâches plus gérables. Par exemple : décomposition ponctuelle puis exécution en séquence, planification et exécution étape par étape, planification multi-chemins et sélection du chemin optimal, etc. Dans certains scénarios qui nécessitent des connaissances professionnelles, les agents peuvent être intégrés à des modules Planner spécifiques au domaine pour améliorer les capacités.

Réflexion sur le plan : après avoir élaboré un plan, vous pouvez y réfléchir et évaluer ses forces et ses faiblesses. Ce type de réflexion repose généralement sur trois aspects : utiliser des mécanismes de rétroaction internes ; obtenir des commentaires de l'interaction avec les humains et obtenir des commentaires de l'environnement ;

Transférabilité et généralisation :

Les LLM possédant une connaissance du monde dotent les agents intelligents de puissantes capacités de migration et de généralisation. Un bon agent n'est pas une base de connaissances statique, mais doit également avoir des capacités d'apprentissage dynamiques :

Généralisation à des tâches inconnues : à mesure que la taille du modèle et des données de formation augmentent, des LLM émergent pour résoudre des tâches inconnues. Possède des capacités étonnantes. .Les grands modèles affinés avec des instructions fonctionnent bien dans les tests zéro tir, obtenant des résultats aussi bons que les modèles experts sur de nombreuses tâches.

Apprentissage en contexte : les grands modèles sont non seulement capables d'apprendre par analogie à partir d'un petit nombre d'exemples en contexte, mais cette capacité peut également être étendue à des scènes multimodales au-delà du texte, fournissant ainsi des applications réelles aux agents. plus de possibilités.

Apprentissage continu : Le principal défi de l'apprentissage continu est l'oubli catastrophique, c'est-à-dire que lorsque le modèle apprend une nouvelle tâche, il perd facilement les connaissances des tâches passées. Les agents intelligents dans des domaines spécialisés devraient essayer d’éviter de perdre leurs connaissances dans des domaines généraux.

Fin de la perception : PerceptionLes humains perçoivent le monde de manière multimodale, les chercheurs ont donc les mêmes attentes à l'égard des agents basés sur le LLM. La perception multimodale peut approfondir la compréhension de l'agent de l'environnement de travail et améliorer considérablement sa polyvalence. Saisie de texte : En tant que capacité la plus élémentaire des LLM, je n'entrerai pas dans les détails ici. Saisie visuelle : Les LLM eux-mêmes n'ont pas de capacités de perception visuelle et ne peuvent comprendre que du contenu textuel discret. Et les entrées visuelles contiennent généralement de nombreuses informations sur le monde, notamment les propriétés des objets, les relations spatiales, la disposition des scènes, etc. Les méthodes courantes sont :

- Convertir l'entrée visuelle en description textuelle correspondante (sous-titrage d'image) : elle peut être directement comprise par les LLM et a une grande interprétabilité.

- Encodage et représentation des informations visuelles : Le module de perception est composé d'un modèle visuel de base + paradigme LLM, et le modèle comprend le contenu des différentes modalités à travers des opérations d'alignement, qui peuvent être entraînées de bout en bout.

Entrée auditive : L'audition est également une partie importante de la perception humaine. Étant donné que les LLM ont d'excellentes capacités d'appel d'outils, une idée intuitive est que l'agent peut utiliser les LLM comme centre de contrôle, appelant des ensembles d'outils existants ou des modèles experts en cascade pour percevoir les informations audio. De plus, l’audio peut également être représenté visuellement via un spectrogramme. Les spectrogrammes peuvent être utilisés comme images plates pour afficher des informations 2D, de sorte que certaines méthodes de traitement visuel peuvent être transférées au champ vocal. Autres entrées : Les informations dans le monde réel sont bien plus que du texte, de la vision et de l'audition. Les auteurs espèrent qu'à l'avenir, les agents intelligents seront équipés de modules de perception plus riches, tels que le toucher, l'odorat et d'autres organes, pour obtenir des attributs plus riches des objets cibles. Dans le même temps, les agents peuvent également avoir une idée claire de la température, de l’humidité et de la luminosité de l’environnement et prendre des mesures plus respectueuses de l’environnement. De plus, l'agent peut également être initié à la perception de l'environnement global plus large : à l'aide de modules de perception matures tels que le lidar, le GPS et les centrales de mesure inertielle. Une fois que le cerveau a effectué l'analyse et la prise de décision, l'agent doit également prendre des mesures pour s'adapter ou modifier l'environnement : Sortie texte : Comme les capacités les plus élémentaires des LLM ne seront pas décrites ici. Utilisation des outils : Bien que les LLM disposent d'excellentes réserves de connaissances et de capacités professionnelles, lorsqu'ils sont confrontés à des problèmes spécifiques, une série de défis tels que des problèmes de robustesse et des hallucinations peuvent survenir. Dans le même temps, les outils, en tant qu'extension des capacités de l'utilisateur, peuvent apporter une aide sur des aspects tels que le professionnalisme, la factualité et l'interprétabilité. Par exemple, vous pouvez utiliser une calculatrice pour résoudre des problèmes mathématiques et un moteur de recherche pour rechercher des informations en temps réel. De plus, les outils peuvent également élargir l'espace d'action des agents intelligents. Par exemple, des actions multimodales peuvent être obtenues en appelant des modèles experts tels que la génération de parole et la génération d'images. Par conséquent, comment faire en sorte que les agents deviennent d'excellents utilisateurs d'outils, c'est-à-dire apprendre à utiliser efficacement les outils, est une direction très importante et prometteuse. Actuellement, les principales méthodes d'apprentissage des outils incluent l'apprentissage à partir de démonstrations et l'apprentissage à partir de retours d'expérience. De plus, le méta-apprentissage, l'apprentissage de cours, etc. peuvent également être utilisés pour fournir aux agents des capacités de généralisation dans l'utilisation de divers outils. En allant plus loin, les agents intelligents peuvent apprendre à créer des outils de manière « autosuffisante », augmentant ainsi leur autonomie et leur indépendance. Action incarnée : L'incarnation fait référence à la capacité d'un agent à comprendre, transformer l'environnement et mettre à jour son propre état lors de l'interaction avec l'environnement. L'action incarnée est considérée comme le pont entre l'intelligence virtuelle et la réalité physique.Les agents traditionnels basés sur l'apprentissage par renforcement ont des limites en termes d'efficacité des échantillons, de généralisation et de raisonnement de problèmes complexes, tandis que les agents basés sur LLM introduisent de riches connaissances intrinsèques des grands modèles, permettant aux agents incarnés de se comporter comme des humains. Détectez et influencez activement l'environnement physique. . Selon le degré d'autonomie de l'agent dans la tâche ou la complexité de l'Action, il peut y avoir les Actions atomiques suivantes :

- L'observation peut aider l'agent intelligent à localiser sa propre position dans l'environnement, à percevoir des objets et des objets, et obtenir d'autres informations environnementales ;

- La manipulation consiste à effectuer certaines tâches spécifiques de saisie, de poussée et d'autres tâches opérationnelles

- La navigation nécessite que l'agent intelligent change de position en fonction de l'objectif de la tâche et mette à jour son statut en fonction de l'objectif de la tâche. aux informations environnementales.

En combinant ces actions atomiques, les agents peuvent accomplir des tâches plus complexes. Par exemple, des tâches d'assurance qualité incorporées telles que « La pastèque dans la cuisine est-elle plus grosse que le bol ? » Pour résoudre ce problème, l’agent doit se rendre dans la cuisine et obtenir la réponse après avoir observé la taille des deux. Limitées par des problèmes tels que le coût élevé du matériel physique et le manque d'ensembles de données incarnées, les recherches actuelles sur les actions incarnées se concentrent encore principalement sur les environnements de type bac à sable virtuel tels que la plateforme de jeu "Minecraft". Par conséquent, d’une part, les auteurs attendent avec impatience un paradigme de tâches et une norme d’évaluation plus proches de la réalité. D’autre part, ils ont également besoin d’une exploration plus approfondie de la construction efficace d’ensembles de données pertinents. Agent en pratique : divers scénarios d'applicationActuellement, les agents basés sur LLM ont démontré une diversité impressionnante et des performances puissantes. Des exemples d'applications familiers tels qu'AutoGPT, MetaGPT, CAMEL et GPT Engineer connaissent un essor sans précédent. Avant de présenter les applications spécifiques, les auteurs ont discuté des principes de conception d'Agent in Practice : 1. Aidez les utilisateurs à se libérer des tâches quotidiennes et du travail répétitif, à réduire la pression de travail humaine et à améliorer l'efficacité de la résolution. tâches ; 2. Les utilisateurs n'ont plus besoin de donner des instructions explicites de bas niveau et peuvent analyser, planifier et résoudre les problèmes de manière totalement autonome 3. Après avoir libéré les mains de l'utilisateur, essayez de libérer le cerveau : science Faire jouer pleinement leur potentiel dans le domaine et réaliser des travaux innovants et exploratoires. Sur cette base, l'application des agents peut avoir trois paradigmes :

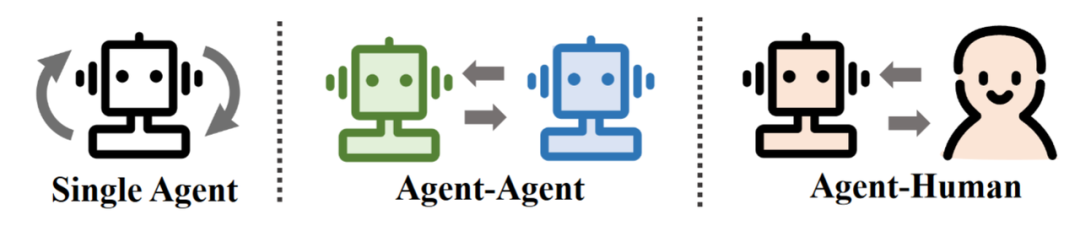

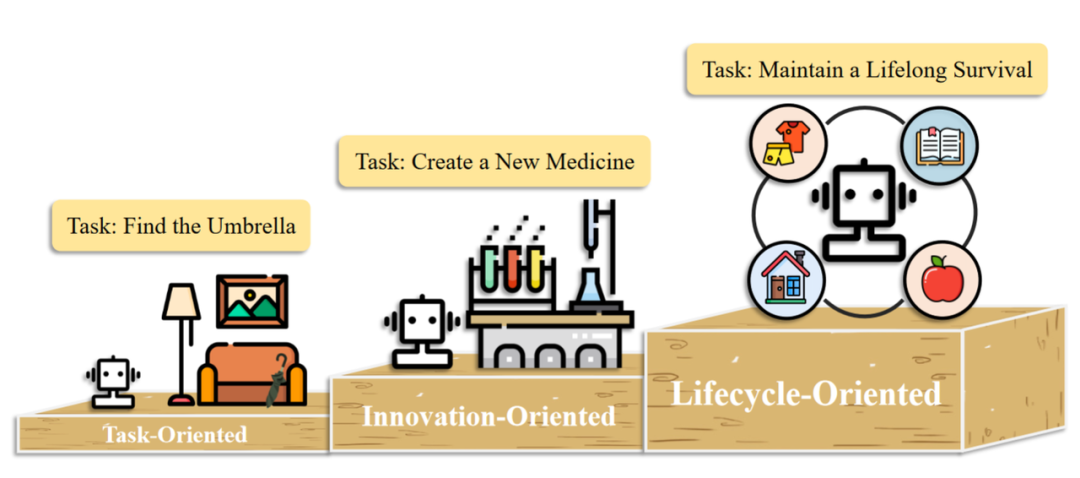

Les trois paradigmes d'application de l'agent basé sur LLM : agent unique, multi-agent et interaction homme-machine. Les agents intelligents capables d'accepter les commandes en langage naturel humain et d'effectuer des tâches quotidiennes sont actuellement très populaires parmi les utilisateurs et ont une grande valeur pratique. Les auteurs ont d'abord développé ses divers scénarios d'application et les capacités correspondantes dans le scénario d'application d'un seul agent intelligent. Dans cet article, l'application d'un seul agent intelligent est divisée en trois niveaux suivants :

的 Trois niveaux de scénarios d'application à agence unique : orienté vers les tâches, orienté vers l'innovation et orienté vers le cycle de vie.

Dans un déploiement

orienté vers les tâches- , les agents aident les utilisateurs humains à gérer les tâches quotidiennes de base. Ils doivent avoir une compréhension de base du commandement, la décomposition des tâches et la capacité d’interagir avec l’environnement. Plus précisément, selon les types de tâches existants, l'application réelle des agents peut être divisée en environnements de réseau simulés et scénarios de vie simulés. Dans le déploiement de

orientés vers l'innovation- , les agents peuvent démontrer le potentiel d'une enquête indépendante dans des domaines scientifiques de pointe. Bien que la complexité inhérente et le manque de données de formation dans des domaines spécialisés entravent la construction d'agents intelligents, de nombreux travaux progressent déjà dans des domaines tels que la chimie, les matériaux, l'informatique, etc. Dans un

déploiement orienté cycle de vie- , les agents ont la capacité d'explorer, d'acquérir et d'utiliser de nouvelles compétences en continu dans un monde ouvert, et de survivre longtemps. Dans cette section, les auteurs prennent comme exemple le jeu "Minecraft". Étant donné que le défi de survie dans le jeu peut être considéré comme un microcosme du monde réel, de nombreux chercheurs l’ont utilisé comme plate-forme unique pour développer et tester les capacités globales des agents.

En 1986, Marvin Minsky a fait une prédiction prospective. Dans The Society of Mind, il a proposé une nouvelle théorie de l’intelligence, affirmant que l’intelligence naît de l’interaction de nombreux agents plus petits et spécifiques à une fonction. Par exemple, certains agents peuvent être chargés d’identifier des modèles, tandis que d’autres peuvent être chargés de prendre des décisions ou de générer des solutions.

Cette idée a été mise en pratique concrètement avec l’essor de l’intelligence artificielle distribuée. Le système multi-agents, l'un des principaux thèmes de recherche, se concentre principalement sur la manière dont les agents peuvent se coordonner et collaborer efficacement pour résoudre des problèmes. L'auteur de cet article divise l'interaction entre multi-agents selon les deux formes suivantes : les deux formes d'interaction des

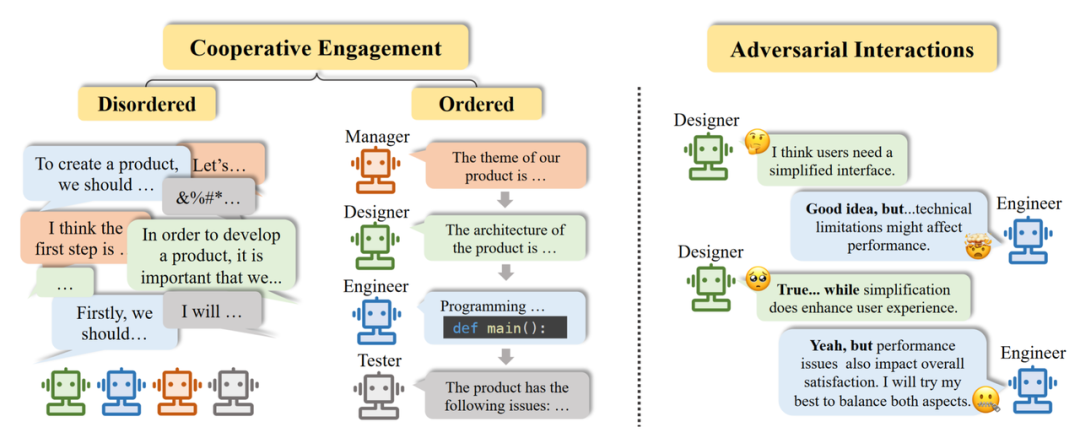

scénarios d'application multi-agents : interaction coopérative et interaction de confrontation.

Interaction coopérative : En tant que type le plus largement déployé dans les applications pratiques, les systèmes d'agents coopératifs peuvent améliorer efficacement l'efficacité des tâches et améliorer conjointement la prise de décision. Plus précisément, selon différentes formes de coopération, les auteurs subdivisent les interactions coopératives en coopération désordonnée et coopération ordonnée.

Lorsque tous les agents expriment librement leurs points de vue et opinions et coopèrent de manière non séquentielle, on parle de coopération désordonnée.

-

Lorsque tous les agents suivent certaines règles, comme exprimer leurs opinions une par une sous la forme d'une chaîne de montage, l'ensemble du processus de coopération est ordonné, ce qu'on appelle une coopération ordonnée.

Interaction contradictoire :

Les agents intelligents interagissent de manière donnant-donnant. Grâce à la compétition, à la négociation et au débat, les agents abandonnent leurs croyances initiales qui pourraient être erronées et mènent des réflexions significatives sur leur propre comportement ou processus de raisonnement, ce qui conduit finalement à une amélioration de la qualité de réponse de l'ensemble du système.

Scénario d'interaction homme-machineL'interaction homme-agent, comme son nom l'indique, est un agent intelligent qui coopère avec les humains pour accomplir des tâches. D'une part, la capacité d'apprentissage dynamique de l'agent doit être soutenue par la communication ; d'autre part, les performances du système d'agent actuel en termes d'interprétabilité sont encore insuffisantes et il peut y avoir des problèmes de sécurité, de légalité, etc., ce qui nécessite des ressources humaines. participation. Réglementation et contrôle.

Les auteurs divisent l'interaction homme-agent selon les deux modes suivants dans l'article :

的 Deux modes de scène d'interaction homme-machine : le mode Instructeur-EXECUTEUR et le mode PARTENARIAT Égal.

Mode Instructeur-Exécuteur- : Les humains agissent en tant qu'instructeurs, donnant des instructions et des commentaires ; les agents agissent en tant qu'exécuteurs, s'ajustant et optimisant progressivement en fonction des instructions. Ce modèle a été largement utilisé dans les domaines de l’éducation, de la médecine, des affaires et autres.

Mode partenariat égal : - Certaines études ont observé que les agents peuvent faire preuve d'empathie dans la communication avec les humains ou participer à l'exécution de tâches sur un pied d'égalité. Les agents intelligents présentent un potentiel d’application dans la vie quotidienne et devraient être intégrés dans la société humaine à l’avenir.

Agent Society : De la personnalité à la socialité Depuis longtemps, les chercheurs rêvent de construire une « société artificielle interactive », du jeu bac à sable « Les Sims » à « Meta « Univers », la définition que les gens donnent de la société simulée peut être résumée comme suit : environnement + individus vivant et interagissant dans l'environnement.

Dans l'article, les auteurs utilisent un diagramme pour décrire le cadre conceptuel de la société agent :

念 Le cadre conceptuel de la société d'agence est divisé en deux parties clés : l'agence et l'environnement.

Dans ce cadre, nous pouvons voir : Partie gauche : - Au niveau individuel, les agents présentent une variété de comportements intériorisés tels que la planification, le raisonnement et la réflexion. De plus, les agents présentent des traits de personnalité intrinsèques qui couvrent les dimensions cognitives, émotionnelles et personnelles.

Partie médiane : - Un agent unique peut former un groupe avec d'autres agents individuels pour présenter conjointement des comportements de groupe tels que la coopération, tels que la coopération collaborative.

Partie droite : - L'environnement peut prendre la forme d'un environnement bac à sable virtuel ou d'un monde physique réel. Les éléments de l'environnement comprennent les acteurs humains et diverses ressources disponibles. Pour un seul agent, d’autres agents font également partie de l’environnement.

Interaction globale : - Les agents participent activement à l'ensemble du processus d'interaction en détectant l'environnement externe et en prenant des mesures.

Le comportement social et la personnalité des agents

L'article examine la performance des agents dans la société du point de vue du comportement externe et de la personnalité interne : : D'un point de vue social, le comportement peut être divisé en deux niveaux : individuel et collectif : Le comportement individuel constitue la base du fonctionnement et du développement de l'agent lui-même. Il comprend les entrées représentées par la perception, les sorties représentées par l'action et le comportement intériorisé de l'agent. Le comportement Swarm fait référence au comportement qui se produit lorsque deux agents ou plus interagissent spontanément. Cela comprend les comportements positifs représentés par la collaboration, les comportements négatifs représentés par le conflit et les comportements neutres tels que suivre le troupeau et surveiller.

- Personnalité : Y compris la cognition, l'émotion et la personnalité. Tout comme les humains développent progressivement leurs traits à travers le processus de socialisation, les agents font également preuve de ce qu'on appelle une « intelligence semblable à celle de l'humain », qui est la formation progressive de la personnalité par l'interaction avec des groupes et des environnements.

Capacités cognitives : couvrent le processus par lequel les agents acquièrent et comprennent les connaissances. La recherche montre que les agents basés sur le LLM peuvent faire preuve d'une délibération et d'une intelligence similaires à celles des humains à certains égards. Intelligence émotionnelle : implique des sentiments subjectifs et des états émotionnels, tels que la joie, la colère, le chagrin et la joie, ainsi que la capacité de faire preuve de sympathie et d'empathie.

- Représentation du personnage : Afin de comprendre et d'analyser les caractéristiques de la personnalité des LLM, les chercheurs ont utilisé des méthodes d'évaluation matures, telles que les tests Big Five Personality et MBTI, pour explorer la diversité et la complexité de la personnalité.

- Simuler l'environnement opérationnel de la société

La société d'agents n'est pas seulement composée d'individus indépendants, mais comprend également l'environnement dans lequel ils interagissent. L'environnement influence la façon dont les agents perçoivent, agissent et interagissent. À leur tour, les agents modifient également l’état de l’environnement par leurs actions et décisions. Pour un agent individuel, l'environnement comprend d'autres agents autonomes, les humains et les ressources disponibles. Ici, l'auteur explore trois types d'environnements :

Environnements basés sur du texte :

Étant donné que les LLM reposent principalement sur le langage comme format d'entrée et de sortie, les environnements basés sur du texte sont les plus naturels pour les agents. plateforme d'exploitation. Les phénomènes et interactions sociales sont décrits par des mots, et l'environnement textuel fournit des connaissances sémantiques et contextuelles. Les agents existent dans de tels mondes textuels et s’appuient sur des ressources textuelles pour percevoir, raisonner et agir. Environnement Sandbox Virtuel :

Dans le domaine informatique, un bac à sable fait référence à un environnement contrôlé et isolé, souvent utilisé pour les tests de logiciels et l'analyse de virus. L'environnement sandbox virtuel de la société d'agents est une plateforme de simulation d'interaction sociale et de simulation comportementale. Ses principales fonctionnalités incluent : Visualisation : Vous pouvez utiliser des interfaces graphiques 2D simples ou même une modélisation 3D complexe pour afficher le monde. décrivant tous les aspects de la société simulée de manière intuitive. Évolutivité : Différents scénarios (Web, jeux, etc.) peuvent être construits et déployés pour mener diverses expériences, offrant ainsi un large espace à explorer aux agents.

- Environnement Physique Réel : Un environnement physique est un environnement tangible composé d'objets et d'espaces réels dans lesquels les agents observent et agissent. Cet environnement introduit de riches apports sensoriels (visuels, auditifs et spatiaux). Contrairement aux environnements virtuels, les espaces physiques imposent davantage d’exigences au comportement des agents. Autrement dit, l'agent doit être adaptable à l'environnement physique et générer un contrôle de mouvement exécutable.L'auteur a donné un exemple pour expliquer la complexité de l'environnement physique : imaginez un agent intelligent actionnant un bras robotique dans une usine. Lors du fonctionnement du bras robotique, un contrôle précis de la force est nécessaire pour éviter d'endommager des objets de différents matériaux. ; de plus, l'agent Il est nécessaire de naviguer dans l'espace physique de travail et d'ajuster la trajectoire de mouvement dans le temps pour éviter les obstacles et optimiser la trajectoire de mouvement du bras robotique. Ces exigences augmentent la complexité et le défi des agents dans l'environnement physique. Simulation, lancez-vous ! Dans l'article, les auteurs estiment qu'une société simulée doit être ouverte, persistante, situationnelle et organisée. L'ouverture permet aux agents d'entrer et de sortir de la société simulée de manière autonome ; la persistance signifie que la société a une trajectoire cohérente qui se développe au fil du temps ; la contextualité met l'accent sur l'existence et le fonctionnement des sujets dans un environnement spécifique ; comme les règles et les restrictions. En ce qui concerne l'importance de la société simulée, la ville des agents génératifs de l'université de Stanford fournit un exemple frappant pour tout le monde : la société des agents peut être utilisée pour explorer les limites des capacités d'intelligence de groupe, par exemple, les agents ont organisé conjointement une fête pour la Saint-Valentin. ; Il peut également être utilisé pour accélérer la recherche en sciences sociales, comme l'observation des phénomènes de communication en simulant les réseaux sociaux. En outre, il existe également des études visant à explorer les valeurs derrière les agents en simulant des scénarios de prise de décision éthique, et à aider à la prise de décision en simulant l'impact des politiques sur la société. En outre, l'auteur souligne que ces simulations peuvent également comporter certains risques, notamment : des phénomènes sociaux néfastes et des préjugés ; Questions ouvertes prospectives À la fin de l'article, l'auteur aborde également quelques questions ouvertes prospectives pour inciter les lecteurs à réfléchir à : Intelligent agents et grands modèles de langage Comment nos recherches peuvent-elles se promouvoir mutuellement et se développer ensemble ? Les grands modèles ont montré un fort potentiel en termes de capacités de compréhension du langage, de prise de décision et de généralisation, et sont devenus un rôle clé dans le processus de construction d'agents. Les progrès des agents ont également mis en avant des exigences plus élevées pour les grands modèles. Quels défis et inquiétudes les agents basés sur LLM apporteront-ils ? La question de savoir si des agents intelligents peuvent réellement être mis en pratique nécessite une évaluation de sécurité rigoureuse pour éviter de nuire au monde réel. L'auteur résume d'autres menaces potentielles, telles que : les abus illégaux, le risque de chômage, l'impact sur le bien-être humain, etc. Quels opportunités et défis le passage à l’échelle apportera-t-il ? Dans une société simulée, augmenter le nombre d'individus peut améliorer considérablement la crédibilité et l'authenticité de la simulation. Cependant, à mesure que le nombre d'agents augmente, les problèmes de communication et de diffusion des messages deviendront très complexes, et la distorsion de l'information, les malentendus ou les hallucinations réduiront considérablement l'efficacité de l'ensemble du système de simulation. Le débat sur Internet pour savoir si l'agent basé sur LLM est la voie appropriée vers l'AGI. Certains chercheurs pensent que les grands modèles représentés par GPT-4 ont été formés sur un corpus suffisant et que les agents construits sur cette base ont le potentiel de devenir la clé pour ouvrir la porte à l'AGI. Mais d’autres chercheurs pensent que la modélisation linguistique auto-régressive ne montre pas une réelle intelligence car elle ne fait que réagir. Une méthode de modélisation plus complète, comme le World Model, peut conduire à l'AGI. L'évolution de l'intelligence en essaim. L’intelligence en essaim est un processus consistant à recueillir les opinions de nombreuses personnes et à les convertir en décisions. Mais la véritable « intelligence » sera-t-elle produite par la simple augmentation du nombre d’agents ? De plus, comment coordonner les agents individuels pour permettre à une société d’agents intelligents de surmonter la « pensée de groupe » et les biais cognitifs personnels ? Agent en tant que service (AaaS). Étant donné que les agents basés sur LLM sont plus complexes que le grand modèle lui-même et qu'il est plus difficile pour les petites et moyennes entreprises ou les particuliers de les créer localement, les fournisseurs de cloud peuvent envisager de mettre en œuvre des agents intelligents sous forme de services, c'est-à-dire des agents intelligents. en tant que service. Comme d’autres services cloud, l’AaaS a le potentiel d’offrir aux utilisateurs une grande flexibilité et un libre-service à la demande.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!