Maison >Périphériques technologiques >IA >Outil méta open source FACET pour évaluer les préjugés raciaux et sexistes dans les modèles d'IA

Outil méta open source FACET pour évaluer les préjugés raciaux et sexistes dans les modèles d'IA

- 王林avant

- 2023-09-13 19:53:071346parcourir

Actualités du 2 septembre, afin d'atténuer le problème des préjugés systémiques à l'égard des femmes et des personnes de couleur dans de nombreux modèles de vision par ordinateur actuels, Meta Company a récemment lancé un nouvel outil d'IA appelé FACET pour identifier la race et le sexe dans les systèmes de vision par ordinateur.

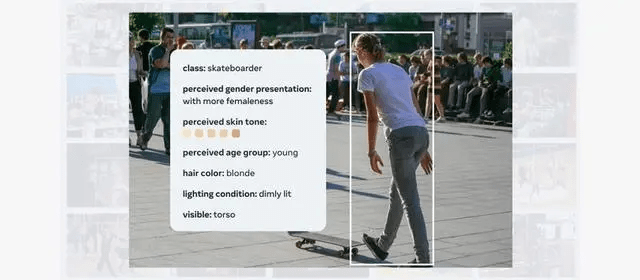

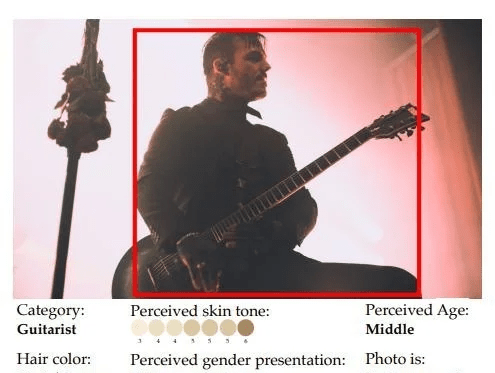

L'outil FACET est actuellement formé sur 30 000 images, dont des images de 50 000 personnes. Il améliore notamment la perception du sexe et de la couleur de la peau et peut être utilisé pour évaluer des modèles de vision par ordinateur sur diverses caractéristiques.

L'outil FACET peut répondre à des questions complexes après l'entraînement. Par exemple, après avoir identifié le sujet comme étant un homme, il peut identifier davantage les skateurs, ainsi que les peaux claires et foncées.

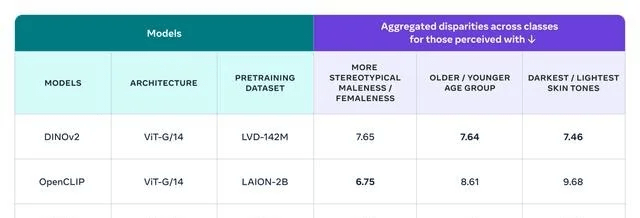

Meta utilise FACET pour évaluer le modèle DINOv2 et le modèle SEERv2 développés par la société, ainsi que le modèle OpenCLIP d'OpenAI. Dans l'ensemble, OpenCLIP est plus performant que les autres modèles en termes de sexe, tandis que DINOv a de meilleures performances en termes d'âge et de couleur de peau.

L'open source FACET aidera les chercheurs à effectuer des analyses comparatives similaires pour comprendre les biais de leurs propres modèles et surveiller l'impact des mesures d'atténuation prises pour résoudre les problèmes d'équité. IT House joint ici l'adresse du communiqué de presse Meta, et les utilisateurs intéressés peuvent la lire en profondeur.

【Source : IT Home】

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI