Maison >Périphériques technologiques >IA >Débat : Quelles sont les différences entre les opinions d'OpenAI sur l'IA entre Ultraman, Hinton et Yang Likun ?

Débat : Quelles sont les différences entre les opinions d'OpenAI sur l'IA entre Ultraman, Hinton et Yang Likun ?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-06-13 15:50:23912parcourir

La Conférence Zhiyuan de Pékin 2023 s'est ouverte à Pékin le 9 juin, organisée par l'Institut de recherche Zhiyuan. La conférence se tient depuis cinq années consécutives et constitue un événement annuel d'échange professionnel international haut de gamme sur l'intelligence artificielle.

Il est rapporté que cette conférence a duré deux jours et que le sujet principal était les opportunités et les défis rencontrés par le développement de l'intelligence artificielle. Plus de 200 experts de haut niveau dans le domaine de l'IA ont participé à la conférence, dont le fondateur d'OpenAI, Sam Altman. , Geoffrey Hinton et Yann LeCun, lauréats du Figure Spirit Award, entre autres. Ils ont tous exprimé leur point de vue sur le développement et les enjeux de l’IA.

(Source : Carte des données)

(Source : Carte des données)

"Les réseaux de neurones artificiels seront-ils bientôt plus intelligents que les vrais réseaux de neurones ?" Hinton a principalement abordé cette question dans son discours.

(Source : Carte des données)

(Source : Carte des données)

La capacité de suivre les instructions avec précision est la clé des ordinateurs dans l’informatique traditionnelle. Grâce à cette fonctionnalité, les utilisateurs peuvent choisir un matériel différent lorsqu'ils utilisent le même programme ou réseau neuronal. Cela montre qu'il n'y a aucune dépendance entre les poids du réseau neuronal dans le programme et celui du matériel.

"La raison pour laquelle ils suivent les instructions est qu'elles sont conçues pour nous permettre d'abord d'examiner un problème, de déterminer les étapes nécessaires pour le résoudre, puis de donner à l'ordinateur un modèle pour exécuter ces étapes", a déclaré Hinton.

Afin de former de grands modèles de langage à moindre coût, il a proposé le « calcul limité », ce qui signifie abandonner le principe de base de la séparation du matériel et des logiciels dans l'informatique traditionnelle et effectuer efficacement des tâches informatiques basées sur la simulation du matériel.

Cependant, cette approche pose deux problèmes principaux.

Premièrement, « le processus d’apprentissage doit exploiter les propriétés de simulation spécifiques des composants matériels sur lesquels il s’exécute, et nous ne savons pas exactement quelles sont ces propriétés », a déclaré Hinton.

Deuxièmement, cette méthode est limitée. « Parce que les connaissances sont inextricablement liées aux détails du matériel, lorsqu'un périphérique matériel spécifique tombe en panne, toutes les connaissances acquises sont perdues », explique Hinton. »

Afin de résoudre les problèmes ci-dessus, lui et ses collaborateurs ont essayé de nombreuses méthodes, comme la « méthode de distillation », qui s'est avérée très efficace.

Il a également souligné que la manière dont un groupe d'agents partage ses connaissances affectera de nombreux facteurs informatiques. Cela signifie qu’actuellement les grands modèles linguistiques semblent capables d’apprendre d’énormes quantités de connaissances, mais comme ils acquièrent principalement des connaissances par l’apprentissage de documents et n’ont pas la capacité d’apprendre directement du monde réel, la méthode d’apprentissage est très inefficace.

Les modèles d'apprentissage non supervisés, comme la modélisation vidéo, leur permettent d'apprendre efficacement. Selon Hinton, une fois activés, ces agents numériques ont de plus grandes capacités d’apprentissage que les humains et peuvent apprendre très rapidement. »

Si nous suivons cette tendance de développement, les agents intelligents deviendront bientôt plus intelligents que les humains. Cependant, cela entraînera également de nombreux défis, tels que la lutte pour le contrôle entre les agents et les humains, ainsi que les questions d'éthique et de sécurité.

« Imaginez que dans les dix prochaines années, les systèmes d’intelligence générale artificielle (AGI) dépasseront le niveau d’expertise que possédaient les humains au début des années 1990 », a déclaré Altman.

Dans son discours et sa séance de questions-réponses avec Zhang Hongjiang, président de l'Institut de recherche Zhiyuan, il a discuté de l'importance et des stratégies de promotion de la sécurité des AGI.

(Source : Carte des données)

(Source : Carte des données)

"Nous devons assumer la responsabilité des problèmes qui peuvent découler d'un développement et d'un déploiement imprudents", a déclaré Altman, soulignant deux directions, à savoir l'établissement de normes et standards internationaux inclusifs et la promotion de la construction de systèmes de sécurité AGI par le biais de la coopération internationale.

Pour l'instant, comment former de grands modèles de langage afin qu'ils puissent devenir des assistants humains véritablement sûrs et utiles est le principal problème à résoudre.

À cet égard, Ultraman a proposé plusieurs solutions.

Tout d’abord, investissez dans une supervision évolutive, comme la formation d’un modèle qui peut aider les humains à superviser d’autres systèmes d’IA.

Deuxièmement, continuez à mettre à niveau la technologie d'apprentissage automatique pour améliorer encore l'interprétabilité du modèle.

Notre objectif ultime est de permettre aux systèmes d'IA de mieux s'optimiser. Altman a déclaré : « À mesure que les futurs modèles deviendront de plus en plus intelligents et puissants, nous trouverons de meilleures techniques d'apprentissage qui réduiront les risques tout en tirant parti des avantages extraordinaires de l'IA. »

Yang Likun et Altman partagent le même point de vue sur la manière de gérer les risques actuels posés par l'IA. Cette phrase peut être réécrite comme suit : « Bien que ces risques existent, ils peuvent être atténués ou contrôlés grâce à une conception technique minutieuse. ». »

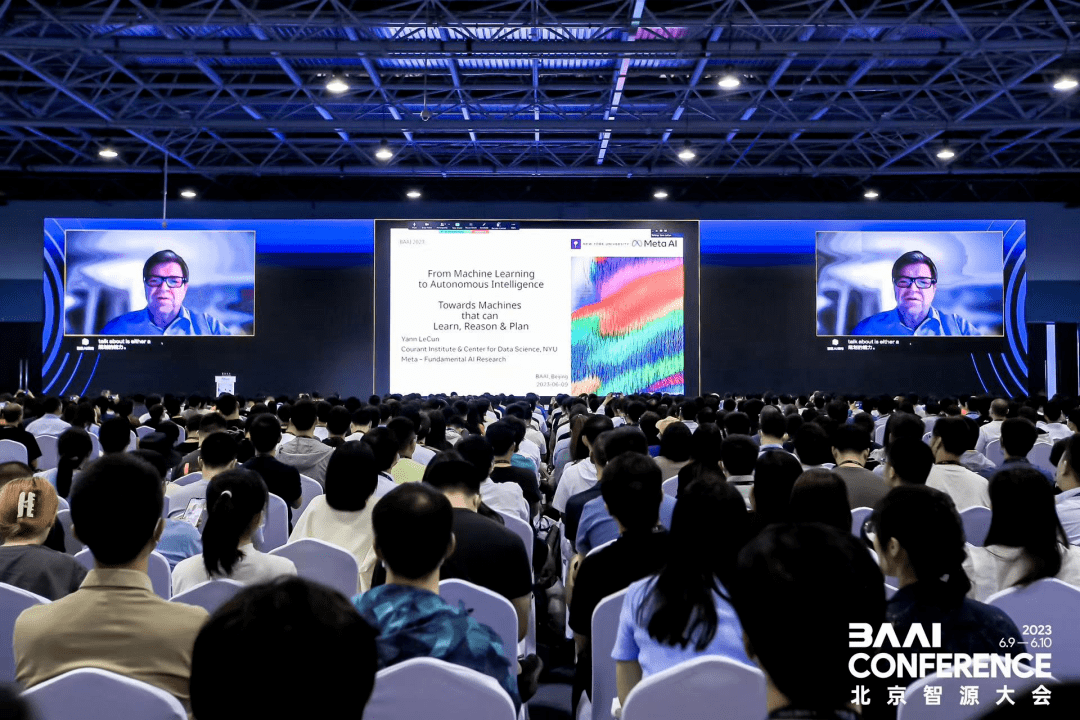

Cependant, en tant qu'expert qui s'est toujours opposé aux grands modèles de type GPT, Yang Likun a clairement souligné les avantages et les inconvénients des systèmes d'IA représentés par l'apprentissage auto-supervisé dans son discours intitulé "Vers des machines capables d'apprendre, de penser et de planifier".

(Source : Carte des données)

(Source : Carte des données)

Bien qu'il ait montré des effets extrêmement puissants dans le traitement et la génération du langage naturel, il n'a pas la capacité de raisonner et de planifier comme les humains et les animaux, cela conduira donc inévitablement à des erreurs factuelles, des erreurs logiques et des erreurs de valeur et autres. problèmes.

Sur cette base, Yang Likun estime que l'IA sera confrontée à trois défis majeurs dans les prochaines années : l'apprentissage de modèles de représentation et de prédiction du monde ; l'apprentissage des capacités de raisonnement ; et l'apprentissage de la décomposition de tâches complexes en tâches simples et de leur progression en couches.

En outre, il a proposé l'idée que le modèle mondial est au cœur du chemin vers l'AGI.

Selon lui, un modèle mondial est un système capable d'imaginer ce qui se passera dans le futur et de faire ses propres prédictions à un coût minime.

Le système fonctionne en utilisant des visions du monde antérieures qui peuvent être stockées en mémoire pour traiter l'état actuel du monde. Vous utilisez ensuite le modèle du monde pour prédire comment le monde évoluera et ce qui se passera. "Yang Likun a dit.

Alors, comment mettre en œuvre ce modèle mondial ? "Nous disposons d'un système en couches qui extrait de plus en plus de représentations abstraites de l'état du monde à travers une chaîne d'encodeurs et de modèles du monde utilisant différents niveaux de prédicteurs", a-t-il déclaré.

En termes simples, cela signifie accomplir des tâches complexes en les décomposant et en les planifiant à la milliseconde près. Pour être clair, il doit y avoir un système en place pour contrôler les coûts et optimiser les normes.

En résumé, on peut constater que bien que les trois experts aient des points de vue et des opinions différents sur l'IA, ils ont tous déclaré que le développement de l'IA est devenu une tendance générale. Comme l’a dit Ultraman, nous ne pouvons pas arrêter le développement de l’IA.

Sur cette base, comment trouver une meilleure façon de développer l'IA, supprimer une série de risques et de dommages qu'elle peut entraîner, et enfin avancer vers la fin de l'AGI sera la principale direction sur laquelle les gens devront se concentrer dans la prochaine étape.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI