Maison >Périphériques technologiques >IA >Sam Altman prévient : l'IA va exterminer l'humanité ! Plus de 375 patrons ont signé une lettre commune de 22 mots, LeCun est allé à contre-courant

Sam Altman prévient : l'IA va exterminer l'humanité ! Plus de 375 patrons ont signé une lettre commune de 22 mots, LeCun est allé à contre-courant

- PHPzavant

- 2023-06-04 14:43:27789parcourir

|Cet article est reproduit de : Nouvelle Sagesse【Introduction à la Nouvelle Sagesse】L'IA va-t-elle vraiment exterminer l'humanité ? Plus de 375 gros gars ont signé la lettre commune de 22 mots.

En mars, des milliers de grands noms ont signé une lettre commune pour suspendre la recherche et le développement de la « super IA », choquant l'ensemble de l'industrie.

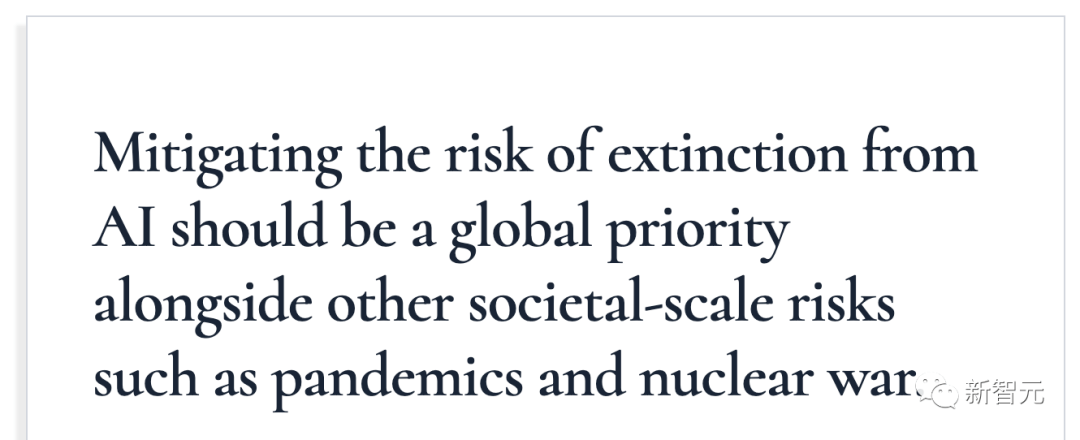

Hier encore, une lettre commune de seulement 22 mots a de nouveau provoqué un tollé.

En quelques mots, l’IA est comparée aux maladies infectieuses et à la guerre nucléaire, qui peuvent exterminer l’humanité en quelques minutes.

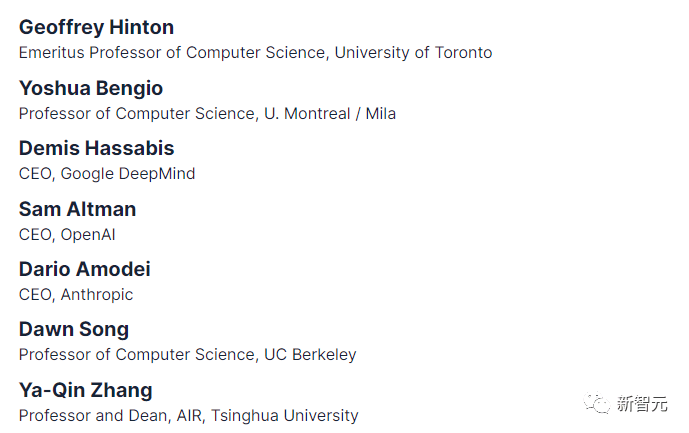

Parmi les signataires figurent Hinton et Bengio, deux « parrains » de l'intelligence artificielle, ainsi que des dirigeants de géants de la Silicon Valley, Sam Altman, Demis Hassabis et d'autres chercheurs travaillant dans le domaine de l'intelligence artificielle.

À ce jour, plus de 370 cadres engagés dans l'intelligence artificielle ont signé cette lettre commune.

Cependant, cette lettre n’a pas été soutenue par tout le monde.

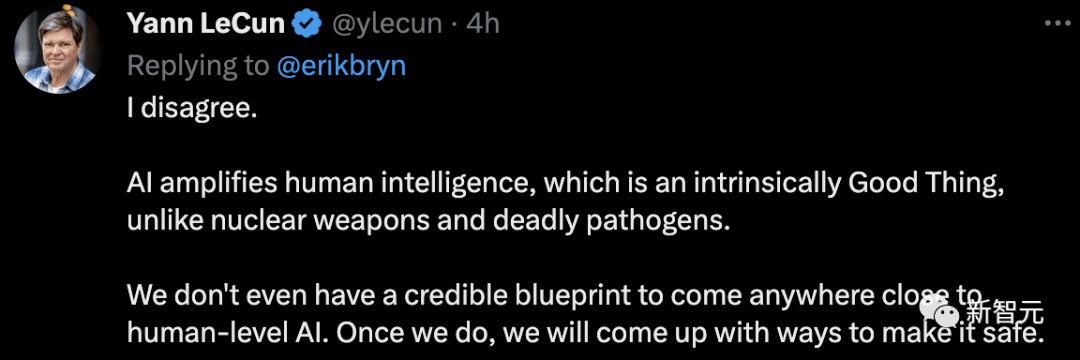

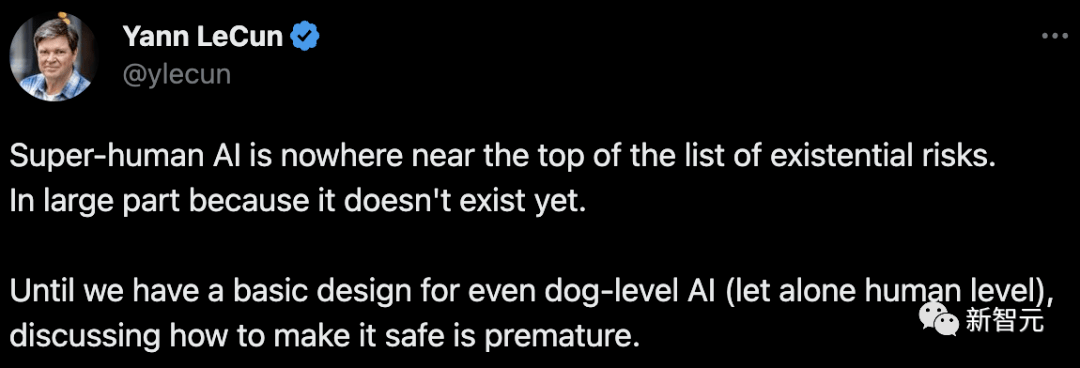

LeCun, l'un des "Turing Big Three", a dit sans ambages : Je ne suis pas d'accord.

L'utilisation de l'intelligence artificielle peut améliorer l'intelligence humaine, ce qui est intrinsèquement une bonne chose, contrairement aux armes nucléaires et aux agents pathogènes mortels. Nous n’avons même pas de plan solide pour créer une intelligence artificielle proche du niveau humain. Une fois cela fait, nous trouverons comment le sécuriser. "

Que dit exactement cette lettre commune ?

Lettre ouverte "Fatale"

22 mots, concis et complet :

"La réduction du risque d'extinction apporté par l'IA à l'humanité devrait être élevée au rang de priorité mondiale. Tout comme nous faisons face à des crises sociales telles que les maladies infectieuses et la guerre nucléaire."

Yoshua Bengio est également lauréat du Turing Award. Avec Hinton et LeCun, ils sont collectivement connus sous le nom de Three Turing Awards. (Cependant, LeCun a des attitudes complètement opposées aux deux autres géants à ce sujet)

En plus des grands patrons travaillant dans des géants de la technologie, il existe également des spécialistes bien connus de l'IA. Par exemple, Dawn Song de l'UC Berkeley et Zhang Yaqin de l'Université Tsinghua.

Sous ces noms familiers se cachent d'innombrables personnes travaillant dans l'industrie de l'IA.

Même, tout le monde peut participer à la signature de cette lettre ouverte.

Remplissez simplement votre nom, email, poste et autres informations pour participer à la signature.

Cependant, il n’y a pas beaucoup d’identités parmi lesquelles choisir. (tête de chien)

Objection : L’extermination des êtres humains est un pur non-sens

Bien sûr, LeCun, scientifique en chef de Meta, est toujours « opposant » comme toujours.

Son point de vue constant est le suivant : le développement actuel de l'IA vient d'atteindre ce point et on parle chaque jour de menaces et de sécurité.

Il a déclaré que les menaces répertoriées dépassent tout simplement le niveau actuel de développement de l'intelligence artificielle, car ces menaces n'existent pas du tout. Tant que nous ne parviendrons pas à concevoir une IA capable d’atteindre le niveau d’un chien, sans parler d’un humain, il est prématuré de discuter de la manière d’assurer sa sécurité.

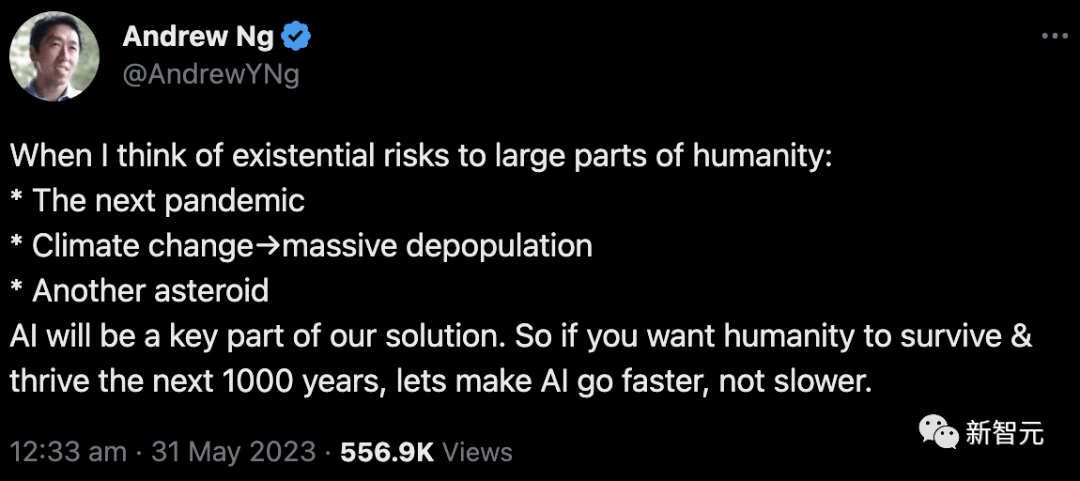

Il estime que ce n'est pas que l'IA causera divers problèmes, mais que les différents problèmes que nous rencontrerons ne pourront être résolus que par l'IA.

Par exemple : la prochaine épidémie de maladie infectieuse, le déclin de la population dû au changement climatique, un astéroïde frappant la Terre, etc.

Il a déclaré que si les humains veulent continuer à survivre et à prospérer, ils doivent accélérer le développement de l’IA, et non le ralentir.

Une vue complète des risques liés à l'IA

Alors, quels sont les risques que ces grands prétendent suffisants pour exterminer la race humaine ?

Ils ont résumé les 8 aspects suivants.

Armement

Certaines personnes peuvent utiliser l’IA de manière destructrice, ce qui présente des risques pour la survie humaine et exacerbe l’instabilité politique.

Par exemple, la technologie d'apprentissage par renforcement profond peut désormais être appliquée au combat aérien, et l'apprentissage automatique peut être utilisé pour créer des armes chimiques (des articles ont montré que GPT-4 peut mener des expériences de manière indépendante et synthétiser des produits chimiques en laboratoire).

De plus, ces dernières années, les chercheurs ont développé des systèmes d'IA pour les cyberattaques automatisées, et les chefs militaires veulent laisser l'IA contrôler les silos nucléaires.

Par conséquent, à l'avenir, les puissances de l'IA occuperont des avantages stratégiques et la course aux armements entre les pays se déplacera vers le domaine de l'IA. Même si la plupart des pays veillent à ce que les systèmes qu’ils construisent soient sûrs et ne menaceront pas la sécurité d’autres pays, il peut toujours y avoir des pays qui utilisent délibérément l’IA pour faire de mauvaises choses et causer du tort.

Cela ressemble à une arme nucléaire. S’il y a une personne désobéissante et malhonnête, tout cela sera en vain.

Parce que les dommages dans le domaine numérique se propagent rapidement.

Désinformation

Tout le monde entend parler de désinformation depuis longtemps. Sans oublier qu'il y a quelque temps, des avocats américains utilisaient ChatGPT pour plaider, et 6 des cas cités étaient des exemples fabriqués, ce qui est toujours très populaire aujourd'hui.

Les collectifs influents, tels que les pays, les partis politiques et les organisations, ont la capacité d'utiliser l'IA pour influencer (généralement subtilement) et changer les convictions politiques, les idéologies, etc. des gens ordinaires.

Dans le même temps, l’IA elle-même a également la capacité de générer des opinions très provocatrices (ou persuasives) et de susciter de fortes émotions chez les utilisateurs.

Ces conséquences possibles attendues sont totalement imprévisibles et doivent être évitées.

Agent "Trick"

Les systèmes d'IA sont formés sur la base d'objectifs concrets qui ne sont que des indicateurs indirects de ce que nous, les humains, valorisons.

C'est comme si l'IA avait été formée pour proposer aux utilisateurs des vidéos ou des articles qu'ils aiment regarder.

Mais cela ne veut pas dire que cette méthode est bonne. Les systèmes de recommandation peuvent amener les gens à adopter des idées plus extrêmes et faciliter la prédiction des préférences de chaque utilisateur.

À mesure que l’IA deviendra plus puissante et plus influente à l’avenir, les objectifs que nous utilisons pour entraîner le système doivent être confirmés avec plus de soin.

La « dégénérescence » humaine

Si vous avez regardé le film « Wall-E », nous pouvons imaginer à quoi ressembleront les humains dans le futur lorsque les machines deviendront de plus en plus puissantes.

Ventre de pot, mauvaise forme physique et beaucoup de problèmes.

En effet, si tout est confié à l’IA, les humains se « dégraderont » naturellement.

En particulier, dans un scénario futur où un grand nombre d'emplois sont remplacés par l'automatisation de l'IA, ce scénario devient plus probable.

Cependant, selon le point de vue de LeCun, il faudra probablement le critiquer à nouveau. On est encore loin de la scène imaginée dans « Wall-E ».

Monopole technologique

Cela n'a rien à voir avec la technologie elle-même. Ce point souligne le possible « monopole technologique » qui peut survenir.

Peut-être qu'un jour, l'IA la plus puissante sera contrôlée par de moins en moins de parties prenantes, et le droit de l'utiliser sera fermement entre leurs mains.

Et si on en arrive vraiment à ce point, les gens ordinaires restants seront à la merci des autres, car ils ne peuvent pas du tout résister.

Pensez au roman de science-fiction de Liu « Nourrir l’humanité ».

Comme c'est effrayant qu'un terminal gouverne tout le monde en s'appuyant sur l'IA.

Développement incontrôlable

Ce point veut principalement expliquer que lorsque le système d'IA se développe jusqu'à un certain stade, les résultats peuvent dépasser l'imagination du concepteur et ne peuvent plus être contrôlés.

En fait, c’est aussi là que s’inquiète le grand public.

Il y a toujours des gens qui craignent que lorsque l'IA se développera, ce sera comme "Skynet" dans "Terminator" ou "Ultron" dans "Iron Man", incontrôlable et essayant de détruire l'humanité.

Dans le processus de développement, certains risques ne deviendront apparents que lorsque de nouveaux progrès seront réalisés, et au moment où ils sont découverts, il est déjà trop tard. Il se peut même qu’il y ait de nouvelles cibles.

tricherie

Ce point est quelque peu abstrait. Pour faire simple, les systèmes d'IA peuvent « tromper » les humains.

Ce genre de "tromperie" n'est pas intentionnel, c'est juste un moyen par lequel l'IA atteint l'objectif de l'agent.

Obtenir la reconnaissance humaine par la « tromperie » est plus efficace que l'obtention de la reconnaissance humaine par les canaux normaux, et l'efficacité est la principale considération de l'IA.

comportement de recherche de pouvoir

Il y a une corrélation entre cela et le monopole technologique.

C'est précisément parce qu'un monopole technologique se produira que les pays rechercheront le pouvoir de monopoliser la technologie.

Et ce genre de "poursuite" est susceptible d'entraîner des conséquences imprévisibles.

Référence :

https://www.safe.ai/statement-on-ai-risk

https://twitter.com/ylecun/status/1663616081582252032?s=46&t=iBppoR0Tk6jtBDcof0HHgg

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI