Maison >Périphériques technologiques >IA >La version open source nationale du « système de plug-in ChatGPT » est là ! Douban, les recherches sont toutes disponibles, publiées conjointement par l'Université Tsinghua, Face Wall Intelligence, etc.

La version open source nationale du « système de plug-in ChatGPT » est là ! Douban, les recherches sont toutes disponibles, publiées conjointement par l'Université Tsinghua, Face Wall Intelligence, etc.

- 王林avant

- 2023-05-24 14:25:071491parcourir

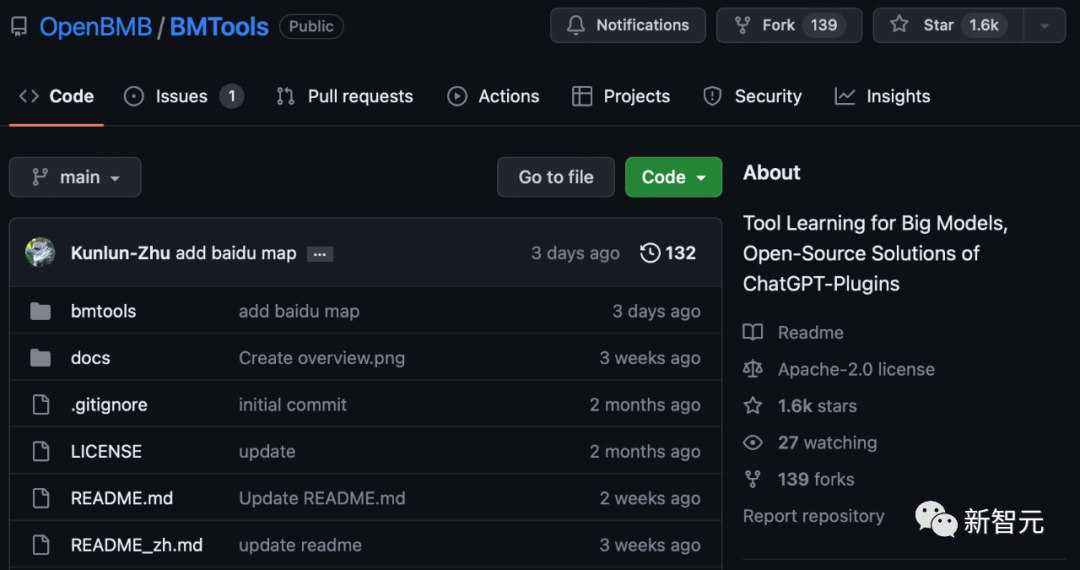

Récemment, un projet open source appelé « ChatGPT Plugins Domestic Alternative System » a connu une forte augmentation du nombre d'étoiles sur GitHub.

Ce projet est BMTools, un moteur d'apprentissage d'outils de grands modèles développé par Wallface Intelligence.

Adresse du projet : https://www.php.cn/link/a330f9fecc388ce67f87b09855480ca3

Explorez en profondeur l'avant-garde et intégrez rapidement l'apprentissage des outils de grands modèles

Tout d'abord, le plus question importante, qu'est-ce qu'il y a de si génial avec BMTools ?

En tant que plate-forme d'apprentissage d'outils évolutive open source basée sur des modèles de langage, l'équipe R&D de Wallface a unifié divers processus d'appel d'outils dans le cadre BMTools, standardisant et automatisant l'ensemble du processus d'appel d'outils.

Actuellement, les plug-ins pris en charge par BMTools couvrent le divertissement, l'enseignement, la vie et d'autres aspects, notamment douban-film (film Douban), la recherche (recherche Bing), Klarna (shopping), etc.

Les développeurs peuvent utiliser BMTools pour utiliser un modèle donné (tel que ChatGPT, GPT-4) pour appeler une variété d'interfaces d'outils afin d'implémenter des fonctions spécifiques.

De plus, la boîte à outils BMTools a également intégré les outils Auto-GPT et BabyAGI récemment populaires.

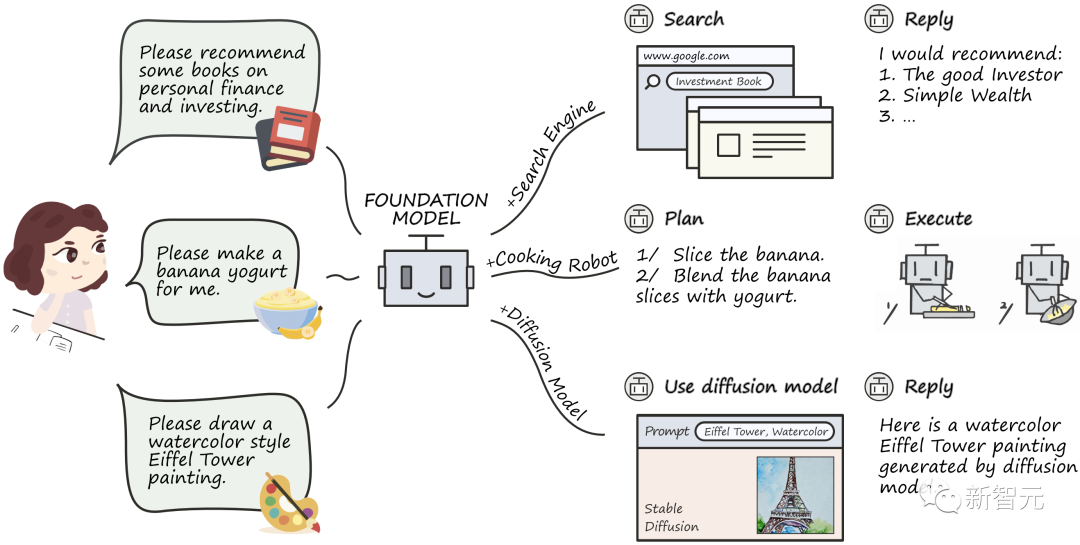

Alors, à quoi sert ce type d'apprentissage d'outils pour les grands modèles ?

Bien que les grands modèles aient obtenu des résultats remarquables à bien des égards, ils présentent encore certaines limites dans les tâches dans des domaines spécifiques. Ces tâches nécessitent souvent des outils spécialisés ou des connaissances du domaine pour être résolues efficacement.

Par conséquent, tout comme les smartphones doivent télécharger des applications pour avoir une meilleure expérience utilisateur, les grands modèles doivent avoir la possibilité d'appeler divers outils professionnels afin de fournir une prise en charge plus complète pour les tâches du monde réel.

Tool Learning, un nouveau paradigme des grands modèles a vu le jour. Au cœur de ce paradigme se trouve la fusion d’outils spécialisés avec les atouts des modèles sous-jacents pour obtenir une plus grande précision, efficacité et autonomie dans la résolution de problèmes.

La combinaison organique de grands modèles et d'outils externes a réussi à combler de nombreuses lacunes des capacités précédentes, et l'apprentissage des outils a considérablement libéré le potentiel des grands modèles.

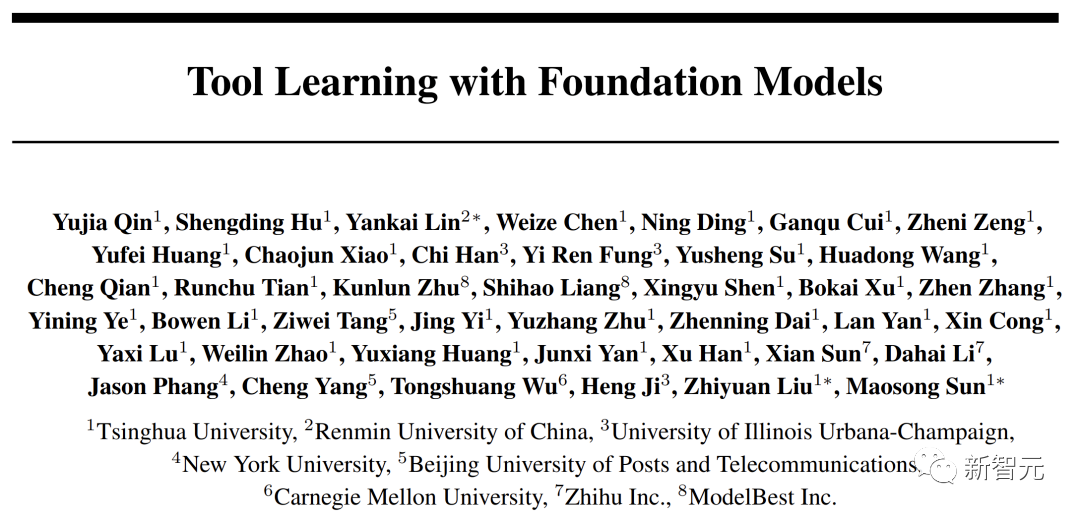

Adresse papier : https://arxiv.org/abs/2304.08354

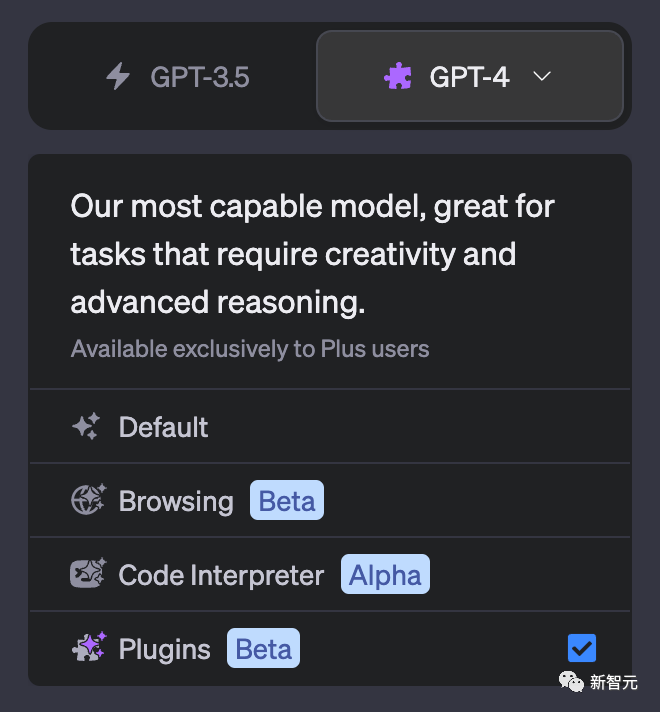

Le 23 mars 2023, OpenAI a annoncé le lancement du système de plug-in (Plugins) La compétence est ce que nous appelons l’apprentissage instrumental.

Avec la prise en charge de l'apprentissage des outils, les plugins peuvent prendre en charge ChatGPT pour connecter les navigateurs, les calculs mathématiques et d'autres outils externes, améliorant ainsi considérablement ses capacités.

L'émergence des plugins ChatGPT a complété les dernières lacunes de ChatGPT, lui permettant de prendre en charge la mise en réseau et de résoudre des calculs mathématiques. C'est ce qu'on appelle le moment "App Store" d'OpenAI. Cependant, jusqu'à présent, il n'était pris en charge que par les utilisateurs d'OpenAI Plus et restait indisponible pour la plupart des développeurs.

Pourquoi Mianbi peut-il lancer BMTools seulement dix jours après la sortie des plugins ChatGPT ?

Facing Wall Intelligence se concentre sur le développement d'outils informatiques efficaces pour l'ensemble du processus de grands modèles depuis 2022, en essayant de combiner les modèles de langage existants avec. des moteurs de recherche, des bases de connaissances et d'autres outils ont été obtenus. L’équipe a également mené une exploration fructueuse dans le domaine de recherche de pointe de l’apprentissage des outils.

Afin de satisfaire les attentes enthousiastes de nombreux développeurs quant aux capacités des plugins OpenAI, sur la base de l'accumulation précédente, l'équipe a rapidement intégré les résultats de recherche pertinents et les a accumulés dans la boîte à outils BMTools, qui L'apprentissage des outils est intégré dans le système de capacité intelligent de grands modèles face au mur et rejoint officiellement le système d'outils de grands modèles OpenBMB « Family Bucket ».

L'apprentissage des outils est également un autre chef-d'œuvre lancé par Wallface Intelligence après la suite efficace de formation, de réglage fin, d'inférence et de compression.

Boîte à outils BMTools : https://www.php.cn/link/a330f9fecc388ce67f87b09855480ca3

Leading the Wall Breaking, le premier modèle chinois de questions et réponses d'assistance en ligne

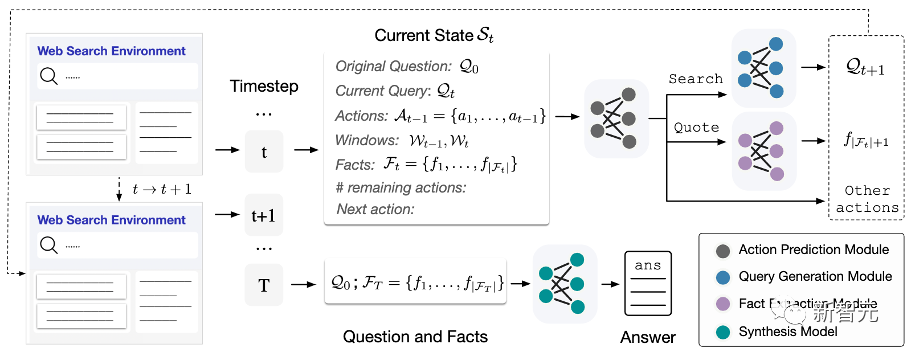

Récemment, Wall-Facing Intelligence, en collaboration avec des chercheurs de l'Université Tsinghua, de l'Assemblée populaire nationale et de Tencent, ont publié conjointement WebCPM, le premier cadre de modèle de questions et réponses open source basé sur la recherche Web interactive dans le domaine chinois. Cette initiative a comblé une lacune dans le domaine des grands modèles domestiques. Et WebCPM est la pratique réussie de BMTools.

Actuellement, les travaux liés au WebCPM ont été acceptés dans l'ACL 2023, la principale conférence sur le traitement du langage naturel.

Lien papier WebCPM : https://arxiv.org/abs/2305.06849

Lien données et code WebCPM : https://github.com/thunlp/WebCPM

Cela peut Il faut dire que depuis que ChatGPT est devenu populaire, de grands modèles de diverses factions ont vu le jour en Chine, mais la plupart des modèles ne sont pas connectés à Internet.

Les grands modèles qui ne sont pas connectés à Internet ne peuvent pas obtenir les dernières informations et le contenu généré est basé sur d'anciens ensembles de données, ce qui présente certaines limites.

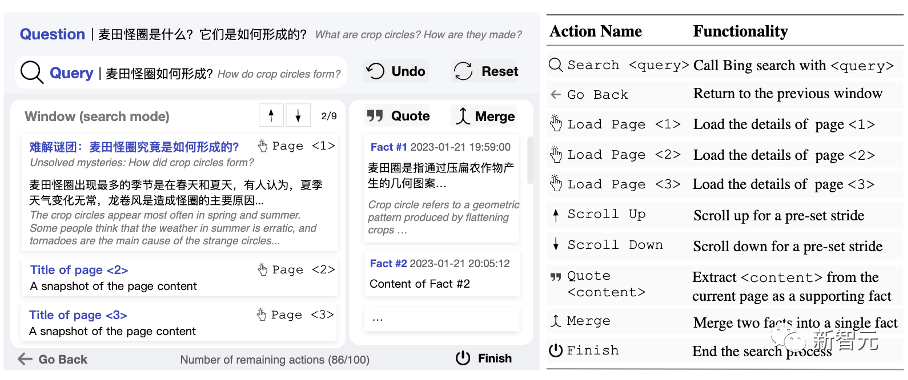

La caractéristique de WebCPM est que sa recherche d'informations est basée sur une recherche Web interactive, Il peut interagir avec les moteurs de recherche comme les humains pour collecter les connaissances factuelles nécessaires pour répondre aux questions et générer des réponses.

En d'autres termes, avec le support de la fonction Internet, le temps réel et la précision des réponses aux questions des grands modèles ont été considérablement améliorés. Le cadre de modèle WebCPM est comparé à WebGPT, qui est également la technologie de recherche de nouvelle génération derrière le nouveau Bing récemment lancé par Microsoft.

Comme WebGPT, WebCPM surmonte les défauts du paradigme traditionnel de questions et réponses ouvertes à texte long LFQA (Long-form Question Answering)

surmonte les défauts du paradigme traditionnel de questions et réponses ouvertes à texte long LFQA (Long-form Question Answering)

Dans le cadre WebCPM, le modèle peut filtrer des informations de haute qualité comme les humains en interagissant avec les moteurs de recherche en temps réel pour effectuer des recherches sur le Web.

De plus, lorsqu'il rencontre des problèmes complexes, le modèle le décompose également en plusieurs sous-problèmes comme les humains et pose des questions dans l'ordre.De plus, en identifiant et en parcourant les informations pertinentes, le modèle améliorera progressivement sa compréhension du problème d'origine et interrogera continuellement de nouvelles questions pour rechercher des informations plus diverses.

Interface interactive de recherche WebCPM

À l'avenir, l'intelligence orientée vers les murs favorisera davantage l'application et la transformation des résultats de la recherche scientifique et s'efforcera de promouvoir la mise en œuvre de grands modèles WebCPM dans les domaines correspondants. champs.

Nous nous engageons à construire un système national de grands modèles à partir de haut niveau

Wall-face Intelligence s'est toujours efforcé de diriger l'innovation originale des grands modèles et s'engage à construire une infrastructure de grands modèles à l'ère intelligente et construire un système national de grands modèles, en vue de parvenir à terme à « laisser les grands modèles voler dans » des milliers de foyers.

Les résultats de l'intelligence face aux murs sont évidents pour tous et ont été reconnus par l'industrie.

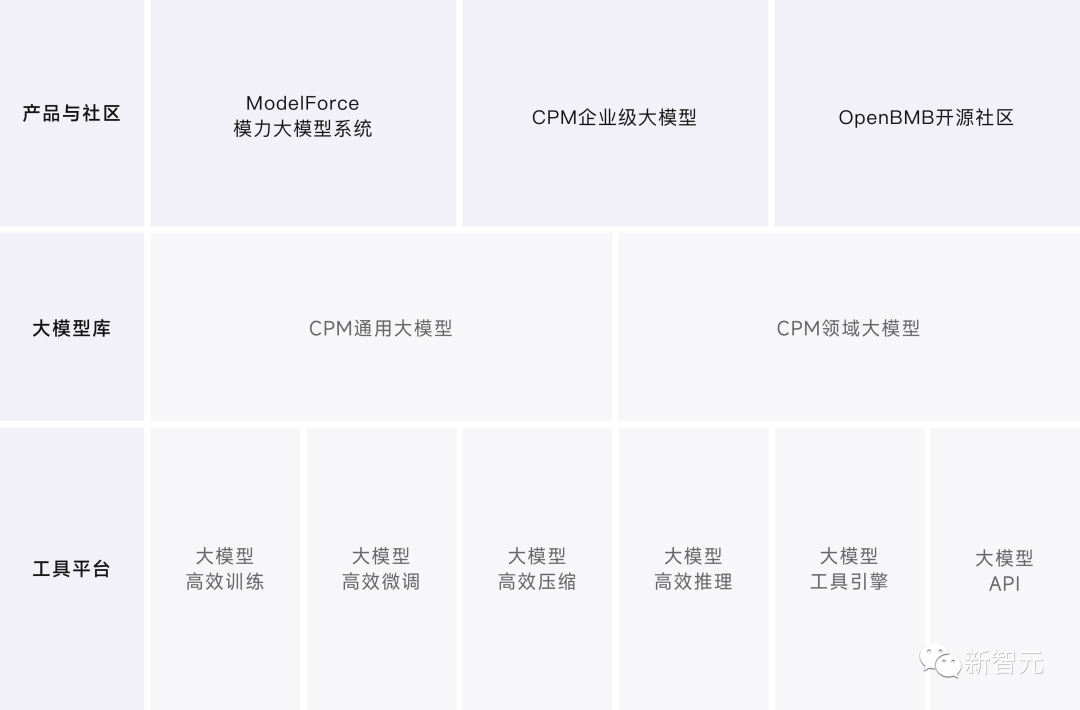

Li Dahai, directeur de la technologie de Zhihu, a un jour commenté Wall-Facing Intelligence : « L'équipe Wall-Facing Intelligence est la première équipe en Chine à mener des recherches sur des modèles de langage à grande échelle. la recherche et les applications de grands modèles, y compris la technologie de réglage fin et la technologie Accelerate, etc., et ses capacités de R&D occupent une position de leader dans l'industrie "Zhihu a déclaré qu'il pensait que Wall-facing Intelligence pouvait devenir un fabricant clé d'infrastructures. dans le domaine du modélisme à grande échelle en Chine et contribuer à l'industrie chinoise du modélisme à grande échelle. « Panorama intelligent face au mur » ModelForce, une plate-forme de productivité d'IA basée sur de grands modèles, dispose d'un système d'outils informatiques efficace intégré pour l'ensemble du processus de formation, de réglage fin, de compression et d'inférence de grands modèles.

La plate-forme est basée sur les capacités générales des grands modèles avec peu d'échantillons et zéro échantillon. Elle utilise des méthodes de réglage fin standardisées pour les grands modèles et crée des clients de réglage fin sans code, ce qui peut réduire considérablement les coûts d'annotation des données. les coûts de puissance de calcul et les coûts de main-d'œuvre dans le processus de R&D en IA.

CPM Large Model Enterprise Edition a mis à niveau ses capacités pour le modèle de version open source et présente les caractéristiques d'une intégration multi-capacités, d'un réglage fin incrémentiel et d'une adaptation flexible, ainsi que d'une application multi-scénarios. Basé sur le grand modèle CPM au niveau de l'entreprise et le système de grands modèles ModelForce, Wallface Intelligence a coopéré avec Zhihu pour former le grand modèle

"Zhihaitu AI". Le grand modèle « Zhihaitu AI » a été appliqué à la Zhihu Hot List, qui peut rapidement extraire des éléments, trier les opinions et regrouper le contenu. Il a été publié lors de la conférence Zhihu Discovery le 23 avril.

Cela ne s'arrête pas là. En fait, Wall-facing Intelligence se dresse haut et a réussi à créer un modèle écologique à grande échelle industrie-université-recherche « Trinité » en intégrant la puissance de recherche universitaire des meilleures universités et en continuant à construire et à exploiter le modèle à grande échelle. modèle de communauté open source OpenBMB, Wall-facing Intelligence a construit les besoins de l'industrie, Le canal en boucle fermée entre l'algorithme open source et la mise en œuvre industrielle s'efforce de promouvoir la recherche de pointe, la recherche et le développement d'applications et le développement industriel dans le domaine de l'industrie nationale. grands modèles. La communauté open source OpenBMB contribue à la construction d'un écosystème open source national de grands modèles et a publié une série de modèles grandeur nature de grands modèles, notamment OpenPrompt et OpenDelta. , BMInf, BMCook, BMTrain, BMTools, etc. Une boîte à outils open source de processus et des cours ouverts à grande échelle pour tous ont été lancés sur Zhihu, Bilibili et d'autres plateformes.

- Département d'informatique de l'Université TsinghuaLaboratoire de traitement du langage naturel et d'humanités sociales (THUNLP)

En tant que force de recherche sans précédent dans les universités, il a été créé dans les années 1970 et est le premier à mener Recherche en PNL en Chine Il s'agit de l'unité de recherche scientifique la plus ancienne et la plus influente, avec de nombreux universitaires et scientifiques de renom qui y travaillent, et ses travaux de recherche dans le domaine des grands modèles de langage sont très remarquables.

- Facing the Wall Intelligence

s'engage dans l'application et la mise en œuvre de grands modèles dans des scénarios et des domaines typiques de l'intelligence artificielle. Le grand modèle CPM est un module de langage de pré-formation auto-développé par. l'équipe de Facing the Wall basée sur des années d'expérience en formation de grands modèles. La société a désormais réalisé des dizaines de millions de yuans de financement providentiel et a conclu une coopération stratégique avec un certain nombre d'institutions bien connues.

Dans le cadre de ses efforts visant à construire un système national de grands modèles, la vision de Wallface Intelligence a toujours été de permettre la mise en œuvre de grands modèles pour responsabiliser davantage d'industries et bénéficier à davantage d'entreprises et d'individus.

L'étincelle a déclenché un feu de prairie, et nous attendons avec impatience que les grands modèles libèrent leur potentiel dans davantage de domaines et démontrent une valeur d'application surprenante.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI