Maison >Périphériques technologiques >IA >Google affirme que son TPU de quatrième génération est meilleur que le GPU Nvidia, mais l'industrie estime que la position de leader de ce dernier est difficile à ébranler.

Google affirme que son TPU de quatrième génération est meilleur que le GPU Nvidia, mais l'industrie estime que la position de leader de ce dernier est difficile à ébranler.

- PHPzavant

- 2023-05-09 13:10:121194parcourir

Google a récemment affirmé que l'entreprise pouvait surpasser Nvidia en termes de puissance de calcul IA. Cependant, l'industrie estime que cette nouvelle ne risque pas de causer beaucoup de problèmes à Nvidia, le leader du marché.

Google a récemment publié un rapport de recherche indiquant que les supercalculateurs IA alimentés par son TPU ont de meilleures performances et une meilleure efficacité énergétique que les machines équivalentes exécutant des GPU Nvidia A100.

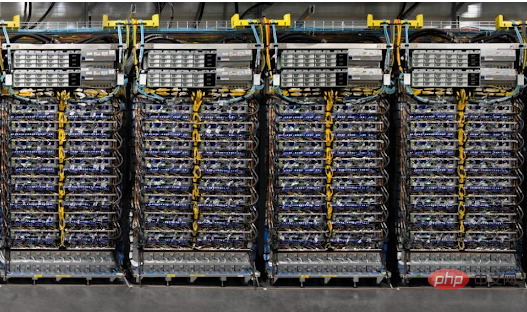

Google a assemblé 4 000 TPU de quatrième génération pour construire un superordinateur qui, selon lui, fonctionnera 1,7 fois plus vite et 1,9 fois plus efficacement que les machines équivalentes utilisant des GPU Nvidia A100.

Google exploite un supercalculateur alimenté par TPU v4 en Oklahoma

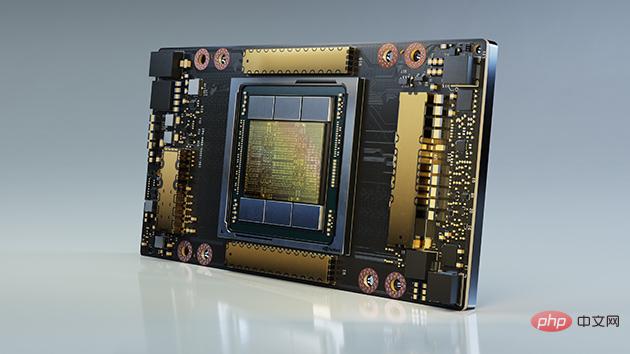

Nvidia bénéficie de l'essor de l'IA générative, avec une demande croissante des utilisateurs pour les GPU Nvidia A100. A100 est principalement utilisé pour former des modèles d’IA en langage volumineux, tels que le GPT-4 d’OpenAI.

L’industrie estime qu’étant donné que le nouveau GPU H100 de Nvidia est sur le point d’être lancé, il est peu probable que l’entreprise s’inquiète de cette réussite de Google.

Google utilise TPU v4 en interne depuis 2020 et a mis ces puces à disposition de ses clients Google Cloud Platform l'année dernière. Le plus grand modèle de langage à grande échelle de l'entreprise, PaLM, est formé à l'aide de deux supercalculateurs 4 000 TPU.

Le chercheur Google Norm Jouppi et l'ingénieur distingué David Patterson ont expliqué dans un article de blog à propos du système : « Les composants défaillants peuvent être facilement contournés avec des commutateurs de circuits optiques. Cette flexibilité nous permet même de modifier la topologie de l'interconnexion informatique pour accélérer les performances. de modèles d'apprentissage automatique. » Mike Orme, responsable du développement du marché des semi-conducteurs chez GlobalData, a déclaré que l'utilisation de commutateurs de circuits optiques est la clé pour améliorer les performances des supercalculateurs de Google. Il a expliqué : "Bien que chaque TPU ne traite pas aussi rapidement que les meilleures puces NVIDIA AI, la technologie de commutation de circuits optiques que Google utilise pour connecter les puces et transmettre les données entre elles compense la différence de performances.

NVIDIA La technologie est devenue." l'étalon-or pour la formation des modèles d'IA, et certaines grandes entreprises technologiques ont acheté des milliers de GPU Nvidia A100 pour tenter de surpasser leurs adversaires dans la compétition de technologie d'IA. Le supercalculateur utilisé par OpenAI pour entraîner GPT-4 est équipé de 10 000 GPU Nvidia, chacun coûtant jusqu'à 10 000 $.

GPU Nvidia A100

GPU Nvidia A100

Les dernières nouvelles montrent que l'A100 sera bientôt remplacé par le dernier modèle de Nvidia, le H100. Dans un rapport de référence d'inférence récemment publié par MLPerf, une alliance ouverte d'ingénierie en IA qui suit les performances du processeur, le H100 est en tête de liste du secteur en termes de puissance et d'efficacité.

GPU Nvidia H100

GPU Nvidia H100

Cet avantage en termes de vitesse éliminera les avantages apportés par la technologie de commutation de circuits optiques de Google. 90 % de la formation IA de Google utilise le TPU, mais malgré sa puce puissante, Orme ne s'attend pas à ce que Google la propose à des tiers car Google n'a pas l'ambition de concurrencer les puces Nvidia sur le marché des puces IA commerciales, dont les TPU sont dédiés à Les centres de données de Google ou ses supercalculateurs IA. «

Pourquoi peu d'utilisateurs en dehors de Google utilisent cette technologie ? Orme estime que c'est parce que Google Cloud détient une petite part du marché du cloud public. Selon les données d'enquête publiées par Synergy Research Group, la part de marché de Google Cloud est de 11 %. derrière AWS et Microsoft Azure à 34 % et 21 %

Dans le même temps, Google a également conclu un accord avec NVIDIA pour fournir la puissance de calcul du GPU H100 aux clients de Google Cloud, ce qui montre que NVIDIA continuera à maintenir son leadership sur le marché à l'avenir. Même Google ne peut pas s'en passer.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI