Maison >Périphériques technologiques >IA >Stanford HAI publie son dernier livre blanc : Les États-Unis progressent lentement dans leur stratégie nationale en matière d'IA depuis deux ans

Stanford HAI publie son dernier livre blanc : Les États-Unis progressent lentement dans leur stratégie nationale en matière d'IA depuis deux ans

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-20 15:55:091385parcourir

Récemment, le Stanford HAI Institute et le Stanford Regulatory, Evaluation and Governance Laboratory ont publié conjointement le livre blanc « Les défis de mise en œuvre des trois piliers de la stratégie américaine d'intelligence artificielle », qui évalue systématiquement les progrès de l'intelligence artificielle aux États-Unis.

Le livre blanc se concentre principalement sur les trois piliers de l'innovation en matière d'IA et d'une IA digne de confiance :

1. La loi sur l'intelligence artificielle dans le gouvernement de 2020

2 À propos du décret exécutif sur le « leadership en matière d'intelligence artificielle » ;

3. Décret exécutif sur « L'intelligence artificielle au sein du gouvernement ».

Dans l’ensemble, ces décrets et la loi sur l’intelligence artificielle dans le gouvernement sont essentiels pour garantir la stratégie nationale des États-Unis en matière d’intelligence artificielle, qui est simplement « un avantage concurrentiel sur le reste du monde au cours de la prochaine décennie ».

Après avoir vérifié de manière approfondie l'état de mise en œuvre de chaque exigence dans plus de 200 agences fédérales, l'auteur a constaté que même si les États-Unis ont fait de nombreux progrès dans l'innovation en matière d'intelligence artificielle, ils sont également confrontés à certains problèmes :

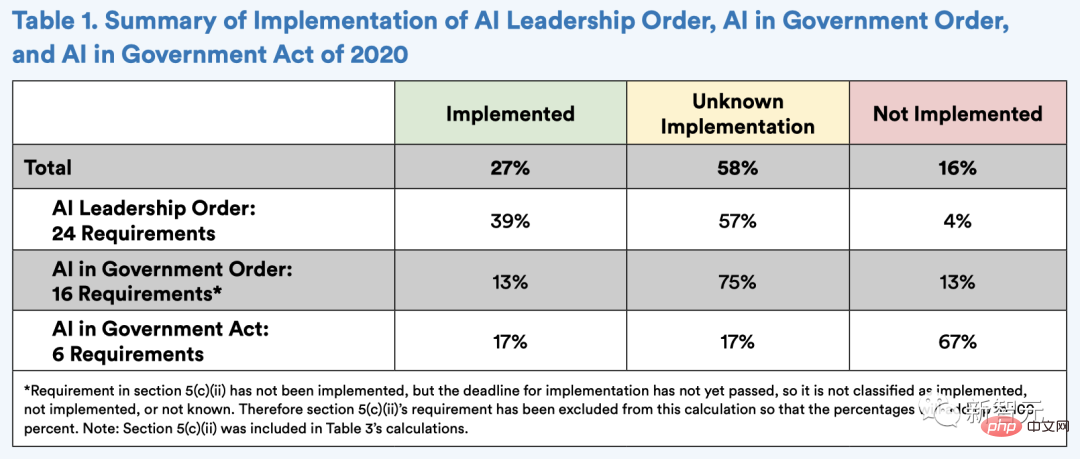

- Moins plus de 40 % de toutes les exigences peuvent être publiquement vérifiées comme étant mises en œuvre.

- 88 % des institutions interrogées n'ont pas réussi à fournir un plan d'IA identifiant les agences de réglementation liées à l'IA.

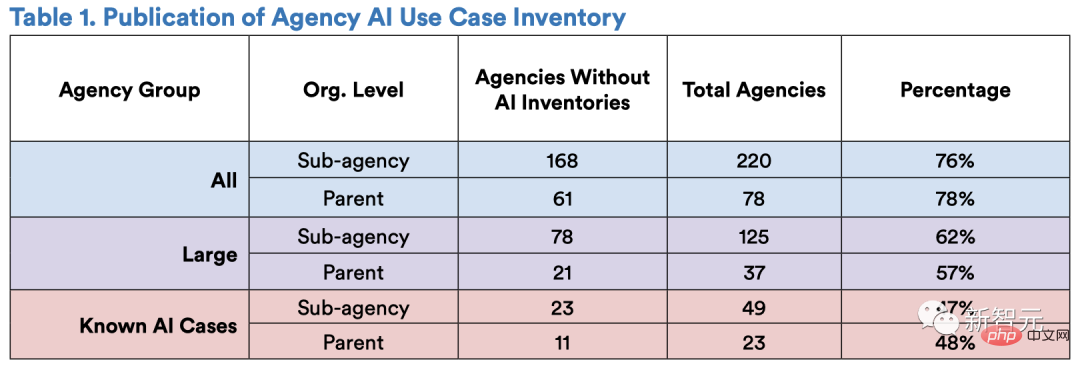

- Environ la moitié ou plus des agences n'ont pas soumis de liste de cas d'utilisation de l'IA comme l'exige l'Intelligence artificielle dans l'ordre gouvernemental.

Résumé

Le potentiel transformateur de l'intelligence artificielle (IA) est un fait incontestable.

Pour profiter de la « Quatrième révolution industrielle » ou de la « Troisième vague de révolution numérique », les pays donnent la priorité aux efforts visant à réorganiser leurs secteurs public et privé, à financer la recherche et le développement (R&D) et à construire des infrastructures pour libérer l'IA. structure et politiques d’innovation.

Aux États-Unis, la Maison Blanche et le Congrès promeuvent l'innovation en matière d'IA et son déploiement fiable en augmentant les investissements dans la R&D, en explorant des mécanismes visant à accroître l'accès équitable aux ressources liées à l'IA grâce aux ressources nationales de recherche en IA et en finançant l'intelligence artificielle nationale. L'Intelligence Institute, qui consacre 280 milliards de dollars à la fabrication nationale de semi-conducteurs et aux « industries du futur » par le biais du CHIPS et de la Science Act, coordonne la politique en matière d'IA au sein du Bureau de la National Artificial Intelligence Initiative de la Maison Blanche.

1. Stratégie nationale pour l'intelligence artificielle : décret et législation

Alors que l'Artificial Intelligence Leadership Order cherche à générer des percées technologiques dans tous les secteurs américains, les deux autres efforts se concentrent sur l'utilisation de l'IA par le gouvernement fédéral.

Décret exécutif 13859

L'Ordre du leadership en matière d'intelligence artificielle a lancé l'Initiative américaine en matière d'intelligence artificielle pour « concentrer les ressources fédérales sur le développement de l'intelligence artificielle afin d'accroître la prospérité américaine, de renforcer la sécurité nationale et économique américaine et d'améliorer la qualité de l'intelligence artificielle ». vie pour le peuple américain. Plus précisément, il cherche à accélérer les efforts fédéraux en mettant l'accent sur la recherche et le développement de l'IA, les données et ressources liées à l'IA, les orientations réglementaires et les normes techniques, la main-d'œuvre en IA et la compréhension du public de l'intelligence artificielle. Une approche à plusieurs volets, incluant la confiance dans le renseignement et l’engagement international, construit l’infrastructure, les fondements politiques et les talents nécessaires au leadership américain en matière d’IA.

En outre, une « stratégie coordonnée du gouvernement fédéral » est nécessaire et l'IA « aura un impact sur les missions de presque tous les départements et agences exécutifs. L'ordre de leadership de l'IA habilite en outre les agences à poursuivre six objectifs stratégiques liés pour « promouvoir et protéger les progrès américains en matière d'intelligence artificielle.

Décret Exécutif 13960

Décret Exécutif 13960

L'Intelligence artificielle dans l'ordre gouvernemental ordonne aux agences fédérales d'exploiter le « potentiel de l'intelligence artificielle pour améliorer les opérations gouvernementales ». Reconnaissant que « l’adoption et l’acceptation continues de l’IA dépendront fortement de la confiance du public », l’IA in the Government énonce neuf principes que les agences fédérales devraient mettre en œuvre lors de la conception, du développement, de l’acquisition et de l’utilisation de l’IA. Ces principes stipulent que l'intelligence artificielle doit être (a) légale, (b) axée sur la performance, (c) précise, fiable et efficace, (d) sûre, fiable et résiliente, (e) capable de comprendre, (f ) responsable et traçable, (g) régulièrement contrôlé, (h) transparent et (i) responsable. Loi de 2020 sur l'intelligence artificielle dans le gouvernement Cette loi vise à « garantir que l'utilisation de l'intelligence artificielle au sein du gouvernement fédéral est efficace et éthique en fournissant des ressources et des conseils aux agences fédérales » " Cela comprend la création d'une série de carrières en IA, appelant à des conseils formels sur l'utilisation, l'approvisionnement, l'évaluation et l'atténuation des préjugés de l'IA par les agences, et la création d'un centre d'excellence au sein de l'Administration des services généraux (GSA) pour soutenir l'adoption par le gouvernement de l'intelligence artificielle. L'auteur a étudié la mise en œuvre des dispositions de chaque département dans les deux décrets et la loi sur l'intelligence artificielle dans le gouvernement. Dans les deux décrets ci-dessus et dans la loi de 2020 sur l'intelligence artificielle dans le gouvernement, les auteurs ont constaté que 11 des 45 exigences, soit environ 27 %, ont été mises en œuvre. Cependant, 7 exigences sur 45 (16 %) n'ont pas été mises en œuvre dans les délais, et les 26 exigences restantes (58 %) n'ont pas pu être confirmées si elles étaient pleinement mises en œuvre ou non. De même, parmi les exigences déjà mises en œuvre, le statut spécifique de mise en œuvre est également incertain. Cela comprend des efforts visant à rendre les données et le code source plus accessibles pour la R&D en IA, à mieux exploiter et à créer de nouveaux programmes d'éducation et de développement de la main-d'œuvre liés à l'IA, et à garantir l'engagement total de l'agence pour poursuivre la mise en œuvre d'une IA digne de confiance. Quatre exigences liées aux délais de la loi sur l'intelligence artificielle dans le gouvernement n'ont pas été mises en œuvre : Parmi les mesures mises en place, plusieurs sont en retard. Par exemple, le Comité spécial sur l'intelligence artificielle du Conseil national des sciences et technologies (NSTC) a soumis son rapport au président sur une meilleure utilisation de la technologie du cloud computing 16 mois après la date limite. Comme mentionné ci-dessus, un objectif important de ces décrets et projets de loi est de "réduire les obstacles à l'utilisation de la technologie de l'intelligence artificielle pour promouvoir ses applications innovantes" tout en protégeant les libertés civiles, la vie privée et les États-Unis. les valeurs, l'économie américaine et la sécurité nationale. Ainsi, ces décrets mettent l'accent sur la révision du rôle approprié de la régulation de l'intelligence artificielle, dans l'espoir "d'éviter les actions réglementaires ou non réglementaires qui entravent inutilement l'innovation et la croissance de l'IA". Deux exigences sont essentielles pour atteindre cet objectif : 1. Demander à l'OMB de publier un mémorandum aux chefs d'agence fournissant des conseils sur la manière dont les agences devraient réglementer l'intelligence artificielle 2. Exiger des agences dotées d'une « autorité de réglementation » qu'elles élaborent et publient publiquement un plan (« Plan d'intelligence artificielle de l'agence ») pour « assurer la cohérence » avec les orientations fournies par l'OMB. Le 17 novembre 2020, l'OMB a publié le Mémorandum aux chefs des départements exécutifs et des agences sur les orientations réglementaires pour les applications d'intelligence artificielle (OMB M-21-06), exhortant les agences à adopter une « approche réglementaire pour promouvoir l'innovation et la croissance ». " , générer de la confiance tout en protégeant les valeurs fondamentales de l'Amérique. » Le mémorandum définit 10 principes pour la gestion des applications d'intelligence artificielle afin de guider les approches réglementaires et non réglementaires des agences en matière d'intelligence artificielle, identifie les approches non réglementaires lorsque la réglementation est inappropriée et recommande à diverses agences les mesures prises par institutions à réduire les obstacles au déploiement et à l’utilisation de l’IA. Les agences sont tenues de soumettre leurs plans d'ici mai 2021 (date limite pour se conformer à l'Ordonnance de leadership sur l'intelligence artificielle) et de publier publiquement leurs plans sur les sites Web de leurs agences. Actuellement, sur les 41 agences évaluées, seules 5 (13 %) ont publié des plans d'IA en utilisant le modèle fourni par le mémorandum de réglementation de l'OMB sur l'IA. Ces agences sont les ministères de l'Énergie (DOE), de la Santé et des Services sociaux (HHS) et des Anciens Combattants (VA), ainsi que l'Agence de protection de l'environnement (EPA) et l'Agence des États-Unis pour le développement international (USAID). Les 36 institutions restantes n'ont pas annoncé leurs propres projets d'intelligence artificielle. Le mandat de l'intelligence artificielle au sein du gouvernement est axé sur la promotion du développement, de l'adoption et de l'acquisition d'une intelligence artificielle fiable au sein du gouvernement fédéral. À cette fin, elle exige que les agences « préparent une liste de cas d'utilisation non confidentiels et non sensibles de l'intelligence artificielle » et la partagent avec le Conseil fédéral des directeurs de l'information (Conseil CIO), d'autres agences et le publique. Cependant, divulguer publiquement la liste des cas d'utilisation de l'IA a toujours été un problème. Parmi les 220 institutions identifiées comme potentiellement soumises à cette exigence, 168 institutions ne disposent pas d'un inventaire indépendant des cas d'utilisation de l'IA ou n'incluent pas leurs cas d'utilisation de l'IA dans l'inventaire de leur agence mère. Sur les 78 agences mères examinées, seules 17 ont publié des listes de cas d’utilisation de l’IA. C'est-à-dire que parmi les 220 établissements de niveau supérieur et inférieur, 76 % des établissements n'ont pas publié la liste, et 78 % des établissements n'ont pas publié la liste lors de l'évaluation de niveau supérieur. De plus, parmi les 49 institutions de niveau supérieur et inférieur connues pour avoir des cas d'utilisation de l'intelligence artificielle, 47% des institutions n'ont pas publié de liste de cas d'utilisation de l'intelligence artificielle (23 de niveau supérieur et inférieur établissements de niveau supérieur). Parmi le groupe d’institutions le plus restreint, soit les 23 grandes institutions ayant des cas d’utilisation connus de l’IA au niveau de la société mère, seules 11 ont publié des inventaires de l’IA. Les listes elles-mêmes reflètent les défis rencontrés lors de la mise en œuvre. Premièrement, les agences ne divulguent pas les cas d'utilisation de l'IA, même s'ils ont été publiquement documentés. Deuxièmement, l’incohérence des institutions dans la mise en œuvre des listes de contrôle des cas d’utilisation de l’IA met en évidence trois points clés qui ne sont pas encore clairs. Pour les agences qui n'ont pas publié de liste, il n'est pas clair si elles affirment qu'elles n'utilisent pas l'intelligence artificielle ou si elles ne remplissent tout simplement pas cette exigence. À l'exception de la liste du NIST, toutes les listes publiées sont publiées au niveau de l'agence mère (par exemple, le ministère du Commerce ou le ministère de l'Énergie), et non la liste de la NOAA ou de l'Electric Power Administration). Mais il n'est pas clair si les sous-agences non répertoriées dans la liste n'ont pas de cas d'utilisation pertinents ou si elles ne répondent pas aux exigences de reporting de l'agence mère supposée. La définition de l'intelligence artificielle fournie dans la NDAA de l'exercice 2019 et intégrée dans la directive gouvernementale sur l'intelligence artificielle est probablement assez large, ce qui peut rendre difficile pour les agences d'utiliser l'IA à des fins d'inventaire. Il est plus difficile de s'y conformer lorsqu'une technologie spécifique est classée comme « intelligence artificielle ». Troisièmement, les listes d'agences incluent souvent des initiatives de transparence existantes, mais varient considérablement. Dans l'ensemble, l'auteur estime que les trois piliers de la stratégie américaine en matière d'intelligence artificielle, l'ordre de leadership en matière d'intelligence artificielle, l'ordre gouvernemental en matière d'intelligence artificielle et la loi gouvernementale sur l'intelligence artificielle, ne sont pas idéaux dans le fonctionnement réel. Les exigences actuelles sont considérées par de nombreuses organisations comme des « tâches non financées ». En réponse, le Congrès devrait fournir aux agences les ressources nécessaires pour doter le personnel et développer l’expertise technique nécessaire pour élaborer des plans stratégiques en matière d’IA. Ne pas fournir les ressources appropriées et donner aux cadres supérieurs les moyens de s’acquitter de ces responsabilités sapera probablement le leadership américain en matière d’IA. À propos de l'auteur Christie Lawrence est candidate au JD/MPP à la Stanford Law School et à la Harvard Kennedy School, et membre du laboratoire de réglementation, d'évaluation et de gouvernance de Stanford (RegLab). Elle a été directrice de la recherche et de l'analyse au Conseil national de sécurité sur l'intelligence artificielle (NSCAI) et a travaillé à l'Institut pour l'intelligence artificielle centrée sur l'humain de Stanford, au Cyber Program du Belfer Center de Harvard, au Département d'État et en tant que consultant en gestion. Elle est titulaire d'un baccalauréat en politiques publiques de l'Université Duke. Isaac Cui est étudiant en première année de doctorat à la Stanford Law School, membre du RegLab et Knight-Hennessy Scholar à l'Université de Stanford. Il est titulaire d'un baccalauréat en physique et en sciences politiques du Pomona College, ainsi que d'une maîtrise en sciences appliquées des données sociales et d'une maîtrise en réglementation de la London School of Economics and Political Science, où il était boursier Marshall. Daniel E. Ho est professeur de droit William Benjamin Scott et Luna M. Scott et professeur de sciences politiques à l'Université de Stanford, et chercheur principal au Stanford Economic Policy Institute. Il est membre désigné du National Artificial Intelligence Advisory Council (NAIAC), directeur associé de l'Institut pour l'intelligence artificielle centrée sur l'humain (HAI) de l'Université de Stanford, membre du corps professoral du Center for Advanced Study in the Behavioral Sciences et directeur. du Laboratoire de Supervision. Il est titulaire d'un doctorat en droit de la Yale Law School et d'un doctorat de l'Université Harvard.

2. Mise en œuvre globale

3. Plans d'IA de l'agence

IV. Liste des cas d'utilisation de l'IA

5. Résumé

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI