Maison >Périphériques technologiques >IA >Les outils d'IA deviennent-ils une denrée prisée par les cybercriminels ? Une étude révèle que les pirates russes contournent les restrictions d'OpenAI pour accéder à ChatGPT

Les outils d'IA deviennent-ils une denrée prisée par les cybercriminels ? Une étude révèle que les pirates russes contournent les restrictions d'OpenAI pour accéder à ChatGPT

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-12 13:19:051216parcourir

Selon les médias du secteur, OpenAI a restreint l'application de ChatGPT, un puissant chatbot, dans certains pays et régions, en raison de craintes qu'il puisse être utilisé à des fins criminelles. Cependant, l'étude a révélé que certains cybercriminels russes ont tenté de trouver de nouveaux moyens de contourner les restrictions existantes afin d'adopter ChatGPT, et ont découvert des cas tels que le contournement des restrictions relatives à l'IP, aux cartes de paiement et aux numéros de téléphone.

Des chercheurs ont trouvé sur un forum de hackers des preuves selon lesquelles des pirates russes tentaient de contourner les restrictions pour accéder à ChatGPT

Depuis son lancement en novembre 2022, ChatGPT est devenu un outil de flux de travail important pour les développeurs, les écrivains et les étudiants, mais il est également devenu une arme puissante qui peut être exploitée par les cybercriminels, il est prouvé que les pirates l'utilisent pour écrire du code malveillant et améliorer les e-mails de phishing.

ChatGPT peut être utilisé à des fins malveillantes, ce qui signifie qu'OpenAI doit limiter la manière dont l'outil est déployé, car les pirates utilisant ChatGPT peuvent mener des attaques malveillantes plus rapidement. OpenAI utilise des mesures de blocage de géolocalisation pour empêcher les utilisateurs russes d'accéder au système.

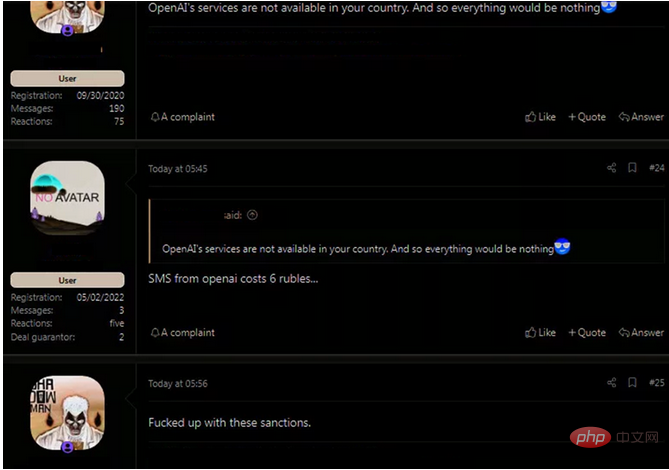

Cependant, les chercheurs de Check Point Software ont découvert plusieurs cas de pirates informatiques russes discutant sur des forums de piratage clandestins de la manière de contourner ces restrictions. Par exemple, un groupe de hackers russes a posé une question sur le forum : s'ils ne peuvent pas accéder normalement à ChatGPT, comment peuvent-ils utiliser une carte de paiement volée pour payer un compte OpenAI et utiliser l'API pour accéder au système ? Le système est actuellement en version préliminaire gratuite, tandis que l'API inclut la génération de texte et de code à l'aide de jetons pour le paiement pendant les sessions.

Sergey Shykevich, responsable du département de renseignement sur les menaces de Check Point, a déclaré que contourner les restrictions d'OpenAI n'est pas particulièrement difficile : « Nous voyons maintenant certains pirates en Russie discuter et examiner comment contourner les barrières géographiques et utiliser ChatGPT à des fins malveillantes. Nous pensons que ces pirates tentent probablement de tester et d'adopter ChatGPT dans leurs activités cybercriminelles. Les cybercriminels s'intéressent de plus en plus à ChatGPT car la technologie d'intelligence artificielle qui la sous-tend peut rendre leurs cyberattaques plus efficaces »

Ces forums de piratage clandestins fournissent également des informations russes. des didacticiels linguistiques sur les services de messagerie texte en ligne semi-légitimes et comment les utiliser pour s'inscrire à ChatGPT, donnant l'impression que ChatGPT est utilisé dans d'autres pays qui ne sont pas bloqués.

Les hackers apprennent sur ces forums qu'il leur suffit de payer 2 centimes pour un numéro virtuel et d'utiliser ensuite ce numéro pour obtenir des codes d'OpenAI. Ces numéros de téléphone temporaires peuvent provenir de n'importe où dans le monde et de nouveaux numéros peuvent être générés selon les besoins.

Utilisation malveillante d'Infostealer et de ChatGPT

Des enquêtes antérieures ont révélé des exemples de cybercriminels publiant sur ces forums de piratage comment exploiter ChatGPT pour des activités illégales. Cela inclut la création d’un Infostealer très simple. À mesure que les outils d’intelligence artificielle seront de plus en plus utilisés, ces infostealers deviendront plus avancés.

Infostealer est un exemple de l'adoption de ces « outils simples » et est apparu sur un forum de hackers dans un article intitulé « ChatGPT – Les avantages des logiciels malveillants ». L'auteur du message note que les pirates peuvent utiliser ChatGPT pour recréer le malware en alimentant des descriptions et des rapports dans un outil d'intelligence artificielle, puis partager du code de vol basé sur Python qui recherche les types de fichiers courants, les copie dans des dossiers de fichiers aléatoires et les télécharge. vers un serveur FTP codé en dur.

Shykevitch a dit. "Les cybercriminels ont trouvé ChatGPT attrayant. Ces dernières semaines, nous avons découvert des preuves que les pirates ont commencé à utiliser ChatGPT pour écrire du code malveillant. ChatGPT a le potentiel de fournir un bon point de départ aux pirates et d'accélérer la progression des cyberattaques. Comme ChatGPT peut être utilisé Tout comme il aide les développeurs à écrire du code, il peut également être utilisé à des fins malveillantes »

OpenAI a déclaré avoir pris des mesures pour limiter l'utilisation de ChatGPT, notamment en limitant les types de requêtes qui peuvent être faites, mais certaines requêtes peuvent être utilisées. être manqué. Il existe également des preuves que ses astuces sont utilisées pour « usurper » ChatGPT, en fournissant des exemples de code potentiellement dangereux sous couvert de recherche ou comme exemples fictifs.

ChatGPT et désinformation potentielle

Pendant ce temps, OpenAI travaille avec le Centre pour la sécurité et les technologies émergentes de l'Université de Georgetown et l'Observatoire Internet de Stanford pour étudier comment de grands modèles de langage (tels que GPT-3, la base de ChatGPT) pourraient être utilisé Moyens de diffuser de fausses informations.

Ce modèle peut être utilisé pour réduire le coût d'exploitation des opérations d'influence, en les gardant sous le contrôle de nouveaux types de cybercriminels, alors qu'auparavant seuls les grands acteurs avaient accès à ce type de contenu. De même, les recruteurs capables d’automatiser la production de textes peuvent bénéficier de nouveaux avantages concurrentiels.

L'utilisation de ChatGPT par les pirates peut également conduire à des comportements différents, augmenter l'ampleur des cyberattaques et permettre la création de contenu plus personnalisé et ciblé par rapport à la création manuelle. En fin de compte, ils ont constaté que les outils de génération de texte étaient capables de générer des messages plus percutants et plus convaincants, par rapport à la plupart des documents de propagande générés par l'homme, que les pirates informatiques pouvaient ne pas avoir la connaissance requise de la langue ou de la culture de leurs cibles.

Les chercheurs d'OpenAI déclarent : « Notre jugement fondamental est que les modèles de langage sont utiles pour les évangélistes de marque et peuvent transformer les opérations d'influence en ligne. Même les modèles les plus avancés sont cryptés ou via des interfaces de programmation d'applications (API), les défenseurs peuvent également être tentés de le faire. adopter des alternatives open source. »

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI