Maison >Périphériques technologiques >IA >Le taux de victoire contre les humains est de 84 %. DeepMind AI atteint pour la première fois le niveau des experts humains aux échecs occidentaux.

Le taux de victoire contre les humains est de 84 %. DeepMind AI atteint pour la première fois le niveau des experts humains aux échecs occidentaux.

- PHPzavant

- 2023-04-12 13:10:081271parcourir

DeepMind a réalisé de nouvelles réalisations dans le domaine de l'IA des jeux, cette fois dans les échecs occidentaux.

Dans le domaine des jeux d'IA, les progrès de l'intelligence artificielle sont souvent démontrés à travers les jeux de société. Les jeux de société peuvent mesurer et évaluer la manière dont les humains et les machines développent et exécutent des stratégies dans des environnements contrôlés. Pendant des décennies, la capacité de planifier à l’avance a été la clé du succès de l’IA dans les jeux à information parfaite comme les échecs, les dames, le shogi et le Go, ainsi que dans les jeux à information imparfaite comme le poker et Scotland Yard.

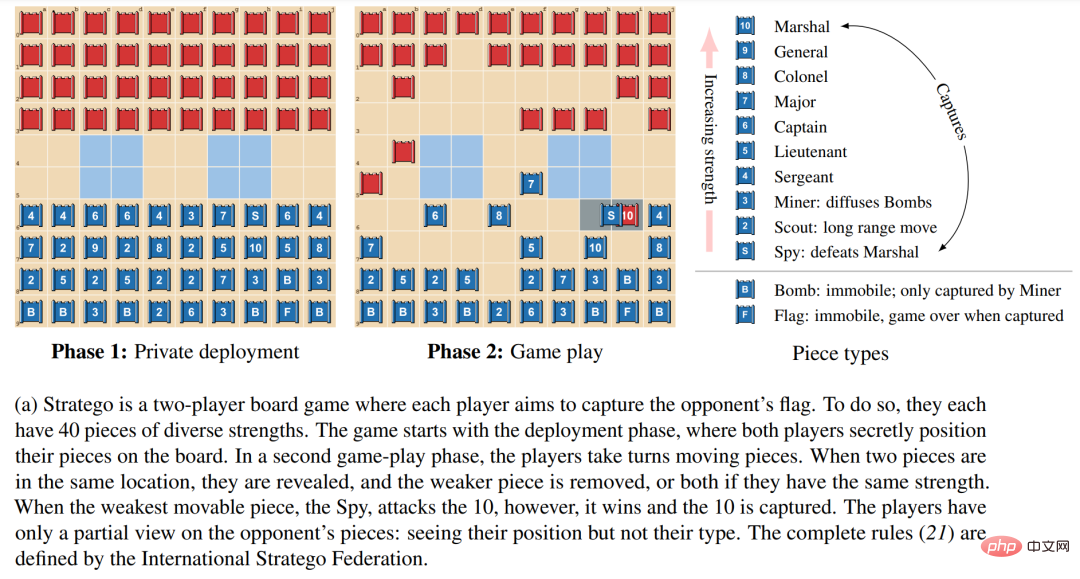

Stratego est devenu l'une des prochaines frontières de la recherche en IA. Une visualisation des étapes et des mécanismes du jeu est présentée ci-dessous en 1a. Le jeu est confronté à deux défis.

Premièrement, l'arbre de jeu de Stratego compte 10 535 états possibles, ce qui est plus que les jeux d'informations imparfaites bien étudiés Texas Hold'em sans restriction (10 164 états possibles) et Go (10 360 états possibles).

Deuxièmement, agir dans un environnement donné dans Stratego nécessite de raisonner sur 1066 déploiements possibles pour chaque joueur en début de partie, alors que le poker ne dispose que de 103 paires de mains possibles. Les jeux d'information parfaite tels que le Go et les échecs n'ont pas de phase de déploiement privée, évitant ainsi la complexité de ce défi dans Stratego.

Actuellement, il n'est pas possible d'utiliser des techniques de planification d'informations parfaites SOTA basées sur des modèles, ni d'utiliser des techniques de recherche d'informations imparfaites qui décomposent le jeu en situations indépendantes.

Pour ces raisons, Stratego fournit une référence difficile pour étudier les interactions politiques à grande échelle. Comme la plupart des jeux de société, Stratego teste notre capacité à prendre des décisions relativement lentes, réfléchies et logiques de manière séquentielle. Et parce que la structure du jeu est très complexe, la communauté de recherche en IA a fait peu de progrès, et l'intelligence artificielle ne peut atteindre que le niveau des joueurs amateurs humains. Par conséquent, développer un agent pour apprendre des stratégies de bout en bout afin de prendre des décisions optimales sous les informations imparfaites de Stratego, en partant de zéro et sans données de démonstration humaine, reste l'un des défis majeurs de la recherche en IA.

Pour ces raisons, Stratego fournit une référence difficile pour étudier les interactions politiques à grande échelle. Comme la plupart des jeux de société, Stratego teste notre capacité à prendre des décisions relativement lentes, réfléchies et logiques de manière séquentielle. Et parce que la structure du jeu est très complexe, la communauté de recherche en IA a fait peu de progrès, et l'intelligence artificielle ne peut atteindre que le niveau des joueurs amateurs humains. Par conséquent, développer un agent pour apprendre des stratégies de bout en bout afin de prendre des décisions optimales sous les informations imparfaites de Stratego, en partant de zéro et sans données de démonstration humaine, reste l'un des défis majeurs de la recherche en IA.

Récemment, dans un dernier article de DeepMind, des chercheurs ont proposé DeepNash, un agent qui apprend le jeu personnel de Stratego sans modèle et sans démonstration humaine. DeepNask a vaincu les précédents agents SOTA AI et a atteint le niveau de joueur humain expert dans la variante la plus complexe du jeu, Stratego Classic.

Adresse papier : https://arxiv.org/pdf/2206.15378.pdf.

Adresse papier : https://arxiv.org/pdf/2206.15378.pdf.

Le cœur de DeepNash est un algorithme d'apprentissage par renforcement structuré et sans modèle, que les chercheurs appellent Regularized Nash Dynamics (R-NaD). DeepNash combine R-NaD avec une architecture de réseau neuronal profond et converge vers un équilibre de Nash, ce qui signifie qu'il apprend à rivaliser grâce à des incitations et qu'il est robuste face aux concurrents qui tentent de l'exploiter.

La figure 1b ci-dessous est un aperçu de haut niveau de la méthode DeepNash. Les chercheurs ont systématiquement comparé ses performances avec celles de différents robots SOTA Stratego et de joueurs humains sur la plateforme de jeu Gravon. Les résultats montrent que DeepNash a vaincu tous les robots SOTA actuels avec un taux de victoire de plus de 97 % et a rivalisé férocement avec les joueurs humains. Il s'est classé parmi les 3 premiers du classement en 2022 et à chaque période, avec un taux de victoire de 84 %.

Les chercheurs ont déclaré que sans déployer aucune méthode de recherche dans l'algorithme d'apprentissage, c'est la première fois qu'un algorithme d'IA peut atteindre le niveau d'experts humains dans un jeu de société complexe. atteint le niveau des experts humains dans le jeu Stratego.

Présentation de la méthode

DeepNash utilise une stratégie d'apprentissage de bout en bout pour exécuter Stratego et placer stratégiquement les pièces sur le plateau au début du jeu (voir Figure 1a). Au cours de la phase de jeu, les chercheurs utilisent une méthode intégrée. méthode RL profonde et game On. L'agent vise à apprendre un équilibre de Nash approximatif grâce au jeu personnel.

Cette recherche utilise des chemins orthogonaux sans recherche et propose une nouvelle méthode qui combine l'apprentissage par renforcement sans modèle dans l'auto-jeu avec l'idée d'un algorithme de théorie des jeux - la combinaison de dynamiques de Nash régularisées (RNaD).

La partie sans modèle signifie que la recherche n'établit pas de modèle d'adversaire explicite pour suivre les états possibles de l'adversaire. La partie théorie des jeux est basée sur l'idée que, sur la base de la méthode d'apprentissage par renforcement, elles guident le comportement d'apprentissage de l'agent. vers le développement de Nash dans une direction équilibrée. Le principal avantage de cette approche compositionnelle est qu’il n’est pas nécessaire de se moquer explicitement de l’État privé et de l’État public. Un défi complexe supplémentaire consiste à combiner cette approche d'apprentissage par renforcement sans modèle avec R-NaD pour permettre aux joueurs d'échecs occidentaux de rivaliser avec des joueurs experts humains, ce qui n'a pas été réalisé jusqu'à présent. Cette méthode DeepNash combinée est présentée dans la figure 1b ci-dessus.

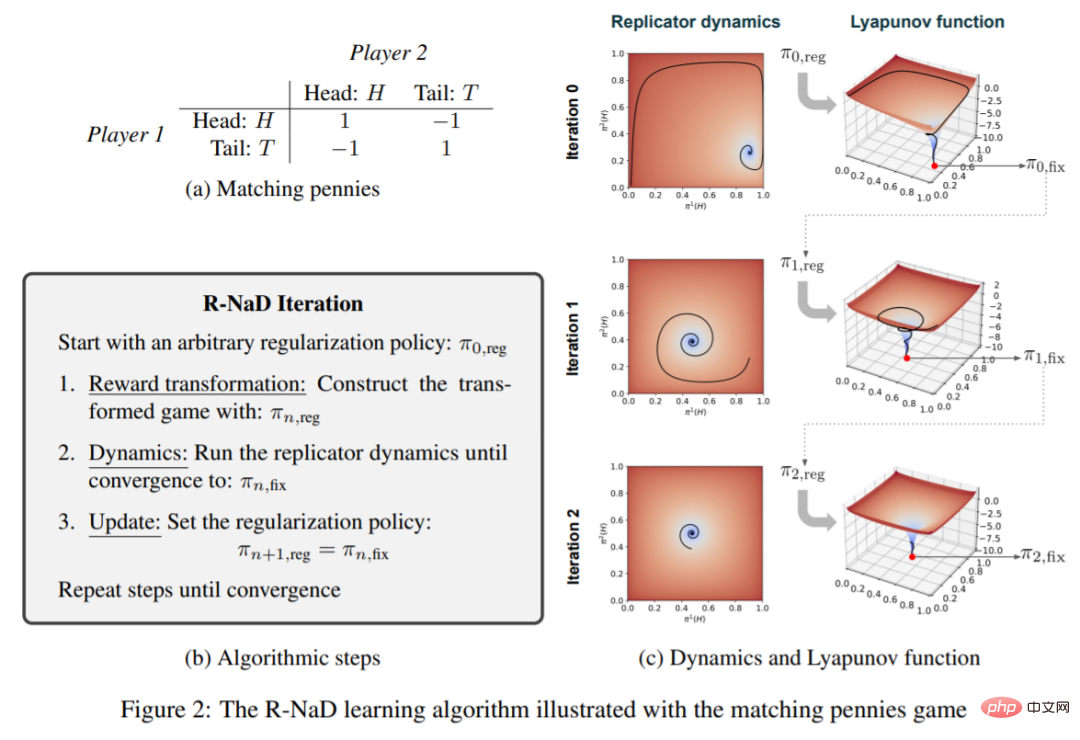

Algorithme de dynamique Nash régularisé

L'algorithme d'apprentissage R-NaD utilisé dans DeepNash est basé sur l'idée de régularisation pour parvenir à la convergence. R-NaD repose sur trois étapes clés, comme le montre la figure 2b ci-dessous :  .

.

DeepNash se compose de trois composants : (1) le composant de formation de base R-NaD ; (2) l'ajustement fin de la stratégie d'apprentissage pour réduire la probabilité résiduelle que le modèle prenne des actions extrêmement improbables, et (3) post- tester le traitement pour filtrer les actions à faible probabilité et corriger les erreurs.

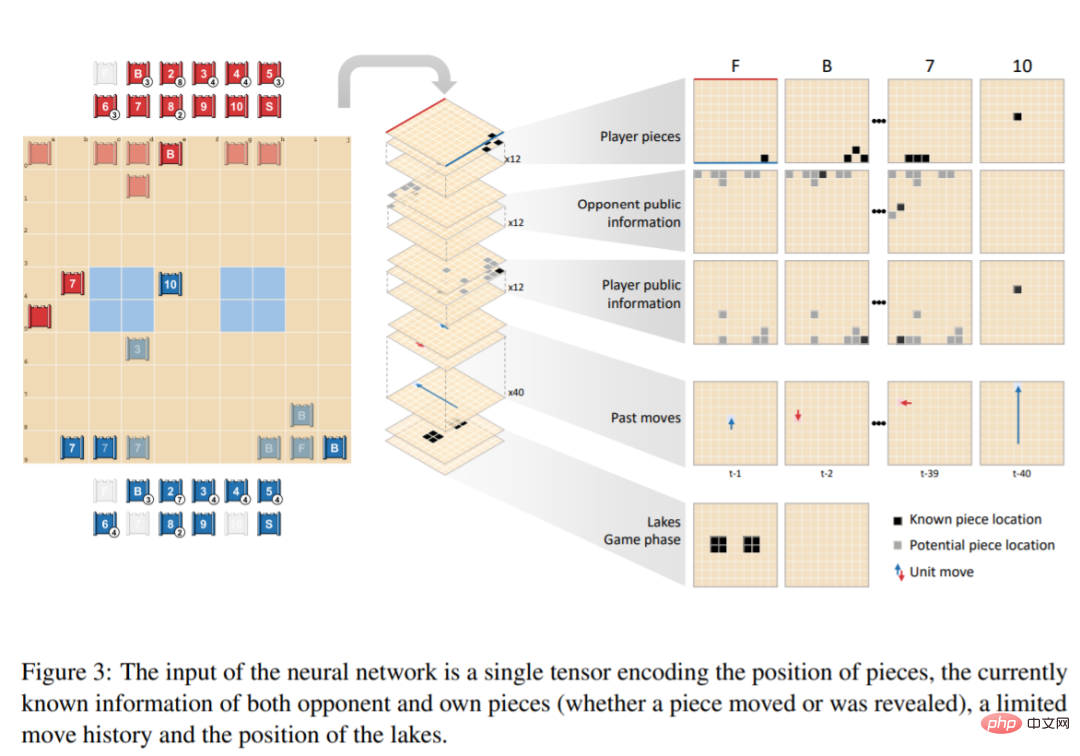

Le réseau DeepNash se compose des composants suivants : une dorsale U-Net avec des blocs résiduels et des connexions sautées, et quatre têtes. La première tête DeepNash génère la fonction de valeur sous forme de scalaire, tandis que les trois têtes restantes codent la politique de l'agent en produisant une distribution de probabilité de ses actions pendant le déploiement et le jeu. La structure de ce tenseur d'observation est présentée dans la figure 3 :

Résultats expérimentaux

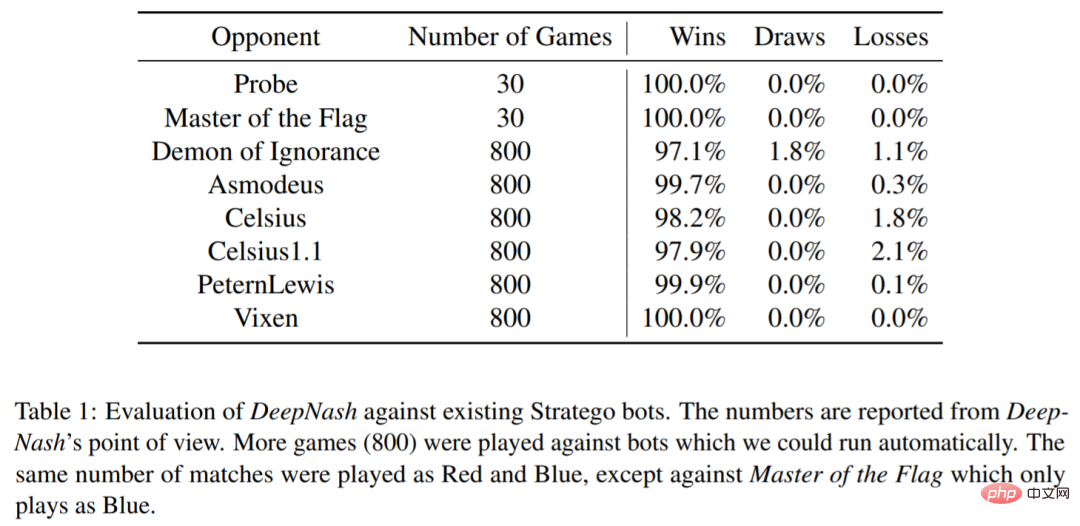

DeepNash a également été évalué par rapport à plusieurs programmes informatiques Stratego existants : Probe au Computer Stratego World Championship, dont trois années Winner (2007 , 2008, 2010) ; Master of the Flag a remporté le championnat en 2009 ; Demon of Ignorance est une implémentation open source de Stratego, Celsius, Celsius1.1, PeternLewis et Vixen ont été lauréats de 2012 dans des universités australiennes. concours, que Petern Lewis a remporté.

Comme le montre le tableau 1, DeepNash a remporté la grande majorité des parties contre tous ces agents, même si DeepNash n'était pas entraîné contre eux et utilisait uniquement le jeu personnel.

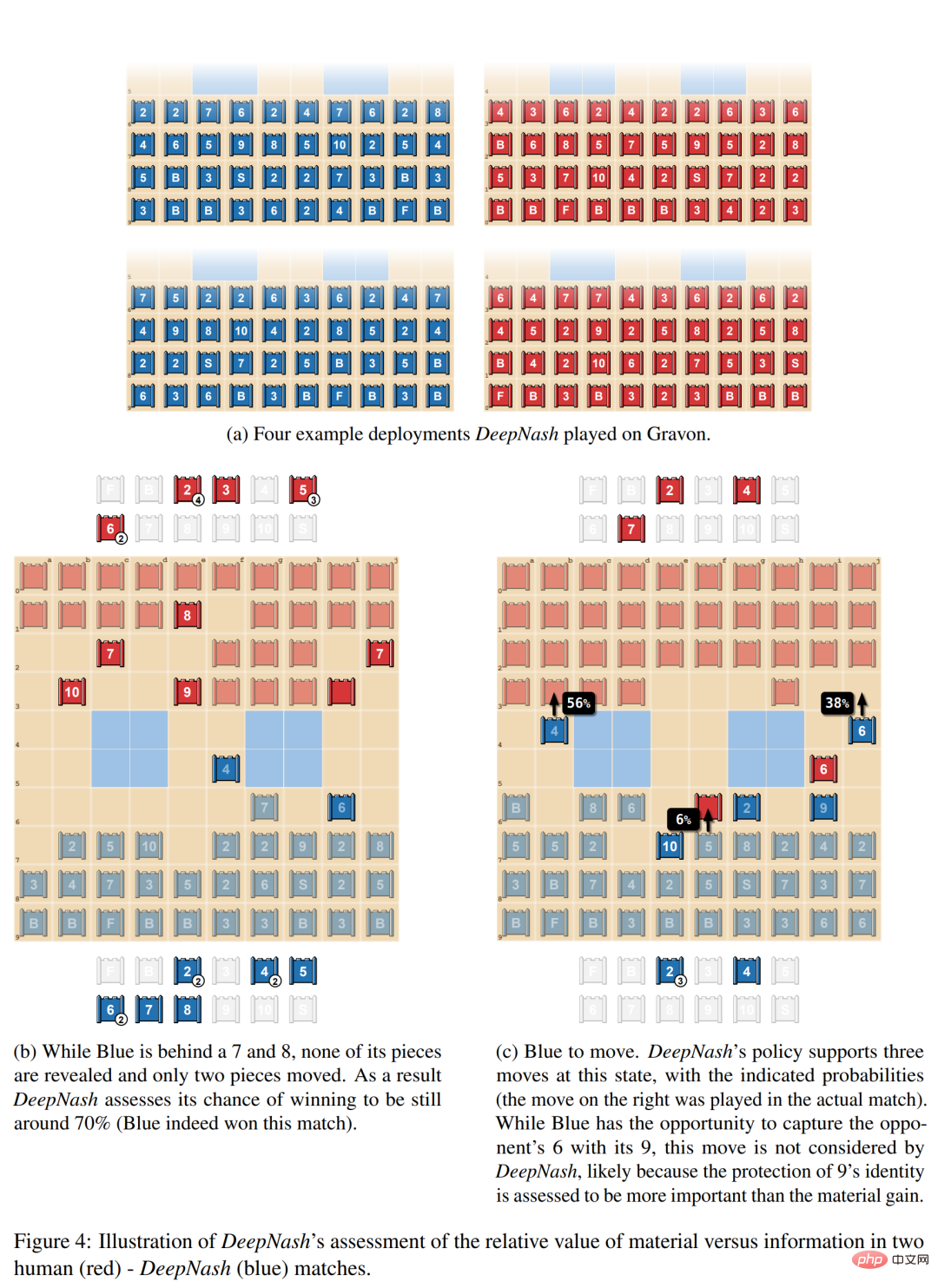

La figure 4a ci-dessous illustre certaines des méthodes de déploiement souvent répétées dans DeepNash ; la figure 4b montre DeepNash (côté bleu) en retard (perdant 7 et 8) mais en tête en situation d'information, car l'adversaire sur le côté rouge a 10, 9, 8 et deux 7. Le deuxième exemple de la figure 4c montre DeepNash ayant la possibilité de capturer le 6 de l'adversaire avec son 9, mais ce mouvement n'a pas été envisagé, peut-être parce que DeepNash pensait que la protection de l'identité du 9 était considérée comme plus importante que le gain matériel.

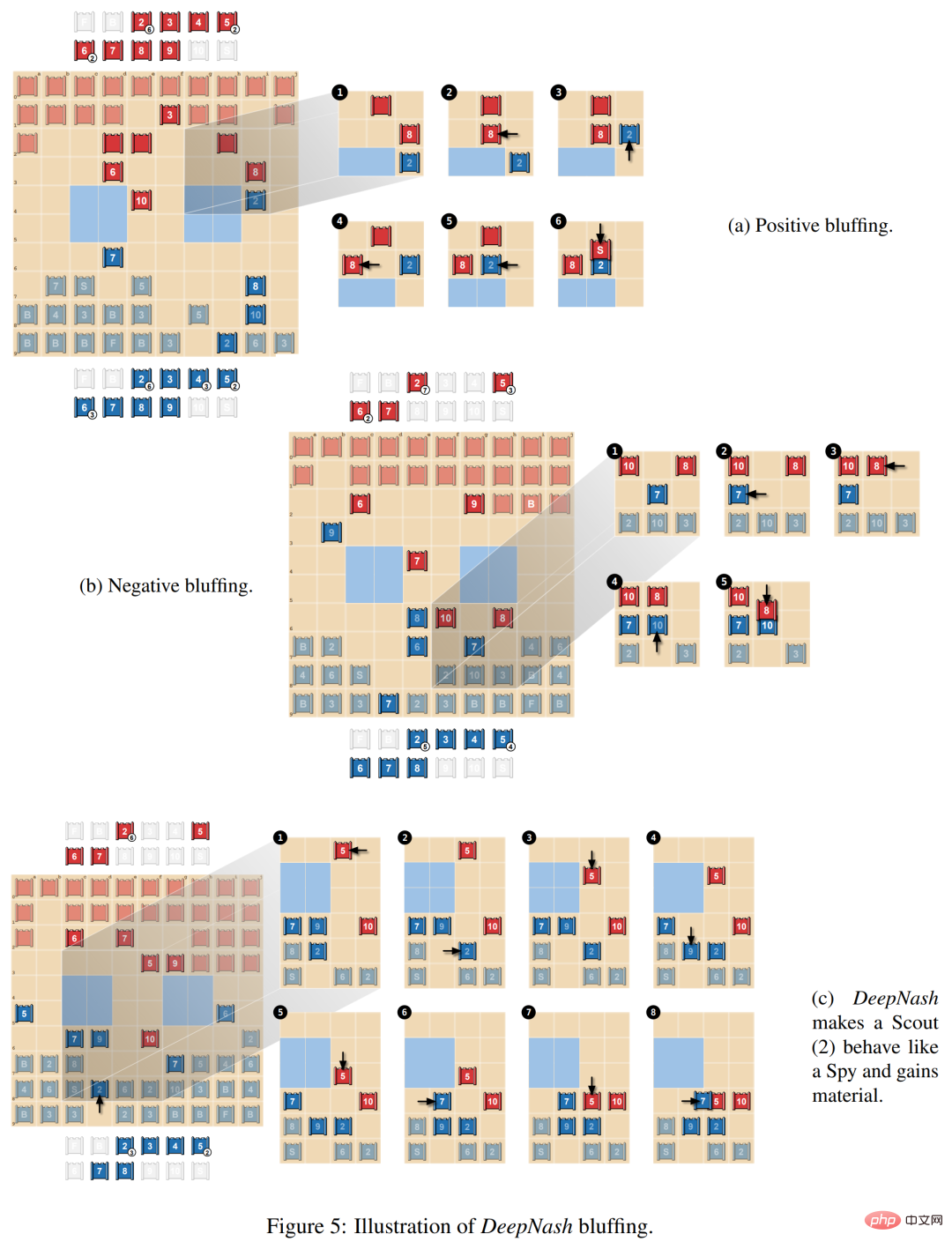

Dans la figure 5a ci-dessous, les chercheurs démontrent un bluff positif, où le joueur prétend que la valeur de la pièce est supérieure à la valeur réelle. DeepNash poursuit le 8 de l'adversaire avec la pièce inconnue Scout (2) et prétend qu'il s'agit d'un 10. L'adversaire pense que la pièce pourrait être un 10 et la guide à côté du Spy (où le 10 peut être capturé). Cependant, afin de capturer cette pièce, le Spy de l'adversaire a perdu face au Scout de DeepNash.

Le deuxième type de bluff est le bluff négatif, comme le montre la figure 5b ci-dessous. C'est l'opposé du bluff actif, où le joueur prétend que la pièce vaut moins qu'elle ne l'est réellement.

La figure 5c ci-dessous montre un bluff plus complexe, où DeepNash place son Scout (2) non divulgué près du 10 de l'adversaire, ce qui pourrait être interprété comme un Spy. Cette stratégie permet en fait à Bleu de capturer le 5 de Rouge avec le 7 quelques coups plus tard, gagnant ainsi du matériel, empêchant le 5 de capturer Scout (2), et révélant qu'il ne s'agit pas réellement d'un Spy.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI