Maison >Périphériques technologiques >IA >Li Xuelong, membre de l'IEEE : L'informatique cognitive multimodale est la clé de la réalisation de l'intelligence artificielle générale

Li Xuelong, membre de l'IEEE : L'informatique cognitive multimodale est la clé de la réalisation de l'intelligence artificielle générale

- 王林avant

- 2023-04-12 09:58:111820parcourir

Dans la recherche actuelle sur l'intelligence artificielle basée sur les données, les informations fournies par les données monomodales ne peuvent plus répondre aux besoins d'amélioration des capacités cognitives des machines. De la même manière que les humains utilisent plusieurs informations sensorielles telles que la vision, l’ouïe, l’odorat et le toucher pour percevoir le monde, les machines doivent également simuler la synesthésie humaine pour améliorer les niveaux cognitifs.

Parallèlement, avec l'explosion des données spatio-temporelles multimodales et l'amélioration de la puissance de calcul, les chercheurs ont proposé un grand nombre de méthodes pour faire face à la diversité croissante des besoins. Cependant, l’informatique cognitive multimodale actuelle se limite encore à imiter les capacités apparentes de l’humain et manque de fondement théorique au niveau cognitif. Face à des tâches intelligentes plus complexes, l’intersection des sciences cognitives et de l’informatique est devenue inévitable.

Récemment, le professeur Li Xuelong de la Northwestern Polytechnical University a publié l'article « Multimodal Cognitive Computing » dans la revue « Science China : Information Science ». Le modèle du processus avance l'idée que « l'informatique cognitive multimodale peut améliorer la capacité d'extraction d'informations de la machine », qui unifie théoriquement diverses tâches de l'informatique cognitive multimodale.

Li Xuelong estime queL'informatique cognitive multimodale est l'une des clés de la réalisation de l'intelligence artificielle générale et a de larges perspectives d'application dans des domaines tels que la « Sécurité Vicinagearth ». Cet article explore le modèle cognitif unifié des humains et des machines et apporte une source d'inspiration pour promouvoir la recherche sur l'informatique cognitive multimodale. Format de la Critation: Xuelong Li, «Multi-modal Cognitive Computing», Scientia Sinica Informationis, doi: 10.1360 / SSI-2022-0226

li Xuelong est professeur à la Northwestern Polytechnical University, se concentrer sur la haute dimension La relation entre l'acquisition intelligente, le traitement et la gestion des données joue un rôle dans les systèmes d'application tels que « Vicinagearth Security ». Il a été élu membre de l'IEEE en 2011 et a été le premier chercheur du continent élu au comité exécutif de l'Association internationale pour l'intelligence artificielle (AAAI).

AI Technology Review a résumé les points clés de l'article « Multimodal Cognitive Computing » et a mené un dialogue approfondi avec le professeur Li Xuelong dans cette direction. 1 comme suit).

Tout d’abord, nous devons comprendre comment les humains extraient les informations sur les événements.

En 1948, Shannon, le fondateur de la théorie de l'information, a proposé le concept d'« entropie de l'information » pour représenter le degré d'incertitude des variables aléatoires. Plus la probabilité d'un événement est faible, plus la quantité d'informations fournies par celui-ci est grande. occurrence. C'est-à-dire que dans une tâche cognitive T donnée, la quantité d'informations apportée par l'occurrence de l'événement L'état est transmis en tant que porteur en supposant que l'espace événementiel

Les humains ont une attention limitée dans une certaine plage spatio-temporelle. (supposé être 1), ainsi, lorsque les événements spatio-temporels passent d'une modalité unique à une multimodalité, les humains n'ont pas besoin d'ajuster constamment leur attention et de la concentrer sur des informations sur des événements inconnus pour obtenir le maximum d'informations :

On peut voir que plus il y a de modalités contenues dans les événements spatio-temporels, plus la quantité d'informations qu'un individu peut obtenir est grande, et le niveau de cognition augmentera également en conséquence.

Donc pour une machine, plus la quantité d’informations qu’elle obtient est grande, plus la machine se rapprochera du niveau cognitif humain ?

La réponse n'est pas la même. Afin de mesurer la capacité cognitive de la machine, Li Xuelong a exprimé le processus par lequel la machine extrayait des informations de l'espace événementiel comme suit, sur la base de la Théorie de la « confiance ». Parmi eux, D est la quantité de données de l'espace d'événements x.

Ainsi, la capacité cognitive d'une machine peut être définie comme la capacité à obtenir le maximum d'informations à partir d'une unité de données. De cette manière, l'apprentissage cognitif des humains et des machines est unifié en un processus. d'améliorer l'utilisation de l'information.

Alors, comment améliorer l’utilisation des données multimodales par la machine et ainsi améliorer les capacités de calcul cognitif multimodal ?

Tout comme l'amélioration de la cognition humaine est indissociable de l'association, du raisonnement, de l'induction et de la déduction du monde réel, si vous souhaitez améliorer la cognition machine, vous devez également partir des trois aspects correspondants : association, génération, collaboration, Ce sont aussi les trois tâches fondamentales de l'analyse multimodale d'aujourd'hui.

2 Trois lignes principales de l'informatique cognitive multimodale

L'association multimodale, la génération intermodale et la collaboration multimodale ont des objectifs différents dans le traitement des données multimodales, mais leurs cœurs sont de utiliser le moins de données possible pour en maximiser la quantité d'informations.

Corrélation multimodale

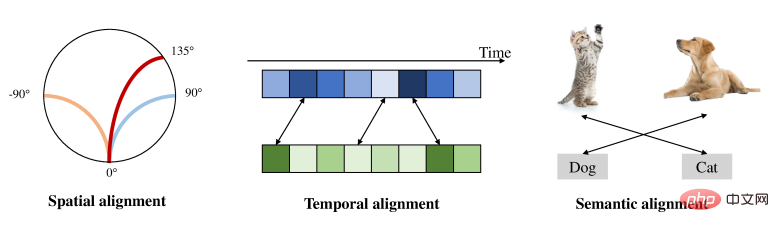

Comment corréler des contenus provenant de différentes modalités aux niveaux spatial, temporel et sémantique ? C'est l'objectif des tâches d'association multimodales et la condition préalable à l'amélioration de l'utilisation de l'information.

L'alignement des informations multimodales aux niveaux spatial, temporel et sémantique est la base de la perception multimodale. La récupération multimodale est l'application de la perception dans la vie réelle. , nous pouvons saisir des phrases de vocabulaire pour récupérer des clips vidéo.

Légende : Diagramme d'alignement multimodal

Inspirés par le mécanisme de perception intersensorielle humaine, les chercheurs en IA ont utilisé des modèles calculables pour la lecture labiale et les modalités manquantes en mode multimodal tâches de perception telles que la génération,facilite également la perception intermodale des groupes handicapés. À l'avenir, les principaux scénarios d'application de la perception intermodale ne se limiteront plus aux applications de remplacement de la perception pour les personnes handicapées, mais seront davantage intégrés à la perception intersensorielle humaine pour améliorer le niveau de perception multisensorielle humaine.

De nos jours, le contenu modal numérique se développe rapidement et les exigences d'application pour la récupération multimodale deviennent de plus en plus abondantes. Cela présente sans aucun doute de nouvelles opportunités et de nouveaux défis pour l'apprentissage associatif multimodal.

Génération intermodale

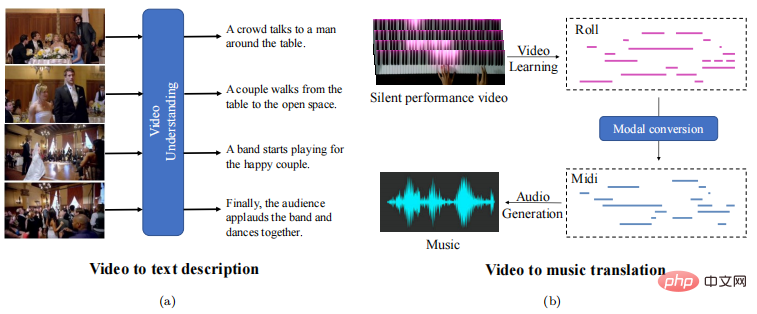

Lorsque nous lisons l'intrigue d'un roman, l'image correspondante apparaîtra naturellement dans notre esprit. C'est le reflet du raisonnement intermodal humain et des capacités de génération.De même, en informatique cognitive multimodale, le but de la tâche de génération intermodale est de donner à la machine la capacité de générer des entités de modalités inconnues. Du point de vue de la théorie de l'information, l'essence de cette tâche est d'améliorer les capacités cognitives des machines au sein des canaux d'information multimodaux. Il existe deux manières : l'une consiste à augmenter la quantité d'informations, c'est-à-dire la synthèse intermodale, et l'autre. est de

Réduire la quantité de données, c'est-à-dire la conversion intermodale. La tâche de la synthèse intermodale est d'enrichir les informations existantes lors de la génération de nouvelles entités modales, augmentant ainsi la quantité d'informations. En prenant comme exemple la génération d'images basée sur du texte, au début, l'association d'entités était principalement utilisée, qui s'appuyait souvent largement sur des bibliothèques de récupération. Aujourd’hui, la technologie de génération d’images repose principalement sur des réseaux adverses génératifs, capables de générer des images réalistes et de haute qualité. Cependant, la génération d’images faciales reste très difficile, car au niveau de l’information, même de petits changements d’expression peuvent véhiculer une très grande quantité d’informations. Dans le même temps, convertir des modalités complexes en modalités simples et trouver des expressions plus concises peut réduire la quantité de données et améliorer les capacités d'acquisition d'informations. Légende : Tâches courantes de conversion intermodale En tant que modèle de combinaison de la vision par ordinateur et des technologies de traitement du langage naturel, la conversion intermodale peut considérablement améliorer l'efficacité de la récupération en ligne. Par exemple, donnez une brève description en langage naturel d'une longue vidéo ou générez des signaux audio liés à une information vidéo. Les deux modèles génératifs traditionnels actuels, VAE (variational autoencoder) et GAN (generative adversarial network), ont chacun leurs propres forces et faiblesses. Li Xuelong estime que le VAE repose sur des hypothèses, tandis que le GAN a une mauvaise interprétabilité, et les deux. doivent être combinés raisonnablement. Un point particulièrement important est que le défi des tâches de génération multimodale réside non seulement dans la qualité de la génération, mais également dans les écarts sémantiques et de représentation entre les différentes modalités. Il faut résoudre le raisonnement sur les connaissances sous la prémisse des écarts sémantiques. dans le futur. Collaboration multimodale Dans le mécanisme cognitif humain, l'induction et la déduction jouent un rôle important. Nous pouvons comprendre ce que nous voyons, entendons, sentons, touchons, etc. Utilisez une perception de pointe. effectuer l'induction, la fusion et la déduction conjointe comme base de prise de décision. De même, l'informatique cognitive multimodale nécessite également la coordination de deux ou plusieurs données modales, la coopération entre elles pour effectuer des tâches multimodales plus complexes et l'amélioration des capacités de précision et de généralisation. Du point de vue de la théorie de l'information, son essence est la fusion mutuelle d'informations multimodales pour atteindre l'objectif de complémentation de l'information, et c'est l'optimisation de l'attention. Tout d'abord, la fusion modale consiste à résoudre les problèmes de différences de données multimodales causées par le format des données, l'alignement spatio-temporel, les interférences sonores, etc. À l'heure actuelle, les méthodes de fusion des règles aléatoires comprennent la fusion en série, la fusion parallèle et la fusion pondérée, et les méthodes de fusion basées sur l'apprentissage incluent le modèle du mécanisme d'attention, l'apprentissage par transfert et la distillation des connaissances. Deuxièmement, une fois la fusion des informations multimodales terminée, un apprentissage conjoint des informations modales est nécessaire pour aider le modèle à explorer la relation entre les données modales et à établir des connexions auxiliaires ou complémentaires entre les modes. Grâce à l'apprentissage conjoint, d'une part, il peut améliorer les performances modales, telles que le guidage visuel audio, le guidage audio, la vision en profondeur et d'autres applications, d'autre part, il peut résoudre des tâches difficiles à réaliser ; réaliser dans des modalités uniques dans le passé, telles que l'informatique des émotions complexes, la modélisation du visage par correspondance audio, la génération de musique guidée audiovisuelle, etc. sont autant d'orientations de développement de l'informatique cognitive multimodale à l'avenir. Ces dernières années, la technologie d'apprentissage profond a grandement favorisé le développement théorique et technique de l'informatique cognitive multimodale. Mais aujourd’hui, les exigences des applications se diversifient et la vitesse d’itération des données s’accélère, ce qui pose de nouveaux défis et de nombreuses opportunités pour l’informatique cognitive multimodale. Nous pouvons envisager quatre niveaux d'amélioration des capacités cognitives des machines : Au niveau des données, la recherche multimodale traditionnelle sépare la collecte de données et le calcul en deux processus indépendants. Cette méthode présente des inconvénients. Le monde humain est composé de signaux analogiques continus, tandis que les machines traitent des signaux numériques discrets, et le processus de conversion entraînera inévitablement une distorsion et une perte d'informations. À cet égard, Li Xuelong estime que « l'optoélectronique intelligente » représentée par les réseaux de neurones optiques peut apporter des solutions si l'intégration de la détection et du calcul des données multimodales peut être complétée, l'efficacité du traitement de l'information et le niveau d'intelligence de la machine le seront. être grandement amélioré. le traitement de la sémantique de haut niveau dans l'information, comme la relation de position dans la vision, le style des images, l'émotion de la musique, etc. Actuellement, les tâches multimodales se limitent à de simples cibles et interactions dans des scénarios, et ne peuvent pas comprendre une sémantique logique profonde ou une sémantique subjective. Par exemple, une machine peut générer l’image d’une fleur qui s’épanouit dans une prairie, mais elle ne peut pas comprendre le bon sens selon lequel les fleurs se fanent en hiver. Au niveau du mécanisme de fusion, comment effectuer une optimisation de haute qualité de modèles multimodaux composés de composants hétérogènes est actuellement une difficulté. La plupart des calculs cognitifs multimodaux actuels optimisent le modèle dans le cadre d'un objectif d'apprentissage unifié. Cette stratégie d'optimisation manque d'ajustements ciblés sur les composants hétérogènes du modèle, ce qui entraîne de gros problèmes dans les modèles multimodaux existants. être abordé sous de multiples aspects tels que l’apprentissage automatique multimodal et les méthodes théoriques d’optimisation. Au niveau de la tâche, la méthode d'apprentissage cognitif de la machine varie en fonction de la tâche. Nous devons concevoir une stratégie d'apprentissage pour le retour d'information sur les tâches afin d'améliorer la capacité à résoudre une variété de tâches connexes. De plus, compte tenu des lacunes de la méthode actuelle d'apprentissage « de type spectateur » de l'apprentissage automatique pour comprendre le monde à partir d'images, de textes et d'autres données, nous pouvons apprendre des résultats de recherche en sciences cognitives, tels que IA incarnée C'est une solution potentielle : les agents intelligents doivent interagir de manière multimodale avec l'environnement afin d'évoluer continuellement et de former la capacité de résoudre des tâches complexes. Revue de la technologie IA : Dans la recherche sur l'intelligence artificielle, pourquoi devrions-nous prêter attention aux données multimodales et à l'informatique cognitive multimodale ? Quels avantages et obstacles la croissance des données multimodales apporte-t-elle aux performances des modèles ? Li Xuelong :Merci pour votre question. La raison pour laquelle nous prêtons attention et étudions les données multimodales est que l'intelligence artificielle dépend essentiellement des données. Les informations que les données monomodales peuvent fournir sont toujours très limitées, tandis que les données multimodales peuvent fournir de multiples perspectives hiérarchiques et multimodales. d'autre part, le monde physique objectif étant multimodal, la recherche de nombreux problèmes pratiques ne peut être séparée des données multimodales, comme la recherche d'images par texte, l'identification d'objets en écoutant de la musique, etc. Les informations multimodales complexes et entrelacées apporteront également beaucoup de bruit et de redondance, ce qui augmentera la pression d'apprentissage du modèle, rendant les performances des données multimodales pires que celles d'une seule modalité dans certains cas, ce qui pose un problème de conception et d'optimisation de modèles présente de plus grands défis.

Revue de la technologie IA : Du point de vue de la théorie de l'information, quelles sont les similitudes entre l'apprentissage cognitif humain et l'apprentissage cognitif automatique ? Quelle importance directrice la recherche sur les mécanismes cognitifs humains a-t-elle pour l’informatique cognitive multimodale ? À quelles difficultés l’informatique cognitive multimodale sera-t-elle confrontée sans comprendre la cognition humaine ? Li Xuelong : Aristote croit que la compréhension des choses par les gens commence par le ressenti, tandis que Platon croit que ce qui s'obtient par le ressenti ne peut pas être appelé connaissance. Les humains transmettent des informations multimodales au cerveau via de multiples canaux sensoriels tels que la vue, l'ouïe, l'odorat, le goût, le toucher, etc., produisant une stimulation articulaire du cortex cérébral. La recherche en psychologie a montré que l'action combinée de plusieurs sens peut produire des modèles d'apprentissage cognitif tels que « l'intégration multisensorielle », la « synesthésie », la « réorganisation perceptuelle » et la « mémoire perceptuelle ». Ces mécanismes cognitifs humains sont multimodaux. l'inspiration, comme la dérivation de tâches d'analyse multimodale typiques telles que la collaboration multimodale, l'association multimodale et la génération intermodale, a également donné naissance au partage local, à la mémoire à long et à court terme, aux mécanismes d'attention et à d'autres mécanismes d'analyse automatique typiques. À l’heure actuelle, le mécanisme cognitif humain n’est pas clair. Manque de conseils de la recherche cognitive humaine, l'informatique cognitive multimodale tombera dans le piège de l'ajustement des données. Nous sommes également incapables de juger si le modèle a acquis les connaissances dont les humains ont besoin. C'est également un point controversé en intelligence artificielle. . Commentaire sur la technologie IA : Votre point de vue selon lequel « l'informatique cognitive multimodale peut améliorer les capacités d'extraction d'informations de la machine » du point de vue de la théorie de l'information est étayé par des preuves dans des tâches informatiques cognitives multimodales spécifiques ? Li Xuelong :On peut répondre à cette question sous deux aspects. Premièrement, les informations multimodales peuvent améliorer les performances d’une seule modalité dans différentes tâches. De nombreux travaux ont permis de vérifier que lors de l'ajout d'informations sonores, les performances des algorithmes de vision par ordinateur seront considérablement améliorées, telles que la reconnaissance de cibles, la compréhension de scènes, etc. Nous avons également construit une caméra environnementale et avons constaté qu'en fusionnant les informations multimodales provenant de capteurs tels que la température et l'humidité, la qualité d'image de la caméra peut être améliorée. Deuxièmement, la modélisation conjointe de l'information multimodale offre la possibilité de réaliser des tâches intelligentes plus complexes. Par exemple, nous avons réalisé des travaux sur « Écouter l'image » pour encoder des informations visuelles en son, permettant aux personnes aveugles de « Voir ». " La scène devant vous prouve également que l'informatique cognitive multimodale aide les machines à extraire plus d'informations. Revue de la technologie IA : Dans les tâches d'association multimodale, quelle est l'interconnexion entre l'alignement, la perception et la récupération ? Li Xuelong :La nature de la relation entre ces trois C'est relativement compliqué. Dans cet article, je ne donne que quelques avis préliminaires. Le principe de la corrélation de différentes informations modales est qu'elles décrivent conjointement une existence objective identique/similaire. Cependant, cette corrélation est difficile à déterminer lorsque les informations externes sont compliquées ou interférées. Cela nécessite d'abord d'aligner les différentes informations pour déterminer les différentes informations modales. correspondance associée. Ensuite, sur la base de l’alignement, la perception d’une modalité à une autre est obtenue. C'est comme si lorsque nous ne voyons que les mouvements des lèvres d'une personne, nous pouvons sembler entendre ce qu'elle dit. Ce phénomène repose également sur la corrélation et l'alignement d'éléments visuels (Viséme) et de phonèmes (Phoneme). Dans la vie réelle, nous avons également appliqué cette perception multimodale à des applications telles que la récupération, la récupération d'images ou de contenu vidéo de produits via du texte et la réalisation d'applications de corrélation multimodale calculables. AI Technology Review : Le DALL-E et d'autres modèles récemment très populaires sont un exemple de tâches de génération multimodale. Ils fonctionnent bien dans les tâches d'image de génération de texte, mais leurs images générées sont sémantiquement pertinentes et interprétables. et ainsi de suite ont encore de grandes limites. Comment pensez-vous que ce problème devrait être résolu ? Quelle est la difficulté ? Li Xuelong : Générer des images à partir d'un texte est une tâche « d'imagination » Les gens voient ou entendent une phrase, comprennent les informations sémantiques qu'elle contient, puis s'appuient sur la mémoire cérébrale pour imaginer la scène la plus appropriée à générer. " Sens de l'image ». Actuellement, DALL-E en est encore au stade de l'utilisation de l'apprentissage statistique pour l'ajustement des données afin de résumer et de résumer des ensembles de données à grande échelle, ce pour quoi l'apprentissage en profondeur est actuellement le meilleur. Cependant, si vous voulez vraiment apprendre « l’imagination » des gens, vous devez également considérer le modèle cognitif humain pour atteindre un « niveau élevé » d’intelligence. Cela nécessite l’intégration croisée des neurosciences, de la psychologie et des sciences de l’information, ce qui constitue à la fois un défi et une opportunité. Ces dernières années, de nombreuses équipes ont également réalisé un travail de premier ordre dans ce domaine. Grâce à l'intégration croisée de plusieurs disciplines, l'exploration de la théorie de la calculabilité des modèles cognitifs humains est également l'une des orientations des efforts de notre équipe. Nous pensons que cela apportera également de nouvelles avancées dans le domaine de l'intelligence de « haut niveau ». AI Technology Review : Comment vous inspirez-vous des sciences cognitives dans vos travaux de recherche ? Quelles recherches en sciences cognitives vous intéressent particulièrement ? Li Xuelong : Demandez-lui à quel point c'est clair ? Venez chercher l’eau vive d’une source. J'observe et réfléchis souvent à certains phénomènes intéressants de ma vie quotidienne. Il y a vingt ans, j'ai parcouru une page Web avec des photos de paysages de Jiangnan Lorsque j'ai cliqué sur la musique sur la page Web, j'ai soudainement eu l'impression d'y être. À ce moment-là, j'ai commencé à comprendre Pensez à la relation entre l'audition. et la vision d'un point de vue. Au cours de mes études en sciences cognitives, j'ai découvert le phénomène de la « synesthésie ». Combiné avec ma propre direction de recherche scientifique, j'ai complété un article intitulé « Musique visuelle et vision musicale », qui était aussi le premier. la synesthésie" a été introduite dans le domaine de l'information. Plus tard, j'ai ouvert le premier cours d'informatique cognitive dans le domaine de l'information, et j'ai également créé le comité technique sur l'informatique cognitive de l'IEEE SMC pour tenter de briser les frontières entre les sciences cognitives et l'informatique. une Définition, qui est la description actuelle sur la page d'accueil du comité technique. En 2002, j'ai proposé la capacité de fournir des informations par unité de quantité de données, qui est le concept de « Capacité d'information », et j'ai essayé de mesurer la capacité cognitive des machines. J'ai l'honneur de la présenter en 2020 sous le titre de « Multi ». -modal" "Cognitive Computing" a remporté le Tencent Scientific Exploration Award. Jusqu'à présent, j'ai continué à prêter attention aux derniers développements en matière de synesthésie et de perception. Dans la nature, il existe de nombreux modes au-delà des cinq sens humains, et il existe même des modes potentiels qui ne sont pas encore clairs. Par exemple, l'intrication quantique peut montrer que l'espace tridimensionnel dans lequel nous vivons n'est qu'une projection d'un espace tridimensionnel. espace. Si tel est effectivement le cas, alors nos méthodes de détection sont également limitées. Peut-être que ces modes potentiels pourraient être exploités pour permettre aux machines de se rapprocher, voire de dépasser la perception humaine. Commentaire sur la technologie IA : Sur la question de savoir comment mieux intégrer la cognition humaine et l'intelligence artificielle, vous avez proposé de construire un réseau d'interaction modal avec "Méta-Modal" comme noyau. Pouvez-vous présenter ce point de. voir? Quelle est sa base théorique ? Li Xuelong : La métamodalité elle-même est un concept provenant du domaine des neurosciences cognitives. Elle fait référence au cerveau ayant un tel type d'organisation qui répond aux informations saisies lors de l'exécution d'une certaine fonction ou opération de représentation. des hypothèses spécifiques sont faites sur les catégories sensorielles, mais elles peuvent toujours avoir de bonnes performances d'exécution. La métamodalité n'est pas un concept fantaisiste. C'est essentiellement l'hypothèse et la conjecture des scientifiques cognitifs intégrant des phénomènes et des mécanismes tels que la perception intermodale et la plasticité neuronale. Cela nous incite également à construire des architectures et des méthodes d'apprentissage efficaces entre différentes modalités afin d'obtenir des capacités de représentation modale plus généralisées. AI Technology Review : Quelles sont les principales applications de l’informatique cognitive multimodale dans le monde réel ? Donnez des exemples. Li Xuelong :L'informatique cognitive multimodale est une recherche très proche des applications pratiques. Notre équipe a déjà travaillé sur la perception intermodale, qui code les informations visuelles en signaux sonores et stimule le cortex visuel primaire du cortex cérébral. Elle a été appliquée pour aider les personnes handicapées à voir le monde extérieur. Dans la vie quotidienne, nous utilisons souvent la technologie informatique cognitive multimodale. Par exemple, les plateformes de vidéos courtes combinent des balises vocales, d’images et de texte pour recommander des vidéos susceptibles d’intéresser les utilisateurs. Plus largement, l'informatique cognitive multimodale est également largement utilisée dans la sécurité sur site mentionnée dans l'article, comme la recherche et le sauvetage intelligents, les drones et robots au sol collectant des sons, des images, la température, l'humidité, etc. Besoins en données être intégré et analysé d'un point de vue cognitif, et différentes stratégies de recherche et de sauvetage peuvent être mises en œuvre en fonction de la situation sur place. Il existe de nombreuses applications similaires, telles que l'inspection intelligente, la télédétection inter-domaines, etc. AI Technology Review : Vous avez mentionné dans votre article que les tâches multimodales actuelles se limitent à des interactions dans des cibles et des scénarios simples. Une fois qu'une sémantique logique plus profonde ou une sémantique subjective est impliquée, cela devient difficile. Alors, est-ce une opportunité pour la renaissance de l’intelligence artificielle symbolique ? Quelles autres solutions réalisables sont disponibles pour améliorer la capacité des machines à traiter des informations sémantiques de haut niveau ? Li Xuelong :Russell pense que l'essentiel de la valeur de la connaissance réside dans son incertitude. L’apprentissage des connaissances nécessite de la chaleur et la capacité d’interagir et de réagir avec le monde extérieur. La plupart des recherches que nous voyons actuellement sont monomodales, passives et orientées sur des données données, ce qui peut répondre aux besoins de recherche de certains objectifs et scénarios simples. Mais pour une sémantique logique ou une sémantique subjective plus profonde, il est nécessaire d'explorer et d'excaver pleinement des situations qui sont multidimensionnelles dans l'espace et dans le temps, soutenues par davantage de modalités et capables d'interaction active. Afin d'atteindre cet objectif, les méthodes et méthodes de recherche peuvent s'inspirer davantage des sciences cognitives. Par exemple, certains chercheurs ont introduit l'hypothèse de « l'expérience incarnée » en sciences cognitives dans le domaine de l'intelligence artificielle pour explorer comment les machines créent un nouvel apprentissage. problèmes et tâches dans le contexte d'une interaction active avec le monde extérieur et d'une entrée d'informations multimodale, et des résultats gratifiants ont été obtenus. Cela démontre également le rôle et l’importance positive de l’informatique cognitive multimodale dans la connexion de l’intelligence artificielle et des sciences cognitives. Commentaire sur la technologie IA : L'optoélectronique intelligente est également l'un de vos axes de recherche. Vous avez mentionné dans votre article que l'optoélectronique intelligente peut apporter des solutions exploratoires à la numérisation de l'information. Que peut faire l’optoélectronique intelligente en termes de détection et de calcul de données multimodales ? Li Xuelong : Les signaux lumineux et électriques sont les principaux moyens permettant aux gens de comprendre le monde. La plupart des informations que les humains reçoivent chaque jour proviennent de la vision. Pour aller plus loin, les informations visuelles proviennent principalement de la lumière. . Les cinq sens humains que sont la vue, l’ouïe, l’odorat, le goût et le toucher convertissent également différentes sensations telles que la lumière, les ondes sonores, la pression, l’odorat et la stimulation en signaux électriques pour une cognition de haut niveau. Par conséquent, la photoélectricité est la principale source d’informations permettant aux humains de percevoir le monde. Ces dernières années, grâce à divers dispositifs optoélectroniques avancés, nous avons détecté davantage d’informations que la lumière visible et les ondes sonores audibles. On peut dire que l'équipement photoélectrique est à l'avant-garde de la perception humaine du monde. La recherche en optoélectronique intelligente dans laquelle nous sommes engagés s'engage à explorer l'intégration du matériel de détection photoélectrique et des algorithmes intelligents, à introduire des a priori physiques dans le processus de conception de l'algorithme, à utiliser les résultats de l'algorithme pour guider la conception du matériel et à former une rétroaction mutuelle entre le « sens » et le « calcul ». ". Élargissez les limites de la perception et atteignez l'objectif d'imiter, voire de dépasser la perception multimodale humaine. AI Technology Review : Quels travaux de recherche menez-vous actuellement dans le sens de l'informatique cognitive multimodale ? Quels sont vos futurs objectifs de recherche ? Merci pour la question. Je me concentre actuellement sur l'informatique cognitive multimodale dans Vicinagearth Security. La sécurité au sens traditionnel fait généralement référence à la sécurité urbaine. À l'heure actuelle, l'espace d'activité humaine s'est étendu à basse altitude, au sol et sous l'eau. Nous devons établir un système de sécurité et de défense tridimensionnel dans l'espace proche du sol pour effectuer une série de tâches pratiques telles que la détection inter-domaines et les drones autonomes. systèmes. Un gros problème auquel est confrontée la sécurité sur site est de savoir comment traiter intelligemment une grande quantité de données multimodales générées par différents capteurs, par exemple en permettant aux machines de comprendre les observations simultanées des drones et des équipements de surveillance au sol d'un point de vue humain. . Cela implique l’informatique cognitive multimodale et la combinaison de l’informatique cognitive multimodale et de l’optoélectronique intelligente. À l'avenir, je continuerai à étudier l'application de l'informatique cognitive multimodale à la sécurité sur site, dans l'espoir d'ouvrir le lien entre l'acquisition et le traitement des données, et d'utiliser rationnellement le « bruit d'excitation direct » (Pi- Noise), établir un système de sécurité sur site soutenu par l'informatique cognitive multimodale et l'optoélectronique intelligente.

3 Opportunités et défis

Conversation avec Li Xuelong

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI