Maison >Périphériques technologiques >IA >Un nouveau paradigme pour l'édition de texte et d'images, un modèle unique permet l'édition d'images guidées multi-textes

Un nouveau paradigme pour l'édition de texte et d'images, un modèle unique permet l'édition d'images guidées multi-textes

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBavant

- 2023-04-10 19:41:021333parcourir

Bref aperçu de l'article

La recherche liée à l'utilisation de texte pour éditer des images est très en vogue Récemment, de nombreuses études sont basées sur des modèles de diffusion de débruitage pour améliorer l'effet, mais peu de chercheurs continuent de prêter attention aux recherches connexes. sur GAN. Cet article est basé sur les classiques StyleGAN et CLIP et propose un module de modulation sémantique, de sorte qu'un seul modèle est nécessaire pour différents textes pour effectuer l'édition texte-image.

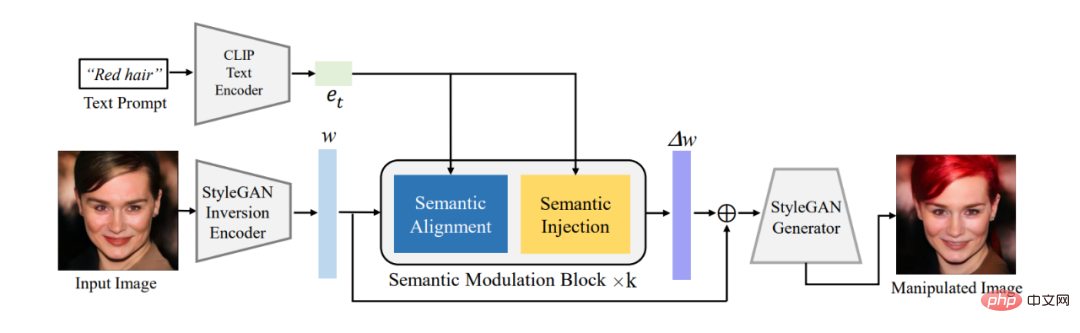

Cet article utilise d'abord l'encodeur existant pour convertir l'image à éditer en code latent w dans l'espace sémantique W^+ de StyleGAN, puis module de manière adaptative le code latent via le module de modulation sémantique proposé. Le module de modulation sémantique comprend des modules d'alignement sémantique et d'injection sémantique. Il aligne d'abord la sémantique entre l'encodage de texte et l'encodage latent du GAN via le mécanisme d'attention, puis injecte les informations textuelles dans l'encodage latent aligné pour garantir que l'encodage Caïn est propriétaire. le texte. Informations permettant ainsi d'éditer des images à l'aide de texte.

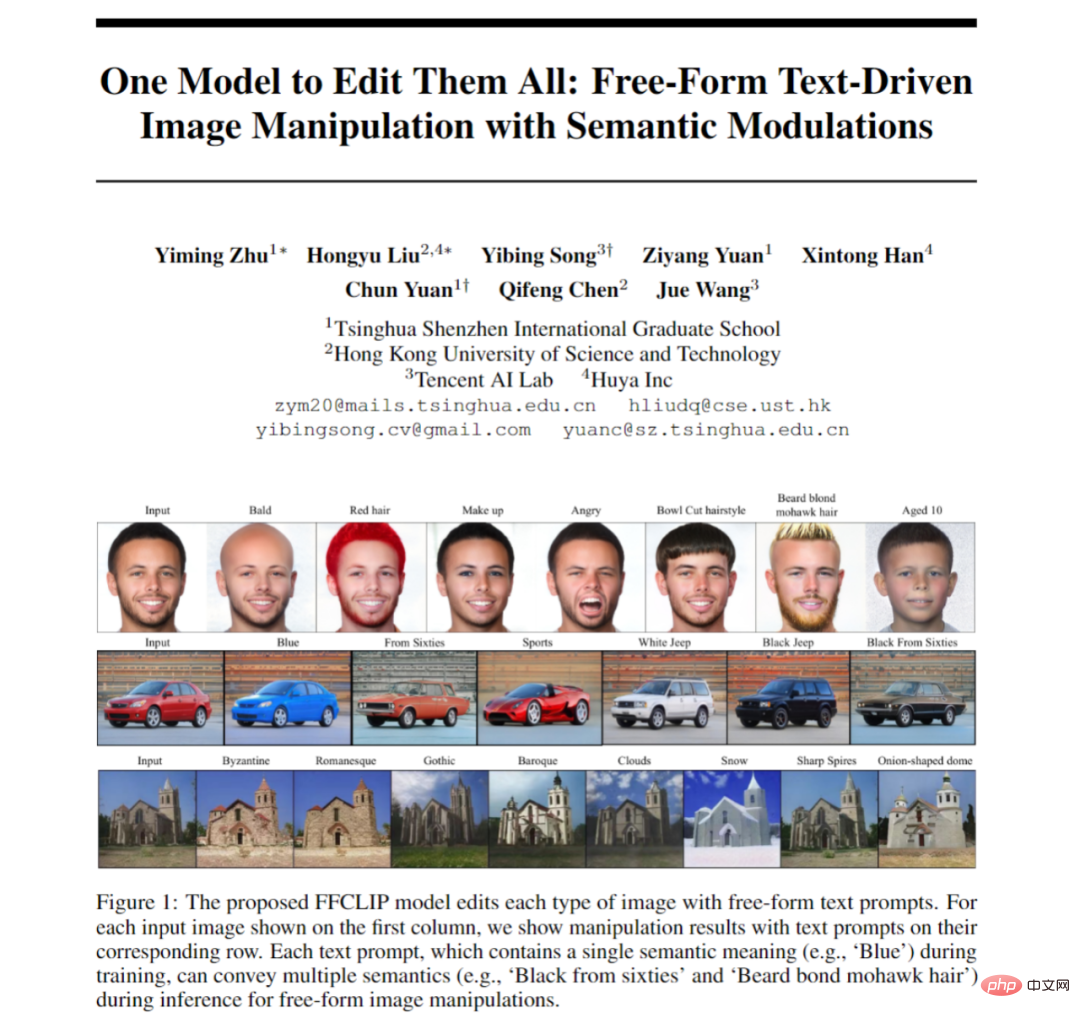

Différent du modèle StyleCLIP classique, notre modèle n'a pas besoin de former un modèle distinct pour chaque texte. Un modèle peut répondre à plusieurs textes pour éditer efficacement les images, de sorte que notre modèle devient une manipulation d'image pilotée par texte sans forme FFCLIP. . Dans le même temps, notre modèle a obtenu de très bons résultats sur les ensembles de données classiques d'église, de visage et de voiture.

- Adresse papier : https://arxiv.org/pdf/2210.07883.pdf

- Adresse Github : https://github.com/KumapowerLIU/FFCLIP

Contexte et implications

Récemment, des invites de texte libre décrivant les intentions de l'utilisateur ont été utilisées pour modifier les espaces latents StyleGAN pour les opérations d'édition d'images [1, 2]. En prenant en entrée une phrase (par exemple, « Bleu ») ou une expression (par exemple, « Homme âgé de 10 ans »), ces méthodes modifient les attributs de l'image décrite en conséquence en modulant le codage latent dans l'espace latent StyleGAN.

Texte précis - L'édition d'images repose sur un mappage latent précis entre l'espace sémantique visuel de StyleGAN et l'espace sémantique textuel de CLIP. Par exemple, lorsque l'invite textuelle est « surprise », nous identifions d'abord son sous-espace sémantique associé (c'est-à-dire « expression », car la surprise appartient à l'attribut d'expression) dans l'espace sémantique visuel. Après avoir trouvé le sous-espace sémantique correspondant au texte, le texte nous indiquera le sens dans lequel l'encodage latent change, de l'expression courante à l'expression surprise. Des études pionnières telles que TediGAN [1] et StyleCLIP [2] ont prédéfini de manière empirique quel sous-espace visuel latent correspond à l'intégration d'indices textuels cible (c'est-à-dire la sélection d'attributs spécifiques dans TediGAN et le mappage de regroupement dans StyleCLIP). Cette reconnaissance empirique oblige, étant donné une invite de texte, à former un modèle d'édition correspondant.

Différents signaux textuels nécessitent différents modèles pour moduler les codes latents dans le sous-espace visuel latent de StyleGAN. Bien que la méthode d'orientation globale dans StyleCLIP n'utilise pas un tel processus, les ajustements des paramètres et les orientations d'édition sont prédéfinis manuellement. Pour cette raison, nous avons des raisons d’explorer comment trouver automatiquement le sous-espace sémantique visuel implicite à travers un texte explicite, afin qu’un seul modèle puisse gérer plusieurs textes.

Dans cet article, nous proposons FFCLIP-Free Form CLIP, qui peut trouver automatiquement le sous-espace visuel correspondant pour différents textes. FFCLIP se compose de plusieurs modules de modulation sémantique qui prennent en entrée l'encodage latent w^+ et l'encodage de texte e dans l'espace latent StyleGAN W^+.

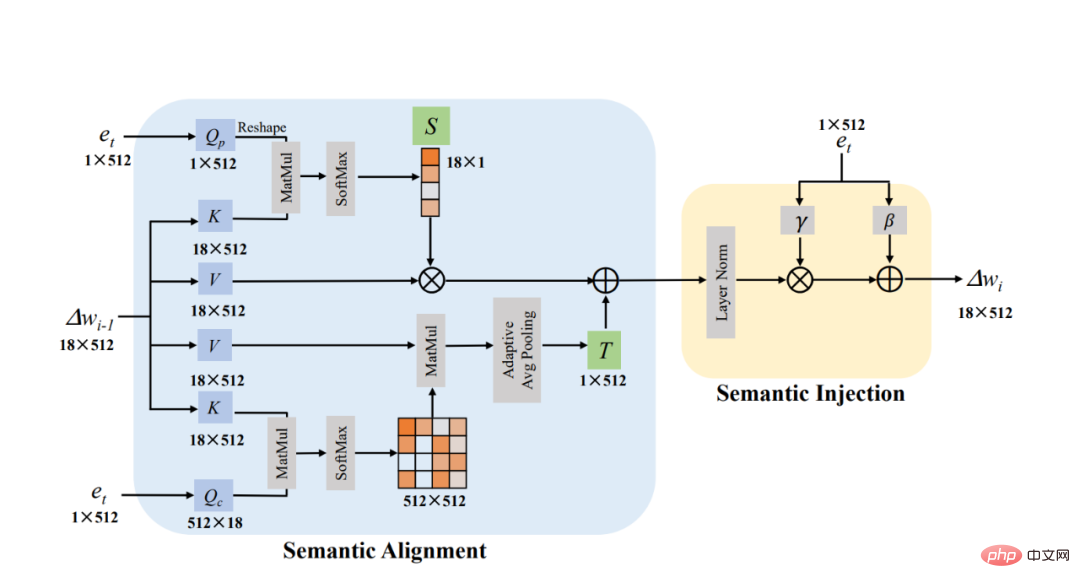

Le module de modulation sémantique se compose d'un module d'alignement sémantique et d'un module d'injection sémantique. Le module d'alignement sémantique prend le codage de texte e comme requête et le codage latent était comme clé et valeur. Ensuite, nous calculons l’attention croisée dans les dimensions de la position et du canal respectivement, ce qui donne lieu à deux cartes d’attention. Ensuite, nous utilisons la transformation linéaire pour transformer l'espace visuel actuel en sous-espace correspondant au texte, où les paramètres de transformation linéaire (c'est-à-dire les paramètres de traduction et de mise à l'échelle) sont calculés sur la base de ces deux cartes d'attention. Grâce à cet alignement, nous pouvons trouver automatiquement le sous-espace visuel correspondant à chaque texte. Enfin, le module d'injection sémantique [3] modifie le code latent dans le sous-espace en suivant une autre transformation linéaire.

Du point de vue de FFCLIP, [1, 2] la sélection empirique dans l'espace neutronique est une forme particulière de notre transformation linéaire dans le module d'alignement sémantique. Leur opération de sélection de groupe est similaire aux valeurs binaires de nos paramètres de mise à l'échelle pour indiquer l'utilisation de chaque dimension de position de w. D'un autre côté, nous observons que la sémantique de l'espace W^+ est toujours enchevêtrée et que la conception empirique ne parvient pas à trouver une cartographie précise entre l'espace latent de StyleGAN et l'espace sémantique textuel de CLIP. Au lieu de cela, le paramètre de mise à l'échelle de notre module d'alignement sémantique modifie de manière adaptative le code latent w pour mapper différentes intégrations d'indices textuels. L'alignement est ensuite encore amélioré via nos paramètres de traduction. Nous évaluons notre méthode sur des ensembles de données de référence et comparons FFCLIP avec les méthodes de pointe. Les résultats montrent que FFCLIP est capable de générer un contenu plus raisonnable tout en transmettant l'intention de l'utilisateur.

FFCLIP

La figure 1 montre notre cadre global. FFCLIP obtient d'abord l'encodage latent des images et des textes via l'encodeur d'inversion GAN pré-entraîné et l'encodeur de texte. L'encodage latent des images est w dans l'espace sémantique visuel StyleGAN mentionné précédemment W^+, tandis que l'encodage du texte est e_t. Comme StyleCLIP, nous utilisons l'encodeur d'inversion e4e GAN [4] et l'encodeur de texte dans CLIP pour obtenir respectivement l'encodage latent correspondant. Ensuite, nous utilisons e_t et w comme entrée du module de modulation et produisons le décalage Δw de w. Enfin, ajoutons Δw au w d'origine et plaçons-le dans le StyleGAN pré-entraîné pour obtenir le résultat correspondant.

Figure 1 : Schéma du cadre général

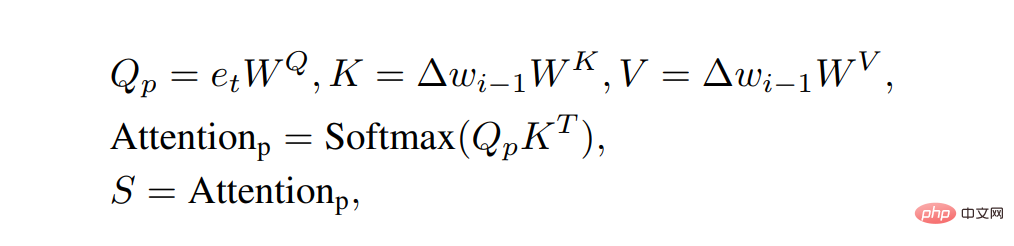

La deuxième figure ci-dessous est notre module de modulation sémantique. Dans le module d'alignement sémantique (Semantic Alignment), nous pouvons clairement voir que nous définissons Δw sur Key et Value et définissons e_t sur Query pour calculer deux cartes d'attention. Les tailles de ces deux cartes d'attention sont respectivement de 18 × 1 et 512 × 512. . Ensuite, nous utilisons la carte d'attention 18×1 comme coefficient d'échelle S dans la transformation linéaire. Notre processus de calcul de la carte d'attention est le suivant :

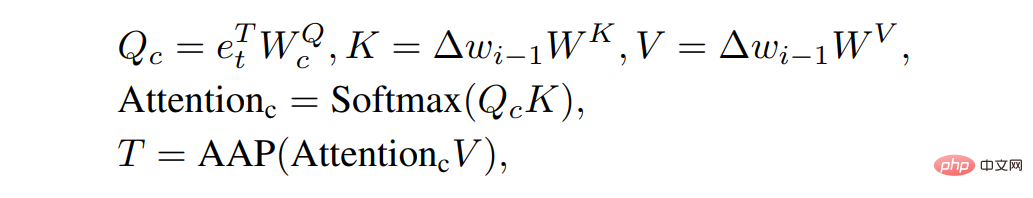

En même temps, nous multiplions la carte d'attention 512×512. par valeur puis passer. L'opération de pooling obtient le coefficient de traduction T dans la transformation explicite. Notre processus de calcul de la carte d'attention est le suivant :

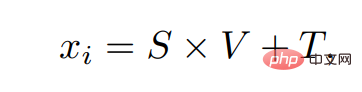

Après avoir obtenu les coefficients de traduction et de mise à l'échelle, nous pouvons trouver le sous-espace visuel correspondant pour le texte actuel e_t par transformation linéaire. Les étapes de calcul sont les suivantes :

Midterm x_i est le résultat de sortie de notre i-ème module de modulation sémantique. Puisque la taille de Δw est de 18×512, les cartes d'attention de 18×1 et 512×512 sont calculées respectivement dans les deux dimensions de position et de canal de Δw. Cette opération est similaire à la double attention [5].

Nous pouvons obtenir le sous-espace visuel correspondant au texte grâce aux opérations ci-dessus, puis nous utilisons une méthode similaire à AdaIN pour injecter des informations textuelles dans Dans cet espace, pour obtenir le résultat final, nous appelons cette opération le module d'injection sémantique (Semantic Injection). Les étapes de mise en œuvre de l'ensemble du module sont les suivantes :

Au final, un total de 4 modules de modulation sémantique ont été empilés dans notre FFCLIP, et finalement le décalage final Δw a été obtenu.

Résultats expérimentaux

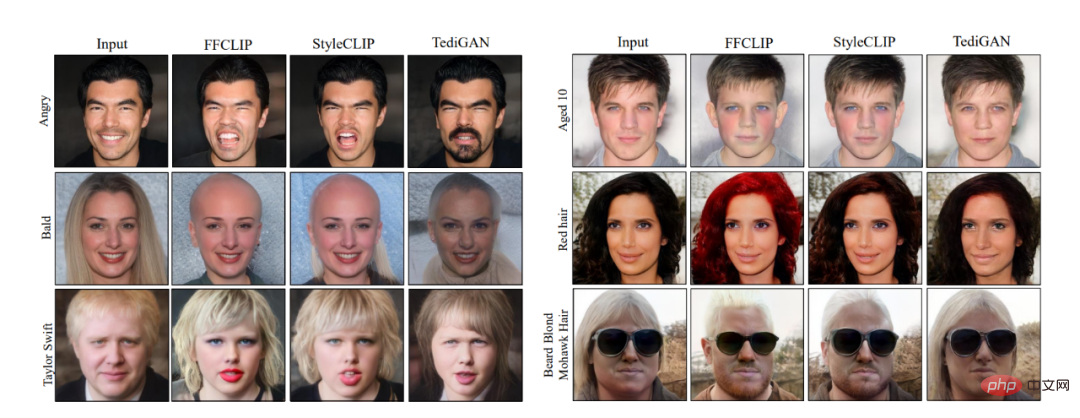

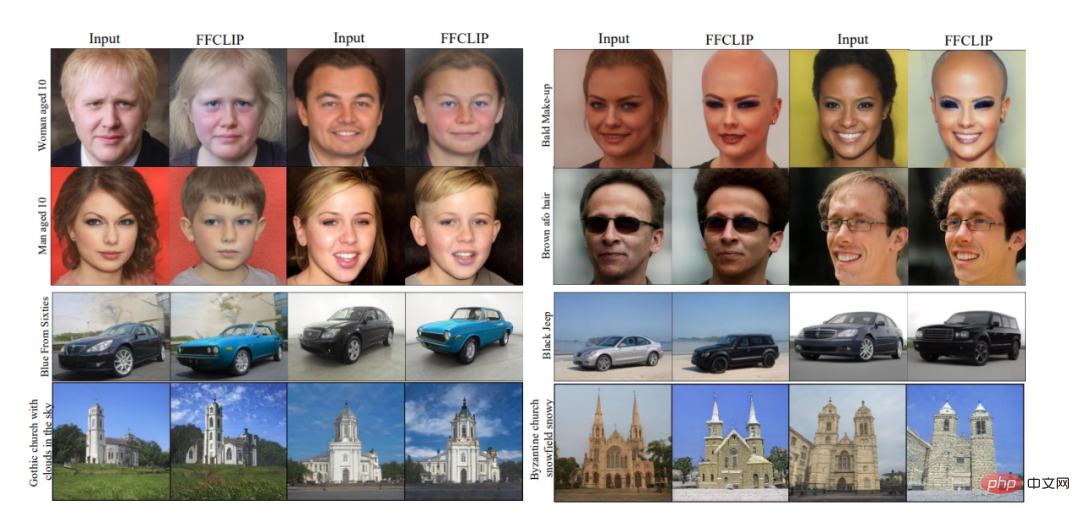

Figure 3 : Tableau de comparaison visuelle

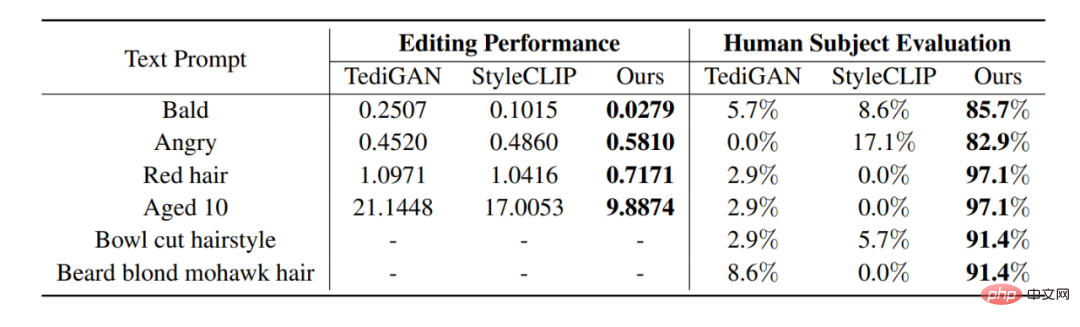

Comme le montre la figure 3, nous avons effectué des comparaisons visuelles avec StyleCLIP [1], TediGAN [2] et HairCLIP [3] Comparaison sur : On peut voir que FFCLIP peut mieux refléter la sémantique du texte et générer des images éditées plus réalistes. Dans le même temps, les résultats de comparaison numérique correspondants sont présentés dans le tableau ci-dessous. Notre méthode permet d'obtenir les meilleurs résultats en termes de valeurs objectives et subjectives.

Tableau 1 : Comparaison numérique

En même temps, notre méthode montre également une très bonne robustesse. FFCLIP n'a pas vu de combinaison de mots lors de l'entraînement mais en utilise un seul. Les mots sont. utilisé pour la formation, mais dans le test, l'image peut être bien éditée selon la sémantique de la phrase. L'effet visuel est illustré à la figure 4.

Figure 4 : Édition de phrases

Pour plus de résultats expérimentaux et d'expériences d'ablation, veuillez consulter le texte original.

Résumé

Dans cet article, nous proposons FFCLIP, une nouvelle méthode d'édition d'images efficace qui peut cibler différents textes mais ne nécessite qu'un seul modèle. La motivation de cet article est que les méthodes existantes correspondent au texte actuel et au sous-espace sémantique du GAN sur la base de l'expérience existante, de sorte qu'un modèle d'édition ne peut gérer qu'une seule invite de texte. Nous améliorons la cartographie latente grâce à l’alignement et à la modulation sémantique injectée. Il facilite un modèle d'édition pour gérer plusieurs invites de texte. Des expériences sur plusieurs ensembles de données démontrent que notre FFCLIP produit efficacement des résultats sémantiquement pertinents et visuellement réalistes.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI