Maison >Périphériques technologiques >IA >Peu importe si vous ne savez pas utiliser PS, la technologie de puzzle IA peut déjà donner l'impression que le faux est réel.

Peu importe si vous ne savez pas utiliser PS, la technologie de puzzle IA peut déjà donner l'impression que le faux est réel.

- 王林avant

- 2023-04-04 12:15:011216parcourir

Au cours des deux dernières années, le « modèle de diffusion d'images générées par texte » est devenu vraiment populaire. DALL·E 2 et Imagen sont toutes deux des applications développées sur cette base.

Cet article est réimprimé avec l'autorisation d'AI New Media Qubit (ID de compte public : QbitAI). Veuillez contacter la source pour la réimpression.

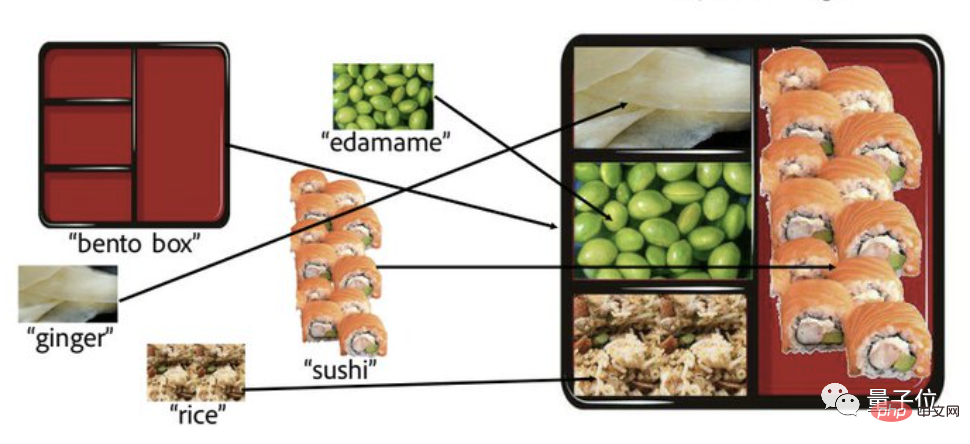

C'est un bento japonais apparemment ordinaire.

Mais pouvez-vous le croire ? En fait, chaque grille de nourriture est P-ed, et la photo originale est toujours de tante Jiang :

△ Il suffit de découper l'image et de la coller, l'effet est faux à première vue

L'opérateur derrière ce n'est pas un patron PS, mais une IA au nom très simple : Collage Diffusion.

Il suffit de trouver quelques petites images et de les donner, et l'IA sera capable de comprendre elle-même le contenu de l'image, puis de mettre les différents éléments très naturellement dans une grande image - il y a aucune imposture du tout.

L'effet a étonné de nombreux internautes.

Certains passionnés de PS ont même dit directement :

C'est tout simplement une aubaine... J'espère le voir bientôt dans Automatic1111 (une interface utilisateur réseau couramment utilisée par les utilisateurs de Stable Diffusion, et également une version plug-in intégrée à PS). .

Pourquoi l'effet est-il si naturel ?

En fait, il existe plusieurs versions générées du "bento japonais" généré par cette IA - elles semblent toutes naturelles.

Quant à savoir pourquoi il existe plusieurs versions ? La raison pour laquelle je demande est que les utilisateurs peuvent également le personnaliser. Ils peuvent affiner divers détails sans rendre la situation globale trop scandaleuse.

En plus du « bento japonais », il possède également de nombreuses œuvres remarquables.

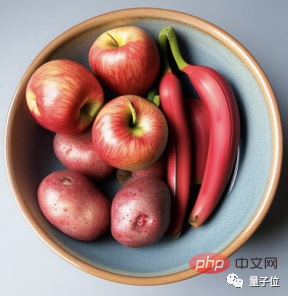

Par exemple, c'est le matériel donné à l'IA. Les traces des images P sont évidentes :

C'est l'image rassemblée par l'IA. Quoi qu'il en soit, je n'ai vu aucune trace d'images P :

En 2016, le « modèle de diffusion d'images générées par texte » est devenu très populaire. DALL·E 2 et Imagen étaient toutes deux des applications développées sur cette base. L'avantage de ce modèle de diffusion est que les images générées sont diversifiées et de haute qualité.

Cependant, texte ne peut jouer qu'un rôle de normalisation flou tout au plus pour l'image cible, de sorte que les utilisateurs doivent généralement passer beaucoup de temps à ajuster les invites (invites) et doivent utiliser des composants de contrôle supplémentaires pour obtenir de bons résultats. effet.

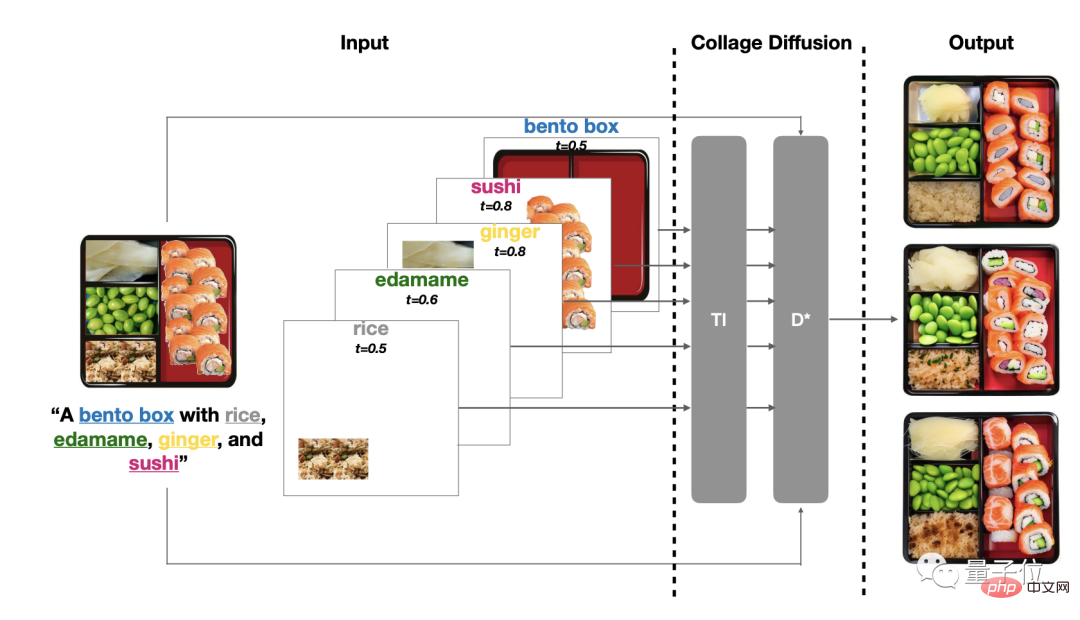

Prenons l'exemple du bento japonais présenté ci-dessus :

Si l'utilisateur saisit uniquement "une boîte à bento contenant du riz, des edamames, du gingembre et des sushis", alors il ne décrit ni quel aliment est placé dans quelle grille, ni il n'y a pas de description. de ce à quoi ressemble chaque aliment. Mais s'il faut que ce soit clair, l'utilisateur devra peut-être rédiger un court essai...

Face à cela, l'équipe de Stanford a décidé de partir sous un autre angle.

Ils ont décidé de se référer à des idées traditionnelles et de générer l'image finale à travers un puzzle, et ont ainsi développé un nouveau modèle de diffusion.

Ce qui est intéressant c’est que, pour parler franchement, ce modèle peut être considéré comme « épelé » selon des techniques classiques.

La première est la superposition : utilisez l'interface utilisateur d'édition d'image basée sur des calques pour décomposer l'image source en calques RVBA (R, V et B représentent respectivement le rouge, le vert et le bleu, et A représente la transparence), puis combinez-les Disposez les calques sur le canevas et associez chaque calque à une invite de texte.

Grâce à la superposition, divers éléments de votre image peuvent être modifiés.

Jusqu'à présent, la superposition est une technologie mature dans le domaine de l'infographie, mais les informations précédemment superposées étaient généralement utilisées comme résultat de sortie d'image unique.

Dans ce nouveau « modèle de diffusion de puzzle », les informations superposées deviennent l'entrée des opérations ultérieures.

En plus de la superposition, est également associé à la technologie existante de coordination d'images basée sur la diffusion pour améliorer la qualité visuelle des images.

En bref, cet algorithme limite non seulement les modifications de certains attributs des objets (comme les caractéristiques visuelles), mais permet également aux attributs (direction, éclairage, perspective, occlusion) de changer.

——Équilibrant ainsi la relation entre le degré de restauration et le degré de naturel, générant des images « spirituellement similaires » et n'ayant aucun sentiment de violation.

Le processus de fonctionnement est également très simple. En mode d'édition interactif, les utilisateurs peuvent créer un collage en quelques minutes.

Ils peuvent non seulement personnaliser la disposition spatiale de la scène (c'est-à-dire placer les photos prises ailleurs dans la position appropriée) ; ils peuvent également ajuster les différents composants qui génèrent l'image. En utilisant la même image source, vous pouvez obtenir différents effets.

△La colonne la plus à droite est le résultat de sortie de cette IA

Et en mode non interactif (c'est-à-dire que l'utilisateur ne fait pas de puzzle et lance directement un tas de petites images à l'IA), l'IA Vous pouvez également obtenir une petite image basée sur le , créer automatiquement une grande image avec des effets naturels.

Équipe de recherche

Enfin, parlons de l'équipe de recherche derrière cela. Il s'agit d'un groupe d'enseignants et d'étudiants du département d'informatique de l'Université de Stanford.

Le premier auteur de la thèse, Vishnu Sarukkai est actuellement étudiant diplômé au Département d'informatique de Stanford, où il étudie pour une maîtrise et un doctorat.

Ses principaux axes de recherche sont : l'infographie, la vision par ordinateur et l'apprentissage automatique.

De plus, le co-auteur de l'article, Linden Li, est également étudiant diplômé au Département d'informatique de Stanford.

Pendant ses études, il a effectué un stage chez NVIDIA pendant 4 mois. Il a collaboré avec l'équipe de recherche en apprentissage profond de NVIDIA et a participé à la formation d'un modèle de convertisseur visuel qui a ajouté plus de 100 millions de paramètres.

Adresse papier : https://arxiv.org/abs/2303.00262

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Articles Liés

Voir plus- Tendances technologiques à surveiller en 2023

- Comment l'intelligence artificielle apporte un nouveau travail quotidien aux équipes des centres de données

- L'intelligence artificielle ou l'automatisation peuvent-elles résoudre le problème de la faible efficacité énergétique des bâtiments ?

- Co-fondateur d'OpenAI interviewé par Huang Renxun : les capacités de raisonnement de GPT-4 n'ont pas encore atteint les attentes

- Bing de Microsoft surpasse Google en termes de trafic de recherche grâce à la technologie OpenAI