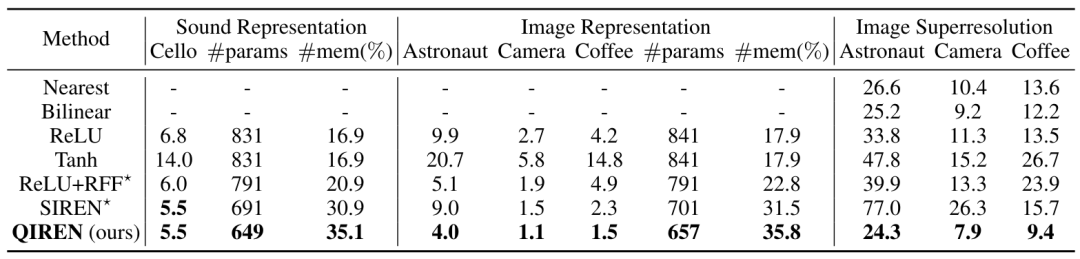

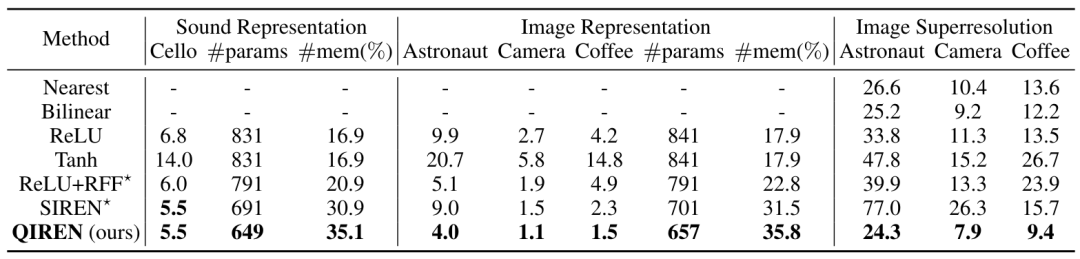

Analyse théorique du modèleDans certaines études antérieures, les propriétés mathématiques du circuit quantique de ré-téléchargement de données ont été révélées. Essentiellement, le circuit quantique de ré-téléchargement de données doit s'adapter à la fonction objectif sous la forme. d'une série de Fourier. Cependant, les travaux antérieurs n'ont exploré que les circuits multicouches à qubit unique ou les circuits multi-qubits monocouches, et n'ont pas comparé les méthodes classiques et n'ont pas trouvé les avantages des circuits quantiques de rechargement de données. Nous étendons nos recherches aux circuits multicouches multi-qubits. De plus, nous avons prouvé que dans le domaine de la représentation neuronale implicite, le réseau neuronal quantique hybride QIREN, qui utilise des circuits quantiques de rechargement de données comme composant principal, présente des avantages exponentiels par rapport aux méthodes classiques. Nous avons analysé le rôle de la couche quantique et de la couche classique dans QIREN et l'avons résumé dans les trois points suivants : 1 Dans des conditions optimales, la capacité de rechargement des données à représenter les séries de Fourier du circuit quantique augmente avec le. La taille du circuit augmente de façon exponentielle. Voir les sections 4.2 et 4.3 du document pour une dérivation spécifique. 2. La fonction de la couche linéaire est d'élargir davantage le spectre et d'ajuster la fréquence, améliorant ainsi les performances d'ajustement. Appliquer une couche linéaire avant de télécharger des données sur un circuit quantique équivaut à ajuster les valeurs propres de l'hamiltonien de la couche de codage, affectant finalement le spectre. Cette approche a deux avantages. Premièrement, cela peut élargir le spectre. Certains termes redondants sont produits dans le spectre lors du codage uniquement avec des portes. Cette redondance peut être réduite en utilisant des couches linéaires. Deuxièmement, il permet d'ajuster la couverture du spectre, visant à couvrir des fréquences avec des coefficients plus grands et plus importants. Par conséquent, l’ajout d’une couche linéaire peut encore améliorer les performances d’ajustement de QIREN. 3. Le rôle de la couche Batchnorm est d'accélérer la convergence du modèle quantique. Dans les réseaux neuronaux à rétroaction, les données passent généralement par la couche BatchNorm avant la fonction d'activation, ce qui empêche efficacement le problème de disparition du gradient. De même, dans QIREN, les circuits quantiques remplacent la fonction d'activation et jouent un rôle dans la non-linéarité (le circuit quantique lui-même est linéaire, mais le processus de téléchargement de données classiques vers le circuit quantique est non linéaire). Par conséquent, nous avons ajouté ici une couche BatchNorm dans le but de stabiliser et d'accélérer la convergence du modèle. Nous avons vérifié les performances supérieures de QIREN dans la représentation des signaux, en particulier des signaux haute fréquence, à travers des tâches de représentation d'images et de représentation sonore. Les résultats expérimentaux sont présentés dans le tableau 1. QIREN et SIREN ont montré des performances similaires sur la tâche de représentation sonore. Bien que les performances des deux modèles semblent comparables, il convient de souligner que notre modèle réalise 35,1 % d'économies de mémoire avec le moins de paramètres, et la convergence de SIREN nécessite de définir des hyperparamètres appropriés, alors que notre modèle ne fait pas cette restriction. Nous avons ensuite analysé les résultats du modèle du point de vue de la fréquence. Nous visualisons le spectre de sortie du modèle dans la figure 4. Il est évident que les distributions basse fréquence issues du modèle sont proches de la situation réelle. Cependant, en ce qui concerne les distributions haute fréquence, QIREN et SIREN s'adaptent bien, suivis par MLP basé sur ReLU avec caractéristiques de Fourier aléatoires (RFF). Les MLP basés sur ReLU et Tanh n'ont même pas la partie haute fréquence du signal.

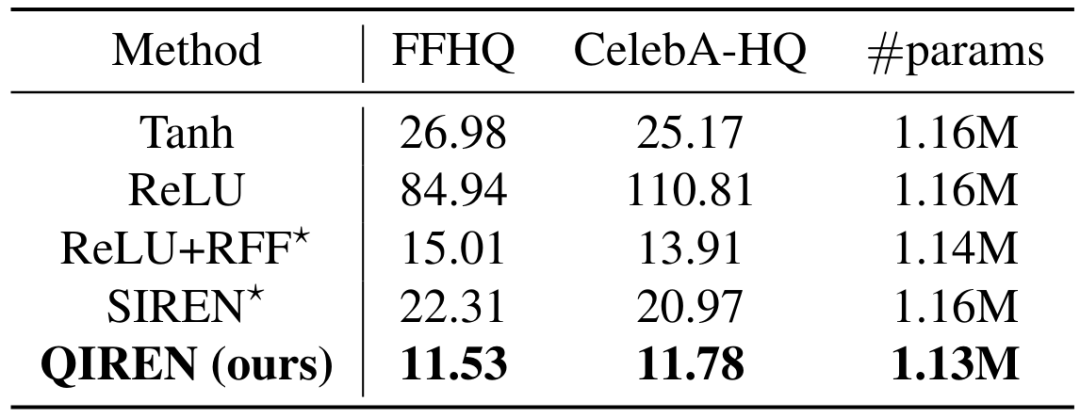

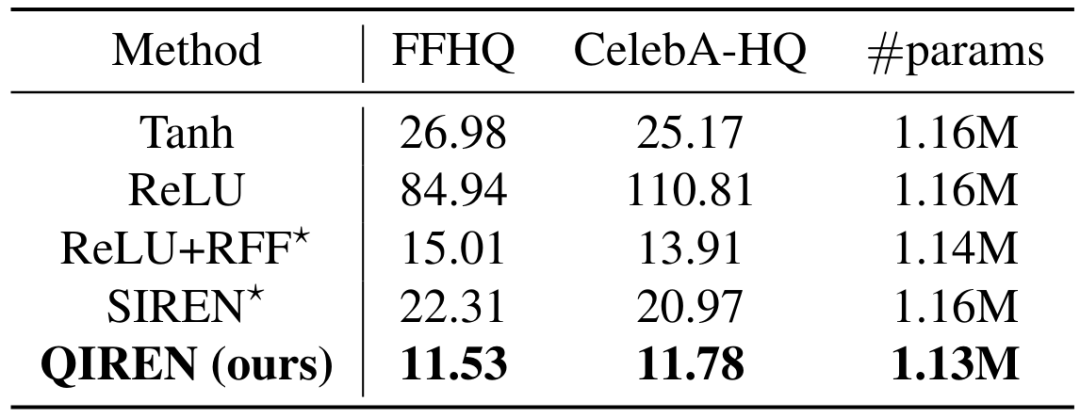

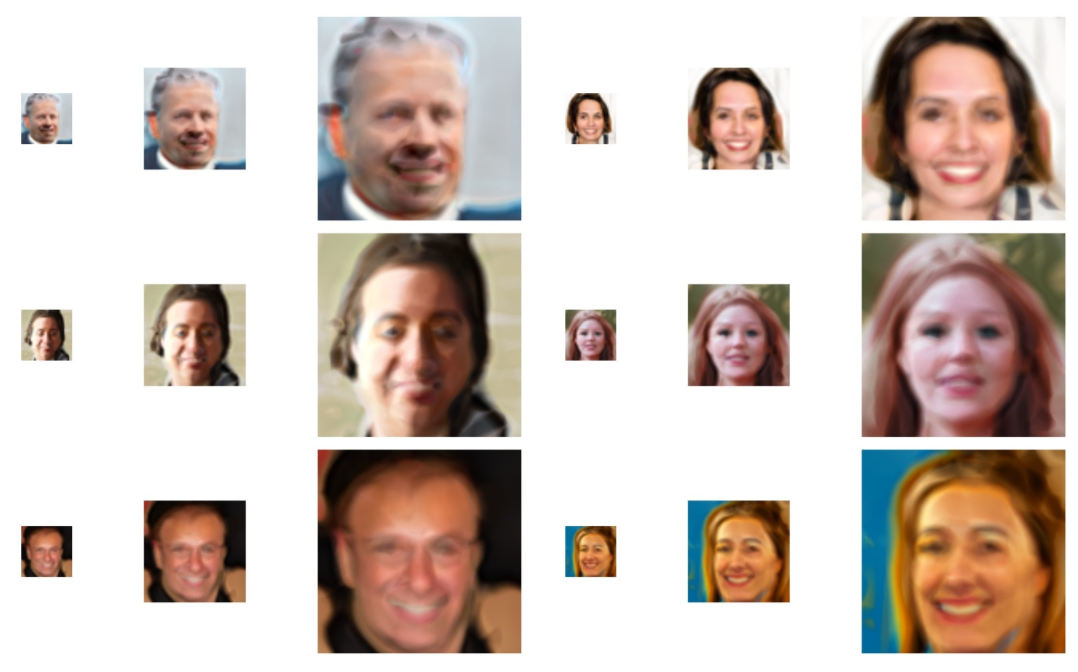

Tableau 1. MSE() du modèle sur les tâches de représentation du signal et de super-résolution d'image. Les modèles considérés comme SOTA sont marqués *. params représente la quantité de paramètres du modèle et mem représente la mémoire économisée par le modèle par rapport à la représentation en grille discrète.任 Figure 4. Son indiquant le spectre de sortie du modèle dans la tâche. Qiren obtient les meilleures performances dans la tâche de représentation d'image. Par rapport au modèle SOTA, l'erreur est La réduction maximale était de 34,8 %. Pour explorer davantage les capacités de représentation du signal du modèle, nous utilisons des filtres pour séparer les composantes haute fréquence et basse fréquence de sa sortie et comparer les erreurs d'ajustement de ces deux composantes respectivement, avec les résultats présentés dans la figure 5. QIREN atteint systématiquement les erreurs les plus faibles lors de l’ajustement des composants haute et basse fréquence. Figure 5. erreur ative de chaque modèle par rapport au MLP basé sur Tanh. Les zones ombrées représentent les erreurs à basse fréquence, tandis que les zones non ombrées représentent les erreurs à haute fréquence. Les dernières recherches introduisent un cadre révolutionnaire pour étendre les représentations neuronales implicites à la génération d'images. Plus précisément, le cadre utilise un hyperréseau prenant des distributions aléatoires en entrée pour générer des paramètres qui caractérisent implicitement le réseau. Par la suite, ces paramètres générés sont attribués au réseau de représentation implicite. Enfin, le réseau de représentation implicite génère des images en prenant les coordonnées en entrée. Une approche contradictoire est utilisée pour garantir que les images générées sont cohérentes avec les résultats souhaités. Dans cette tâche, nous adoptons un tel cadre et nous basons sur StyleGAN2. Les résultats expérimentaux sont présentés dans le tableau 2. Nous explorons également plus en détail certaines fonctionnalités intéressantes du générateur QIREN, comme le montrent les figures 6 et 7. F Tableau 2. Score FID du modèle sur les jeux de données FFHQ et CELEBA-HQ.

Figure 7. Interpolation significative de l'espace image

Ce travail intègre non seulement les avantages quantiques dans la représentation neuronale implicite, mais ouvre également une direction d'application prometteuse pour l'espace image quantique. réseaux de neurones - représentation neuronale implicite. Il convient de souligner que les représentations neuronales implicites ont de nombreuses autres applications potentielles, telles que la représentation de scènes ou d'objets 3D, la prédiction de séries chronologiques et la résolution d'équations différentielles. Pour une large classe de tâches modélisant des signaux continus, nous pouvons envisager d’introduire des réseaux de représentation implicite comme composant de base. Sur la base des fondements théoriques et expérimentaux de cet article, nous pouvons étendre QIREN à ces applications dans des travaux futurs, et QIREN devrait produire de meilleurs résultats avec moins de paramètres dans ces domaines. Dans le même temps, nous avons trouvé un scénario d’application approprié pour l’apprentissage automatique quantique. Promouvoir ainsi de nouvelles recherches pratiques et innovantes au sein de la communauté de l’apprentissage automatique quantique.