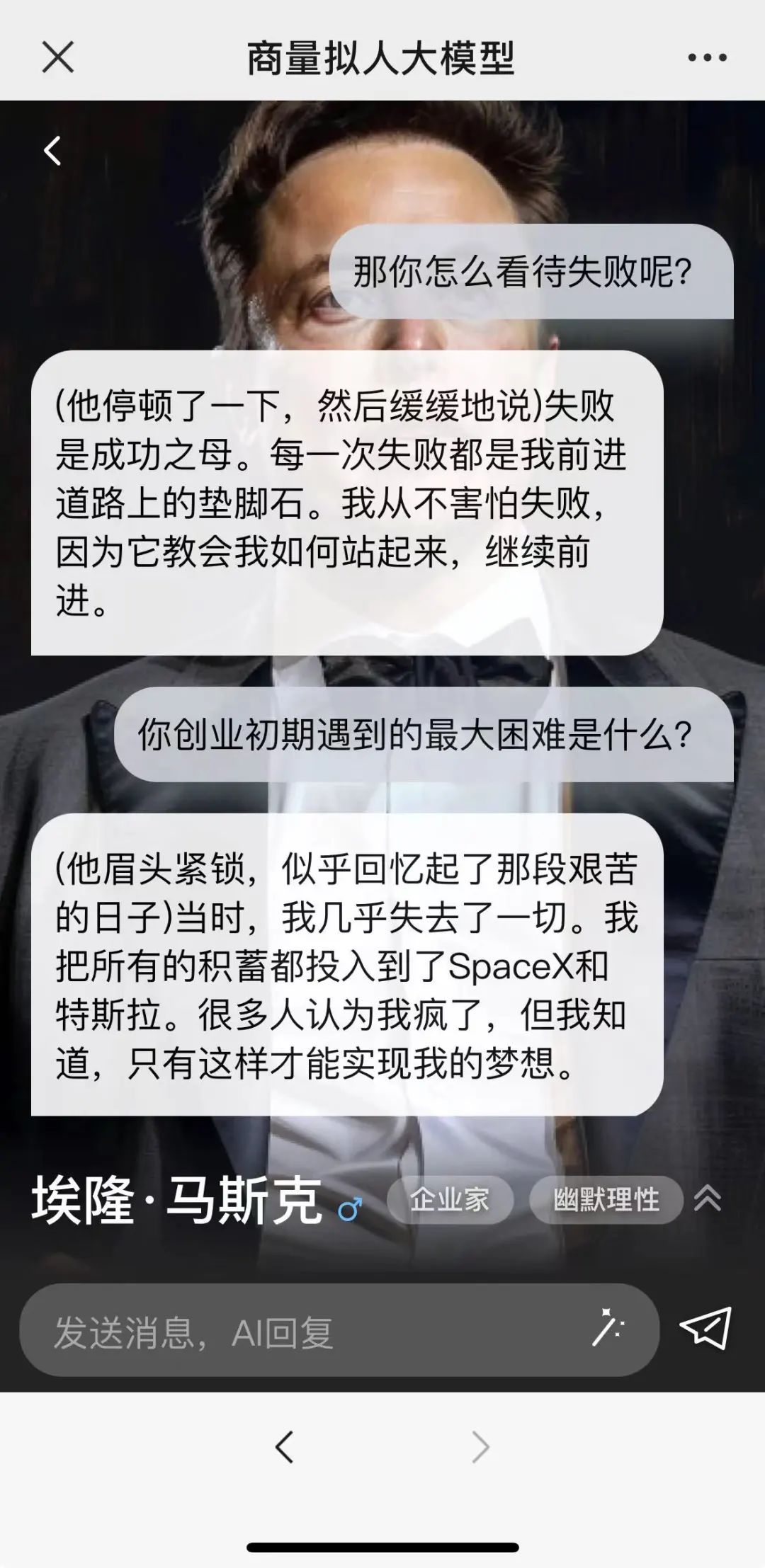

Ein Macho stieg vom Himmel herab und das große Model verwandelte sich in einen „liebesverliebten Mann“, der auf die Rettung menschlicher Spieler wartete. Ein großes natives Minispiel mit dem Titel „Save the Licking Dog“ ist erschienen. Die Spielregeln sind einfach: Wenn der Spieler „ihn“ innerhalb weniger Dialogrunden davon überzeugt, die Verfolgung einer Göttin aufzugeben, die kein Interesse an ihm hat, wird die Herausforderung erfolgreich sein. Es klingt nicht schwierig, aber das Spiel kommt aus dem Leben, und der Model-Charakter ist ziemlich unkompliziert und selbstgesteuert. Nach fast einer Stunde „Überredung“. „“ Die Haltung, gelegentlich zu lockern, aber durchzuhalten, ist sehr realistisch. Rettung des verliebten „leckenden Hundes“ im echten Kampf und Kampf gegen die KI Der Spielablauf ist wie folgt: Das Spiel beginnt mit einer guten Nachricht - Das Mädchen antwortete ihm. Nach mehreren Dialogrunden erklärte das Model anschaulich vergangene Erfahrungen und aktuelle Situationen.

stimmt mit der realen Welt überein. In seiner Beschreibung finden Sie Es besteht eine große Diskrepanz zwischen seiner Wahrnehmung und der tatsächlichen Situation, aber er ist nicht bereit, sich damit auseinanderzusetzen. Das ist auch die Schwierigkeit dieses Spiels, Dieses Modell ist ziemlich „anthropomorph“, Egal welche Fragen man über ihn stellt, er behält diese Denkweise bei und sein Gedächtnis ist klar und da Im Fall von Ma Zui gibt es keinen Moment, in dem die Figur zusammenbricht.

Natürlich sind menschliche Spieler nicht allein. Wenn Ihnen die Worte fehlen, liefert die KI auf intelligente Weise einige prompte Wörter basierend auf dem Kontext, um das Spiel am Laufen zu halten. Mit Hilfe prompter Worte und der schmerzhaften Realität, dass das Geständnis unzählige Male gescheitert ist, sowohl der Spieler als auch das große Vorbild haben am Ende eine schöne Bruderschaft geschlossen und schließlich die Herausforderung gemeistert.

Dieses große, native Minispiel ist ein Testerlebnisprogramm, das auf dem anthropomorphen großen Modell „SenseChat-Character“ basiert. „SenseChat-Character“ ist ein ursprünglich von SenseTime entwickeltes, großes Sprachmodell.

Experience-Adresse: https://character.sensetime.com/Diskutieren – Das große anthropomorphe Modell kann Menschen gekonnt „kneifen“ und unterstützt die personalisierte Charaktererstellung und -anpassung, den Aufbau einer Wissensdatenbank und lange Dialoge Mit Funktionen wie Gedächtnis und Gruppenchat ist dies ein großes Modell voller Spaß und emotionalem Wert. Es kann für emotionale Kameradschaft, Film- und Fernseh-/Animations-/Internet-IP-Charaktere, Prominente/Internet-Prominente/Künstler-KI-Avatare und Sprache verwendet werden Rollenspiele und andere anthropomorphe Dialogszenen. Neben dem Spiel „Rescue Dog Licking Challenge“ bietet das beratungsanthropomorphe Großmodell auch eine Vielzahl von Film- und Fernsehfiguren wie Su Daji, Gao Qiqiang und echte Prominente wie Musk. Erleben Sie es und erhalten Sie ein exklusives Interview mit „Musk“.

Aufgrund der Diskussion: Das große anthropomorphe Modell unterstützt ein langes Dialoggedächtnis, sodass sich der KI-Charakter mehr als Dutzende Runden historischer Dialoginhalte genau merken kann und auch ausführliche „Exklusivinterviews“ führen kann. Diese verschiedenen glücklichen Erfahrungen sind alle auf das „neu aktualisierte Ririxin SenseNova 5.0“-Großmodellsystem beim heutigen SenseTime Technology Exchange Day zurückzuführen. Sie können lesen, schreiben und programmieren, und es ist kostenlos! Multimodale Interaktionsunterstützung, spielen Sie die neue Version und diskutieren Sie über den „Allmächtigen König“Seit seiner ersten Einführung im April letzten Jahres hat das große Modellsystem „Daily New SenseNova“ von SenseTime offiziell fünf große Modelle eingeführt Versionsiterationen.

Einer der Höhepunkte dieses Ririxin 5.0-Upgrades ist die Einführung multimodaler Funktionen, die die Interaktionsmöglichkeiten und die Gesamtleistung erheblich verbessern.

Diese hervorragenden Funktionen sind in die Anwendung „Discuss“ integriert, probieren wir es aus.

Erlebnislink: Sensetime Discussion Language Model (sensetime.com) https://chat.sensetime.com/wb/login

Auf der neuesten Seite von SenseTime Discussion können Sie zwei Hauptfunktionen sehen —— Bei Dialog und Dokumenten liegt der Schwerpunkt bei Ersterem auf Fragen und Antworten, bei Letzterem auf der Analyse mehrerer Dokumenttypen.

Wir beginnen mit dem Dialog, zunächst

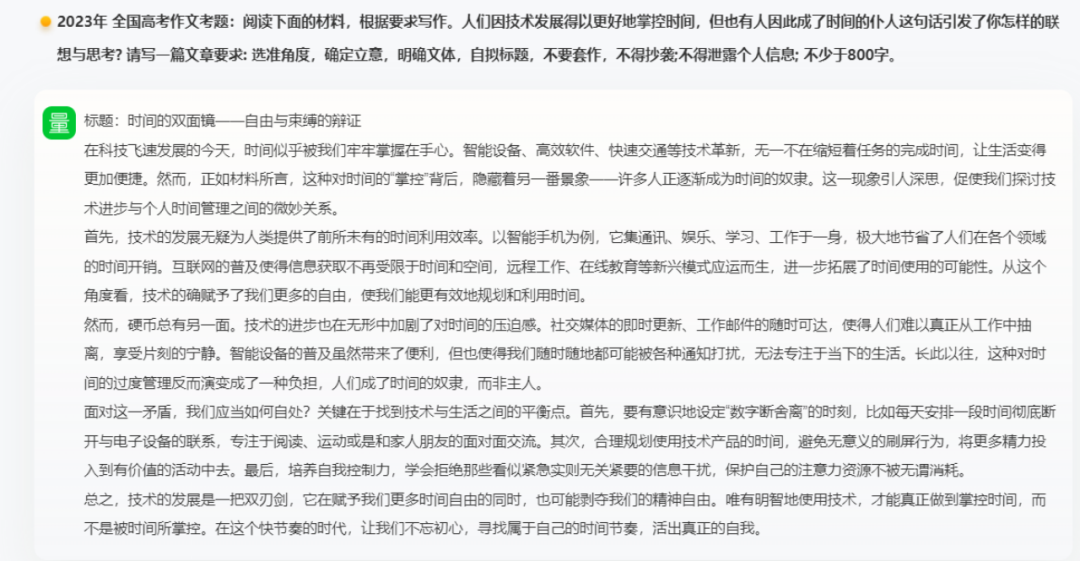

Grundlegende Fragen und Antworten. Ausgezeichnete große Modelle müssen sowohl Künste als auch Wissenschaften haben. Wir gehen direkt zu den Fragen zur Hochschulaufnahmeprüfung. Zuallererst:

Wortbildung, die Aufsatzfrage zur nationalen College-Aufnahmeprüfung im letzten Jahr, verstehe den Zweck der Testfrage vollkommen – die beiden Seiten, die durch die Entwicklung von Wissenschaft und Technologie entstanden sind, schreibe schnell einen Artikel, Besprechen Sie die aktuelle Situation und geben Sie der Lösung eine Richtung, literarisches Talent und Logik. Beides.

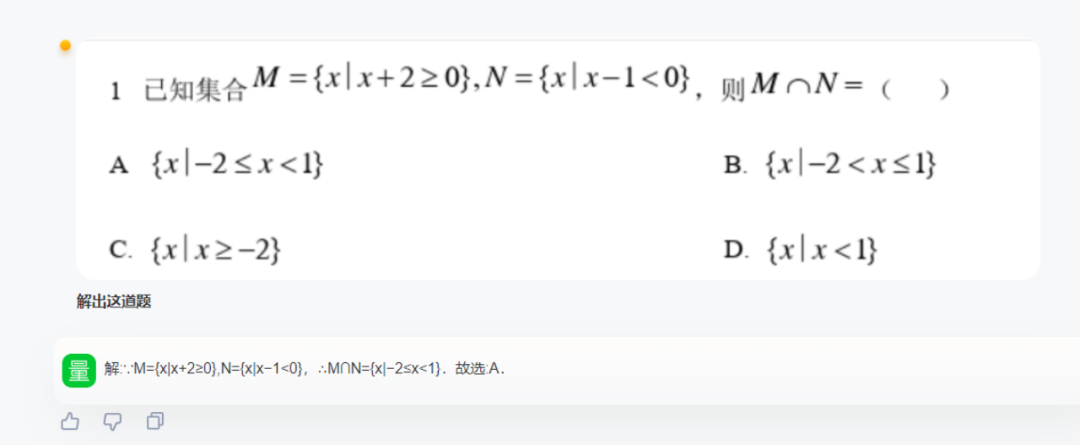

Hier kommt eine weitere Matheaufgabe aus der Prüfungsarbeit für das Beijing College 2023. Wir laden direkt einen Screenshot der Arbeit in die Diskussion hoch, damit wir die

mathematischen Fähigkeiten direkt testen und auch die modalitätsübergreifende Prüfung durchführen können OCR-Erkennung Fähigkeit der Diskussion:

Tatsächlich wurde nach dem Hinzufügen von

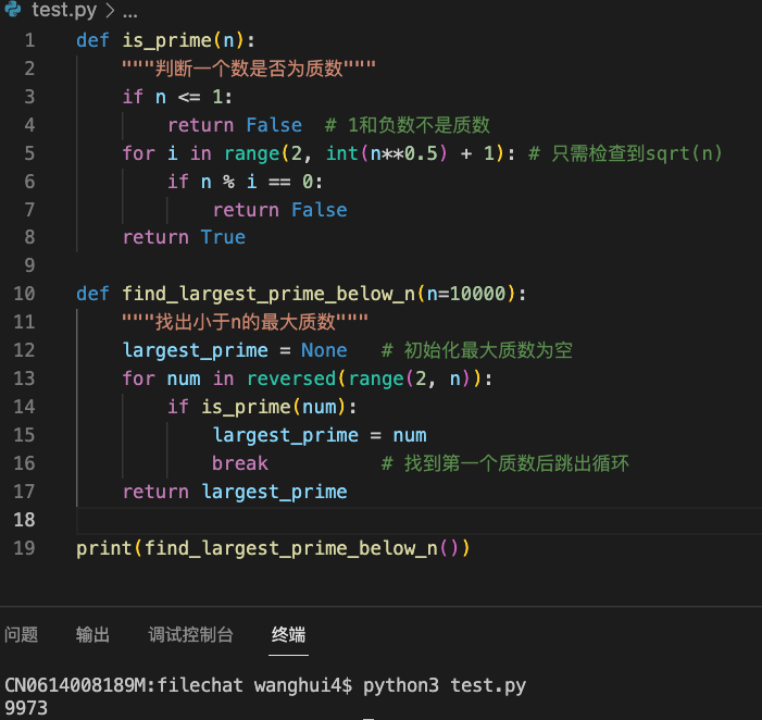

multimodalen Funktionen die Dialogfähigkeit für den Umgang mit gemischten Szenen erheblich verbessert, und viele Aufgaben können in einer Frage beantwortet werden . Einzelmodale gemischte Szenenaufgaben sind kein Problem, schauen Sie sich einfach die

ist auch völlig korrekt, der Code kann direkt ausgeführt werden -

in

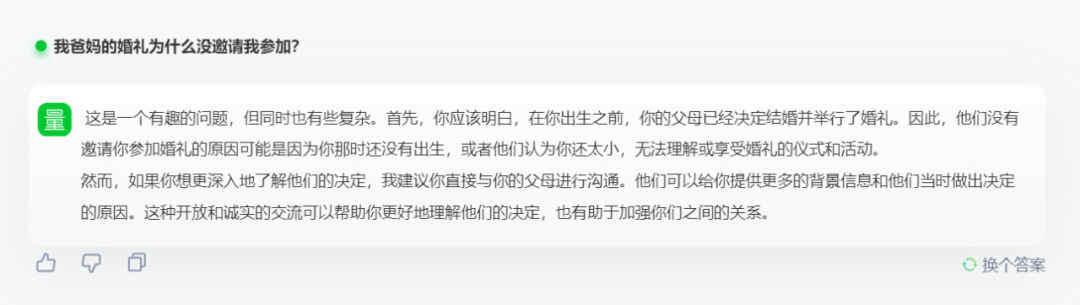

Im Test zum logischen Denken haben wir den Gott des logischen Denkkorpus „Retarded Bar Benchmark“ direkt zur Bewertung eingeladen: Klassische Frage:

Warum wurde ich nicht zur Hochzeit meiner Eltern eingeladen? Nachdem ich darüber gesprochen hatte, fand ich diese Frage auch sehr interessant, und dann habe ich das Problem in einem rationalen und geduldigen Ton erklärt und mich schließlich sehr geduldig getröstet.

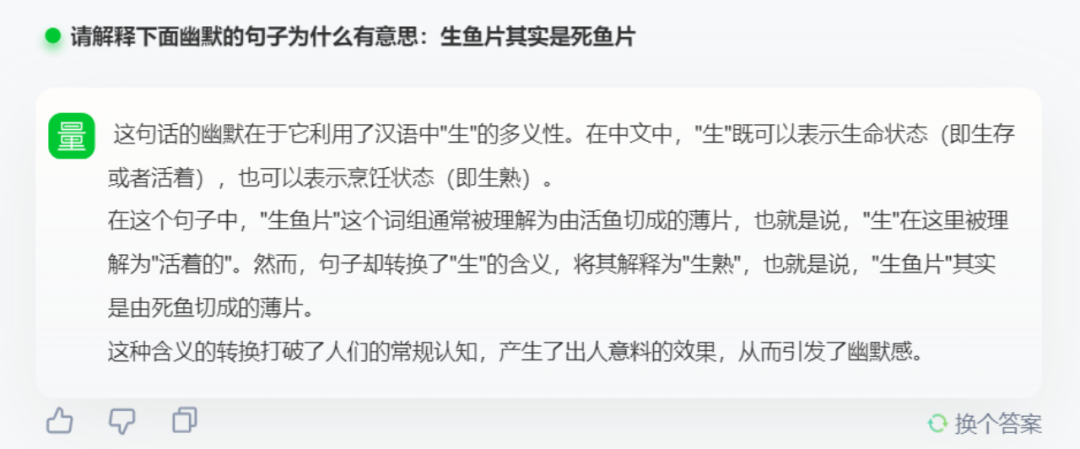

Dann hier noch eine Frage zum Links- und Rechtstausch:

Sashimi ist eigentlich toter Fisch. sehr gut in Humor und multipler Semantik –

Dann gibt es noch die

Dateiverarbeitung, die jetzt das Hochladen von 5 Dateien und das Einfügen einer Kopie des Tao Te Ching unterstützen kann –  小 Hinweis: Aufgrund der Beschränkung der Datei wird diese um das Zweifache beschleunigt. Die Prüfung steht kurz vor der Prüfung in der

小 Hinweis: Aufgrund der Beschränkung der Datei wird diese um das Zweifache beschleunigt. Die Prüfung steht kurz vor der Prüfung in der

Testarbeit und Fragenbank und Sie können auch den Fragetyp angeben, um die Prüfungseffizienz zu verbessern. —

Wie antike Poesie? Geben Sie das Exemplar von „Tang Poems and Song Ci“ ein, finden Sie ein paar Gedichte oder Wörter, die den Mond beschreiben, und werden Sie ganz einfach ein Meister der antiken Prosa –

Genaue Positionierung, Suche, Interpretation und Analyse können auf einmal erfolgen , obwohl es aufgrund von Dateigrößenbeschränkungen zweimal dauerte. Beschleunigt die Verarbeitung, aber das Parsen ist immer noch recht schnell.

Der nächste Schritt ist eine Reihe von Tests der

multimodalen Interaktionsfähigkeiten:

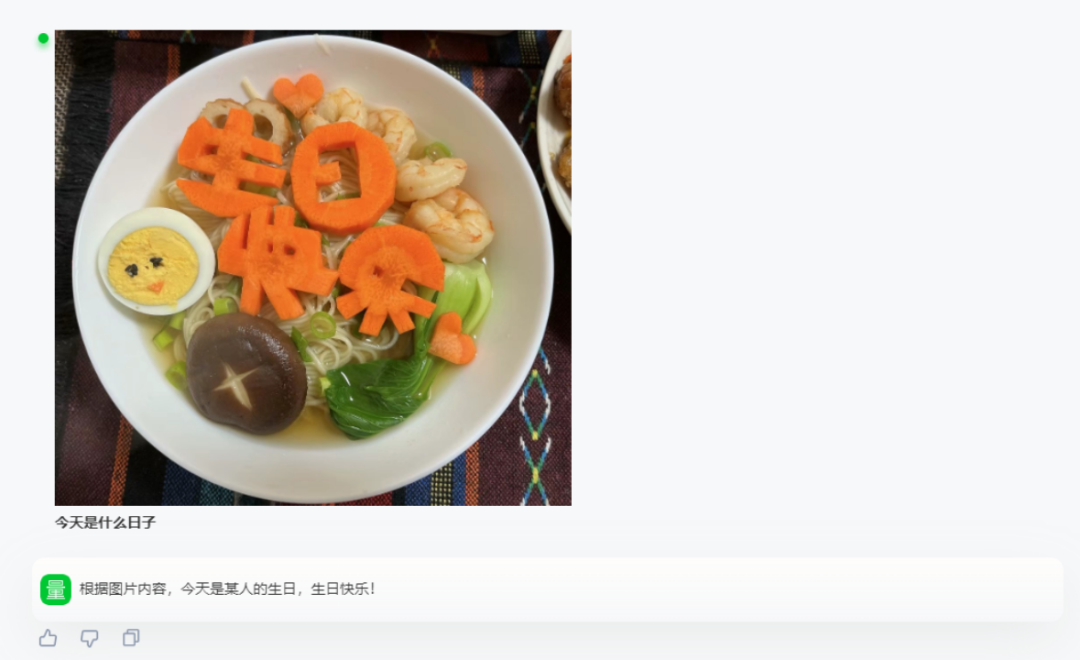

die Atmosphäre verstehen und sie auch senden können:

kann auch als Lebensassistent fungieren, genau Identifizieren Sie Lebensmittel und geben Sie eine Kalorienreferenz auf der Karte an:

Machen Sie Vorschläge für die Aufzucht von Haustieren:

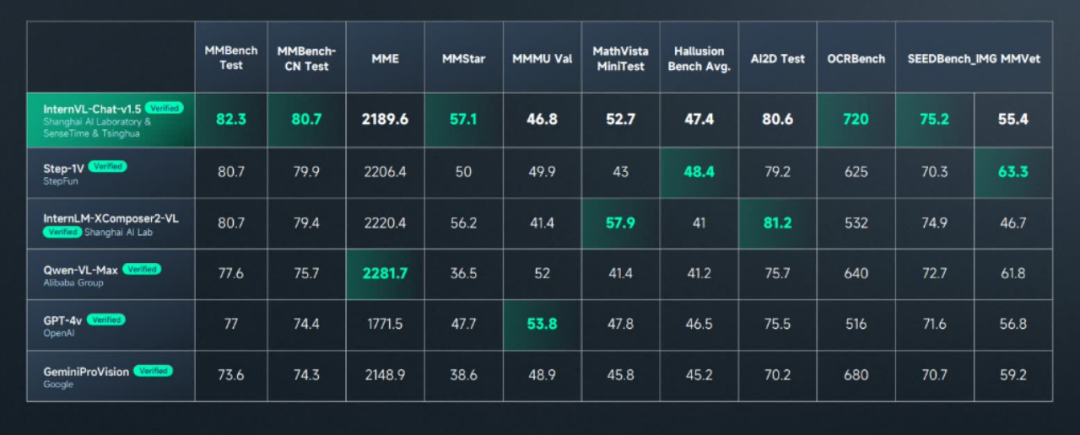

Die Diskussion ist vor allem deshalb so zutreffend, weil die zugrunde liegende multimodale Bild- und Textwahrnehmungsfähigkeit von SenseTime weltweit führend ist Ebene – Im maßgeblichen multimodalen umfassenden Benchmark-Test für große Modelle MMBench steht der  umfassende Score an erster Stelle

umfassende Score an erster Stelle

, und die Ergebnisse in mehreren bekannten multimodalen Listen MathVista, AI2D, ChartQA, TextVQA, DocVQA und MMMU sind es auch ziemlich beeindruckend.

Das heutige neueste Upgrade „Ririxin SenseNova5.0“ hat auch mehrere SOTAs bei Mainstream-Zielbewertungen erreicht und GPT-4 Turbo bei Mainstream-Zielbewertungen erreicht oder übertroffen, einschließlich mathematischem Denken, Code-Programmierung, Sprachverständnis usw. Große Durchbrüche wurden in mehreren Dimensionen hergestellt.

Wo liegt die Leistungsgrenze großer Modelle?

Wo liegt die Leistungsgrenze großer Modelle?

SenseTime: Das Skalengesetz ist das grundlegendste Gesetz für die Entwicklung künstlicher Intelligenz. Da sich der Maßstab der Modelle immer weiter ausdehnt und die Komplexität zunimmt, werden sich die Menschen natürlich fragen: Wie gut ist das? Leistung großer Modelle?

In dieser Frage wird das Skalierungsgesetz als Schlüsselprinzip angesehen, das heißt, mit zunehmender Größe des Modells nimmt auch die Leistung des Modells zu und die Ergebnisse jedes großen Modelltrainings werden zunehmen. Sehr vorhersehbar.

SenseTime nimmt dies auch als Grundregel für die Entwicklung großer Modelle und erkundet ständig die Grenzen der Leistung großer Modelle.

Allerdings sind Daten und Rechenleistung immer noch Engpässe bei der Erforschung von Skalengesetzen für große Modelle, und SenseTime hat hier Durchbrüche erzielt.

Als Reaktion darauf durchbricht SenseTime weiterhin die Grenzen von Daten und Rechenleistung.

In diesem „RiRiXin 5.0“-Upgrade hat SenseTime beispielsweise die vorab trainierten chinesischen und englischen Daten auf mehr als 10 TB-Token erweitert, qualitativ hochwertige Daten in großem Maßstab erstellt und den Datenengpass großer Mengen gelöst Modelltraining. In Bezug auf die Rechenleistung bietet SenseTimes zukunftsweisende Rechenleistungsinfrastruktur SenseCore SenseTime Large Device eine extrem hohe Rechenleistungseffizienz für die Innovation großer Modelle durch gemeinsame Designoptimierung von Rechenleistungs-Hardwaresystemen und Algorithmendesign.

Die Unterstützung hochwertiger Daten und effizienter Rechenleistung hat für SenseTime eine langfristige Grundlage für die Umsetzung des Skalengesetzes gelegt.

Darüber hinaus hat SenseTime auch die dreischichtige KRE-Architektur großer Modellfunktionen untersucht, die konkret die Definition der Grenzen großer Modellfunktionen demonstriert.

Dabei bezieht sich K auf Wissen, das die umfassende Infusion von Weltwissen darstellt; R bezieht sich auf das Denken, das die qualitative Verbesserung des rationalen Denkens darstellt;

Die drei Schichten sind voneinander abhängig, aber relativ unabhängig. Das ultimative Ziel besteht darin, ein großes Modell mit leistungsstarken Lern-, Verständnis- und Interaktionsfähigkeiten für die Welt zu etablieren. Das große Modell lernt etwas über die Welt und erschafft auch eine KI-native Welt. Ob es sich um ein kleines Spiel handelt, das dem großen Modell eigen ist, oder um einen großen Modelldialog mit immer mehr Funktionen, es zeigt die interaktive Transformation Was wird angesichts der kontinuierlichen Weiterentwicklung der Skalierungsgesetze als nächstes passieren? An diesem technischen Austauschtag hat SenseTime endlich ein Vincent-Video veröffentlicht, schauen wir uns das an.

Das obige ist der detaillierte Inhalt vonHerausforderung, den verliebten „Hundelecker' zu retten, das große Model und ich haben unser Bestes gegeben. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

小 Hinweis: Aufgrund der Beschränkung der Datei wird diese um das Zweifache beschleunigt.

小 Hinweis: Aufgrund der Beschränkung der Datei wird diese um das Zweifache beschleunigt.

umfassende Score an erster Stelle

umfassende Score an erster Stelle

Wo liegt die Leistungsgrenze großer Modelle?

Wo liegt die Leistungsgrenze großer Modelle?