Heim >Technologie-Peripheriegeräte >KI >Neue Ideen für die LiDAR-Simulation |. LidarDM: Hilft bei der Generierung einer 4D-Welt, Simulationskiller~

Neue Ideen für die LiDAR-Simulation |. LidarDM: Hilft bei der Generierung einer 4D-Welt, Simulationskiller~

- PHPznach vorne

- 2024-04-12 11:46:15916Durchsuche

Originaltitel: LidarDM: Generative LiDAR Simulation in a Generated World

Papierlink: https://arxiv.org/pdf/2404.02903.pdf

Codelink: https://github.com/vzyrianov/lidardm

Zugehörigkeit zum Autor: University of Illinois, Massachusetts Institute of Technology

Idee für die Abschlussarbeit:

Dieses Papier stellt LidarDM vor, ein neuartiges Lidar-Generierungsmodell, das realistische, Layout-bewusste, physikalisch glaubwürdige und zeitlich kohärente Lidar-Videos erzeugen kann. LidarDM verfügt über zwei beispiellose Fähigkeiten bei der Modellierung der Lidar-Generierung: (1) Lidar-Generierung basierend auf Fahrszenarien, die erhebliche Anreize für autonome Fahrsimulationen bietet, (2) 4D-Lidar-Punktwolken-Generierung, die die Erstellung realistischer und zeitlich kohärenter Lidar-Sequenzen ermöglicht. Der Kern unseres Modells ist ein neuartiges, umfassendes 4D-Weltgenerierungs-Framework. Insbesondere verwendet dieser Artikel latente Diffusionsmodelle, um 3D-Szenen zu generieren, kombiniert sie mit dynamischen Akteuren, um die zugrunde liegende 4D-Welt zu bilden, und generiert dann realistische Laserwahrnehmungsdaten in dieser virtuellen Umgebung. Unsere Experimente zeigen, dass unsere Methode konkurrierende Algorithmen in Bezug auf Genauigkeit, zeitliche Kohärenz und Layoutkonsistenz übertrifft. Dieser Artikel zeigt auch, dass LidarDM als generativer Weltsimulator zum Trainieren und Testen von Wahrnehmungsmodellen verwendet werden kann.

Netzwerkdesign:

Die entwickelten generativen Modelle haben bei der Verarbeitung von Datenverteilung und Inhaltserstellung, wie der Bild- und Videogenerierung [10, 33, 52-55] und der 3D-Objektgenerierung [10,19], immer mehr Aufmerksamkeit auf sich gezogen ,38,52], Komprimierung [5,29,68] und Bearbeitung [37,47] und andere Felder. Generative Modelle zeigen auch ein hervorragendes Simulationspotenzial [6, 11, 18, 34, 46, 60, 64, 66, 76, 82] und ermöglichen die Erstellung realistischer Szenarien und der damit verbundenen sensorischen Daten für das Training und die Bewertung sicherheitskritischer Intelligenzfähigkeiten B. Roboter und selbstfahrende Fahrzeuge, machen eine kostspielige manuelle Modellierung der realen Welt überflüssig. Diese Fähigkeiten sind von entscheidender Bedeutung für Anwendungen, die auf umfangreicher Umweltschulung oder Szenariotests angewiesen sind.

Die Fortschritte bei der bedingten Bild- und Videogenerierung waren bemerkenswert, aber die spezifische Aufgabe, realistische Lidar-Punktwolkensequenzen für funktionsspezifische Szenarien für autonome Fahranwendungen zu generieren, bleibt noch unzureichend erforscht. Aktuelle Methoden zur Lidar-Generierung lassen sich in zwei Hauptkategorien einteilen, die jeweils mit spezifischen Herausforderungen konfrontiert sind.

- Aktuelle Modellierungsmethoden für die Lidar-Generierung [8, 72, 79, 83] sind auf die Generierung einzelner Frames beschränkt und bieten keine Möglichkeit zur semantischen Steuerbarkeit und zeitlichen Konsistenz.

- Lidar-Resimulation [14, 17, 46, 65, 67, 74] stützt sich stark auf vom Benutzer erstellte oder in der realen Welt gesammelte Assets. Dies führt zu hohen Betriebskosten, schränkt die Vielfalt ein und schränkt eine breitere Anwendbarkeit ein.

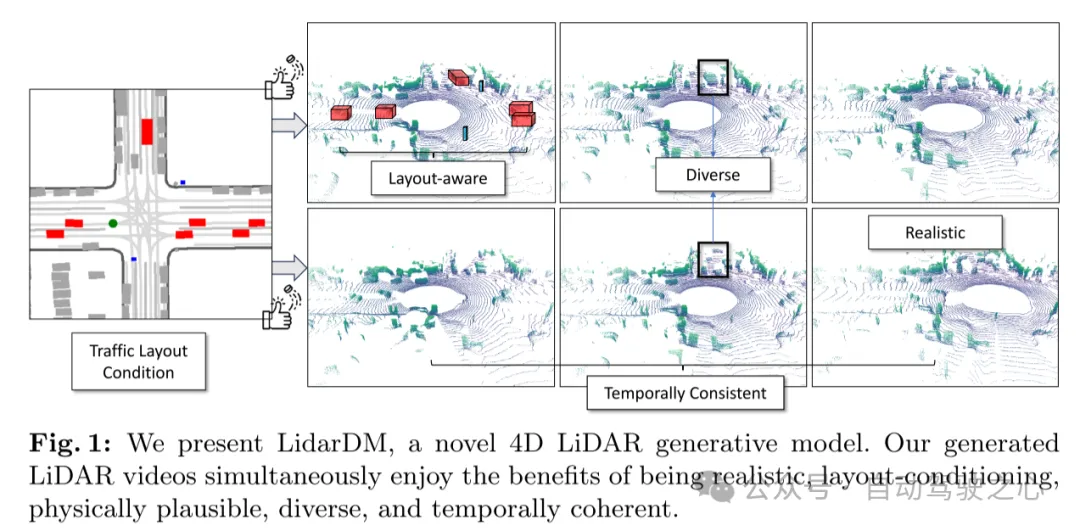

Um diese Herausforderungen anzugehen, schlägt dieses Papier LidarDM (Lidar Diffusion Model) vor, mit dem realistische, Layout-bewusste, physikalisch glaubwürdige und zeitlich kohärente Lidar-Videos erstellt werden können. In diesem Artikel werden zwei neuartige Fähigkeiten untersucht, die bisher noch nicht angesprochen wurden: (i) Lidar-Synthese basierend auf Fahrszenarien, die ein großes Potenzial für die Simulation autonomen Fahrens bietet, und (ii) das Ziel, realistische, kommentierte Lidar-Punktwolken zu erzeugen. Sequentielle 4D-Lidar-Punktwolke Synthese. Die wichtigste Erkenntnis zur Erreichung dieser Ziele in diesem Artikel liegt darin, zunächst die zugrunde liegende 4D-Welt zu generieren und zu kombinieren und dann realistische Wahrnehmungsbeobachtungen innerhalb dieser virtuellen Umgebung zu erstellen. Um dies zu erreichen, integriert dieser Artikel bestehende Methoden zur 3D-Objektgenerierung, um dynamische Akteure zu erstellen, und entwickelt eine neue Methode zur groß angelegten 3D-Szenengenerierung auf der Grundlage latenter Diffusionsmodelle. Dieser Ansatz ist in der Lage, aus der semantischen Anordnung von Partikeln realistische und vielfältige 3D-Fahrszenen zu erzeugen, und nach dem besten Wissen dieser Arbeit handelt es sich um den ersten Versuch. Dieser Artikel wendet Trajektorien an, um eine 3D-Welt zu erzeugen, und führt eine stochastische Raycasting-Simulation durch, um die endgültige 4D-Lidar-Sequenz zu generieren. Wie in Abbildung 1 dargestellt, sind die in dieser Arbeit generierten Ergebnisse vielfältig, auf die Layoutbedingungen abgestimmt und sowohl realistisch als auch zeitlich kohärent.

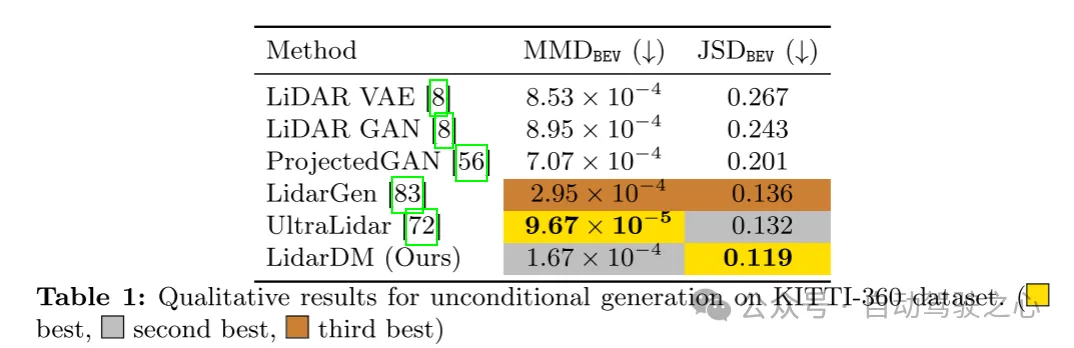

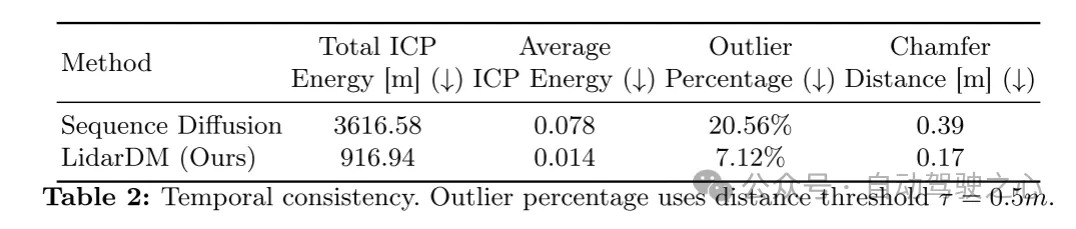

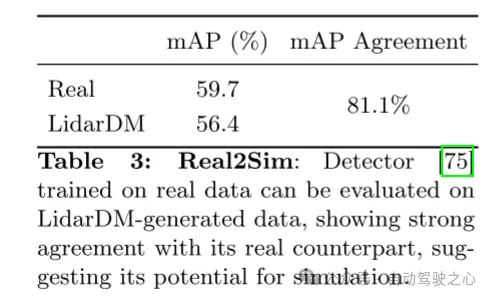

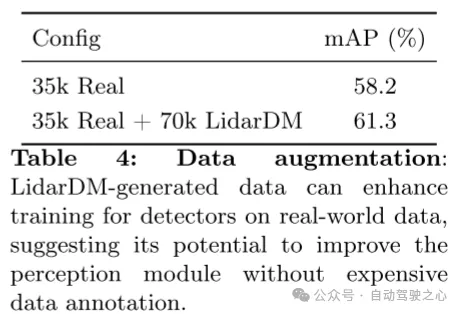

Die experimentellen Ergebnisse dieser Arbeit zeigen, dass von LidarDM erzeugte Einzelbildbilder Realismus und Vielfalt aufweisen und ihre Leistung mit der hochmodernen streifenfreien Einzelbild-Laserpunktwolken-Erzeugungstechnologie vergleichbar ist. Darüber hinaus zeigt dieser Artikel, dass LidarDM in der Lage ist, zeitlich kohärente Laserpunktwolkenvideos zu erzeugen, die über die robuste Basislinie der Diffusionssensorgenerierung hinausgehen. Nach unserem besten Wissen ist dies die erste Laser-Punktwolken-Erzeugungsmethode mit dieser Fähigkeit. In diesem Artikel werden die Möglichkeiten zur Elementgenerierung von LidarDM weiter demonstriert, indem eine gute Übereinstimmung zwischen der generierten Laserpunktwolke und der echten Laserpunktwolke unter übereinstimmenden Kartenelementen demonstriert wird. Abschließend zeigt dieser Artikel, dass mit LidarDM generierte Daten minimale Domänenlücken aufweisen, wenn sie mit auf realen Daten trainierten Wahrnehmungsmodulen getestet werden, und dass sie auch zur Erweiterung der Trainingsdaten verwendet werden können, wodurch die Leistung von 3D-Detektoren erheblich verbessert wird. Dies schafft die Voraussetzung dafür, mit dem generierten Laser-Punktwolkenmodell eine realistische und kontrollierbare Simulationsumgebung für das Training und Testen von Fahrmodellen zu schaffen.

Abbildung 1: Dieses Papier demonstriert LidarDM, ein neuartiges generatives 4D-Lidar-Modell. Das in diesem Artikel generierte Lidar-Video bietet gleichzeitig die Vorteile von Wahrhaftigkeit, Layout-Konditionalität, physischer Glaubwürdigkeit, Vielfalt und zeitlicher Kohärenz.

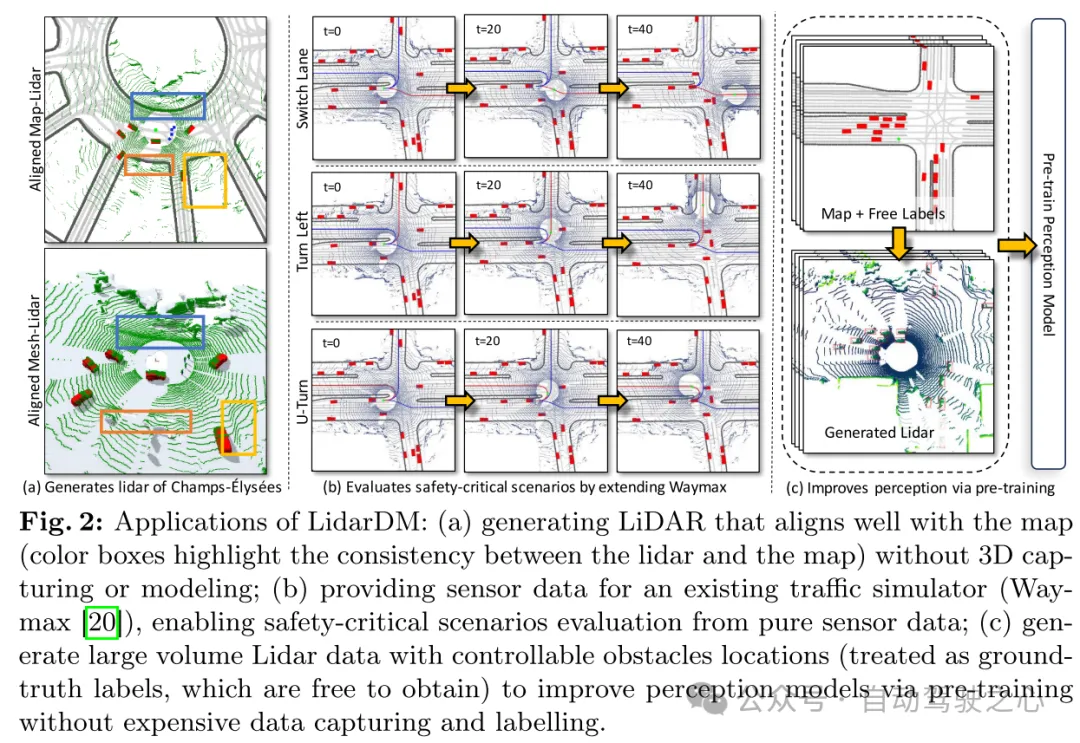

Abbildung 2: Anwendung von LidarDM: (a) Generieren von Lidar, das eng an der Karte ausgerichtet ist, ohne 3D-Erfassung oder -Modellierung (farbige Kästchen heben die Konsistenz zwischen Lidar und Karte hervor); b) Bereitstellung von Sensordaten für einen vorhandenen Verkehrssimulator ( Waymax [20]), das es ermöglicht, sicherheitskritische Szenarien nur anhand reiner Sensordaten zu bewerten; (c) große Mengen an Lidar-Daten mit kontrollierbaren Hindernispositionen zu generieren (angesehen wie bei frei verfügbaren realen Etiketten), um Wahrnehmungsmodelle durch Vortraining zu verbessern ohne teure Datenerfassung und Annotation.

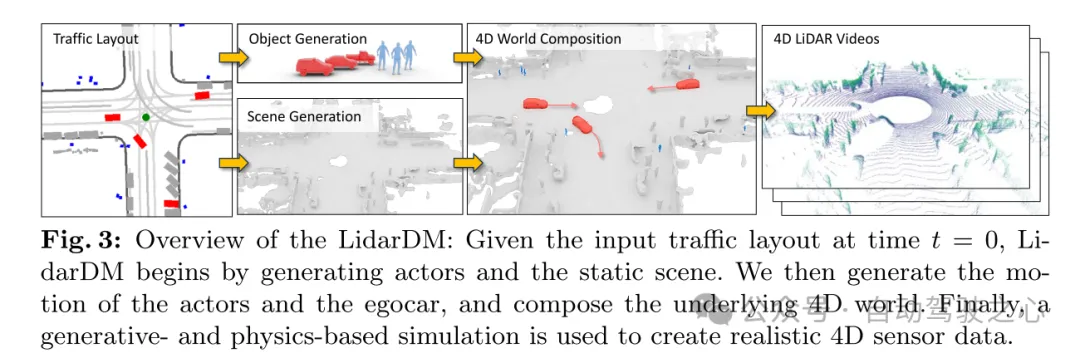

Abbildung 3: LidarDM-Übersicht: Angesichts der Verkehrslayout-Eingabe zum Zeitpunkt t = 0 generiert LidarDM zunächst Verkehrsakteure und statische Szenen. Anschließend generiert dieser Artikel die Bewegungen von Verkehrsteilnehmern (Akteuren) und eigenen Fahrzeugen und erstellt die zugrunde liegende 4D-Welt. Nutzen Sie abschließend generative und physikbasierte Simulationen, um realistische 4D-Sensordaten zu erstellen.

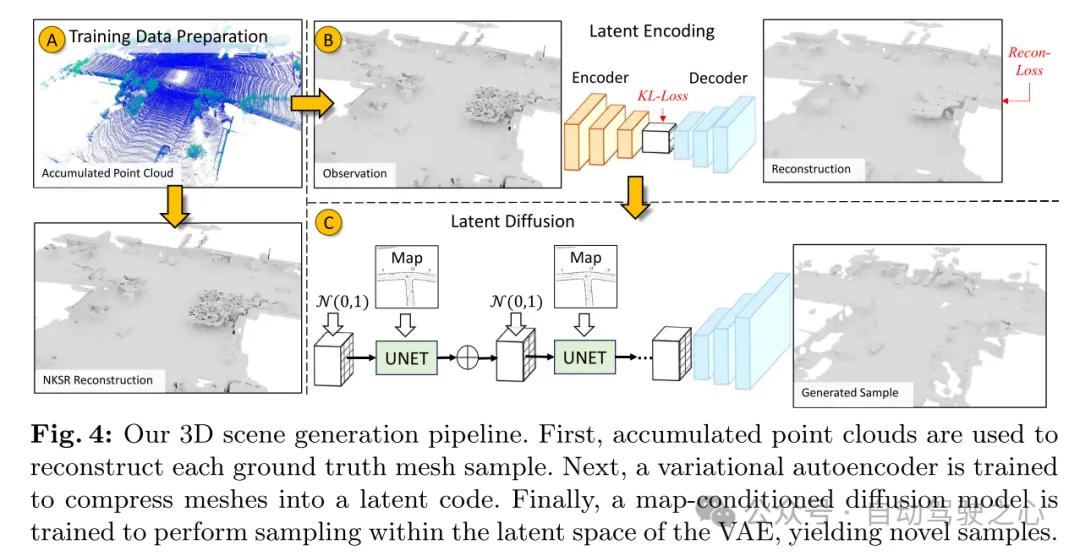

Abbildung 4: Der 3D-Szenengenerierungsprozess dieses Artikels. Zunächst wird die akkumulierte Punktwolke verwendet, um jede reale Netzprobe zu rekonstruieren. Als nächstes wird ein Variational Autoencoder (VAE) trainiert, um das Raster in eine implizite Codierung zu komprimieren. Schließlich wird ein auf der Karte konditioniertes Diffusionsmodell darauf trainiert, innerhalb des latenten Raums des VAE abzutasten, um neue Proben zu erzeugen.

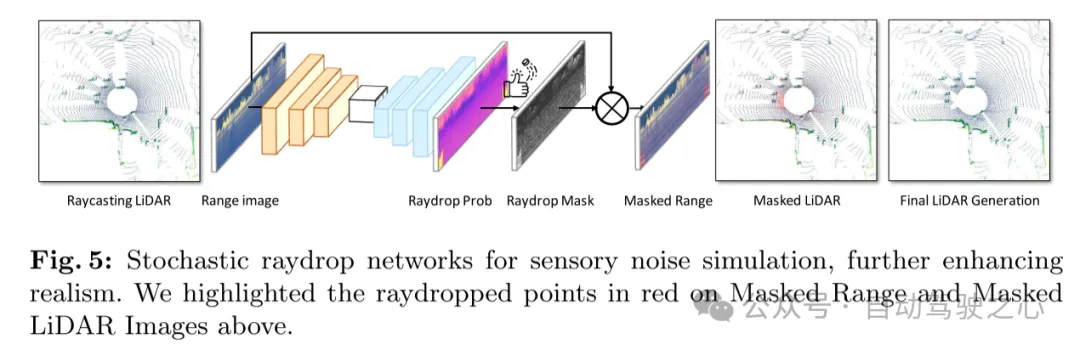

Abbildung 5: Zufälliges Raydrop-Netzwerk zur Simulation von Wahrnehmungsgeräuschen, was den Realismus weiter verbessert. In diesem Artikel werden durch Strahlen fallende Punkte in der maskierten Entfernungskarte und dem maskierten LIDAR-Bild oben rot hervorgehoben.

Experimentelle Ergebnisse:

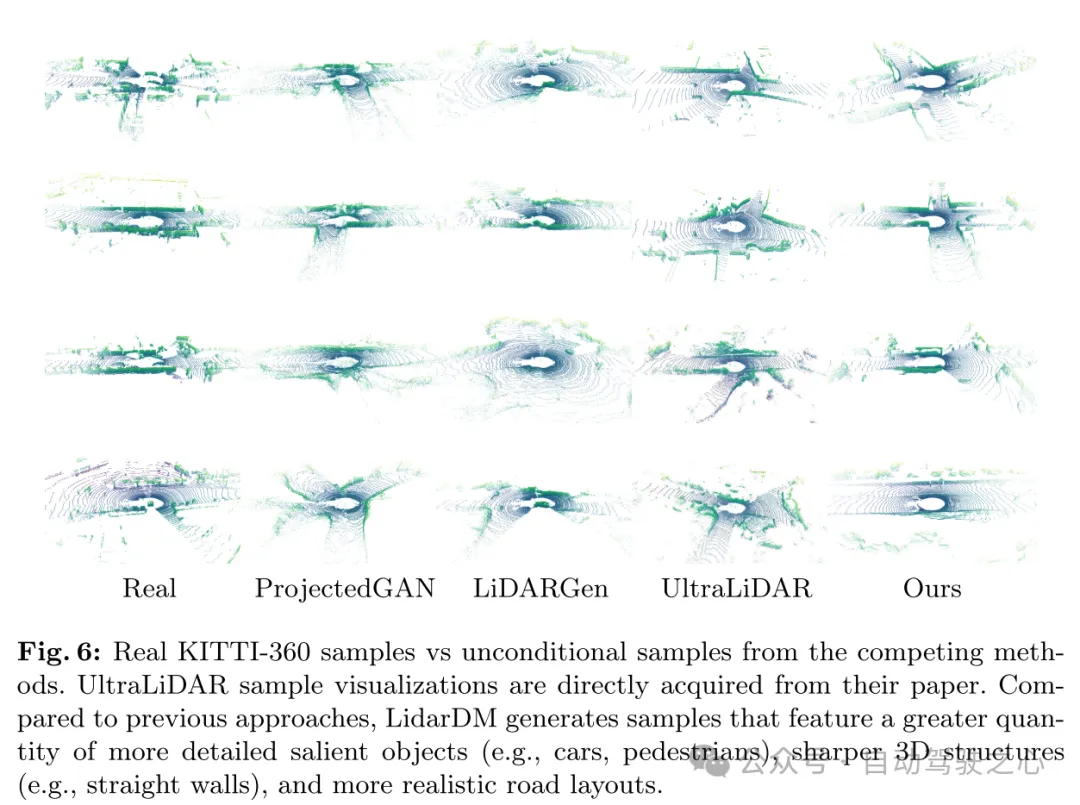

Abbildung 6: Echte KITTI-360-Proben im Vergleich zu unkonditionierten Proben konkurrierender Methoden. UltraLiDAR-Beispielvisualisierungen stammen direkt aus ihrer Arbeit. Im Vergleich zu früheren Methoden generiert LidarDM Stichproben mit einer größeren Anzahl detaillierterer markanter Objekte (z. B. Autos, Fußgänger), klareren 3D-Strukturen (z. B. geraden Wänden) und einem realistischeren Straßenlayout.

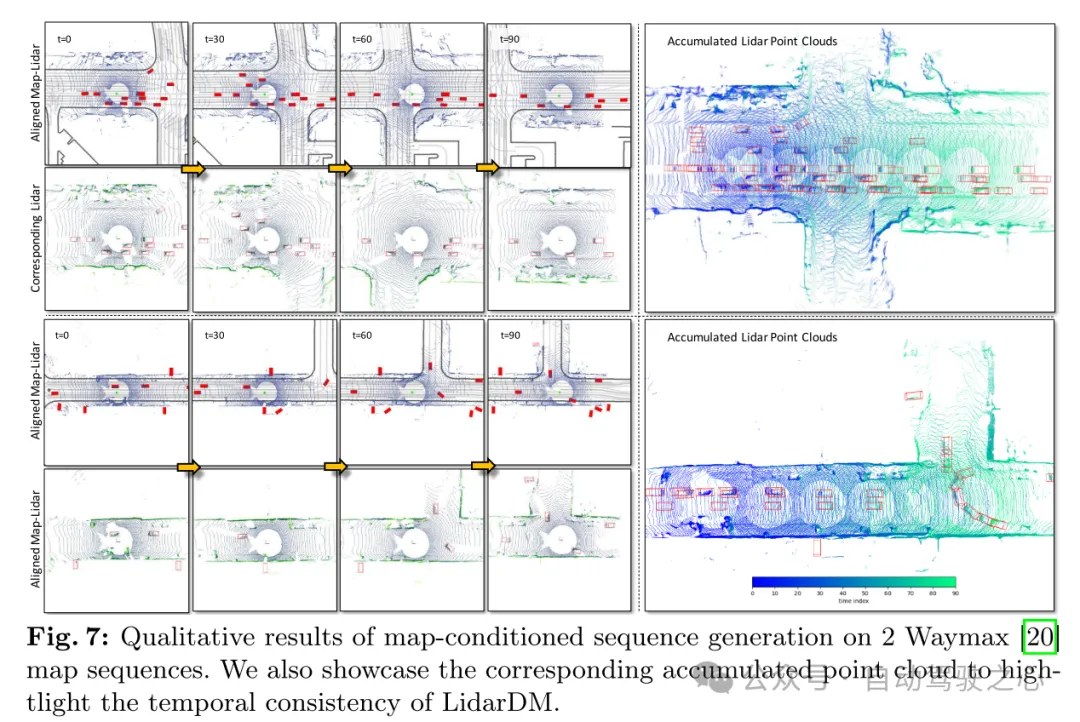

Abbildung 7: Qualitative Ergebnisse der kartenbedingten Sequenzgenerierung auf 2 Waymax [20]-Kartensequenzen. In diesem Artikel wird auch die entsprechende kumulative Punktwolke gezeigt, um die zeitliche Konsistenz von LidarDM hervorzuheben.

Zusammenfassung:

Dieses Papier schlägt LidarDM vor, ein neuartiges latentes Diffusionsmodell basierend auf Layoutbedingungen zur Erzeugung realistischer Lidar-Punktwolken. Unser Ansatz formuliert das Problem als eine gemeinsame Aufgabe zur Erstellung von 4D-Welten und zur Generierung von Wahrnehmungsdaten und entwickelt ein neuartiges latentes Diffusionsmodell zur Erstellung von 3D-Szenen. Das resultierende Punktwolkenvideo ist realistisch, kohärent und Layout-bewusst.

Das obige ist der detaillierte Inhalt vonNeue Ideen für die LiDAR-Simulation |. LidarDM: Hilft bei der Generierung einer 4D-Welt, Simulationskiller~. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Was sind die sechs am häufigsten verwendeten Befehle in Git?

- Was sind die Unterschiede zwischen Git und SVN?

- Das Diffusionsmodell explodiert. Dies ist die erste Überprüfung und Zusammenfassung von Github-Artikeln

- Bei der Bild- und Videogenerierung übertrifft das Sprachmodell erstmals das Diffusionsmodell, und der Tokenizer ist der Schlüssel

- Das Team von He Kaiming und Xie Saining verfolgte erfolgreich die Erforschung des Dekonstruktions-Diffusionsmodells und entwickelte schließlich den hochgelobten Autoencoder zur Rauschunterdrückung.