Technologie-Peripheriegeräte

Technologie-Peripheriegeräte KI

KI Google Cloud Database bietet weitere Funktionen für künstliche Intelligenz

Google Cloud Database bietet weitere Funktionen für künstliche IntelligenzGoogle Cloud Database bietet weitere Funktionen für künstliche Intelligenz

Google Cloud erweitert seine Analyse- und Transaktionsdatenbanken, darunter BigQuery, AlloyDB und Spanner, mit dem Ziel, die Entwicklung seiner kundengenerierten Anwendungen für künstliche Intelligenz voranzutreiben.

BigQuery ist der fortschrittliche Datenbankdienst von Google Cloud, der zur Unterstützung von Analysen und Aufgaben der künstlichen Intelligenz entwickelt wurde. Der Dienst führt mehrere Verbesserungen der künstlichen Intelligenz ein. Zunächst veröffentlichte Google Cloud eine Vorschauversion der Integration von BigQuery und Vertex AI, die sich auf Text- und Sprachfunktionen konzentrierte. Durch diese Integration können Benutzer wertvolle Erkenntnisse aus unstrukturierten Daten wie Bildern und Dokumenten gewinnen.

Das leistungsstärkste Modell der künstlichen Intelligenz des Unternehmens, Gemini, wurde BigQuery-Kunden über Vertex AI zur Verfügung gestellt. Das Modell löste letzte Woche einige Kontroversen aus, nachdem es auf dem Verbrauchermarkt kein herausragendes Debüt gegeben hatte.

Diese KI-Funktionen folgen der früheren Ankündigung von BigQuery zu Vektorsuchfunktionen. Die Vektorsuchfunktion in der Vorschau ist eine Schlüsselkomponente von GenAI-Anwendungen und unterstützt die Ähnlichkeitssuche und Retrieval-Augmented Generation (RAG) unter Verwendung großer Sprachmodelle.

Der direkte Zugriff auf Vertex AI in BigQuery bietet Google Cloud AI-Kunden in mehrfacher Hinsicht Benutzerfreundlichkeit, sagte Gerrit Kazmaier, General Manager und Vice President für Datenanalyse bei Google Cloud AI.

In der Pressekonferenz erwähnte Kazmaier, dass Sie als Datenanalyse-Praktiker über die SQL-Befehlszeile oder die in BigQuery eingebettete Python-API auf alle Vertex-KI-Modelle, einschließlich Gemini-Modelle, zugreifen können. Dies erleichtert den Zugriff auf diese Modelle, ohne auf einen Datenwissenschaftler oder eine Plattform für maschinelles Lernen angewiesen zu sein. Sie können mit den vorhandenen Daten direkt in Ihrem Arbeitsbereich darauf zugreifen. Das Aufkommen dieser neuen Technologie bringt mehr Möglichkeiten und Flexibilität in die Datenanalyse.

Kazmaier wies darauf hin, dass ein zweiter Vorteil der Integration der einfachere Zugriff auf die für KI-Modelle benötigten Daten sei. Vor der Integration erforderte die Übertragung von Daten an KI-Modelle häufig den Aufbau und die Wartung von Datenpipelines, um die Daten zu verschieben. Jetzt, sagt er, sei das nicht mehr nötig. „Alle komplizierten Verfahren wurden vereinfacht.“

In Vertex können Datenanalysten durch die Nutzung der Funktionen text- und bildbasierter künstlicher Intelligenzmodelle mehr Datenanalysevorteile durch BigQuery erzielen und den Kunden mehr Vorteile bieten.

„Dies eröffnet eine neue Phase der Szenarioanalyse.“ Er sagte, dass die Zusammenfassung, Emotionsextraktion, Klassifizierung, Konzentration und Übersetzung strukturierter und unstrukturierter Daten eine große Sache seien. Grob gesagt sind 90 % der Daten unstrukturiert. Diese Daten werden normalerweise nicht für die Analyse von Unternehmensdaten verwendet, da sie nicht sinnvoll verarbeitet werden können.

Auf der transaktionalen (oder betrieblichen) Seite kündigte Google Cloud die allgemeine Verfügbarkeit von AlloyDB AI an, der KI-spezifischen Version der gehosteten Postgres-Datenbank, die das Unternehmen letztes Jahr auf der Next 23-Konferenz angekündigt hatte. AlloyDB AI verfügt über die Fähigkeit, Vektoreinbettungen zu speichern und Vektorsuchfunktionen auszuführen, was Google Cloud als eine Kernkomponente der GenAI-Anwendungsfälle seiner Kunden betrachtet.

Google Cloud hat außerdem eine neue Integration mit LangChain eingeführt, einem beliebten Open-Source-Framework, das dabei hilft, Kundendaten in große Sprachmodelle (LLMs) zu integrieren. Andi Gutmans, General Manager und Vizepräsident für Datenbanken bei Google Cloud, sagte, dass alle Google Cloud-Datenbanken in LangChain integriert werden.

Gutmans sagte, die neuen Funktionen seien eine Reaktion auf die Nachfrage der Kunden, einen Weg zu finden, mehr GenAI-Wert aus ihren Daten zu ziehen.

Das Unternehmen kündigte außerdem an, dass es Vektorsuchfunktionen zu anderen Datenbanken hinzufügen wird, die in seiner Cloud für Kunden gehostet werden, darunter Redis und MySQL. Cloud Spanner, Firestore und Bigtable werden ebenfalls Vektorfähigkeiten erhalten, sagte Gutmans.

„Das Besondere an Spanner ist, dass es über die Möglichkeit zur Suche nach nächsten Nachbarn verfügt, was eine etwas andere Variante ist“, sagte Gutmans. „Was wirklich spannend ist, sind die Kunden, die wirklich große Anwendungsfälle haben – z. B. Billionen von Vektoren.“ als Höhenpartitionierung basierend auf Benutzern. Sie können sich vorstellen, dass einige der internen Anwendungen von Google nach Benutzern partitioniert sind – sie werden in der Lage sein, Vektoren im Maßstab von Billionen (Vektoren) zu speichern und zu durchsuchen“, sagte er. : „Wir glauben, dass jede Datenbank Jeder Ort, an dem Betriebsdaten gespeichert werden, die Sie in einem GenAI-Anwendungsfall benötigen, sollte auch über Vektorfunktionen verfügen.“ Behalten Sie einfach die Grundfunktionalität der Datenbank bei.“

Das obige ist der detaillierte Inhalt vonGoogle Cloud Database bietet weitere Funktionen für künstliche Intelligenz. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Wie fahre ich LLM lokal mit LM Studio aus? - Analytics VidhyaApr 19, 2025 am 11:38 AM

Wie fahre ich LLM lokal mit LM Studio aus? - Analytics VidhyaApr 19, 2025 am 11:38 AMMühelos großes Sprachmodelle zu Hause ausführen: LM Studio Benutzerhandbuch In den letzten Jahren haben Fortschritte in Software und Hardware es ermöglicht, große Sprachmodelle (LLMs) auf PCs durchzuführen. LM Studio ist ein hervorragendes Werkzeug, um diesen Prozess einfach und bequem zu machen. In diesem Artikel wird in LM Studio in LLM ausgelöst, wobei wichtige Schritte, mögliche Herausforderungen und die Vorteile von LLM vor Ort abdecken. Egal, ob Sie ein Technikbegeisterter sind oder neugierig auf die neuesten KI -Technologien sind, dieser Leitfaden bietet wertvolle Erkenntnisse und praktische Tipps. Fangen wir an! Überblick Verstehen Sie die grundlegenden Anforderungen für die lokale Ausführung von LLM. Richten Sie LM Studi auf Ihrem Computer ein

Guy Peri hilft bei der Zukunft von McCormick durch DatenumwandlungApr 19, 2025 am 11:35 AM

Guy Peri hilft bei der Zukunft von McCormick durch DatenumwandlungApr 19, 2025 am 11:35 AMGuy Peri ist McCormicks Chief Information und Digital Officer. Obwohl Peri nur sieben Monate nach seiner Rolle eine umfassende Transformation der digitalen Fähigkeiten des Unternehmens vorantreibt. Sein beruflicher Fokus auf Daten und Analysen informiert

Was ist die Kette von Emotionen in der schnellen Ingenieurwesen? - Analytics VidhyaApr 19, 2025 am 11:33 AM

Was ist die Kette von Emotionen in der schnellen Ingenieurwesen? - Analytics VidhyaApr 19, 2025 am 11:33 AMEinführung Künstliche Intelligenz (KI) entwickelt sich, um nicht nur Wörter, sondern auch Emotionen zu verstehen und mit einer menschlichen Berührung zu reagieren. Diese anspruchsvolle Interaktion ist im schnell vorrückenden Bereich der KI und der Verarbeitung natürlicher Sprache von entscheidender Bedeutung. Th

12 Beste KI -Tools für den Datenwissenschafts -Workflow - Analytics VidhyaApr 19, 2025 am 11:31 AM

12 Beste KI -Tools für den Datenwissenschafts -Workflow - Analytics VidhyaApr 19, 2025 am 11:31 AMEinführung In der heutigen datenzentrierten Welt ist die Nutzung fortschrittlicher KI-Technologien für Unternehmen, die einen Wettbewerbsvorteil und eine verbesserte Effizienz suchen, von entscheidender Bedeutung. Eine Reihe leistungsstarker Tools ermöglichen Datenwissenschaftlern, Analysten und Entwicklern, aufzubauen, zu erschrecken

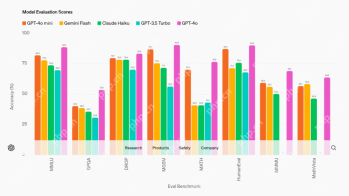

AV-Byte: OpenAIs GPT-4O-Mini und andere KI-InnovationenApr 19, 2025 am 11:30 AM

AV-Byte: OpenAIs GPT-4O-Mini und andere KI-InnovationenApr 19, 2025 am 11:30 AMDie KI -Landschaft dieser Woche explodierte mit bahnbrechenden Veröffentlichungen von Branchengiganten wie Openai, Mistral AI, Nvidia, Deepseek und Umarmungsgesicht. Diese neuen Modelle versprechen eine erhöhte Leistung, Erschwinglichkeit und Zugänglichkeit, die durch Fortschritte in TR angeheizt werden

Die Android -App der Verwirrung ist mit Sicherheitsfehler befallen, BerichtsfundeApr 19, 2025 am 11:24 AM

Die Android -App der Verwirrung ist mit Sicherheitsfehler befallen, BerichtsfundeApr 19, 2025 am 11:24 AMDie Android -App des Unternehmens, die nicht nur Suchfunktionen bietet, sondern auch als KI -Assistent fungiert, ist jedoch mit einer Vielzahl von Sicherheitsproblemen, die seine Benutzer Datendiebstahl, Übernahmen und Identitätsangriffe von böswilligen Angriffen aussetzen könnten

Jeder kann besser KI verwenden: Gedanken zur Stimmung codierenApr 19, 2025 am 11:17 AM

Jeder kann besser KI verwenden: Gedanken zur Stimmung codierenApr 19, 2025 am 11:17 AMSie können sich ansehen, was auf Konferenzen und Handelsshows passiert. Sie können Ingenieure fragen, was sie tun, oder sich mit einem CEO wenden. Überall, wo Sie aussehen, ändern sich die Dinge mit brezdemschneller Geschwindigkeit. Ingenieure und Nicht-Ingenieure Was ist der Unterschied?

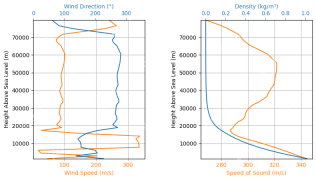

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics VidhyaApr 19, 2025 am 11:12 AM

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics VidhyaApr 19, 2025 am 11:12 AMSimulieren Raketenstarts mit Rocketpy: Eine umfassende Anleitung Dieser Artikel führt Sie durch die Simulation von Rocketpy-Starts mit hoher Leistung mit Rocketpy, einer leistungsstarken Python-Bibliothek. Wir werden alles abdecken, von der Definition von Raketenkomponenten bis zur Analyse von Simula

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

PHPStorm Mac-Version

Das neueste (2018.2.1) professionelle, integrierte PHP-Entwicklungstool

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

SAP NetWeaver Server-Adapter für Eclipse

Integrieren Sie Eclipse mit dem SAP NetWeaver-Anwendungsserver.

EditPlus chinesische Crack-Version

Geringe Größe, Syntaxhervorhebung, unterstützt keine Code-Eingabeaufforderungsfunktion

DVWA

Damn Vulnerable Web App (DVWA) ist eine PHP/MySQL-Webanwendung, die sehr anfällig ist. Seine Hauptziele bestehen darin, Sicherheitsexperten dabei zu helfen, ihre Fähigkeiten und Tools in einem rechtlichen Umfeld zu testen, Webentwicklern dabei zu helfen, den Prozess der Sicherung von Webanwendungen besser zu verstehen, und Lehrern/Schülern dabei zu helfen, in einer Unterrichtsumgebung Webanwendungen zu lehren/lernen Sicherheit. Das Ziel von DVWA besteht darin, einige der häufigsten Web-Schwachstellen über eine einfache und unkomplizierte Benutzeroberfläche mit unterschiedlichen Schwierigkeitsgraden zu üben. Bitte beachten Sie, dass diese Software