Heim >Technologie-Peripheriegeräte >KI >Gemischte Stile von Yang Mi und Taylor: Xiaohongshu AI bringt SD- und ControlNet-geeignete Stile auf den Markt

Gemischte Stile von Yang Mi und Taylor: Xiaohongshu AI bringt SD- und ControlNet-geeignete Stile auf den Markt

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2024-01-18 17:15:251437Durchsuche

Ich muss sagen, das Fotografieren ist jetzt wirklich „so einfach, dass es lächerlich ist“.

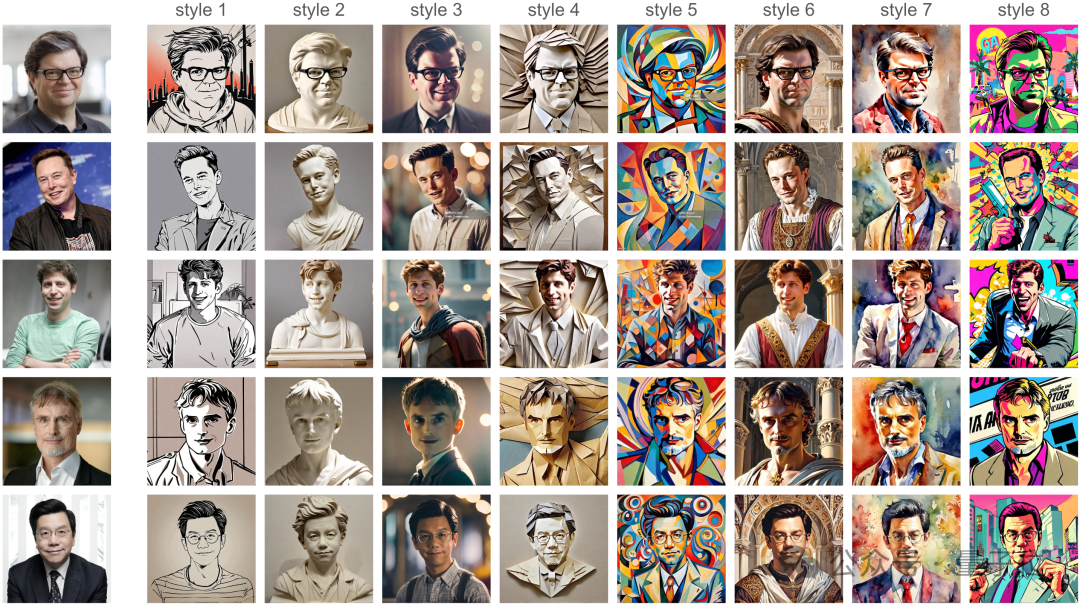

Eine echte Person muss nicht vor der Kamera erscheinen und muss sich nicht um Pose oder Frisur kümmern. Sie brauchen nur ein Bild von sich selbst, warten ein paar Sekunden, und Sie können 7 völlig unterschiedliche Stile erhalten:

Schauen Sie genau hin, die Form/Pose. Alles ist klar für Sie erledigt und das Originalbild kommt sofort heraus, sodass keine Bearbeitung erforderlich ist.

Vorher dürfen wir nicht mindestens einen ganzen Tag im Fotostudio verbringen, das würde uns, den Fotografen und den Visagisten fast erschöpfen.

Das Obige ist die Leistung einer KI namens InstantID.

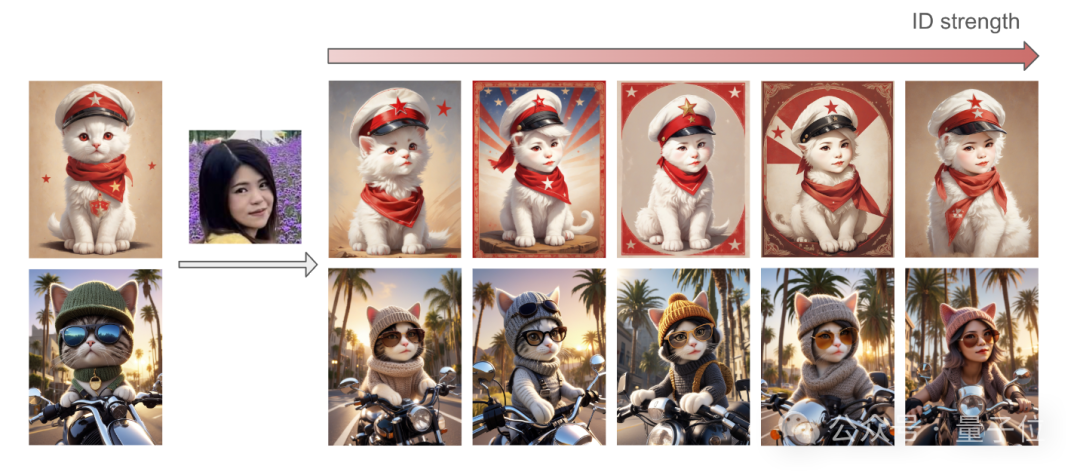

Neben realistischen Fotos kann es auch „nicht menschlich“ sein:

Zum Beispiel hat es einen Katzenkopf und -körper, aber wenn man genau hinschaut, hat es Ihre Gesichtszüge.

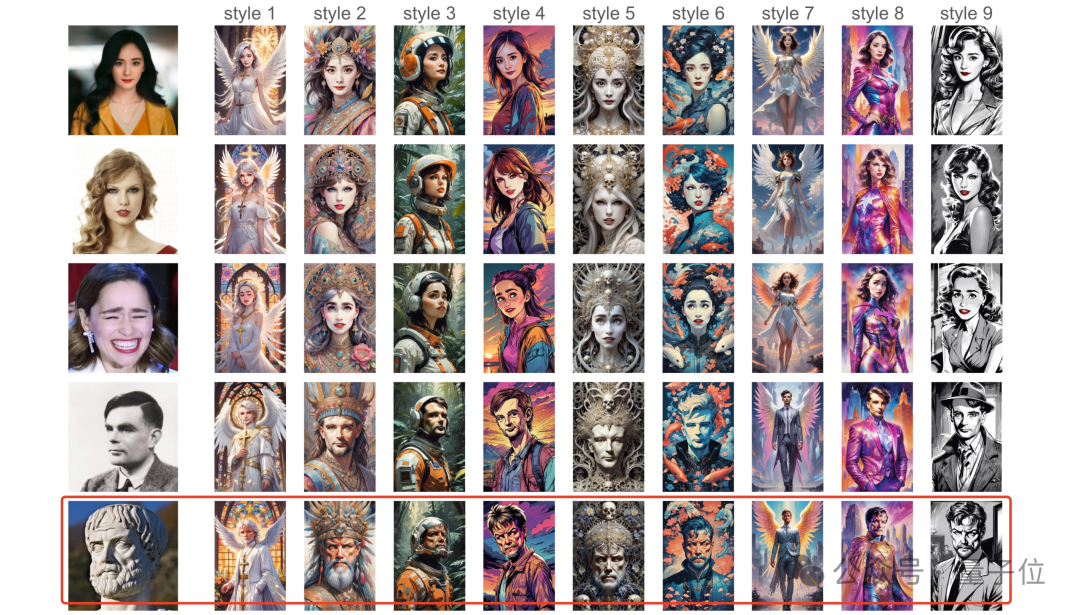

Ganz zu schweigen von den verschiedenen virtuellen Stilen:

Wie bei Stil 2 verwandelt sich eine reale Person direkt in eine Steinstatue.

Natürlich kann die Eingabe einer Steinstatue sie auch direkt in Folgendes verwandeln:

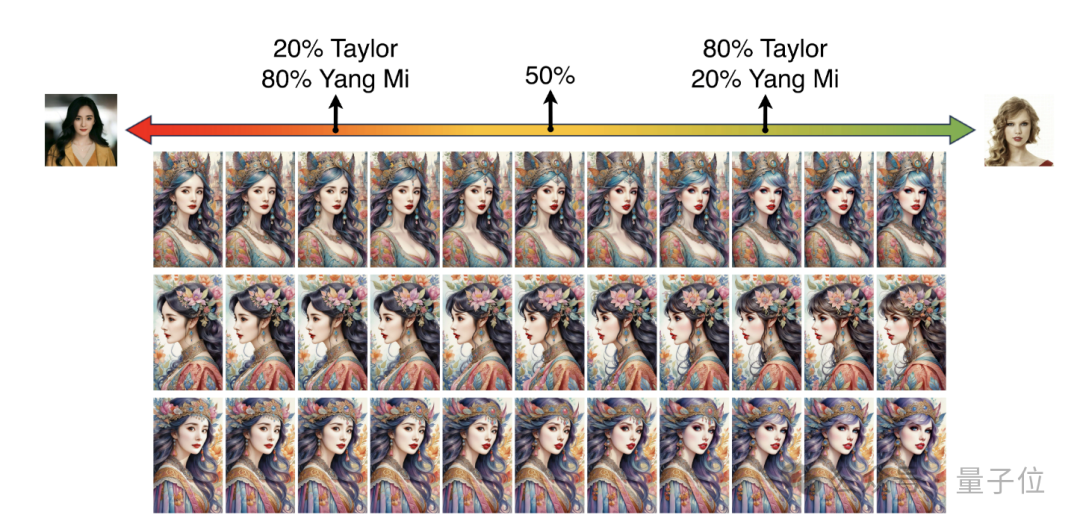

Übrigens können Sie auch die Hochleistungsoperation „Zwei Gesichter verschmelzen“ durchführen. Sehen Sie, was 20 % von Yang Mi + sind 80 % von Taylor sehen aus wie:

Ein Bild hat unbegrenzte hochwertige Transformationen, aber man muss es herausfinden.

Ein Bild hat unbegrenzte hochwertige Transformationen, aber man muss es herausfinden.

Also, wie geht das?

Basiert auf dem Diffusionsmodell und kann nahtlos in SD integriert werden

Der Autor stellte vor, dass die aktuelle Bildstilisierungstechnologie die Aufgabe bereits mit nur einer Vorwärtsinferenz erledigen kann

(d. h. basierend auf ID-Einbettung). Aber diese Technologie hat auch Probleme: Sie erfordert entweder eine umfassende Feinabstimmung zahlreicher Modellparameter, ist nicht mit von der Community entwickelten vorab trainierten Modellen kompatibel oder kann keine hochauflösenden Gesichtszüge beibehalten.

Um diese Herausforderungen zu lösen, haben sie InstantID entwickelt.

InstantID basiert auf dem Diffusionsmodell und sein Plug-and-Play-Modul kann verschiedene stilisierte Transformationen mit nur einem einzigen Gesichtsbild gekonnt verarbeiten und dabei eine hohe Wiedergabetreue gewährleisten.

Das Bemerkenswerteste ist, dass es nahtlos in gängige vorab trainierte Text-zu-Bild-Diffusionsmodelle (wie SD1.5, SDXL) integriert und als Plug-In verwendet werden kann.

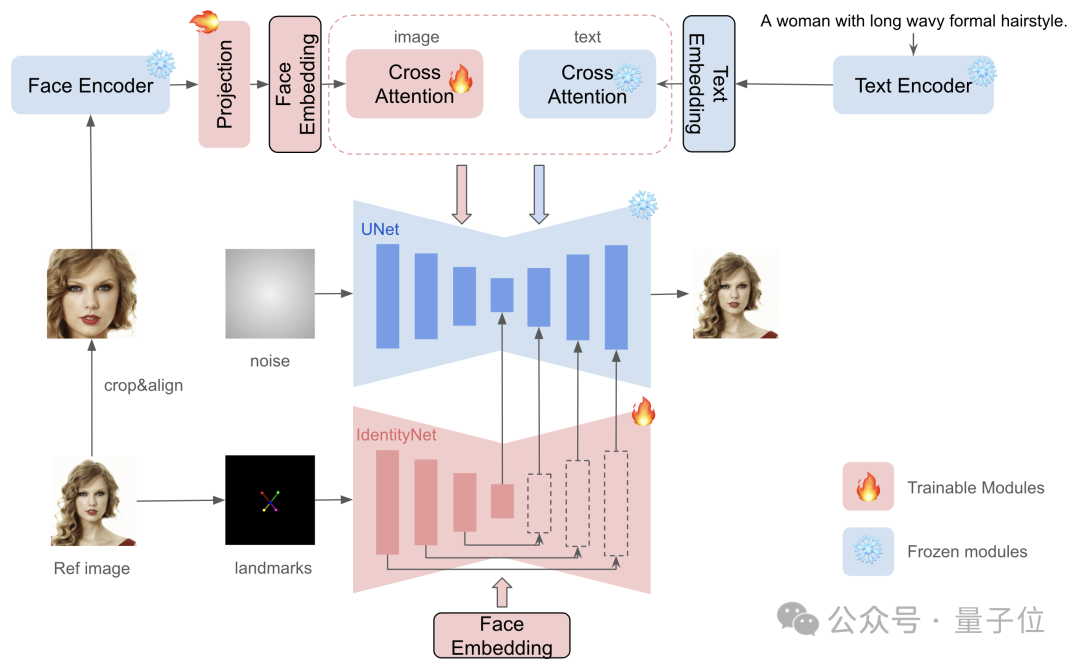

Im Einzelnen besteht InstantID aus drei Schlüsselkomponenten: (1) ID-Einbettung, die robuste semantische Gesichtsinformationen erfasst;

(2) Ein leichtes Anpassungsmodul mit entkoppelter Kreuzaufmerksamkeit, das praktische Bilder als visuelle Hinweise bietet; (3) IdentityNet-Netzwerk, das detaillierte Merkmale des Referenzbilds durch zusätzliche räumliche Kontrolle codiert und letztendlich die Bildgenerierung vervollständigt.

Im Vergleich zu früheren Arbeiten in der Branche weist InstantID mehrere Unterschiede auf: Erstens besteht keine Notwendigkeit, UNet zu trainieren, sodass die Generierungsfähigkeit des ursprünglichen Text-zu-Bild-Modells beibehalten werden kann, und das ist auch der Fall kompatibel mit vorhandenen vorab trainierten Modellen und Modellen in der ControlNet. Zweitens ist keine Testzeitanpassung erforderlich, sodass für einen bestimmten Stil nicht mehrere Bilder zur Feinabstimmung gesammelt werden müssen und nur eine Schlussfolgerung für ein einzelnes Bild gezogen werden muss.

Zweitens ist keine Testzeitanpassung erforderlich, sodass für einen bestimmten Stil nicht mehrere Bilder zur Feinabstimmung gesammelt werden müssen und nur eine Schlussfolgerung für ein einzelnes Bild gezogen werden muss.

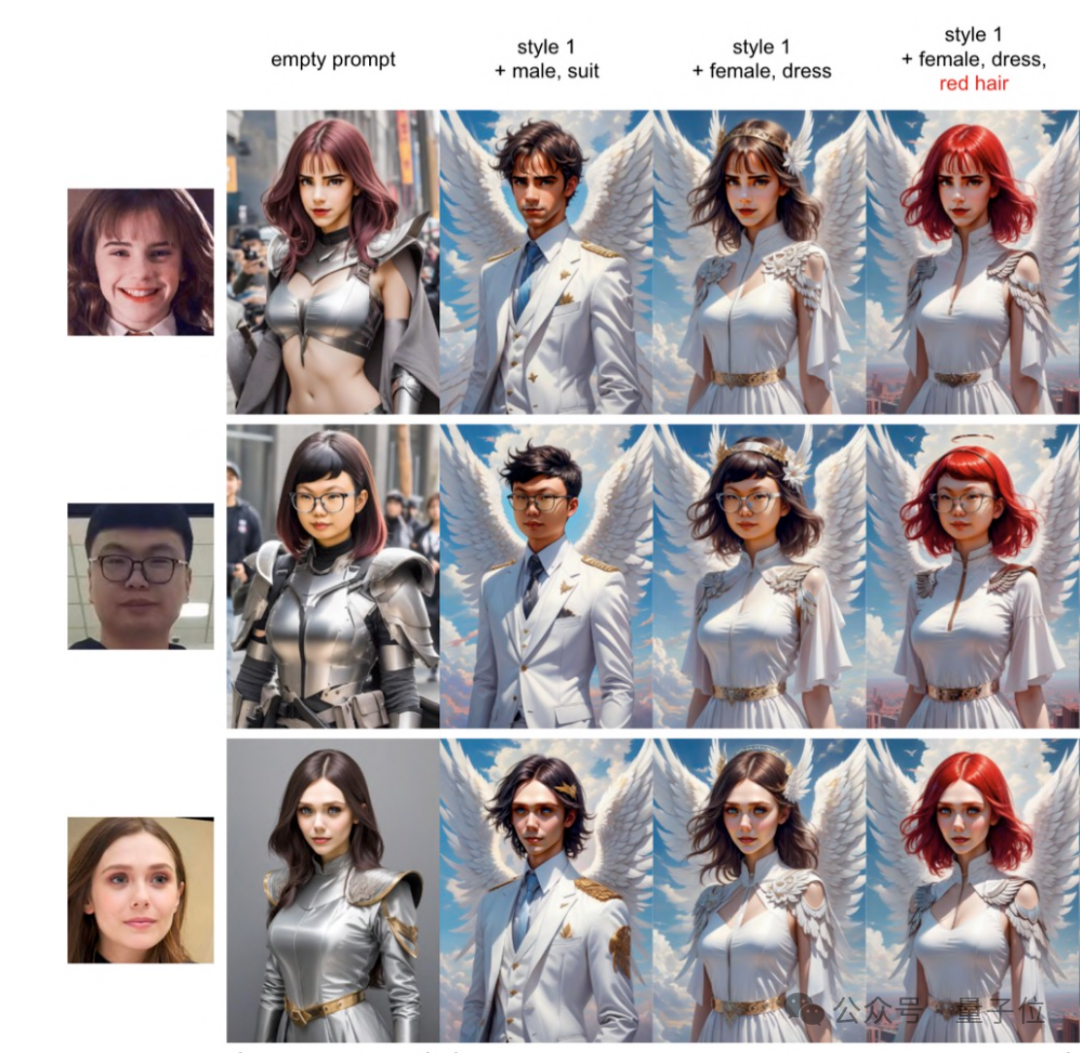

Drittens wird nicht nur eine bessere Gesichtstreue erreicht, sondern auch die Bearbeitbarkeit des Textes beibehalten. Wie im Bild unten gezeigt, können Sie mit nur wenigen Worten das Geschlecht des Bildes, den Anzug, die Frisur und die Haarfarbe ändern.

Noch einmal: Alle oben genannten Effekte können in wenigen Sekunden mit nur einem Referenzbild abgeschlossen werden. Wie das Experiment unten zeigt, ein paar weitere Referenzbilder nützen wenig und man kann gute Arbeit leisten

ein paar weitere Referenzbilder nützen wenig und man kann gute Arbeit leisten

.

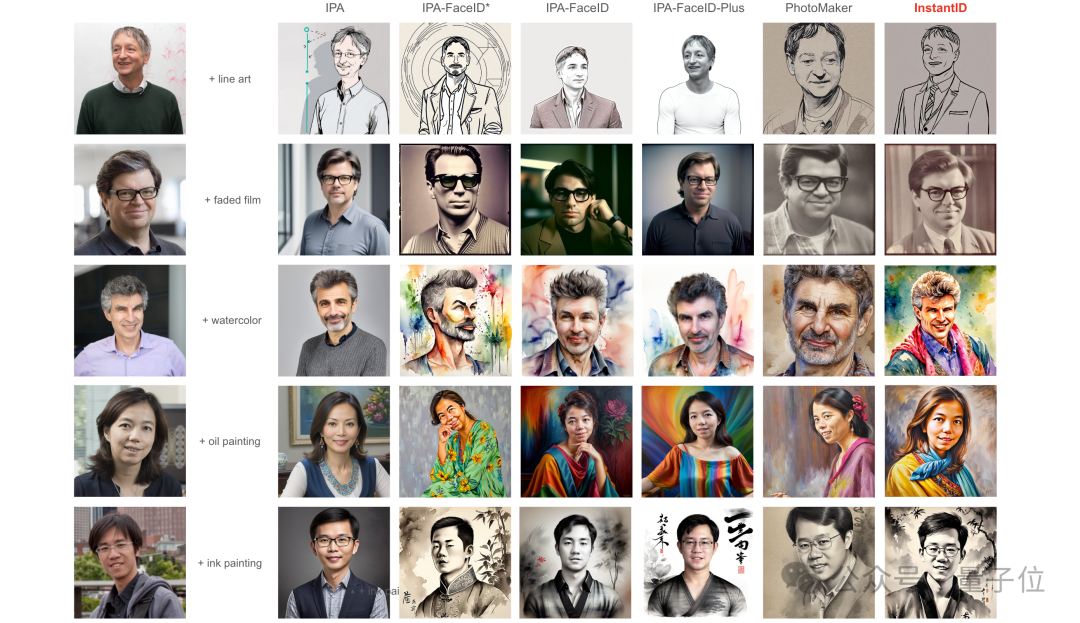

Hier einige konkrete Vergleiche.

Die Vergleichsobjekte sind die vorhandenen optimierungsfreien SOTA-Methoden: IP-Adapter (IPA), IP-Adapter-FaceID und PhotoMaker, der erst vor zwei Tagen von Tencent veröffentlicht wurde.

Sie können sehen, dass alle ziemlich „lautstark“ sind und der Effekt nicht schlecht ist – aber wenn man sie genau vergleicht, haben PhotoMaker und IP-Adapter-FaceID beide eine gute Wiedergabetreue, aber ihre Textsteuerungsfunktionen sind offensichtlich schlechter.

Im Gegensatz dazu harmonieren die Gesichter und Stile von InstantID besser und erzielen eine bessere Wiedergabetreue bei gleichzeitig guter Textbearbeitbarkeit.

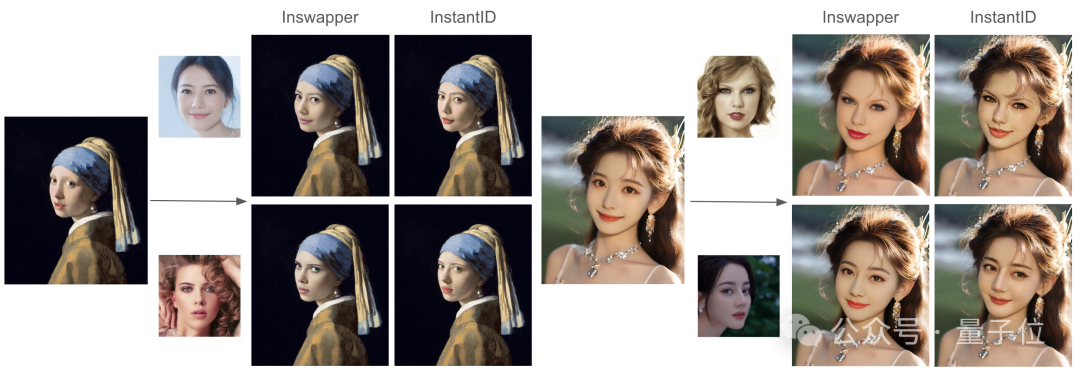

Darüber hinaus gibt es auch einen Vergleich mit dem InsightFace Swapper-Modell. Welches ist Ihrer Meinung nach besser?

Vorstellung des Autors

In diesem Artikel gibt es 5 Autoren vom mysteriösen InstantX-Team (nicht viele Informationen sind online zu finden).

Aber einer davon ist Qixun Wang aus Little Red Book.

Der korrespondierende Autor Wang Haofan ist ebenfalls Ingenieur bei Xiaohongshu. Er beschäftigt sich mit der Forschung zur kontrollierbaren und bedingten Inhaltsgenerierung (AIGC) und ist ein CMU’20-Alumnus.

Das obige ist der detaillierte Inhalt vonGemischte Stile von Yang Mi und Taylor: Xiaohongshu AI bringt SD- und ControlNet-geeignete Stile auf den Markt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!