Heim >Technologie-Peripheriegeräte >KI >Interpretation verschiedener Codebeispiele für maschinelles Lernen: Erklärung mit LIME

Interpretation verschiedener Codebeispiele für maschinelles Lernen: Erklärung mit LIME

- PHPznach vorne

- 2023-11-06 11:13:011158Durchsuche

Modelle für maschinelles Lernen werden immer ausgefeilter und genauer, ihre Undurchsichtigkeit bleibt jedoch eine große Herausforderung. Um Vertrauen aufzubauen und sicherzustellen, dass es sich wie erwartet verhält, ist es wichtig zu verstehen, warum ein Modell eine bestimmte Vorhersage trifft. In diesem Artikel stellen wir LIME vor und erklären damit verschiedene gängige Modelle.

LIME

Eine leistungsstarke Python-Bibliothek LIME (Local Interpretable Model-agnostic Explanations) kann dabei helfen, das Verhalten von Klassifikatoren (oder Modellen) für maschinelles Lernen zu erklären. Der Hauptzweck von LIME besteht darin, interpretierbare, für Menschen lesbare Erklärungen für einzelne Vorhersagen bereitzustellen, insbesondere für komplexe Modelle des maschinellen Lernens. Durch die Bereitstellung eines detaillierten Verständnisses der Funktionsweise dieser Modelle fördert LIME das Vertrauen in Systeme des maschinellen Lernens. LIME löst dieses Problem, indem es lokale Erklärungen für bestimmte Fälle erstellt, wodurch es für Benutzer einfacher wird, Modelle für maschinelles Lernen zu verstehen und ihnen zu vertrauen.

Untersuchen Sie einzelne Prognosen, um mögliche Verzerrungen und Fehler im Modell zu identifizieren.

Untersuchen Sie einzelne Prognosen, um mögliche Verzerrungen und Fehler im Modell zu identifizieren.

Verbessern Sie die Modellleistung, indem Sie die Funktionen verstehen, die zu genauen Vorhersagen beitragen.

Sorgen Sie für Transparenz und Erklärbarkeit, um das Vertrauen der Benutzer in maschinelle Lernsysteme zu stärken.

- LIME funktioniert durch die Annäherung komplexer ML-Modelle an ein einfacheres, lokal interpretierbares Modell, das um eine bestimmte Instanz herum aufgebaut ist. Die Hauptschritte des LIME-Workflows lassen sich in folgende Schritte unterteilen:

- Wählen Sie die zu erklärende Instanz aus.

- Stören Sie Instanzen, indem Sie einen Satz benachbarter Samples generieren.

- Verwenden Sie komplexe ML-Modelle, um Vorhersagen für gestörte Stichproben zu erhalten.

Passen Sie ein einfacheres, interpretierbares Modell (z. B. lineare Regression oder Entscheidungsbaum) an die gestörte Stichprobe und ihre Vorhersagen an.

- Erklären Sie einfachere Modelle, die Erklärungen für Originalbeispiele liefern.

- LIME in verschiedenen Modellen verwenden

- Bevor Sie LIME verwenden, müssen Sie es installieren. LIME kann mit dem pip-Befehl installiert werden:

-

pip install lime

1. Klassifizierungsmodell - Um LIME mit einem Klassifizierungsmodell zu verwenden, müssen Sie ein Interpreterobjekt erstellen und dann eine Erklärung für eine bestimmte Instanz generieren. Das Folgende ist ein einfaches Beispiel für die Verwendung der LIME-Bibliothek und des Klassifizierungsmodells:

# Classification- Lime import lime import lime.lime_tabular from sklearn import datasets from sklearn.ensemble import RandomForestClassifier # Load the dataset and train a classifier data = datasets.load_iris() classifier = RandomForestClassifier() classifier.fit(data.data, data.target) # Create a LIME explainer object explainer = lime.lime_tabular.LimeTabularExplainer(data.data, mode="classification", training_labels=data.target, feature_names=data.feature_names, class_names=data.target_names, discretize_cnotallow=True) # Select an instance to be explained (you can choose any index) instance = data.data[0] # Generate an explanation for the instance explanation = explainer.explain_instance(instance, classifier.predict_proba, num_features=5) # Display the explanation explanation.show_in_notebook()

2. Regressionsmodell

Die Verwendung von LIME zur Erläuterung des Regressionsmodells ähnelt der Verwendung von LIME zur Erläuterung des Klassifizierungsmodells . Für eine bestimmte Instanz muss ein Interpreterobjekt erstellt und eine Interpretation generiert werden. Hier ist ein Beispiel unter Verwendung der LIME-Bibliothek und eines Regressionsmodells: #Regression - Lime import numpy as np from sklearn.model_selection import train_test_split from sklearn.linear_model import LinearRegression from lime.lime_tabular import LimeTabularExplainer # Generate a custom regression dataset np.random.seed(42) X = np.random.rand(100, 5) # 100 samples, 5 features y = 2 * X[:, 0] + 3 * X[:, 1] + 1 * X[:, 2] + np.random.randn(100) # Linear regression with noise # Split the data into training and testing sets X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) # Train a simple linear regression model model = LinearRegression() model.fit(X_train, y_train) # Initialize a LimeTabularExplainer explainer = LimeTabularExplainer(training_data=X_train, mode="regression") # Select a sample instance for explanation sample_instance = X_test[0] # Explain the prediction for the sample instance explanation = explainer.explain_instance(sample_instance, model.predict) # Print the explanation explanation.show_in_notebook()

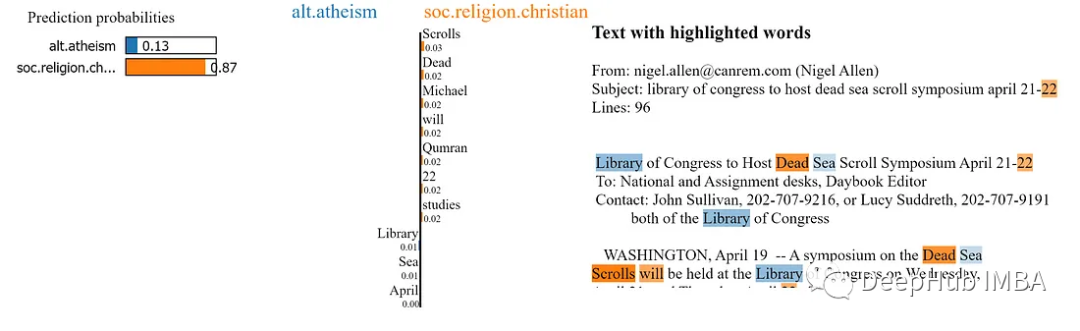

3. Text erklären

LIME kann auch zur Erklärung von Vorhersagen verwendet werden, die von Textmodellen gemacht werden. Um LIME mit einem Textmodell zu verwenden, müssen Sie ein LIME-Textinterpreterobjekt erstellen und dann eine Interpretation für eine bestimmte Instanz generieren. Das Folgende ist ein Beispiel für die Verwendung der LIME-Bibliothek und des Textmodells: # Text Model - Lime import lime import lime.lime_text from sklearn.feature_extraction.text import TfidfVectorizer from sklearn.naive_bayes import MultinomialNB from sklearn.datasets import fetch_20newsgroups # Load a sample dataset (20 Newsgroups) for text classification categories = ['alt.atheism', 'soc.religion.christian'] newsgroups_train = fetch_20newsgroups(subset='train', categories=categories) # Create a simple text classification model (Multinomial Naive Bayes) tfidf_vectorizer = TfidfVectorizer() X_train = tfidf_vectorizer.fit_transform(newsgroups_train.data) y_train = newsgroups_train.target classifier = MultinomialNB() classifier.fit(X_train, y_train) # Define a custom Lime explainer for text data explainer = lime.lime_text.LimeTextExplainer(class_names=newsgroups_train.target_names) # Choose a text instance to explain text_instance = newsgroups_train.data[0] # Create a predict function for the classifier predict_fn = lambda x: classifier.predict_proba(tfidf_vectorizer.transform(x)) # Explain the model's prediction for the chosen text instance explanation = explainer.explain_instance(text_instance, predict_fn) # Print the explanation explanation.show_in_notebook()

4. Bildmodell

LIME kann verwendet werden, um die Vorhersageergebnisse des Bildmodells zu erklären. Sie müssen ein LIME-Bildinterpreterobjekt erstellen und eine Erklärung für eine bestimmte Instanz generieren. import lime import lime.lime_image import sklearn # Load the dataset and train an image classifier data = sklearn.datasets.load_digits() classifier = sklearn.ensemble.RandomForestClassifier() classifier.fit(data.images.reshape((len(data.images), -1)), data.target) # Create a LIME image explainer object explainer = lime.lime_image.LimeImageExplainer() # Select an instance to be explained instance = data.images[0] # Generate an explanation for the instance explanation = explainer.explain_instance(instance, classifier.predict_proba, top_labels=5)

Interpretation der Ausgabe von LIME. Nachdem Sie LIME zum Generieren der Erklärung verwendet haben, können Sie die Erklärung visualisieren, um den Beitrag jeder einzelnen Instanz zu verstehen Funktion zur Vorhersage. Für tabellarische Daten können Sie die Methoden show_in_notebook oder as_pyplot_figure verwenden, um Erklärungen anzuzeigen. Für Text- und Bilddaten können Sie die Methode show_in_notebook verwenden, um Notizen anzuzeigen.

Indem wir den Beitrag jedes Features verstehen, können wir ein tieferes Verständnis des Entscheidungsprozesses des Modells erlangen und potenzielle Vorurteile oder Problembereiche identifizieren.

LIME bietet einige fortgeschrittene Techniken zur Verbesserung der Qualität von Erklärungen, diese Techniken Dazu gehören:

Anpassen der Anzahl gestörter Proben: Durch Erhöhen der Anzahl gestörter Proben kann die Stabilität und Genauigkeit der Interpretation verbessert werden.

Wählen Sie ein interpretierbares Modell: Die Auswahl eines geeigneten interpretierbaren Modells (z. B. lineare Regression, Entscheidungsbaum) beeinflusst die Qualität der Erklärung.

Funktionsauswahl: Durch Anpassen der Anzahl der in der Erklärung verwendeten Funktionen können Sie sich auf die wichtigsten Beiträge zu Vorhersagen konzentrieren.

LIME-Einschränkungen und Alternativen

Obwohl LIME ein leistungsstarkes Werkzeug zur Interpretation von Modellen für maschinelles Lernen ist, weist es auch einige Einschränkungen auf:

Lokale Interpretation: LIME konzentriert sich auf die lokale Interpretation, die möglicherweise nicht das Gesamtverhalten des Modells erfasst.

Kostspielig: Das Generieren von Erklärungen mithilfe von LIME kann zeitaufwändig sein, insbesondere bei großen Datensätzen und komplexen Modellen.

Wenn LIME Ihren Anforderungen nicht entspricht, gibt es andere Möglichkeiten, Modelle für maschinelles Lernen zu erklären, z. B. SHAP ( SHApley Additive ExPlanations) und Anker.

Zusammenfassung

LIME ist ein wertvolles Werkzeug, um zu erklären, was ein Klassifikator (oder Modell) für maschinelles Lernen tut. Indem LIME eine praktische Möglichkeit zum Verständnis komplexer Modelle für maschinelles Lernen bietet, ermöglicht es Benutzern, ihren Systemen zu vertrauen und sie zu verbessern.

Durch die Bereitstellung interpretierbarer Erklärungen für einzelne Vorhersagen kann LIME dazu beitragen, Vertrauen in Modelle für maschinelles Lernen aufzubauen. Diese Art von Vertrauen ist in vielen Branchen von entscheidender Bedeutung, insbesondere wenn ML-Modelle zur Entscheidungsfindung eingesetzt werden. Durch ein besseres Verständnis der Funktionsweise ihrer Modelle können sich Benutzer sicher auf maschinelle Lernsysteme verlassen und datengesteuerte Entscheidungen treffen.

Das obige ist der detaillierte Inhalt vonInterpretation verschiedener Codebeispiele für maschinelles Lernen: Erklärung mit LIME. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Die 10 wichtigsten Algorithmen für maschinelles Lernen, die Sie kennen müssen

- SublimeText3-Python-Eingabeaufforderungen zur automatischen Vervollständigung

- Tipps zur Verwendung von Sublime Text3 (Installation und allgemeine Einstellungen)

- Wie künstliche Intelligenz und maschinelles Lernen die Zukunft des Gesundheitswesens beeinflussen werden

- So verwenden Sie die Scikit-Learn-Bibliothek für maschinelles Lernen in Python.