Heim >Technologie-Peripheriegeräte >KI >Vom einzelnen Gegner zum vielfältigen Gegner: CVPR 2023 untersucht verallgemeinerbare, vielfältige gegnerische Angriffe

Vom einzelnen Gegner zum vielfältigen Gegner: CVPR 2023 untersucht verallgemeinerbare, vielfältige gegnerische Angriffe

- 王林nach vorne

- 2023-08-30 21:13:07955Durchsuche

Ist das Gesichtserkennungssystem, das angeblich eine Genauigkeit von 99 % hat, wirklich unzerbrechlich? Tatsächlich kann das Gesichtserkennungssystem leicht gebrochen werden, indem einige Änderungen an den Gesichtsfotos vorgenommen werden, die sich nicht auf das visuelle Urteilsvermögen auswirken. Beispielsweise kann festgestellt werden, dass es sich bei dem Mädchen von nebenan und der männlichen Berühmtheit um dieselbe Person handelt Angriff. Das Ziel gegnerischer Angriffe besteht darin, gegnerische Proben zu finden, die natürlich sind und das neuronale Netzwerk verwirren können. Im Wesentlichen besteht das Auffinden gegnerischer Proben darin, die Schwachstellen des neuronalen Netzwerks zu finden.

Kürzlich hat ein Forschungsteam der Dongfang University of Technology ein Paradigma für einen generalisierten Mannigfaltigkeitsangriff (GMAA) vorgeschlagen, der „den traditionellen „Punkt“-Angriffsmodus zu einem „Gesichts“-Angriffsmodus umwandeltund die Generalisierungsfähigkeit erheblich verbessert des gegnerischen Angriffsmodells und entwickelt eine neue Idee für die Arbeit gegnerischer Angriffe. Diese Forschung verbessert frühere Arbeiten sowohl aus der Zieldomäne als auch aus der gegnerischen Domäne. Auf der Zieldomäne findet diese Studie leistungsfähigere gegnerische Beispiele mit hoher Generalisierung, indem sie die Menge der Zustände der Zielidentität angreift. Für den kontradiktorischen Bereich haben frühere Arbeiten nach diskreten kontradiktorischen Stichproben gesucht, d. h. nach mehreren „Schwachstellen“ (Punkten) des Systems, während diese Forschung nach kontinuierlichen kontradiktorischen Mannigfaltigkeiten sucht, d das neuronale Netzwerk. Darüber hinaus führt diese Studie in Domänenkenntnisse der Ausdrucksbearbeitung ein und schlägt ein neues Paradigma vor, das auf der Instanziierung des Ausdruckszustandsraums basiert. Durch kontinuierliches Abtasten der generierten kontradiktorischen Mannigfaltigkeit können wir stark verallgemeinerbare kontradiktorische Muster mit kontinuierlichen Ausdrucksänderungen erhalten. Im Vergleich zu Methoden wie Make-up, Beleuchtung und Hinzufügen von Störungen ist der

Ausdruckszustandsraum universeller und natürlicher und wird nicht vom Geschlecht beeinflusst und Beleuchtung.Die Forschungsarbeit wurde vom CVPR 2023 angenommen.

Papier-Link: Bitte klicken Sie hier, um das Papier anzuzeigen

Papier-Link: Bitte klicken Sie hier, um das Papier anzuzeigen

Der Inhalt, der neu geschrieben werden muss, ist: Code-Link https://github.com/tokaka22/GMAA

EinführungsmethodeIm Ziel Domänenteil, zuvor Die gesamte Arbeit besteht darin, gegnerische Muster für ein bestimmtes Foto der Zielidentität A zu entwerfen. Wie in Abbildung 2 dargestellt, wird der Angriffseffekt jedoch erheblich verringert, wenn die durch diese Angriffsmethode erzeugte gegnerische Stichprobe zum Angriff auf ein anderes Foto von A verwendet wird. Angesichts solcher Angriffe ist der regelmäßige Wechsel der Fotos in der Gesichtserkennungsdatenbank natürlich eine wirksame Abwehrmaßnahme. Die in dieser Studie vorgeschlagene GMAA trainiert jedoch nicht nur auf einer einzelnen Stichprobe der Zielidentität, sondern sucht auch nach gegnerischen Stichproben, die den Satz von Zielidentitätszuständen angreifen können die aktualisierte Gesichtserkennungsbibliothek. Gute Angriffsleistung.

Diese leistungsfähigeren gegnerischen Beispiele entsprechen auch den schwächeren Bereichen des neuronalen Netzwerks und sind einer eingehenden Untersuchung wert.In früheren Forschungen auf dem Gebiet der Gegnerschaft wird normalerweise nach einer oder mehreren diskreten Gegnerproben gesucht, was dem Finden eines oder mehrerer „Punkte“ entspricht, an denen das neuronale Netzwerk im hochdimensionalen Raum anfällig ist. Diese Studie geht jedoch davon aus, dass neuronale Netze im gesamten „Gesicht“ anfällig sein können und daher alle gegnerischen Beispiele auf diesem „Gesicht“ finden sollten. Ziel dieser Forschung ist es daher, gegnerische Mannigfaltigkeiten im hochdimensionalen Raum zu finden. Zusammenfassend ist GMAA ein neues Angriffsparadigma, das gegnerische Mannigfaltigkeiten verwendet, um die Zustandsmenge der Zielidentität anzugreifen.

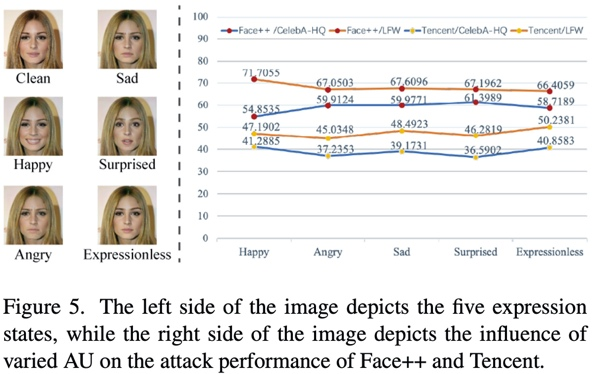

Bitte beachten Sie Abbildung 1, die die Kernidee des Artikels darstelltIn dieser Studie wird insbesondere das Facial Action Coding System (FACS) als Domänenwissen zur Instanziierung des vorgeschlagenen neuen Angriffsparadigmas vorgestellt . FACS ist ein System zur Kodierung des Gesichtsausdrucks. Es unterteilt das Gesicht in verschiedene Muskeleinheiten. Die Größe des Vektorelements repräsentiert die Muskelaktivität der entsprechenden Einheit und kodiert so den Ausdruckszustand . . Im Bild unten stellt beispielsweise das erste Element des AU-Vektors, AU1, den Grad dar, in dem die innere Augenbraue angehoben wird Die Forschung zielt darauf ab, eine Vielzahl von Zielzuständen anzugreifen, um eine bessere Angriffsleistung auf unbekannte Zielbilder zu erzielen. Diese Forschung erstellt eine gegnerische Mannigfaltigkeit, die dem AU-Raum entspricht, und kann durch Ändern der gegnerischen Mannigfaltigkeit Proben auf der gegnerischen Mannigfaltigkeit abtasten AU-Wert-Probe: Durch kontinuierliche Änderung des AU-Werts werden kontradiktorische Stichproben mit sich ständig ändernden Ausdrücken generiert

Es ist erwähnenswert, dass diese Studie den Ausdruckszustandsraum verwendet, um das GMAA-Angriffsparadigma zu instanziieren. Dies liegt daran, dass Mimik der häufigste Zustand bei menschlichen Gesichtsaktivitäten ist und der Ausdruckszustandsraum relativ stabil ist und nicht durch Rasse oder Geschlecht beeinflusst wird (Licht kann die Hautfarbe verändern und Make-up kann das Geschlecht beeinflussen). Solange andere geeignete Zustandsräume gefunden werden können, kann dieses Angriffsparadigma tatsächlich verallgemeinert und auf andere gegnerische Angriffsaufgaben in der Natur angewendet werden.

Der Inhalt, der neu geschrieben werden muss, ist: ModellergebnisseDie visuellen Ergebnisse dieser Studie sind in der folgenden Animation dargestellt. Jeder Animationsrahmen ist ein gegnerisches Beispiel, das durch Abtasten auf der gegnerischen Mannigfaltigkeit erhalten wird. Durch kontinuierliche Stichproben kann eine Reihe kontradiktorischer Beispiele mit sich ständig ändernden Ausdrücken erhalten werden (links). Der rote Wert in der Animation stellt die Ähnlichkeit zwischen dem gegnerischen Beispiel des aktuellen Frames und dem Zielbeispiel (rechts) unter dem Gesichtserkennungssystem Face++ dar.

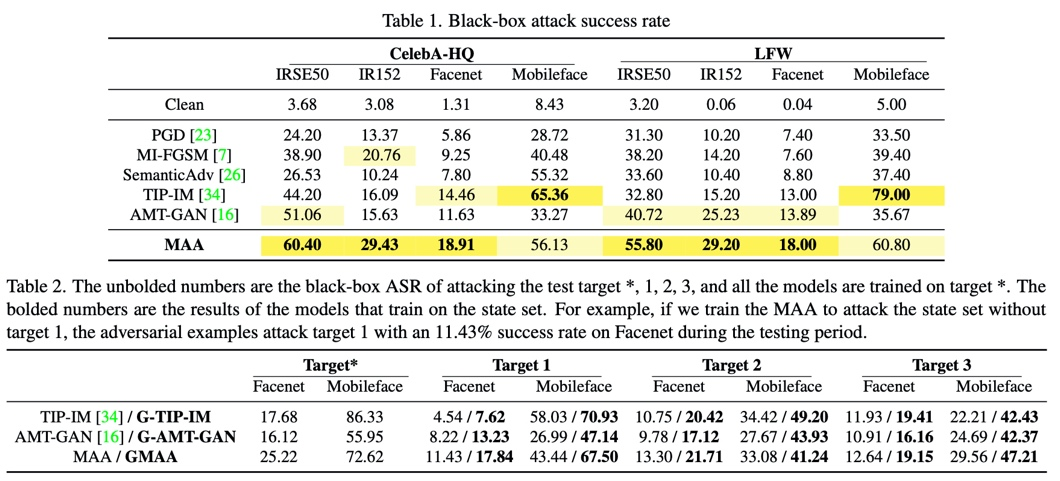

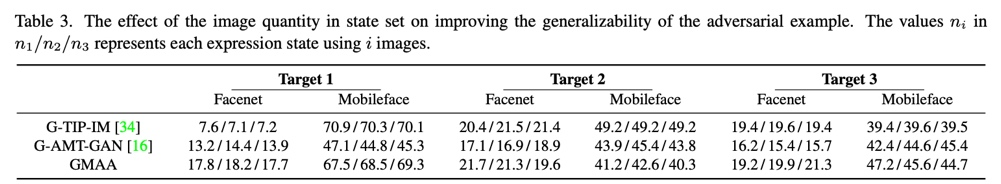

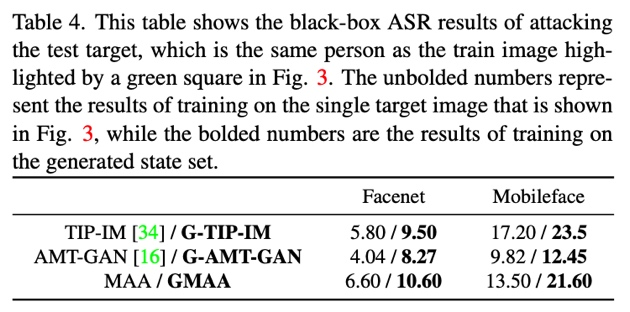

In Tabelle 1 sind vier Gesichtserkennungsmodelle in zwei Black-Box-Angriffen aufgeführt Erfolgsquote für den Datensatz. Unter diesen ist MAA eine reduzierte Version von GMAA, die das Punktangriffsmodell nur auf vielfältige Angriffe im gegnerischen Bereich ausdehnt. In der Zieldomäne greift es immer noch ein einzelnes Ziel an. Der Statussatz des Angriffsziels ist eine übliche experimentelle Einstellung. Der Artikel fügt diese Einstellung zu den drei Methoden einschließlich MAA in Tabelle 2 hinzu (der fett gedruckte Teil in der Tabelle ist das Ergebnis des Hinzufügens dieser Einstellung in Tabelle 2 (A „G“). wird zum Namen der Methode hinzugefügt, um sie zu unterscheiden), was bestätigt, dass die Erweiterung der Zieldomäne die Verallgemeinerung gegnerischer Proben verbessern kann

In Tabelle 1 sind vier Gesichtserkennungsmodelle in zwei Black-Box-Angriffen aufgeführt Erfolgsquote für den Datensatz. Unter diesen ist MAA eine reduzierte Version von GMAA, die das Punktangriffsmodell nur auf vielfältige Angriffe im gegnerischen Bereich ausdehnt. In der Zieldomäne greift es immer noch ein einzelnes Ziel an. Der Statussatz des Angriffsziels ist eine übliche experimentelle Einstellung. Der Artikel fügt diese Einstellung zu den drei Methoden einschließlich MAA in Tabelle 2 hinzu (der fett gedruckte Teil in der Tabelle ist das Ergebnis des Hinzufügens dieser Einstellung in Tabelle 2 (A „G“). wird zum Namen der Methode hinzugefügt, um sie zu unterscheiden), was bestätigt, dass die Erweiterung der Zieldomäne die Verallgemeinerung gegnerischer Proben verbessern kann

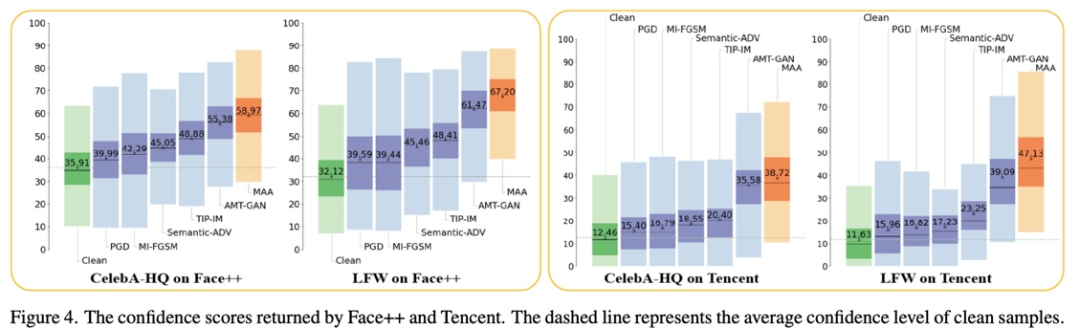

Abbildung 4 zeigt die Ergebnisse des Angriffs auf zwei kommerzielle Gesichtserkennungssystem-APIs

Abbildung 4 zeigt die Ergebnisse des Angriffs auf zwei kommerzielle Gesichtserkennungssystem-APIs Der Inhalt wird wie folgt umgeschrieben: Die Studie untersuchte auch den Einfluss verschiedener Ausdrücke auf die Angriffsleistung und den Einfluss der Anzahl der Stichproben im Statussatz auf die Angriffsgeneralisierungsleistung

Der Inhalt wird wie folgt umgeschrieben: Die Studie untersuchte auch den Einfluss verschiedener Ausdrücke auf die Angriffsleistung und den Einfluss der Anzahl der Stichproben im Statussatz auf die Angriffsgeneralisierungsleistung

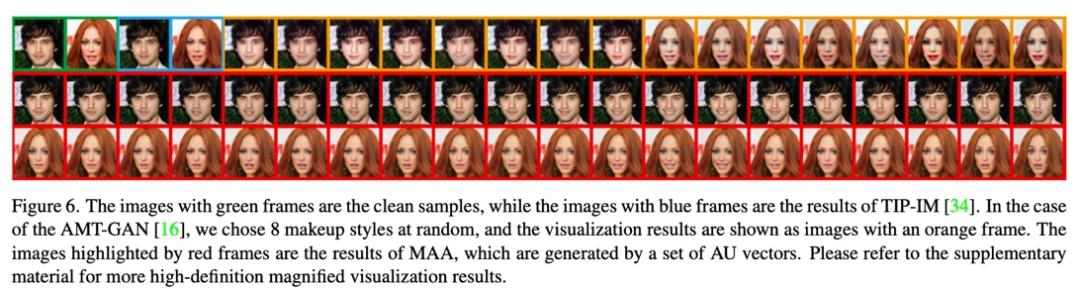

in Abbildung 6. zeigt den Vergleich der Visualisierungsergebnisse verschiedener Methoden. Die MAA-Methode hat 20 gegnerische Proben auf der gegnerischen Mannigfaltigkeit abgetastet. Aus den Ergebnissen ist ersichtlich, dass der Visualisierungseffekt natürlicher ist

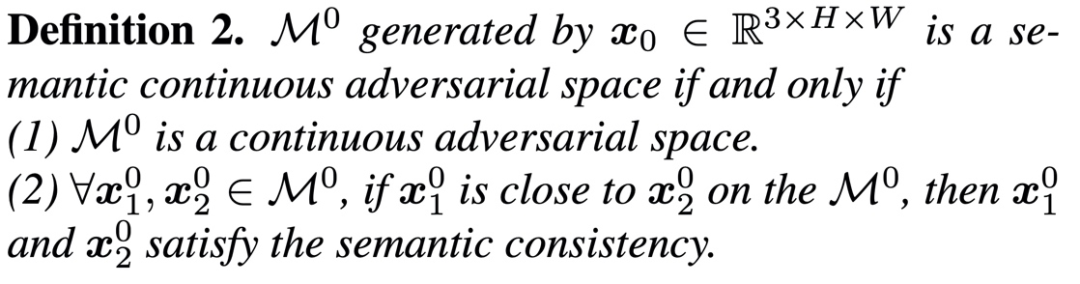

in Abbildung 6. zeigt den Vergleich der Visualisierungsergebnisse verschiedener Methoden. Die MAA-Methode hat 20 gegnerische Proben auf der gegnerischen Mannigfaltigkeit abgetastet. Aus den Ergebnissen ist ersichtlich, dass der Visualisierungseffekt natürlicher ist Natürlich enthalten nicht alle Datensätze Bilder verschiedener Zustände. Wie können in diesem Fall die Daten im Zielfeld erweitert werden? Diese Studie schlägt eine praktikable Lösung vor, die darin besteht, AU-Vektoren und Ausdrucksbearbeitungsmodelle zu verwenden, um eine Reihe von Zielzuständen zu generieren. Die Studie zeigt auch die Ergebnisse des Angriffs auf den synthetischen Zielzustandssatz, und die Ergebnisse zeigen, dass die Generalisierungsleistung verbessert wird. Der Inhalt, der neu geschrieben werden muss, ist: Prinzip und Methode Kernteil des Modells Es umfasst ein Generierungsmodul, ein Ausdrucksüberwachungsmodul, ein Modul zur Verbesserung der Übertragbarkeit und ein verallgemeinertes Angriffsmodul basierend auf WGAN-GP. Unter anderem kann das verallgemeinerte Angriffsmodul die Aggregationsfunktion von Angriffszielzuständen realisieren, und das Modul zur Verbesserung der Übertragbarkeit basiert auf früheren Forschungsarbeiten. Um einen fairen Vergleich zu gewährleisten, wurde dieses Modul allen Benchmark-Modellen hinzugefügt. Das Ausdrucksüberwachungsmodul besteht aus vier geschulten Ausdruckseditoren. Es erreicht die Ausdrucksumwandlung von kontradiktorischen Proben durch globale Strukturüberwachung und lokale Detailüberwachung. In Bezug auf das Ausdrucksüberwachungsmodul werden entsprechende Ablationsexperimente bereitgestellt Die lokale Detailüberwachung kann Artefakte und Unschärfen erzeugter Bilder reduzieren, die visuelle Qualität kontradiktorischer Proben effektiv verbessern und auch die Genauigkeit der Ausdruckssynthese kontradiktorischer Proben verbessern. Darüber hinaus definiert das Papier eine kontinuierliche kontradiktorische Mannigfaltigkeit und das Konzept der semantisch kontinuierlichen kontradiktorischen Mannigfaltigkeit

Natürlich enthalten nicht alle Datensätze Bilder verschiedener Zustände. Wie können in diesem Fall die Daten im Zielfeld erweitert werden? Diese Studie schlägt eine praktikable Lösung vor, die darin besteht, AU-Vektoren und Ausdrucksbearbeitungsmodelle zu verwenden, um eine Reihe von Zielzuständen zu generieren. Die Studie zeigt auch die Ergebnisse des Angriffs auf den synthetischen Zielzustandssatz, und die Ergebnisse zeigen, dass die Generalisierungsleistung verbessert wird. Der Inhalt, der neu geschrieben werden muss, ist: Prinzip und Methode Kernteil des Modells Es umfasst ein Generierungsmodul, ein Ausdrucksüberwachungsmodul, ein Modul zur Verbesserung der Übertragbarkeit und ein verallgemeinertes Angriffsmodul basierend auf WGAN-GP. Unter anderem kann das verallgemeinerte Angriffsmodul die Aggregationsfunktion von Angriffszielzuständen realisieren, und das Modul zur Verbesserung der Übertragbarkeit basiert auf früheren Forschungsarbeiten. Um einen fairen Vergleich zu gewährleisten, wurde dieses Modul allen Benchmark-Modellen hinzugefügt. Das Ausdrucksüberwachungsmodul besteht aus vier geschulten Ausdruckseditoren. Es erreicht die Ausdrucksumwandlung von kontradiktorischen Proben durch globale Strukturüberwachung und lokale Detailüberwachung. In Bezug auf das Ausdrucksüberwachungsmodul werden entsprechende Ablationsexperimente bereitgestellt Die lokale Detailüberwachung kann Artefakte und Unschärfen erzeugter Bilder reduzieren, die visuelle Qualität kontradiktorischer Proben effektiv verbessern und auch die Genauigkeit der Ausdruckssynthese kontradiktorischer Proben verbessern. Darüber hinaus definiert das Papier eine kontinuierliche kontradiktorische Mannigfaltigkeit und das Konzept der semantisch kontinuierlichen kontradiktorischen Mannigfaltigkeit erzeugte kontradiktorische Mannigfaltigkeit homöomorph zum AU-Vektorraum ist.

Zusammenfassung ist eine Zusammenfassung und Zusammenfassung vorhandener Informationen oder Erfahrungen. Dabei handelt es sich um einen Prozess der Organisation und Zusammenfassung von Gedanken mit dem Ziel, die wichtigsten Ideen und Schlussfolgerungen herauszuarbeiten. Das Zusammenfassen kann uns helfen, das Gelernte besser zu verstehen und uns daran zu erinnern, und es kann uns auch dabei helfen, besser zu kommunizieren und unsere Ideen auszutauschen. Durch das Zusammenfassen können wir komplexe Informationen vereinfachen und auf ihre Kernpunkte reduzieren, sodass sie leichter zu verstehen und anzuwenden sind. Zusammenfassungen sind ein wichtiges Instrument im Lern- und Kommunikationsprozess. Sie können uns helfen, große Informationsmengen effizienter zu verarbeiten und zu nutzen. Ob im Studium, bei der Arbeit oder im Leben: Zusammenfassen ist eine wesentliche Fähigkeit. Zusammenfassend schlägt diese Studie ein neues Angriffsparadigma namens GMAA vor, das gleichzeitig die Zieldomäne und die gegnerischen Domänen erweitert und so die Leistung von Angriffen verbessert. Für die Zieldomäne verbessert GMAA die Generalisierungsfähigkeit auf die Zielidentität, indem es eine Sammlung von Zuständen anstelle eines einzelnen Bildes angreift. Darüber hinaus erweitert GMAA den kontradiktorischen Bereich von diskreten Punkten auf semantisch kontinuierliche kontradiktorische Mannigfaltigkeiten („Punkt-zu-Oberfläche“)

. Diese Studie instanziiert das GMAA-Angriffsparadigma, indem sie Domänenwissen zur Ausdrucksbearbeitung einführt. Umfangreiche Vergleichsexperimente belegen, dass GMAA eine bessere Angriffsleistung und eine natürlichere visuelle Qualität aufweist als andere Konkurrenzmodelle.Das obige ist der detaillierte Inhalt vonVom einzelnen Gegner zum vielfältigen Gegner: CVPR 2023 untersucht verallgemeinerbare, vielfältige gegnerische Angriffe. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Detaillierte Einführung in die MySQL-Theorie und Grundkenntnisse

- Fassen Sie 7 Lösungen für verteilte Transaktionen zusammen (Theorie + Lösungen)

- Lassen Sie uns über die Theorie der Master-Slave-Replikation, Sentry und Clustering in Redis sprechen [ausführliche Erklärung mit Bildern und Text]

- Google führt multimodales Vid2Seq ein, um den Video-IQ online zu verstehen, Untertitel werden nicht offline sein CVPR 2023

- Neue Forschungsergebnisse aus Stanford und Berkeley stürzen Googles „Quantenüberlegenheit'! In der Theorie schön, in der Praxis jedoch nutzlos