Heim >Technologie-Peripheriegeräte >KI >Mininglamp Technology veröffentlicht die kostenlose Open-Source-Datei TensorBoard.cpp, um das Vortraining großer Modelle zu erleichtern

Mininglamp Technology veröffentlicht die kostenlose Open-Source-Datei TensorBoard.cpp, um das Vortraining großer Modelle zu erleichtern

- PHPznach vorne

- 2023-08-14 08:17:02919Durchsuche

Kürzlich hat die Mininglamp Technology Group die C++-Schnittstelle des Visualisierungstools für maschinelles Lernen – TensorBoard – implementiert, das das C++-basierte Toolset für Großmodellprojekte weiter bereichert und die Überwachung des Vortrainingsprozesses für große Modelle bequemer und effizienter macht und Beschleunigung des Vorschulungsprozesses großer Modelle im Marketingbereich. Das Tool ist Open Source auf Github.

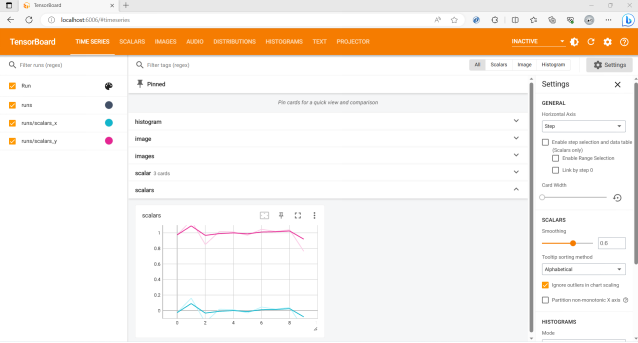

TensorBoard ist ein von Google entwickeltes Visualisierungstool für maschinelles Lernen und wird häufig zur Überwachung verschiedener Indikatoren des maschinellen Lernprozesses verwendet. Zhao Liang, leitender technischer Direktor von Mininglamp Technology, sagte: „Während des Trainingsprozesses großer Modelle ist die Datenüberwachung eine wichtige Dimension, und TensorBoard visualisiert verschiedene Parameter und Ergebnisse im Modell, wie z. B. die Aufzeichnung von Verluständerungen und die Überprüfung des Trainingsprozesses.“ von großen Modellen. Eine Reihe von PPL-Änderungen, Lernratenänderungen, Token-Verbrauch, einstufige Parameteraktualisierungsverzögerung und andere Indikatoren, um den Trainingsstatus zu analysieren, Probleme zu erkennen, die während des Trainingsprozesses auftreten, und rechtzeitig Interventionsmaßnahmen zu ergreifen, um den Prozess zu verbessern Wirkung des Trainings großer Modelle.“ Dieses Mal implementiert Mininglamp Technology TensorBoard über C++,wird den Werkzeugsatz großer Modellprojekte auf Basis von C++ weiter bereichern, die Effizienz des Modelltrainings und der Modellüberwachung erheblich verbessern, den Modelltrainingsprozess beschleunigen und die Tools nach dem Umschreiben der Die Schnittstelle verwendet mehrdimensionale Datenmuster, um Trainingsindikatoren anzuzeigen, einschließlich Skalar-, Histogramm-, Bild-, Bildsammlungs-, Audio-, Text- und anderen Datenmustern. Das Toolkit wird über das Github-Projekt Tensorboard.cpp geteilt und hilft mehr Forschern und Entwicklern, sich am Entwicklungsprozess großer Modelle zu beteiligen und diesen zu beschleunigen sowie die Anwendungserforschung künstlicher Intelligenz in mehreren Bereichen zu fördern.

Minglue Technology hat zwei Toolkits auf Github geöffnet: ASR-BlockFormer und tensorboard.cpp

Hao Jie, CTO der MiningLamp Technology Group, sagte: „Wir wollen Um große Modelle im Marketingbereich unter den Anforderungen einer höheren Effizienz und geringeren Kosten herzustellen, sollte die Fähigkeit großer Modelle durch adaptive Technologie verbessert werden. Gute branchenübliche große Modelle müssen über die Logik und Sprachglätte allgemeiner großer Modelle verfügen, und sie benötigen auch Um die gleiche Logik und Sprachgewandtheit zu erreichen, die in einer bestimmten Branche oder einem bestimmten Bereich nicht verfügbar ist, stützen wir unsere Bemühungen auf die umfangreichen Branchendaten, die Mininglamp Technology in den letzten 17 Jahren gesammelt hat Ausgehend von den tatsächlichen Bedürfnissen der Kunden und der Nutzung der riesigen Datenmengen werden wir mithilfe von Visualisierungstools zur Schulungsüberwachung die Schulungsgeschwindigkeit verbessern, Probleme rechtzeitig erkennen und eine zuverlässigere und effektivere Branche für unsere Kunden schaffen Modell.“

Das obige ist der detaillierte Inhalt vonMininglamp Technology veröffentlicht die kostenlose Open-Source-Datei TensorBoard.cpp, um das Vortraining großer Modelle zu erleichtern. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr