Heim >Technologie-Peripheriegeräte >KI >Debatte: Was sind die Unterschiede zwischen den Meinungen von OpenAI zur KI zwischen Ultraman, Hinton und Yang Likun?

Debatte: Was sind die Unterschiede zwischen den Meinungen von OpenAI zur KI zwischen Ultraman, Hinton und Yang Likun?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-06-13 15:50:23902Durchsuche

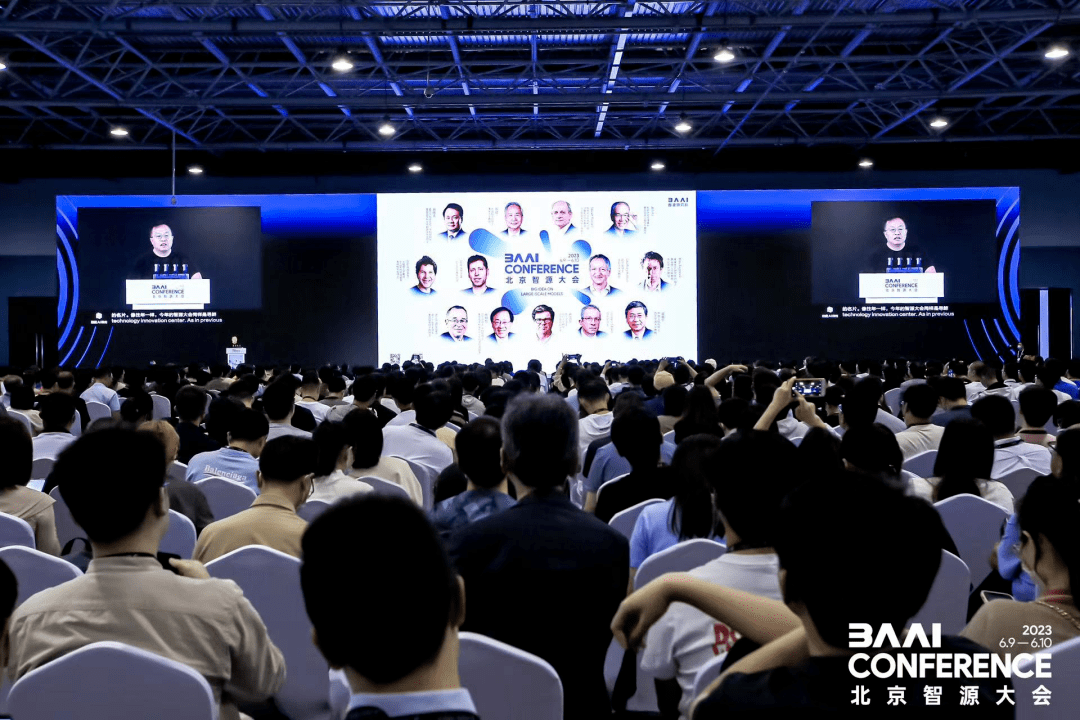

Am 9. Juni wurde in Peking die Beijing Zhiyuan-Konferenz 2023 eröffnet, die vom Zhiyuan Research Institute organisiert wurde. Die Konferenz findet seit fünf Jahren in Folge statt und ist eine jährliche internationale High-End-Fachaustauschveranstaltung zum Thema künstliche Intelligenz.

Es wird berichtet, dass diese Konferenz zwei Tage dauerte und das Kernthema die Chancen und Herausforderungen waren, denen sich die Entwicklung künstlicher Intelligenz gegenübersieht. Mehr als 200 Top-Experten auf dem Gebiet der KI nahmen an der Konferenz teil, darunter OpenAI-Gründer Sam Altman , unter anderem die Figure Spirit Award-Gewinner Geoffrey Hinton und Yann LeCun. Sie alle äußerten ihre Ansichten zur Entwicklung und den Herausforderungen der KI.

(Quelle: Datenkarte)

(Quelle: Datenkarte)

„Werden künstliche neuronale Netze bald intelligenter sein als echte neuronale Netze?“ Hinton ging in seiner Rede hauptsächlich auf eine solche Frage ein.

(Quelle: Datenkarte)

(Quelle: Datenkarte)

Die Fähigkeit, Anweisungen genau zu befolgen, ist der Schlüssel zu Computern im traditionellen Computing. Aufgrund dieser Funktion können Benutzer unterschiedliche Hardware wählen, wenn sie dasselbe Programm oder dasselbe neuronale Netzwerk verwenden. Dies zeigt, dass keine Abhängigkeit zwischen den Gewichten des neuronalen Netzwerks im Programm und der Hardware besteht.

„Der Grund, warum sie Anweisungen befolgen, liegt darin, dass sie es uns ermöglichen sollen, ein Problem zu betrachten, die zu seiner Lösung erforderlichen Schritte zu bestimmen und dann dem Computer ein Muster vorzugeben, nach dem diese Schritte ausgeführt werden sollen“, sagte Hinton.

Um große Sprachmodelle zu geringeren Kosten zu trainieren, schlug er „Limited Computing“ vor, was bedeutet, das Grundprinzip der Trennung von Hardware und Software im traditionellen Computing aufzugeben und Rechenaufgaben basierend auf der Simulation von Hardware effizient auszuführen.

Allerdings gibt es bei diesem Ansatz zwei Hauptprobleme.

Erstens „muss der Lernprozess spezifische Simulationseigenschaften der Hardwarekomponenten nutzen, auf denen er läuft, und wir wissen nicht genau, um welche Eigenschaften es sich handelt“, sagte Hinton.

Zweitens ist diese Methode begrenzt. „Da Wissen untrennbar mit Hardwaredetails verbunden ist, gehen alle gewonnenen Erkenntnisse verloren, wenn ein bestimmtes Hardwaregerät ausfällt“, erklärt Hinton.

Um die oben genannten Probleme zu lösen, haben er und seine Mitarbeiter viele Methoden ausprobiert, beispielsweise die „Destillationsmethode“, die sich als sehr effektiv erwiesen hat.

Er wies auch darauf hin, dass die Art und Weise, wie eine Gruppe von Agenten Wissen teilt, viele Faktoren im Computerbereich beeinflusst. Dies bedeutet, dass große Sprachmodelle derzeit scheinbar in der Lage sind, große Mengen an Wissen zu erlernen. Da sie sich Wissen jedoch hauptsächlich durch das Lernen von Dokumenten aneignen und nicht in der Lage sind, direkt aus der realen Welt zu lernen, ist die Lernmethode sehr ineffizient.

Unüberwachte Lernmodelle, wie z. B. Videomodellierung, ermöglichen ihnen ein effizientes Lernen. Sobald diese digitalen Agenten aktiviert sind, verfügen sie laut Hinton über größere Lernfähigkeiten als Menschen und können sehr schnell lernen.

Wenn wir diesem Entwicklungstrend folgen, werden intelligente Agenten bald schlauer als Menschen. Allerdings wird dies auch viele Herausforderungen mit sich bringen, etwa den Kampf um die Kontrolle zwischen Agenten und Menschen, Ethik- und Sicherheitsfragen.

„Stellen Sie sich vor, dass Systeme der künstlichen allgemeinen Intelligenz (AGI) in den nächsten zehn Jahren das Fachwissen übertreffen werden, über das die Menschen Anfang der 1990er Jahre verfügten.“

In seiner Rede und Frage-und-Antwort-Runde mit Zhang Hongjiang, Vorsitzender des Zhiyuan Research Institute, erörterte er die Bedeutung und Strategien der Förderung der AGI-Sicherheit.

(Quelle: Datenkarte)

(Quelle: Datenkarte)

„Wir müssen die Verantwortung für die Probleme übernehmen, die aus rücksichtsloser Entwicklung und Bereitstellung entstehen können“, sagte Altman und wies auf zwei Richtungen hin, nämlich die Festlegung integrativer internationaler Normen und Standards und die Förderung des Aufbaus von AGI-Sicherheitssystemen durch internationale Zusammenarbeit.

Im Moment ist das Hauptproblem, das gelöst werden muss, die Frage, wie man große Sprachmodelle trainiert, damit sie zu wirklich sicheren und hilfreichen menschlichen Assistenten werden können.

In diesem Zusammenhang hat Ultraman mehrere Lösungen vorgeschlagen.

Investieren Sie zunächst in eine skalierbare Überwachung, beispielsweise in das Training eines Modells, das Menschen bei der Überwachung anderer KI-Systeme unterstützen kann.

Zweitens sollten Sie die Technologie für maschinelles Lernen weiter verbessern, um die Interpretierbarkeit des Modells weiter zu verbessern.

Unser oberstes Ziel ist es, KI-Systeme in die Lage zu versetzen, sich selbst besser zu optimieren. Altman sagte: „Da zukünftige Modelle immer intelligenter und leistungsfähiger werden, werden wir bessere Lerntechniken finden, die Risiken reduzieren und gleichzeitig die außerordentlichen Vorteile der KI nutzen.“

Yang Likun und Altman vertreten die gleiche Ansicht darüber, wie mit den Risiken umgegangen werden soll, die die aktuelle KI mit sich bringt. Dieser Satz kann wie folgt umgeschrieben werden: „Obwohl diese Risiken bestehen, können sie durch sorgfältige technische Planung gemindert oder kontrolliert werden.“

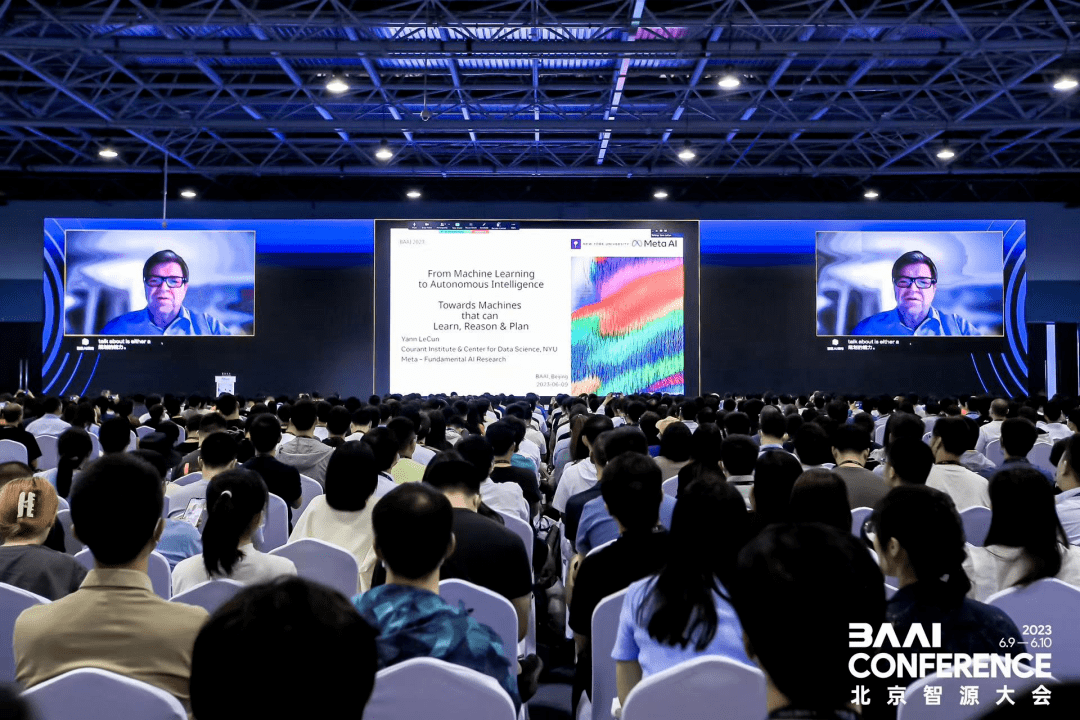

Allerdings wies Yang Likun als Experte, der schon immer gegen große GPT-Modelle war, in seiner Rede mit dem Titel „Auf dem Weg zu Maschinen, die lernen, denken und planen können“ deutlich auf die Vor- und Nachteile von KI-Systemen hin, die durch selbstüberwachtes Lernen repräsentiert werden.

(Quelle: Datenkarte)

(Quelle: Datenkarte)

Obwohl es äußerst starke Auswirkungen auf die Verarbeitung und Erzeugung natürlicher Sprache hat, verfügt es nicht über die Fähigkeit, wie Menschen und Tiere zu denken und zu planen, sodass es unweigerlich zu einigen sachlichen Fehlern, logischen Fehlern und Wertfehlern führt Probleme.

Auf dieser Grundlage glaubt Yang Likun, dass die KI in den nächsten Jahren vor drei großen Herausforderungen stehen wird: das Erlernen von Modellen für die Darstellung und Vorhersage der Welt, das Erlernen von Denkfähigkeiten und das Erlernen der Zerlegung komplexer Aufgaben in einfache Aufgaben und deren Weiterentwicklung.

Außerdem schlug er die Idee vor, dass das Weltmodell der Kern des Weges zur AGI sei.

Ein Weltmodell ist seiner Ansicht nach ein System, das sich vorstellen kann, was in der Zukunft passieren wird, und mit minimalem Aufwand eigene Vorhersagen treffen kann.

Das System nutzt frühere Weltanschauungen, die möglicherweise im Speicher gespeichert sind, um den aktuellen Zustand der Welt zu verarbeiten. Anschließend verwenden Sie das Weltmodell, um vorherzusagen, wie sich die Welt entwickeln wird und was passieren wird. „Sagte Yang Likun.

Wie lässt sich dieses Weltmodell umsetzen? „Wir haben ein mehrschichtiges System, das durch eine Kette von Encodern und Modellen der Welt unter Verwendung verschiedener Schichten von Prädiktoren immer abstraktere Darstellungen des Weltzustands extrahiert“, sagte er.

Einfach ausgedrückt bedeutet es, komplexe Aufgaben zu erledigen, indem man sie auf die Millisekundenebene zerlegt und plant. Um es klar auszudrücken: Es muss ein System zur Kostenkontrolle und Optimierung von Standards vorhanden sein.

Zusammenfassend lässt sich feststellen, dass die drei Experten zwar unterschiedliche Ansichten und Meinungen zum Thema KI haben, aber alle feststellten, dass die Entwicklung von KI zu einem allgemeinen Trend geworden ist. Wie Ultraman sagte, können wir die Entwicklung der KI nicht aufhalten.

Auf dieser Grundlage wird die Hauptrichtung, auf die sich die Menschen in der nächsten Phase konzentrieren müssen, darin bestehen, einen besseren Weg zur Entwicklung von KI zu finden, eine Reihe von Risiken und Schäden, die sie mit sich bringen kann, zu unterdrücken und sich schließlich dem Ende von AGI zu nähern.

Das obige ist der detaillierte Inhalt vonDebatte: Was sind die Unterschiede zwischen den Meinungen von OpenAI zur KI zwischen Ultraman, Hinton und Yang Likun?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr