Heim >Technologie-Peripheriegeräte >KI >Jeder hat einen „kleinen Film'! Die Videoversion von Midjourney ist kostenlos erhältlich und in nur einem Satz entsteht ein cooler Blockbuster, der Internetnutzer verblüfft

Jeder hat einen „kleinen Film'! Die Videoversion von Midjourney ist kostenlos erhältlich und in nur einem Satz entsteht ein cooler Blockbuster, der Internetnutzer verblüfft

- 王林nach vorne

- 2023-06-13 09:55:511697Durchsuche

Nach drei Monaten Wartezeit ist Runway’s Gen-2 endlich zum kostenlosen Test verfügbar!

Man kann sagen, dass dies ein Tag ist, der es wert ist, in die Geschichte der Entwicklung von KI-Videotools aufgenommen zu werden.

Testadresse: https://app.runwayml.com

Dieses KI-Tool kann schnell ein 4-Sekunden-Video aus Text und Bildern erstellen. Mit anderen Worten: Die Art und Weise, Videos zu erstellen, besteht vollständig darin, „etwas aus dem Nichts zu machen“.

Nachdem ich mir die Demo unten angesehen hatte, rief ich aus: Werden der Regisseur und die Schauspieler wirklich mit einem Klick eliminiert?

Begeisterte Internetnutzer beeilten sich, es zu testen. Ihre Gedanken waren: Die Wirkung ist so explosiv.

Das einzige Bedauern ist, dass das aktuell generierte Video nur 4 Sekunden lang ist. (Wenn die Szenen davor und danach aber nicht abrupt sind, reicht es eigentlich, noch ein paar 4-Sekunden-Videos zusammenzufügen)

Aufgeregtes Herz, zitternde Hände, der Redakteur, der oft automatisch diverse Blockbuster in seinem Schädel aufführt, das kann ich wirklich Ich halte es nicht länger aus. (Kann die Szene in meinem Traum also wahr werden?)

Echter Test der Redaktion: Jeder kann einen Kurzfilm machen!

Ohne weitere Umschweife kommt hier der eigentliche Test.

Nachdem Sie die Seite aufgerufen haben, versuchen Sie es mit einer einfachen Eingabeaufforderung: „Die Szene, in der Menschen zum ersten Mal auf dem Mars landen und eine Basis aufbauen.“

Der von Gen-2 generierte Bildschirminhalt stimmt mit der Beschreibung des Aufforderungsworts überein, aber die Elemente auf dem Bildschirm sind zu einfach und der künstlerische Sinn ist nicht zufriedenstellend.

Also fügte der Herausgeber einige Inhalte zum Umgebungsstil hinzu: „Menschen landeten zum ersten Mal auf dem Mars und bauten eine Marsbasis, Bilder im Filmstil, Stil der Zukunft.“

Tatsächlich sind die von Gen-2 dieses Mal generierten Inhalte und Effekte tatsächlich reichhaltiger als zuvor.

Allerdings gibt es bei diesem Video immer noch ein Problem: Die Bilder und Charaktere sind fast statisch, mit sehr wenigen Änderungen.

Nach wiederholten Tests haben wir einige unverzichtbare Inhalte für schnelle Worte gefunden: Stil, Linse, Inhalt, Aktion, Umgebung und Licht.

Solange Sie diese Inhalte zu den Aufforderungswörtern hinzufügen, wird die generierte Animation sofort erheblich verbessert.

Für das Thema der Landung auf dem Mars hat die Redaktion versucht, ein promptes Wort umzuschreiben:

„Filmstil, Science-Fiction-Stil, zwei Astronauten bauen einen Arbeitsturm in der Marsbasis, sehr starkes Sonnenlicht“

Im Vergleich zu den beiden vorherigen wurde die jetzt generierte Animation hinsichtlich Bildstil, Inhaltsreichtum, Aktionseffekten sowie Licht- und Schatteneffekten offensichtlich erheblich verbessert.

Schließlich lud der Redakteur ein Bild basierend auf demselben Aufforderungswort hoch und bat Gen-2, eine Animation basierend auf dem Aufforderungswort und dem Bild zu erstellen.

Es ist ersichtlich, dass im Vergleich zum dritten Video mit demselben Aufforderungswort, aber ohne Bild, das vierte Video mit Bildaufforderung tatsächlich einen signifikanten Zusammenhang mit dem Bildinhalt hat.

Mit der präzisen Beschreibung prompter Wörter und Bilder kann im Grunde jeder sofort einen idealen Videoinhalt erstellen.

Die Zeiten haben sich geändert: Nichts ist unmöglich, es sei denn, Sie stellen es sich vor

Im Vergleich zum letzten Mal geht der Slogan von Runway dieses Mal noch weiter: „Solange Sie es sich vorstellen können, kann es für Sie geschaffen werden.“ (Das letzte Mal lautete der Slogan „Sag es, sieh es“)

Ist das in Ordnung? Der Unterschied zwischen gewöhnlichen Menschen und großartigen Regisseuren ist neben Fachwissen und Erfahrung das professionelle Fototeam und die Schauspieler.

Die letztgenannte Lücke wird jetzt vollständig durch KI-Tools wie Gen-2 gefüllt. Keine Kamera, keine Kamera, keine 3D-Modellierung, kein Cinema 4D ...

Solange Ihre Fantasie voll ist, lernen Sie das Geschickte „Zauberspruch“ und „Jeder kann seinen eigenen Film machen“ ist kein Traum mehr!

Ob es sich um ein realistisches Bild handelt –

oder um etwas Abstrakteres –

Sie können sogar Animationen erstellen, verschiedene Operationen daran ausführen und sich dann selbst in das Video einfügen.

Der Schwellenwert für die Videogenerierung wurde stark gesenkt, was für die meisten Content-Ersteller eine wirklich gute Nachricht ist.

Man kann sagen, dass die KI von Wensheng Video/Tusheng Video wirklich zu viele disruptive Veränderungen in die Branche gebracht hat.

Wenn Scissorhands in der Vergangenheit ein geeignetes Material finden wollte (z. B. einige im Weltraum spritzende Farben), mussten sie auf Material-Websites wie Stock Footage suchen. Die Auswahl an Materialien war sehr begrenzt und alle verfügbar. Material ist nicht exklusiv.

Oder schnappen Sie sich etwas Farbe, werfen Sie sie im Studio herum und halten Sie sie selbst mit einer Kamera fest. Das ist zeitaufwändig und arbeitsintensiv und führt zudem zu einer Unordnung in der Umgebung.

Sie können es auch selbst in Blender machen, was normalerweise Stunden oder sogar Tage dauert.

Oder Sie müssen ein professionelles Team engagieren, um diesen Prozess zu filmen. Die Kosten liegen wahrscheinlich zwischen einigen Hundert und einigen Tausend Dollar.

Jetzt hat Gen-2 all diese Kosten reduziert!

Gen-1 ist wieder beliebt

Tatsächlich war die vorherige Gen-1 bereits explosiv genug.

Mit der Veröffentlichung von Gen-2 ist das folgende Video in letzter Zeit wieder populär geworden.

Ich sah, dass sich der Onkel mit einem Fingerschnippen in einen Adligen verwandelte und im 17. und 18. Jahrhundert an die europäischen Höfe reiste.

Bald verwandelte er sich mit einem Fingerschnippen in den Protagonisten in „Rise of the Planet“, der durch das zerstörte Schlachtfeld reiste.

Das ist nichts, der darauffolgende Geschlechtswechsel ist ein Meisterwerk!

Wer hätte gedacht, dass eine so fitte Frau gerade tatsächlich der „alte Mann“ ist.

Ich muss sagen, dass durch die Schulung der Internetnutzer die von Gen-2 generierten Hintergründe, Gesichter und Kleidung nicht nur ganz natürlich sind, sondern auch eine starke Konsistenz zu haben scheinen.

Aber die Hände, mit denen es am schwierigsten umzugehen ist, haben immer noch oft Wanzen.

Ein MV, 30 Dollar

Einige Twitter-Nutzer mit schnellen Händen haben bereits die Fähigkeit von Gen-2 getestet, MVs zu generieren.

Die Praxis hat gezeigt, dass wir eine ziemlich lange Anlaufzeit benötigen, um qualitativ hochwertige und kontrollierbare Ergebnisse zu erzielen. Es kann jedoch eine Feinabstimmung vorgenommen werden, indem ein Wort hinzugefügt oder geändert wird.

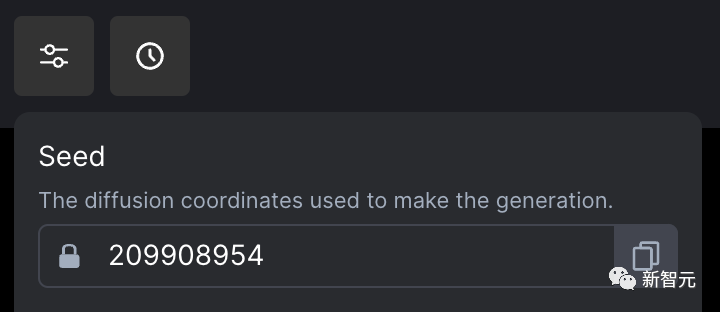

Darüber hinaus gibt es noch einen weiteren wichtigen Einflussfaktor – die Samensperre.

Der Rest ist nur viel Probieren.

Zum Beispiel hat dieser Steve Mills insgesamt etwa 500 Sekunden Video erstellt und es schließlich zu einem 140 Sekunden langen MV geschnitten.

Bitte genießen Sie als nächstes: „Blue City Streets“.

Es ist erwähnenswert, dass dieses Video tatsächlich in der Beta-Version erstellt wurde.

Wenn man den Preis der öffentlichen Version zugrunde legt, wird die gesamte Produktion nach Einschätzung des Autors mindestens 30 US-Dollar kosten. In Verbindung mit der vorherigen Lern- und Erkundungsphase wird der Preis sogar noch höher sein.

Bringen Sie Schritt für Schritt bei, wie man es benutzt

Wie können Sie Hollywood-Regisseur werden, nachdem Sie so viele Beispiele gesehen haben? Gehen wir es Schritt für Schritt an.

Registrieren Sie zunächst ein Konto.

Nachdem Sie die Startseite aufgerufen haben, wählen Sie Gen-2: Text to Video.

Dann erscheint das Eingabeaufforderungsfeld. Hier müssen Sie Ihr Können unter Beweis stellen!

Nachdem die Eingabeaufforderung abgeschlossen ist, können Sie auch die Optionseinstellungskarte öffnen, um Ihre Ergebnisse zu verbessern, z. B. das Einfügen von Frames auszuwählen, den Videoübergang flüssiger zu gestalten, die Auflösung zu erhöhen, Wasserzeichen zu entfernen usw.

Klicken Sie dann auf „Generieren“ und der nächste Schritt besteht darin, Zeuge des Wunders zu werden!

Aber viele Freunde müssen sagen, dass sie früh gestorben sind und keine zu komplexen und wunderschönen Aufforderungen schreiben konnten.

Keine Sorge, der Start der Gen-2 hat uns dieses Mal eine große Überraschung beschert – selbst für einfache Hinweise ist das von Gen-2 produzierte Video nicht schlecht.

Wenn Sie beispielsweise einfach „einen Baum“ eingeben, sieht das generierte Video so aus:

Wenn Sie „einen Baum auf einem grasbewachsenen Berg im Mittleren Westen der USA“ eingeben, professionelle Filme „Stil, geringe Schärfentiefe, Motivfokus, schöne Beleuchtung, sanfte dynamische Bewegung“, das generierte Video sieht so aus:

Das heißt, wir müssen nicht zum Prompt-Master vorgehen , wir normalen Benutzer können auch schnell coole Videos erstellen!

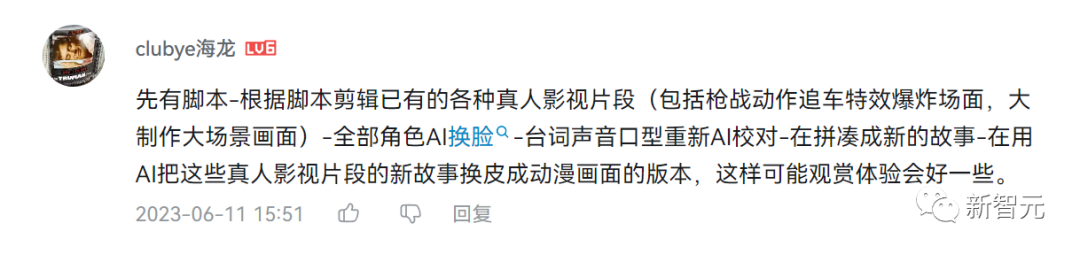

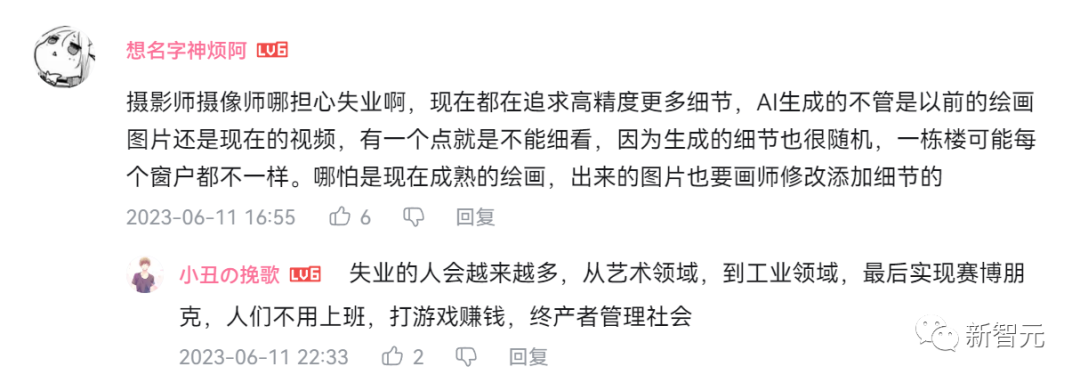

Heiße Diskussion unter Internetnutzern

Als Reaktion darauf haben die Internetnutzer von Station B ihre Meinung geöffnet.

Einige Leute haben auch angefangen, es zu testen.

Ausländische Internetnutzer riefen auch aus, als sie Gen-2 sahen

Ich habe endlich auf dich gewartet, aber zum Glück habe ich nicht aufgegeben.

Während die generative KI weiterhin Videoinhalte generiert, steht die Unterhaltungsbranche vor einem Wandel.

Vor ein paar Jahrzehnten war die Qualität der Filme noch ganz anders als heute.

Jetzt, mit dem Segen von KI-Tools wie Gen-2, sind die Grenzen von Filmen in der Zukunft vielleicht nur die Grenzen der menschlichen Vorstellungskraft, nicht die Grenzen der Technologie.

Das obige ist der detaillierte Inhalt vonJeder hat einen „kleinen Film'! Die Videoversion von Midjourney ist kostenlos erhältlich und in nur einem Satz entsteht ein cooler Blockbuster, der Internetnutzer verblüfft. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr