Heim >Technologie-Peripheriegeräte >KI >KI imitiert das Gedächtnismodell des menschlichen Gehirns und die Spielergebnisse stiegen um 29,9 %

KI imitiert das Gedächtnismodell des menschlichen Gehirns und die Spielergebnisse stiegen um 29,9 %

- 王林nach vorne

- 2023-06-06 11:13:02698Durchsuche

Uns wird oft beigebracht, „zweimal nachzudenken, bevor man handelt“ und die gesammelten Erfahrungen voll auszunutzen. Nun hat dieser Satz auch die KI inspiriert.

Herkömmliche Entscheidungsfindungs-KI-Modelle können aufgrund des Vergessenseffekts keine Erfahrungen effektiv sammeln, aber eine von China geleitete Forschung hat die Art und Weise, wie KI sich erinnert, verändert.

Die neue Gedächtnismethode imitiert das menschliche Gehirn und verbessert effektiv die Effizienz der KI beim Sammeln von Erfahrungen, wodurch die Spielleistung der KI um 29,9 % gesteigert wird.

Das Forschungsteam besteht aus jeweils sechs Personen vom Mira-Québec AI Research Institute und dem Microsoft Montreal Research Institute, von denen vier Chinesen sind.

Sie nannten das Ergebnis Decision Transformer with Memory (DT-Mem).

Im Vergleich zu herkömmlichen Entscheidungsmodellen ist DT-Mem breiter anwendbar und die Effizienz des Modellbetriebs ist ebenfalls höher.

Neben dem Anwendungseffekt wurde auch die Einarbeitungszeit von DT-Mem von mindestens 200 Stunden auf 50 Stunden verkürzt.

Gleichzeitig schlug das Team auch eine Feinabstimmungsmethode vor, damit sich DT-Mem an neue Szenarien anpassen kann, die noch nicht trainiert wurden.

Das fein abgestimmte Modell kann auch in Spielen gut funktionieren, die es zuvor noch nicht gelernt hat.

Der Arbeitsmechanismus ist vom Menschen inspiriert

Das traditionelle Entscheidungsmodell basiert auf LLM und nutzt implizites Gedächtnis und seine Leistung verlässt sich auf Daten und Berechnungen.

Implizite Erinnerungen werden unbewusst erzeugt und nicht bewusst erinnert und können daher nicht bewusst abgerufen werden.

Einfacher ausgedrückt ist der relevante Inhalt offensichtlich dort gespeichert, aber das Modell weiß nicht, dass er existiert.

Dieses Merkmal des impliziten Gedächtnisses führt dazu, dass das traditionelle Modell ein Vergessensphänomen aufweist, was zu einer geringen Arbeitseffizienz führt.

Das Vergessensphänomen zeigt, dass das Modell nach dem Erlernen einer neuen Lösungsmethode für ein Problem möglicherweise den alten Inhalt vergisst, selbst wenn das alte und das neue Problem vom gleichen Typ sind.

Das menschliche Gehirn verwendet eine verteilte Gedächtnisspeicherung Methode, bei der der Gedächtnisinhalt verteilt in mehreren verschiedenen Bereichen des Gehirns gespeichert wird.

Dieser Ansatz hilft dabei, mehrere Fähigkeiten effektiv zu verwalten und zu organisieren und so das Phänomen des Vergessens zu mildern.

Inspiriert davon schlug das Forschungsteam ein internes Arbeitsspeichermodul vor, um Informationen für verschiedene nachgelagerte Aufgaben zu speichern, zu mischen und abzurufen.

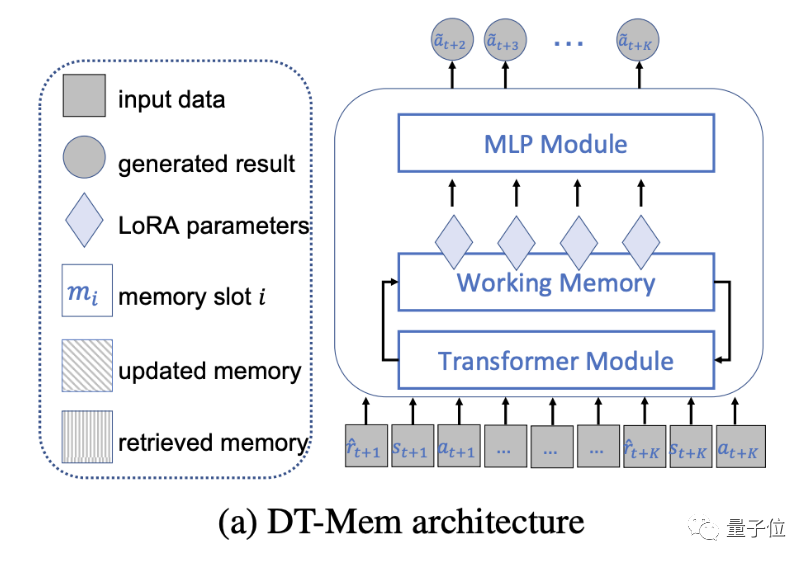

Konkret besteht DT-Mem aus drei Teilen: Transformer, Speichermodul und Multi-Layer-Perception (MLP)-Modul.

Der Transformer von DT-Mem imitiert die Architektur von GPT-2, löscht jedoch den Aufmerksamkeitsmechanismus.

Gleichzeitig wird das MLP-Modul in GPT-2 im Rahmen von DT-Mem in unabhängige Komponenten aufgeteilt.

Dazwischen führte das Forschungsteam ein Arbeitsgedächtnismodul ein, um Zwischeninformationen zu speichern und zu verarbeiten.

Diese Struktur ist von der neuronalen Turing-Maschine inspiriert, bei der der Speicher zum Ableiten verschiedener Algorithmen verwendet wird.

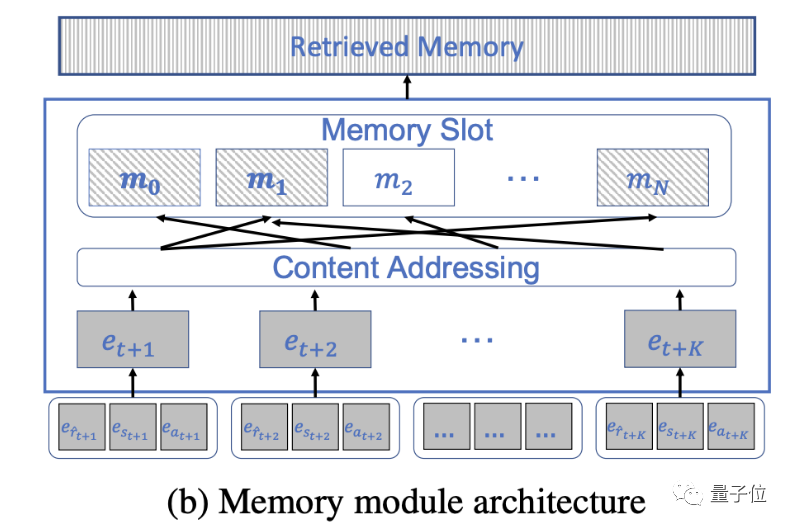

Das Speichermodul analysiert die vom Transformer ausgegebenen Informationen und bestimmt seinen Speicherort und wie es mit vorhandenen Informationen integriert werden kann.

Darüber hinaus wird in diesem Modul auch darüber nachgedacht, wie diese Informationen in zukünftigen Entscheidungsprozessen genutzt werden.

Diese Aufgaben werden zunächst in fünf Schritten initialisiert.

Dann folgt das Sortieren der Eingabeinformationen. In diesem Schritt werden die Informationen nicht an den Transformer übergeben, sondern in Form von Tupeln im selben Raum gespeichert.

Danach müssen Sie den Speicherort bestimmen. Menschen speichern verwandte Informationen normalerweise am selben Ort, und auch DT-Mem basiert auf diesem Prinzip.

Die letzten beiden Schritte – Speicheraktualisierung und -abruf – sind der Kern des Speichermoduls und das wichtigste Glied im gesamten DT-Mem.

Speicheraktualisierung bedeutet das Bearbeiten und Ersetzen vorhandener Informationen, um sicherzustellen, dass die Informationen rechtzeitig entsprechend den Anforderungen der Aufgabe aktualisiert werden können.

In diesem Schritt berechnet DT-Mem die Lösch- und Schreibvektoren, um zu bestimmen, wie sie mit vorhandenen Daten gemischt werden.

Speicherabruf ist der Zugriff auf und die Wiederherstellung vorhandener Informationen sowie der rechtzeitige Abruf relevanter und nützlicher Informationen, wenn Entscheidungen getroffen werden müssen.

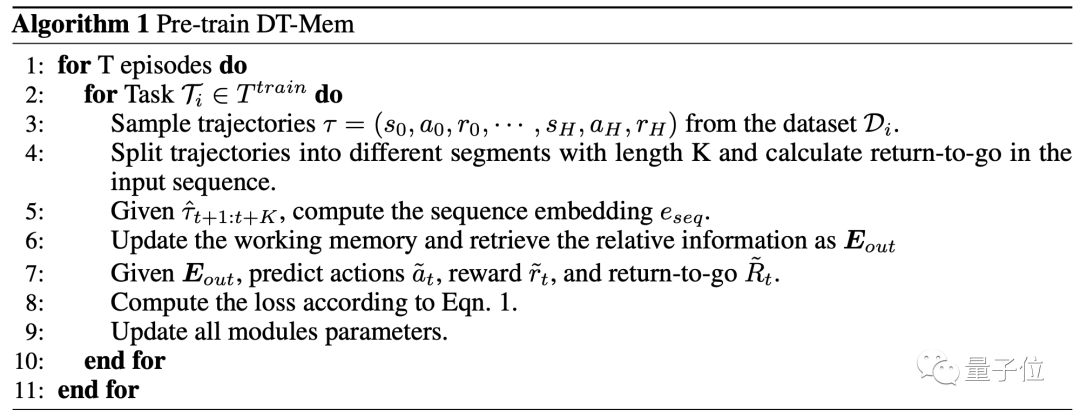

Bevor DT-Mem tatsächlich eingesetzt werden kann, muss es noch einen Vorschulungsprozess durchlaufen.

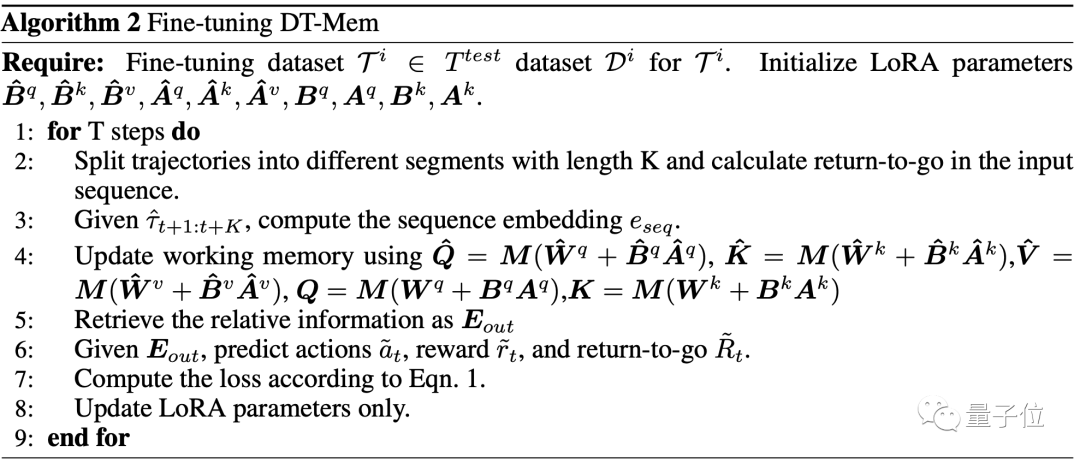

Für die Feinabstimmung von DT-Mem schlug das Team auch einen neuen Weg vor.

Da es Daten verwendet, die auf der Grundlage von Aufgaben gekennzeichnet sind, kann diese Art der Feinabstimmung DT-Mem dabei helfen, sich an neue Aufgaben anzupassen.

Dieser Prozess basiert auf der Low-Rank-Adaption (LoRA), bei der Low-Rank-Elemente zur bestehenden Matrix hinzugefügt werden.

Die Trainingszeit kann bis zu 32-fach verkürzt werden

Zum Testen Aufgrund der Entscheidungsfähigkeit von DT-Mem ließ das Forschungsteam mehrere Spiele spielen.

Es gibt insgesamt 5 Spiele, alle von Atari.

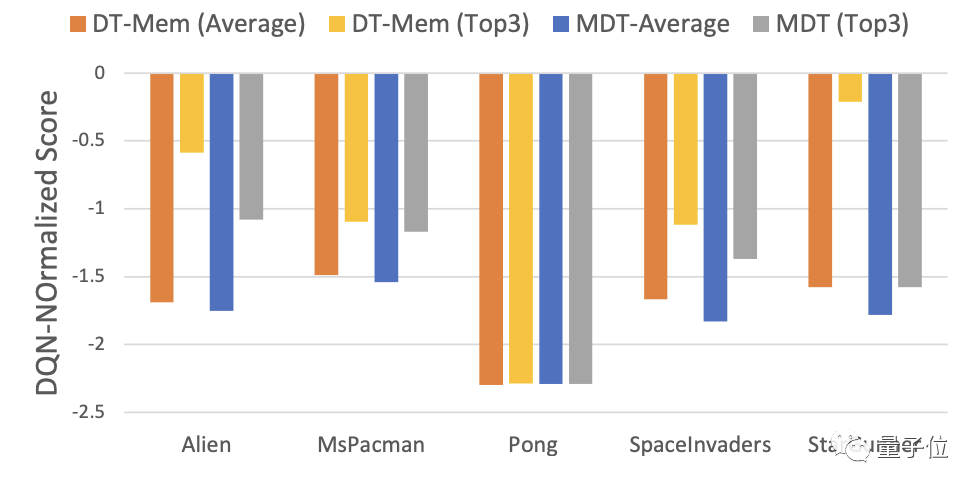

Gleichzeitig testete das Team auch die Leistung des traditionellen Modells M[ulti-game]DT als Referenz.

Daher waren die besten Ergebnisse von DT-Mem in vier Spielen besser als die von MDT.

Konkret verbessert DT-Mem den normalisierten DQN-Score um 29,9 % im Vergleich zu MDT.

Allerdings beträgt die Parametermenge von DT-Mem nur 20 Mio., was nur 10 % von MDT (200 Mio. Parameter) entspricht.

Eine solche Leistung ist keineswegs übertrieben.

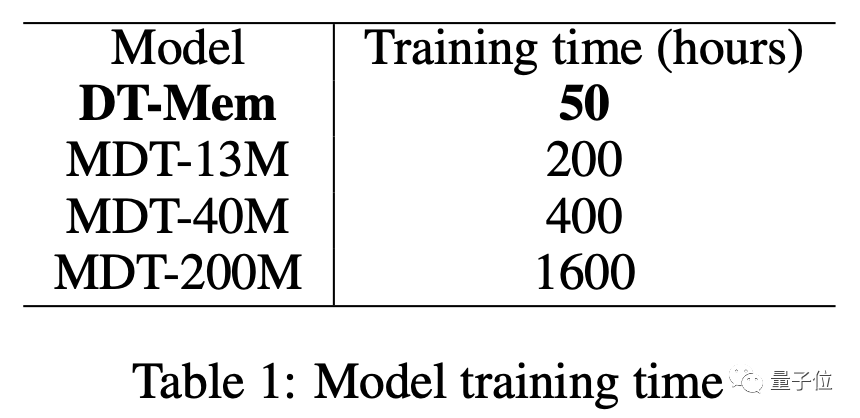

Zusätzlich zu seiner hervorragenden Leistung übertrifft DT-Mem auch die Trainingseffizienz von MDT.

Die 13M-Parameterversion von MDT benötigt 200 Stunden zum Trainieren, während die 20M-DT-Mem-Version nur 50 Stunden benötigt.

Im Vergleich zur 200M-Version verkürzt sich die Trainingszeit um das 32-fache, die Leistung ist aber noch besser.

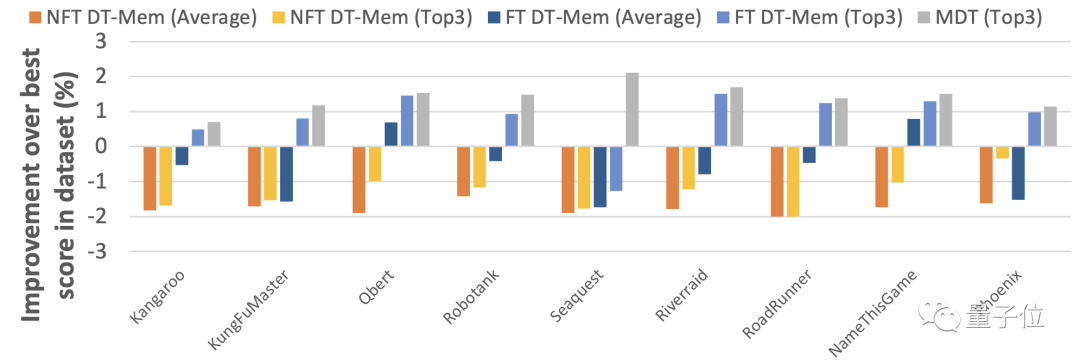

Die Testergebnisse der vom Team vorgeschlagenen Feinabstimmungsmethode zeigen auch, dass diese Feinabstimmung die Fähigkeit von DT-Mem verbessert, sich an unbekannte Szenarien anzupassen.

Es ist zu beachten, dass die in der folgenden Tabelle zum Testen verwendeten Spiele MDT bekannt sind, sodass die Leistung von MDT in dieser Runde nicht als Grundlage für die Messung verwendet wird.

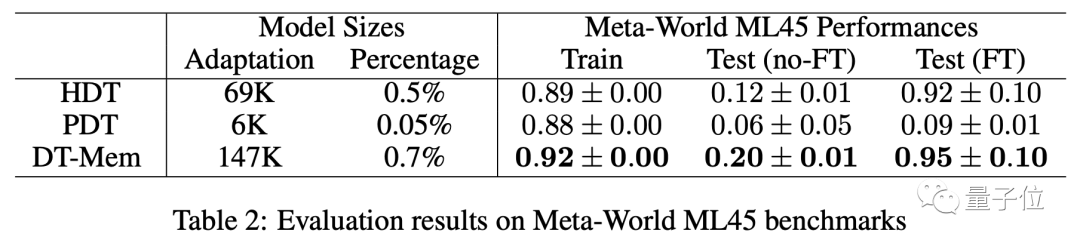

Neben Spielen testete das Team DT-Mem auch mit dem Meta-World ML45-Benchmark.

Die diesmal als Referenz verwendeten sind H[yper]DT und P[romot]DT.

Die Ergebnisse zeigen, dass bei den Modellen ohne Feinabstimmung die Leistung von DT-Mem 8 Prozentpunkte höher ist als die von HDT.

Es ist zu beachten, dass der hier getestete HDT zwar nur 69.000 Parameter hat, aber auf einem vorab trainierten Modell mit 2,3 Millionen Parametern basiert, sodass die tatsächliche Parameteranzahl mehr als das Zehnfache der von DT-Mem (147.000) beträgt.

Papieradresse: https://arxiv.org/abs/2305.16338

Das obige ist der detaillierte Inhalt vonKI imitiert das Gedächtnismodell des menschlichen Gehirns und die Spielergebnisse stiegen um 29,9 %. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr