Heim >Technologie-Peripheriegeräte >KI >Selbstbewusste KI: AutoGPT

Selbstbewusste KI: AutoGPT

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-05-25 10:28:202213Durchsuche

1. Einführung

ChatGPT ist heutzutage in aller Munde und liegt in der Fähigkeit, reibungslose und kohärente Gespräche zu führen und gleichzeitig zu verstehen Kontext und Antwort basierend auf dem Kontext. Es kann schnell an verschiedene Anwendungsszenarien angepasst werden, beispielsweise in den Bereichen Kundenservice, Bildung, Unterhaltung und anderen Bereichen. ChatGPT kann als intelligenter Assistent eingesetzt werden, um Benutzern komfortable Dienste und Unterhaltungserlebnisse zu bieten.

Von GPT-3 bis GPT-4 können wir sehen, dass ChatGPT im kontinuierlichen Optimierungstraining große Erfolge in Bezug auf fortgeschrittenes Denken, Eingabeeinstellungen, Feinabstimmung des Verhaltens und Verständnis längerer Kontextinformationen erzielt hat Fortschritt.

Aber für dieses interaktive GPT-Modell hoffen wir, künstliche Intelligenz wie die im Film zu sehen, mit Selbstbewusstsein und der Fähigkeit, selbstständig zu lernen und sich weiterzuentwickeln. Es ist keine häufige Anleitung und Interaktion erforderlich. Wir müssen lediglich ein Ziel vorschlagen, und die KI kann die gesamte Ausführungsplanung und logische Verarbeitung autonom abschließen, weiterhin Selbstdemonstrationen und Optimierungen durchführen und schließlich das von uns vorgeschlagene Ziel erreichen.

Heute ist es also da, es ist die weiterentwickelte Version von ChatGPT: AutoGPT.

2. Was ist AutoGPT?

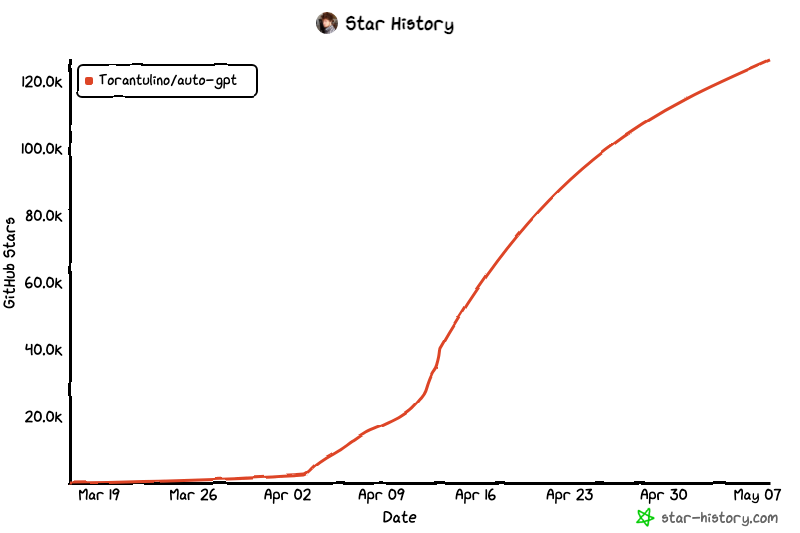

AutoGPT ist eine experimentelle Open-Source-Anwendung, die das GPT-4-Sprachmodell von OpenAI nutzt, um vollständig autonome und anpassbare KI-Agenten zu erstellen. Es wurde am 30. März 2023 von Toran Bruce Richards veröffentlicht.

Der Spieleentwickler Toran gründete eine Spielefirma namens Significant Gravitas.

In etwas mehr als einem Monat hat das Git-Projekt von AutoGPT mehr als 1,2 Millionen Sterne erhalten. Als eines der ersten Beispiele dafür, dass GPT-4 völlig autonom läuft, sprengt AutoGPT die Grenzen des Möglichen mit KI.

AutoGPT ist im Vergleich zu anderen KI-Tools einzigartig, da es unabhängig läuft, was bedeutet, dass Sie es nicht tun müssen Bearbeiten Sie das Modell entsprechend Ihren Anforderungen. Stattdessen schreiben Sie einfach Ihre Ziele auf und die KI erledigt den Rest für Sie. Dadurch verändert AutoGPT die Art und Weise, wie KI mit Menschen interagiert, grundlegend, da der Mensch keine aktive Rolle mehr übernehmen muss und gleichzeitig die gleiche oder eine bessere Ergebnisqualität als bei anderen KI-Anwendungen wie ChatGPT erhalten bleibt.

3. Wie funktioniert AutoGPT?

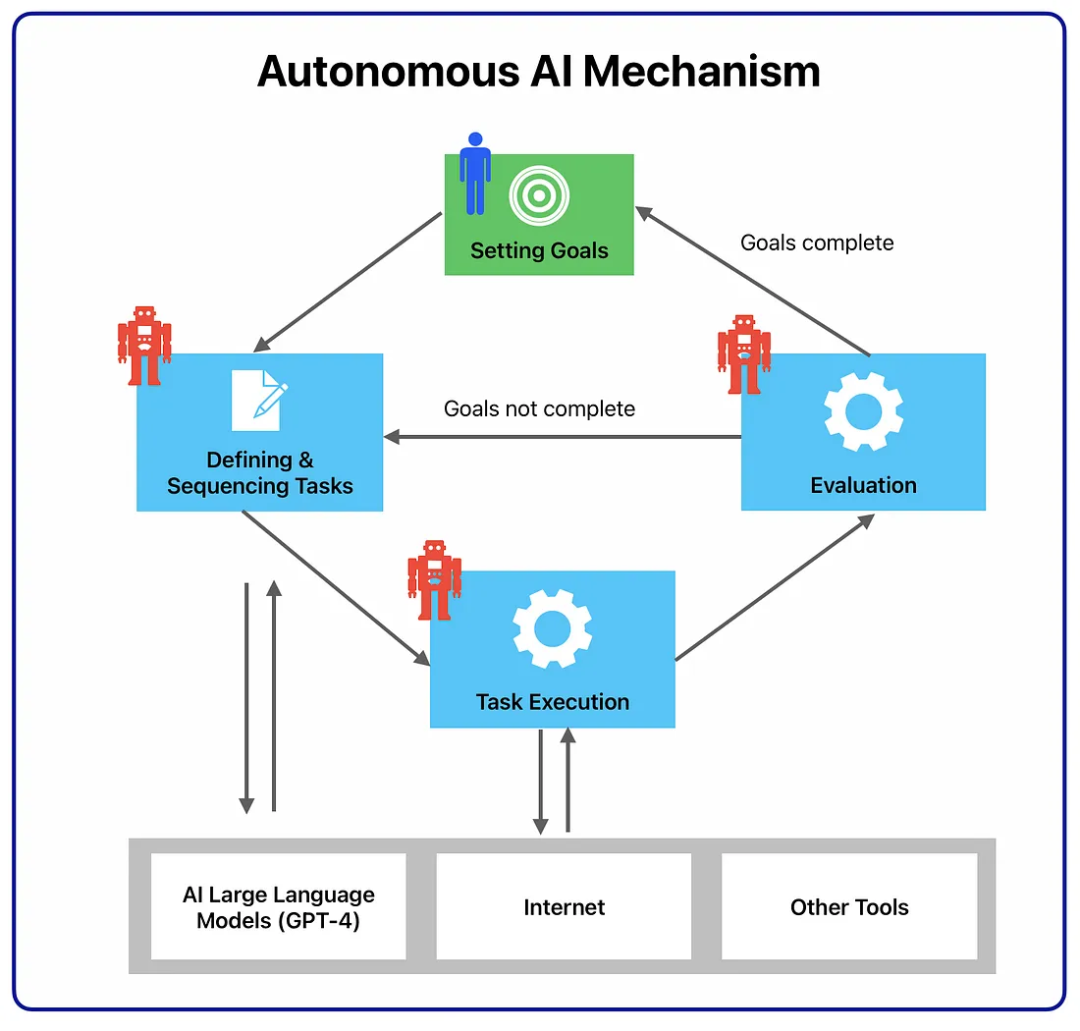

AutoGPT basiert auf einem autonomen KI-Mechanismus, bei dem das KI-System verschiedene KI-Agenten erstellt, um bestimmte Aufgaben zu erfüllen, darunter:

- Aufgabenerstellungsagent: Wenn Sie der erste KI-Agent sind, der mit dem Aufgabenerstellungsagenten interagiert, wenn Sie ein Ziel in AutoGPT eingeben. Basierend auf Ihren Zielen wird eine Liste mit Aufgaben und Schritten zur Erreichung dieser Ziele erstellt und an den Prioritätsagenten gesendet.

- Aufgabenprioritätsagent: Nach Erhalt der Aufgabenliste stellt der Prioritäts-KI-Agent sicher, dass die Reihenfolge korrekt und logisch ist, bevor er sie an den Ausführungsagenten sendet.

- Aufgabenausführungsagent: Nach Abschluss der Priorisierung erledigt der Ausführungsagent die Aufgaben einzeln. Dazu gehört die Nutzung von GPT-4, dem Internet und anderen Ressourcen, um Ergebnisse zu erzielen.

Die oben genannten Agenten kommunizieren miteinander. Wenn der Ausführungsagent also alle Aufgaben abschließt und die Ergebnisse nicht zufriedenstellend sind, kann er mit dem Aufgabenerstellungsagenten kommunizieren, um eine neue Aufgabenliste zu erstellen. Iterative Schleifen zwischen den drei Agenten, bis alle benutzerdefinierten Ziele erreicht sind.

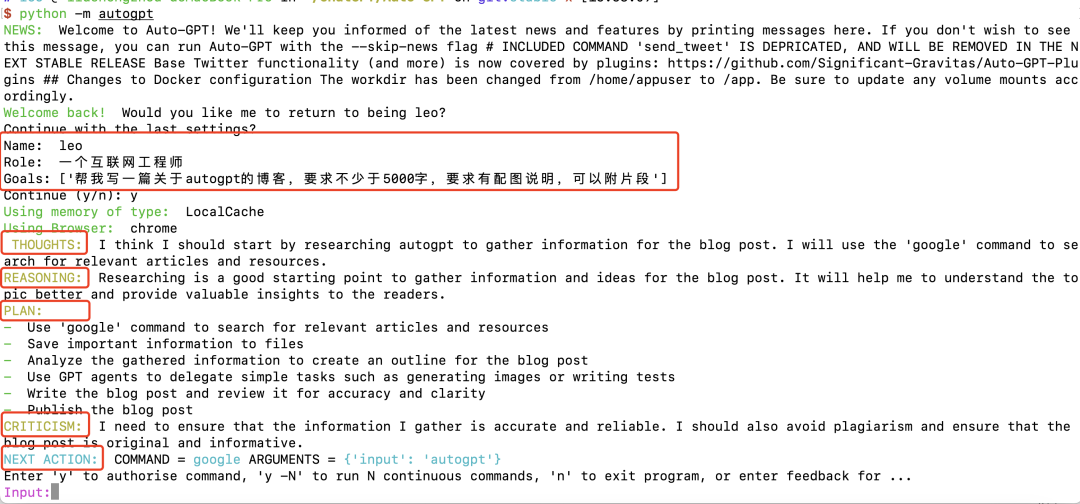

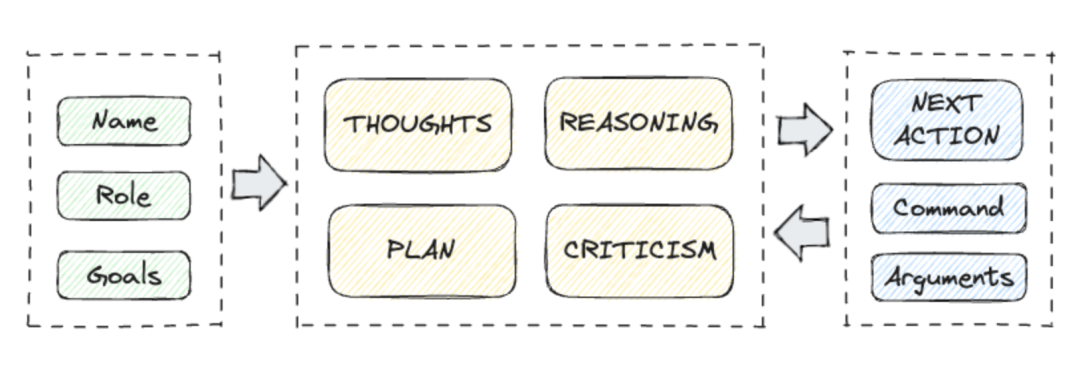

Die Aktionen des KI-Agenten werden auch auf der Benutzeroberfläche angezeigt und in vier Gruppen unterteilt: Denken, Denken, Planen, Urteilen.

- GEDANKEN: Der KI-Agent teilt seine Gedanken über das Ziel mit.

- REASONING: Wie die Argumentation von KI-Agenten ihre Ideen entwickelt und umsetzt.

- Plan (PLAN): Durch Analyse listet der KI-Agent den Plan für die zu erledigenden Aufgaben auf.

- KRITIK: Die KI beurteilt sich selbst, korrigiert Fehler und überwindet alle einschränkenden Probleme.

Durch die gemeinsame Nutzung dieses Berechnungsprozesses kann AutoGPT Versuch-und-Irrtum-Demonstrationen durchführen und eine gezielte Optimierungsverarbeitung durchführen, um alle aufgetretenen Probleme ohne Benutzereingriff zu überwinden.

4. Vergleich zwischen AutoGPT und ChatGPT?

Obwohl das zugrunde liegende LLM-Modell dasselbe ist, gibt es dennoch viele Unterschiede zwischen AutoGPT und ChatGPT.

4.1 Echtzeit-Einblicke

Das neueste von ChatGPT verwendete GPT-4-Modell wird auf denselben Daten trainiert wie GPT-3.5, das nur bis September 2021 verfügbar ist und mit dem Sie es nicht erhalten können ChatGPT Echtzeit-Dateninformationen, da Sie keinen Zugriff auf Websites und Online-Plattformen haben, um Informationen abzurufen und Informationen zu extrahieren.

Im Gegensatz dazu hat AutoGPT Zugriff auf das Internet. Es kann nicht nur im Internet surfen, sondern auch überprüfen, ob die Quelle legitim ist. Darüber hinaus kann AutoGPT auf jede Plattform zugreifen, um Aufgaben auszuführen. Wenn Sie die KI beispielsweise bitten, Interessenten für den Verkauf eines Produkts zu recherchieren und eine Outreach-E-Mail zu senden, erstellt und versendet sie die E-Mail direkt über Ihr Gmail-Konto.

4.2 Speicherverwaltung

Das Kontextfenster ist sehr wichtig, damit das Sprachmodell genaue Antworten liefert. Aber in LLM wie GPT-4 ist das Fenster auf 4000 bis 8000 Token begrenzt. Wenn die Anforderungen daher die Grenzwerte überschreiten, befolgt das Modell möglicherweise nicht alle Anweisungen korrekt, oder es weicht von der Tangente ab und liefert eine unzuverlässige Ausgabe.

Im Gegensatz dazu eignet sich AutoGPT gut für die Verwaltung des Kurzzeit- und Langzeitgedächtnisses. Durch die Verwendung von Datenbanken, lokalem Cache und Redis zur Speicherverwaltung können große Mengen an Kontextinformationen oder früheren Erfahrungen gespeichert werden, sodass das KI-Modell bessere Entscheidungen treffen kann.

4.3 Bildgenerierung

AutoGPT ist in der Lage, Bilder zu generieren, da es eine Vielzahl von Bildgenerierungs-Engines verwenden kann, wobei standardmäßig DALL-E verwendet wird. Wenn Sie die Bildgenerierung für Ihren KI-Agenten aktivieren möchten, müssen Sie auf die API von DALL-E zugreifen. Obwohl es sich um eine multimodale Eingabemethode handelt, ist diese Funktion derzeit in ChatGPT-4 nicht verfügbar.

3.4 Text-to-Speech

Sie können Text-to-Speech auf AutoGPT aktivieren, indem Sie python -m autogpt --speak in die Befehlszeile eingeben. Sie müssen den Befehl jedoch jedes Mal eingeben, wenn Sie mit AutoGPT interagieren. Sie können Ihrer Sprache auch verschiedene Klänge hinzufügen, indem Sie AutoGPT mit der vielseitigen KI-Sprachsoftware Eleven Labs verbinden.

5. Einschränkungen von AutoGPT

Es besteht kein Zweifel, dass Autonomie KI-Systemen eine neue Dimension verleiht. Gleichzeitig können wir die Einschränkungen und Risiken von AutoGPT nicht ignorieren. Nachfolgend sind einige wichtige Einschränkungen aufgeführt, die Sie beachten müssen.

5.1 Hohe Kosten

Während die Funktionen erstaunlich sind, kann die Praktikabilität von AutoGPT Sie enttäuschen. Da AutoGPT das teure GPT-4-Modell verwendet, können die Kosten für die Erledigung jeder Aufgabe selbst bei kleinen Aufgaben hoch sein. Dies liegt hauptsächlich daran, dass AutoGPT GPT-4 während der Schritte einer bestimmten Aufgabe mehrmals verwendet.

5.2 Bleibt häufig in einer Schleife hängen

Das häufigste Problem, mit dem Benutzer bei der Verwendung von AutoGPT konfrontiert sind, besteht darin, dass es in einer Schleife hängen bleibt. Wenn dies länger als ein paar Minuten anhält, kann es sein, dass Sie den Vorgang neu starten müssen. Dies geschieht, weil AutoGPT auf GPT-4 angewiesen ist, um Aufgaben korrekt zu definieren und zu zerlegen. Daher liegt ein Versuch-und-Irrtum-Problem vor, wenn das zugrunde liegende LLM nicht genügend Ergebnisse zurückgibt, damit AutoGPT Maßnahmen ergreifen kann.

5.3 Datensicherheit

Da AutoGPT vollständig autorisiert ist, kann es autonom laufen und auf Ihr System und das Internet zugreifen, z. B. über Ihr Twitter-Konto, die Anmeldung bei Github usw Durch die Verwendung von Suchmaschinen usw. können Ihre Daten gefährdet sein. AutoGPT verfügt über keinen Sicherheitsagenten. Daher müssen Sie bei der Verwendung von AutoGPT vorsichtig sein. Sie können nicht zulassen, dass das Modell weiter ausgeführt wird, ohne die richtigen Anweisungen und Sicherheitsrichtlinien zu geben.

5. Wie installiere ich AutoGPT?

Im Gegensatz zu anderen KI-Tools verfügt AutoGPT nicht über einen einfachen Registrierungsprozess, um auf seine Plattform und Funktionen zuzugreifen. Bevor Sie AutoGPT verwenden, müssen Sie verschiedene Software herunterladen, um die Anforderungen zu erfüllen. Im Folgenden finden Sie detaillierte Schrittvoraussetzungen:

Schritt 1: Laden Sie die erforderliche Software herunter

Zuerst müssen Sie über ein Git-Konto verfügen und Python3.1.0 oder höher installieren Sie müssen in der Lage sein, gängige Shell-Befehle geschickt zu verwenden oder über einen Docker-Container für den Projektstart und die Projektkonfiguration zu verfügen.

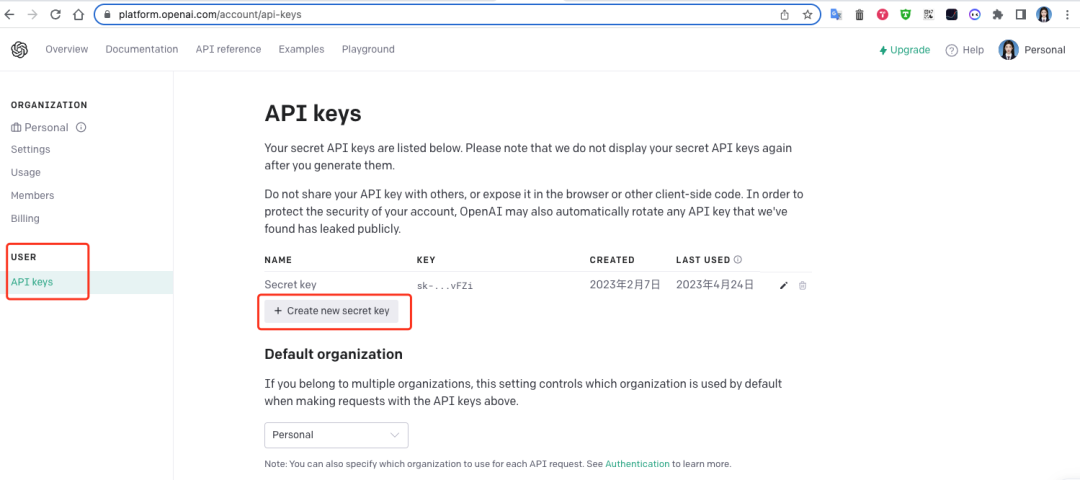

Schritt 2: Richten Sie Ihren OpenAI-API-Schlüssel ein

Wenn Sie noch keinen haben, erstellen Sie bitte ein OpenAI-Konto (natürlich, wenn Sie ein Konto erstellen möchten). China, das ist keine Selbstverständlichkeit) Für einfache Dinge können Sie auf andere Artikel im Internet verweisen, um ein Konto zu beantragen. Nachdem Sie Ihr OpenAI-Konto eröffnet haben, öffnen Sie BENUTZER – API-Schlüssel und gehen Sie zur Registerkarte API-Schlüssel. Sie sehen eine Option zum Erstellen eines Schlüssels. Klicken Sie darauf und kopieren Sie den Schlüssel.

Schritt 3: Klonen Sie die neueste Version von AutoGPT

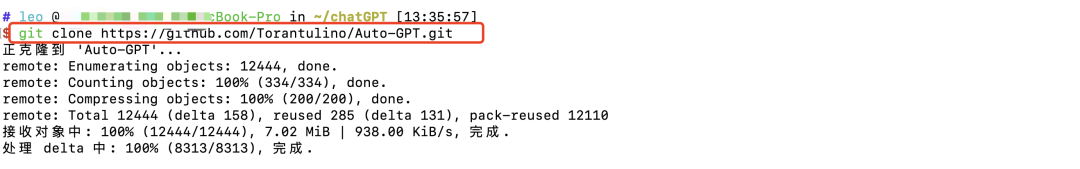

(1) Klonprojekt

Öffnen Sie das Befehlszeilentool und klonen Sie das Projekt lokal über den Befehl git clone https://github.com/Torantulino/Auto-GPT.git

#🎜 🎜#

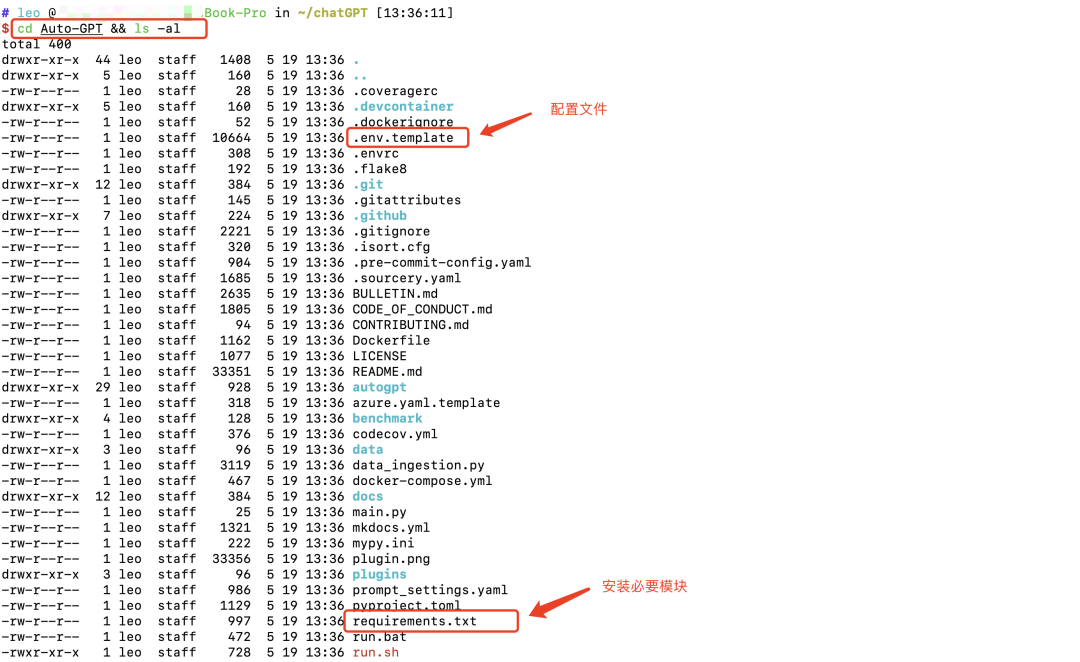

(2) Führen Sie die Installation aus

Nachdem Sie das Verzeichnis über den Befehl cd Auto-GPT && ls -al eingegeben haben, können Sie sehen, dass es viele Dateien gibt, darunter Anforderungen.txt. In dieser Datei sehen Sie die Module, die zum Ausführen von AutoGPT erforderlich sind.

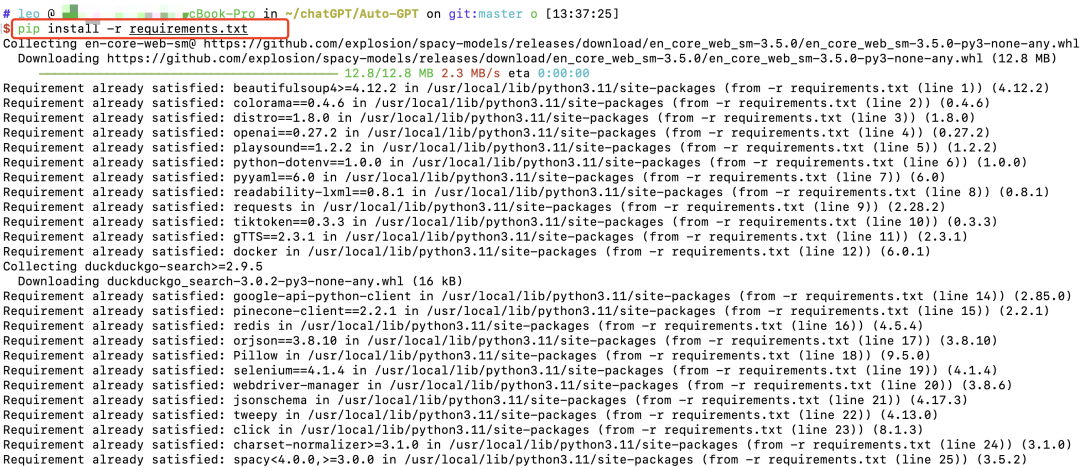

Um diese Module zu installieren, können Sie den Befehl pip install -r require.txt zum Herunterladen und Installieren verwenden.

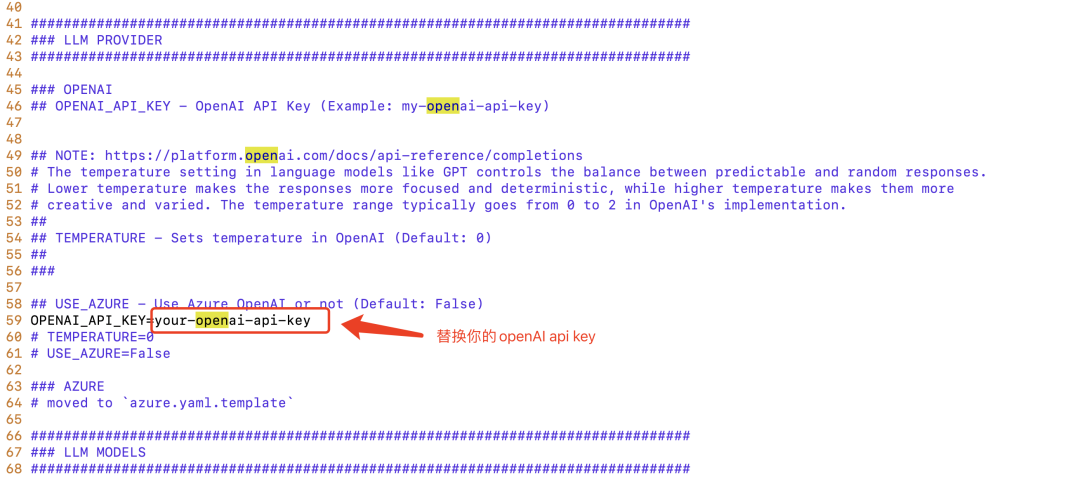

(3) Ändern Sie die Konfiguration

über den Befehl vim .env.template your-openai-api-key. Nachdem die Konfiguration abgeschlossen ist, führen Sie mv .env.template .env aus, um die Konfiguration vorzunehmen in Kraft treten

Andere verwandte Konfigurationen können nach Bedarf anhand der Tabelle vorgenommen werden

LLM PROVIDER |

OPENAI_API_KEY kann konfiguriert werden, ob verwendet werden soll AZUR |

LLM-MODELLEINSTELLUNGEN |

können openAI konfigurieren. Das bereitgestellte Token-Limit vermeidet übermäßige Anrufkostenverschwendung. Der Standardwert ist 4000-8000. |

LLM-Modell Sie können GPT-4 oder GPT-3.5-Turbo wählen | Bildgenerierung, Sie können Bildgröße und Bildgenerierungs-Engine konfigurieren: Dalle, HUGGINGFACE, STABLE DIFFUSION WEBUI |

| AUDIO TO TEXT PROVIDER | Voice to Text, Sie können HUGGINGFACE konfigurieren |

GIT-Anbieter für Repository-Aktionen |

github-Konfiguration, durch Konfigurieren des Github-API-Schlüssels Um auf Github zuzugreifen und es zu verwalten, können Sie verschiedene Browser konfigurieren: Firefox, Chrome, Safari, Suchmaschine: Google usw. Autorisieren Sie die offene API für den Zugriff auf das Internet, um Informationen abzurufen und die Zugriffstiefe zu verwalten | #🎜🎜 #

| Sie können MAC OS, STREAMELEMENTS und ELEVENLABS für die Text-to-Speech-Konfiguration verwenden#🎜🎜 # | #🎜🎜 # | TWITTER API

|

Twitter-Kontoverwaltung, verwalten und konfigurieren Sie Ihr Twitter-Konto, Konfigurieren Sie das Token für den Zugriff auf die entsprechende API. Einige Standardeinstellungen der AutoGPT-Konfiguration, z. B. Speicherverzeichnis, Schalter, Benutzeragent, KI-Einstellungen usw. (4) Beginnen Sie mit der Verwendung vonNachdem Sie die obige Konfiguration abgeschlossen haben, haben Sie die Grundkonfiguration von AutoGPT abgeschlossen. Zu diesem Zeitpunkt können Sie Ihre AutoGPT-Reise beginnen, indem Sie python -m autogpt befehlen!

Wie Sie auf dem Bild oben sehen können, erfordert AutoGPT, dass Sie der KI einen Namen geben [Name ] und eine Rollenpositionierung [Rolle], und Sie können Ziele [Ziele] dafür festlegen (bis zu 5 Ziele, wenn Sie nur ein Ziel haben, drücken Sie einfach die Eingabetaste). Nachdem Sie das Ziel festgelegt und erreicht haben, wird AutoGPT unabhängig nachdenken und Ihr Ziel analysieren [GEDANKEN]. Nachdem die Überlegungen abgeschlossen sind, beginnt es zu verstehen und darüber nachzudenken, wie das Ziel erreicht werden kann [GRÜNDUNG]. , und beginnen Sie dann mit dem eigenständigen Abbau. Ein spezifischer Plan [PLAN] wird erstellt und schließlich wird eine Überprüfung [KRITIK] vorgeschlagen, um sicherzustellen, dass der KI-Agent Fehler korrigiert und richtige Entscheidungen trifft. Nach Abschluss der oben genannten Verhaltensplanung fordert AutoGPT die auszuführenden Anweisungen und Aktionen auf [NÄCHSTE AKTION], die den spezifischen Ausführungsbefehl [BEFEHL] und Parameter [ARGUMENTE] enthält kann identifiziert werden, um unerwartete Risiken wie Datenlecks zu vermeiden. Hier können Sie y oder n verwenden, um die nachfolgenden Befehlsaktionen von AutoGPT zu autorisieren oder zu verweigern.

AutoGPT durchläuft die oben genannten Schritte mehrmals. Da AutoGPT jedes Mal Kontext und historische Erfahrungen speichern kann Mit der Zeit wird er auf der Grundlage der Feedback-Ergebnisse tiefer nachdenken, einen besseren Plan formulieren und schließlich die Pläne auflisten, die er umsetzen möchte, und wiederholt versuchen, sie zu ergänzen, bis Sie Ihre erwarteten Ziele erreichen. AutoGPT durchläuft die oben genannten Schritte mehrmals. Da AutoGPT Kontext und historische Erfahrungen speichern kann, wird es jedes Mal auf der Grundlage der Feedback-Ergebnisse tiefer nachdenken und schließlich einen besseren Plan formulieren Um den Plan auszuführen, versuchen Sie es immer wieder und ergänzen Sie ihn, bis Sie Ihr gewünschtes Ziel erreicht haben. (5) Docker verwendetNatürlich können Sie Docker auch zum Ausführen verwenden: <code>// 最简单的方式就是通过docker-composedocker-compose build auto-gptdocker-compose run --rm auto-gpt// 使用docker命令构建docker build -t auto-gpt .docker run -it --env-file=.env -v $PWD:/app auto-gpt</code> Sie können zusätzliche Parameter übergeben, zum Beispiel die laufende Methode --gpt3only und --continuous Modus: <code>// docker-composedocker-compose run --rm auto-gpt --gpt3only --continuous// docker docker run -it --env-file=.env -v $PWD:/app --rm auto-gpt --gpt3only --continuous</code> 6. ZusammenfassungIm Vergleich zur herkömmlichen Textgenerierungstechnologie haben wir festgestellt, dass die Entwicklung der Fähigkeiten von AutoGPT erstaunlich ist. Indem es Ihre Ziele analysiert, zerlegt es diese automatisch in die Aufgaben, die es ausführen muss, und optimiert, verbessert und fasst sie basierend auf vorhandenen Erfahrungen und Entscheidungen während des Ausführungsprozesses zusammen. Gleichzeitig bietet AutoGPT auch viele Möglichkeiten, dies zu tun Es kann Suchmaschinen verwenden, um die erforderlichen Informationen über Suche, Github, Web-Tools und andere Kanäle herunterzuladen und zu verfeinern, und schließlich die von Ihnen gesetzten Ziele durch lokales Caching, Sprachkonvertierung, Bildgenerierung und andere Plug-in-Funktionen erreichen. Diese Form der Selbsterkenntnis, Selbstwiederholung und Aktualisierung kommt der künstlichen Intelligenz wie Moss im Film „The Wandering Earth“ sehr nahe! Die letzte Frage ist: Wird dieser Artikel automatisch von AutoGPT generiert? |

Das obige ist der detaillierte Inhalt vonSelbstbewusste KI: AutoGPT. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr