Heim >Technologie-Peripheriegeräte >KI >Halluzination? Auch Musks TruthGPT kommt damit nicht zurecht! Der Mitbegründer von OpenAI sagt, es sei kompliziert

Halluzination? Auch Musks TruthGPT kommt damit nicht zurecht! Der Mitbegründer von OpenAI sagt, es sei kompliziert

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-05-23 19:13:04759Durchsuche

Letzten Monat forderte Musk verzweifelt eine sechsmonatige Aussetzung der Super-KI-Forschung und -Entwicklung.

Schon bald konnte Lao Ma nicht still sitzen und kündigte offiziell den Start einer KI-Plattform namens TruthGPT an.

Musk sagte einmal, dass TruthGPT die „größte wahrheitssuchende künstliche Intelligenz“ sein wird, die versuchen wird, die Natur des Universums zu verstehen.

Er betonte, dass eine KI, der das Verständnis des Universums am Herzen liegt, die Menschheit wahrscheinlich nicht ausrotten wird, weil wir ein interessanter Teil des Universums sind.

Allerdings kann bisher kein Sprachmodell mit „Illusion“ umgehen.

Kürzlich erklärte der Mitbegründer von OpenAI, warum die Verwirklichung der hohen Ideale von TruthGPT so schwierig ist.

TruthGPT-Ideal ist eine Blase?

Das TruthGPT, das Musks X.AI aufbauen möchte, ist ein ehrliches Sprachmodell.

Dabei zielen wir direkt auf ChatGPT ab.

Denn früher produzierten KI-Systeme wie ChatGPT häufig klassische Halluzinationsfälle wie fehlerhafte Ausgaben und unterstützten sogar Berichte über bestimmte politische Überzeugungen.

Obwohl ChatGPT Benutzern mehr Kontrolle über Sprachmodelle zur Lösung von Problemen ermöglicht, ist „Illusion“ immer noch ein Kernproblem, mit dem sich die Unternehmen für künstliche Intelligenz von OpenAI, Google und Musk in Zukunft befassen müssen.

OpenAI-Mitbegründer und Forscher John Schulman diskutierte diese Herausforderungen und wie man mit ihnen umgeht, in seinem Vortrag „RL and Truthfulness – Towards TruthGPT“.

Warum gibt es „Halluzinationen“?

Laut Schulman können Halluzinationen grob in zwei Typen unterteilt werden:

1 „Mustervervollständigungsverhalten“, das heißt, das Sprachmodell kann seine eigene Unsicherheit nicht ausdrücken, die Prämisse in der Aufforderung nicht in Frage stellen oder fortfahren bevor Fehler gemacht wurden.

2. Das Modell hat falsch geraten.

Da das Sprachmodell einen Wissensgraphen darstellt, der Fakten aus den Trainingsdaten in seinem eigenen Netzwerk enthält, kann Feinabstimmung als Lernen einer Funktion verstanden werden, die auf diesem Wissensgraphen operiert und Token-Vorhersagen ausgibt.

Ein Feinabstimmungsdatensatz könnte beispielsweise die Frage „Was ist das Genre von Star Wars?“ und die Antwort „Science Fiction“ enthalten.

Wenn diese Informationen bereits in den ursprünglichen Trainingsdaten enthalten sind, also Teil des Wissensgraphen sind, lernt das Modell keine neuen Informationen, sondern ein Verhalten – und gibt die richtige Antwort aus. Diese Art der Feinabstimmung wird auch „Behavioral Cloning“ genannt.

Aber das Problem ist, wenn die Frage „Wie heißt Han Solos Spin-off-Film?“ im Feinabstimmungsdatensatz auftaucht.

Aber wenn die Antwort „Solo“ nicht Teil des ursprünglichen Trainingsdatensatzes (noch Teil des Wissensgraphen) ist, lernt das Netzwerk zu antworten, auch wenn es die Antwort nicht kennt.

Bringen Sie dem Netzwerk bei, Antworten zu fabrizieren, indem Sie sie mithilfe von Antworten verfeinern, die tatsächlich richtig sind, aber nicht im Wissensgraphen enthalten sind – d. h. „Halluzinationen“ erzeugen. Umgekehrt führt das Training mit falschen Antworten dazu, dass das Netzwerk Informationen zurückhält.

Daher sollte Verhaltensklonen idealerweise immer auf Netzwerkwissen basieren, aber dieses Wissen ist dem menschlichen Arbeiter, der den Datensatz erstellt oder auswertet, wie zum Beispiel bei der Anweisungsoptimierung, oft unbekannt.

Laut Schulman besteht dieses Problem auch dann, wenn andere Modelle fein abgestimmte Datensätze erstellen, wie es bei der Alpaka-Formel der Fall ist.

Er prognostiziert, dass kleinere Netzwerke mit kleineren Wissensgraphen nicht nur lernen werden, die Ausgabe von ChatGPT zu nutzen, um Antworten zu geben und Anweisungen zu befolgen, sondern auch lernen werden, häufiger zu halluzinieren.

Wie bekämpft OpenAI Halluzinationen?

Zunächst können Sprachmodelle bei einfachen Fragen vorhersagen, ob sie in den meisten Fällen die Antwort kennen, und auch Unsicherheit ausdrücken.

Daher sagte Schulman, dass das Modell bei der Feinabstimmung des Datensatzes lernen muss, wie man Unsicherheit ausdrückt, wie man mit Situationen umgeht, in denen die Prämisse geändert wird und wenn Fehler anerkannt werden.

Instanzen dieser Situationen müssen dem Modell mitgeteilt werden, damit es lernen kann.

Aber die Modelle sind immer noch schlecht im Timing geschult, das heißt, sie wissen nicht, wann sie diese Vorgänge durchführen sollen.

Schulman sagte, dass hier Reinforcement Learning (RL) ins Spiel kommt. Zum Beispiel Reinforcement Learning with Human Feedback (RLHF).

Durch die Anwendung von RL kann das Modell „Verhaltensgrenzen“ lernen und lernen, wann welches Verhalten ausgeführt werden muss.

Eine weitere Schwierigkeit ist die Fähigkeit, Quellen abzurufen und zu zitieren.

Die Frage ist: Warum halluziniert ChatGPT trotz der Fähigkeit, Verhalten und RLHF zu kopieren?

Der Grund liegt in der Schwierigkeit des Problems selbst.

Obwohl die obige Methode für kurze Fragen und Antworten gut funktioniert, treten bei Einstellungen für lange Formate, die in ChatGPT üblich sind, andere Probleme auf.

Einerseits ist eine völlig falsche Antwort unwahrscheinlich. In den meisten Fällen vermischen sich falsch und richtig.

Im Extremfall kann es sich nur um einen Fehler in 100 Codezeilen handeln.

In anderen Fällen sind die Informationen nicht im herkömmlichen Sinne falsch, sondern eher irreführend. Daher ist es in einem System wie ChatGPT schwierig, die Qualität der Ausgabe im Hinblick auf Informationsgehalt oder Korrektheit zu messen.

Aber diese Messung ist sehr wichtig für RL-Algorithmen, die darauf ausgelegt sind, komplexe Verhaltensgrenzen zu trainieren.

Derzeit verlässt sich OpenAI auf das rankenbasierte Belohnungsmodell von RLHF, das vorhersagen kann, welche von zwei Antworten seiner Meinung nach besser ist, aber kein wirksames Signal gibt, um zu klären, welche Antwort besser oder informativer ist richtig oder richtig.

Schulman sagte, es fehle an der Fähigkeit, dem Modell Feedback zu geben, um feine Verhaltensgrenzen zu lernen. Und diese Art feiner Verhaltensgrenzen ist der mögliche Weg, die Illusion zu lösen.

Darüber hinaus wird dieser Prozess durch menschliches Versagen im RLHF-Kennzeichnungsprozess noch komplizierter.

Obwohl Schulman RL als eine der wichtigsten Möglichkeiten zur Reduzierung von Halluzinationen ansieht, glaubt er, dass es immer noch viele ungelöste Probleme gibt.

Abgesehen davon, wie das oben erwähnte Belohnungsmodell aussehen muss, um korrektes Verhalten anzuleiten, verlässt sich RLHF derzeit nur auf menschliches Urteilsvermögen.

Dies kann die Wissensgenerierung erschweren. Denn Vorhersagen über die Zukunft führen manchmal zu weniger überzeugenden Präsentationen.

Allerdings glaubt Schulman, dass die Generierung von Wissen der nächste wichtige Schritt in Sprachmodellen ist. Gleichzeitig glaubt er, dass die theoretische Konstruktion von Problemen wie der Vorhersage der Zukunft und der Angabe von Inferenzregeln der ist nächster Schritt, der dringend gelöst werden muss. Eine mögliche Lösung, sagte Schulman, bestehe darin, andere KI-Modelle zum Trainieren von Sprachmodellen zu verwenden.

OpenAI glaubt auch, dass diese Methode für die KI-Ausrichtung sehr sinnvoll ist.

ChatGPT-Architekt

Als ChatGPT-Architekt kam John Schulman 2015 als Joint Venture zu OpenAI, als er noch promovierte . Einer der Gründer.

In einem Interview erklärte Schulman den Grund, warum er OpenAI beigetreten ist:

Obwohl es damals etwas verrückt schien, über AGI zu sprechen, hielt ich es für vernünftig, darüber nachzudenken, und ich wollte an einem Ort sein, an dem man reden kann über AGI war akzeptabel.

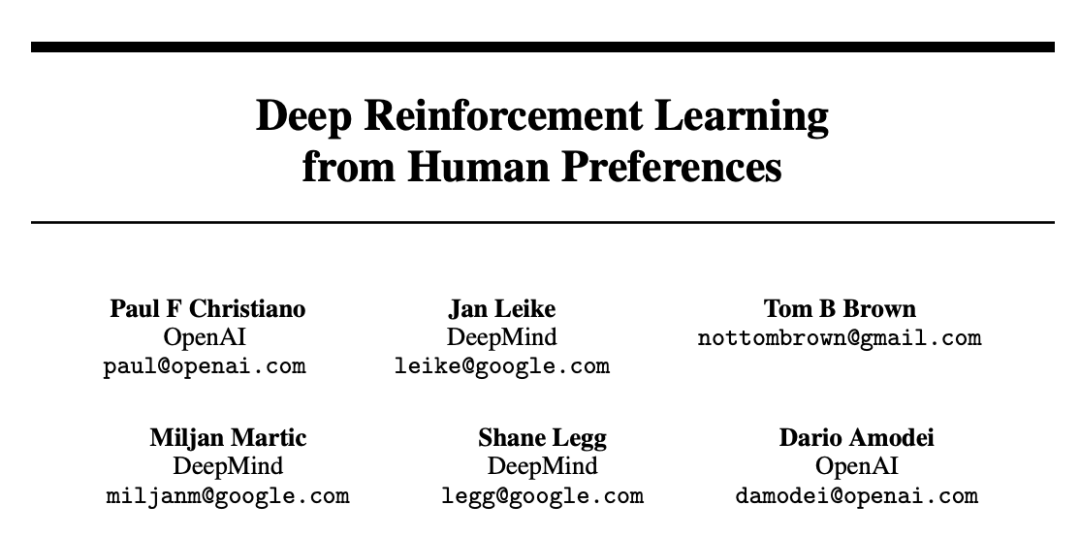

Darüber hinaus lässt sich laut Schulman die Idee von OpenAI, Human Feedback Reinforcement Learning (RLHF) in ChatGPT einzuführen, auf die Zeit vor 17 Jahren zurückführen.

Zu dieser Zeit war er auch Mitglied von OpenAI und veröffentlichte einen Artikel „Deep Reinforcement Learning from Human Preferences“, in dem diese Methode erwähnt wurde.

Papieradresse: https://arxiv.org/pdf/1706.03741.pdf#🎜 🎜#

Das OpenAI-Sicherheitsteam arbeitet daran, weil es seine Modelle an menschlichen Vorlieben ausrichten möchte – und versucht, dass die Modelle wirklich auf Menschen hören und dies auch versucht was Menschen tun wollen. Als GPT-3 die Ausbildung abschloss, beschloss Schulman, sich diesem Trend anzuschließen, weil er das Potenzial der gesamten Forschungsrichtung erkannte.

Auf die Frage, was seine erste Reaktion war, als er ChatGPT zum ersten Mal nutzte, verrieten Schulmans Worte „keine Emotionen“.

Ich erinnere mich noch daran, dass ChatGPT letztes Jahr herauskam, was bei vielen Menschen sofort das Gehirn explodieren ließ.

Und niemand bei OpenAI ist von ChatGPT begeistert. Da es sich beim veröffentlichten ChatGPT um ein schwächeres Modell auf Basis von GPT-3.5 handelte, spielten Kollegen damals mit GPT-4.

Damals war niemand bei OpenAI von ChatGPT begeistert, weil es ein so leistungsfähigeres und intelligenteres Modell gab, das bereits trainiert worden war.

In Bezug auf die nächste Grenze der künstlichen Intelligenz in der Zukunft sagte Schulman, dass die KI sich bei schwierigeren Aufgaben weiter verbessert und dann das Problem entsteht: Was Sollten Menschen dies tun und bei welchen Aufgaben können Menschen mit Hilfe großer Modelle mehr Einfluss nehmen und mehr Arbeit leisten?

Das obige ist der detaillierte Inhalt vonHalluzination? Auch Musks TruthGPT kommt damit nicht zurecht! Der Mitbegründer von OpenAI sagt, es sei kompliziert. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr