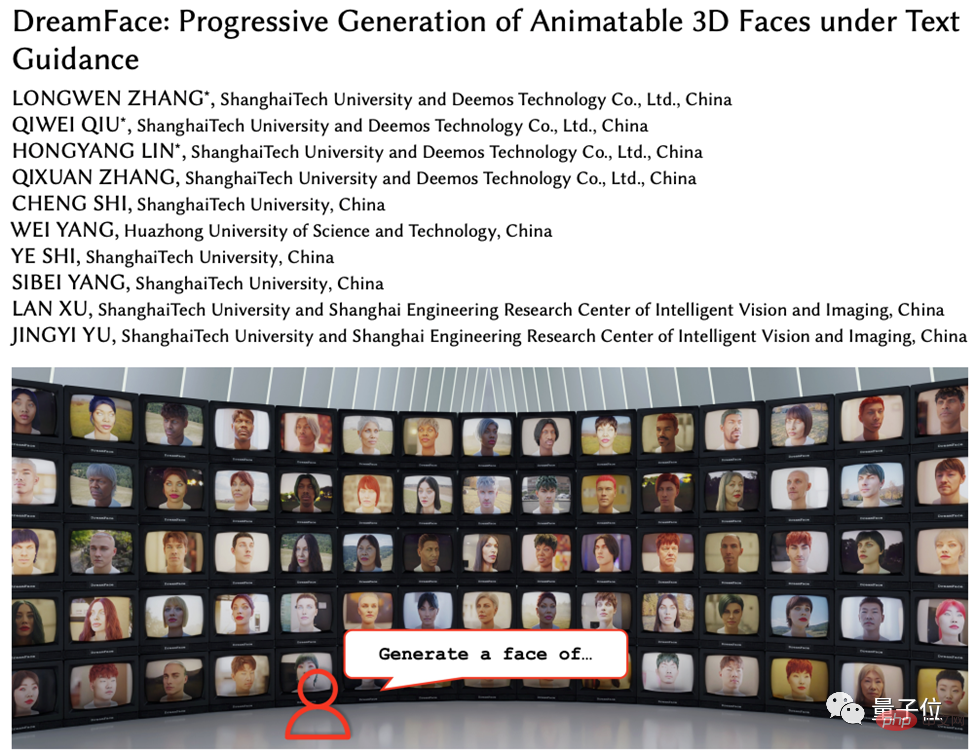

Heim >Technologie-Peripheriegeräte >KI >Erzeugen Sie in fünf Minuten einen digitalen 3D-Menschen von Marvel! Der amerikanische Spider-Man und der Joker können es alle und die Gesichtsdetails werden in High Definition wiederhergestellt.

Erzeugen Sie in fünf Minuten einen digitalen 3D-Menschen von Marvel! Der amerikanische Spider-Man und der Joker können es alle und die Gesichtsdetails werden in High Definition wiederhergestellt.

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-05-05 22:40:051834Durchsuche

Mit der Entwicklung der Computergrafik wird die 3D-Generierungstechnologie allmählich zu einem Forschungsschwerpunkt. Allerdings gibt es noch viele Herausforderungen bei der Generierung von 3D-Modellen aus Text oder Bildern.

Kürzlich haben Unternehmen wie Google, NVIDIA und Microsoft 3D-Generierungsmethoden auf Basis neuronaler Strahlungsfelder (NeRF) eingeführt, diese Methoden weisen jedoch Kompatibilitätsprobleme und Einschränkungen mit herkömmlicher 3D-Rendering-Software (wie Unity, Unreal Engine, Maya, usw.) seine breite Anwendung in praktischen Anwendungen.

Zu diesem Zweck schlug das Forschungs- und Entwicklungsteam von Yingmo Technology und der ShanghaiTech University ein textgesteuertes progressives 3D-Generierungsframework vor, das diese Probleme lösen soll.

Generieren Sie 3D-Assets basierend auf Textbeschreibungen

Das vom Forschungsteam vorgeschlagene textgesteuerte progressive 3D-Generierungsframework (kurz DreamFace) kombiniert das visuelle Sprachmodell, das implizite Diffusionsmodell und die physikbasierte Materialdiffusionstechnologie, um computergestützte konforme Grafikproduktionsstandard-3D-Assets.

Die Innovation dieses Frameworks liegt in seinen drei Modulen: Geometriegenerierung, physikbasierte Materialdiffusionsgenerierung und Animationsfähigkeitsgenerierung.

Diese Arbeit wurde von der Top-Zeitschrift Transactions on Graphics angenommen und wird auf der SIGGRAPH 2023, der führenden internationalen Computergrafikkonferenz, präsentiert.

Projektwebsite: https://sites.google.com/view/dreamface

Vordruckpapier: https://arxiv.org/abs/2304.03117

Webdemo: https: //hyperhuman.top

HuggingFace Space: https://huggingface.co/spaces/DEEMOSTECH/ChatAvatar

So implementieren Sie die drei Hauptfunktionen von DreamFace

DreamFace umfasst hauptsächlich drei Module, die auf der Geometriegenerierung basieren Physik Materialdiffusion und Animationsfähigkeiten werden generiert. Im Vergleich zu früheren Arbeiten zur 3D-Generierung gehören zu den Hauptbeiträgen dieser Arbeit:

- Vorgeschlagenes DreamFace, ein neuartiges Generationsschema, das aktuelle visuelle Sprachmodelle mit animierbaren und physikalisch materialisierbaren Gesichtselementen kombiniert, durch progressives Formellernen zur Trennung von Geometrie, Aussehen und Animationsmöglichkeiten.

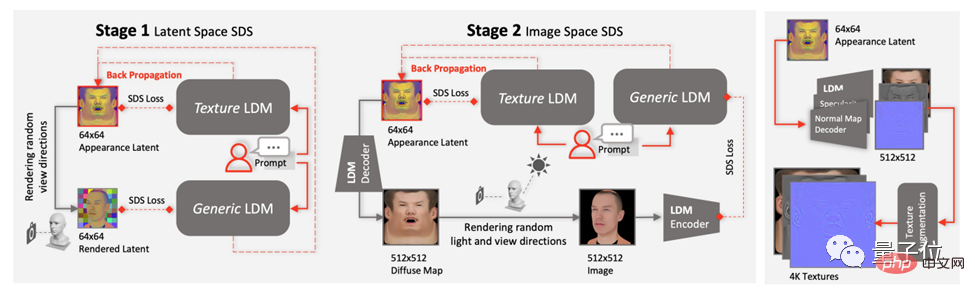

- Führt das Design der Zweikanal-Erscheinungsgenerierung ein, indem ein neuartiges Materialdiffusionsmodell mit einem vorab trainierten Modell kombiniert und gleichzeitig eine zweistufige Optimierung im latenten Raum und im Bildraum durchgeführt wird.

- Gesichtselemente mit BlendShapes oder generierten personalisierten BlendShapes werden animiert und demonstrieren zusätzlich die Verwendung von DreamFace für die Gestaltung natürlicher Charaktere.

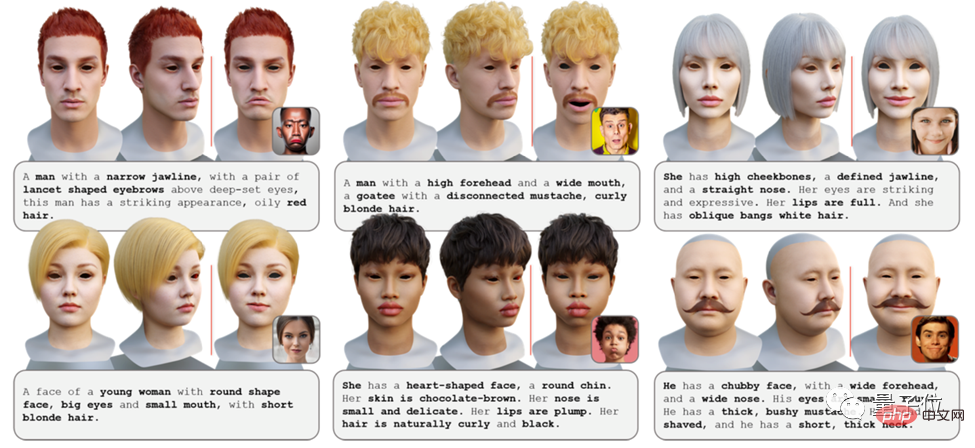

Geometriegenerierung: Dieses Modul generiert geometrische Modelle basierend auf Textaufforderungen über das CLIP-Auswahlframework (Contrastive Language-Image Pre-Training).

Stichproben Sie zunächst zufällig Kandidaten aus dem geometrischen Gesichtsparameterraum und wählen Sie dann basierend auf Textaufforderungen das grobe geometrische Modell mit der höchsten Übereinstimmungsbewertung aus.

Als nächstes werden dem groben Geometriemodell mithilfe des Implicit Diffusion Model (LDM) und der Scored Distillation Sampling (SDS)-Verarbeitung Gesichtsdetails und detaillierte Normalkarten hinzugefügt, um hochpräzise Geometrie zu erzeugen.

Physikalisch basierte Materialdiffusionsgenerierung: Dieses Modul generiert Gesichtstexturen für vorhergesagte Geometrie und Texthinweise. Zunächst wird das LDM feinabgestimmt, um zwei Diffusionsmodelle zu erhalten.

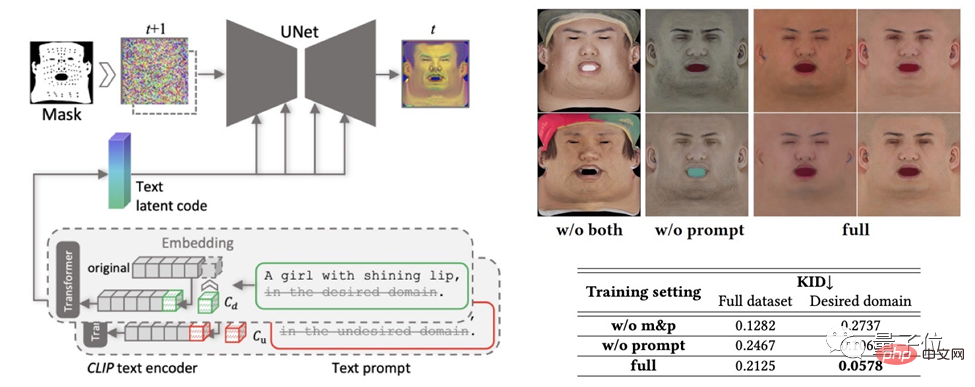

Die beiden Modelle werden dann durch ein gemeinsames Trainingsschema koordiniert, eines für die direkte Entrauschung von U-Texturkarten und das andere für überwachte gerenderte Bilder. Darüber hinaus werden eine Hinweis-Lernstrategie und eine Nicht-Gesichtsbereichsmaskierung eingesetzt, um die Qualität der generierten diffusen Karten sicherzustellen.

Abschließend wenden Sie das Super-Resolution-Modul an, um physikalisch basierte 4K-Texturen für ein hochwertiges Rendering zu generieren.

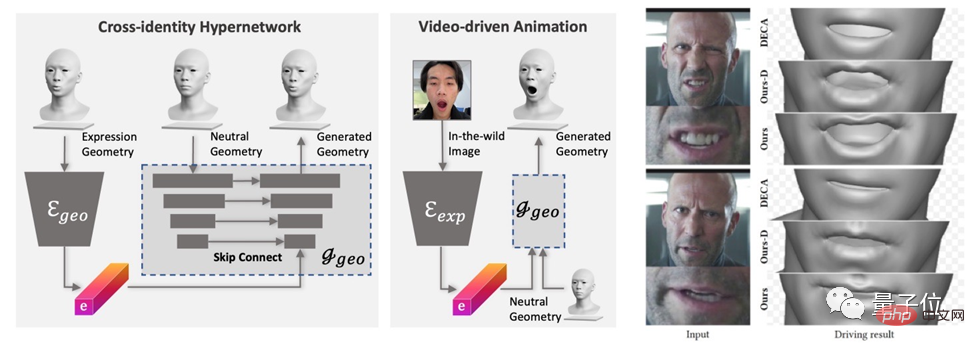

Animationsfunktionsgenerierung: Das von DreamFace generierte Modell verfügt über Animationsfunktionen. Im Gegensatz zu herkömmlichen BlendShapes-basierten Methoden animiert dieses Framework das Neutralmodell, indem es einzigartige Verformungen vorhersagt, um personalisierte Animationen zu generieren.

Trainieren Sie zunächst den geometrischen Generator, um den latenten Ausdrucksraum zu lernen, und trainieren Sie dann den Ausdrucksencoder, um Ausdrucksmerkmale aus RGB-Bildern zu extrahieren. Abschließend werden mithilfe monokularer RGB-Bilder personalisierte Animationen generiert.

Generieren Sie spezifizierte 3D-Assets in 5 Minuten

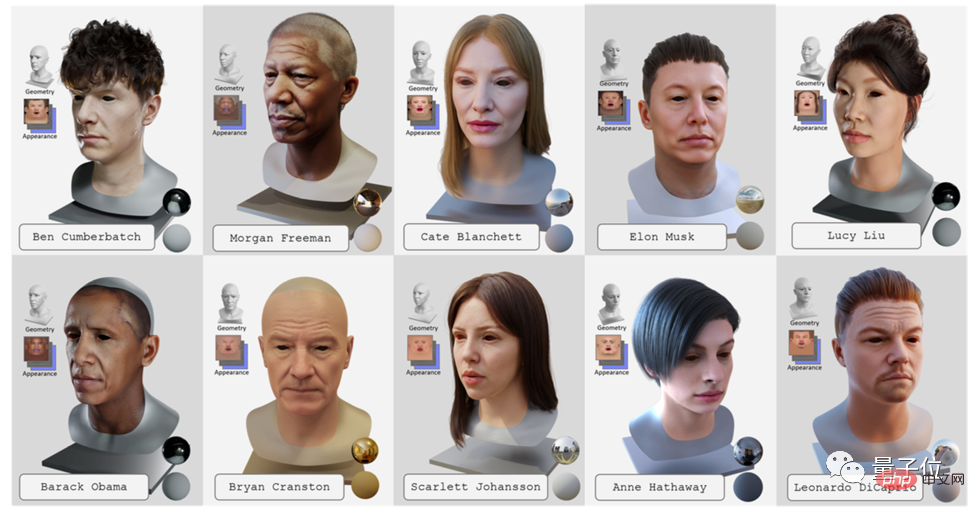

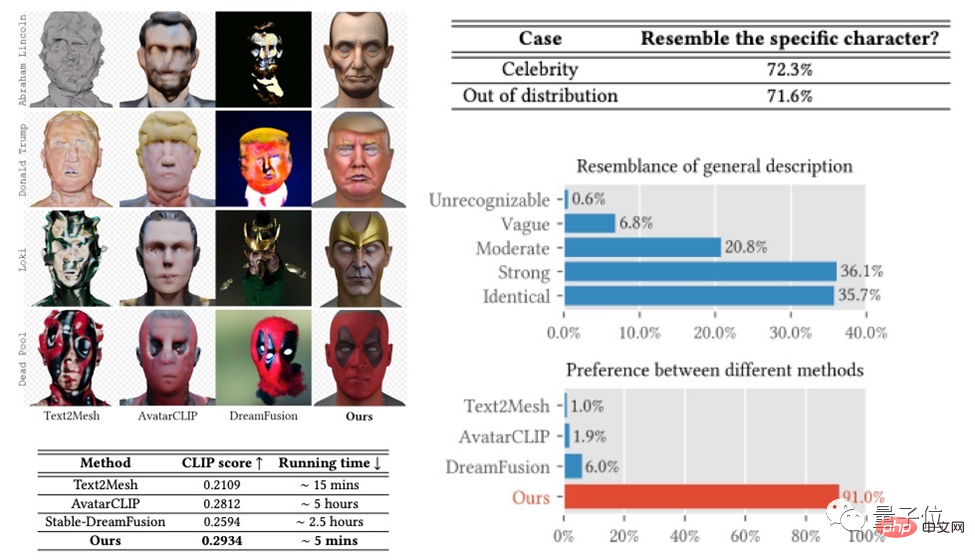

Das DreamFace-Framework hat bei Aufgaben wie der Generierung von Prominenten und Beschreibungen gute Ergebnisse erzielt und bei Benutzerbewertungen Ergebnisse erzielt, die frühere Arbeiten übertreffen.

Gleichzeitig weist es gegenüber bestehenden Methoden deutliche Laufzeitvorteile auf.

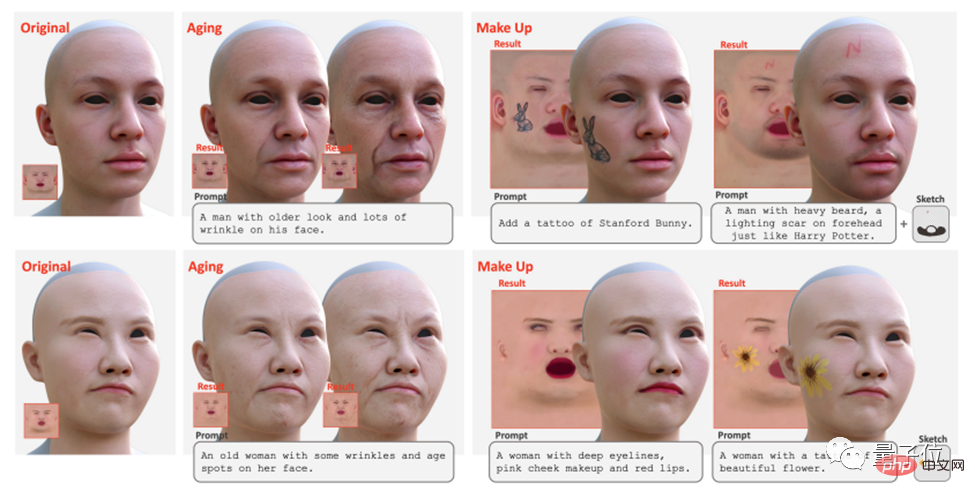

Darüber hinaus unterstützt DreamFace die Texturbearbeitung mithilfe von Tipps und Skizzen, um globale Bearbeitungseffekte (z. B. Alterung, Make-up) und lokale Bearbeitungseffekte (z. B. Tätowierungen, Bärte, Muttermale) zu erzielen.

Kann in Film, Fernsehen, Spielen und anderen Branchen verwendet werden

Als textgesteuertes progressives 3D-Generierungsframework kombiniert DreamFace das visuelle Sprachmodell, das implizite Diffusionsmodell und die physikbasierte Materialdiffusionstechnologie Erreichen Sie eine 3D-Generierung mit hoher Präzision, Effizienz und guter Kompatibilität.

Dieses Framework bietet eine effektive Lösung zur Lösung komplexer 3D-Generierungsaufgaben und soll weitere ähnliche Forschungs- und Technologieentwicklungen fördern.

Darüber hinaus wird die physikalisch basierte Materialdiffusionsgenerierung und die Generierung von Animationsfähigkeiten die Anwendung der 3D-Generierungstechnologie in der Film- und Fernsehproduktion, der Spieleentwicklung und anderen verwandten Branchen fördern.

Das obige ist der detaillierte Inhalt vonErzeugen Sie in fünf Minuten einen digitalen 3D-Menschen von Marvel! Der amerikanische Spider-Man und der Joker können es alle und die Gesichtsdetails werden in High Definition wiederhergestellt.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr