Heim >Technologie-Peripheriegeräte >KI >Interpretation des neuesten HuggingGPT-Papiers von Microsoft. Was haben Sie gelernt?

Interpretation des neuesten HuggingGPT-Papiers von Microsoft. Was haben Sie gelernt?

- WBOYnach vorne

- 2023-04-29 19:40:051003Durchsuche

Microsoft hat kürzlich einen Artikel zu HuggingGPT veröffentlicht. Ursprüngliche Adresse: HuggingGPT: KI-Aufgaben lösen mit ChatGPT und seinen Freunden in Hugging Face[1]. Dieser Artikel ist eine Interpretation des Papiers.

HuggingGPT: KI-Aufgaben lösen mit ChatGPT und seinen Freunden in Hugging Face. Ins Chinesische übersetzt: HuggingGPT: KI-Aufgaben lösen mit ChatGPT und seinen Freunden in Hugging Face.

Was sind seine Freunde? Nach dem Lesen des Artikels sollte es sich um das große Sprachmodell handeln, das durch GPT4 und verschiedene Expertenmodelle dargestellt wird. Das in diesem Artikel erwähnte Expertenmodell bezieht sich auf das allgemeine Modell und ist ein Modell in einem bestimmten Bereich, beispielsweise ein Modell im medizinischen Bereich, ein Modell im Finanzbereich usw.

Hugging Face ist eine Open-Source-Community und Plattform für maschinelles Lernen.

Sie können den Hauptinhalt der Arbeit schnell verstehen, indem Sie die folgenden Fragen beantworten.

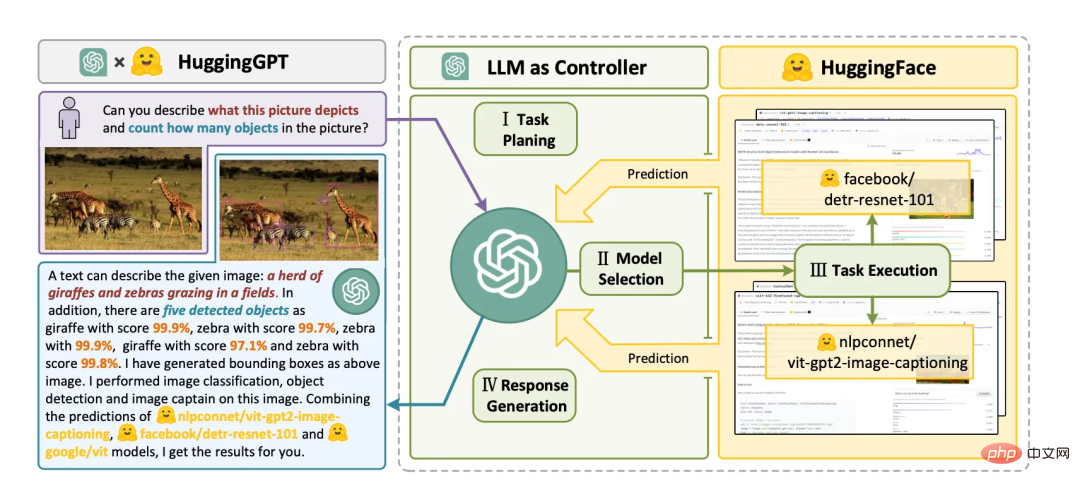

- Was ist die Idee hinter HuggingGPT und wie funktioniert es? Model (LLM) fungiert als Controller zur Verwaltung von KI-Modellen und zur Lösung komplexer KI-Aufgaben. HuggingGPT nutzt die Stärken von LLM in Bezug auf Verständnis und Argumentation, um Benutzeranfragen zu analysieren und in mehrere Teilaufgaben zu zerlegen. Basierend auf der Beschreibung des Expertenmodells ordnet HuggingGPT dann jeder Aufgabe das am besten geeignete Modell zu und integriert die Ergebnisse verschiedener Modelle. Der Workflow von HuggingGPT umfasst vier Phasen: Aufgabenplanung, Modellauswahl, Aufgabenausführung und Antwortgenerierung. Weitere Informationen finden Sie auf den Seiten 4 und 16 der PDF-Datei.

- Was ist die Idee hinter HuggingGPT und wie funktioniert es? Es nutzt große Sprachmodelle (LLM) als Controller, um KI-Modelle zu verwalten und komplexe KI-Aufgaben zu lösen. Das Arbeitsprinzip von HuggingGPT besteht darin, die Vorteile von LLM beim Verstehen und Denken zu nutzen, um Benutzerabsichten zu analysieren und Aufgaben in mehrere Unteraufgaben zu zerlegen. Basierend auf der Beschreibung des Expertenmodells ordnet HuggingGPT dann jeder Aufgabe das am besten geeignete Modell zu und integriert die Ergebnisse verschiedener Modelle. Der Workflow von HuggingGPT umfasst vier Phasen: Aufgabenplanung, Modellauswahl, Aufgabenausführung und Antwortgenerierung. Weitere Informationen finden Sie auf den Seiten 4 und 16 der PDF-Datei.

- Wie nutzt HuggingGPT Sprache als universelle Schnittstelle zur Verbesserung von KI-Modellen? Eine universelle Schnittstelle zur Verbesserung des KI-Modells besteht darin, ein großes Sprachmodell (LLM) als Controller zur Verwaltung des KI-Modells zu verwenden. LLM kann die Anforderungen der Benutzer in natürlicher Sprache verstehen und begründen und die Aufgabe dann in mehrere Unteraufgaben zerlegen. Basierend auf der Beschreibung des Expertenmodells ordnet HuggingGPT jeder Teilaufgabe das am besten geeignete Modell zu und integriert die Ergebnisse verschiedener Modelle. Dieser Ansatz ermöglicht es HuggingGPT, komplexe KI-Aufgaben in vielen verschiedenen Modalitäten und Bereichen abzudecken, darunter Sprache, Sehvermögen, Sprache und andere anspruchsvolle Aufgaben. Weitere Informationen finden Sie auf den Seiten 1 und 16 der PDF-Datei.

- HuggingGPT Wie verwendet man große Sprachmodelle, um vorhandene KI-Modelle zu verwalten? Das Modell dient als Schnittstelle zur Weiterleitung von Benutzeranfragen an Expertenmodelle und kombiniert effektiv die Sprachverständnisfähigkeiten großer Sprachmodelle mit der Expertise anderer Expertenmodelle. Das große Sprachmodell fungiert als Gehirn für Planung und Entscheidungsfindung, während das kleine Modell als Ausführer jeder spezifischen Aufgabe fungiert. Dieses Kollaborationsprotokoll zwischen Modellen bietet neue Möglichkeiten zum Entwurf allgemeiner KI-Modelle. (Seite 3-4)

- Welche komplexen KI-Aufgaben kann HuggingGPT lösen?

- HuggingGPT It kann eine breite Palette von Aufgaben lösen, die verschiedene Modalitäten wie Sprache, Bild, Audio und Video abdecken, einschließlich verschiedener Formen von Aufgaben wie Erkennung, Generierung, Klassifizierung und Beantwortung von Fragen. Beispiele für 24 Aufgaben, die HuggingGPT lösen kann, sind Textklassifizierung, Objekterkennung, semantische Segmentierung, Bildgenerierung, Fragebeantwortung, Text-to-Speech und Text-to-Video. (Seite 3)

- Kann HuggingGPT mit verschiedenen Arten von KI-Modellen verwendet werden, oder ist es auf bestimmte Modelle beschränkt?

- HuggingGPT ist nicht auf bestimmte KI-Modelle oder visuelle Wahrnehmungsaufgaben beschränkt. Es kann Aufgaben in jeder Modalität oder Domäne lösen, indem es die Zusammenarbeit zwischen Modellen über große Sprachmodelle organisiert. Unter der Planung großer Sprachmodelle können Aufgabenprozesse effektiv spezifiziert und komplexere Probleme gelöst werden. HuggingGPT verfolgt einen offeneren Ansatz und weist Aufgaben entsprechend den Modellbeschreibungen zu und organisiert sie. (Seite 4)

Der Workflow von HuggingGPT besteht aus vier Phasen:

- Aufgabenplanung: Verwenden Sie ChatGPT, um Benutzeranfragen zu analysieren, ihre Absichten zu verstehen und sie in lösbare Aufgaben aufzuteilen.

- Modellauswahl: Um die geplanten Aufgaben zu lösen, wählt ChatGPT anhand ihrer Beschreibungen KI-Modelle aus, die auf Hugging Face gehostet werden.

- Aufgabenausführung: Rufen Sie jedes ausgewählte Modell auf, führen Sie es aus und geben Sie die Ergebnisse an ChatGPT zurück.

- Antwort generieren: Verwenden Sie abschließend ChatGPT, um die Vorhersagen aller Modelle zu integrieren und eine Antwort zu generieren.

Zitierlink

[1] HuggingGPT: KI-Aufgaben lösen mit ChatGPT und seinen Freunden in Hugging Face: https://arxiv.org/pdf/2104.06674.pdf

Das obige ist der detaillierte Inhalt vonInterpretation des neuesten HuggingGPT-Papiers von Microsoft. Was haben Sie gelernt?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr