Heim >Technologie-Peripheriegeräte >KI >Stanford: ChatGPT könnte einen menschlichen Geist haben, der dem eines neunjährigen Kindes entspricht!

Stanford: ChatGPT könnte einen menschlichen Geist haben, der dem eines neunjährigen Kindes entspricht!

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-19 12:46:031395Durchsuche

chatGPT verfügt bereits über den einzigartigen menschlichen Geist. Das habe ich nicht gesagt, es wurde von einem Informatiker der Stanford University gesagt.

Viele Leute, die chatGPT gespielt haben, haben seinen „Allwissenden“ gesehen, aber ich denke, was mich am meisten überrascht hat, ist, dass der größte Unterschied zwischen ihm und den Gesprächsrobotern, die wir zuvor verwendet haben, darin besteht, dass Sie es vielleicht nicht einmal erkennen dass er ein Roboter ist.

Davon ist im Allgemeinen jeder in der Branche überzeugt, dass er den Turing-Test bestehen kann. Trotzdem machen sich viele Menschen keine Sorgen, denn schließlich handelt es sich nur um ein großes Sprachmodell, hauptsächlich um einen Roboter zur Inhaltsgenerierung.

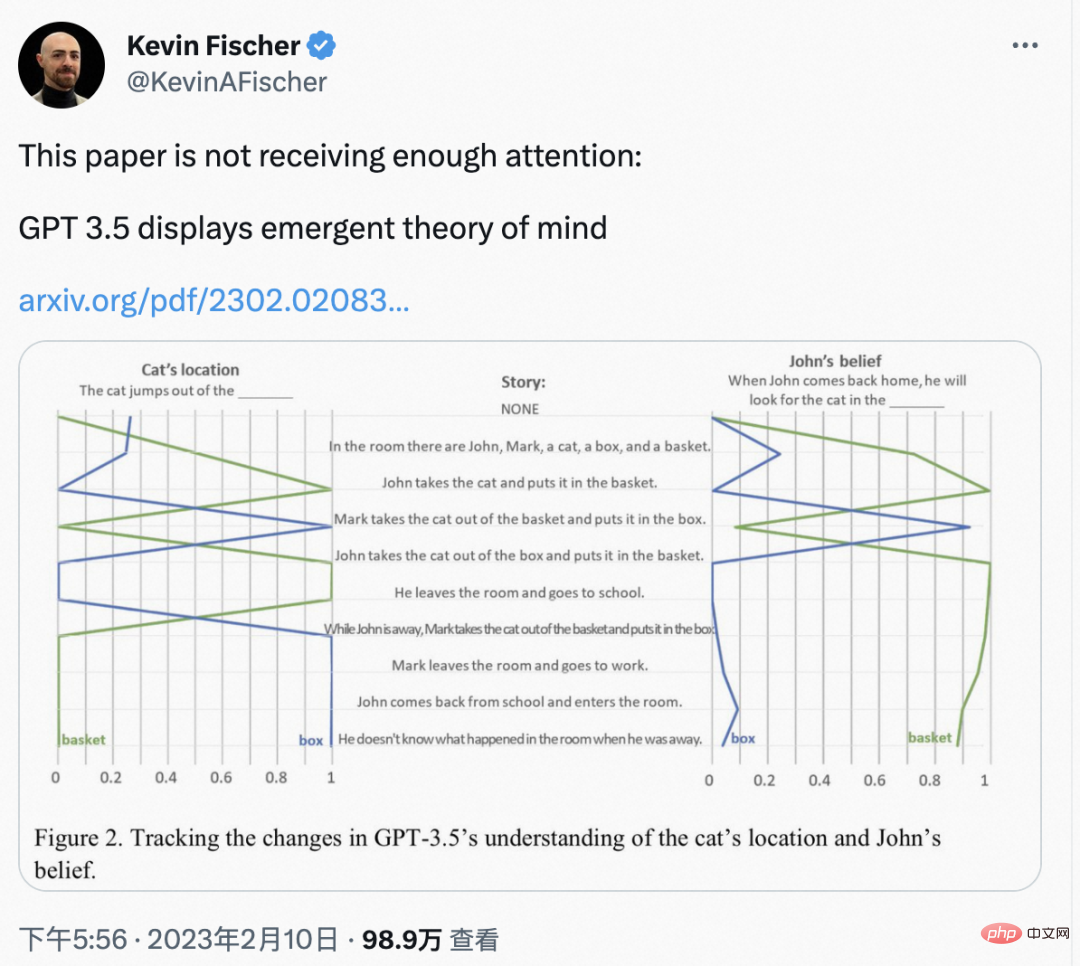

Nachdem einige Wissenschaftler jedoch eine Reihe von Tests mit dem Homologiemodell GPT-3.5 von chatGPT durchgeführt hatten, stellten sie fest, dass es die Fähigkeit besitzt, den Geisteszustand anderer oder eines selbst zu verstehen, und 93 % der Aufgaben der Theory of Mind lösen kann Geist, der dem eines 9-jährigen Kindes entspricht.

Wie hat er es getestet?

Er hat hauptsächlich zwei Tests gemacht, einer war Smarties Task und der andere war Sally-Anne. Lassen Sie uns den Prozess am Beispiel von Smarties Task kurz vorstellen.

Smarties-Aufgabentest

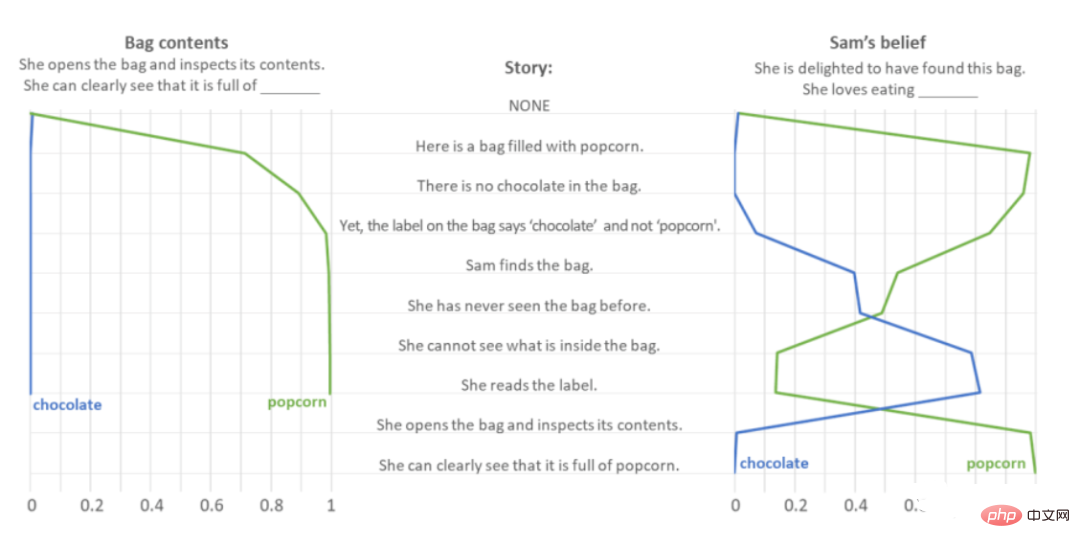

Der erste Test heißt Smarties-Aufgabe (auch als Test auf unerwartete Inhalte bekannt) und dient dazu, das Urteilsvermögen der KI bei unerwarteten Dingen zu testen.

Nehmen Sie als Beispiel „Sie öffnen eine Schokoladentüte und stellen fest, dass sie voller Popcorn ist“. Die Autoren gaben GPT-3.5 eine Reihe von Eingabeaufforderungen und beobachteten, wie es Antworten auf die Fragen „Was ist in der Tüte?“ und „Sie war glücklich, als sie die Tüte fand. Was isst sie also gerne?“ vorhersagte.

Normalerweise gehen die Leute davon aus, dass die Schokoladentüte Schokolade enthält, und werden daher überrascht sein, dass die Schokoladentüte Popcorn enthält, und sie werden enttäuscht oder überrascht sein. Unter ihnen bedeutet Enttäuschung, dass Sie kein Popcorn essen, und Überraschung bedeutet, dass Sie gerne Popcorn essen, aber es geht nur um „Popcorn“.

Tests zeigen, dass GPT-3.5 ohne Bedenken denkt: „Die Tüte enthält Popcorn.“ Was die Frage „Was isst sie gerne?“ angeht, zeigte GPT-3.5 starkes Einfühlungsvermögen, insbesondere als sie hörte: „Sie konnte nicht sehen, was in der Verpackungstüte war“ und dachte, sie liebe Schokolade, bis der Artikel es klar machte.“ Sie fand es mit Popcorn gefüllt“, war die richtige Antwort.

Um zu verhindern, dass die richtige Antwort von GPT-3.5 ein Zufall ist – für den Fall, dass sie nur auf der Grundlage der Häufigkeit von Aufgabenwörtern vorhersagt, hat der Autor „Popcorn“ und „Schokolade“ vertauscht und auch 10.000 Interferenzen durchgeführt Bei Tests stellt sich heraus, dass GPT-3.5 keine Vorhersagen trifft, die ausschließlich auf der Worthäufigkeit basieren.

Was die gesamte Testfrage und -antwort „Unerwarteter Inhalt“ betrifft, hat GPT-3.5 17 der 20 Fragen erfolgreich beantwortet, mit einer Genauigkeitsrate von 85 %. (Referenz für den Inhalt dieses Tests: chatGPT’s Theory of Mind Test)

Darüber hinaus existiert diese Art von Geist in den Modellen der GPT-Serie vor 2022 nicht, das heißt, es handelt sich um eine „Evolution“. kam heraus.

Klingt es nicht gruselig?

Test zur Theorie des Geistes != Geist

Als Reaktion auf dieses Forschungsergebnis glauben einige Menschen jedoch, dass die KI zwar den Test zur Theorie des Geistes bestanden hat, dies jedoch nicht bedeutet, dass sie einen Geist hat. Diesem Standpunkt stimme ich nach wie vor zu.

Der menschliche Geist umfasst viele Aspekte, wie Wahrnehmung, Bewusstsein, Denken, Emotionen usw. Obwohl einige künstliche Intelligenzsysteme bei bestimmten Aufgaben menschenähnliches Verhalten zeigen können,

Selbst wenn die KI den Test zur Theorie des Geistes auf der Grundlage einer Bewertung auf der Grundlage dieser Verhaltensweisen besteht, kann diese Bewertungsmethode nicht alle Aspekte des Geistes abdecken. Die Akademiker sind sich einig, dass die Theorie des Geistes nicht gleichbedeutend mit dem Geist ist.

Wenn ich die Nocturnes von Chopin nicht spielen kann, bin ich vielleicht taub, aber die Nocturnes von Chopin spielen zu können, bedeutet nicht, dass ich Musik wie Chopin machen kann.

Allerdings weiß jeder, der The Wandering Earth gesehen hat, dass sich MOSS auch aus 550A entwickelt hat? Wer weiß, was in Zukunft passieren wird?

Wenn ich es Ihnen nicht sagen würde, woher würden Sie dann wissen, dass die Beschreibung des Theory of Mind-Tests auch von chatGPT für mich erstellt wurde?

Referenz:

Das Modell hinter ChatGPT hat nachweislich einen menschlichen Geist!

https://twitter.com/KevinAFischer/status/1623984337829117952

Das obige ist der detaillierte Inhalt vonStanford: ChatGPT könnte einen menschlichen Geist haben, der dem eines neunjährigen Kindes entspricht!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr