Heim >Technologie-Peripheriegeräte >KI >Was tun, wenn das Mooresche Gesetz versagt? Experte für neuromorphes Computing: Dendritisches Lernen im Fokus

Was tun, wenn das Mooresche Gesetz versagt? Experte für neuromorphes Computing: Dendritisches Lernen im Fokus

- 王林nach vorne

- 2023-04-13 14:22:03855Durchsuche

Im Jahr 1965 fasste Gordon Moore eine Faustregel zusammen: Die Anzahl der Transistoren, die auf einem integrierten Schaltkreis untergebracht werden können, verdoppelt sich etwa alle 18 bis 24 Monate. Mit anderen Worten: Die Prozessorleistung verdoppelt sich etwa alle zwei Jahre.

Diese Faustregel wird „Moores Gesetz“ genannt. In den folgenden vier Jahrzehnten hat sich der Herstellungsprozess von Halbleiterchips tatsächlich in schwindelerregendem Tempo verdoppelt. In den letzten Jahren hat sich die Verdoppelungswirkung des Mooreschen Gesetzes jedoch verlangsamt, und einige gehen sogar davon aus, dass es in naher Zukunft auslaufen wird.

Die Industrie hat verschiedene Lösungen vorgeschlagen, um diesen Entwicklungsengpass zu bewältigen. Kwabena Boahen, Neuromorphikerin von der Stanford University, hat kürzlich eine neue Idee vorgeschlagen: Künstliche Neuronen sollten die Dendriten biologischer Neuronen imitieren und nicht Synapsen. Die Forschungsarbeit wurde in Nature veröffentlicht.

Papieradresse: https://www.nature.com/articles/s41586-022-05340-6

Derzeit zielt neuromorphes Computing darauf ab, die Neuronen nachzuahmen, aus denen das menschliche Gehirn besteht und synaptische Mechanismen zur Implementierung künstlicher Intelligenz (KI). Künstliche neuronale Netzwerke passen die Synapsen, die Neuronen verbinden, wiederholt an, um das „Gewicht“ oder die Stärke des Einflusses eines Neurons auf ein anderes zu ändern. Das neuronale Netzwerk bestimmt dann, ob die resultierenden Verhaltensmuster besser geeignet sind, sie zu lösen. Mit der Zeit erkennt das System, welche Modi für die Berechnung der Ergebnisse am besten geeignet sind, und übernimmt diese Modi als Standard.

Neuronale Netze enthalten normalerweise viele Schichten von Neuronen. GPT-3 hat beispielsweise 175 Milliarden Gewichte, Verbindungen, die 8,3 Millionen Neuronen entsprechen, und eine Tiefe von 384 Schichten. Da neuronale Netze immer größer und funktionaler werden, werden sie immer teurer und energieintensiver. Am Beispiel von GPT-3 gab OpenAI 4,6 Millionen US-Dollar für den zweiwöchigen Betrieb von 9.200 GPUs aus, um dieses große Modell zu trainieren. Kwabena Boahen sagte: „Die von GPT-3 während des Trainings verbrauchte Energie wird in Kohlenstoffemissionen umgewandelt, die 1.300 Autos entsprechen.“

Dies ist auch ein wichtiger Grund, warum Boahen vorschlug, dass der nächste Schritt für neuronale Netze darin bestehen sollte, Zahlen auszuprobieren Graphenlernen. Durch die Nachahmung von Dendriten in neuronalen Netzen wird die Menge der in übertragenen Signalen übermittelten Informationen erhöht, sodass KI-Systeme keine Megawatt Leistung mehr in der GPU-Cloud benötigen und auf mobilen Geräten wie Mobiltelefonen laufen.

Dendriten können sich massiv verzweigen, sodass sich ein Neuron mit vielen anderen Neuronen verbinden kann. Studien haben ergeben, dass die Reihenfolge, in der ein Dendrit Signale von seinen Zweigen empfängt, die Stärke seiner Reaktion bestimmt.

Das von Boahen vorgeschlagene Rechenmodell der Dendriten reagiert nur, wenn es eine präzise Abfolge von Signalen vom Neuron empfängt. Das bedeutet, dass jeder Dendrit Daten kodieren kann, nicht nur einfache elektrische Signale wie 0/1. Abhängig von der Anzahl der Verbindungen und der Länge der empfangenen Signalsequenz wird das Basissystem leistungsfähiger.

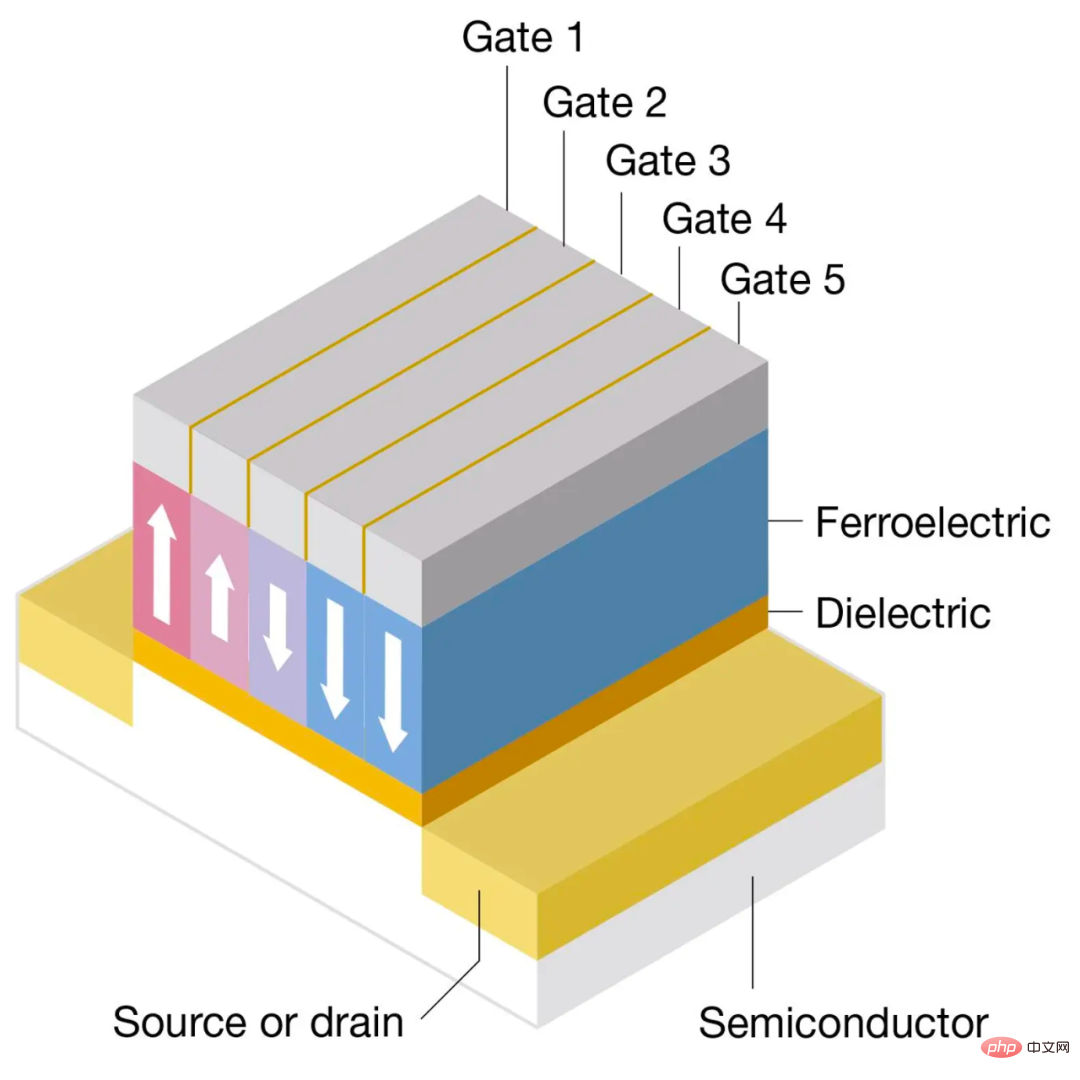

In Bezug auf die tatsächliche Konstruktion schlug Boahen die Verwendung ferroelektrischer FETs (FeFETs) zur Simulation von Dendriten vor. Ein 1,5 Mikrometer langer FeFET mit 5 Gates kann einen 15 Mikrometer langen Dendriten mit 5 Synapsen simulieren. Eine Version dieses Builds könnte in einem „3D-Chip“ implementiert werden, sagte Boahen.

Interessierte Leser können den Originaltext des Artikels lesen, um weitere Forschungsdetails zu erfahren.

Referenzlink: https://spectrum.ieee.org/dendrocentric-learning

Das obige ist der detaillierte Inhalt vonWas tun, wenn das Mooresche Gesetz versagt? Experte für neuromorphes Computing: Dendritisches Lernen im Fokus. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr