Heim >Technologie-Peripheriegeräte >KI >Eine einzelne GPU realisiert 20-Hz-Online-Entscheidungsfindung und Interpretation der neuesten effizienten Flugbahnplanungsmethode basierend auf einem Sequenzgenerierungsmodell

Eine einzelne GPU realisiert 20-Hz-Online-Entscheidungsfindung und Interpretation der neuesten effizienten Flugbahnplanungsmethode basierend auf einem Sequenzgenerierungsmodell

- 王林nach vorne

- 2023-04-13 10:43:021684Durchsuche

Zuvor haben wir die Anwendung von Sequenzmodellierungsmethoden basierend auf dem Transformer- und Diffusionsmodell beim Reinforcement Learning eingeführt, insbesondere im Bereich der Offline-Kontinuitätssteuerung. Unter ihnen sind Trajectory Transformer (TT) und Diffusser modellbasierte Planungsalgorithmen. Sie zeigen eine sehr präzise Flugbahnvorhersage und eine gute Flexibilität, aber die Entscheidungsverzögerung ist relativ hoch. Insbesondere diskretisiert TT jede Dimension unabhängig als Symbol in der Sequenz, wodurch die gesamte Sequenz sehr lang wird und der Zeitaufwand für die Sequenzgenerierung mit zunehmender Dimension von Zuständen und Aktionen rapide zunimmt.

Um dem Modell zur Trajektoriengenerierung eine Entscheidungsgeschwindigkeit auf praktischem Niveau zu ermöglichen, haben wir das Projekt zur effizienten Trajektoriengenerierung und Entscheidungsfindung parallel zu Diffusser gestartet (überlappend, aber wahrscheinlich später). Unser erster Gedanke ist, Transformer+Gauß-Mischung im kontinuierlichen Raum anstelle einer diskreten Verteilung zu verwenden, um die gesamte Trajektorienverteilung anzupassen. Obwohl Implementierungsprobleme nicht ausgeschlossen sind, konnten wir mit diesem Ansatz kein relativ stabiles Generationsmodell erhalten. Dann haben wir Variational Autoencoder (VAE) ausprobiert und einige Durchbrüche erzielt. Die Rekonstruktionsgenauigkeit von VAE ist jedoch nicht besonders ideal, sodass sich die Leistung der nachgeschalteten Steuerung deutlich von der von TT unterscheidet. Nach mehreren Iterationsrunden haben wir schließlich VQ-VAE als Basismodell für die Trajektoriengenerierung ausgewählt und schließlich einen neuen Algorithmus erhalten, der effizient abtasten und planen kann und bei hochdimensionalen Steuerungsaufgaben eine weitaus bessere Leistung als andere modellbasierte Methoden erbringt. Wir haben Trajectory Autoencoding Planner (TAP) genannt.

- Project Homepage: https://sites.google.com/view/latentplan

- paper homepage: https://arxiv.org/abs/2208.10291

Planungseffizienz und Leistung in hohen Dimensionen

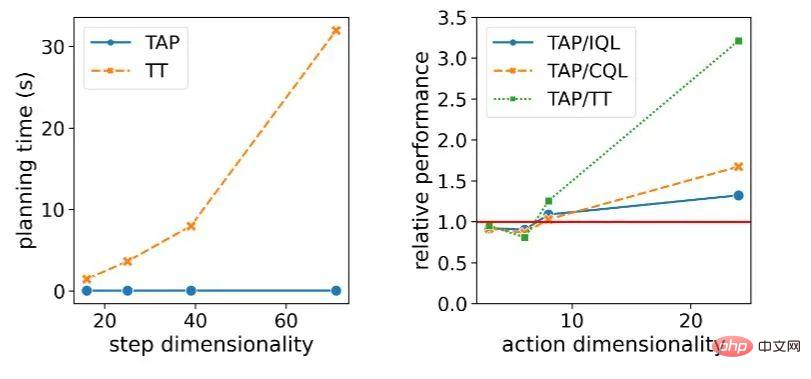

Unter einer einzelnen GPU kann TAP problemlos Online-Entscheidungen mit einer Entscheidungseffizienz von 20 Hz durchführen. Bei der niedrigdimensionalen D4RL-Aufgabe beträgt die Entscheidungsverzögerung beträgt nur etwa 1 % von TT. Noch wichtiger ist, dass mit zunehmendem Aufgabenzustand und Aktionsdimension D die theoretische Entscheidungsverzögerung von TT mit dem Würfel zunimmt  , Diffusser theoretisch linear zunimmt

, Diffusser theoretisch linear zunimmt  , während die Entscheidungsgeschwindigkeit von TAP nicht beeinträchtigt wird durch die Dimension

, während die Entscheidungsgeschwindigkeit von TAP nicht beeinträchtigt wird durch die Dimension  . In Bezug auf die Entscheidungsleistung des Agenten verbessert sich die Leistung von TAP mit zunehmender Handlungsdimension im Vergleich zu anderen Methoden, und die Verbesserung im Vergleich zu modellbasierten Methoden (wie TT) ist besonders offensichtlich.

. In Bezug auf die Entscheidungsleistung des Agenten verbessert sich die Leistung von TAP mit zunehmender Handlungsdimension im Vergleich zu anderen Methoden, und die Verbesserung im Vergleich zu modellbasierten Methoden (wie TT) ist besonders offensichtlich.

Die Bedeutung der Entscheidungsverzögerung für Entscheidungs- und Steuerungsaufgaben ist sehr offensichtlich. Obwohl Algorithmen wie MuZero in Simulationsumgebungen gut funktionieren, sind sie bei Aufgaben, die in der realen Welt eine schnelle Reaktion erfordern, sehr wichtig Zu große Verzögerungen werden zu einer großen Schwierigkeit bei der Umsetzung. Darüber hinaus führt die langsame Entscheidungsgeschwindigkeit unter der Voraussetzung einer Simulationsumgebung auch zu hohen Testkosten für ähnliche Algorithmen, und die Kosten für die Verwendung beim Online-Verstärkungslernen sind ebenfalls relativ hoch.

Darüber hinaus glauben wir, dass die reibungslose Erweiterung der Sequenzgenerierungsmodellierungsmethode auf Aufgaben mit höheren Dimensionen auch ein sehr wichtiger Beitrag von TAP ist. In der realen Welt haben die meisten Probleme, von denen wir hoffen, dass sie durch Verstärkungslernen letztendlich gelöst werden können, tatsächlich höhere Zustands- und Aktionsdimensionen. Beispielsweise ist es beim autonomen Fahren selbst nach der Vorverarbeitung auf verschiedenen Wahrnehmungsebenen unwahrscheinlich, dass die Eingaben verschiedener Sensoren weniger als 100 betragen. Auch die komplexe Robotersteuerung verfügt oft über einen hohen Aktionsraum von etwa 240, was einem Aktionsraum von mindestens 240 Dimensionen entspricht Raum.

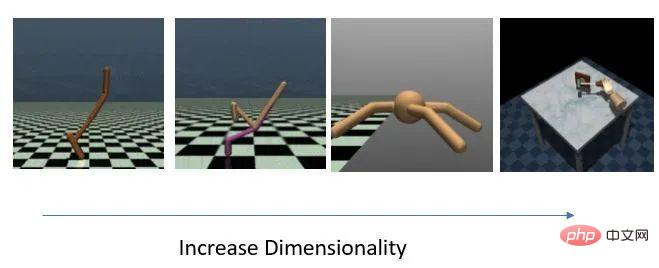

Vier Aufgabensätze mit allmählich zunehmenden Dimensionen

Änderungen der Entscheidungslatenz und der relativen Modellleistung mit zunehmender Aufgabendimension

Methodenübersicht

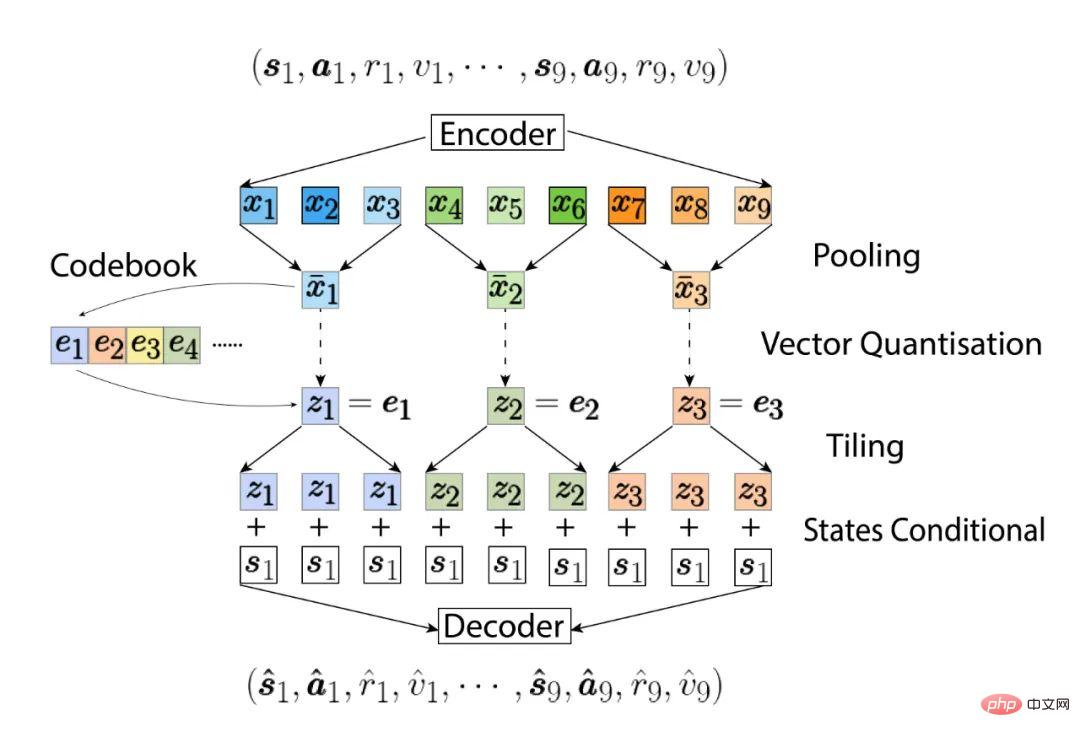

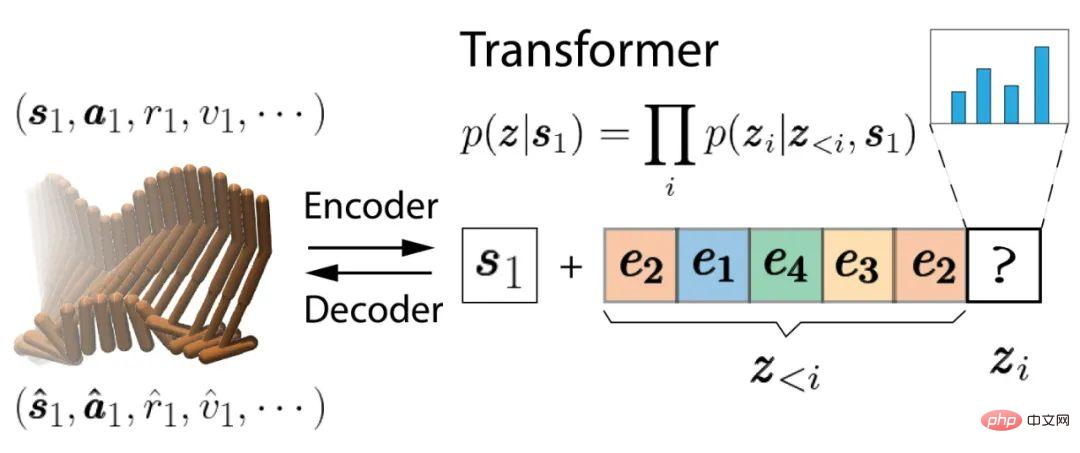

Trainieren Sie zunächst den Autoencoder-Teil von VQ-VAE, der mit dem ursprünglichen VQ-VAE identisch ist. Zwei verschiedene . Der erste Unterschied besteht darin, dass sowohl der Encoder als auch der Decoder auf Causal Transformer statt auf CNN basieren. Der zweite Unterschied besteht darin, dass wir eine bedingte Wahrscheinlichkeitsverteilung lernen und die möglichen zu modellierenden Trajektorien vom aktuellen Zustand ausgehen müssen  . Der Autoencoder lernt eine bidirektionale Zuordnung zwischen Trajektorien ausgehend vom aktuellen Zustand

. Der Autoencoder lernt eine bidirektionale Zuordnung zwischen Trajektorien ausgehend vom aktuellen Zustand  und latenten Codes. Diese latenten Codes sind wie die ursprünglichen Trajektorien in chronologischer Reihenfolge angeordnet, und jeder latente Code wird der tatsächlichen

und latenten Codes. Diese latenten Codes sind wie die ursprünglichen Trajektorien in chronologischer Reihenfolge angeordnet, und jeder latente Code wird der tatsächlichen  -Schritt-Trajektorie zugeordnet. Da wir Causal Transformer verwenden, übertragen latente Codes mit niedrigerer Zeitrangfolge (wie

-Schritt-Trajektorie zugeordnet. Da wir Causal Transformer verwenden, übertragen latente Codes mit niedrigerer Zeitrangfolge (wie  ) keine Informationen an höherrangige Sequenzen (wie

) keine Informationen an höherrangige Sequenzen (wie  ), wodurch TAP die ersten N latenten Codes übergeben und eine Flugbahn teilweise dekodieren kann der Länge NL, was für die spätere Planung sehr nützlich ist.

), wodurch TAP die ersten N latenten Codes übergeben und eine Flugbahn teilweise dekodieren kann der Länge NL, was für die spätere Planung sehr nützlich ist.

Dann werden wir einen anderen GPT-2-Transformer verwenden, um die bedingte Wahrscheinlichkeitsverteilung dieser latenten Codes zu modellieren  :

:

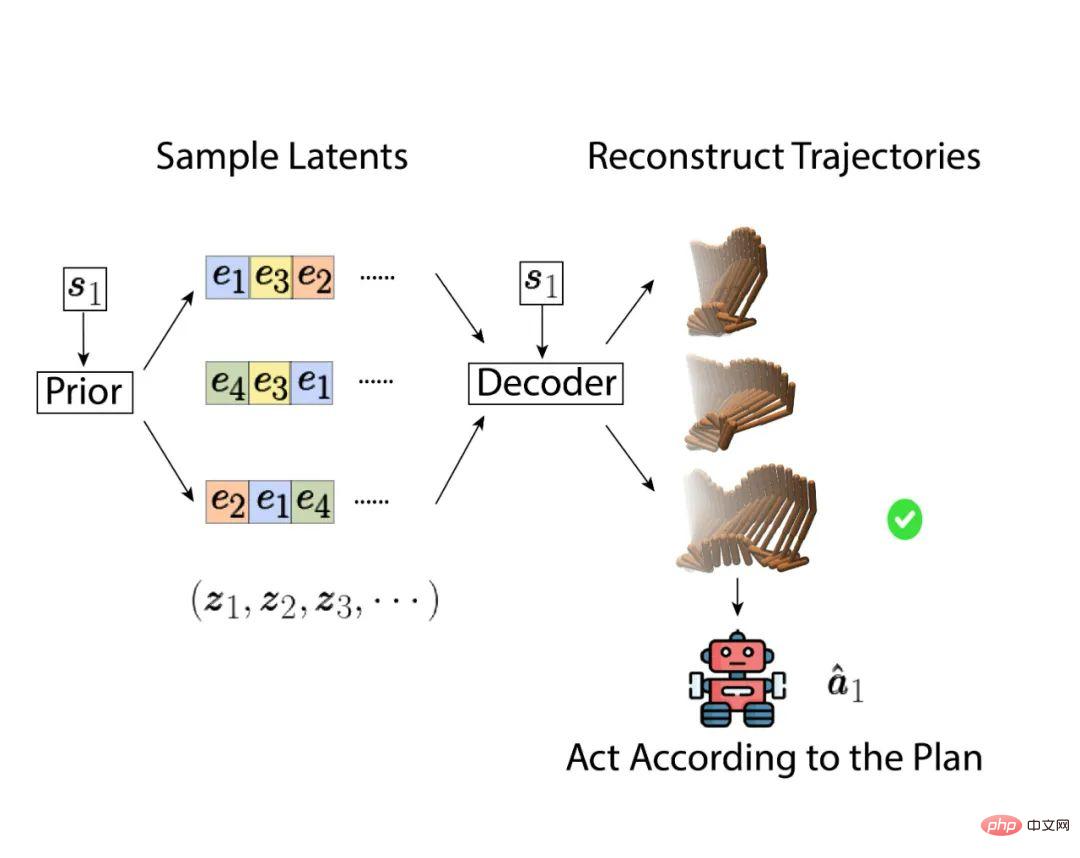

Bei Entscheidungen können wir die latenten Variablen übergeben Optimieren Sie innerhalb des Raums, um die beste zukünftige Flugbahn zu finden, anstatt im ursprünglichen Aktionsraum zu optimieren. Eine sehr einfache, aber effektive Methode besteht darin, direkt Stichproben aus der latenten Codierungsverteilung zu nehmen und dann die Trajektorie mit der besten Leistung auszuwählen, wie unten gezeigt: Berücksichtigen Sie sowohl die erwartete Rendite der Flugbahn (Belohnung plus Bewertung des letzten Schritts) als auch die Machbarkeit oder Wahrscheinlichkeit der Flugbahn selbst. Wie zum Beispiel die folgende Formel, wobei

eine Zahl ist, die weitaus größer ist als die höchste Rendite. Wenn die Wahrscheinlichkeit einer Flugbahn höher als ein Schwellenwert

ist, ist das Kriterium für die Beurteilung dieser Flugbahn die erwartete Rendite (rot hervorgehoben). ), andernfalls ist die Wahrscheinlichkeit der Flugbahn selbst der dominierende Teil (blau hervorgehoben). Mit anderen Worten: TAP wählt unter den Trajektorien, die über dem Schwellenwert liegen, diejenige mit der höchsten erwarteten Rendite aus.

Obwohl die Anzahl der Stichproben groß genug ist, kann die direkte Stichprobe auch dann sehr effektiv sein, wenn die Vorhersagesequenz kurz ist. Unter der Voraussetzung, die Anzahl der Stichproben und die für die Planung erforderliche Gesamtzeit zu begrenzen, bringt die Verwendung eines besseren Optimierers immer noch bessere Ergebnisse Ergebnisse. Gute Leistung. Die folgenden beiden Animationen zeigen den Unterschied zwischen Trajektorien, die durch direkte Abtastung und Strahlsuche generiert werden, bei der Vorhersage von 144 Schritten in die Zukunft. Diese Trajektorien sind nach der endgültigen Zielpunktzahl sortiert. Die Trajektorien oben in der obersten Ebene haben höhere Punktzahlen und die dahinter gestapelten Trajektorien haben niedrigere Punktzahlen. Darüber hinaus weisen Trajektorien mit niedrigen Werten auch eine geringere Transparenz auf.

Auf dem Bild können wir sehen, dass viele der Dynamiken der durch direkte Abtastung erzeugten Flugbahnen instabil sind und nicht den physikalischen Gesetzen entsprechen. Insbesondere die leichteren Flugbahnen im Hintergrund schweben nahezu. Dies sind alles Trajektorien mit relativ geringer Wahrscheinlichkeit und werden eliminiert, wenn der endgültige Plan ausgewählt wird. Die Flugbahn in der ersten Reihe sieht dynamischer aus, aber die entsprechende Leistung ist relativ schlecht und es scheint, als würde sie sinken. Im Gegensatz dazu berücksichtigt die Strahlsuche beim Erweitern der nächsten verborgenen Variablen dynamisch die Wahrscheinlichkeit der Trajektorie, sodass Zweige mit sehr geringer Wahrscheinlichkeit frühzeitig beendet werden, sodass sich die generierten Kandidatentrajektorien auf diejenigen mit besserer Leistung und Möglichkeit konzentrieren Spuren sind in der Nähe. E Direktes Sampling von aBeam Search

experimentelle Ergebnisse

experimentelle Ergebnisse

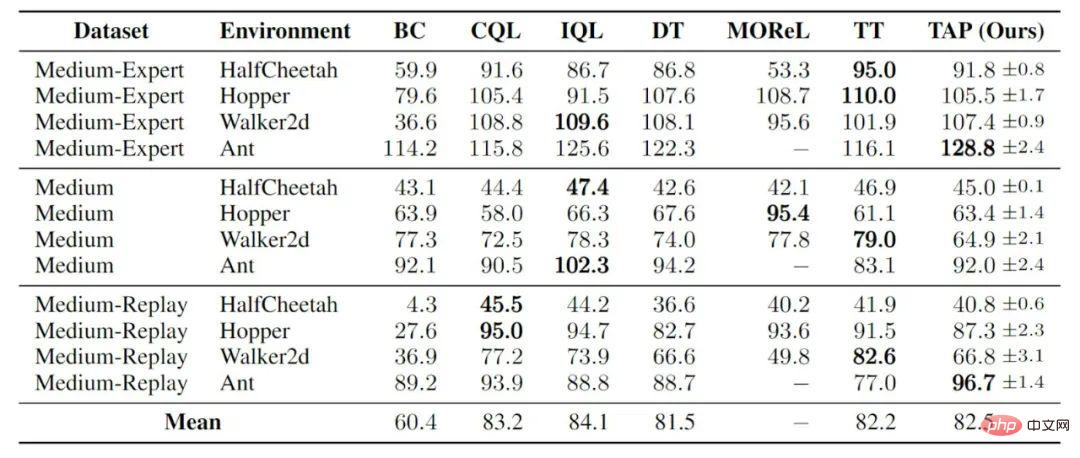

Ohne Bewertung auf höherer Ebene und strategische Verbesserung, nur auf die Vorteile der Vorhersagegenauigkeit angewiesen. Bei niedrigdimensionalen Aufgaben hat TAP eine vergleichbare Leistung wie andere Offline-Verstärkungslernen erreicht:

Kontrolle der Fortbewegung im Fitnessstudio

Bei hochdimensionalen Aufgaben hat TAP weit mehr erreicht als andere Methoden, die auf basieren. Die Leistung modellbasierter Methoden übertrifft auch gängige modellfreie Methoden. Es gibt tatsächlich zwei offene Fragen, die noch nicht beantwortet wurden. Der erste Grund ist, warum frühere modellbasierte Methoden bei diesen hochdimensionalen Offline-Lernaufgaben zur Verstärkung schlecht abschnitten, und der zweite Grund, warum TAP bei diesen Aufgaben viele modellfreie Methoden übertreffen kann. Eine unserer Annahmen ist, dass es sehr schwierig ist, eine Richtlinie für ein hochdimensionales Problem zu optimieren und gleichzeitig zu berücksichtigen, dass die Richtlinie nicht zu stark von der Verhaltensrichtlinie abweicht. Wenn ein Modell gelernt wird, können Fehler im Modell selbst diese Schwierigkeit verstärken. TAP verschiebt den Optimierungsraum in einen kleinen diskreten Raum mit versteckten Variablen, was den gesamten Optimierungsprozess robuster macht.

geschickte Roboterhandsteuerung

geschickte Roboterhandsteuerung

Einige Schnittstudien

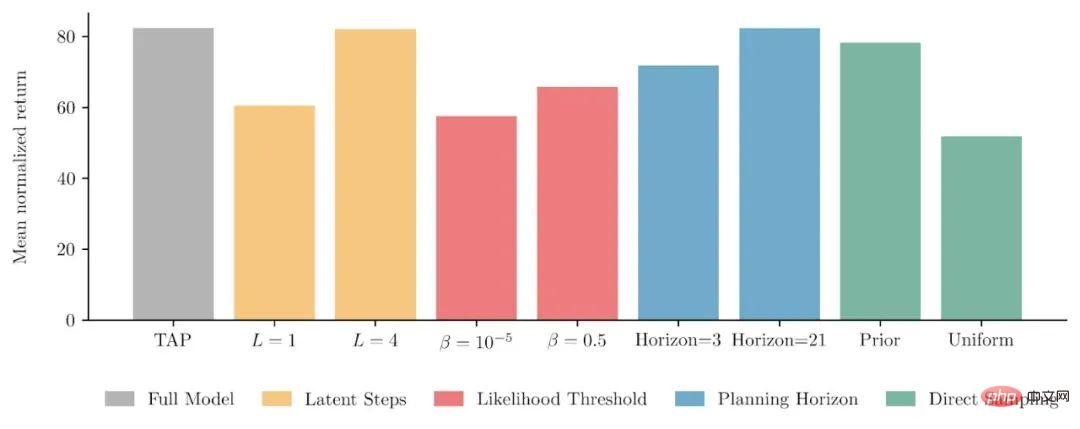

Für viele Designs in TAP haben wir auch eine Reihe von Schnittstudien zur Steuerung der Fortbewegung im Fitnessstudio durchgeführt. Das erste ist die Anzahl der Schritte der Trajektorie, denen jeder latente Code tatsächlich entspricht (gelbes Histogramm). Fakten haben bewiesen, dass die Entsprechung einer latenten Variablen zu einem mehrstufigen Zustandsübergang nicht nur rechnerische Vorteile hat, sondern auch das endgültige Modell verbessert Leistung. Durch Anpassen des Schwellenwerts, der Trajektorienstrafen mit geringer Wahrscheinlichkeit in der Suchzielfunktion(rotes Histogramm) auslöst, haben wir außerdem bestätigt, dass beide Teile der Zielfunktion tatsächlich für die endgültige Leistung des Modells hilfreich sind. Ein weiterer Punkt ist, dass die Anzahl der in die Zukunft geplanten Schritte (Planungshorizont, blaues Histogramm) kaum Einfluss auf die Modellleistung hat. Selbst wenn nur eine versteckte Variable erweitert wird, wird die Leistung des endgültigen Agenten nur verringert um etwa 10 %.

Schließlich haben wir die Leistung von TAP unter direkter Abtastung getestet (grünes Histogramm). Beachten Sie, dass die Anzahl der hier abgetasteten Proben 2048 beträgt, während die Zahl in der obigen Animation nur 256 beträgt und die obige Animation einen Plan für die nächsten 144 Schritte generiert, unser Basismodell jedoch tatsächlich die Planung für 15 Schritte vorgibt. Die Schlussfolgerung ist, dass die Direktabtastung eine ähnliche Leistung wie die Strahlsuche erzielen kann, wenn die Anzahl der Abtastungen ausreichend ist und der geplante Weg nicht lang ist. Dies ist jedoch ein Fall der Stichprobe aus der erlernten bedingten Verteilung latenter Variablen. Wenn wir direkt mit gleicher Wahrscheinlichkeit aus der latenten Kodierung Stichproben ziehen, ist dies am Ende immer noch viel schlechter als beim vollständigen TAP-Modell.

Ergebnisse der Schnittstudie

Das obige ist der detaillierte Inhalt vonEine einzelne GPU realisiert 20-Hz-Online-Entscheidungsfindung und Interpretation der neuesten effizienten Flugbahnplanungsmethode basierend auf einem Sequenzgenerierungsmodell. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr