Heim >Technologie-Peripheriegeräte >KI >Welche inländischen akademischen Kräfte können die Gelegenheit nutzen, um eine chinesische Version von ChatGPT zu erstellen?

Welche inländischen akademischen Kräfte können die Gelegenheit nutzen, um eine chinesische Version von ChatGPT zu erstellen?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-12 20:28:061509Durchsuche

OpenAI ist mittlerweile zum Ziel der Verfolgung im globalen Bereich der künstlichen Intelligenz geworden.

Nachdem Google „Bard“ vorgestellt hatte, begann auch Chinas Technologiekreis zu kochen. Das ursprünglich bittere Forschungsteam zur Verarbeitung natürlicher Sprache ist nun zum Liebling aller geworden. Ein Wettbewerb um Kapital und Talente hat begonnen.

„Erstellen Sie eine chinesische Version von ChatGPT“ wurde in Wang Huiwens Heldenbeitrag verbreitet und auf zehn verteilt, was zum gemeinsamen Ziel chinesischer KI-Praktiker wurde.

Doch egal wie heiß die Diskussion über ChatGPT in den letzten Tagen ist, wir müssen uns einer grausamen Realität stellen: Im Wettbewerb um OpenAI können wir endlich nicht viele Teams haben Guangmingding erreicht.

Einerseits sind die Kosten hoch, und andererseits sind die Mittel für die „Verfeinerung“ großer Modelle genau das Richtige für den Aufbau von ChatGPT begrenzte Talente, die große Modelle trainieren können. Große Modelle sind der technische Eckpfeiler der OpenAI-Entwicklung von ChatGPT, und auch die Suche nach den richtigen Leuten ist äußerst wichtig.

Großmaßstäbliche Modelle müssen eine Richtung sein, in der Industrie, Wissenschaft und Forschung zusammenarbeiten. Wenn ChatGPT-Teilnehmer gewinnen wollen, müssen sie nicht nur Spitzenwissenschaftler haben, sondern auch Außerdem sollten Sie über Verständnis für das politische und geschäftliche Umfeld verfügen und Starunternehmer mit Charisma am Kapitalmarkt und der Bereitschaft zum All-in unterstützen.

Dieser Artikel zielt darauf ab, aus der Perspektive der akademischen Forschung eine Bestandsaufnahme der Positionen wichtiger inländischer potenzieller Kräfte in dieser Welle des ChatGPT-Wettbewerbs zu machen.

1 Macht der Universitäten: Tsinghua-Universität Die Position liegt definitiv vorne.

Die Tsinghua-Universität ist ein akademisches Forschungszentrum auf dem Gebiet der Verarbeitung natürlicher Sprache (NLP) in China. Sie verfügt über eine tiefgreifende Forschungsgeschichte im Bereich NLP und ein großes Forschungsteam. darunter Tang Jie, Sun Maosong und Liu Zhiyuan, Huang Minlie und andere bekannte Wissenschaftler. Ihre Arbeit auf dem Gebiet der großen Sprachmodelle war in den letzten Jahren sehr herausragend. Darüber hinaus sind viele der Leiter großer Modelle großer Hersteller Nachkommen der Tsinghua-Universität, wie He Xiaodong, Vizepräsident von JD.com, Tian Qi, Chefwissenschaftler im Bereich künstliche Intelligenz von Huawei Cloud usw.

Nachdem wir die Sache geklärt haben, gibt es an der Tsinghua-Universität drei potenzielle Kräfte, die mit dieser ChatGPT-Welle Schritt halten können: Eine davon ist das Knowledge Engineering Laboratory (KEG), geleitet von Li Juanzi und ihrem Schüler Tang Jie leiteten das Team; das zweite ist das Natural Language Processing and Social Humanities Computing Laboratory (THUNLP), der akademische Leiter ist Sun Maosong und der Teamleiter Liu Zhiyuan ist sein Schüler Forschungsgruppe für künstliche Intelligenz (CoAI), geleitet von Zhu Xiaoyan und seinen Studenten, gemeinsam geleitet von Huang Minlie.

Tsinghua Tangjie

In der letzten Welle des Großmodellbauwahns hat ein Professor aus der Tang Jie, Fachbereich Informatik der Tsinghua-Universität, ist einer der prominentesten akademischen Vertreter. Im Jahr 2020 versammelte er Universitäten in Peking und leitete die Entwicklung der „Aufklärungs“-Modelle 1.0 und 2.0 des Zhiyuan Research Institute.

#🎜 🎜# Gleichzeitig ist Tang Jie auch ein Wissenschaftler, der großen Wert auf die Integration von Industrie, Wissenschaft und Forschung sowie den Aufbau einer groß angelegten Modellökologie legt. Im Jahr 2019 leiteten Tang Jie und Li Juanzi die Gründung von Zhipu AI und stützten sich dabei auf das Spitzenprodukt AMnier und die technischen Errungenschaften des Knowledge Engineering Laboratory. Zum aktuellen Firmenteam gehören viele Schüler von Tang Jie, die allesamt Hauptakteure der „Erleuchtung“ 2.0 sind.

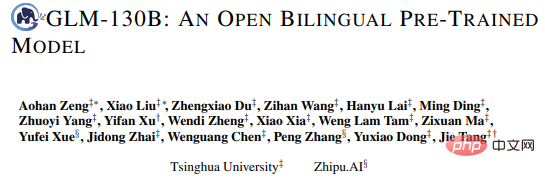

Tang Jie kommt aus dem Bereich Data Mining und Li Juanzi ist ein berühmter Wissenschaftler auf dem Gebiet der Wissensgraphen. Dies bestimmt, dass die Eigenschaften der großen KI von Zhipu groß sind. Das Maßstabsmodell ist „Daten + Wissen“. Letztes Jahr veröffentlichte Zhipu AI das zweisprachige GLM-130B-Modell, das Open Source ist und von Forschungseinrichtungen oder Einzelpersonen kostenlos heruntergeladen werden kann.

GLM-130B übernimmt das vom KEG Laboratory im Jahr 2021 vorgeschlagene GLM-Modell Die Architektur übertrifft das GPT-3-Modell von OpenAI bei mehreren Aufgaben. Durch die Modellquantifizierungstechnologie hat das Team von Tang Jie außerdem die Benutzerfreundlichkeit des Modells verbessert und die Rechenkosten gesenkt. GLM-130B kann Inferenzen auf einem A 100- oder V100-Server durchführen.

GLM-130B übernimmt das vom KEG Laboratory im Jahr 2021 vorgeschlagene GLM-Modell Die Architektur übertrifft das GPT-3-Modell von OpenAI bei mehreren Aufgaben. Durch die Modellquantifizierungstechnologie hat das Team von Tang Jie außerdem die Benutzerfreundlichkeit des Modells verbessert und die Rechenkosten gesenkt. GLM-130B kann Inferenzen auf einem A 100- oder V100-Server durchführen.

Darüber hinaus hat Tangjies Team auch den Austausch und die Kontakte zu vielen großen Unternehmen aufgebaut, um sie bei der Entwicklung großer Modelle wie Alibabas M6 zu unterstützen. Tang Jies Schüler Yang Zhilin ist Mitbegründer des NLP-Startups Circular Intelligence und beteiligte sich auch an der Forschung und Entwicklung des Großmodells „Pangu“ von Huawei.

Insidern zufolge forscht Zhipu AI derzeit an ChatGPT-ähnlichen Produkten und wird diese in den letzten zwei Monaten auf den Markt bringen.

Tsinghua Sun Maosong und Liu Zhiyuan

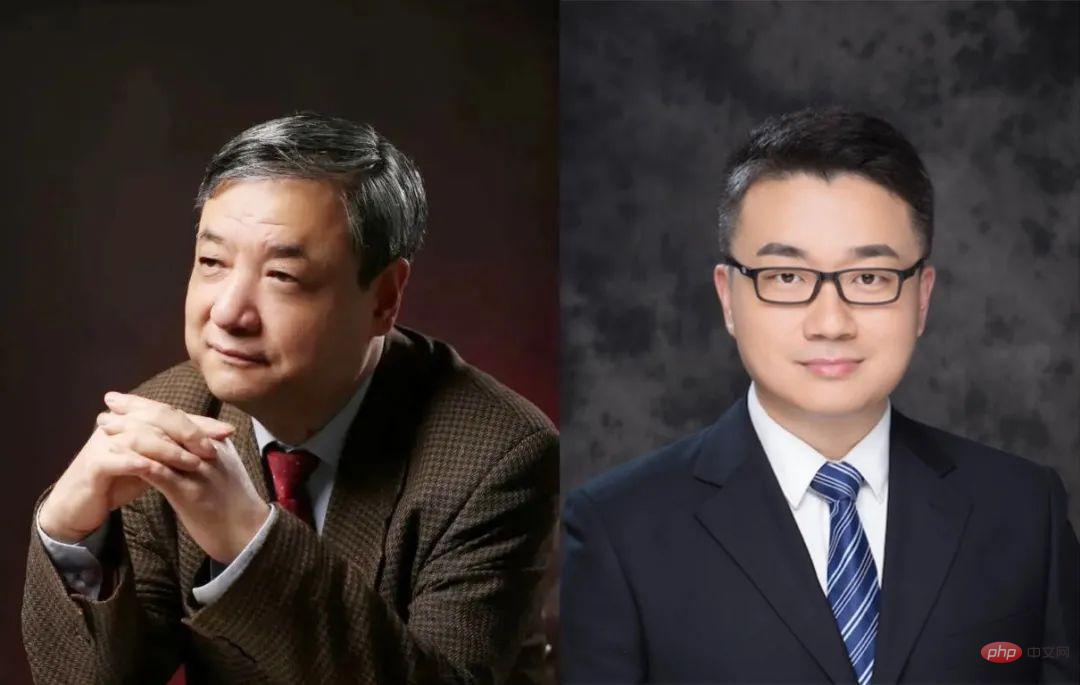

Aus Sicht der Fachrichtung NLP ist das Team aus Sun Maosong und Liu Zhiyuan das „verwurzelteste und beliebteste“ Team in der Tsinghua-Abteilung.

Das Natural Language Processing and Social Humanities Computing Laboratory (THUNLP) der Tsinghua University ist die früheste und einflussreichste wissenschaftliche Forschungseinheit in China, die NLP-Forschung betreibt. Als das Labor Ende der 1970er Jahre gegründet wurde, wurde es von Huang Changning geleitet, dem Pionier des NLP in China, seinem Schüler, und Liu Zhiyuan, einem Schüler von Sun Maosong.

Sun Maosong (links) und Liu Zhiyuan (rechts) „, das auf einer Vielzahl menschlicher Schöpfungen basiert. Die Poesieausbildung hat in Wissenschaft und Industrie große Aufmerksamkeit erregt.

In Bezug auf große Sprachmodelle hat das Team von Sun Maosong und Liu Zhiyuan 2018 das Pre-Training-Paradigma weitergeführt. Anfang 2019 veröffentlichten sie das ERNIE-Sprachmodell (derselbe Name wie die Baidu-Version von ERNIE). zur gleichen Zeit) und entwickelte dann das CPM-Modell, das Zhiyuan Der Vorgänger des Instituts „Wudao·Wenyuan“.

Sun Maosong, Liu Zhiyuan und ihre Doktoranden haben mehrere Unternehmen in den Bereichen NLP und große Modelle gegründet. Einschließlich Power Law Intelligence, gegründet von Tu Cunchao im Jahr 2017, das sich auf die Anwendung von NLP im Rechtsbereich konzentriert; Shenyan Technology, gegründet von Qi Fanchao im Jahr 2022, hat sich zum Ziel gesetzt, eine chinesische Informationsverarbeitungsmaschine in Industriequalität mit selbst entwickeltem Chinesisch aufzubauen große Modelle.

Darüber hinaus gibt es Wall-Facing Intelligence, das letztes Jahr von Zeng Guoyang gegründet wurde und sich auf die Beschleunigung und Anwendung großer Modelle konzentriert. Das Unternehmensteam ist das Rückgrat von „Wudao Wenyuan“. Sie haben gemeinsam mit THUNLP und dem Language Large Model Technology Innovation Center des Zhiyuan Research Institute die OpenBMB Open Source Community ins Leben gerufen und das CPM-Live für zig Milliarden chinesische Live-Trainingsprojekte für große Modelle sowie Tools zur Beschleunigung des gesamten Prozesses großer Modelle ins Leben gerufen .

In dieser ChatGPT-Welle liegt der Vorteil von THUNLP in seinen zahlreichen akademischen NLP-Errungenschaften und seiner großen Erfahrung in der Modellforschung und -entwicklung. Die Herausforderung liegt in der Technik und Kommerzialisierung.

Lingxin Intelligence Huang Minlie

ChatGPT Als Chat-Roboter wird er durch Dialogsystemtechnologie unterstützt. In dieser Richtung ist die Forschung der interaktiven Forschungsgruppe für künstliche Intelligenz (CoAI) der Tsinghua-Universität sehr prominent.

CoAI wird von Zhu Xiaoyan und ihrem Schüler Huang Minlie geleitet. Huang Minlie ist ein Experte auf dem Gebiet der künstlichen Konversationsintelligenz und Autor des Buches „Modern Natural Language Generation“. Er war zuvor auch an der Entwicklung des großen Weisheitsmodells „Wudao“ beteiligt.

Huang Minlie

Huang Minlie

Huang Minlie ist auch ein Mitglied der Tsinghua-Gelehrten, die ihr eigenes Unternehmen gründeten. Er gründete „Lingxin Intelligence“ im Jahr 2021. Basierend auf der Forschungsgrundlage großer Modelle und Dialogsysteme entschied sich Huang Minlie für den Chat-Roboter-Track für psychologische Beratung. Im Jahr 2022 brachte sein Team einen interaktiven Roboter namens „AI Utopia“ auf den Markt, bei dem Benutzer KI-Charaktere anpassen und ausführliche Gespräche mit dem Roboter führen können.

Als eines der wenigen inländischen Teams, das in der Lage ist, große Modelle zu trainieren, hat Huang Minlie kürzlich die Pre-A-Finanzierungsrunde abgeschlossen und sagte, dass sie im Vergleich zu ChatGPT hoffen, „Lingxin Intelligence“ als „Chinas Charakter-KI“ zu positionieren –—Provide Benutzer mit emotionaler Begleitung basierend auf der Textgenerierung. Es wird davon ausgegangen, dass sein Team eine große Menge hochwertiger Trainingsdaten im Bereich der psychischen Gesundheit mit mehr als 3 Milliarden Modellparametern gesammelt hat.

2 Darüber hinaus gehören zu dieser Welle von Internetunternehmen, die ihren Einstieg in die Entwicklung von ChatGPT angekündigt haben, Tencent, ByteDance, Kuaishou, 360, iFlytek, NetEase usw. In der rüstenähnlichen ChatGPT-Forschung und -Entwicklung haben die Banknotenfähigkeiten großer Hersteller zweifellos einen absoluten Vorteil.

Einige Brancheninsider haben angemerkt, dass die Indikatoren einiger großer Hersteller, darunter 360, in der ChatGPT-ähnlichen Technologie nur ein geringfügig besseres Niveau als GPT-2 erreichen können, es besteht immer noch eine Generationslücke. Es handelt sich um einen einfachen Ansatz für große Sprachmodelle (wie Kuaishou, iFlytek, NetEase usw.). Daher bestehen große Unsicherheiten hinsichtlich der Startzeit und der tatsächlichen Wirkung der ChatGPT-ähnlichen Betaversion.

BaiduWenxin Large Model

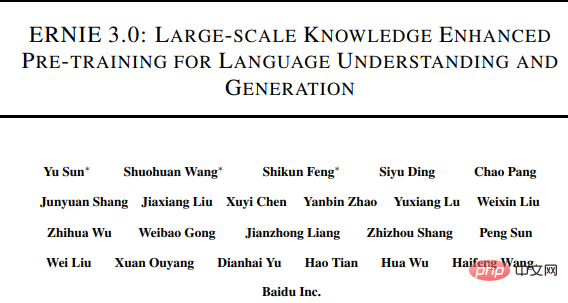

Im Bereich der Verarbeitung natürlicher Sprache kann Baidu unter den großen Herstellern auf die längste Geschichte der Technologieakkumulation zurückblicken.

Die Forschung und Entwicklung des großen Baidu Wenxin-Modells wird von CTO Wang Haifeng geleitet. Im Projekt „Wen Vorsitzender des technischen Komitees von Baidu und einer der Gründer des Baidu Translation Technology Teams.

Wang Haifeng

Wang Haifeng

Baidu ist eines der ersten Teams in China, das sich intensiv mit der Entwicklung von Pre-Training-Modellen beschäftigt Chinesische Effekte übertrafen BERT; Juli 2021 Das veröffentlichte ERNIE 3.0 übertraf GPT-3 in SuperGLUE; das im selben Jahr veröffentlichte „Pengcheng-Baidu Wenxin“ (ERNIE 3.0 Titan) war das erste wissensverbesserte 100-Milliarden-Level-Großmodell.

„Wissenserweiterung“ ist der technische Weg der Wenxin-Reihe, d Lernen großer Modelle Effizienz und Erklärbarkeit.

Im Jahr 2021 brachte Baidu auch einen Gesprächsroboter namens PLATO auf den Markt. Das Modell basiert auf dem groß angelegten Dialoggenerierungsmodell PLATO-XL mit zig Milliarden Parametern.

Der Vorteil von Baidu liegt in seinen umfangreichen Suchkorpusdaten, Benutzerdaten, die seit vielen Jahren intensiv in der KI-Forschung kultiviert werden und durch die Deep-Learning-Plattform Baidu Fei Paddle und selbst entwickelte Chips unterstützt werden.

Nach dem erbitterten Krieg zwischen Microsoft und Google war Baidu eines der ersten Teams in China, das seinen Plan bekannt gab, ein ChatGPT-Produkt („Wen Xin Yi Yan“) zu entwickeln. Insider enthüllten, dass es sich bei der Produktform möglicherweise um ein unabhängiges Portal handelt oder dass es Microsoft Bing imitieren und mit dem Baidu-Suchportal verbunden sein könnte.

AlibabaTongyi Large Model

Die Alibaba Damo Academy stieg 2021 in die Großmodellbranche ein und beteiligte sich an der Entwicklung des Großmodells „Wudao·Wenhui“ des Zhiyuan Research Institute. Training Das Sprachmodell PLUG (27 Milliarden Parameter) bezieht sich vollständig auf die Architektur von GPT-3, integriert Sprachverständnis- und Generierungsfunktionen und liegt in der Nähe von GPT-3.

Die multimodale Großmodellserie M6, die von Yang Hongxia, einem ehemaligen Mitglied des Intelligent Computing Laboratory der DAMO Academy (der letztes Jahr zurückgetreten ist) und Tang Jies Team an der Tsinghua-Universität entwickelt wurde, hat ebenfalls seine Parameter erhöht 10 Milliarden bis 10 Billionen.

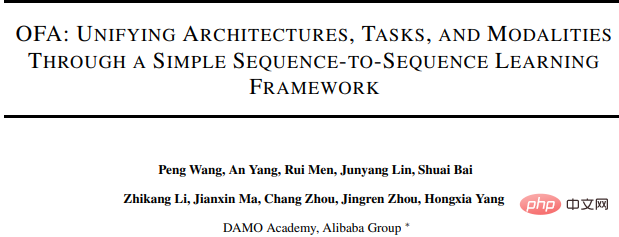

Unter der Leitung von Zhou Jingren, dem derzeitigen stellvertretenden Direktor der DAMO Academy, brachte die DAMO Academy im September letzten Jahres das große Modell „Tongyi“ auf den Markt, das den Höhepunkt der aktuellen Ergebnisse des Alibaba-Modells darstellt.

Jingren Zhou

Das große Modell „allgemeine Bedeutung“ vereint zum ersten Mal Modalität, Architektur und Aufgaben, und die technische Unterstützung dahinter ist das einheitliche Lernparadigma OFA.

Um die ökologische Open-Source-Konstruktion chinesischer Großmodelle zu fördern, hat die DAMO Academy im vergangenen Jahr auch die Open-Source-Community für KI-Modelle „Model Scope“ (Model Scope) ins Leben gerufen, was zu einem große Resonanz in der Branche.

Vor einigen Tagen hat die DAMO Academy bestätigt, dass sie die Alibaba-Version von ChatGPT basierend auf dem „Tongyi“-Großmodell entwickelt. Zusätzlich zur Textgenerierung verfügt sie auch über Malfunktionen. Es versteht sich, dass seine ChatGPT-ähnlichen Produkte tief in DingTalk integriert werden.

JD.comYanxi Large Model

JD.com begann im Jahr 2020 mit der Erforschung der KI-Textgenerierung, um die Generierung von JD.com-Produktseitenbeschreibungen zu unterstützen. Berichten zufolge werden 20 % der Produkteinführungen auf den Mall-Seiten von JD.com vom KI-Team mithilfe der NLP-Technologie generiert. Während dieser Zeit wurden Forschung und Entwicklung aufgrund der allgemeinen Depression der NLP-Technologie behindert, doch später schenkte JD.com erneut Aufmerksamkeit und brachte das große Yanxi-Modell auf den Markt.

He Xiaodong, der 2018 Microsoft verließ, um zu JD.com zu wechseln, ist derzeit Vizepräsident der JD.com Group, Geschäftsführer des JD.com AI Research Institute und Leiter der großen Modellforschung von JD.com Team heute.

He Xiaodong

Im Jahr 2021 leiteten er und der ehemalige JD-KI-Chef Zhou Bowen (der im November 2021 zurücktrat) ein Team zur Entwicklung der KI-Plattform auf JD Yanxipian Domain Modell K-PLUG. Dieses Modell ist eng in das E-Commerce-Szenario von JD.com integriert, lernt aus spezifischem Wissen im E-Commerce-Bereich und kann automatisch Produkttexte generieren.

JD.com verfügt derzeit nicht über ein großes Modell mit Hunderten von Milliarden Parametern, und K-PLUG verfügt nur über 1 Milliarde Parameter. Diesmal hat jedoch auch die JD.com Cloud Yanxi-Plattform ihre angekündigt Einstieg in das Spiel und wird das ChatGPT-Produkt „ChatJD“ auf den Markt bringen und seine „Industrieversion“-Farbe hervorheben.

HuaweiPangu Large Model

Die Rechenressourcen von Huawei bieten einen natürlichen Vorteil für die Forschung an großen Modellen.

Huawei begann im Jahr 2020 mit der Entwicklung großer Modelle, und der Anführer ist Tian Qi (IEEE Fellow, Akademiker der Internationalen Eurasischen Akademie der Wissenschaften).

Tian Qi

Im März 2020 wechselte er als Chefwissenschaftler im Bereich künstliche Intelligenz zu Huawei Cloud, nachdem GPT-3 im Sommer desselben Jahres herauskam Jahr gründete er sofort ein Team und begann mit der Entwicklung des großen Pangu-Modells. Huawei war damit einer der ersten großen Hersteller, der im Jahr 2020 am großen Modellwettbewerb teilnahm.

Basierend auf Ascend AI veröffentlichte Huawei in Zusammenarbeit mit dem Pengcheng Laboratory und Circular Intelligence im April 2021 die „Pangu“-Serie großer Modelle, darunter vier große Modelle für chinesische Sprache, Vision, Multimodalität und wissenschaftliches Rechnen.

Das Pangu NLP-Großmodell ist das erste große Modell der Branche, das Chinesisch in einer Größenordnung von Hunderten von Milliarden generiert und versteht. In der Vortrainingsphase wurden 40 TB chinesische Textdaten erlernt, darunter kleine Beispieldaten aus Industriesegmenten. In Bezug auf die Modellstruktur übernimmt Pangu die Encode- und Decode-Architektur, um seine Leistung bei der Generierung und beim Verständnis sicherzustellen.

Huawei verfügt über Forschungs- und Entwicklungserfahrung mit Hunderten von Milliarden Modellen und leistungsstarken Rechenressourcen, hat dieses Mal jedoch wenig Lärm gemacht und noch nicht klargestellt, ob es ChatGPT-ähnliche Produkte entwickeln wird.

3

Rulanzhou Technology-Gründer Zhou Ming, der Vorsitzende des IDEA Research Institute, Zhang Jiaxing, Xihu Xinchen Lan Zhenzhong, Xianyuan Technology-Gründer Zhou Bowen und andere sind allesamt Vertreter der akademischen Start-up-Schule.

Damit sie im zukünftigen ChatGPT-Geschäftskrieg gewinnen können, müssen sie auch ihre technischen und Marktbetriebskapazitäten stärken. Wie Zhang Jiaxing und Lan Zhenzhong sind sie bereits auf der Suche nach einem CEO für ihr Forschungs- und Entwicklungsteam.

Darüber hinaus können wir auch zwei Einstiegsmodi beobachten: Der eine basiert auf starken technischen Fähigkeiten, um die Mängel bei der Kommerzialisierung auszugleichen, und der andere ist das Ende eines Chefs mit umfassender Kommerzialisierungserfahrung, der technische Talente anzieht ein Team.

Welches Modell am Ende erfolgreicher sein wird, werden wir abwarten.

Lanzhou TechnologyZhou Ming

Als die letzte Runde des Parametertrends für große Modellstapel in vollem Gange war, wählte Zhou Ming einen einzigartigen Ansatz und wählte für sein Start-up-Unternehmen Lanzhou Technology eine leichtgewichtige große Modellroute .

Im Juni 2021 gründete Zhou Ming Lanzhou Technology. Im darauffolgenden Juli veröffentlichte sein Team das „Mencius“-Modell mit einer Milliarde Parametern, das genauso effektiv war wie ein großes Modell mit einer Milliarde Parametern.

Dies ist das Ergebnis der Blütezeit von Zhou Ming sowohl in der Wissenschaft als auch in der Industrie.

Zhou Ming

Zhou Ming

Zhou Ming ist einer der einflussreichsten chinesischen Wissenschaftler auf dem Gebiet des NLP. 1991 schloss er sein Studium am Harbin Institute of Technology mit einem Doktortitel ab. Er ist ein Kommilitone von Baidu-CTO Wang Haifeng und ein Schüler des Harbin Institute of Technology-Professors und NLP-Meisters Li Sheng. Während seiner Doktorarbeit entwickelte Zhou Ming Chinas erstes Chinesisch-Englisch-Übersetzungssystem.

Nach seinem Abschluss ging Zhou Ming zunächst als Lehrer an die Tsinghua-Universität. 1999 wurde er von Kaifu Lee, dem Gründungsdekan von Microsoft Research Asia (MSRA), abgeworben wurde später zum stellvertretenden Dekan von Microsoft Research Asia befördert.

Während der MSRA hat Zhou Ming viele Erfolge bei der Industrialisierung der NLP-Technologie erzielt. Er nahm an mehr als 100 Vorträgen auf der ACL-Konferenz teil, die auch auf erstklassige Anwendungen wie Windows und Office angewendet wurden , Azure und Microsoft Xiaoice im Produkt.

Im Jahr 2020 war Zhou Ming entschlossen, die Zusammenarbeit zwischen Wissenschaft und Industrie auf eine neue Art und Weise anzustreben. Deshalb beendete er seine 21-jährige Karriere bei Microsoft und trat dem von Kai-fu Lee gegründeten Sinovation Ventures Artificial Intelligence Engineering Institute als Leiter bei Wissenschaftler und begann ein Unternehmerteam aufzubauen, das schließlich Lanzhou Technology gründete.

Laut offiziellen Nachrichten wird Lanzhou Technology auf sein großes Sprachmodell zurückgreifen, das der zugrunde liegenden Technologie von ChatGPT ähnelt, um mit Chinese Online zusammenzuarbeiten, das über riesige Datenmengen verfügt, um ein inländisches ChatGPT zu erstellen. Es ist noch nicht bekannt, ob das Team von Zhou Ming weiterhin den Weg des Leichtbaumodells einschlagen oder sich als technische Unterstützung der Herstellung großer Modelle mit mehr als 100 Milliarden Ebenen zuwenden wird. Xianyuan Technology Zhou Bowen Zentrum der Fakultät für Elektronik.

Gleichzeitig ist Zhou Bowen immer noch ein neuer Unternehmer. Ende 2021 trat er als Senior Vice President von JD.com zurück und verließ das Unternehmen, um Xianyuan Technology zu gründen.

zhou. Bowen

#🎜🎜 # # 🎜🎜#Zhou Bowen ist ein Junior-Absolvent der University of Science and Technology of China. Er ist Doktorand an der University of Colorado Boulder. Nach seinem Abschluss arbeitete er bei IBM und war Dekan der IBM Research Artificial Intelligence Foundations (AI Foundations), Chefwissenschaftler der IBM Watson Group und IBM Distinguished Engineer. Im Jahr 2017 kam Zhou Bowen als Vizepräsident der JD.com Group zu JD.com und war für die KI-Forschung von JD.com verantwortlich.NLP, Multimodalität, Mensch-Computer-Dialog usw. sind alles Bereiche, in denen sich Zhou Bowen seit vielen Jahren intensiv engagiert. Der von ihm vorgeschlagene Mechanismus zur Darstellung natürlicher Sprache des Selbstaufmerksamkeitsfusions-Mehrkopfmechanismus wurde später zu einer der Kernideen der Transformer-Architektur. Er schlug auch zwei Modellarchitekturen und Algorithmen zur Erzeugung natürlicher Sprache im Bereich AIGC vor. Im Jahr 2020 wurde er zum IEEE Fellow gewählt.

Nach Ansicht von Zhou Bowen liegt der Kernfortschritt von ChatGPT in der Verbesserung der menschlichen Zusammenarbeit und des interaktiven Lernens und nicht in der Erweiterung des Modells. Darüber hinaus wird sich ChatGPT definitiv weiterentwickeln ein Multi-Mode-Modell im Zukunftszustand, das auch die zentrale Forschungsrichtung des von ihm geleiteten Collaborative Interactive Intelligence Research Center ist.

Bei Xianyuan Technology hat Zhou Bowen auch einige AIGC-Anwendungen implementiert, beispielsweise den Einsatz generativer künstlicher Intelligenz, um verbraucher- und marktorientierte Echtzeitinnovationen zu beschleunigen Erfolgsquote der SKU-Innovation.

IDEA Research Institute Zhang Jiaxing

In der Guangdong-Hong Kong-Macao Greater Bay Area, in Neben Pengcheng Laboratory und Tencent gibt es noch einen weiteren großen Modellspieler, nämlich das IDEA Research Institute (vollständiger Name „Guangdong-Hong Kong-Macao Greater Bay Area Digital Economy Research Institute“), das 2020 von namhaften KI-Wissenschaftlern gegründet wurde wie Shen Xiangyang.

Die Person, die für das große Modell des IDEA Research Institute verantwortlich ist, ist Zhang Jiaxing, der ebenfalls ein KI-Wissenschaftler ist, der von MSRA #🎜 kam 🎜#

🎜##🎜 🎜#

Zhang Jiaxing schloss 2006 sein Studium an der Fakultät für Elektronik der Universität Peking mit einem Doktortitel ab blieb eine Zeit lang bei Baidu, trat dann dem Bing-Suchteam bei und arbeitete mit Zhou Jingren zusammen. Später beschäftigte sich Zhang Jiaxing mit der Systemforschung bei MSRA 2014 trat Zhang Jiaxing dem Alibaba iDST-Team (dem Vorgänger der Damo Academy) bei und wechselte ein Jahr später zu Ant Financial, um das NLP-Technikteam zu leiten, wo er Konversationsroboter auf Finanzszenarien anwendete Wu Haisheng, CEO von Digital, wechselt als leitender Wissenschaftler zu 360 Digital und verließ das Unternehmen nach nur eineinhalb Jahren. Auf Empfehlung von MSRA-Dekan Zhou Lidong wechselte Zhang Jiaxing als leitender Wissenschaftler zum IDEA Research Institute für das Cognitive Computing and Natural Language Research Center 🎜#Zhang Jiaxings Team war schon immer an der Spitze dieser AIGC-Welle. Er leitete die Entwicklung der Open-Source-Modellreihe „Fengshenbang“ und brachte die erste inländische chinesische Version auf den Markt Stabiles Diffusionsmodell „Taiyi“ im letzten Jahr 🎜#

Zhang Jiaxing schloss 2006 sein Studium an der Fakultät für Elektronik der Universität Peking mit einem Doktortitel ab blieb eine Zeit lang bei Baidu, trat dann dem Bing-Suchteam bei und arbeitete mit Zhou Jingren zusammen. Später beschäftigte sich Zhang Jiaxing mit der Systemforschung bei MSRA 2014 trat Zhang Jiaxing dem Alibaba iDST-Team (dem Vorgänger der Damo Academy) bei und wechselte ein Jahr später zu Ant Financial, um das NLP-Technikteam zu leiten, wo er Konversationsroboter auf Finanzszenarien anwendete Wu Haisheng, CEO von Digital, wechselt als leitender Wissenschaftler zu 360 Digital und verließ das Unternehmen nach nur eineinhalb Jahren. Auf Empfehlung von MSRA-Dekan Zhou Lidong wechselte Zhang Jiaxing als leitender Wissenschaftler zum IDEA Research Institute für das Cognitive Computing and Natural Language Research Center 🎜#Zhang Jiaxings Team war schon immer an der Spitze dieser AIGC-Welle. Er leitete die Entwicklung der Open-Source-Modellreihe „Fengshenbang“ und brachte die erste inländische chinesische Version auf den Markt Stabiles Diffusionsmodell „Taiyi“ im letzten Jahr 🎜#

西湖xinchenlanzhenzhong

Auch der Gründer von Xihu Xinchen sucht einen CEO für das Team Leute Lan Zhenzhong

Lan Zhenzhong

Letztes Jahr kam der „Dream Stealer“ (jetzt umbenannt in „Dream Diary“), der unter vielen heimischen KI-Malereiprodukten herausragte, vom Team von Lan Zhenzhong.

Lan Zhenzhong schloss sein Studium an der Sun Yat-sen University mit einem Bachelor ab und studierte Computer Vision an der Carnegie Mellon University. Später wechselte er zur Verarbeitung natürlicher Sprache, als er bei Google arbeitete. Er entwickelte das berühmte Licht -gewichteter Computer basierend auf Googles TPU-Ressourcen, quantitativem Großmodell „ALBERT“.

Im Juni 2020 kehrte Lan Zhenzhong nach China zurück, um an der Westlake University zu studieren, gründete ein Deep-Learning-Labor und begann mit der multimodalen Forschung zur Kombination von Sprache und Sehen.

Auf der Grundlage der wissenschaftlichen Forschungsressourcen der West Lake University und des zuvor beigetretenen Zhiyuan „Qingyuan Club“ startete Lan Zhenzhong das Industrie-Universitäts-Forschungsmodell und gründete West Lake Xinchen. Er entwickelte zunächst den psychologischen Beratungs-Chat-Roboter „Xiaotian“. „ basierend auf einem großen Modell und brachte dann im August 2022 das inländische Malprodukt „Dream Stealer“ in der Stable Diffusion-Welle auf den Markt.

Nicht lange nach der Veröffentlichung von ChatGPT brachte Xihu Xinchen ein ähnliches Textgenerierungsprodukt „Xinchen Chat“ auf den Markt. Der Unterschied besteht darin, dass es auf das Internet zugreifen kann und multimodal interaktiv ist. Es kann nicht nur Text generieren, sondern auch Bilder ausgeben.

Wie viele Menschen, die als Wissenschaftler angefangen und dann mit dem Unternehmertum begonnen haben, war Lan Zhenzhong auch der festen Überzeugung, dass das Team einen CEO mit Managementerfahrung und starken Fähigkeiten zur Ressourcenintegration brauchte, um die chinesische Version von OpenAI zu entwickeln. Bitte achten Sie morgen auf die KI-Technologie-Rezension: „Lan Zhenzhong hat auch einen „Heldenbeitrag“ gepostet, die chinesische Version des ChatGPT-Starunternehmens sucht CEO“

Das obige ist der detaillierte Inhalt vonWelche inländischen akademischen Kräfte können die Gelegenheit nutzen, um eine chinesische Version von ChatGPT zu erstellen?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr