Heim >Technologie-Peripheriegeräte >KI >Eine weitere Revolution im Reinforcement Learning! DeepMind schlägt eine „Algorithmus-Destillation' vor: einen erforschbaren, vorab trainierten Reinforcement-Learning-Transformer

Eine weitere Revolution im Reinforcement Learning! DeepMind schlägt eine „Algorithmus-Destillation' vor: einen erforschbaren, vorab trainierten Reinforcement-Learning-Transformer

- 王林nach vorne

- 2023-04-12 18:58:152155Durchsuche

In aktuellen Sequenzmodellierungsaufgaben kann Transformer als die leistungsstärkste neuronale Netzwerkarchitektur bezeichnet werden, und das vorab trainierte Transformer-Modell kann Eingabeaufforderungen als Bedingungen oder kontextbezogenes Lernen verwenden, um sich an verschiedene nachgelagerte Aufgaben anzupassen.

Die Generalisierungsfähigkeit des vorab trainierten Transformer-Modells in großem Maßstab wurde in mehreren Bereichen überprüft, z. B. Textvervollständigung, Sprachverständnis, Bilderzeugung usw.

Seit letztem Jahr gibt es relevante Arbeiten, die belegen, dass das Modell durch die Behandlung von Offline-Reinforcement-Learning (Offline-RL) als Sequenzvorhersageproblem „Richtlinien aus Offline-Daten lernen“ kann.

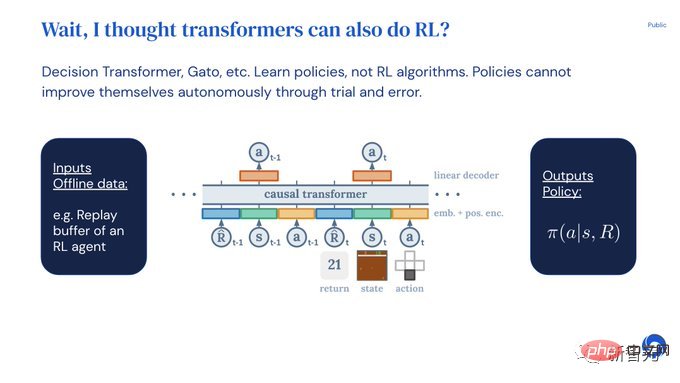

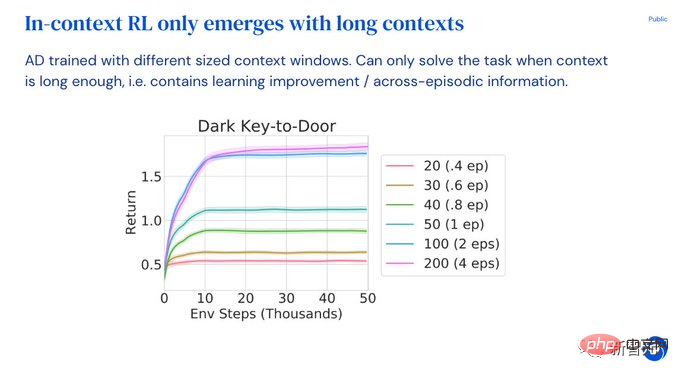

Aber aktuelle Methoden lernen die Richtlinie entweder aus Daten, die kein Lernen enthalten (z. B. eine durch Destillation festgelegte Expertenrichtlinie), oder lernen aus Daten, die Lernen enthalten (z. B. dem Wiedergabepuffer des Agenten), aber weil ihr Kontext vorhanden ist zu klein, es kann politische Verbesserungen nicht erfassen.

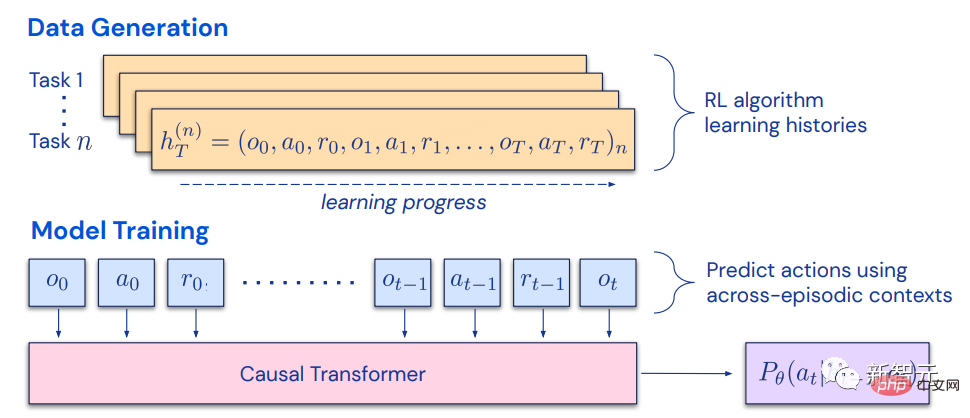

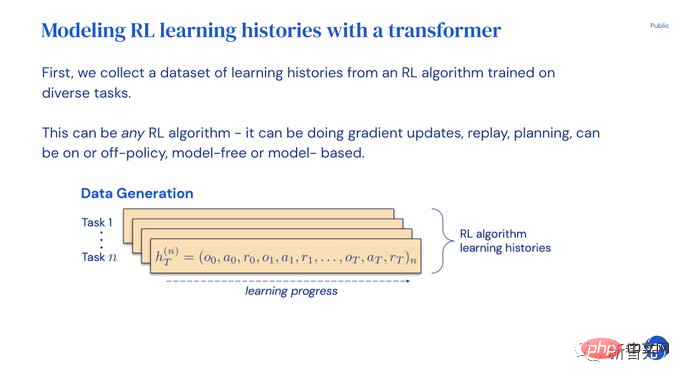

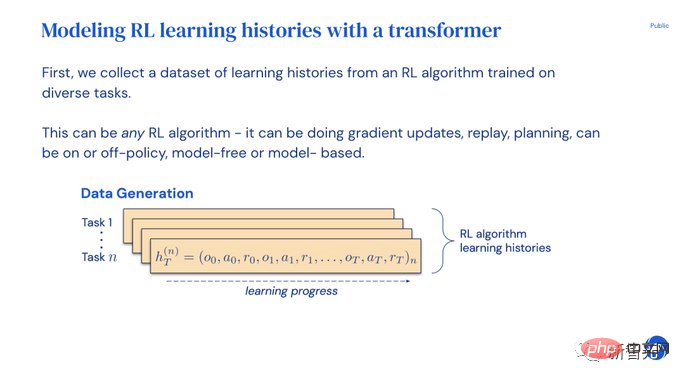

die sequentielle Natur des Lernens beim Training von Reinforcement-Learning-Algorithmen den Reinforcement-Learning-Prozess selbst als „Problem der kausalen Sequenzvorhersage“ modellieren kann .

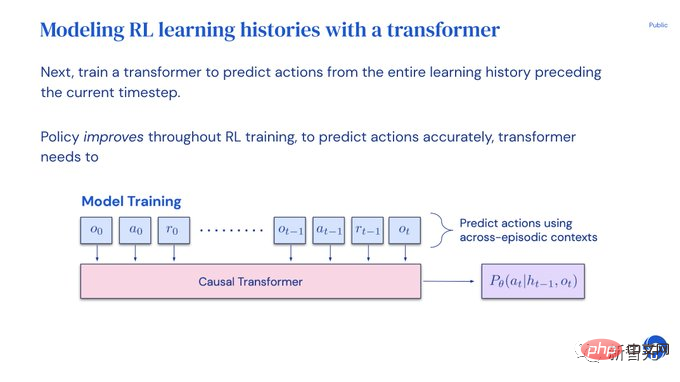

Insbesondere wenn der Kontext eines Transformers lang genug ist, um Richtlinienverbesserungen aufgrund von Lernaktualisierungen einzuschließen, sollte er nicht nur in der Lage sein, eine feste Richtlinie darzustellen, sondern auch in der Lage sein, den Status, die Aktionen und Belohnungen der vorherigen darzustellen Episoden, indem man sich darauf konzentriert, als Betreiber zur Politikverbesserung dargestellt.Dies bietet auch die technische Machbarkeit, dass jeder RL-Algorithmus durch Nachahmungslernen in ein ausreichend leistungsfähiges Sequenzmodell destilliert und in einen kontextbezogenen RL-Algorithmus umgewandelt werden kann.

Auf dieser Grundlage schlug DeepMind die Algorithmusdestillation (AD) vor, die durch die Erstellung eines Kausalsequenzmodells Verstärkungslernalgorithmen in neuronale Netze extrahiert.

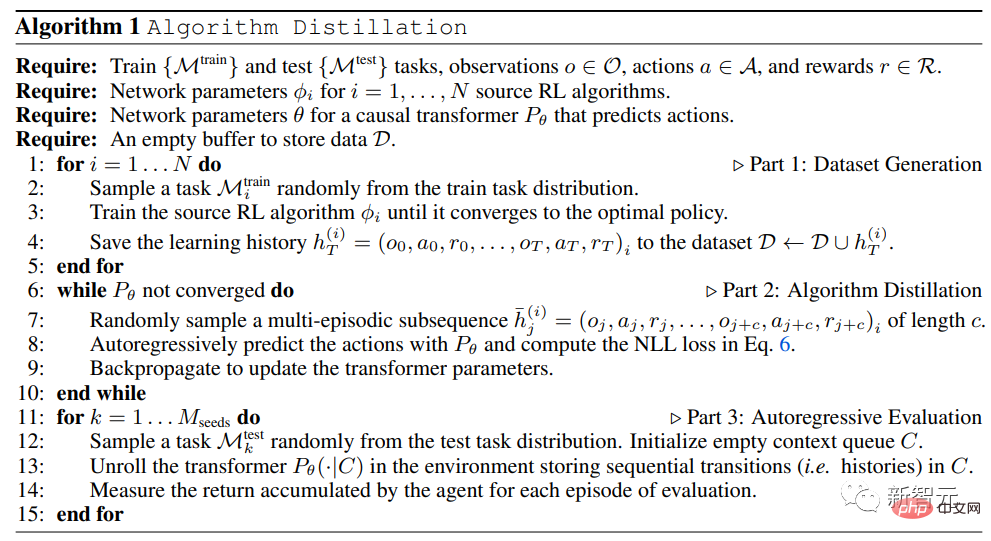

... generiert einen Lernverlaufsdatensatz und trainiert dann den Kausaltransformer, indem er das Verhalten durch Autoregression basierend auf dem Lernverlauf als Kontext vorhersagt.

Transfomer sammelt seine eigenen Daten und maximiert die Belohnungen für neue Aufgaben.

Keine Eingabeaufforderung oder Feinabstimmung erforderlich.

Mit eingefrorenen Gewichten erkundet, nutzt und maximiert Transformer den Kontext. Experten-Destillationsmethoden wie Gato können nicht erforschen und die Erträge nicht maximieren.

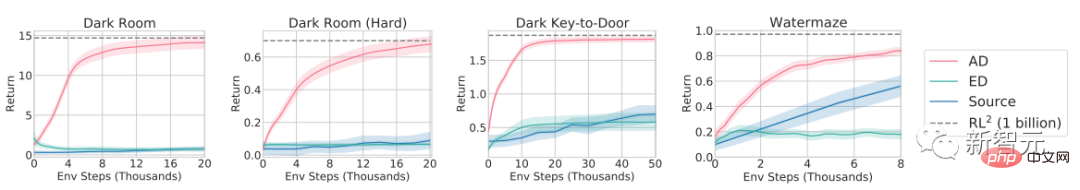

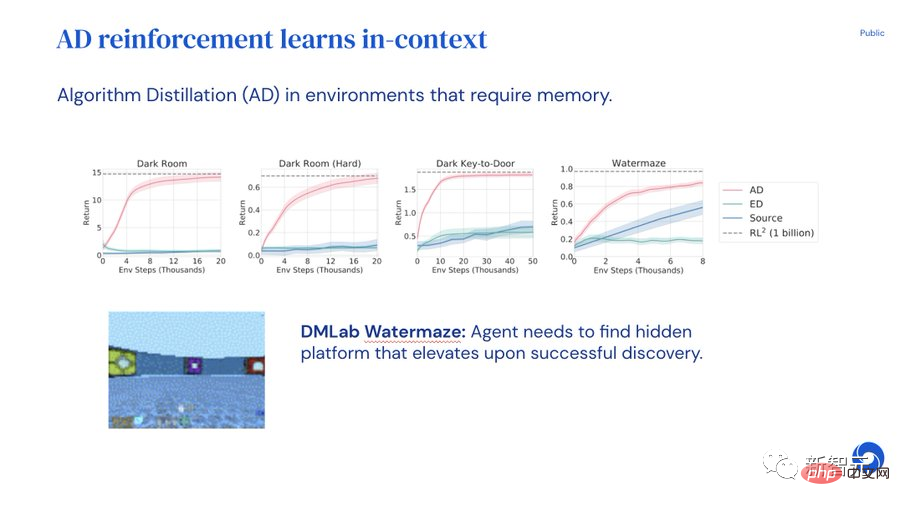

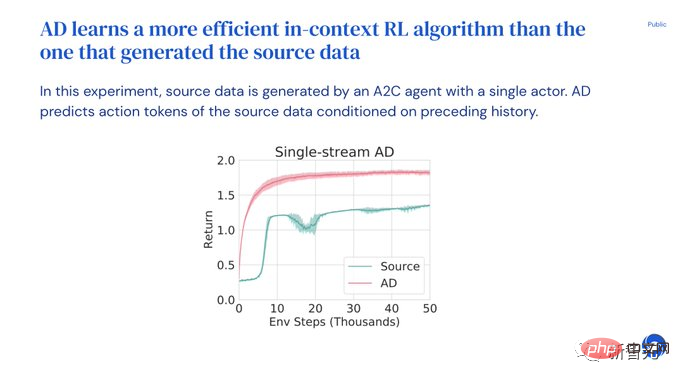

- Experimentelle Ergebnisse belegen, dass AD verstärkendes Lernen in verschiedenen Umgebungen mit spärlichen Belohnungen, kombinierten Aufgabenstrukturen und pixelbasierten Beobachtungen durchführen kann und dass AD-Lernen dateneffizienter ist als der RL-Algorithmus, der Quelldaten generiert .

- AD ist auch das erste

- , das kontextbestärkende Lernmethoden durch Sequenzmodellierung von Offline-Daten mit Imitationsverlust demonstriert. Algorithmusdestillation

Im Jahr 2021 entdeckten einige Forscher erstmals, dass Transformer durch Nachahmungslernen Einzelaufgabenrichtlinien aus Offline-RL-Daten lernen kann, und wurde anschließend erweitert, um Multiaufgabenrichtlinien sowohl in derselben Domäne als auch domänenübergreifend zu extrahieren Einstellungen.

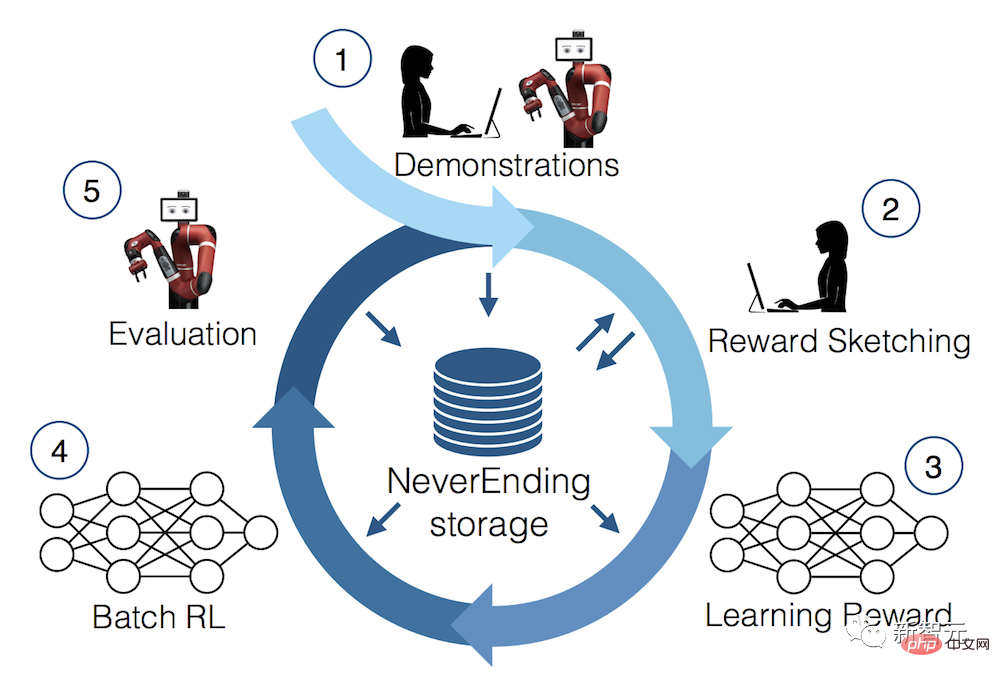

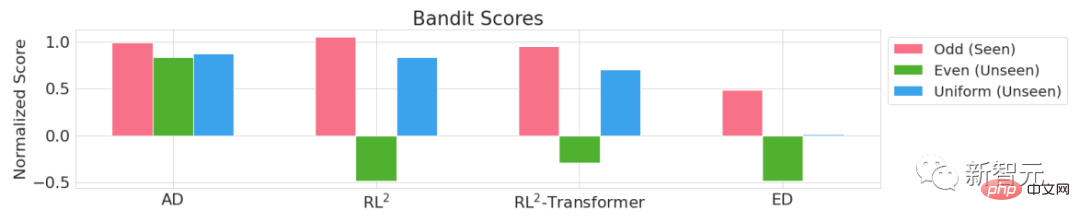

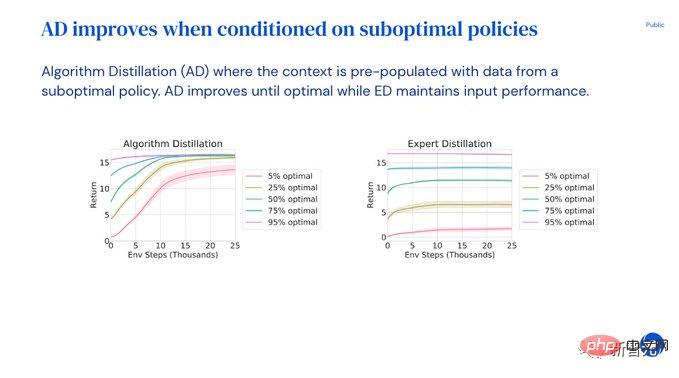

Diese Arbeiten schlagen ein vielversprechendes Paradigma für die Extraktion allgemeiner Multitasking-Richtlinien vor: Sammeln Sie zunächst einen großen und vielfältigen Datensatz von Umweltinteraktionen und extrahieren Sie dann durch Sequenzmodellierung eine Richtlinie aus den Daten. Die Methode zum Erlernen von Richtlinien aus Offline-RL-Daten durch Nachahmungslernen wird auch Offline-Richtliniendestillation oder einfach Richtliniendestillation (PD) genannt. Obwohl die Idee von PD sehr einfach und leicht zu erweitern ist, weist PD einen großen Fehler auf: Die generierte Strategie verbessert sich nicht durch zusätzliche Interaktionen mit der Umgebung. Zum Beispiel hat MultiGame Decision Transformer (MGDT) eine Return-Conditional-Richtlinie gelernt, mit der eine große Anzahl von Atari-Spielen gespielt werden kann, während Gato eine Richtlinie zum Lösen von Aufgaben in verschiedenen Umgebungen durch Kontextinferenzaufgaben gelernt hat, aber beide Methoden nicht verbessert seine Strategie durch Versuch und Irrtum. MGDT passt den Transformator durch Feinabstimmung der Gewichte des Modells an neue Aufgaben an, während Gato fachmännische Demonstrationstipps benötigt, um sich an neue Aufgaben anzupassen. Kurz gesagt, die Policy-Destillation-Methode lernt Richtlinien statt verstärkender Lernalgorithmen. Der Grund, warum Forscher die Hypothese aufstellten, dass Policy Distillation nicht durch Versuch und Irrtum verbessert werden kann, liegt darin, dass es auf Daten trainiert wird, die keinen Lernfortschritt zeigen. Algorithmische Destillation (AD) ist eine Methode zum Erlernen intrinsischer Richtlinienverbesserungsoperatoren durch Optimierung des kausalen Sequenzvorhersageverlusts in der Lernhistorie eines RL-Algorithmus. AD umfasst zwei Komponenten: 1. Generieren Sie einen großen Multitask-Datensatz, indem Sie den Trainingsverlauf eines RL-Algorithmus für viele einzelne Aufgaben speichern; 2, den Transformer nutzt die bisherige Lerngeschichte als Hintergrund, um Handlungen kausal zu modellieren. Da sich die Richtlinie während des gesamten Trainingsprozesses des Quell-RL-Algorithmus ständig verbessert, muss AD lernen, wie der Operator verbessert werden kann, um die Aktionen an jedem beliebigen Punkt im Trainingsverlauf genau zu simulieren. Am wichtigsten ist, dass die Kontextgröße des Transformers groß genug sein muss (d. h. über Epochen hinweg), um Verbesserungen in den Trainingsdaten zu erfassen. Um die Vorteile von AD bei kontextbezogenen RL-Fähigkeiten zu erkunden, konzentrierten sich die Forscher im experimentellen Teil auf Umgebungen, die nach dem Vortraining nicht durch Zero-Shot-Generalisierung gelöst werden können, d Umgebung ist erforderlich. Es werden verschiedene Aufgaben unterstützt, und die Lösung der Aufgabe kann vom Modell nicht einfach aus Beobachtungen abgeleitet werden. Gleichzeitig müssen Episoden kurz genug sein, damit kausale Transformer über Episoden hinweg trainiert werden können. Wie aus den experimentellen Ergebnissen der vier Umgebungen Adversarial Bandit, Dark Room, Dark Key-to-Door und DMLab Watermaze hervorgeht, wird durch die Nachahmung des Gradienten-basierten RL-Algorithmus ein kausaler Transformer mit einem großen Wenn genügend Kontext vorhanden ist, kann AD das Erlernen neuer Aufgaben im Kontext vollständig verstärken. AD ist in der Lage, kontextbezogene Exploration, zeitliche Credit-Zuweisung und Generalisierung durchzuführen. Der von AD erlernte Algorithmus ist dateneffizienter als der Algorithmus, der die Quelldaten für das Transformer-Training generiert. Um das Verständnis des Papiers zu erleichtern, veröffentlichte Michael Laskin, einer der Autoren des Papiers, eine PPT-Erklärung auf Twitter. Experimente zur Algorithmusdestillation zeigen, dass Transformer das Modell durch Versuch und Irrtum autonom verbessern kann, ohne Gewichtungen, Eingabeaufforderungen oder Feinabstimmungen zu aktualisieren. Ein einzelner Transformer kann seine eigenen Daten sammeln und die Belohnungen für neue Aufgaben maximieren. Obwohl es viele erfolgreiche Modelle gibt, die zeigen, wie Transformer im Kontext lernt, konnte noch nicht nachgewiesen werden, dass Transformer das Lernen im Kontext stärkt. Um sich an neue Aufgaben anzupassen, müssen Entwickler entweder manuell eine Eingabeaufforderung festlegen oder das Modell anpassen. Wäre es nicht schön, wenn Transformer sich an Reinforcement Learning anpassen und sofort einsetzbar wäre? Aber Decision Transformers oder Gato können Strategien nur aus Offline-Daten lernen und sich nicht automatisch durch wiederholte Experimente verbessern. Der mit der Pre-Training-Methode der Algorithmic Distillation (AD) generierte Transformer kann bestärkendes Lernen im Kontext durchführen. Trainieren Sie zunächst mehrere Kopien eines Reinforcement-Learning-Algorithmus, um verschiedene Aufgaben zu lösen und den Lernverlauf zu speichern. Sobald der Lernverlaufsdatensatz erfasst ist, kann ein Transformer trainiert werden, um die Aktionen des vorherigen Lernverlaufs vorherzusagen. Da sich Richtlinien in der Vergangenheit verbessert haben, wird die genaue Vorhersage von Aktionen den Transformer dazu zwingen, Richtlinienverbesserungen zu modellieren. Der gesamte Prozess ist so einfach, dass er nur durch Nachahmung von Aktionen trainiert wird. Es gibt keinen Q-Wert wie bei herkömmlichen Verstärkungslernmodellen und keine Rückgaben wie bei DTs. Im Kontext verursacht Reinforcement Learning keinen zusätzlichen Overhead, und das Modell wird dann bewertet, indem beobachtet wird, ob AD die Belohnung für die neue Aufgabe maximieren kann. Transformer erforscht, nutzt und maximiert Erträge, wenn im Kontext seine Gewichte eingefroren sind! Andererseits kann Expert Distillation (das Gato am ähnlichsten ist) weder Renditen erforschen noch maximieren. AD kann jeden RL-Algorithmus extrahieren. Die Forscher haben UCB und DQNA2C ausprobiert. Ein interessantes Ergebnis ist, dass AD beim kontextuellen RL-Algorithmuslernen effizienter ist. Benutzer können auch schnelle und suboptimale Demos eingeben, und das Modell verbessert die Strategie automatisch, bis die optimale Lösung erreicht ist! Und von Experten destilliertes ED kann nur eine suboptimale Demoleistung aufrechterhalten. Context RL wird nur angezeigt, wenn der Kontext des Transformers lang genug ist und mehrere Episoden umfasst. AD erfordert eine ausreichend lange Historie für effektive Modellverbesserungs- und Identifizierungsaufgaben. Durch Experimente kamen Forscher zu folgenden Schlussfolgerungen:

PPT-Erklärung

Das obige ist der detaillierte Inhalt vonEine weitere Revolution im Reinforcement Learning! DeepMind schlägt eine „Algorithmus-Destillation' vor: einen erforschbaren, vorab trainierten Reinforcement-Learning-Transformer. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr