Heim >Technologie-Peripheriegeräte >KI >Machen Sie das Training und die Schlussfolgerung großer Modelle schneller als je zuvor! Googles Zusammenfassung zum Jahresende 2022, die vierte

Machen Sie das Training und die Schlussfolgerung großer Modelle schneller als je zuvor! Googles Zusammenfassung zum Jahresende 2022, die vierte

- 王林nach vorne

- 2023-04-12 18:04:031589Durchsuche

Obwohl Googles Bard umgefallen ist, ist die KI-Stärke von Google immer noch nicht zu unterschätzen.

Seit Anfang des Jahres wird die zusammenfassende Reihe zum Jahresende von Google Research „Google Research, 2022 und darüber hinaus“ fortgesetzt seit Jahresbeginn Update, kürzlich aktualisiert auf die vierte Ausgabe.

Das Thema dieser Ausgabe lautet "Verbesserung der Modelleffizienz". Schauen wir uns an, welche Ideen die Google-Ingenieure entwickelt haben!

Betriebseffizienz wird zum Schlüssel

Deep Learning hat im letzten Jahrzehnt explosionsartig zugenommen, vor allem aufgrund neuer Algorithmen und der Konvergenz von Architekturen Datenvolumen und Verbesserungen der Rechenleistung.

Im Vergleich zu vor zehn Jahren sind Modelle für künstliche Intelligenz und maschinelles Lernen größer und komplexer geworden, mit tieferen und komplexeren Netzwerkstrukturen, mehr Parametern und es werden mehr Daten verwendet in der Ausbildung, die zusammen zu einigen der transformativsten Ergebnisse in der Geschichte des maschinellen Lernens geführt haben.

Da diese Modelle zunehmend in Produktions- und Geschäftsanwendungen eingesetzt werden, sind die Inferenzeffizienz und die Betriebskosten des Modells von einem untergeordneten Faktor zu einem großen begrenzenden Faktor geworden.

Die Antwort von Google in dieser Hinsicht besteht darin, weiterhin stark in die Effizienz des maschinellen Lernens zu investieren und vor allem die folgenden vier Probleme zu lösen:

# 🎜🎜 #1. Effiziente Architektur

2. 🎜🎜#

3. Trainingseffizienz)#🎜🎜 #4. Inferenzeffizienz

Neben der Effizienz steht das Modell auch vor Herausforderungen im Zusammenhang mit der Authentizität. Es gibt viele Probleme wie Sicherheit, Datenschutz und Aktualität.

Dieser Artikel konzentriert sich auf eine Reihe neuer Algorithmen, die von Google Research entwickelt wurden, um die oben genannten Herausforderungen zu bewältigen.

Effiziente Modellarchitektur

Eine grundlegende Frage ist: Gibt es eine bessere Möglichkeit, das Modell zu parametrisieren, um die Effizienz zu verbessern?Im Jahr 2022 konzentriert sich Google Research auf neue Technologien zur Verbesserung von Modellen durch das Abrufen von Kontext, das Mischen von Experten und die Erstellung von Transformatoren (den Kern der meisten großen Modelle für maschinelles Lernen). effektiver, wodurch externes Wissen eingebracht wird.

Kontexterweiterte Modelle

für Im Streben nach höherer Qualität und Effizienz können neuronale Modelle aus dem externen Kontext in großen Datenbanken oder trainierbaren Speichern verbessert werden.

Durch die Nutzung des abgerufenen Kontexts muss sich das neuronale Netzwerk nicht viel Weltwissen in seinen internen Parametern merken und kann eine bessere Parametereffizienz, Interpretierbarkeit usw. erreichen Authentizität.

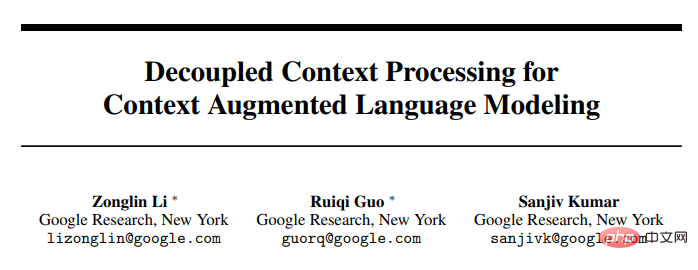

In dem Artikel „Entkoppelte Kontextverarbeitung für kontextgestützte Sprachmodellierung“ untersuchten die Forscher eine entkoppelte Codec-Architektur, die auf der Integration von externem Kontext in die einfache Architektur in Sprachmodellen basiert.

Dieses Modell kann erheblich Rechenaufwand einsparen und bietet gleichzeitig eine hervorragende Leistung bei der autoregressiven Sprachmodellierung und der Beantwortung von Fragen im offenen Bereich Ergebnisse.

Vorab trainierte große Sprachmodelle (LLM) verbrauchen viele Informationen durch die Selbstüberwachung großer Trainingssätze, es ist jedoch nicht klar, wie hoch das weltweite Wissen darüber ist Modelle ist, wie es mit dem Eingabekontext interagiert. #? Kontext und irrelevanten Kontext in überwachte Standarddatensätze integrieren und so die Kontrollierbarkeit und Robustheit von LLM verbessern.

Eines der Probleme bei der Erforschung modularer tiefer Netzwerke besteht darin, eine konzeptionelle Datenbank mit entsprechenden Rechenmodulen zu entwerfen. Die Forscher schlugen eine theoretische Architektur vor, die „Erinnerungsereignisse“ mit Skizzen kombiniert Externe LSH-Tabelle, die ein Zeigermodul zur Bearbeitung von Skizzen enthält.

Ein weiteres Puzzleteil für kontexterweiterte Modelle sind Beschleuniger zum schnellen Abrufen von Informationen aus großen Datenbanken.

Die Forscher entwickelten einen TPU-basierten Suchalgorithmus für den nächsten Nachbarn, der mit dem Leistungsmodell der TPU übereinstimmt und analytische Garantien für den erwarteten Rückruf bietet, um die besten Ergebnisse zu erzielen .

Suchalgorithmen beinhalten oft eine große Anzahl von Hyperparametern und Designoptionen, was es schwierig macht, sie für neue Aufgaben zu optimieren, daher schlugen die Forscher außerdem einen neuen A-beschränkten Optimierungsalgorithmus vor Um Hyperparameter automatisch zu optimieren und dabei einen gewünschten Kosten- oder Rückrufwert als Eingabe zu verwenden, erzeugt der Algorithmus eine Abstimmung, die empirisch sehr nahe an der Pareto-Grenze des Geschwindigkeitsrückrufs liegt und eine führende Leistung bei Standard-Benchmarks bietet. Das „Mixture-of-Experts“-Modell hat sich als wirksames Mittel erwiesen, um die Kapazität neuronaler Netzwerkmodelle zu erhöhen, ohne deren Rechenkosten übermäßig zu erhöhen. Die Grundidee von MoEs besteht darin, ein Netzwerk aus mehreren Experten-Subnetzwerken aufzubauen, wobei jeder Input von einem entsprechenden Experten-Subnetzwerk verarbeitet wird.

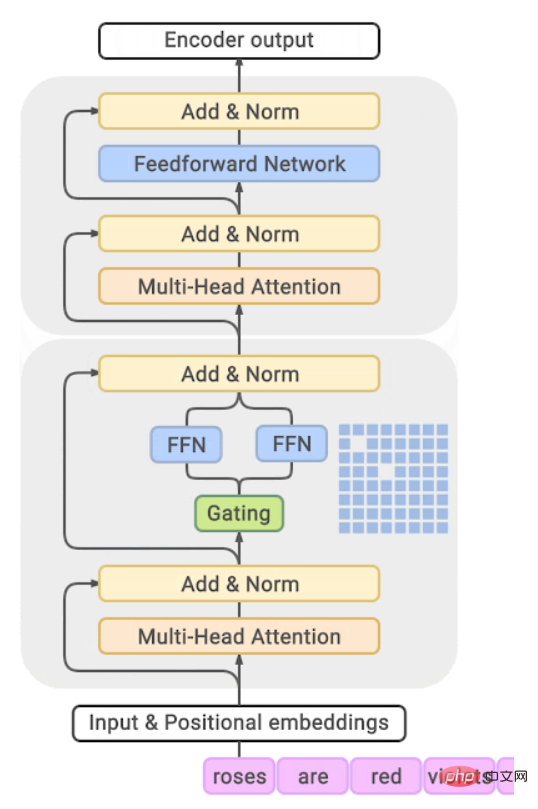

Daher rufen MoEs im Vergleich zu standardmäßigen neuronalen Netzen nur einen kleinen Teil des gesamten Modells auf, wodurch die Effizienz von Sprachmodellanwendungen wie GLaM verbessert wird.

Entscheiden Sie, welche Experten aktiv sein sollen, um an einer bestimmten Veranstaltung teilzunehmen Die Eingabe hängt von der Routing-Funktion ab, und der Entwurf des Routings stellt eine große Herausforderung dar, da der Entwickler erwartet, dass jedes Expertenmodell angemessen ist und nicht zu wenig oder zu stark genutzt wird. In einer kürzlich durchgeführten Arbeit schlugen Forscher das Expertenauswahl-Routing (Expert Choice Routing) vor, einen neuen Routing-Mechanismus, der nicht jedes Eingabe-Token Top-K-Experten zuweist, sondern wiederum jeden Experten Top-K-Token zuweist, die automatisch angepasst werden können der Lastausgleich von Experten, wodurch natürlich mehrere Experten gleichzeitig mit dem Eingabetoken umgehen können 🎜🎜#Effiziente Transformers

Eine Kernkomponente dieses Modelltyps ist die Aufmerksamkeitsschicht, die die Beziehung zwischen „Abfrage“- und „Schlüssel“-Ähnlichkeit berechnet, um einen geeigneten „Wert“ zu konstruieren ( Wert) gewichtete Kombination. Obwohl die Leistung hoch ist, ist die Recheneffizienz des Aufmerksamkeitsmechanismus nicht hoch und die Komplexität beträgt normalerweise die zweite Potenz der Länge der Eingabesequenz.

Da der Umfang von Transformer immer weiter zunimmt, ist die Forschung zu einer der wichtigen Fragen sehr wertvoll: Gibt es ein Lernmodell für natürlich vorkommende Strukturen oder Muster, die sein können? gelöst? Wie Aufmerksamkeit funktioniert.

Da der Umfang von Transformer immer weiter zunimmt, ist die Forschung zu einer der wichtigen Fragen sehr wertvoll: Gibt es ein Lernmodell für natürlich vorkommende Strukturen oder Muster, die sein können? gelöst? Wie Aufmerksamkeit funktioniert.

In diesem Zusammenhang hat Google Research die Lerneinbettungen der mittleren MLP-Schichten untersucht und festgestellt, dass sie beispielsweise nur über Papierlink: https://arxiv.org/pdf/2210.06313.pdf

Forscher haben kürzlich das Treeformer-Modell vorgeschlagen, eine Alternative zur Standard-Aufmerksamkeitsberechnung, die auf Entscheidungsbäumen basiert und es intuitiv ermöglicht, schnell einen kleinen Satz von Schlüsseln zu identifizieren, die für eine Abfrage relevant sind, und Aufmerksamkeit nur auf diesen Satz zu erzwingen. Erfahrungsgemäß kann Treeformer die FLOPs der Aufmerksamkeitsschicht um das 30-fache reduzieren.

Gleichzeitig führten die Forscher auch die sequentielle Aufmerksamkeit ein, eine Methode zur Auswahl differenzierbarer Merkmale, die Aufmerksamkeits- und Gier-Algorithmen kombiniert. Diese Technologie hat sich nachweislich direkt und nahtlos auf groß angelegte Modelle übertragen lassen.

Eine weitere Möglichkeit, die Effizienz von Transformer zu verbessern, besteht darin, die Berechnung von Softmax in der Aufmerksamkeitsschicht zu beschleunigen.

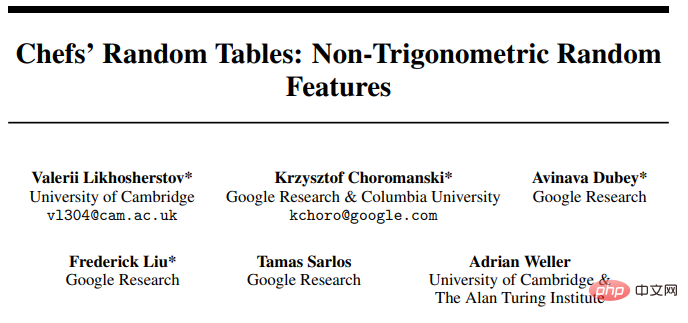

Basierend auf der Untersuchung der Low-Rank-Approximation des Softmax-Kernels schlugen die Forscher einen neuen Typ von Zufallsmerkmalen vor, der die erste „positive und begrenzte“ Zufallsmerkmalsnäherung des Softmax-Kernels bereitstellte und die Sequenzlänge linear berechnete .

Link zum Papier: https://arxiv.org/abs/2205.15317

und schlug auch den ersten Mechanismus vor, der die Maskierung mehrerer Aufmerksamkeit abdeckt, wie z. B. kausale Kodierung und relative Positionskodierung .

Trainingseffizienz

Effektive Optimierungsmethoden sind der Grundstein moderner maschineller Lernanwendungen und besonders wichtig in großen Umgebungen.

In diesem Fall erfordern selbst adaptive Methoden erster Ordnung wie Adam in der Regel viele Berechnungen, und die Stabilität des Trainings wird sehr schwierig.

Darüber hinaus sind diese Methoden oft irrelevant für die Architektur des neuronalen Netzwerks und berücksichtigen nicht die Strukturinformationen innerhalb der Modellarchitektur, was zu einer geringen Trainingseffizienz führt. Dies fördert auch neue Technologien, um moderne neuronale Netzwerkmodelle effektiver zu optimieren .

Google Research hat einige neue Trainingstechniken basierend auf Modellarchitektur entwickelt, beispielsweise zum Training des Transofmre-Netzwerks, einschließlich des neuen skaleninvarianten Transofmre-Netzwerks und der neuen Clipping-Methode im Vergleich zum ursprünglichen stochastischen Gradientenabstieg (SGD). ) In Kombination kann das Training beschleunigt werden.

Link zum Papier: https://arxiv.org/pdf/2202.00980.pdf

Mit dieser Methode gelang es den Forschern erstmals, nur mit einfachen SGD effizient zu trainieren BERT ohne Adaptivität.

Darüber hinaus schlugen die Forscher eine neue Methode, LocoProp, vor, um eine ähnliche Leistung wie der Optimierer zweiter Ordnung zu erzielen und gleichzeitig die gleichen Rechen- und Speicherressourcen wie der Optimierer erster Ordnung zu verwenden.

LocoProp erhält eine modulare Ansicht neuronaler Netze, indem es diese in eine Kombination von Schichten zerlegt. Jede Schicht darf dann ihre eigene Verlustfunktion sowie Ausgabeziele und Gewichtsanpassungen haben. Bei diesem Setup führt LocoProp nach entsprechenden Vorwärts- und Rückwärtsgradientendurchläufen weiterhin parallele Aktualisierungen des „lokalen Verlusts“ jeder Schicht durch.

Link zum Papier: https://proceedings.mlr.press/v151/amid22a.html -Order-Optimierer erreicht LocoProp eine mit High-Order-Optimierern vergleichbare Leistung bei Deep-Autoencoder-Benchmarks und ist gleichzeitig deutlich schneller.

Eine wichtige Annahme von Optimierern wie SGD ist, dass jeder Datenpunkt unabhängig und identisch aus einer Verteilung abgetastet wird. In realen Anwendungsumgebungen wie dem Reinforcement Learning ist es jedoch schwierig, diese Annahme zu erfüllen, da das Modell (. oder Agent) muss aus den generierten Daten auf der Grundlage seiner eigenen Vorhersagen lernen.Forscher haben eine neue Algorithmusmethode namens SGD mit umgekehrter Erfahrungswiedergabe vorgeschlagen, die in linearen dynamischen Systemen, nichtlinearen dynamischen Systemen und Q-Learning des verstärkenden Lernens verwendet werden kann. Finden Sie unter diesen Umständen die optimale Lösung.

Papierlink: https://arxiv.org/abs/2103.05896#🎜 🎜 #

Darüber hinaus hat sich eine verbesserte Version dieser Methode, IER, experimentell als auf dem neuesten Stand und bei verschiedenen gängigen RL-Benchmarks als die stabilste erwiesen Wiedergabetechnologie.

DateneffizienzTiefe neuronale Netze sind stark auf große Datensätze angewiesen, mit den damit verbundenen Speicherkosten und potenziellen Sicherheits-/Datenschutzbedenken, Schulungen sind modern Die Verwendung tiefer neuronaler Netze in diesen Datensätzen ist ebenfalls mit hohen Rechenkosten verbunden.

Ein vielversprechender Weg, dieses Problem zu lösen, ist die Auswahl von Datenteilmengen, bei der das Ziel des Lernenden darin besteht, aus einer großen Anzahl von Trainingsbeispielen die informativste Teilmenge zu finden Ansatz (oder sogar Verbesserung) des Trainings des gesamten Trainingssatzes.

Die Forscher analysierten ein Teilmengenauswahl-Framework, das für die Arbeit mit beliebigen Modellfamilien in einer praktischen Batch-Einstellung konzipiert ist, bei der der Lernende einzelne Proben abtasten, auf den Kontext zugreifen und … echte Labels, aber um den Overhead zu begrenzen, kann der Status nur aktualisiert werden, sobald ein ausreichend großer Stapel von Proben ausgewählt wurde, d. h. die Modellgewichte können weiter trainiert werden.

Darauf aufbauend wurde ein Algorithmus namens IWeS entwickelt, der Stichproben durch Wichtigkeitsstichprobe auswählt, wobei die jeder Stichprobe zugewiesene Stichprobenwahrscheinlichkeit auf der Entropie der Stichprobe basiert Modell, das auf dem zuvor ausgewählten Stapel trainiert wurde. Das Papier bietet eine theoretische Analyse, die Grenzen der Generalisierung und der Abtastrate aufzeigt.

Papierlink: https://arxiv.org /pdf/2301.12052.pdf

Ein weiteres Problem beim Training großer Netzwerke besteht darin, dass sie möglicherweise gemischte Auswirkungen auf die Trainingsdaten und die Daten haben, die sie wann sehen Die bereitgestellten Programme reagieren sehr empfindlich auf Änderungen in den Verteilungen, insbesondere wenn es sich um eine begrenzte Menge an Trainingsdaten handelt, die möglicherweise nicht alle Bereitstellungszeitszenarien umfassen.

Eine aktuelle Studie stellt die Hypothese auf, dass „extreme Einfachheitsverzerrung“ das Schlüsselproblem hinter dieser Fragilität neuronaler Netze ist, und ihre neueste Arbeit macht diese Hypothese machbar. Dies führte zu zwei neue komplementäre Methoden, DAFT und FRR, die zusammen deutlich leistungsfähigere neuronale Netze liefern. Insbesondere nutzen diese beiden Methoden kontradiktorische Feinabstimmung und inverse Merkmalsvorhersage, um die Robustheit des Lernnetzwerks zu verbessern.

Papierlink: https://arxiv.org /pdf/2006.07710.pdf

InferenzeffizienzEs hat sich gezeigt, dass die Vergrößerung eines neuronalen Netzwerks dessen Verbesserung verbessert Vorhersagen Es gibt beeindruckende Ergebnisse in Bezug auf die Genauigkeit. Die Nutzung dieser Vorteile in der realen Welt ist jedoch eine Herausforderung, da die Kosten für die Inferenz für große Modelle unerschwinglich sein können, ein Problem, das auch Strategien zur Verbesserung der Serviceeffizienz ohne Einbußen bei der Genauigkeit vorantreibt. Forscher haben verschiedene Strategien vorgeschlagen, um dieses Ziel zu erreichen, insbesondere solche, die auf Wissensdestillation und adaptivem Computing basieren. Die Destillation ist ein einfaches und effektives Modell. Die Komprimierungsmethode erweitert die potenzielle Anwendbarkeit großer neuronaler Modelle erheblich und hat sich in einer Reihe praktischer Anwendungen wie Werbeempfehlungen als sehr effektiv erwiesen. In den meisten Anwendungsfällen der Destillation geht es um die direkte Anwendung grundlegender Modelle auf eine bestimmte Domäne, wobei nur ein begrenztes Verständnis dafür besteht, wann und warum dies erfolgen sollte. Die Forschung von Google befasst sich mit der Anpassung der Destillation an bestimmte Umstände und untersucht systematisch die Faktoren, die den Destillationserfolg bestimmen. Algorithmisch entwickelten die Forscher durch sorgfältige Modellierung des Rauschens in den vom Lehrermodell bereitgestellten Etiketten einen prinzipiellen Ansatz zur Neugewichtung der Trainingsbeispiele und eine robuste Methode zum Abtasten von Teilmengen von Daten mit Lehreretiketten.

Papierlink: https://arxiv.org /abs/2210.06711

Im Prozess der „lehrergeführten Ausbildung“ schlugen die Forscher einen neuen Destillationsrahmen vor: Anstatt Lehrer passiv zur Kennzeichnung eines festen Datensatzes zu verwenden, werden Lehrer aktiv verwendet, um die Auswahl der zu kennzeichnenden Informationsproben zu steuern Destillationsprozess bei begrenzten Daten oder Long-Tail-Umgebungen effizienter gestalten.

Link zum Dokument: https://arxiv.org/abs/2208.06825 Encoder, der auch eine wichtige Einstellung für die Bewertung der Relevanz von (Abfrage-, Dokument-)Paaren ist.

Link zum Papier: https://proceedings.mlr.press/v162/menon22a/menon22a.pdf

Link zum Papier: https://proceedings.mlr.press/v162/menon22a/menon22a.pdf

Der Leistungsunterschied zwischen dem Cross-Encoder und dem Dual-Encoder wird im untersucht In den Begründungen des Artikels heißt es, dass dies eher auf eine Verallgemeinerung als auf eine Kapazitätsbeschränkung des Dual-Encoders zurückzuführen sein könnte.

Eine sorgfältig konstruierte Destillationsverlustfunktion kann diese Situation entschärfen und die Leistungslücke zwischen Cross-Encoder und Dual-Encoder schließen.

Anschließend wurde bei EmbedDistil die weitere Verbesserung der Dual-Encoder-Destillation durch Anpassen von Einbettungen aus dem Lehrermodell weiter untersucht. Diese Strategie kann auch verwendet werden, um Informationen aus großen bis kleinen Dual-Encoder-Modellen zu extrahieren, bei denen sich die Übernahme und das Einfrieren von Einbettungen von Lehrerdokumenten als sehr effektiv erweist.

Link zum Papier: https://arxiv.org/abs/2301.12005 in der Lage sein, Lehrerbezeichnungen vorherzusagen.

Link zum Papier: https://arxiv.org/abs/2301.12005 in der Lage sein, Lehrerbezeichnungen vorherzusagen.

Link zum Papier: https://arxiv.org/abs/2301.12245 Fähigkeitslücken können sich auf die Destillation auswirken, da die Labels solcher Lehrer den rein zufälligen Labels für Schüler ähneln können.

Link zum Papier: https://arxiv.org/abs/2301.12923 Auch für den Lehrer ist das Modellproblem schwierig. Intuitiv könnte dies den Schülern helfen, ihre begrenzten Fähigkeiten auf die Stichproben zu konzentrieren, die vernünftig modelliert werden können.

Adaptive Berechnung

Obwohl die Destillation eine wirksame Methode zur Reduzierung der Inferenzkosten ist, ist ihre Wirkung bei allen Proben einheitlich. Intuitiv kann es sein, dass einige „einfache“ Proben wesentlich weniger Berechnung erfordern als relativ „schwierigere“. " Proben.

Obwohl die Destillation eine wirksame Methode zur Reduzierung der Inferenzkosten ist, ist ihre Wirkung bei allen Proben einheitlich. Intuitiv kann es sein, dass einige „einfache“ Proben wesentlich weniger Berechnung erfordern als relativ „schwierigere“. " Proben.

Das Ziel des Adaptive Computing besteht darin, Mechanismen zu entwerfen, die solche stichprobenabhängigen Berechnungen durchführen können.

Confident Adaptive Language Modeling (CALM) führt kontrollierte Early-Exit-Funktionalität für Transformer-basierte Textgeneratoren wie T5 ein.... Gate verwendet eine Konfidenzmetrik mit einem Entscheidungsschwellenwert, der kalibriert ist, um statistische Leistungsgarantien zu erfüllen.

Auf diese Weise muss das Modell für die anspruchsvollsten Vorhersagen nur den gesamten Decoder-Layer-Stack und für einfachere Vorhersagen nur wenige Decoder-Layer berechnen. In der Praxis verwendet das Modell durchschnittlich etwa ein Drittel so viele Schichten für Vorhersagen, was zu einer zwei- bis dreifachen Geschwindigkeitssteigerung bei gleichbleibender Generierungsqualität führt.

Ein häufig verwendeter adaptiver Berechnungsmechanismus besteht aus einer Kaskade von zwei oder mehr Grundmodellen. Die Hauptfrage besteht darin, zu entscheiden, ob die Vorhersagen einfach auf nachgelagerte Modelle übertragen werden sollen Eine geeignete Verlustfunktion, die entsprechende Signale als Überwachung nutzen kann, um Entscheidungen aufzuschieben.

Google Research hat bestehende Verlustfunktionen systematisch untersucht und gezeigt, dass sie aufgrund der impliziten Anwendung der Label-Glättung möglicherweise nicht für Trainingsbeispiele geeignet sind. Das Papier zeigte auch, dass diese Situation durch Post-hoc-Training verzögerter Regeln gemildert werden kann Es ist in keiner Weise eine Änderung der Modellinterna erforderlich.

Link zum Papier: https://openreview.net/pdf?id=_jg6Sf6tuF7

Für Retrieval-Anwendungen werden standardmäßige semantische Suchtechniken für jede Einbettung verwendet, die durch große Modelle mit fester Darstellung erzeugt wird Das heißt, die Größe und Fähigkeiten der Darstellung sind größtenteils festgelegt, unabhängig von nachgelagerten Aufgaben und der damit verbundenen Computerumgebung oder Einschränkungen.

Matroschka-Darstellungslernen bietet die Flexibilität, die Darstellung entsprechend der Einsatzumgebung anzupassen, wodurch die Darstellung zu einer natürlichen Reihenfolge in ihren Koordinaten gezwungen wird, sodass in ressourcenbeschränkten Umgebungen nur die höchsten Koordinaten der Darstellung verwendet werden Für umfangreichere und präzisionskritischere Einstellungen ist die Verwendung weiterer dargestellter Koordinaten möglich.

... bieten bis zu 16-mal niedrigere Berechnungen bei gleichen Rückruf- und Präzisionsmessungen.

Groß angelegte Modelle für maschinelles Lernen zeigen transformative Ergebnisse in mehreren Bereichen, aber Effizienz beim Training und bei der Inferenz wird zu einer entscheidenden Voraussetzung, um diese Modelle in der realen Welt umsetzbar zu machen. Durch die Entwicklung neuer Basistechnologien hat Google Research erhebliche Investitionen in die Effizienz groß angelegter Modelle für maschinelles Lernen getätigt, was auch in Zukunft nachhaltige Anstrengungen erfordert. Wir werden uns weiterhin mit den Kernherausforderungen befassen, um Modelle für maschinelles Lernen robuster und effizienter zu machen .

Das obige ist der detaillierte Inhalt vonMachen Sie das Training und die Schlussfolgerung großer Modelle schneller als je zuvor! Googles Zusammenfassung zum Jahresende 2022, die vierte. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr