Heim >Technologie-Peripheriegeräte >KI >Können sich DALL-E und Flamingo verstehen? Drei vorab trainierte SOTA-Neuronale Netze vereinheitlichen Bilder und Text

Können sich DALL-E und Flamingo verstehen? Drei vorab trainierte SOTA-Neuronale Netze vereinheitlichen Bilder und Text

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-12 16:49:101327Durchsuche

Ein wichtiges Ziel der multimodalen Forschung ist die Verbesserung der Fähigkeit der Maschine, Bilder und Texte zu verstehen. Insbesondere haben Forscher große Anstrengungen unternommen, um eine sinnvolle Kommunikation zwischen den beiden Modellen zu erreichen. Beispielsweise sollte die Generierung von Bildunterschriften in der Lage sein, den semantischen Inhalt des Bildes in kohärenten Text umzuwandeln, der für Menschen verständlich ist. Im Gegensatz dazu können generative Text-Bild-Modelle auch die Semantik von Textbeschreibungen nutzen, um realistische Bilder zu erstellen.

Dies wirft einige interessante Fragen im Zusammenhang mit der Semantik auf: Welche Textbeschreibung beschreibt das Bild für ein bestimmtes Bild am genauesten? Und wie lässt sich für einen gegebenen Text ein Bild am sinnvollsten umsetzen? Bezüglich der ersten Frage behaupten einige Studien, dass die beste Bildbeschreibung Informationen sein sollte, die sowohl natürlich sind als auch den visuellen Inhalt wiederherstellen können. Was die zweite Frage betrifft, sollten aussagekräftige Bilder von hoher Qualität, vielfältig und dem Textinhalt treu sein.

In jedem Fall können uns interaktive Aufgaben mit Text-Bild-Generierungsmodellen und Bild-Text-Generierungsmodellen, angetrieben durch menschliche Kommunikation, dabei helfen, den korrektesten Bildtext auszuwählen.

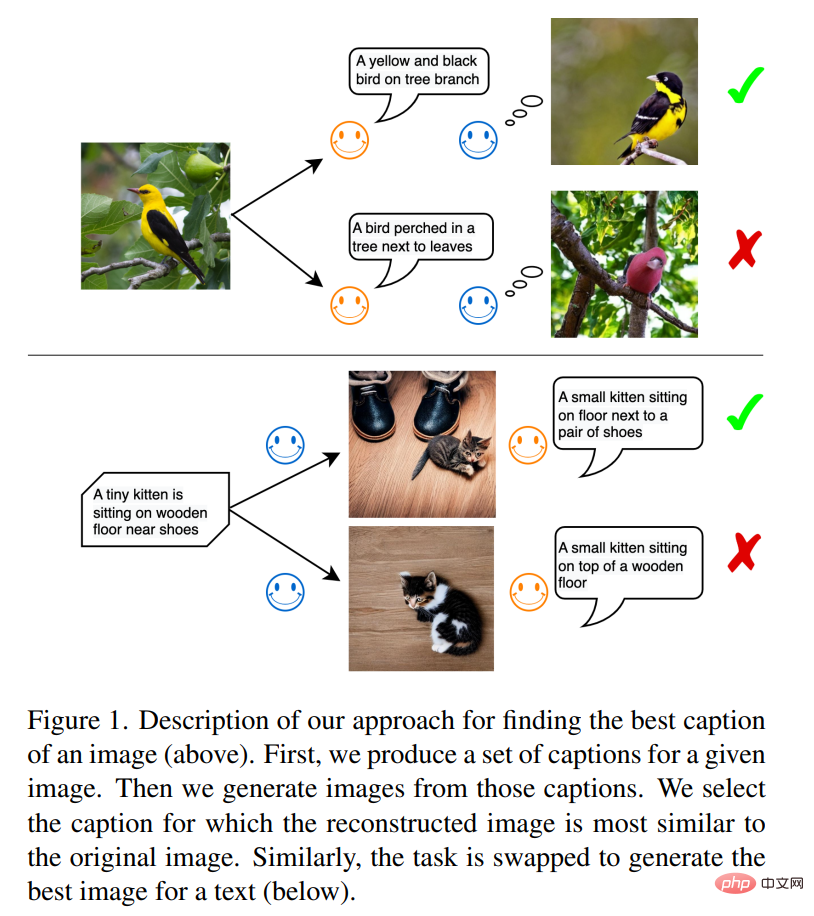

Wie in Abbildung 1 gezeigt, ist in der ersten Aufgabe das Bild-Text-Modell der Informationssender und das Text-Bild-Modell der Informationsempfänger. Ziel des Senders ist es, dem Empfänger den Bildinhalt in natürlicher Sprache zu vermitteln, sodass dieser die Sprache versteht und eine realistische visuelle Darstellung rekonstruiert. Sobald der Empfänger die ursprünglichen Bildinformationen mit hoher Wiedergabetreue rekonstruieren kann, zeigt dies an, dass die Informationen erfolgreich übertragen wurden. Forscher glauben, dass die auf diese Weise generierte Textbeschreibung optimal ist und das dadurch generierte Bild dem Originalbild am ähnlichsten ist.

Diese Regel ist vom Sprachgebrauch der Menschen zur Kommunikation inspiriert. Stellen Sie sich folgendes Szenario vor: In einem Notruf erfährt die Polizei per Telefon etwas über den Autounfall und den Status der Verletzten. Dabei handelt es sich im Wesentlichen um den Prozess der Bildbeschreibung durch Zeugen vor Ort. Die Polizei muss die Umgebungsszene anhand der verbalen Beschreibung gedanklich rekonstruieren, um eine angemessene Rettungsaktion zu organisieren. Offensichtlich sollte die beste Textbeschreibung der beste Leitfaden für die Rekonstruktion der Szene sein.

Die zweite Aufgabe beinhaltet die Textrekonstruktion: Das Text-Bild-Modell wird zum Nachrichtensender und das Bild-Text-Modell zum Nachrichtenempfänger. Sobald sich die beiden Modelle über den Inhalt der Informationen auf der Textebene einig sind, ist das zur Informationsvermittlung verwendete Bildmedium das optimale Bild, das den Quelltext wiedergibt.

In diesem Artikel steht die von Forschern der Universität München, Siemens und anderen Institutionen vorgeschlagene Methode in engem Zusammenhang mit der Kommunikation zwischen Agenten. Sprache ist die wichtigste Methode zum Austausch von Informationen zwischen Agenten. Aber wie können wir sicher sein, dass der erste Agent und der zweite Agent das gleiche Verständnis davon haben, was eine Katze oder ein Hund ist?

Papieradresse: https://arxiv.org/pdf/2212.12249.pdf#🎜 🎜#

Die Idee, die dieser Artikel untersuchen möchte, besteht darin, den ersten Agenten das Bild analysieren und einen das Bild beschreibenden Text generieren zu lassen, und dann erhält der zweite Agent das Bild Text und simulieren Sie Bilder entsprechend. Unter diesen kann der letztere Prozess als ein Prozess der Verkörperung betrachtet werden. Die Studie geht davon aus, dass die Kommunikation erfolgreich ist, wenn das vom zweiten Agenten simulierte Bild dem vom ersten Agenten empfangenen Eingabebild ähnelt (siehe Abbildung 1).

In den Experimenten wurden in dieser Studie Standardmodelle verwendet, insbesondere kürzlich entwickelte vorab trainierte Großmodelle. Flamingo und BLIP sind beispielsweise Bildbeschreibungsmodelle, die automatisch Textbeschreibungen basierend auf Bildern generieren können. Ebenso können auf Bild-Text-Paaren trainierte Bilderzeugungsmodelle die tiefe Semantik von Text verstehen und qualitativ hochwertige Bilder synthetisieren, wie das DALL-E-Modell und das latente Diffusionsmodell (SD).

Darüber hinaus nutzte die Studie auch das CLIP-Modell, um Bilder oder Text zu vergleichen. CLIP ist ein visuelles Sprachmodell, das Bilder und Text in einem gemeinsamen Einbettungsraum zuordnet. Diese Studie verwendet manuell erstellte Bildtextdatensätze wie COCO und NoCaps, um die Qualität des generierten Textes zu bewerten. Generative Bild- und Textmodelle verfügen über stochastische Komponenten, die es ermöglichen, aus einer Verteilung Stichproben zu ziehen und so aus einer Reihe von Kandidatentexten und -bildern die besten auszuwählen. In Bildbeschreibungsmodellen können verschiedene Sampling-Methoden, einschließlich Kernel-Sampling, verwendet werden. In diesem Artikel wird Kernel-Sampling als Grundmodell verwendet, um die Überlegenheit der in diesem Artikel verwendeten Methode zu zeigen.

Methodenübersicht

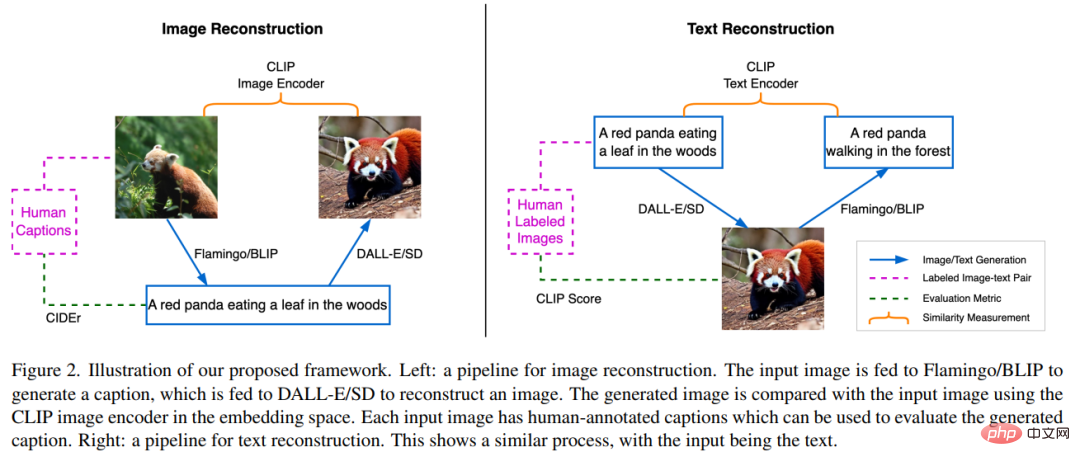

Das Framework dieses Artikels besteht aus drei vorab trainierten SOTA-Neuronalen Netzen. Erstens das Bild-Text-Generierungsmodell; zweitens das multimodale Darstellungsmodell, das aus einem Bild-Encoder und einem Text-Encoder besteht, die Bilder bzw. Texte in ihre semantischen Einbettungen abbilden können.

Bildrekonstruktion über Textbeschreibung

# 🎜🎜#Wie in der linken Hälfte von Abbildung 2 dargestellt, besteht die Aufgabe der Bildrekonstruktion darin, Sprache als Anweisungen zur Rekonstruktion des Quellbildes zu verwenden. Der Effekt dieses Prozesses führt zur Generierung des besten Textes, der die Quelle beschreibt Szene. Zunächst wird ein Quellbild x dem BLIP-Modell zugeführt, um mehrere Kandidatentexte y_k zu generieren. Zum Beispiel frisst ein Roter Panda Blätter im Wald. Der generierte Textkandidatensatz wird mit C bezeichnet, und dann wird der Text y_k an das SD-Modell gesendet, um das Bild x’_k zu generieren. Hier bezieht sich x’_k auf das Bild, das basierend auf Roter Panda generiert wurde. Anschließend wird ein CLIP-Bildencoder verwendet, um semantische Merkmale aus der Quelle und den generierten Bildern zu extrahieren: und  .

.

Dann wird die Kosinusähnlichkeit zwischen den beiden Einbettungsvektoren berechnet, um die Kandidatentextbeschreibung y_s zu finden, d. h. #🎜 🎜 #

Die Studie verwendete CIDEr (Image Description Metric) und referenzierte menschliche Anmerkungen, um die besten Texte zu bewerten. Da wir an der Qualität des generierten Textes interessiert waren, wurde in dieser Studie das BLIP-Modell so eingestellt, dass Text ungefähr gleicher Länge ausgegeben wird. Dies gewährleistet einen relativ fairen Vergleich, da die Länge des Textes positiv mit der Informationsmenge im Bild korreliert, die vermittelt werden kann. Während dieser Arbeit werden alle Modelle eingefroren und es werden keine Feinabstimmungen vorgenommen.

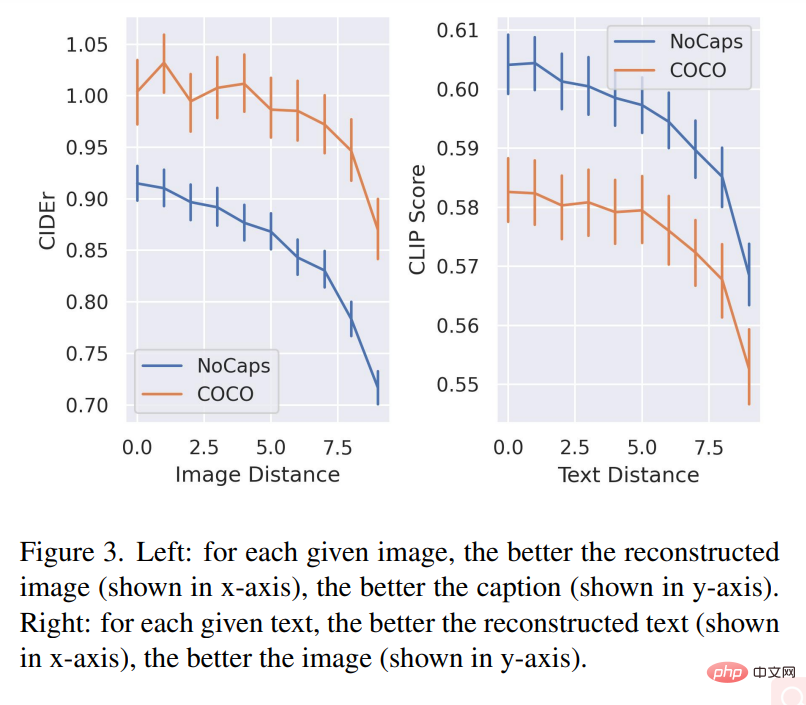

Textrekonstruktion durch Bilder Der rechte Teil von Abbildung 2 zeigt die Umkehrung des im vorherigen Abschnitt beschriebenen Prozesses. Das BLIP-Modell erfordert das Erraten des Quelltexts mithilfe eines SD, der Zugriff auf den Text hat, seinen Inhalt jedoch nur in Form eines Bildes wiedergeben kann. Der Prozess beginnt mit der Verwendung von SD, um Kandidatenbilder x_k für den Text y zu generieren, und der resultierende Satz von Kandidatenbildern wird mit K bezeichnet. Die Generierung von Bildern mithilfe von SD erfordert einen Zufallsstichprobenprozess, bei dem jeder Generierungsprozess zu unterschiedlichen gültigen Bildproben in einem riesigen Pixelraum führen kann. Diese Stichprobenvielfalt bietet einen Pool von Kandidaten, um die besten Bilder herauszufiltern. Anschließend generiert das BLIP-Modell eine Textbeschreibung y’_k für jedes abgetastete Bild x_k. Hier bezieht sich y’_k auf den Anfangstext. Ein roter Panda krabbelt im Wald. Die Studie verwendet dann einen CLIP-Text-Encoder, um Merkmale des Quelltexts und des generierten Texts zu extrahieren, dargestellt durch , das dem Text y entspricht, als Referenzdarstellung von y und quantifiziert das beste Bild anhand seiner Nähe zum Referenzbild. Das rechte Diagramm von Abbildung 3 zeigt die Beziehung zwischen der Qualität des wiederhergestellten Texts und der Qualität des generierten Bildes: Für jeden gegebenen Text wird die rekonstruierte Textbeschreibung ( Je höher die Bildqualität (auf der x-Achse dargestellt), desto besser ist die Bildqualität (auf der y-Achse dargestellt). Abbildung 4(a) und (b) zeigen die Bildrekonstruktionsqualität und die durchschnittliche Textqualität basierend auf dem Quellbild. Abbildung 4(c) und (d) zeigen die Korrelation zwischen Textabstand und rekonstruierter Bildqualität.

bzw.

bzw.  . Der Zweck dieser Aufgabe besteht darin, das beste Kandidatenbild x_s zu finden, das der Semantik des Textes y entspricht. Dazu muss die Studie den Abstand zwischen dem generierten Text und dem Eingabetext vergleichen und dann das Bild mit dem kleinsten gepaarten Textabstand auswählen, d. h.

. Der Zweck dieser Aufgabe besteht darin, das beste Kandidatenbild x_s zu finden, das der Semantik des Textes y entspricht. Dazu muss die Studie den Abstand zwischen dem generierten Text und dem Eingabetext vergleichen und dann das Bild mit dem kleinsten gepaarten Textabstand auswählen, d. h.  # 🎜🎜##🎜 🎜#

# 🎜🎜##🎜 🎜# Experimentelle Ergebnisse

Experimentelle Ergebnisse

Das obige ist der detaillierte Inhalt vonKönnen sich DALL-E und Flamingo verstehen? Drei vorab trainierte SOTA-Neuronale Netze vereinheitlichen Bilder und Text. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr