Heim >Technologie-Peripheriegeräte >KI >Den größten ViT der Geschichte bequem trainiert? Google aktualisiert das visuelle Sprachmodell PaLI: unterstützt mehr als 100 Sprachen

Den größten ViT der Geschichte bequem trainiert? Google aktualisiert das visuelle Sprachmodell PaLI: unterstützt mehr als 100 Sprachen

- 王林nach vorne

- 2023-04-12 09:31:061478Durchsuche

Der Fortschritt der natürlichen Sprachverarbeitung ist in den letzten Jahren größtenteils auf groß angelegte Sprachmodelle zurückzuführen. Mit jedem neuen Modell steigt die Menge an Parametern und Trainingsdaten auf ein neues Niveau Gleichzeitig werden auch die bestehenden Benchmark-Rankings abgeschlachtet!

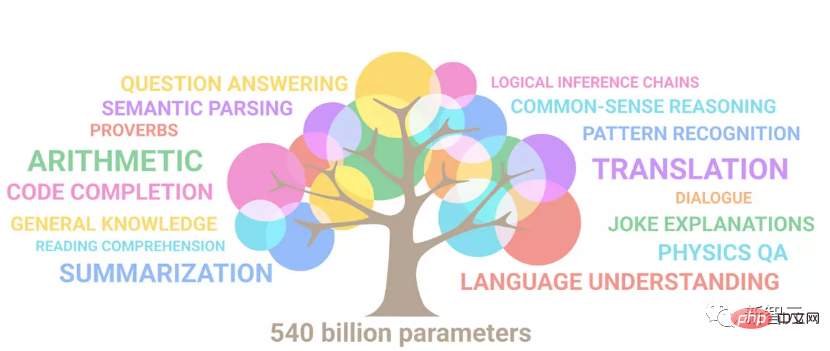

Zum Beispiel Im April dieses Jahres veröffentlichte Google 540 Milliarden Parameter-Sprachmodell PaLM#🎜🎜 # (Pathways Language Model) hat den Menschen in einer Reihe von Sprach- und Argumentationstests erfolgreich übertroffen, insbesondere aufgrund seiner hervorragenden Leistung in Lew-Shot-Lernszenarien mit kleinen Stichproben , was PaLM auch als die Entwicklung der nächsten Generation betrachtet Richtung von Sprachmodellen.

Ähnlich Visuelle Sprache #是 bewirkt energisch Wunder, Sie können die Leistung verbessern, indem Sie die Größe des Modells erhöhen. Wenn nur ein visuelles Sprachmodell für Multitasking

ist, ist es natürlich nicht sehr universell und braucht # 🎜🎜# um mehr zu unterstützen Es kann nur die Ein- und Ausgabe einer Spracheerfolgen. Kürzlich hat Google die PaLM-Erweiterung auf PALI (Pathways Language and Image Model) aktualisiert, das sowohl

mehrere Sprache und Die Fähigkeit,zu verstehen, während über 100 Sprachen unterstützt, um eine Vielzahl von Bild- und Sprachanwendungen in den Bereichen Sehen, Sprache und Multimodalität durchzuführen, wie z. B. visuelle Fragenbeantwortung, Bild Beschreibung (Bildunterschrift), Objekterkennung, Bildklassifizierung, OCR, Textbegründung usw.

Papierlink: https://arxiv.org/abs/2209.06794#🎜 🎜 #

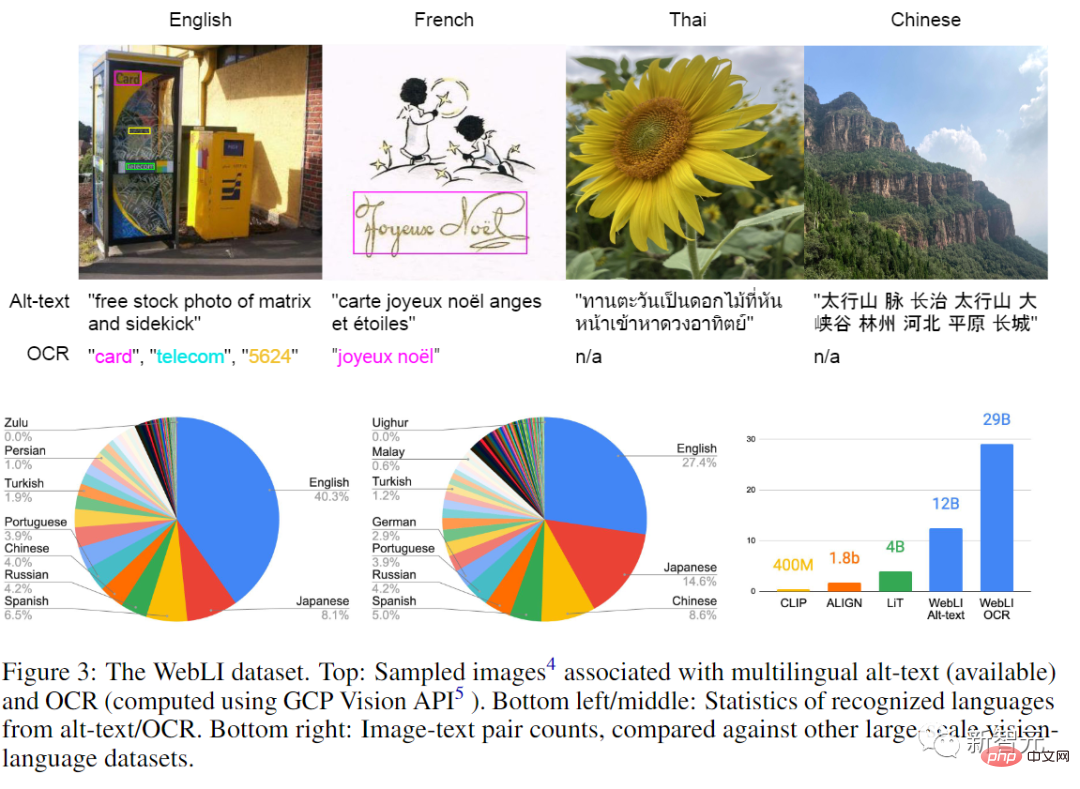

Das Modell wird mithilfe einer öffentlichen Bildsammlung trainiert, die automatisch gecrawlte Anmerkungen in 109 Sprachen enthält , Es heißt auch WebLI

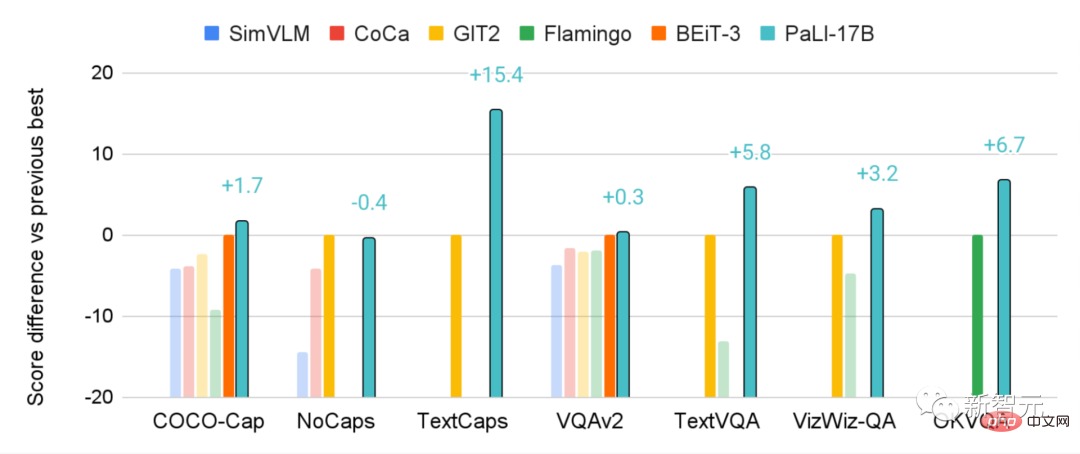

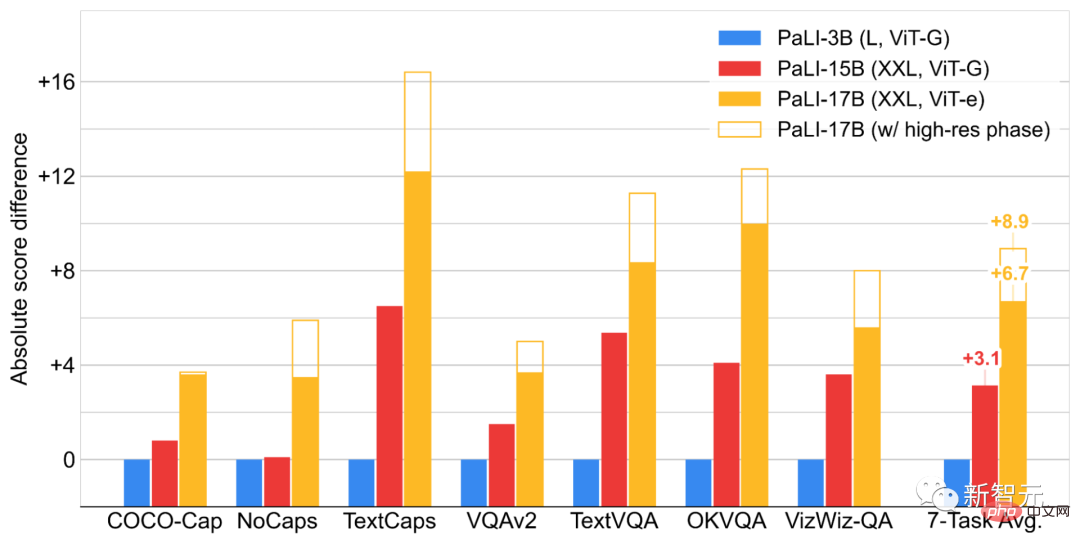

Datensatz im Artikel.Auf WebLI vortrainierte PaLI-Modelle erreichen modernste Leistung bei mehreren Bild- und Sprach-Benchmarks wie COCO-Captions, TextCaps, VQAv2, OK- VQA, TextVQA usw. haben auch die Maßstäbe früherer Modelle für mehrsprachige visuelle Untertitel und visuelle Fragenbeantwortung übertroffen. Modellarchitektur

Eines der Ziele von PALI ist das Studium von Sprache

undVisuellem #🎜 🎜#Ist die Beziehung zwischen der

Leistung und Skalierungdes Modells dieselbe, insbesondere die Skalierbarkeit des Sprach-Bild-Modells? Das architektonische Design des Modells ist also sehr einfach, hauptsächlich aus Gründen der Bequemlichkeit von Experimenten, insbesondere der Wiederverwendbarkeit und Skalierbarkeit.

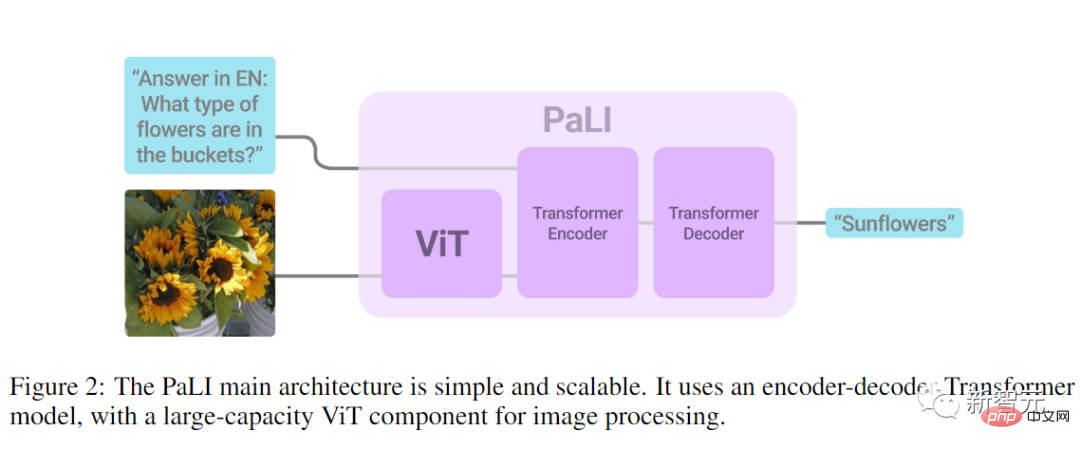

Das Modell besteht aus einem Transformer-Encoder, der Eingabetext verarbeitet, und einem autoregressiven Transformer-Decoder, der Ausgabetext generiert.

Bei der Verarbeitung von Bildern enthält die Eingabe in den Transformer-Encoder auch visuelle Wörter, die die von ViT verarbeiteten Bilder darstellen.

Bei der Verarbeitung von Bildern enthält die Eingabe in den Transformer-Encoder auch visuelle Wörter, die die von ViT verarbeiteten Bilder darstellen.

Ein Schlüsseldesign des PaLI-Modells ist die Wiederverwendung. Die Forscher verwendeten die Gewichte zuvor trainierter einmodaler Seh- und Sprachmodelle (wie mT5-XXL und große ViTs). ) Als Keimzelle des Modells überträgt diese Wiederverwendung nicht nur die Fähigkeiten des einmodalen Trainings, sondern spart auch Rechenkosten.

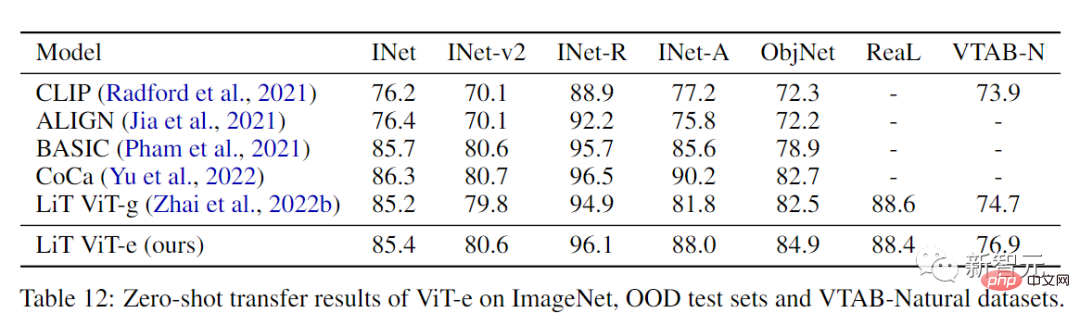

Die visuelle Komponente des Modells verwendet

Die bisher größte ViT-Architektur, ViT-e, was dem 1,8-Milliarden-Parameter entspricht Das ViT-G-Modell hat die gleiche Struktur und verwendet die gleichen Trainingsparameter. Der Unterschied besteht darin, dass es auf 4 Milliarden Parameter erweitert wurde.

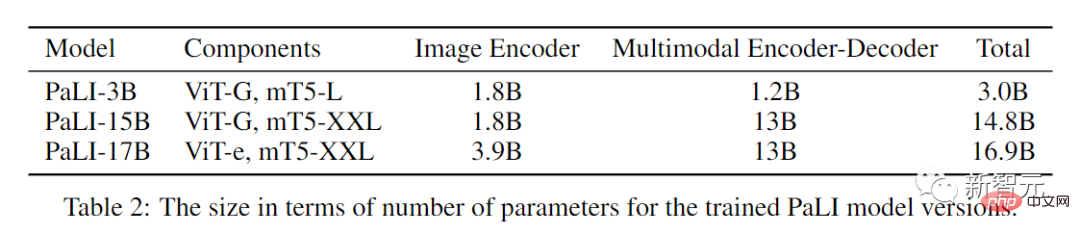

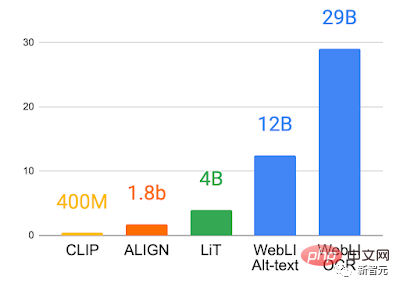

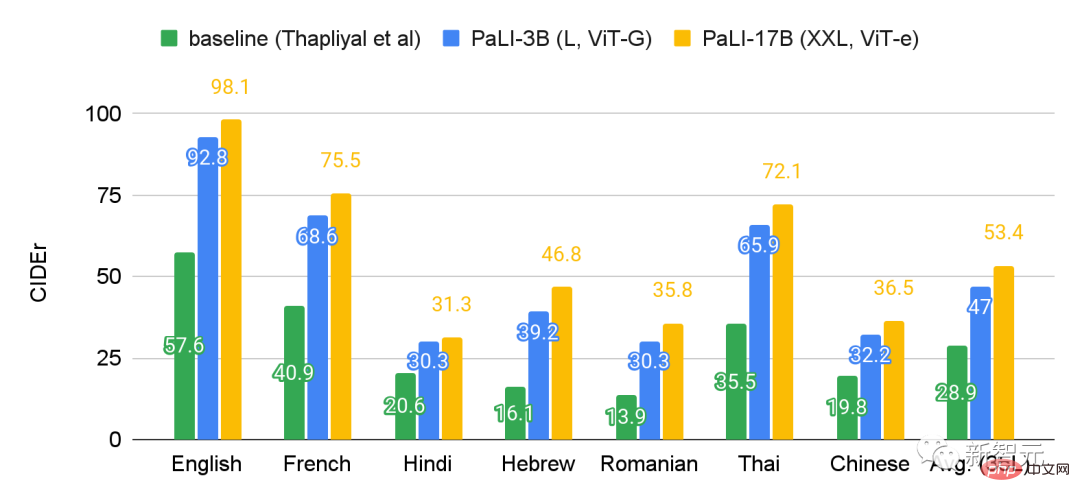

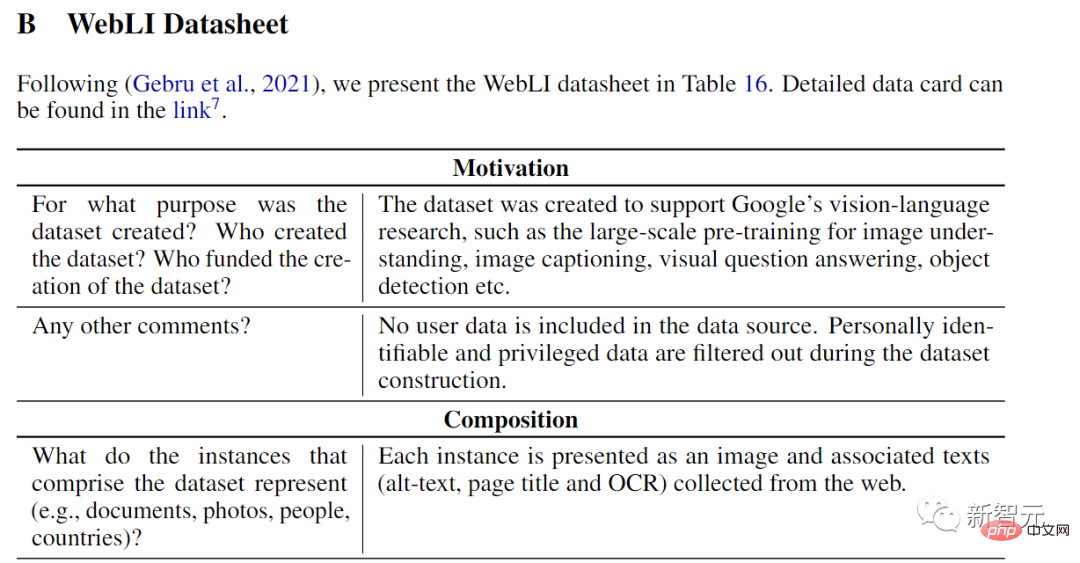

Obwohl Skalierungsgesetze sowohl im visuellen als auch im sprachlichen Bereich untersucht wurden, wurde das Skalierungsverhalten im kombinierten Modell von Vision und Sprache weniger erforscht Die Größe des Backbone-Modells kann zu einer Sättigung der Gewinne bei Klassifizierungsaufgaben führen. Die Forscher haben dies auch weiter bestätigt, und es kann beobachtet werden, dass ViT-e auf ImageNet nur geringfügig besser ist als ViT-G, ViT-e jedoch eine große Verbesserung gegenüber der visuellen Sprachaufgabe von PaLI aufweist. Beispielsweise übertrifft ViT-e ViT-G bei der COCO-Untertitelaufgabe um fast 3 CIDEr-Punkte. 3 Punkte mehr als ViT-G in Aufgaben. Dies deutet auch auf Raum für die Verwendung größerer ViT-Skelettmodelle in visuellen Sprachaufgaben in der Zukunft hin. Die Forscher übernahmen mT5-Backbone als Sprachmodellierungskomponente und verwendeten vorab trainiertes mT5-Large (1 Milliarde Parameter) und mT5-XXL (13 Milliarden Parameter), um den Sprach-Encoder-Decoder von PaLI zu initialisieren wird dann weiterhin gemischt in vielen Sprachaufgaben trainiert, einschließlich reiner Sprachverständnisaufgaben, was auch dazu beiträgt, ein katastrophales Vergessen der Sprachverständnis- und Produktionsfähigkeiten von mT5 zu vermeiden. Endlich habe ich drei PALI-Modelle in verschiedenen Größen bekommen. Ausführliche Forschung im Zusammenhang mit Deep Learning zeigt, dass der erforderliche Trainingsdatensatz umso größer ist, je größer das Modell ist. Um das Potenzial von Sprach-Bild-Vortrainingsmodellen umfassend zu untersuchen und auszuschöpfen, haben Forscher eine große Menge an Bild- und Textdaten aus dem Internet gecrawlt und einen neuen Datensatz WebLI erstellt, der 120 Bilder in 109 Sprachen enthält Milliarden Alternativtexte und 10 Milliarden Bilder. Zusätzlich zur Verwendung von Webtext für Anmerkungen verwendeten die Forscher auch die Cloud Vision API, um eine OCR-Erkennung an Bildern durchzuführen, und erhielten so 29 Milliarden Bild-OCR-Datenpaare. Die Bilder in den Trainings-, Validierungs- und Testteilen von 68 gemeinsamen visuellen und visuellen Sprachdatensätzen wurden mithilfe der Beinahe-Duplizierung dedupliziert, um Datenlecks bei nachgelagerten Bewertungsaufgaben zu vermeiden. Um die Datenqualität weiter zu verbessern, werden die Forscher auch anhand der modalübergreifenden Ähnlichkeit von „Bild und Alt-Text“ punkten, den Schwellenwert anpassen und schließlich nur 10 % davon beibehalten Bilder, insgesamt 1 Milliarde Bilder werden zum Trainieren von PaLI verwendet Da die visuelle Sprachaufgabe multimodal ist, muss das Modell über mehrere semantische Verarbeitungsfähigkeiten verfügen und unterschiedliche Ziele verfolgen. Beispielsweise erfordern einige Aufgaben eine lokale Lokalisierung von Objekten, um die Aufgabe genau zu lösen, während andere Aufgaben möglicherweise globalere semantische Informationen erfordern. Ebenso erfordern einige Sprachaufgaben möglicherweise lange Antworten, während andere möglicherweise kompakte Antworten erfordern. Um all diese inkonsistenten Ziele anzugehen, nutzen Forscher den Reichtum der WebLI-Pre-Training-Daten und führen eine Pre-Training-Task-Mischung ein, um Modelle für verschiedene nachgelagerte Anwendungen vorzubereiten. Um das Modell vielseitiger für die Lösung verschiedener Aufgaben zu machen, hat der Autor alle Aufgaben in einer einzigen gemeinsamen API klassifiziert (Eingabe: Bild + Text; Ausgabe: Text), wodurch mehrere Bild- und Sprachaufgaben ausgeführt werden können Aus Wissensaustausch, der auch mit vorab trainierten Einstellungen geteilt wird. Die für das Vortraining verwendeten Ziele werden als gewichtete Mischung in dieselbe API projiziert, mit dem Ziel, sowohl die Fähigkeit zur Wiederverwendung von Modellkomponenten aufrechtzuerhalten als auch das Modell für die Ausführung neuer Aufgaben zu trainieren. Das Modell verwendet die Open-Source-Frameworks T5X und Flaxformer und wird mit Flax in JAX trainiert. Der visuelle Teil von ViT-e verwendet das Open-Source-Framework BigVision, um die Wortvektoren des Sprachteils und die von generierten Patch-Vektoren zu kaskadieren Der visuelle Teil: Als Eingabe für den multimodalen Encoder-Decoder wird der Encoder mithilfe des mT5-XXL-Vortrainings initialisiert. Während des Trainingsprozesses von PaLI werden die Gewichte der visuellen Komponenten eingefroren und nur die Gewichte des multimodalen Encoder-Decoders aktualisiert. Im experimentellen Teil verglichen die Forscher PaLI anhand gängiger visueller Sprach-Benchmarks, und das PaLI-Modell erzielte bei diesen Aufgaben Ergebnisse auf dem neuesten Stand der Technik und übertraf sogar sehr große Modelle, die in der vorherigen Literatur vorgeschlagen wurden. Zum Beispiel schneidet das PALI mit 17 Milliarden Parametern bei einigen VQA- und Bildbeschriftungsaufgaben besser ab als das Flamingo-Modell mit 80 Milliarden Parametern. Und PALI behält auch bei einzelnen Sprach- oder einzelnen visuellen Aufgaben gute Leistungen bei, obwohl dies nicht das Haupttrainingsziel von PALI ist. Wir untersuchen auch, wie Bild- und Sprachmodellkomponenten im Hinblick auf die Modellskalierung interagieren und wo das Modell die größten Gewinne bringt. Die abschließende Schlussfolgerung ist, dass die gemeinsame Skalierung (Skalierung) dieser beiden Komponenten die beste Leistung erbringt. Insbesondere ist die Skalierung der visuellen Komponente, die relativ wenige Parameter erfordert, am kritischsten, während die Skalierung auch für die Verbesserung der Leistung bei mehrsprachigen Aufgaben wichtig ist . Nach der Evaluierung von PaLI auf dem Benchmark Crossmodal-3600 in 35 Sprachen können wir feststellen, dass die mehrsprachige Titelaufgabe mehr von der Erweiterung des PaLI-Modells profitiert. Um zu vermeiden, dass in großen Sprach- und Bildmodellen unfaire Vorurteile entstehen oder verstärkt werden, müssen die verwendeten Daten und die Art und Weise, wie die Modelle diese Daten verwenden, transparent sein und die Fairness der Modelle getestet werden und verantwortungsvolle Datenanalyse durchführen, daher stellt der Artikel sowohl eine Datenkarte als auch eine Modellkarte bereit

Datensatz in 109 Sprachen

Training großer Modelle

Das obige ist der detaillierte Inhalt vonDen größten ViT der Geschichte bequem trainiert? Google aktualisiert das visuelle Sprachmodell PaLI: unterstützt mehr als 100 Sprachen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr