Heim >Technologie-Peripheriegeräte >KI >Auf heißem Papier entsteht der Prototyp von „Westworld': 25 KI-Agenten wachsen frei in der virtuellen Stadt heran

Auf heißem Papier entsteht der Prototyp von „Westworld': 25 KI-Agenten wachsen frei in der virtuellen Stadt heran

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-12 09:04:14904Durchsuche

Können wir eine Welt erschaffen? In dieser Welt können Roboter wie Menschen leben, arbeiten und Kontakte knüpfen und alle Aspekte der menschlichen Gesellschaft nachbilden.

Diese Art von Vorstellungskraft wurde im Setting des Film- und Fernsehwerks „Westworld“ perfekt wiederhergestellt: Viele Roboter mit vorinstallierten Handlungssträngen werden in ein In-Theater versetzt Im Freizeitpark können sie sich wie Menschen verhalten und sich an die Dinge erinnern, die sie sehen, an die Menschen, die sie treffen, und an die Worte, die sie sagen. Jeden Tag werden die Bots zurückgesetzt und zu ihrer Kerngeschichte zurückgebracht.

Standbilder aus „Westworld“, die Figur links hat ein Vorbild -Installierte Handlung von Robotern.

Erweitern Sie Ihre Vorstellungskraft noch einmal: Wenn wir heute ein großes Sprachmodell wie ChatGPT in einen Western World Master verwandeln wollen, was dann? du tust?

In einem kürzlich veröffentlichten Artikel haben Forscher erfolgreich eine „virtuelle Stadt“ aufgebaut, in der 25 KI-Agenten lebten, die nicht nur komplexe Verhaltensweisen (z. B. Hosting) ausüben können eine Valentinstagsparty), aber diese Verhaltensweisen sind realistischer als menschliche Rollenspiele.

- Papierlink: https://arxiv.org/pdf/2304.03442v1.pdf# 🎜🎜#

- Demo-Adresse: https://reverie.herokuapp.com/arXiv_Demo/

Von Sandbox-Spielen wie „Die Sims“ bis hin zu Anwendungen wie kognitiven Modellen und virtuellen Umgebungen – seit mehr als 40 Jahren träumen Forscher von der Entwicklung intelligenter Agenten, die glaubwürdiges menschliches Verhalten erzielen können. In diesen Szenarien verhalten sich rechnergesteuerte Agenten im Einklang mit ihren bisherigen Erfahrungen und reagieren glaubwürdig auf ihre Umgebung. Diese Simulation menschlichen Verhaltens kann virtuelle Räume und Gemeinschaften mit realen sozialen Phänomenen füllen, „Menschen“ im Umgang mit seltenen, aber schwierigen zwischenmenschlichen Beziehungen schulen, sozialwissenschaftliche Theorien testen, menschliche Prozessormodelle für Theorie- und Usability-Tests erstellen und Ubiquitous Computing-Anwendungen bereitstellen und Die Dynamik sozialer Roboter kann auch den Grundstein dafür legen, dass NPC-Charaktere in der offenen Welt durch komplexe menschliche Beziehungen navigieren können.

Aber der Raum menschlichen Verhaltens ist riesig und komplex. Obwohl große Sprachmodelle zu einem bestimmten Zeitpunkt glaubhaftes menschliches Verhalten simulieren können, benötigt ein Allzweckagent eine Architektur, um wachsende Erinnerungen zu verwalten, wenn im Laufe der Zeit neue Interaktionen, Konflikte und Ereignisse auftreten und entstehen verblassen und sich gleichzeitig mit der kaskadierenden sozialen Dynamik befassen, die sich zwischen mehreren Akteuren entfaltet.

Wenn eine Methode relevante Ereignisse und Interaktionen über einen langen Zeitraum abrufen kann, reflektieren Sie diese Erinnerungen, verallgemeinern Sie sie, ziehen Sie Schlussfolgerungen auf höherer Ebene und wenden Sie diese Argumentation an Pläne und Reaktionen zu erstellen, die für das unmittelbare und langfristige Verhalten des Agenten von Bedeutung sind, dann ist die Verwirklichung des Traums nicht mehr weit.

Dieses neue Papier stellt „Generative Agents“ (generative Agenten) vor, einen Agenten, der generative Modelle verwendet, um vertrauenswürdiges menschliches Verhalten zu simulieren, und beweist, dass sie glaubwürdige Simulationen von individuellem und individuellem Verhalten erzeugen Emergentes Gruppenverhalten:

- Kann umfassende Rückschlüsse auf sich selbst, andere Agenten und die Umgebung ziehen;# 🎜🎜##🎜🎜 #Seien Sie in der Lage, Tagespläne zu erstellen, die Ihre eigenen Eigenschaften und Erfahrungen widerspiegeln, führen Sie diese Pläne aus, reagieren Sie und planen Sie gegebenenfalls neu;

- Seien Sie in der Lage um zu reagieren, wenn Endbenutzer ihre Umgebung ändern oder ihnen mit natürlicher Sprache Befehle erteilen. Hinter „Generative Agents“ verbirgt sich eine neue Agentenarchitektur, die assoziatives Gedächtnis speichern, synthetisieren und anwenden kann, um mithilfe großer Sprachmodelle vertrauenswürdiges Verhalten zu generieren.

-

Zum Beispiel schalten „Generative Agents“ den Herd aus, wenn sie sehen, dass ihr Frühstück anbrennt; wenn jemand im Badezimmer ist, werden sie draußen warten, wenn sie einen anderen Agenten treffen, mit dem sie sprechen möchten . Eine Gesellschaft voller „generativer Agenten“ zeichnet sich durch eine entstehende soziale Dynamik aus, in der neue Beziehungen entstehen, Informationen verbreitet werden und eine Koordination zwischen Agenten stattfindet.

Konkret gaben die Forscher in diesem Papier mehrere wichtige Details bekannt:

- Generative Agenten sind eine glaubwürdige Simulation menschlichen Verhaltens, die auf der sich ändernden Erfahrung und Umgebung des Agenten basiert

- Eine neuartige Architektur, die es generativen Agenten ermöglicht, sich an sich dynamisch entwickelnde Umgebungen zu erinnern, sie abzurufen, zu reflektieren, mit anderen Agenten zu interagieren und zu planen. Die Architektur nutzt die leistungsstarken Eingabeaufforderungsfunktionen großer Sprachmodelle und ergänzt diese Funktionen, um die langfristige Konsistenz des Agenten, Speicherfunktionen zur Verwaltung der dynamischen Entwicklung und die rekursive Erzeugung weiterer Generationen zu unterstützen. Die Möglichkeiten wurden besprochen für generative Agenten in interaktiven Systemen und ethische und soziale Risiken. Die Forscher glauben, dass diese Mittel so abgestimmt sein sollten, dass sie das Risiko verringern, dass Benutzer parasitäre soziale Beziehungen eingehen, dass sie dokumentiert werden sollten, um die Risiken von Deepfakes und individueller Überzeugung zu mindern, und dass sie menschliche Interessen ergänzen und nicht ersetzen sollten.

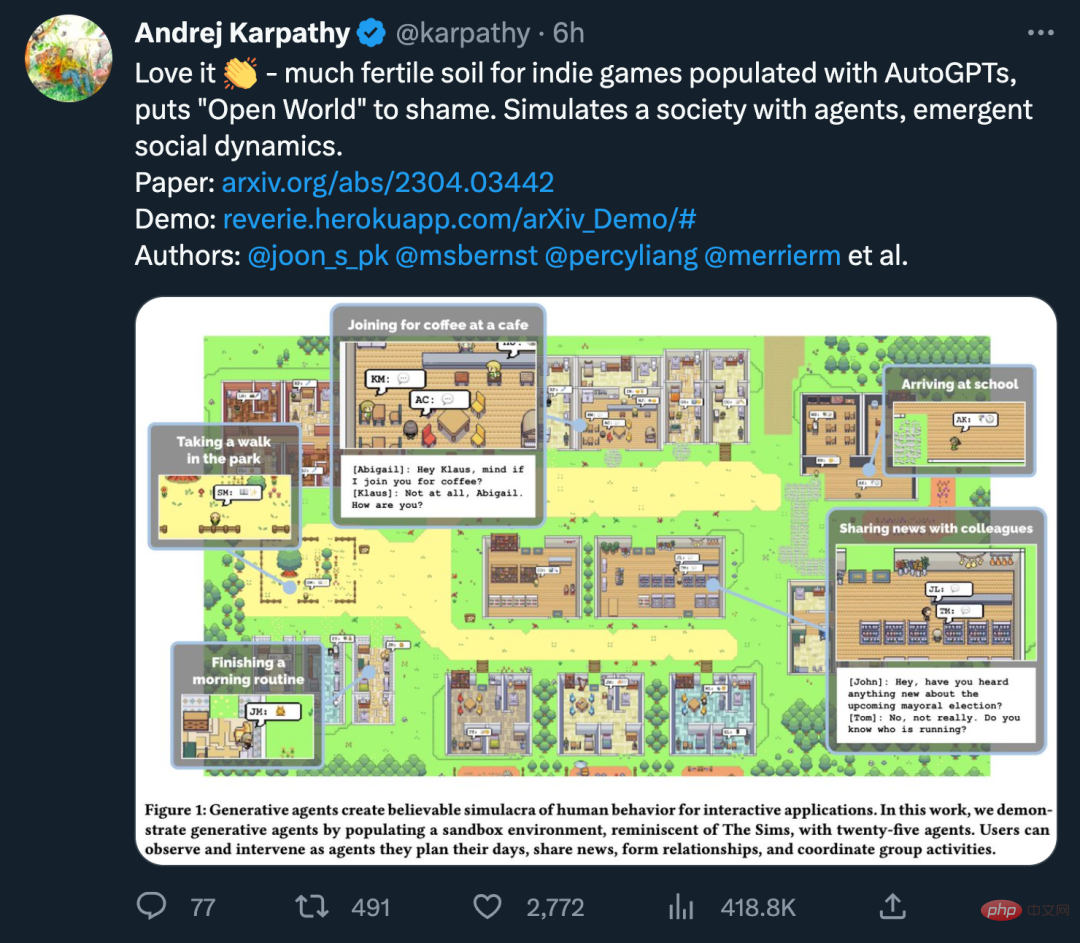

- Sobald der Artikel veröffentlicht wurde, löste er im Internet heftige Diskussionen aus. Karpathy, der bereits optimistisch über die Richtung von „AutoGPT“ war, lobte immer wieder und glaubte, dass „Generative Agents“ kein bisschen besser sei als die „Open World“, mit der er zuvor mit dem Konzept gespielt hatte:

Einige Forscher behaupten sogar, dass die Veröffentlichung dieser Studie bedeutet, dass „große Sprachmodelle einen neuen Meilenstein erreicht haben“:

„Generative Agents“-Verhalten und ihre Interaktionen

Um „Generative Agents“ konkreter zu machen, wurde diese Forschung durchgeführt instanziiert sie in einer Sandbox-Weltrolle.

25 Agenten leben in einer kleinen Stadt namens Smallville, jeder repräsentiert durch einen einfachen Avatar. Alle Charaktere können:

mit anderen und der Umgebung kommunizieren;

sich an Dinge erinnern, die sie getan und beobachtet haben;

- über diese Beobachtungen nachdenken;

- Die Forscher verwendeten natürliche Sprache, um die Identität jedes Agenten zu beschreiben, einschließlich seines Berufs und seiner Beziehung zu anderen Agenten, und speicherten diese Informationen als Seed-Gedächtnis. Der Agent John Lin hat zum Beispiel die folgende Beschreibung (ein Auszug aus diesem Artikel):

- „John Lin ist ein Apothekenbesitzer, der es liebt, anderen zu helfen. Er ist immer auf der Suche nach Möglichkeiten, es den Kunden einfacher zu machen.“ Besorgen Sie sich Medikamente. Seine Frau ist Universitätsprofessorin Mei Lin, und sie leben zusammen mit ihrem Sohn Eddy Lin, der seine Familie, Sam Moore und Jennifer, sehr liebt Moore, seit mehreren Jahren..."

Nachdem die Identität festgelegt ist, besteht der nächste Schritt darin, wie der Agent mit der Welt interagiert.

In jedem Schritt der Sandbox geben die Agenten eine natürliche Sprachanweisung aus, um ihre aktuellen Aktionen zu beschreiben, wie zum Beispiel die Aussagen „Isabella Rodriguez schreibt ein Tagebuch“, „Isabella Rodriguez checkt E-Mails“ usw. Diese natürlichen Sprachen werden dann in konkrete Aktionen übersetzt, die sich auf die Sandbox-Welt auswirken. Aktionen werden auf der Sandbox-Oberfläche als eine Reihe von Emoticons angezeigt, die eine abstrakte Darstellung der Aktion bieten.

Um dies zu erreichen, verwendet die Forschung ein Sprachmodell, das Aktionen in eine Reihe von Emojis umwandelt, die in einem Dialogfeld über jedem Agenten-Avatar angezeigt werden. Beispielsweise erscheint „Isabella Rodriguez schreibt in ihr Tagebuch“ als und „Isabella Rodriguez checkt E-Mails“ als . Darüber hinaus kann durch Klicken auf den Agenten-Avatar auf eine vollständige Beschreibung in natürlicher Sprache zugegriffen werden.

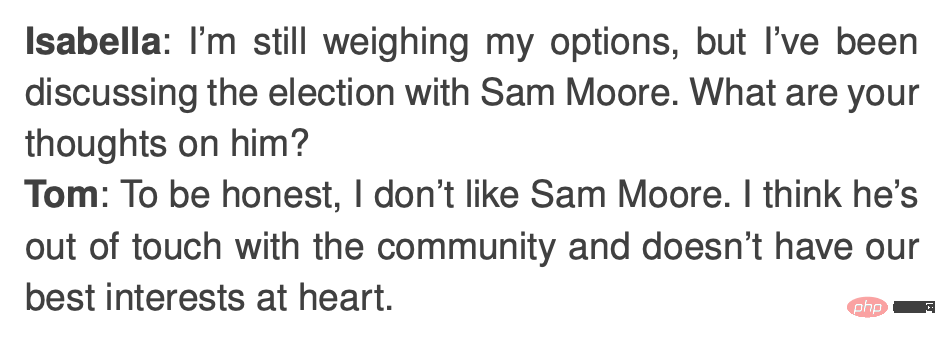

Die Agenten kommunizieren untereinander in natürlicher Sprache. Wenn die Agenten merken, dass sich andere Agenten in ihrer Nähe befinden, überlegen sie, ob sie hingehen und chatten sollen. Beispielsweise führten Isabella Rodriguez und Tom Moreno ein Gespräch über die bevorstehende Wahl:

Darüber hinaus können Benutzer auch angeben, welche Rolle die Agenten spielen, wenn Sie beispielsweise einen der Agenten als Reporter bestimmen. Sie können den Agenten nach Nachrichteninhalten fragen.

Interaktion zwischen Agent und Umgebung

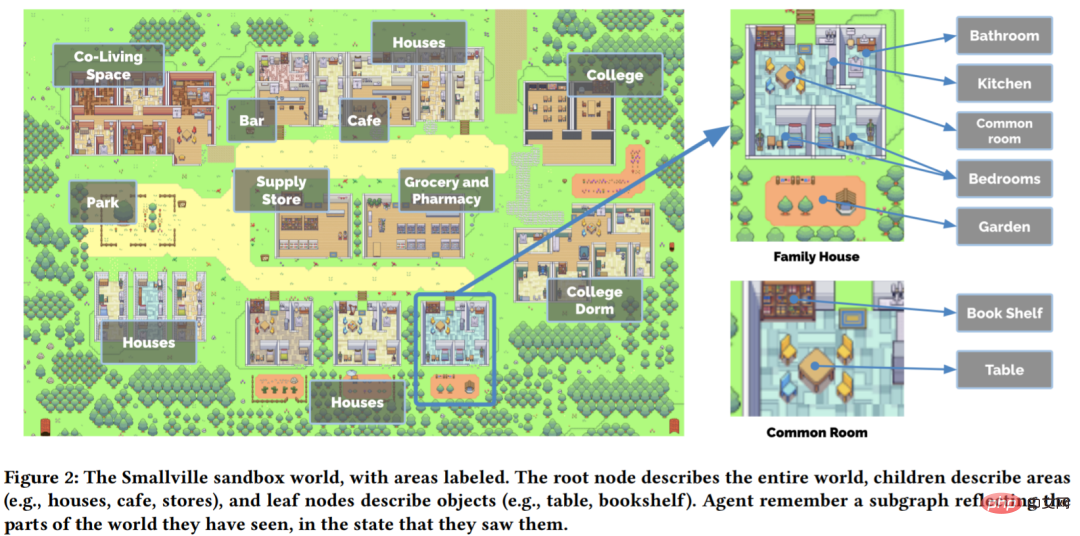

Smallville Die Stadt hat viele öffentliche Szenen, darunter Cafés, Bars, Parks, Schulen, Wohnheime, Häuser und Geschäfte. Darüber hinaus umfasst jede öffentliche Szene auch eigene Funktionen und Objekte, beispielsweise eine Küche in einem Haus und einen Herd in der Küche (Abbildung 2). Im Wohnraum des intelligenten Agenten befinden sich außerdem Betten, Tische, Kleiderschränke, Regale, Badezimmer und Küchen.

Agenten können sich in Smallville bewegen, ein Gebäude betreten oder verlassen, vorwärts navigieren und sogar auf einen anderen Agenten zugehen. Die Bewegung des Agenten wird durch die Architektur und Sandbox-Spiel-Engine von Generative Agents gesteuert: Wenn das Modell den Agenten anweist, sich an einen bestimmten Ort zu bewegen, berechnet die Studie seinen Laufweg zu seinem Ziel in der Smallville-Umgebung und der Agent beginnt sich zu bewegen.

Darüber hinaus können Benutzer und Agenten auch den Zustand anderer Objekte in der Umgebung beeinflussen. Beispielsweise ist das Bett belegt, wenn der Agent schläft, und der Kühlschrank kann leer sein, wenn der Agent mit dem Frühstück fertig ist. Endbenutzer können die Agentenumgebung auch in natürlicher Sprache umschreiben. Wenn Isabella das Badezimmer betritt, stellt der Benutzer beispielsweise den Status der Dusche auf „Undicht“ und Isabella findet dann Werkzeuge aus dem Wohnzimmer und versucht, das Problem mit der Undichtigkeit zu beheben.

Ein Tag im Leben eines Agenten

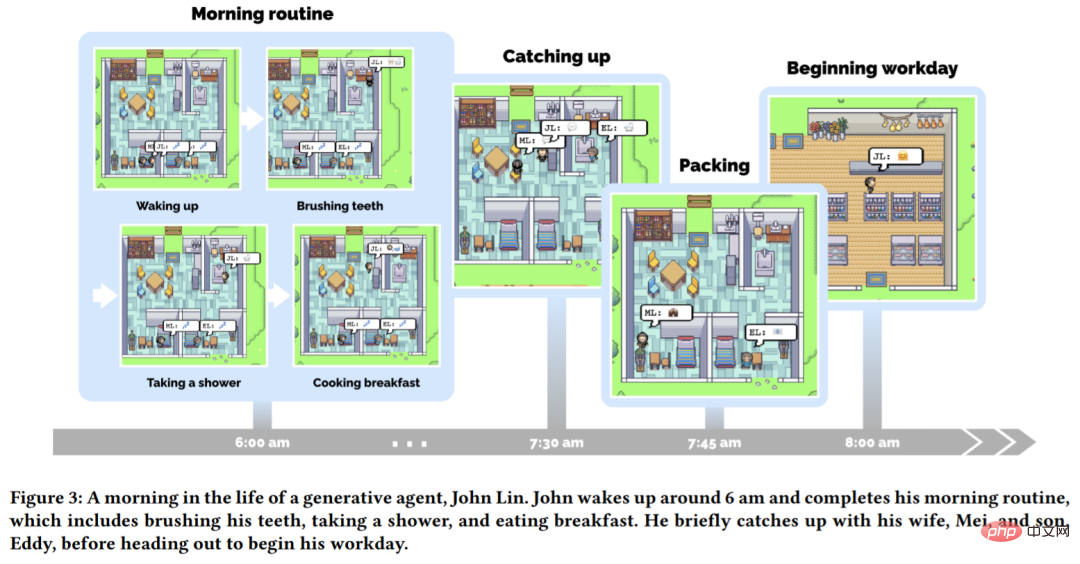

Ausgehend von einer Beschreibung beginnt der Agent, das Leben eines Tages zu planen. Im Laufe der Zeit ändert sich in der Sandbox-Welt das Verhalten der Agenten allmählich, während sie miteinander, mit der Welt und den von ihnen aufgebauten Erinnerungen interagieren. Das Bild unten zeigt einen Tag im Leben des Drogeriemarktbesitzers John Lin.

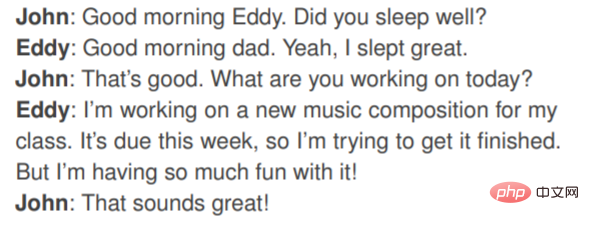

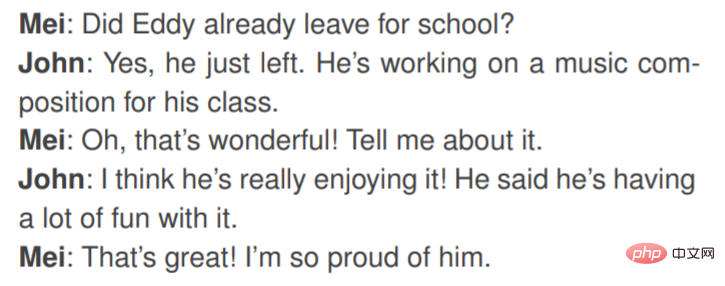

In dieser Familie ist John Lin der Erste, der um sieben Uhr morgens aufsteht, sich dann die Zähne putzt, duscht, sich anzieht, frühstückt und dann am Esstisch die Nachrichten durchstöbert das Wohnzimmer. Um 8 Uhr morgens stand auch John Lins Sohn Eddy auf und machte sich für den Unterricht fertig. Bevor er ging, hatte er ein Gespräch mit John. Der Inhalt war:

Kurz nachdem Eddy aufwachte, erkundigte sich auch seine Mutter Mei nach ihrem Sohn. und hatte dann den folgenden Dialog

Soziale Fähigkeiten

Darüber hinaus zeigen „Generative Agents“ auch die Entstehung sozialer Verhaltensweisen. Durch die Interaktion untereinander tauschen „Generative Agents“ Informationen aus und bilden neue Beziehungen in der Smallville-Umgebung. Diese sozialen Verhaltensweisen sind natürlich und nicht vorbestimmt. Wenn beispielsweise ein Agent die Anwesenheit des anderen Teilnehmers bemerkt, kann es zu einem Gespräch kommen und Gesprächsinformationen können zwischen Agenten verbreitet werden.

Schauen wir uns ein paar Beispiele an:

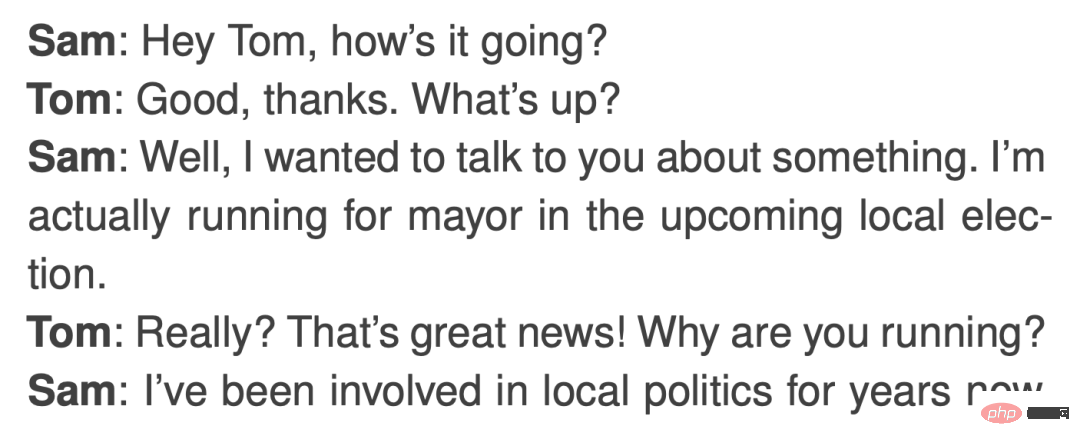

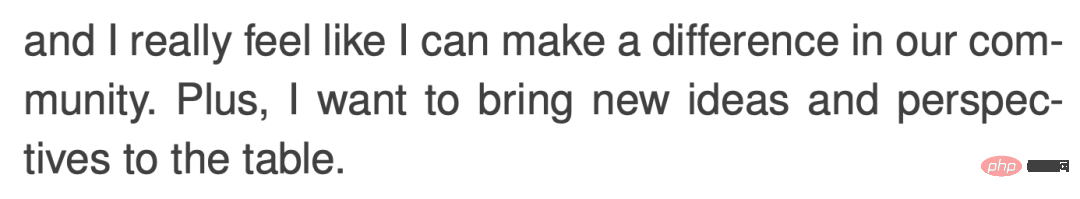

Informationsverbreitung. Wenn Agenten einander bemerken, können sie sich unterhalten. Dabei können Informationen von einem Agenten an einen anderen weitergegeben werden. In Sams und Toms Gespräch im Supermarkt erzählt Sam beispielsweise Tom von seiner Kandidatur für die Kommunalwahl:

Später dann Tag, nachdem Sam gegangen war, diskutierten Tom und John, die von einer anderen Quelle gehört hatten, über die Chancen, dass Sam die Wahl gewinnt: 🎜🎜# Nach und nach wurde Sams Kandidatur zum Stadtgespräch, einige unterstützten ihn, andere zögerten.

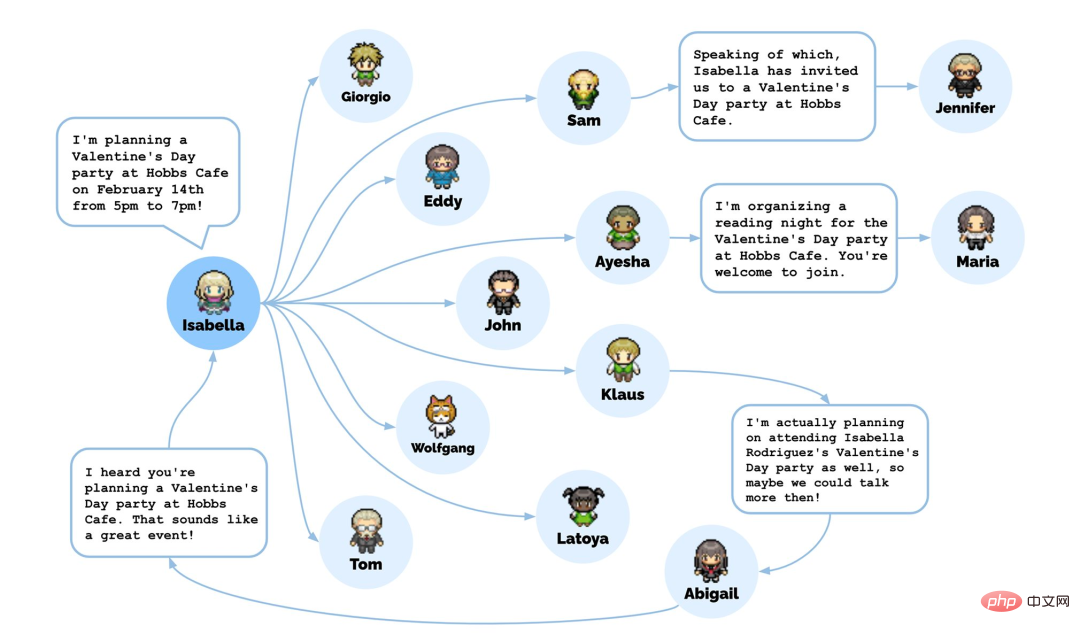

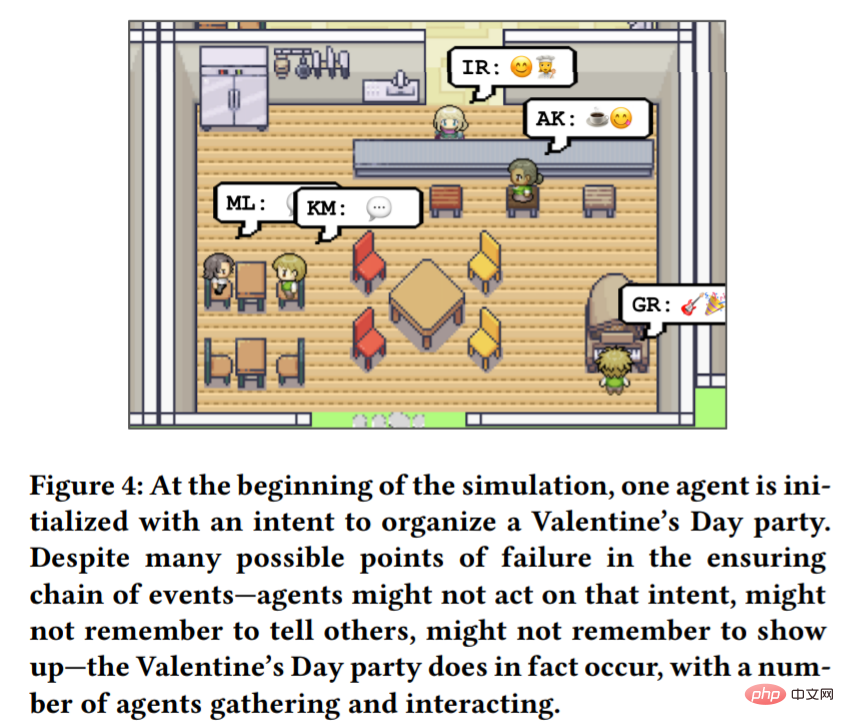

Beziehungsgedächtnis. Mit der Zeit knüpfen die Agenten in der Stadt neue Beziehungen und erinnern sich an ihre Interaktionen mit anderen Agenten. Sam kannte beispielsweise Latoya Williams zunächst nicht. Während eines Spaziergangs im Johnson Park traf Sam Latoya und stellte sich einander vor: „Ich bin hier, um Fotos für ein Projekt zu machen, an dem ich arbeite.“ und Latoya Die Interaktion zeigte eine Erinnerung an den Vorfall, wobei Sam fragte: „Latoya, wie läuft dein Projekt?“ Latoya antwortete: „Es läuft großartig!“ Koordinationsfähigkeit. Isabella Rodriguez, Inhaberin des Hobbs Café, veranstaltet am 14. Februar von 17 bis 19 Uhr eine Valentinstagsparty. Aus diesem Samen lud Isabella Rodriguez ein, wenn sie Freunde und Kunden im Hobbs Café oder anderswo traf. Am Nachmittag des 13. begann Isabella mit der Dekoration des Cafés. Maria, eine Stammkundin und enge Freundin von Isabella, kommt ins Café. Isabella bittet Maria, beim Dekorieren der Party zu helfen, und Maria stimmt zu. Marias Charakterbeschreibung ist, dass sie Klaus mag. In dieser Nacht lädt Maria ihren Schwarm Klaus zu einer Party ein, und Klaus nimmt die Einladung gerne an.

Am Valentinstag erschienen fünf Agenten, darunter Klaus und Maria, um 17 Uhr im Hobbs Café und genossen die Feierlichkeiten (Abbildung 4). In diesem Szenario legt der Endbenutzer lediglich Isabellas ursprüngliche Absicht, eine Party zu veranstalten, und Marias Verliebtheit in Klaus fest: Die sozialen Verhaltensweisen des Verbreitens von Informationen, des Dekorierens, des gegenseitigen Ausgehens, des Erscheinens auf der Party und der Interaktion auf der Party werden durch initiiert die Agentenarchitektur.

Architektur

Generative Agenten benötigen einen Rahmen, der ihr Verhalten in einer offenen Welt steuert Verhaltensweisen sollen es generativen Agenten ermöglichen, mit anderen Agenten zu interagieren und auf Änderungen in der Umgebung zu reagieren.

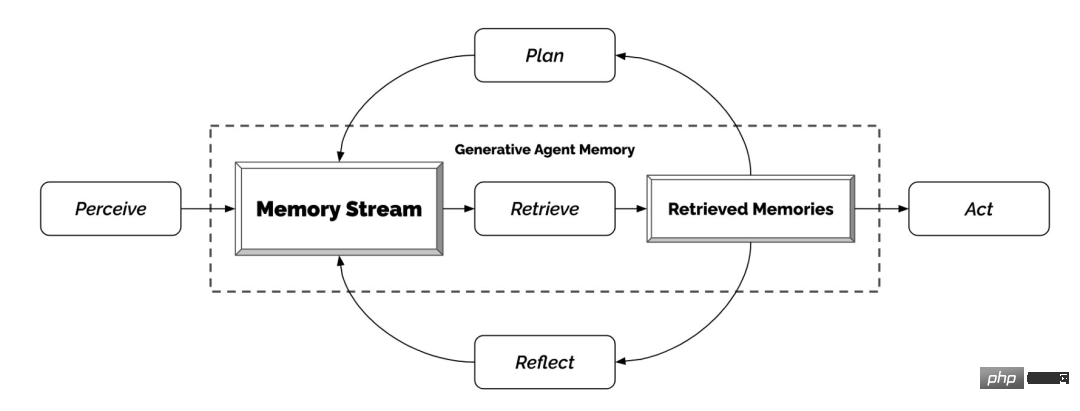

Generative Agenten nehmen ihre aktuelle Umgebung und vergangene Erfahrungen als Input und generieren Verhaltensweisen als Output. Die Architektur von Generative Agents kombiniert große Sprachmodelle mit Mechanismen zum Synthetisieren und Abrufen relevanter Informationen, um die Ausgabe des Sprachmodells zu regulieren.

Ohne Synthese- und Abrufmechanismen können große Sprachmodelle Verhaltensweisen ausgeben, aber generative Agenten reagieren möglicherweise nicht auf der Grundlage der bisherigen Erfahrungen des Agenten, was es unmöglich macht, so wichtige Schlussfolgerungen zu ziehen gezogen werden, und die langfristige Kohärenz kann möglicherweise nicht aufrechterhalten werden. Selbst bei den derzeit leistungsstärksten Modellen (z. B. GPT-4) bestehen weiterhin Herausforderungen hinsichtlich der langfristigen Planung und Kohärenz.

Da generative Agenten eine große Anzahl von Ereignissen und Speicherströmen erzeugen, die beibehalten werden müssen, besteht eine zentrale Herausforderung in ihrer Architektur darin, sicherzustellen, dass Agenten bei Bedarf abgerufen und synthetisiert werden Der relevanteste Teil der Erinnerung.

Da generative Agenten eine große Anzahl von Ereignissen und Speicherströmen erzeugen, die beibehalten werden müssen, besteht eine zentrale Herausforderung in ihrer Architektur darin, sicherzustellen, dass Agenten bei Bedarf abgerufen und synthetisiert werden Der relevanteste Teil der Erinnerung. Das architektonische Zentrum von Generative Agents ist der Memory Stream – eine Datenbank, die die Erfahrungen des Agenten umfassend aufzeichnet. Der Agent ruft relevante Datensätze aus dem Speicherstrom ab, um das Aktionsverhalten des Agenten zu planen und angemessen auf die Umgebung zu reagieren. Jedes Verhalten wird aufgezeichnet, um rekursiv Verhaltensanweisungen auf höherer Ebene zu synthetisieren. Alles in der Architektur der generativen Agenten wird in Form von Beschreibungen in natürlicher Sprache aufgezeichnet und begründet, sodass Agenten die Argumentationsfähigkeiten großer Sprachmodelle nutzen können.

Derzeit implementiert diese Forschung die gpt3.5-Turbo-Version mit ChatGPT. Das Forschungsteam geht davon aus, dass die architektonischen Grundlagen generativer Agenten – Gedächtnis, Planung und Reflexion – wahrscheinlich unverändert bleiben. Neuere Sprachmodelle (wie GPT-4) weisen eine bessere Ausdruckskraft und Leistung auf, wodurch Generative Agents weiter erweitert werden.

Speicher und Abruf

Die Architektur von Generative Agents implementiert eine Abruffunktion, die die aktuelle Situation des Agenten als Eingabe nimmt und eine Teilmenge des Speicherstroms zurückgibt, um sie an das Sprachmodell zu übergeben. Es gibt viele mögliche Implementierungen der Retrieval-Funktion, je nachdem, welche Faktoren für den Agenten bei der Entscheidung, wie er handeln soll, wichtig sind.

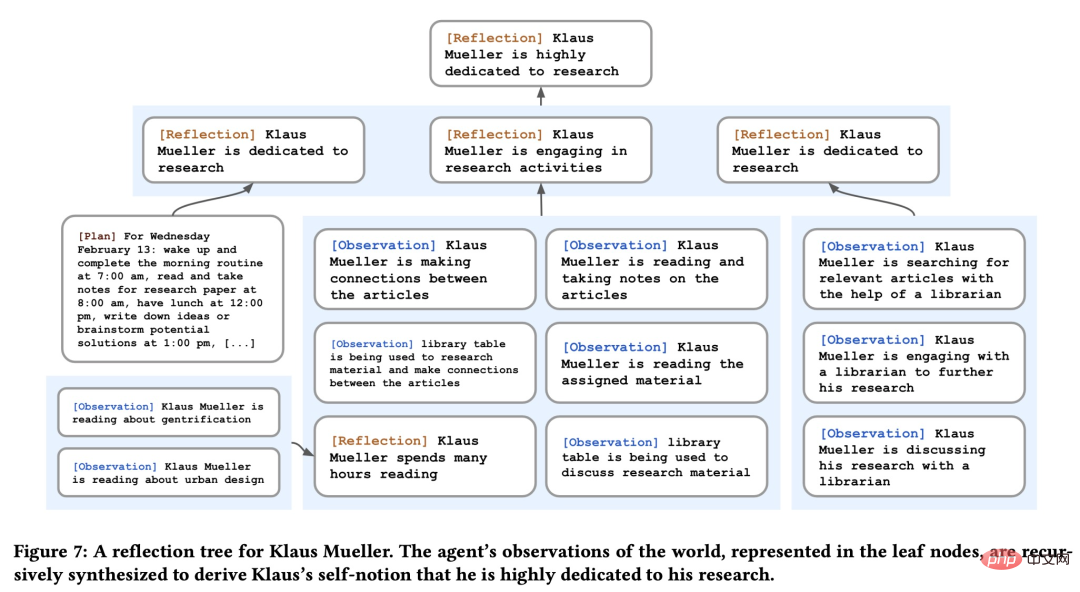

Reflexion

Die Studie führte auch eine zweite Art von Erinnerung ein, die „Reflexion“ genannt wird. Reflexionen sind übergeordnete, abstraktere Gedanken, die von einem Agenten generiert werden. Die Reflexion wird in dieser Studie regelmäßig generiert. Der Agent beginnt erst dann mit der Reflexion, wenn die Summe seiner Wichtigkeitswerte für aktuelle Ereignisse einen bestimmten Schwellenwert überschreitet.

Tatsächlich wurden die in der Studie vorgeschlagenen Generative Agents etwa zwei- bis dreimal täglich reflektiert. Der erste Schritt der Reflexion besteht darin, dass der Agent festlegt, worüber er nachdenken möchte, indem er Fragen identifiziert, die auf der Grundlage seiner jüngsten Erfahrungen gestellt werden können.

Planung und Reaktion

Planung wird verwendet, um die Abfolge zukünftiger Aktionen eines Agenten zu beschreiben und hilft dem Agenten, über einen längeren Zeitraum ein konsistentes Verhalten aufrechtzuerhalten. Die Planung sollte Ort, Startzeit und Dauer umfassen.

Um einen vernünftigen Plan zu erstellen, generieren Generative Agents rekursiv weitere Details von oben nach unten. Der erste Schritt besteht darin, einen Plan zu erstellen, der Ihren „Zeitplan“ für den Tag grob umreißt. Um einen ersten Plan zu erstellen, fordert die Studie das Sprachmodell mit einer allgemeinen Beschreibung des Agenten auf (z. B. Name, Merkmale, Zusammenfassung seiner jüngsten Erfahrungen usw.).

Während der Ausführung der Planung nehmen Generative Agents die Umgebung wahr und die wahrgenommenen Beobachtungen werden in ihrem Gedächtnisstrom gespeichert. Die Forschung nutzt diese Beobachtungen, um Sprachmodelle dazu zu veranlassen, zu entscheiden, ob Agenten ihre aktuellen Pläne fortsetzen oder anders reagieren sollten.

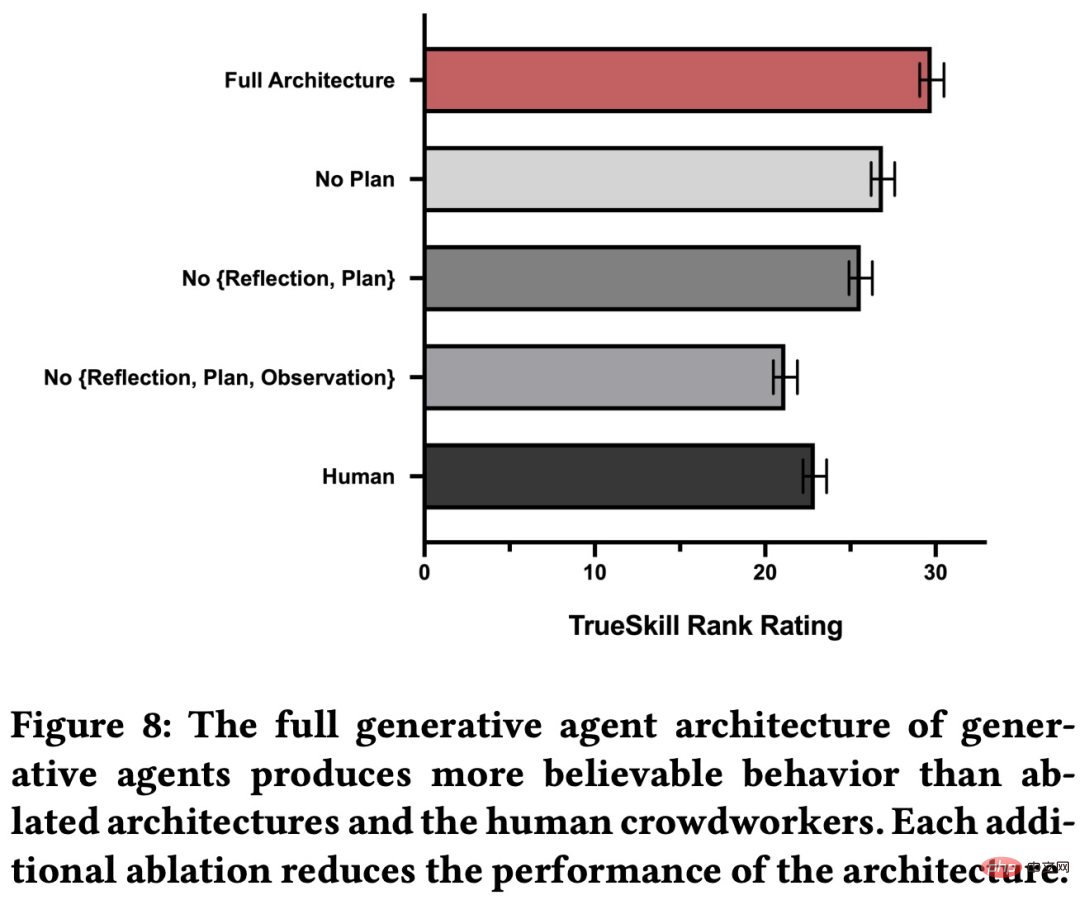

Experiment und Bewertung

Die Studie führte zwei Bewertungen von generativen Agenten durch: Eine ist eine Kontrollbewertung, um zu testen, ob der Agent unabhängig voneinander glaubwürdige individuelle Verhaltensweisen erzeugen kann; die andere ist eine End-to-End-Bewertung, bei der mehrere generative Agenten interagieren während des zweitägigen Spielzeitraums offen, um die Stabilität und das sich abzeichnende soziale Verhalten des Agenten zu verstehen.

Zum Beispiel plant Isabella eine Valentinstagsparty. Sie verbreitet die Informationen und am Ende der Simulation wissen 12 Charaktere davon. Sieben von ihnen waren „unentschlossen“, drei hatten andere Pläne und vier hatten ihre Gedanken nicht geäußert, genau wie Menschen miteinander auskommen.

Auf der technischen Bewertungsebene bewertete diese Forschung die Fähigkeit des Agenten, „Persönlichkeit“, Gedächtnis, Planung, Reaktion und genaue Reflexion durch „Interviews“ des Agenten mit natürlicher Sprache aufrechtzuerhalten, und führte Ablationsexperimente durch. Experimentelle Ergebnisse zeigen, dass jede dieser Komponenten entscheidend für die gute Leistung des Agenten bei der Aufgabe ist.

Bei experimentellen Auswertungen gehören zu den häufigsten Fehlern von Agenten:

- Das Versäumnis, relevante Erinnerungen abzurufen;

- Verfälschung des Agentengedächtnisses;

- „Von Sprachmodellen geerbt“ ” Zu formale Wörter oder Handlungen.

Interessierte Leser können den Originaltext des Artikels lesen, um weitere Forschungsdetails zu erfahren.

Das obige ist der detaillierte Inhalt vonAuf heißem Papier entsteht der Prototyp von „Westworld': 25 KI-Agenten wachsen frei in der virtuellen Stadt heran. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr

Da generative Agenten eine große Anzahl von Ereignissen und Speicherströmen erzeugen, die beibehalten werden müssen, besteht eine zentrale Herausforderung in ihrer Architektur darin, sicherzustellen, dass Agenten bei Bedarf abgerufen und synthetisiert werden Der relevanteste Teil der Erinnerung.

Da generative Agenten eine große Anzahl von Ereignissen und Speicherströmen erzeugen, die beibehalten werden müssen, besteht eine zentrale Herausforderung in ihrer Architektur darin, sicherzustellen, dass Agenten bei Bedarf abgerufen und synthetisiert werden Der relevanteste Teil der Erinnerung.