Heim >Technologie-Peripheriegeräte >KI >Unter Verwendung von CNN als Basismodell erreicht die verformbare Faltung InternImage einen neuen Rekord bei der Erkennung und Segmentierung!

Unter Verwendung von CNN als Basismodell erreicht die verformbare Faltung InternImage einen neuen Rekord bei der Erkennung und Segmentierung!

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-12 08:19:082006Durchsuche

Die boomende Entwicklung großformatiger visueller Transformer in den letzten Jahren hat die Leistungsgrenzen im Bereich Computer Vision verschoben. Vision Transformer-Modelle besiegen Faltungs-Neuronale Netze, indem sie die Anzahl der Modellparameter und Trainingsdaten erweitern. Forscher des Shanghai Artificial Intelligence Laboratory, der Tsinghua University, Nanda, SenseTime und Hong Kong Chinese haben die Lücken zwischen Faltungs-Neuronalen Netzen und visuellen Transformatoren zusammengefasst. Auf Betreiberebene mangelt es herkömmlichen CNNs-Betreibern an Fernabhängigkeiten und adaptiven räumlichen Aggregationsfähigkeiten; auf struktureller Ebene mangelt es traditionellen CNNs-Strukturen an fortschrittlichen Komponenten.

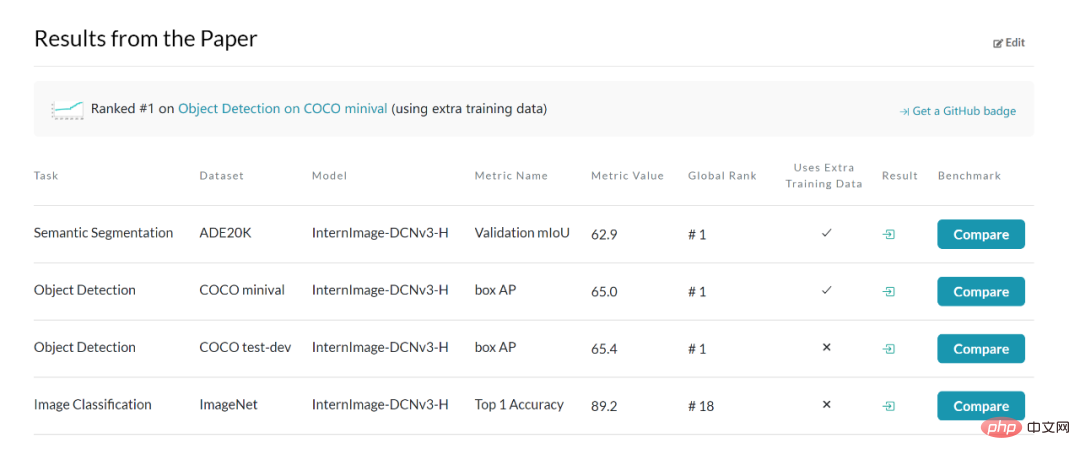

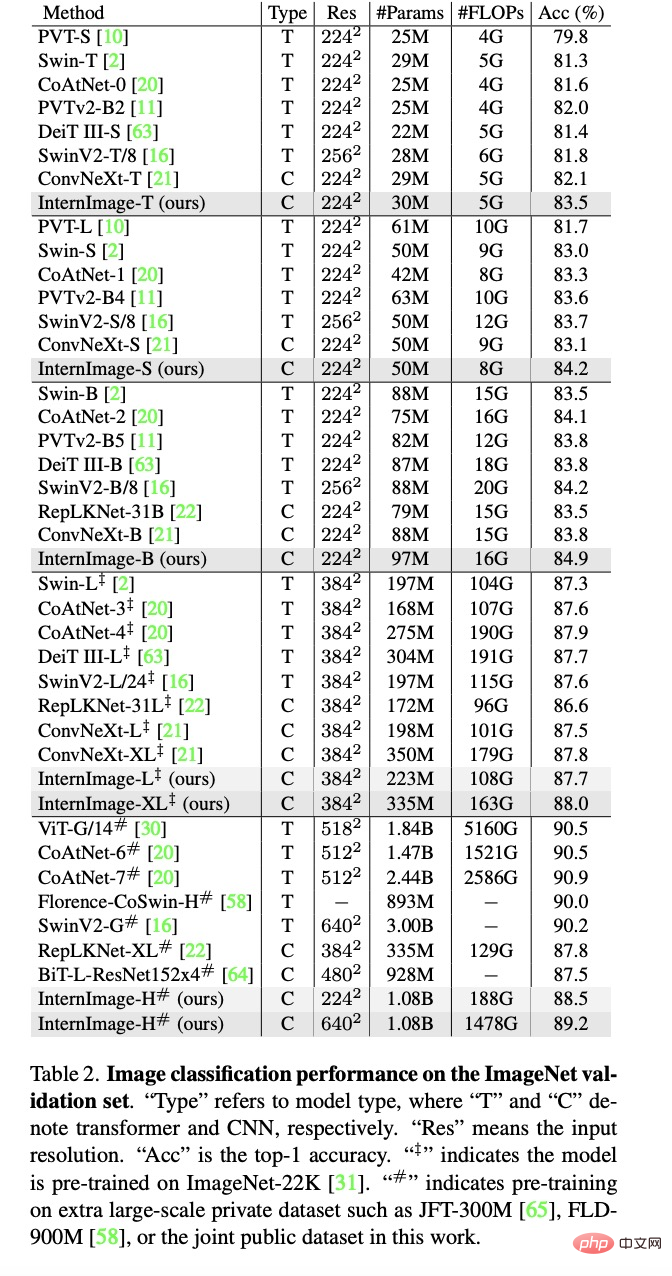

Angesichts der oben genannten technischen Probleme Forscher des Pujiang Laboratory, der Tsinghua-Universität und anderer Institutionen haben auf innovative Weise ein groß angelegtes Modell namens InternImage vorgeschlagen, das auf Faltungs-Neuronalen Netzen basiert und eine spärliche dynamische Faltung als Kernberechnungsuntereinheit verwendet , Erzielen einer adaptiven räumlichen Aggregation durch Eingabe relevanter Informationen als Bedingung. InternImage ermöglicht das Erlernen leistungsfähigerer und robusterer großräumiger Parametermuster aus umfangreichen Daten, indem es den strengen induktiven Bias herkömmlicher CNNs reduziert. Seine Wirksamkeit wurde bei visuellen Aufgaben wie Bildklassifizierung, Objekterkennung und semantischer Segmentierung überprüft. Es hat in anspruchsvollen Benchmark-Datensätzen wie ImageNet, COCO und ADE20K wettbewerbsfähige Ergebnisse erzielt. Auf der gleichen Parameterebene hat es die visuelle Transformer-Struktur übertroffen und eine neue Richtung für große Bildmodelle vorgegeben. ??

- Einschränkungen herkömmlicher Faltungs-Neuronaler NetzeDie Erweiterung des Modellmaßstabs ist eine wichtige Strategie zur Verbesserung der Qualität der Merkmalsdarstellung. Die Erweiterung der Anzahl der Modellparameter kann nicht nur effektiv verbessert werden die Repräsentationslernfähigkeit tiefer Modelle, sondern auch das Lernen und den Wissenserwerb aus massiven Daten. ViT und Swin Transformer haben das Tiefenmodell zum ersten Mal auf 2 Milliarden und 3 Milliarden Parameterebenen erweitert. Die Klassifizierungsgenauigkeit ihrer einzelnen Modelle im ImageNet-Datensatz überstieg ebenfalls 90 % und übertraf damit das traditionelle CNN-Netzwerk und kleine Modelle bei weitem. Durchbrechen des technischen Engpasses. Aufgrund des Mangels an Funktionen zur Modellierung von Fernabhängigkeiten und räumlichen Beziehungen können herkömmliche CNN-Modelle jedoch keine Erweiterungsmöglichkeiten im Modellmaßstab erreichen, die denen der Transformer-Struktur ähneln. Die Forscher fassten die Unterschiede zwischen dem traditionellen Faltungs-Neuronalen Netzwerk und dem visuellen Transformator zusammen:

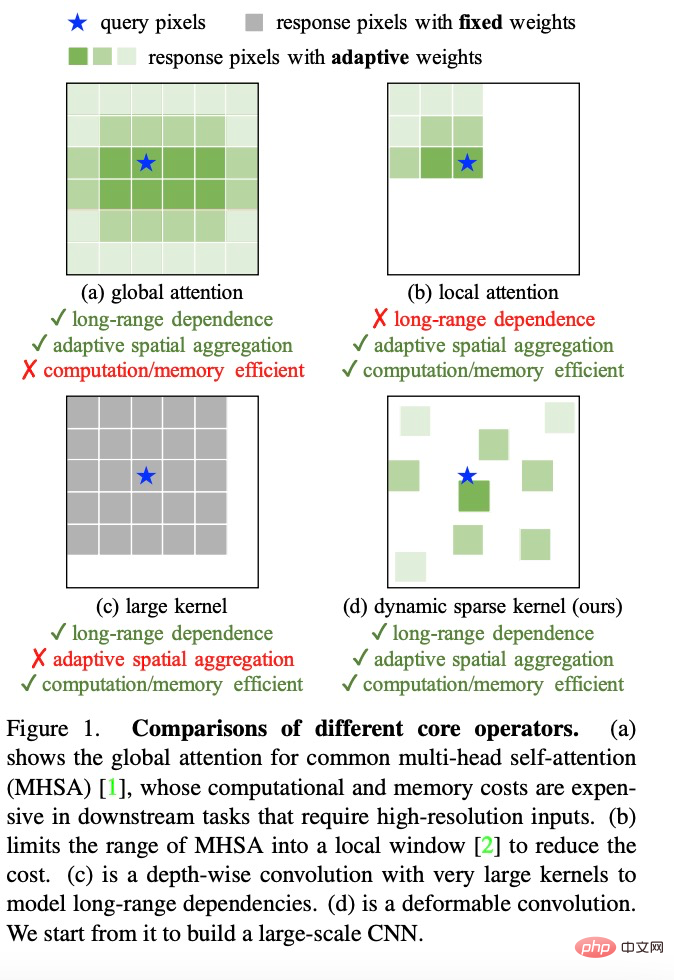

- (1) Auf der Bedienerebene verfügt der Mehrkopf-Aufmerksamkeitsmechanismus des visuellen Transformators über Fernabhängigkeiten und adaptive räumliche Aggregationsfähigkeiten, was davon profitiert Von hier aus kann der visuelle Transformer aus massiven Daten leistungsfähigere und robustere Darstellungen lernen als das CNN-Netzwerk. (2) Aus Sicht der Modellarchitektur verfügt der visuelle Transformer zusätzlich zum Multi-Head-Aufmerksamkeitsmechanismus über fortgeschrittenere Module, die das CNN-Netzwerk nicht hat, wie z. B. Layer Normalization (LN), Feedforward-Neuronales Netzwerk FFN, GELU usw.

InternImage verbessert die Skalierbarkeit von Faltungsmodellen und lindert induktive Verzerrungen durch Neugestaltung von Operatoren und Modellstrukturen, einschließlich (1) DCNv3-Operator, basierend auf DCNv2-Operator Sub-führt gemeinsame Projektionsgewichte ein, Multi- Gruppenmechanismen und Sample-Point-Modulation. (2) Basismodul, das erweiterte Module als Basismoduleinheit für die Modellkonstruktion integriert. (3) Modulstapelregeln, die die Breite, Tiefe, Anzahl der Gruppen und andere Hyperparameter des Modells beim Erweitern des Modells standardisieren.

Diese Arbeit konzentriert sich auf den Aufbau eines CNN-Modells, das effizient auf große Parameter skaliert werden kann. Zunächst wird der verformbare Faltungsoperator DCNv2 neu gestaltet, um ihn an Abhängigkeiten über große Entfernungen anzupassen und die induktive Vorspannung abzuschwächen. Anschließend wird der angepasste Faltungsoperator mit erweiterten Komponenten kombiniert, um schließlich die Stapel- und Skalierungsregeln von Modulen zu erforschen und umzusetzen Der Aufbau eines Basismodells mit umfangreichen Parametern und leistungsstarken Darstellungen kann aus umfangreichen Daten gelernt werden.

Auf Operatorebene fasst diese Studie zunächst die Hauptunterschiede zwischen dem Faltungsoperator und anderen Mainstream-Operatoren zusammen. Die aktuellen Mainstream-Modelle der Transformer-Serie basieren hauptsächlich auf dem Multi-Head-Selbstaufmerksamkeitsmechanismus, um eine große Modellkonstruktion zu erreichen. Seine Operatoren verfügen über Fernabhängigkeiten, die ausreichen, um Verbindungsbeziehungen zwischen Fernmerkmalen aufzubauen, und verfügen auch über eine räumliche adaptive Aggregation Möglichkeiten, eine Beziehung auf Pixelebene zu erreichen. Dieser globale Aufmerksamkeitsmechanismus erfordert jedoch enorme Rechen- und Speicheranforderungen, was es schwierig macht, effizientes Training und schnelle Konvergenz zu erreichen. Ebenso fehlt den lokalen Aufmerksamkeitsmechanismen die Abhängigkeit von Merkmalen über große Entfernungen. Die dichte Faltung mit großem Kern verfügt nicht über die Fähigkeit zur räumlichen Aggregation, daher ist es schwierig, die natürliche induktive Tendenz der Faltung zu überwinden, was der Erweiterung des Modells nicht förderlich ist. Daher entwirft InternImage dynamische Faltungsoperatoren mit geringer Dichte, um globale Aufmerksamkeitseffekte zu erzielen, ohne zu viel Rechen- und Speicherressourcen zu verschwenden und so ein effizientes Training zu erreichen.

Basierend auf dem DCNv2-Operator hat der Forscher den DCNv3-Operator neu entworfen, angepasst und vorgeschlagen. Zu den spezifischen Verbesserungen gehören die folgenden Teile.

(1) Gemeinsames Projektionsgewicht. Ähnlich wie bei der herkömmlichen Faltung haben verschiedene Abtastpunkte in DCNv2 unabhängige Projektionsgewichte, sodass die Parametergröße linear mit der Gesamtzahl der Abtastpunkte zusammenhängt. Um die Parameter- und Speicherkomplexität zu reduzieren, greifen wir auf die Idee der trennbaren Faltung zurück und verwenden ortsunabhängige Gewichte, um die Gruppierungsgewichte zu ersetzen. Die Projektionsgewichte werden zwischen verschiedenen Abtastpunkten geteilt und alle Abhängigkeiten der Abtastposition bleiben erhalten.

(2) Führen Sie mehrere Gruppen von Mechanismen ein. Das Mehrgruppendesign wurde erstmals in der gruppierten Faltung eingeführt und wird häufig in der Multi-Head-Selbstaufmerksamkeit verwendet. Es kann mit adaptiver räumlicher Aggregation kombiniert werden, um die Funktionsvielfalt effektiv zu verbessern. Davon inspiriert teilten die Forscher den räumlichen Aggregationsprozess in mehrere Gruppen ein, und jede Gruppe verfügt über einen unabhängigen Stichprobenversatz. Seitdem weisen verschiedene Gruppen einer einzelnen DCNv3-Schicht unterschiedliche räumliche Aggregationsmuster auf, was zu einer reichen Funktionsvielfalt führt.

(3) Skalare Normalisierung der Abtastpunktmodulation. Um das Instabilitätsproblem bei der Erweiterung der Modellkapazität zu lindern, stellten die Forscher den Normalisierungsmodus für jede Probe auf Softmax-Normalisierung ein. Dadurch wird nicht nur der Trainingsprozess großer Modelle, sondern auch der Konstrukte stabiler ein Modell aller Stichprobenverbindungsbeziehungen.

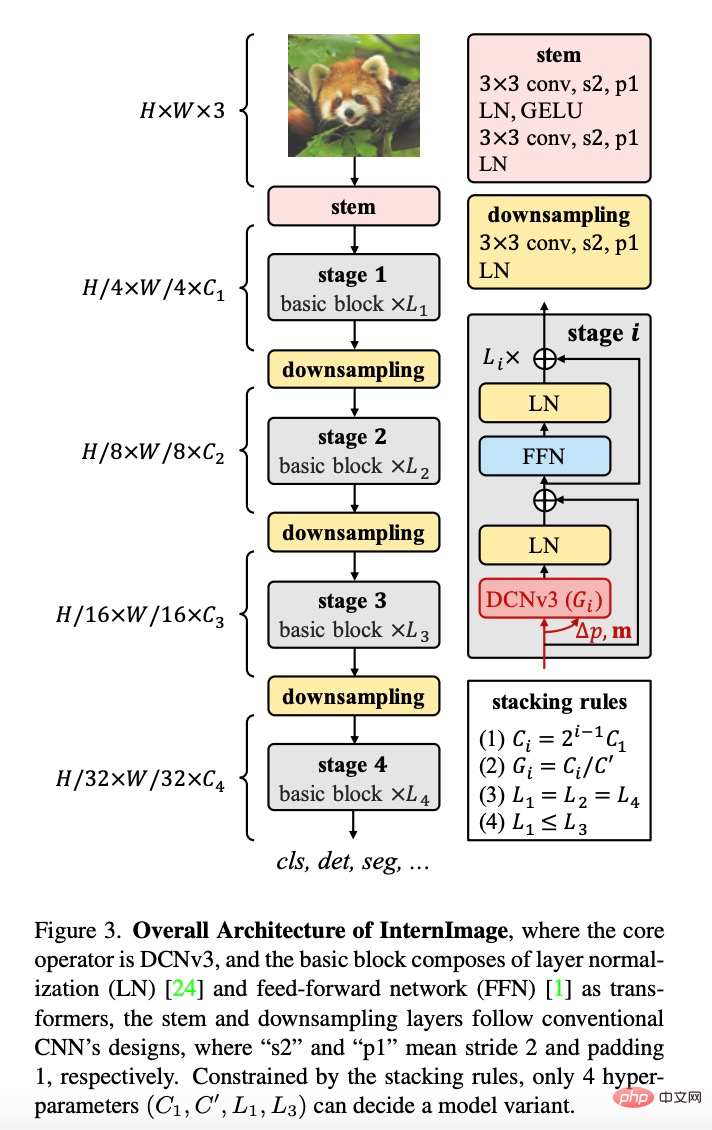

Nach dem Erstellen des DCNv3-Operators besteht der nächste Schritt darin, die Gesamtdetails des Basismoduls und anderer Schichten zu standardisieren Anschließend wird InternImage erstellt, indem die Stapelstrategie dieser Grundmodule untersucht wird. Schließlich werden Modelle mit unterschiedlichen Parametermengen gemäß den Erweiterungsregeln des vorgeschlagenen Modells konstruiert.

Basismodul. Anders als die im herkömmlichen CNN weit verbreitete Engpassstruktur verwendet diese Studie ein Basismodul, das näher an ViTs liegt und mit fortschrittlicheren Komponenten ausgestattet ist, darunter GELU, Layer Normalization (LN) und Feed-Forward-Netzwerk (FFN), die sich bewährt haben effizienter bei einer Vielzahl von Sehaufgaben. Die Details des Basismoduls sind in der Abbildung oben dargestellt, wobei der Kernoperator DCNv3 ist, der den Sampling-Bias und die Modulationsskala vorhersagt, indem er die Eingabemerkmale durch eine leichte trennbare Faltung leitet. Befolgen Sie für andere Komponenten das gleiche Design wie bei einem normalen Transformator.

Stapelregeln. Um den Blockstapelprozess zu verdeutlichen, schlägt diese Studie zwei Modulstapelregeln vor. Die erste Regel ist die Anzahl der Kanäle in den letzten drei Stufen  , die durch die Anzahl der Kanäle in der ersten Stufe

, die durch die Anzahl der Kanäle in der ersten Stufe  bestimmt wird. Das heißt,

bestimmt wird. Das heißt,  Die zweite Regel ist, dass die Gruppennummer jedes Moduls der Anzahl der Kanäle in jeder Stufe entspricht, das heißt,

Die zweite Regel ist, dass die Gruppennummer jedes Moduls der Anzahl der Kanäle in jeder Stufe entspricht, das heißt,  Drittens ist der Stapelmodus auf „AABA“ festgelegt, d. Die Anzahl der Modulstapel in den Stufen 1, 2 und 4 ist gleich

Drittens ist der Stapelmodus auf „AABA“ festgelegt, d. Die Anzahl der Modulstapel in den Stufen 1, 2 und 4 ist gleich und nicht größer als in Stufe 3

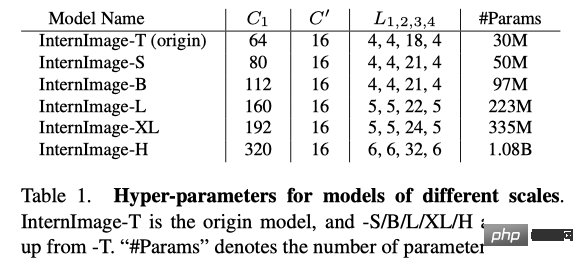

und nicht größer als in Stufe 3  . Als Basis wird daher ein Modell mit einem Parametervolumen von 30M gewählt. Die spezifischen Parameter sind: Die Anzahl der Steam-Ausgangskanäle

. Als Basis wird daher ein Modell mit einem Parametervolumen von 30M gewählt. Die spezifischen Parameter sind: Die Anzahl der Steam-Ausgangskanäle beträgt 64; die Anzahl der Gruppen beträgt 1/16 der Anzahl der Eingangskanäle in jeder Stufe , Stufen 1, 2 und 4. Die Anzahl der Modulstapel

beträgt 64; die Anzahl der Gruppen beträgt 1/16 der Anzahl der Eingangskanäle in jeder Stufe , Stufen 1, 2 und 4. Die Anzahl der Modulstapel  beträgt 4, die Anzahl der Modulstapel

beträgt 4, die Anzahl der Modulstapel  in Stufe 3 beträgt 18 und die Modellparameter betragen 30 Millionen.

in Stufe 3 beträgt 18 und die Modellparameter betragen 30 Millionen.

Modellskalierungsregeln. Basierend auf dem optimalen Modell unter den oben genannten Einschränkungen normalisierte diese Studie zwei Skalierungsdimensionen des Netzwerkmodells: nämlich Tiefe D (Anzahl der Modulstapel) und Breite C (Anzahl der Kanäle) unter Verwendung der Einschränkungsfaktoren  und

und  entlang Der zusammengesetzte Koeffizient

entlang Der zusammengesetzte Koeffizient  skaliert die Tiefe und Breite, also

skaliert die Tiefe und Breite, also  , wobei

, wobei  Experimenten zufolge seine optimale Einstellung

Experimenten zufolge seine optimale Einstellung  ist.

ist.

Dieser Regel folgend konstruierte diese Studie Modelle verschiedener Maßstäbe, nämlich InternImage-T, S, B, L, XL. Die spezifischen Parameter sind:

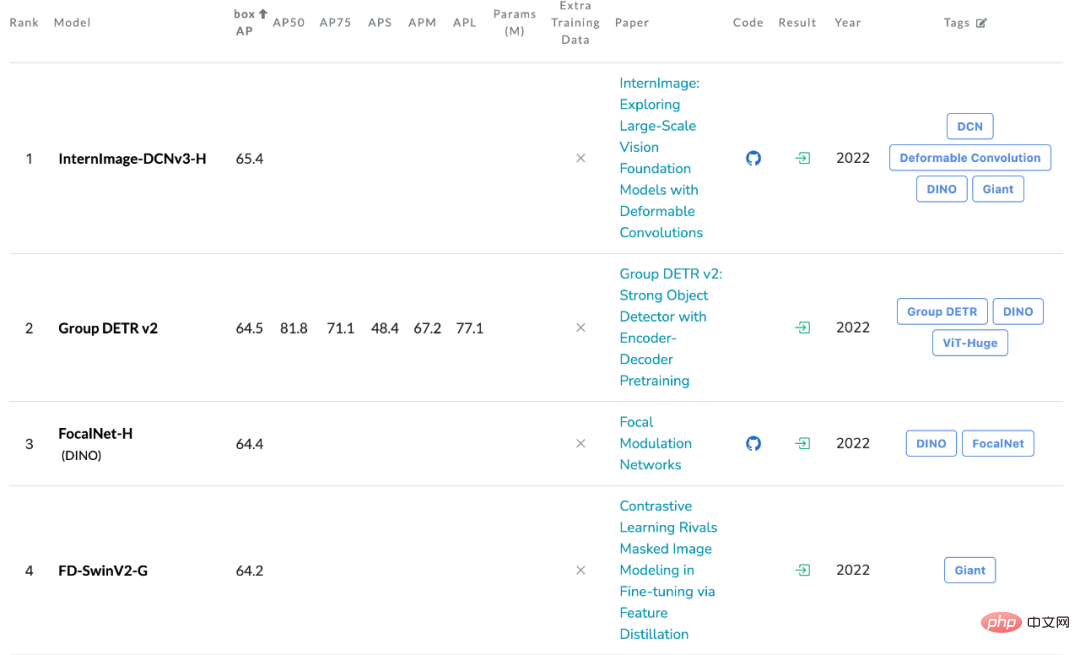

Objekterkennung

: Verwenden Sie das größte InternImage-H als Backbone-Netzwerk und verwenden Sie DINO als grundlegendes Erkennungsframework, trainieren Sie den DINO-Detektor vorab auf dem Objects365-Datensatz und führen Sie ihn dann aus es auf COCO Nehmen Sie Feineinstellungen vor. Das Modell erzielte bei der Zielerkennungsaufgabe ein optimales Ergebnis von 65,4 % und durchbrach damit die Leistungsgrenze der COCO-Zielerkennung. Semantische Segmentierung

FazitDiese Studie schlägt InternImage vor, ein neues groß angelegtes CNN-basiertes Basismodell, das leistungsstarke Darstellungen für vielseitige Sehaufgaben wie Bildklassifizierung, Objekterkennung und semantische Segmentierung bereitstellen kann. Die Forscher passten den flexiblen DCNv2-Operator an die Anforderungen des Basismodells an und entwickelten eine Reihe von Blockierungs-, Stapel- und Skalierungsregeln basierend auf dem Kernoperator. Umfangreiche Experimente zu Objekterkennungs- und semantischen Segmentierungs-Benchmarks haben bestätigt, dass InternImage eine gleichwertige oder bessere Leistung erzielen kann als gut gestaltete, groß angelegte visuelle Transformer, die auf großen Datenmengen trainiert wurden, was darauf hindeutet, dass CNN auch einen erheblichen Schritt im groß angelegten visuellen Basismodell darstellt Forschung wählen. Dennoch befinden sich groß angelegte CNNs noch in einem frühen Entwicklungsstadium, und die Forscher hoffen, dass InternImage als guter Ausgangspunkt dienen kann.

Das obige ist der detaillierte Inhalt vonUnter Verwendung von CNN als Basismodell erreicht die verformbare Faltung InternImage einen neuen Rekord bei der Erkennung und Segmentierung!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr