Heim >Technologie-Peripheriegeräte >KI >Die Zero-Sample-Genauigkeit von ImageNet übersteigt zum ersten Mal 80 % und das stärkste Open-Source-CLIP-Modell der Welt wird aktualisiert

Die Zero-Sample-Genauigkeit von ImageNet übersteigt zum ersten Mal 80 % und das stärkste Open-Source-CLIP-Modell der Welt wird aktualisiert

- 王林nach vorne

- 2023-04-11 23:10:011470Durchsuche

Obwohl ImageNet seine historische Mission längst erfüllt hat, ist es immer noch ein wichtiger Datensatz im Bereich Computer Vision.

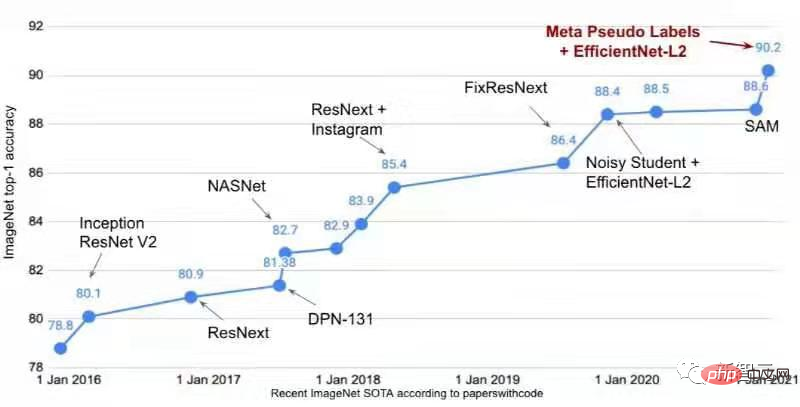

Im Jahr 2016 betrug die Sota-Genauigkeit des auf ImageNet trainierten Klassifizierungsmodells heute noch weniger als 80 %, und nur die Zero-Shot-Generalisierung des groß angelegten vorab trainierten Modells kann eine Genauigkeitsrate von 80,1 % erreichen.

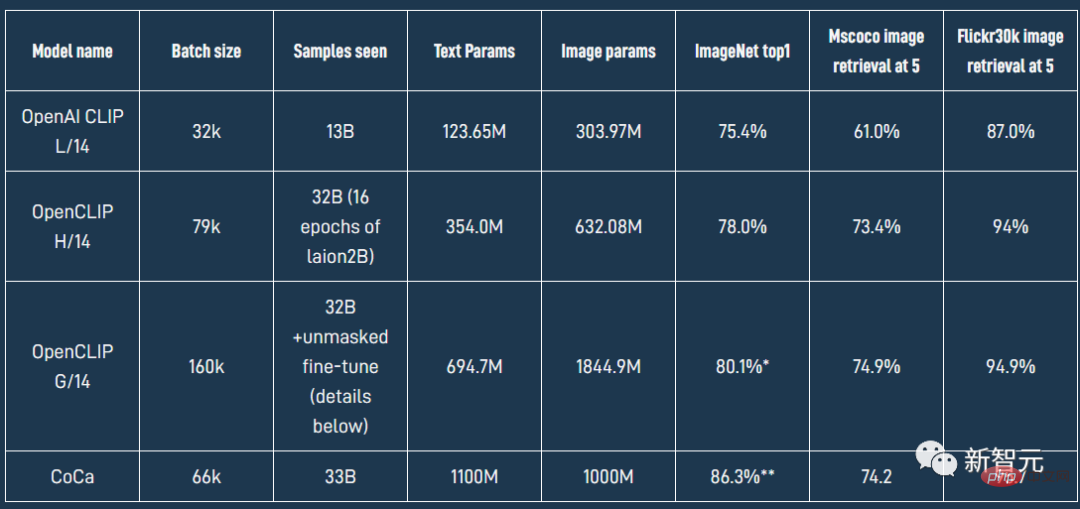

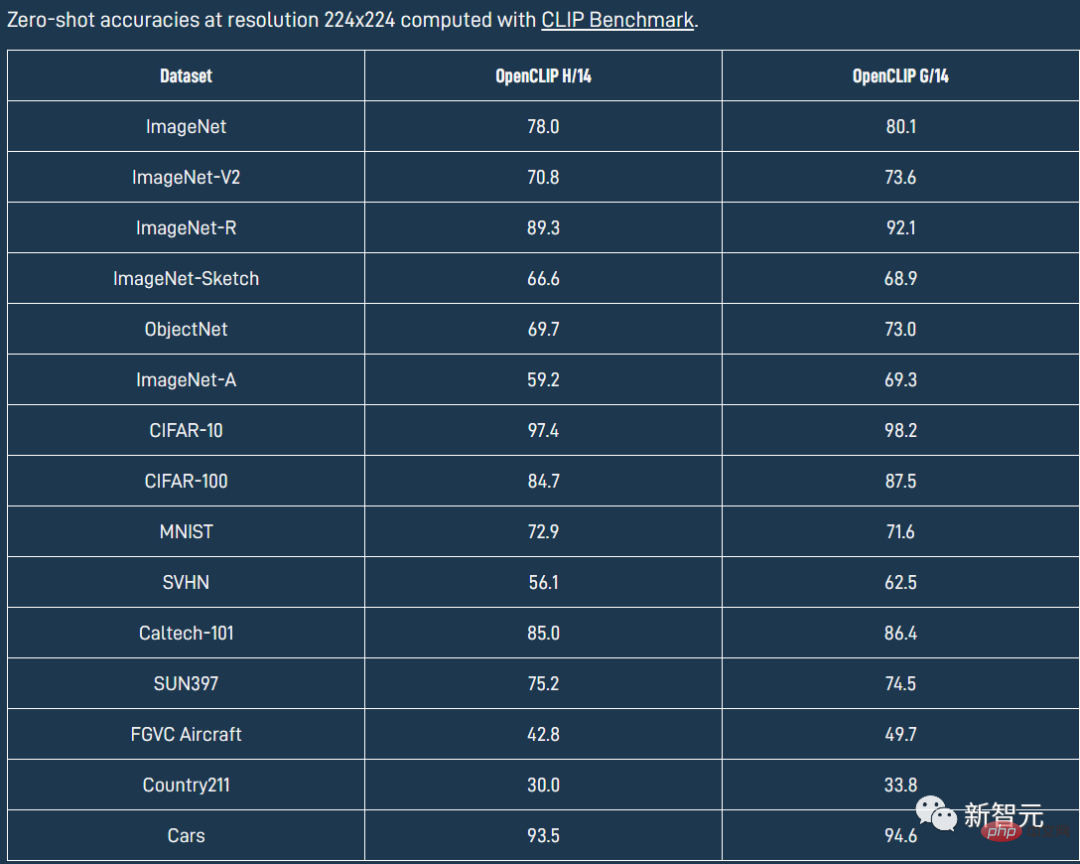

Kürzlich hat LAION das Open-Source-Code-Framework OpenCLIP verwendet, um ein brandneues ViT-G/14 CLIP-Modell zu trainieren. Im ImageNet-Datensatz beträgt die Genauigkeit des ursprünglichen OpenAI CLIP nur 75,4 %. , während OpenCLIP eine Zero-Shot-Genauigkeit von 80,1 % und einen Zero-Shot-Bildabruf von 74,9 % (Recall@5) auf MS COCO erreichte. Dies ist derzeit auch das leistungsstärkste Open-Source-CLIP-Modell.

LAION, was für Large-scale Artificial Intelligence Open Network steht, ist eine gemeinnützige Organisation mit Mitgliedern aus der ganzen Welt, deren Ziel es ist, groß angelegte Modelle, Datensätze und zugehörige Codes für maschinelles Lernen bereitzustellen die Öffentlichkeit. Sie behaupten, wirklich Open AI zu sein, 100 % gemeinnützig und 100 % kostenlos.

LAION, was für Large-scale Artificial Intelligence Open Network steht, ist eine gemeinnützige Organisation mit Mitgliedern aus der ganzen Welt, deren Ziel es ist, groß angelegte Modelle, Datensätze und zugehörige Codes für maschinelles Lernen bereitzustellen die Öffentlichkeit. Sie behaupten, wirklich Open AI zu sein, 100 % gemeinnützig und 100 % kostenlos.

Interessierte Freunde können ihr CLIP-Modell aktualisieren!

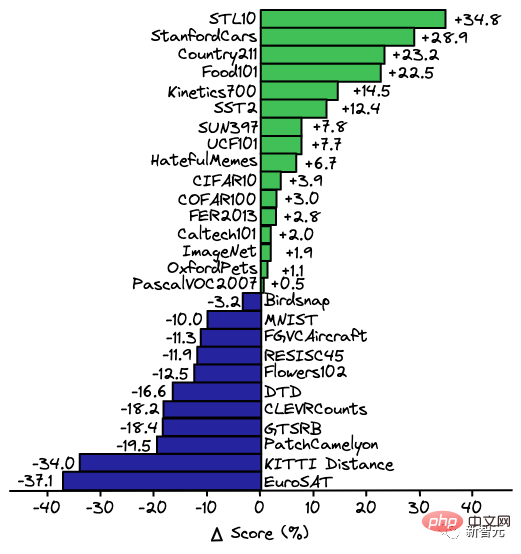

Das OpenCLIP-Modell ist für jeden Datensatz spezifisch. Leistung ist in der folgenden Tabelle dargestellt.

Zero-Shot-Fähigkeit

Zero-Shot-Fähigkeit

Im Allgemeinen basiert die Sota-Leistung von Computer Vision (CV)-Modellen bei verschiedenen Aufgaben auf Trainingsdaten in einem bestimmten Bereich und kann nicht auf andere Bereiche oder Aufgaben übertragen werden. Dies führt zu einem eingeschränkten Verständnis der allgemeinen Eigenschaften der visuellen Welt.

Das Generalisierungsproblem ist besonders wichtig in Bereichen, in denen große Mengen an Trainingsdaten fehlen.

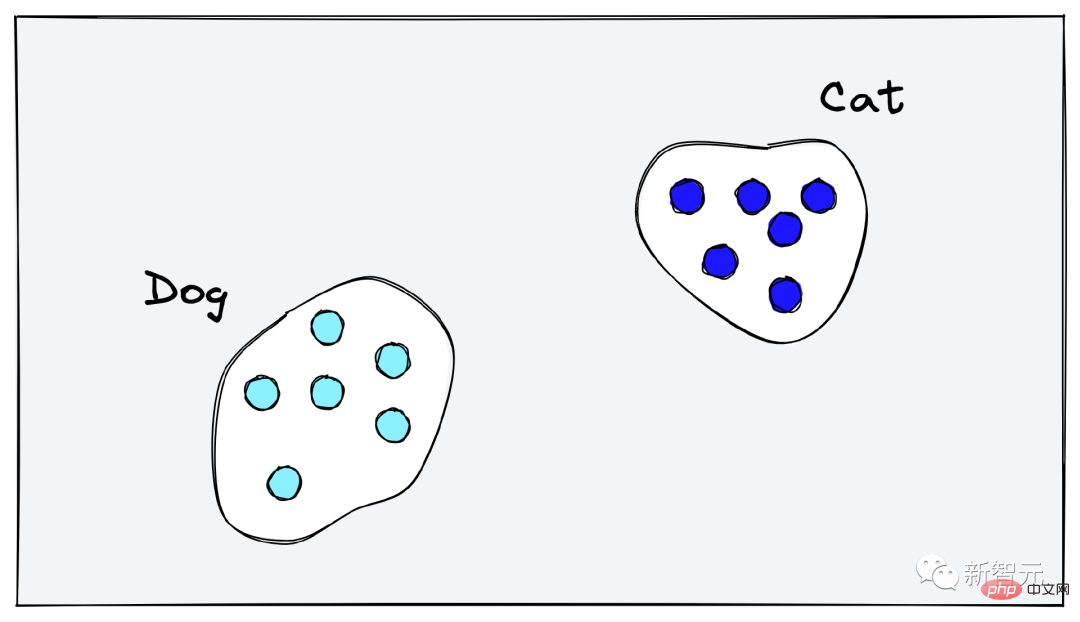

Idealerweise sollte das CV-Modell den semantischen Inhalt des Bildes lernen, anstatt sich zu sehr auf bestimmte Bezeichnungen im Trainingssatz zu konzentrieren. Bei einem Bild eines Hundes sollte das Modell beispielsweise in der Lage sein, zu verstehen, dass sich auf dem Bild ein Hund befindet, und darüber hinaus zu verstehen, dass sich im Hintergrund Bäume befinden, dass es tagsüber ist, dass der Hund im Gras ist usw .

Aber die aktuellen Ergebnisse, die durch die Verwendung des „Klassifizierungstrainings“ erzielt werden, sind genau das Gegenteil von den Erwartungen. Das Modell lernt, die interne Darstellung von Hunden in denselben „Hundevektorraum“ und die Katzen in denselben „Katzenvektorraum“ zu verschieben Leerzeichen". Alle Die Antwort auf die Frage ist immer binär, d. h. ob das Bild an einer Klassenbezeichnung ausgerichtet werden kann.

Glücklicherweise ist das CLIP-Modell von OpenAI ein sehr flexibles Klassifizierungsmodell und kann in der Regel ohne Umschulung in neuen Klassifizierungsaufgaben verwendet werden.

Warum CLIP Zero-Shot kann

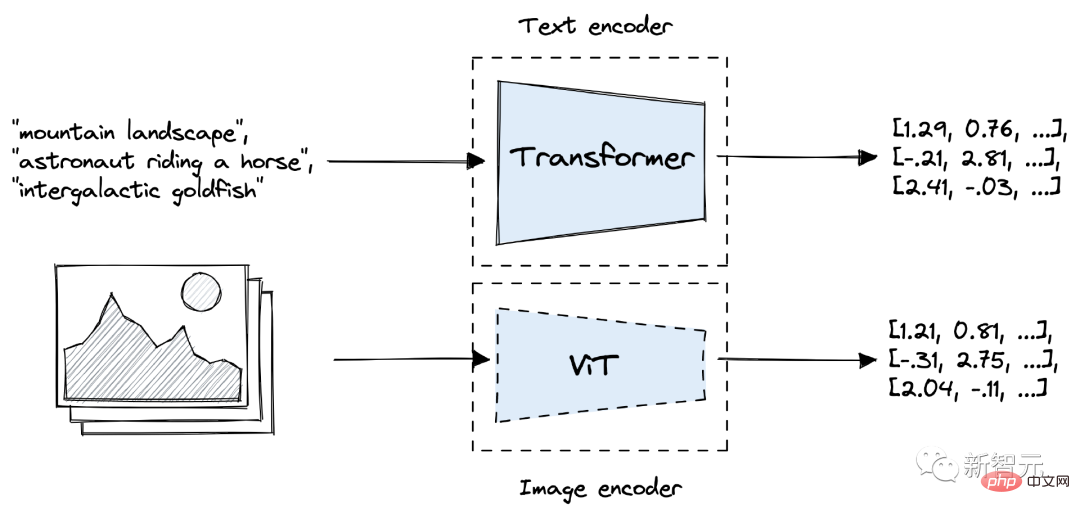

Contrastive Language-Image Pretraining (CLIP, Contrastive Language-Image Pretraining) ist ein 2021 von OpenAI veröffentlichtes Modell, das hauptsächlich auf Transformer basiert. CLIP besteht aus zwei Modellen, einem Transformer-Encoder zum Konvertieren von Text in Einbettungen und einem Visual Transformer (ViT) zum Codieren von Bildern.

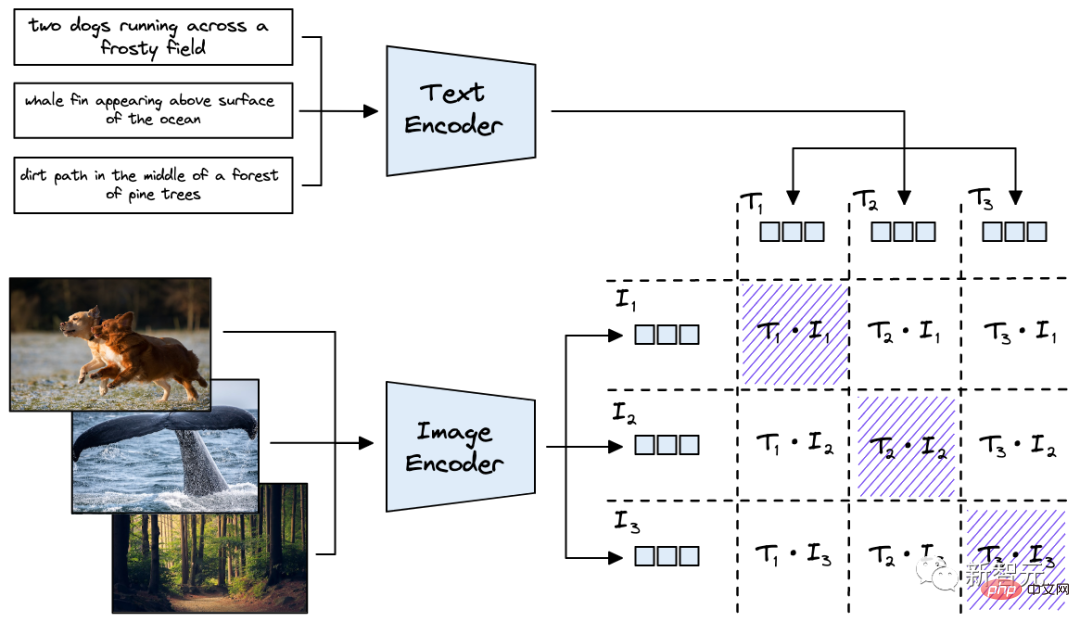

Sowohl Text- als auch Bildmodelle in CLIP werden während des Vortrainings optimiert, um ähnliche Texte und Bilder im Vektorraum auszurichten. Während des Trainingsprozesses werden Bild-Text-Paare in den Daten im Vektorraum näher zusammengeschoben, während Bild- und Textvektoren, die nicht zu einem Paar gehören, getrennt werden.

Es gibt mehrere Unterschiede zwischen CLIP- und allgemeinen Klassifizierungsmodellen:

Erstens wird OpenAI mithilfe eines sehr großen Datensatzes trainiert, der 400 Millionen aus dem Internet gecrawlte Text-Bild-Paare enthält. Die Vorteile sind:

1. Das Training von CLIP erfordert nur „Bild-Text-Paare“ und keine spezifischen Klassenbezeichnungen, und diese Art von Daten ist in der heutigen, auf soziale Medien ausgerichteten Online-Welt sehr häufig.

2. Große Datensätze bedeuten, dass CLIP in der Lage ist, gängige Textkonzepte in Bildern zu verstehen.

3. Der Textdeskriptor enthält häufig verschiedene Merkmale im Bild, nicht nur ein Kategoriemerkmal, was bedeutet, dass eine umfassendere Bild- und Textdarstellung erstellt werden kann.

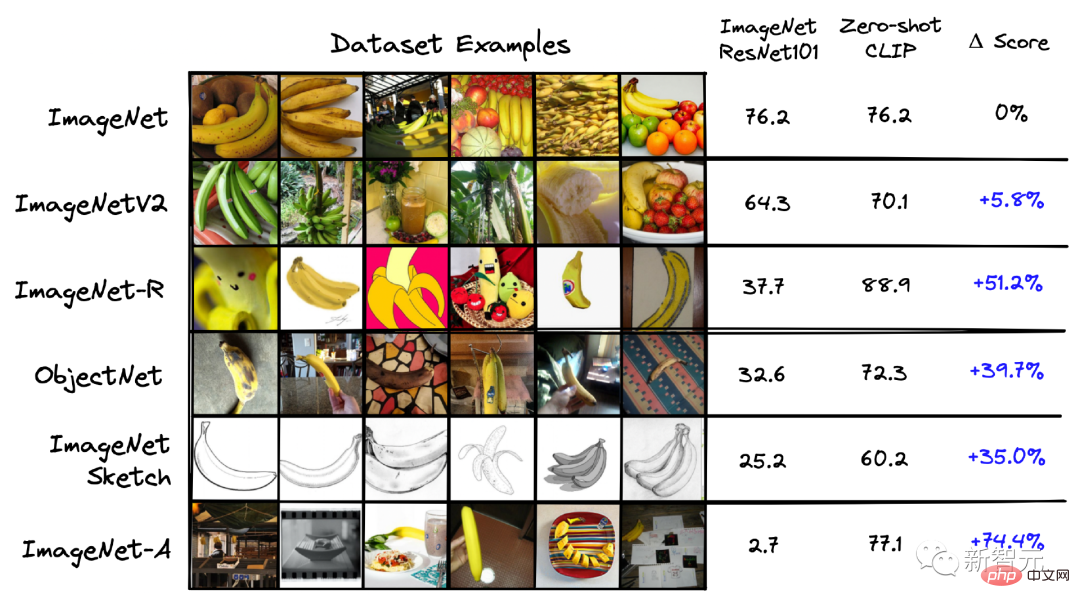

Die oben genannten Vorteile sind auch ein Schlüsselfaktor für die Fähigkeit von CLIP, Zero-Shot zu etablieren. Der Autor des Papiers verglich auch das speziell auf ImageNet trainierte ResNet-101-Modell und wendete es auf andere von ImageNet abgeleitete Datensätze an. wie unten gezeigt Zum Leistungsvergleich.

Es ist ersichtlich, dass ResNet-101 zwar auf ImageNet trainiert wird, seine Leistung bei ähnlichen Datensätzen jedoch viel schlechter ist als die Leistung von CLIP bei derselben Aufgabe.

Bei der Anwendung des ResNet-Modells auf andere Felder ist eine gängige Methode die „lineare Sonde“, d. Tuning.

Im CLIP-Artikel wird die lineare Erkennung ResNet-50 mit Zero-Shot CLIP verglichen. Die Schlussfolgerung ist, dass Zero-Shot CLIP bei mehreren Aufgaben eine bessere Leistung erbringt als ResNet-50.

Es ist jedoch erwähnenswert, dass Zero-Shot bei mehreren Trainingsbeispielen die lineare Erkennung nicht übertrifft.

Zero-Shot-Klassifizierung mit CLIP

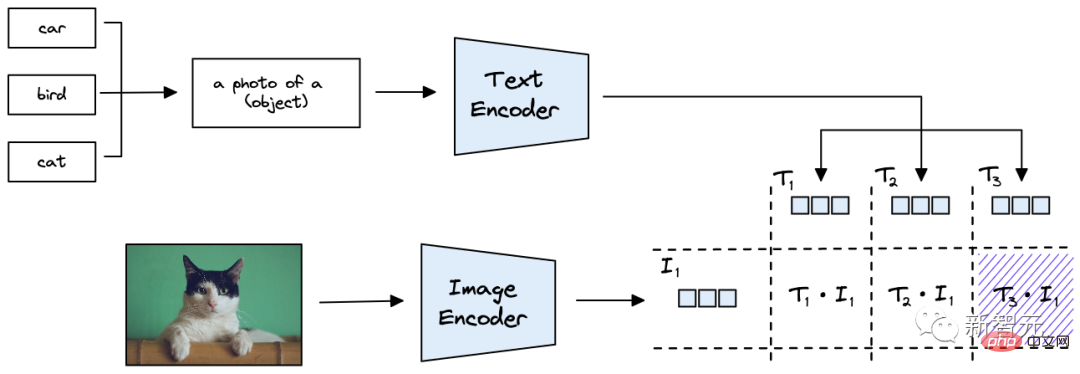

Wie Sie der obigen Beschreibung entnehmen können, kann der Bild- und Textencoder einen 512-dimensionalen Vektor erstellen, um das Eingabebild und die Texteingabe demselben Vektorraum zuzuordnen.

Die Verwendung von CLIP für die Zero-Shot-Klassifizierung bedeutet, Kategorieinformationen in Textsätze einzufügen.

Wenn Sie beispielsweise ein Bild eingeben und feststellen möchten, ob es sich bei der Kategorie um ein Auto, einen Vogel oder eine Katze handelt, können Sie drei Textzeichenfolgen zur Darstellung der Kategorien erstellen:

T1 steht für ein Auto: ein Foto von einem Auto

T2 steht für einen Vogel: ein Foto eines Vogels

T3 steht für eine Katze: ein Foto einer Katze

Geben Sie die Kategoriebeschreibung in den Text-Encoder ein und Sie erhalten einen Vektor, der die Kategorie darstellen kann.

Angenommen, die Eingabe ist ein Foto einer Katze. Berechnen Sie nach Erhalt des Bildvektors den Kosinusabstand zwischen ihm und dem Kategorievektor als größte Ähnlichkeit bedeutet, dass die Kategorie des Bildes zur Katze gehört.

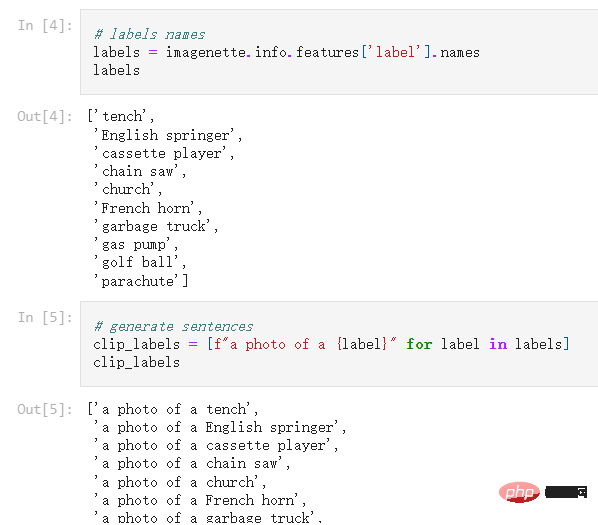

Wie Sie sehen können, ist die Kategoriebezeichnung kein einfaches Wort, sondern wird basierend auf dem Format der Vorlage „ein Foto einer {Beschriftung}“ in einen Satz umgeschrieben, der erweitert werden kann ohne Training Eingeschränkte Klassenvorhersage.

Im Experiment verbesserte die Verwendung dieser Eingabeaufforderungsvorlage die Klassifizierungsgenauigkeit von ImageNet um 1,3 Prozentpunkte. Bei der tatsächlichen Verwendung muss sie jedoch anhand verschiedener Datensätze getestet werden.

Python-Implementierung

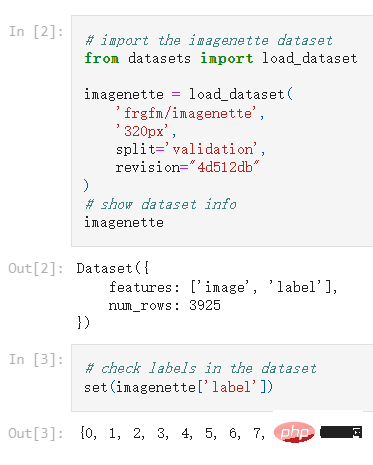

Es ist auch sehr einfach, CLIP für die Zero-Shot-Klassifizierung zu verwenden. Der Autor hat den frgfm/imagenette-Datensatz in Hugging Face als Demonstration ausgewählt. Der Datensatz enthält 10 Beschriftungen und alle werden als Ganzzahl gespeichert Werte.

Die Verwendung von CLIP zur Klassifizierung erfordert die Konvertierung von Ganzzahlwertbeschriftungen in entsprechenden Textinhalt.

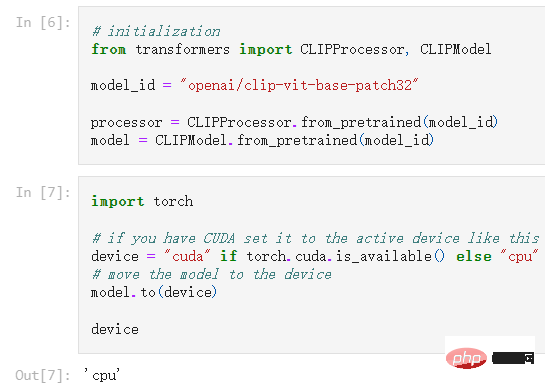

Bevor Sie die Ähnlichkeit zwischen Tags und Fotos direkt berechnen, müssen Sie das CLIP-Modell initialisieren, das mit dem CLIP implementiert werden kann, das über Hugging Face-Transformatoren gefunden wird.

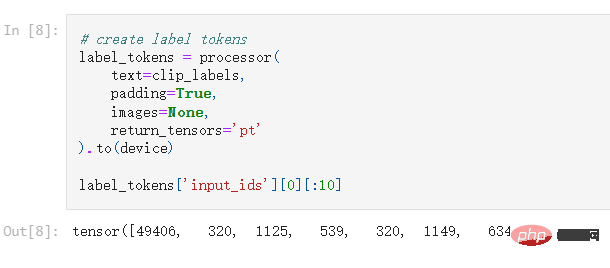

Der Texttransformator kann Text nicht direkt lesen, erfordert jedoch einen Satz ganzzahliger Werte, sogenannte Token-IDs (oder Eingabe_IDs), wobei jede eindeutige Ganzzahl ein Wort oder Unterwort (d. h. Token) darstellt.

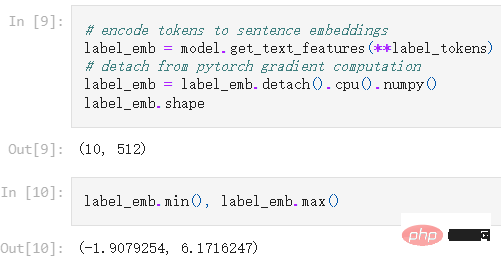

Geben Sie den konvertierten Tensor in den Texttransformator ein, um die Texteinbettung des Etiketts zu erhalten.

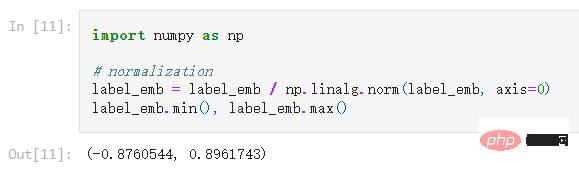

Beachten Sie, dass der von CLIP ausgegebene Vektor noch nicht normalisiert wurde und die nach der Punktmultiplikation erhaltene Ähnlichkeit ist. Die Ergebnisse sind ungenau.

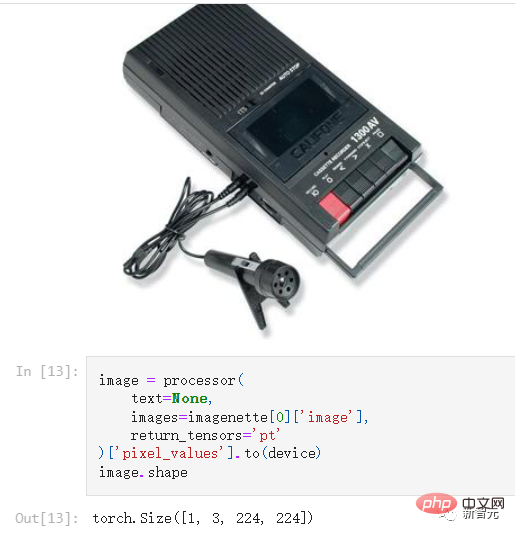

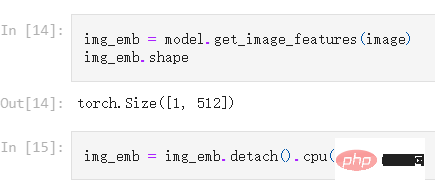

Jetzt können Sie ein Bild im Datensatz zum Testen auswählen und nach dem gleichen Verarbeitungsprozess den Bildvektor erhalten.

Nachdem Sie das Bild in einen Vektor mit den Abmessungen (1, 3, 224, 224) konvertiert haben, geben Sie es in das Modell ein, um die Einbettung zu erhalten

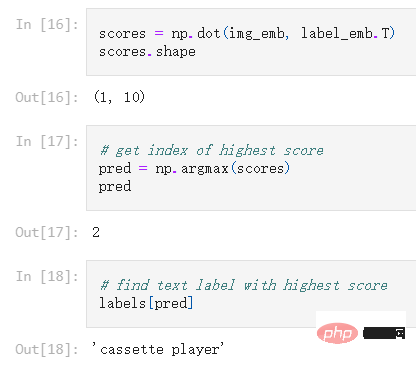

Der nächste Schritt besteht darin, die Bildeinbettung zu berechnen und Die Zehn im Datensatz Die Skalarproduktähnlichkeit zwischen Etikettentexteinbettungen, diejenige mit der höchsten Punktzahl ist die vorhergesagte Kategorie.

Das vom Modell angegebene Ergebnis ist ein Kassettenrekorder. Nachdem wir den gesamten Datensatz wiederholt ausgeführt haben, können wir eine Genauigkeit von 98,7 % erhalten , multimodaler Suche, Zielerkennung und generativen Modellen wie Dall-E und Stable von OpenAI eröffnet CLIP eine neue Tür zur Computer Vision.

Das obige ist der detaillierte Inhalt vonDie Zero-Sample-Genauigkeit von ImageNet übersteigt zum ersten Mal 80 % und das stärkste Open-Source-CLIP-Modell der Welt wird aktualisiert. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr