Heim >Technologie-Peripheriegeräte >KI >Die „aktualisierte Version' von OPT-IML, Metas großem Modell mit Hunderten Milliarden Parametern, ist da und das vollständige Modell und der Code werden veröffentlicht!

Die „aktualisierte Version' von OPT-IML, Metas großem Modell mit Hunderten Milliarden Parametern, ist da und das vollständige Modell und der Code werden veröffentlicht!

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-11 22:31:091643Durchsuche

Im Mai dieses Jahres kündigte MetaAI offiziell die Veröffentlichung des ultragroßen Modells OPT-175B an, das auf 175 Milliarden Parametern basiert und allen Communities kostenlos zur Verfügung steht.

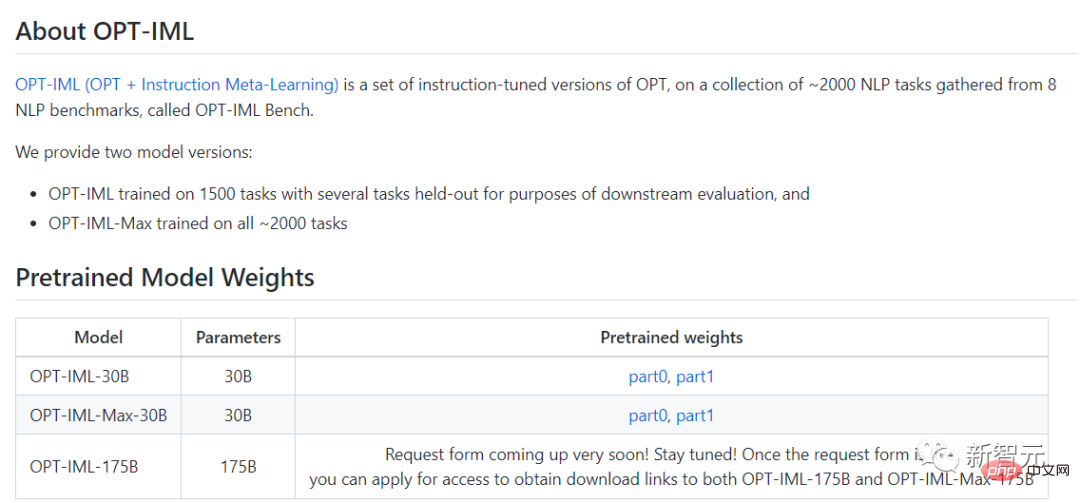

Am 22. Dezember wurde eine aktualisierte Version des Modells, OPT-IML (Open Pre-trained Transformer), offiziell eingeführt. Meta sagte, es sei „getestet worden“. 2.000 Sprachaufgaben mit 175 Milliarden Parametern werden auch für nichtkommerzielle Forschungszwecke frei verfügbar sein.

Werfen wir einen Blick auf die Leistung dieses aktualisierten OPT-IML.

Dieses Mal hat OPT-IML zwei Modellgrößen erstellt, 30B und 175B.

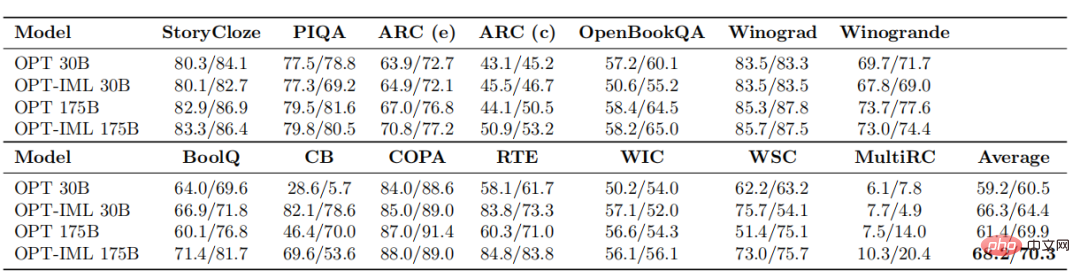

Im Vergleich zum alten OPT-Modell übertraf OPT-IML OPT im Durchschnitt bei 14 Standard-NLP-Bewertungsaufgaben.

Die beiden Modellgrößen sind bei der Null-Schuss-Lernaufgabe um 7 % besser und bei der 32-Schuss-Aufgabe um 4 % bzw. 0,4 % besser.

In dieser Studie beschreiben Forscher, wie sich eine zunehmende Modell- und Benchmarkgröße auf die Auswirkungen von Entscheidungen zur Befehlsoptimierung auf die Leistung nachgelagerter Aufgaben auswirkt.

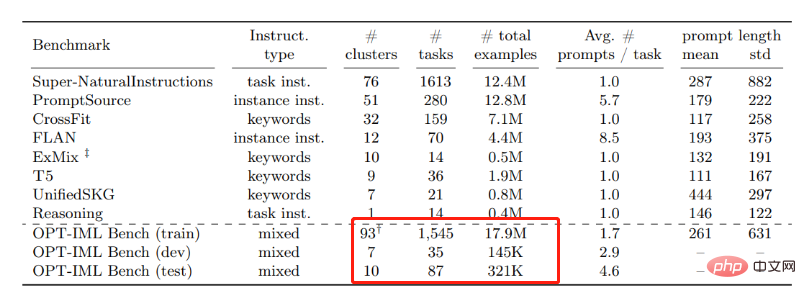

Zu diesem Zweck entwickelten sie OPT-IML Bench, einen ziemlich großen Instructional Meta-Learning (IML)-Benchmark mit 2000 NLP-Aufgaben, die auf aktuellen acht Benchmarks basieren in Aufgabenkategorien unterteilt.

Um OPT-IML 30B und 175B zu trainieren, wandten die Forscher zunächst OPT-IML aus der Perspektive des Frameworks an Es werden Einblicke in Entscheidungen zur Befehlsoptimierung für 30B bereitgestellt.

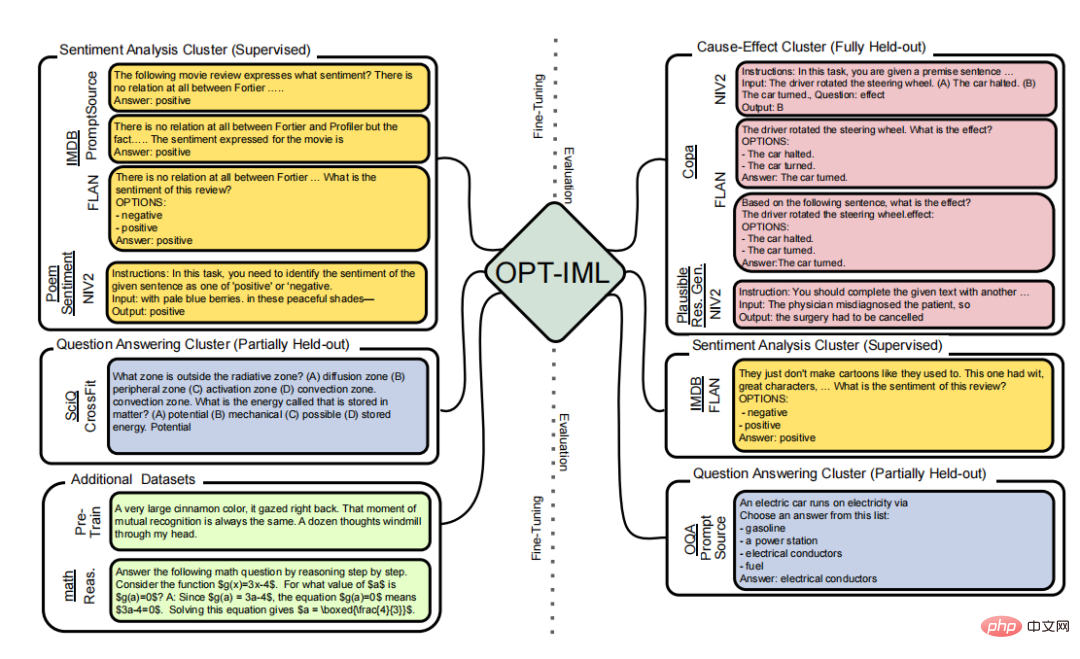

OPT-IML wird auf zwei Skalen anhand von vier Bewertungsbenchmarks (PromptSource, FLAN, Super-NaturalInstructions und UnifiedSKG) mit unterschiedlichen Zielen und Eingabeformaten für alle drei Generalisierungsfähigkeiten demonstriert.

Es übertrifft nicht nur OPT in allen Benchmarks deutlich, sondern übertrifft auch bestehende, für diesen spezifischen Benchmark optimierte Modelle auf sehr wettbewerbsfähige Weise.

Darüber hinaus ist OPT-IML Open Source und der Github-Link ist auch unten gepostet~

#🎜 🎜## 🎜🎜#

Github-Link: https://github.com/facebookresearch/metaseq/tree/main/projects/OPT-IML #🎜🎜 # Lassen Sie uns als Nächstes anhand des Artikels mehr über OPT-IML erfahren.

Forschungsmethode

Die instruktive Feinabstimmung großer Sprachmodelle ist geworden a Eine effektive Methode für die Fähigkeit zur Null-Schuss- und Wenig-Schuss-Generalisierung. In dieser Studie haben Meta-Forscher drei wichtige Ergänzungen zur Feinabstimmung des Unterrichts vorgenommen.

Zuerst stellten sie einen groß angelegten Benchmark zur Feinabstimmung von Anweisungen zusammen, der 2.000 NLP-Aufgaben aus einer Sammlung von acht Datensätzen enthielt, kategorisiert nach Aufgabentyp.

Forscher erstellten selektiv Bewertungssplits für diesen Benchmark, um drei verschiedene Arten von Modellverallgemeinerungsfähigkeiten zu testen:

Beinhaltet Aufgaben aus vollständig zurückgehaltenen Kategorien, zurückgehaltene Aufgaben aus gesehenen Typen und zurückgehaltene Instanzen aus gesehenen Aufgaben.

Feinabstimmung von Anweisungen

Die Feinabstimmung von Modellen, um sie mit Compliance-Anweisungen in Einklang zu bringen, ist eine der aktuellen Forschungsrichtungen im maschinellen Lernen.

Es gibt zwei Methoden zur Befehlsfeinabstimmung. Das eine konzentriert sich auf die Feinabstimmung von Modellen für eine Vielzahl von Aufgaben mithilfe von von Menschen kommentierten Anweisungen und Feedback. Das andere konzentriert sich auf das Hinzufügen von Anweisungen über Anmerkungen oder automatisch zu öffentlich zugänglichen Benchmarks und Datensätzen.

In dieser Studie konzentrierten sich Meta AI-Mitglieder auf die zweite Technik und stellten eine Reihe öffentlich zugänglicher Datensätze zusammen, die Methoden zur Verbesserung von OPT enthalten.

Während der Forschung schlugen Meta-Mitglieder eine ähnliche Skalierungsmethode unter Verwendung von 1836 Aufgaben aus vier Benchmarks vor. Während die Forscher schließlich den gesamten Test optimieren, um die Leistungsgrenzen anspruchsvoller externer Benchmarks wie MMLU und Big-Bench Hard (BBH) zu überschreiten, beschreiben sie die Gewichtungen verschiedener Strategien zur Befehlsoptimierung, die sich auf die nachgelagerte Leistung auswirken können.

Multi-Task-Lernen

Multi-Task-Lernen ist ein Ausdruck der anweisungsbasierten Feinabstimmung (MTL).

MTL ist ein beliebtes Paradigma, das die Generalisierungsleistung einer Aufgabe verbessern kann, wenn es mit ähnlichen Funktionen kombiniert wird, die vergleichbare Parameter oder Darstellungen teilen.

In den letzten Jahren wurde MTL auf zahlreiche NLP-Szenarien angewendet, wobei der Schwerpunkt hauptsächlich auf der Verbesserung der Leistung von Trainingsaufgaben oder neuen Domänen durch die Nutzung von Signalen relevanter Aktivitäten lag.

Im Gegensatz dazu hilft uns die anweisungsbasierte Feinabstimmung dabei, die Generalisierungsleistung bei noch nie dagewesenen Problemen zu verbessern. Dies geschieht durch die Anweisung, alle Aufgaben zu einem Konzept zusammenzufassen und sie gemeinsam zu trainieren, indem allen Aufgaben die Gewichtungen des Modells zugewiesen werden.

Was ist OPT?

Groß angelegte Sprachmodelle, Systeme zur Verarbeitung natürlicher Sprache mit über 100 Milliarden Parametern, haben die NLP- und KI-Forschung in den letzten Jahren verändert.

Diese Modelle wurden anhand einer Vielzahl unterschiedlicher Texte trainiert und haben überraschende neue Fähigkeiten unter Beweis gestellt, um kreative Texte zu generieren, grundlegende mathematische Probleme zu lösen, Fragen zum Leseverständnis zu beantworten und vieles mehr.

Während die Öffentlichkeit in einigen Fällen über kostenpflichtige APIs mit diesen Modellen interagieren kann, ist der vollständige Zugang zur Forschung immer noch auf eine Handvoll gut ausgestatteter Labore beschränkt.

Dieser eingeschränkte Zugriff schränkt die Fähigkeit der Forscher ein, zu verstehen, wie und warum diese großen Sprachmodelle funktionieren, und behindert den Fortschritt bei der Verbesserung ihrer Robustheit und der Abschwächung bekannter Probleme wie Voreingenommenheit.

Im Rahmen seines Engagements für offene Wissenschaft veröffentlichte Meta AI im Mai dieses Jahres Open Pretrained Transformer (OPT-175B), ein Modell mit 175 Milliarden Parametern, die auf öffentlichen Datensätzen trainiert wurden. Durch die Weitergabe dieses Modells hofft Meta AI, dies zu erreichen breitere Gemeinschaft beim Verständnis grundlegender Techniken rund um große Modelle.

Einfach ausgedrückt: Meta eröffnet der Öffentlichkeit den Zugang zu groß angelegten Sprachmodellen, die für die Forschung im Bereich der künstlichen Intelligenz verwendet werden, und demokratisiert so die künstliche Intelligenz für die Forschung im großen Maßstab.

Vergleich mit der alten Version

Laut der jetzt von Meta veröffentlichten IML-Version wurde sie verfeinert und schneidet bei Aufgaben in natürlicher Sprache besser ab als die alte Version von OPT.

Zu den typischen Sprachaufgaben gehören das Beantworten von Fragen, das Zusammenfassen von Texten und das Übersetzen.

Zur Feinabstimmung verwendeten die Forscher etwa 2.000 Aufgaben in natürlicher Sprache. Die Aufgaben sind in acht NLP-Benchmarks (OPT-IML Bench) unterteilt, die ebenfalls von den Forschern bereitgestellt werden.

Am Beispiel der 30B- und 175B-Modelle verbessert OPT-IML die Zero-Shot-Lerngenauigkeit im Vergleich zu OPT um etwa 6–7 %. In 32 Epochen zeigte das Modell mit 30 Milliarden Parametern eine deutliche Verbesserung der Genauigkeit und das Modell mit 175 Milliarden Parametern zeigte eine leichte Verbesserung.

Nach dem Vergleich stellte das Meta-Team fest, dass die Leistung von OPT-IML bei allen Benchmarks besser ist als die von OPT und in Bezug auf Zero-Shot und Fence-Shot wettbewerbsfähiger als andere auf Befehlsfeinabstimmung basierende Modelle ist Lerngenauigkeit.

Das obige ist der detaillierte Inhalt vonDie „aktualisierte Version' von OPT-IML, Metas großem Modell mit Hunderten Milliarden Parametern, ist da und das vollständige Modell und der Code werden veröffentlicht!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr