Heim >Technologie-Peripheriegeräte >KI >ChatGPT rast den ganzen Weg, wo sind unsere Sicherheitsgurte?

ChatGPT rast den ganzen Weg, wo sind unsere Sicherheitsgurte?

- WBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBOYWBnach vorne

- 2023-04-11 21:37:011544Durchsuche

Seit seiner Veröffentlichung am 30. November letzten Jahres hat sich ChatGPT von OpenAI in nur drei Monaten in verschiedenen sozialen Bereichen durchgesetzt: Normale Leute nutzen es als Suchmaschine; Code schreiben.

Aber besorgniserregend ist, dass Schüler es auch für Hausaufgaben verwenden. Eine vor einiger Zeit durchgeführte Umfrage ergab, dass fast 90 % der Studenten in den Vereinigten Staaten ChatGPT bereits zum Schreiben von Hausaufgaben verwenden, und eine von ChatGPT erstellte Arbeit belegte sogar den ersten Platz in der Klasse. Für Schullehrer kommt dieser Wandel zu plötzlich. Bevor Gegenmaßnahmen ergriffen wurden, entschieden sich einige Schulen direkt für ein Verbot.

Einige Unternehmen haben ChatGPT ebenfalls verboten, darunter Wall-Street-Finanzinstitute wie Citigroup, Goldman Sachs und JPMorgan Chase, weil sie befürchten, dass Mitarbeiter bei der Nutzung von ChatGPT vertrauliche Unternehmensinformationen preisgeben.

Diese hektischen Reaktionen spiegeln ein Problem wider: Unsere Gesellschaft ist noch nicht bereit für die Einführung von KI-generierten Modellen wie ChatGPT, und Diskussionen zu verwandten Themen müssen auf die Tagesordnung gesetzt werden. Vielleicht ist dies der Grund, warum die kürzlich abgehaltene Global Artificial Intelligence Developer Pioneer Conference „Youzhizhi: AI Safety and Ethical Insights Theme Forum“ voller Sitzplätze war.

Obwohl das Thema der Konferenz „Sicherheit und ethische Erkenntnisse“ lautet, beschränkte sich der Umfang der Diskussion der Gäste nicht darauf, sondern fügte mehrere Diskussionsdimensionen hinzu, von KI-Generierungsmodellen wie z als ChatGPT zu Grundlagen Von den Auswirkungen der Forschung über ihre Anwendungsfragen bis hin zu den Ideen der Talentausbildung in der neuen Ära wurden ausführliche Diskussionen aus allen Blickwinkeln geführt. In diesem Forum versucht jeder, die Antwort auf eine Frage zu finden: Wie sollen wir in der angebrochenen AIGC-Ära reagieren?

Welche Inspirationen und Herausforderungen bringt ChatGPT in den Bereich der wissenschaftlichen Forschung?

Im Januar dieses Jahres wurde der Turing-Award-Gewinner Yann LeCun aufgrund seiner harten Bewertung von ChatGPT auf die Hot-Search-Liste gesetzt. Seiner Ansicht nach „hat ChatGPT keine besondere Innovation“ und kann auch nicht „etwas Revolutionäres“ sein.

„Ob ChatGPT revolutionär ist“ ist ein kontroverses Thema. Aber es besteht kein Zweifel daran, dass es sich tatsächlich um ein Meisterwerk der Ingenieurskunst handelt. Vor Ort wies auch E Weinan, ein Akademiker der Chinesischen Akademie der Wissenschaften, auf diesen Punkt hin.

Er betonte auch, dass dieses Meisterwerk das Ergebnis der schrittweisen Überprüfung und konzentrierten Investition von OpenAI sei. Unter ihnen ist „konzentrierte Investitionen“ sehr wichtig. Denn der Erfolg von OpenAI zeigt, dass die bisherige „kleine Werkstatt, projektbasierte“ KI-Empowerment-Methode Geschichte wird und „KI-Engineering und Plattformisierung“ zu einer wichtigen Unterstützung für die Freisetzung der Dividenden der Technologie der künstlichen Intelligenz werden. Wenn es gelingt, sich an diesen Wandel anzupassen, wird erwartet, dass sich der Erfolg der KI im Bereich der natürlichen Sprache auch im Bereich der wissenschaftlichen Grundlagenforschung wiederholt. Dies ist auch die Arbeit, an der sich Akademiker E Weinan im Bereich KI für die Wissenschaft beteiligt.

Natürlich ist diese Arbeit nicht einfach und erfordert, dass wir uns auf den Aufbau einer Plattforminfrastruktur für die wissenschaftliche Grundlagenforschung konzentrieren, einschließlich Daten, grundlegender Softwaretools, Computerplattformen, intelligenter wissenschaftlicher Forschungsplattformen usw. In den letzten Jahren hat Akademiker E das Team zu einigen Arbeiten in diesem Bereich geführt und wichtige Ergebnisse veröffentlicht, wie zum Beispiel das Pre-Training-Modell der interatomaren potentiellen Energiefunktion.

Allerdings steht ihre Arbeit immer noch vor vielen Herausforderungen, wie zum Beispiel, dass die gesammelten Datenformate unterschiedlich und verrauscht sind, der Software ein grundlegendes Testsystem fehlt, die Computerinfrastruktur nicht mithalten kann usw. Nach Ansicht von Akademiker E ist dies die „Dunkelheit vor der Morgendämmerung“. Nur wenn wir es wagen, Ressourcen in originelle Innovationsrichtungen zu bündeln, können wir die Morgendämmerung einläuten.

Neben den Naturwissenschaften hat die Entstehung von ChatGPT auch Forscher im Bereich der Sozialwissenschaften inspiriert. In diesem Zusammenhang hat Wu Guanjun, Dekan der Fakultät für Politik und Internationale Beziehungen an der East China Normal University, sehr wertvolle Ideen beigesteuert.

Dekan Wu wies darauf hin, dass sozialwissenschaftliche Forscher vor ChatGPT ein gewisses Krisengefühl haben sollten. Erstens steckt dahinter eine riesige Datenmenge, die Anthropologen mit herkömmlichen Feldstudien möglicherweise nicht sammeln können, und es können große Datenmengen in kurzer Zeit verarbeitet werden. Zweitens „liest“ es eine große Anzahl von Büchern, die ein Mensch im Laufe seines Lebens möglicherweise nicht durchlesen kann.

„Wir stehen vor einer (technologischen) Singularität, aber viele unserer Wissenschaftler sind sich dessen nicht bewusst“, sagte Wu Guanjun.

Die technologische Singularität bezieht sich hier auf eine auf der Geschichte der technologischen Entwicklung zusammengefasste Ansicht, die davon ausgeht, dass in der Zukunft ein unvermeidliches Ereignis eintreten wird: Die technologische Entwicklung wird großartig sein In sehr kurzer Zeit findet ein nahezu unendlicher Fortschritt statt. Bis dahin verlieren alle uns bekannten Kenntnisse, Werte und Regeln ihre Gültigkeit.

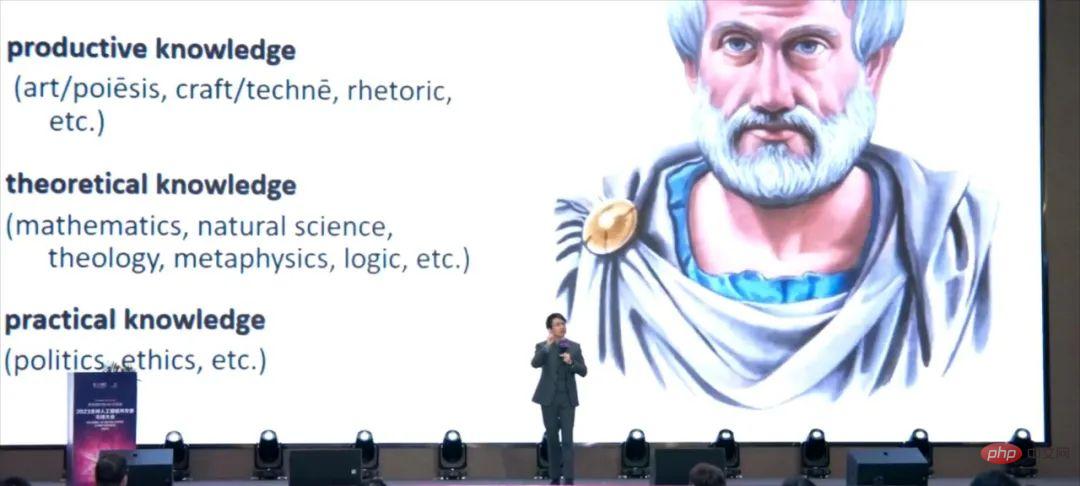

Daher forderte er Sozialwissenschaftler auf, mit anderen Wissenschaftlern zusammenzuarbeiten, um die Forschung im Zeitalter der technologischen Singularität voranzutreiben. Diese Art der Forschung konzentriert sich auf „praktisches Wissen“ (wie Ethik und Politik) in der Wissensklassifikation des Aristoteles, da die KI in den beiden anderen Arten von Wissen (produktives Wissen und theoretisches Wissen) begonnen hat zu lernen und sogar besser zu lernen als Menschen. In Bereichen des praktischen Wissens wie der Politik kann KI nur nacherzählen und keine neue Welt erschaffen. Daher glaubt Dekan Wu, dass die Menschheit auf diesem Gebiet großes Potenzial haben wird.

AIGC-Markt steht kurz vor der Explosion, wie sollte sich die Anwendungsseite darauf vorbereiten?

Vor ein paar Tagen veröffentlichte OpenAI die ChatGPT-API inmitten lang erwarteter Aufrufe, und der Preis ist sehr günstig, da eine Million Token für nur 2 US-Dollar generiert wurden. Für die Anwendungsseite sind das durchaus aufregende Neuigkeiten. Gleichzeitig beschleunigt sich auch die Forschung und Entwicklung inländischer ChatGPT-ähnlicher Produkte, und in diesem Monat werden neue Produkte veröffentlicht. Es ist absehbar, dass im nächsten Jahr die Zahl der vom AIGC-Modell unterstützten Anwendungen im In- und Ausland explodieren wird.

Aber gleichzeitig scheinen unsere Investitionen in die Anwendungsseite nicht mitzuhalten. Das ist Deloitte China Chairman Jiang Ying #🎜🎜 #Beobachtetes Phänomen.

Insbesondere stellte sie fest, dass die Entwicklung der künstlichen Intelligenz in meinem Land ein Ungleichgewicht bei den Investitionen auf der Angebots- und Anwendungsnachfrageseite in Forschung und Entwicklung aufweist. Dieses Ungleichgewicht äußert sich in drei Aspekten.

Zunächst einmal bestehen viele aktuelle Entscheidungsorganisationen in Bezug auf die Rollen hauptsächlich aus wissenschaftlichen Forschungseinrichtungen und Technologieunternehmen und der Beteiligung relevanter Parteien an der Anwendung Szenarien wie Branchenverbände sind relativ unzureichend. Deshalb glaubt Jiang Ying, dass wir ein Mehrparteienbündnis gründen müssen, um die Rolle der transformierenden nachfrageseitigen Kräfte bei der Entwicklung künstlicher Intelligenz weiter zu stärken.

Zweitens wurde in Bezug auf die Entwicklung die Verbesserung der Entwicklung künstlicher Intelligenz durch technologische Innovation ausführlich erwähnt und erhielt viel Unterstützung, aber die Kraft der Modellinnovation schon nicht vollständig bewertet. Daher schlug Jiang Ying vor, dass wir die praktische Anwendung innovativer Geschäftsmodelle der künstlichen Intelligenz fördern und die Forschung in diesem Bereich verstärken sollten.

Was schließlich die Talentausbildung angeht, verfügen viele Universitäten inzwischen über Hauptfächer im Bereich der künstlichen Intelligenz, aber die meisten dieser Hauptfächer beschränken sich auf die Förderung naturwissenschaftlicher und technischer Kenntnisse und Fähigkeiten, was dazu führt, dass es einen relativen Mangel an Talenten mit wechselseitigem Wissen in Technologie und Managementanwendungen gibt. Sie müssen wissen, dass es in tatsächlichen Anwendungsszenarien nicht ausreicht, KI nur zur Erledigung der Arbeit einer bestimmten Produktionslinie einzusetzen. Die gesamte Prozess- und Managementstruktur muss transformiert werden Diesen Bedarf zu decken, ist derzeit sehr rar. #🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜##in den App Auf der Ebene von Tian Feng

, Präsident des SenseTime Intelligent Industry Research Institute und Vizepräsident des Shanghai Artificial Intelligence Research Institute, teilte ebenfalls seine Ansichten, aber er ist mehr besorgt über Es gibt verschiedene Risiken, die im Anwendungsprozess von KI bestehen, einschließlich Modellrisiken, Datenrisiken usw.

Konkret befürwortet Tian Feng den Einsatz von Technologie und Managementtools, um die Fähigkeiten der Unternehmens-KI-Ethik-Governance zu verbessern. In den letzten Jahren hat SenseTime eine Reihe von Toolboxen für die Steuerung ethischer KI-Risiken entwickelt, darunter digitale Wasserzeichen, Datendesensibilisierung, Datensandbox, Modellphysik-Untersuchungsplattform usw., die Design, Entwicklung, Bereitstellung und Einführung des gesamten Produktlebenszyklus abdecken .

Alle Schüler nutzen ChatGPT. Was sollten Lehrer tun?

Auf dem Forum wurde Vizepräsident der Shanghai University Wang Xiaofan eine Frage gestellt: Wird die Shanghai University Studenten die Nutzung von ChatGPT verbieten? Als Antwort antwortete Rektor Wang: Ich befürworte kein Verbot.

Aus seiner Sicht hat das Aufkommen von KI-Tools wie ChatGPT auch seine positiven Seiten.

In der Unterrichtspraxis kann es den Schülern sofortiges Feedback geben und ihnen helfen, schneller Fortschritte zu machen, so wie AlphaGo menschlichen Schachspielern hilft. Denken Sie daran, dass wir vor 30 Jahren noch Dokumente einzeln in der Bibliothek überprüften; vor 20 Jahren begannen wir, Dokumente schnell online zu durchsuchen, und heute kann ChatGPT uns bereits dabei helfen, Dokumente in Abstracts oder Rezensionen zu organisieren. Dies verbessert zweifellos die Effizienz unseres Lernwissens erheblich.

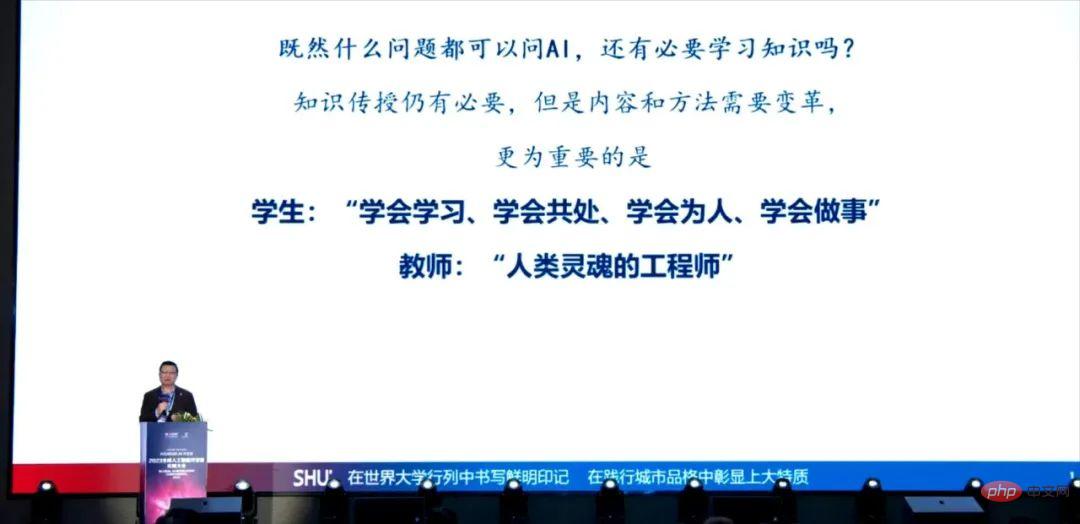

In Bezug auf Lehrinhalte und -methoden wird es Lehrkräfte zum Nachdenken zwingen: Welches Wissen soll unsere Ausbildung vermitteln? Wie können wir Tools wie ChatGPT nutzen, um das „Lehren“ und „Lernen“ in unserer Hochschulbildung effizienter zu gestalten? Nach dieser Phase des Nachdenkens und Wandels könnte die Hochschulbildung ihrem Wesen näher kommen. Wie Einstein sagte: „Der Wert einer Hochschulausbildung besteht nicht darin, sich viele Fakten zu merken, sondern darin, das Gehirn zum Denken zu trainieren … Die oberste Priorität sollte immer die Entwicklung der allgemeinen Fähigkeit zum unabhängigen Denken und Urteilen sein und nicht der Erwerb.“ des Wissens „spezifisches Wissen“.

Natürlich sind die Probleme, die ChatGPT für die Hochschulbildung mit sich bringt, unvermeidbar. In diesem Zusammenhang schlug Präsident Wang drei Aufgaben vor, die erledigt werden müssen: Erstens müssen Regeln befolgt werden, das heißt, Leitprinzipien für den Einsatz von AIGC in Lehre und Forschung zu formulieren und sicherzustellen, dass Schüler und Lehrer diese verstehen und befolgen können Richtlinien; zweitens Fair Use, das heißt, die angemessene Nutzung von AIGC in Lehre, Lernen und Forschung zu unterstützen, aber wirksame Maßnahmen zu ergreifen, um akademisches Fehlverhalten wie Plagiate zu verbieten; drittens, Lehrdemonstration, das heißt, Lehrer spielen eine Vorbildfunktion Lehr- und Forschungsprozess und die Nutzung von Fair-Use-Technologien der künstlichen Intelligenz wie AIGC werden in die Lehre akademischer Integritäts- und Ethikkurse integriert.

Die Entwicklung der künstlichen Intelligenz kann nicht dem alten Weg des Automobils folgen

Neben dem wunderbaren Austausch der Gäste brachte dieses Forum auch zwei wichtige Ergebnisse hervor.

Das erste Ergebnis ist, dass die Kernexperten der Arbeitsgruppe „Information Technology Artificial Intelligence System Life Cycle Governance Guidelines“ des Shanghai Standards Ernennungsschreiben erhalten haben. Dieser Leitfaden beginnt mit dem konzeptionellen Entwurf des KI-Algorithmusmodells und durchläuft den gesamten Lebenszyklus von Entwicklung, Tests und Evaluierung, Bereitstellung, Betriebsüberwachung und Stilllegung und bietet Leitlinien für die Steuerung von Systemen der künstlichen Intelligenz. Dies ist der erste lokale Standard des Landes zur Steuerung künstlicher Intelligenzsysteme. Er zielt darauf ab, die Entwicklung mit Standardregeln zu fördern, das Endergebnis von Sicherheit und Ethik durch technische Mittel und Regulierungsmaßnahmen aufrechtzuerhalten und sicherzustellen, dass Technologien wie AIGC ihre soziale und soziale Wirkung voll entfalten können wirtschaftlichen Wert und ihre tatsächlichen Ergebnisse begründen die „Shanghai-Erfahrung“ bei der Entwicklung künstlicher Intelligenz.

Die Veröffentlichung und Unterzeichnung des zweiten Ergebnisses „2023 Shanghai Artificial Intelligence Safety Ethics Initiative“. Der „Vorschlag“ orientiert sich an den „Shanghai-Vorschriften zur Förderung der Entwicklung der Industrie für künstliche Intelligenz“ und befürwortet, dass sich Entwickler künstlicher Intelligenz dem Licht zuwenden, und stellt sicher, dass sich die Industrie für künstliche Intelligenz in Richtung Fairness und Gerechtigkeit, Inhaltssicherheit und Datenschutz bewegt Schutz, Vernetzung und gemeinsamer Aufbau und Austausch. Die Richtung der Regierungsführung schreitet weiter voran und entwickelt sich nach oben. Vertreter der Shanghai Artificial Intelligence Industry Association, der Shanghai Young and Middle-aged Intellectuals Association, der Shanghai Lingang Group, der East China Branch der Academy of Information and Communications Technology und des Municipal Software Development Center unterzeichneten gemeinsam den „Vorschlag“.

Warum müssen Sie diese beiden Dinge tun? In seiner Rede erwähnte Präsident Wang eine Kleinigkeit: Das Automobil wurde Ende des 19. Jahrhunderts erfunden, aber erst in der zweiten Hälfte des 20. Jahrhunderts führten verschiedene Länder Vorschriften ein, die das Anlegen von Sicherheitsgurten während der Fahrt vorschrieben. Es ist denkbar, wie viele Menschen umsonst gestorben sein müssen.

Wenn man genau darüber nachdenkt, sind wir tatsächlich ein bisschen wie die Menschen, die im 19. Jahrhundert gerade erst mit Autos in Kontakt kamen: Die aufkommende AIGC beschleunigt sich, aber es gibt keine Vorschriften, die die Fahrer einschränken, und Es besteht keine Sicherheit für Autofahrer. Der Gurt kann angelegt werden. Diese Probleme sind dringend.

„Die heutige Entwicklung der künstlichen Intelligenz kann offensichtlich nicht mit dem Weg der Autos mithalten“, sagte Rektor Wang ernst. Ausgehend vom Forum beschreiten alle gesellschaftlichen Parteien einen neuen Weg, damit wir den Beginn der AIGC-Ära gelassen meistern können.

Das obige ist der detaillierte Inhalt vonChatGPT rast den ganzen Weg, wo sind unsere Sicherheitsgurte?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

In Verbindung stehende Artikel

Mehr sehen- Technologietrends, die Sie im Jahr 2023 im Auge behalten sollten

- Wie künstliche Intelligenz Rechenzentrumsteams neue Alltagsaufgaben beschert

- Können künstliche Intelligenz oder Automatisierung das Problem der geringen Energieeffizienz in Gebäuden lösen?

- OpenAI-Mitbegründer im Interview mit Huang Renxun: Die Argumentationsfähigkeiten von GPT-4 haben noch nicht die Erwartungen erfüllt

- Dank der OpenAI-Technologie übertrifft Bing von Microsoft Google im Suchverkehr